Este post foi co-escrito por Jyoti Sharma e Sharmo Sarkar da Vericast.

Para qualquer problema de aprendizado de máquina (ML), o cientista de dados começa trabalhando com dados. Isso inclui coletar, explorar e entender os aspectos comerciais e técnicos dos dados, juntamente com a avaliação de quaisquer manipulações que possam ser necessárias para o processo de construção do modelo. Um aspecto dessa preparação de dados é a engenharia de recursos.

Engenharia de recursos refere-se ao processo em que as variáveis relevantes são identificadas, selecionadas e manipuladas para transformar os dados brutos em formas mais úteis e utilizáveis para uso com o algoritmo de ML usado para treinar um modelo e realizar inferência nele. O objetivo desse processo é aumentar o desempenho do algoritmo e do modelo preditivo resultante. O processo de engenharia de recursos envolve vários estágios, incluindo criação de recursos, transformação de dados, extração de recursos e seleção de recursos.

Construir uma plataforma para engenharia de recursos generalizada é uma tarefa comum para clientes que precisam produzir muitos modelos de ML com diferentes conjuntos de dados. Esse tipo de plataforma inclui a criação de um processo orientado por programação para produzir dados finalizados com engenharia de recursos prontos para treinamento de modelo com pouca intervenção humana. No entanto, generalizar a engenharia de recursos é um desafio. Cada problema de negócios é diferente, cada conjunto de dados é diferente, os volumes de dados variam muito de cliente para cliente e a qualidade dos dados e, muitas vezes, a cardinalidade de uma determinada coluna (no caso de dados estruturados) podem desempenhar um papel significativo na complexidade da engenharia de recursos processo. Além disso, a natureza dinâmica dos dados de um cliente também pode resultar em uma grande variação do tempo de processamento e dos recursos necessários para concluir de maneira ideal a engenharia de recursos.

Cliente da AWS Vercast é uma empresa de soluções de marketing que toma decisões baseadas em dados para aumentar os ROIs de marketing para seus clientes. A plataforma interna de aprendizado de máquina baseada em nuvem da Vericast, criada em torno do processo CRISP-ML(Q), usa vários serviços da AWS, incluindo Amazon Sage Maker, Processamento do Amazon SageMaker, AWS Lambda e Funções de etapa da AWS, para produzir os melhores modelos possíveis, adaptados aos dados específicos do cliente. Essa plataforma visa capturar a repetibilidade das etapas que envolvem a criação de vários fluxos de trabalho de ML e agrupá-los em módulos de fluxo de trabalho generalizáveis padrão na plataforma.

Nesta postagem, compartilhamos como a Vericast otimizou a engenharia de recursos usando o SageMaker Processing.

Visão geral da solução

A plataforma de aprendizado de máquina da Vericast ajuda na implantação mais rápida de novos modelos de negócios com base em fluxos de trabalho existentes ou na ativação mais rápida de modelos existentes para novos clientes. Por exemplo, um modelo que prevê a propensão à mala direta é bastante diferente de um modelo que prevê a sensibilidade dos cupons de desconto dos clientes de um cliente da Vericast. Eles resolvem diferentes problemas de negócios e, portanto, têm diferentes cenários de uso em um design de campanha de marketing. Mas, do ponto de vista de ML, ambos podem ser interpretados como modelos de classificação binária e, portanto, podem compartilhar muitas etapas comuns de uma perspectiva de fluxo de trabalho de ML, incluindo ajuste e treinamento de modelo, avaliação, interpretabilidade, implantação e inferência.

Como esses modelos são problemas de classificação binária (em termos de ML), estamos separando os clientes de uma empresa em duas classes (binárias): os que responderiam positivamente à campanha e os que não responderiam. Além disso, esses exemplos são considerados uma classificação desequilibrada porque os dados usados para treinar o modelo não conteriam um número igual de clientes que responderiam e não responderiam favoravelmente.

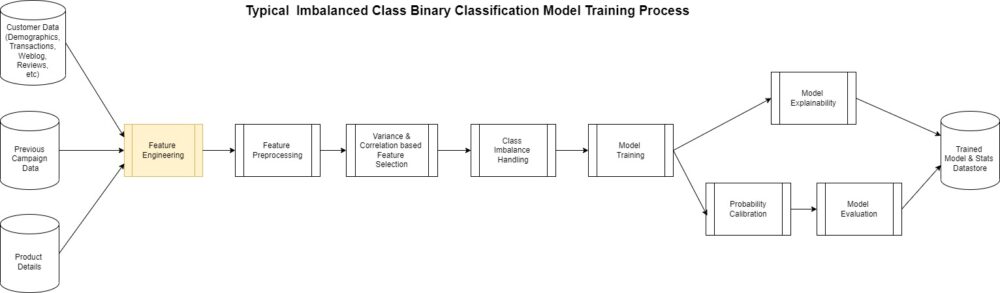

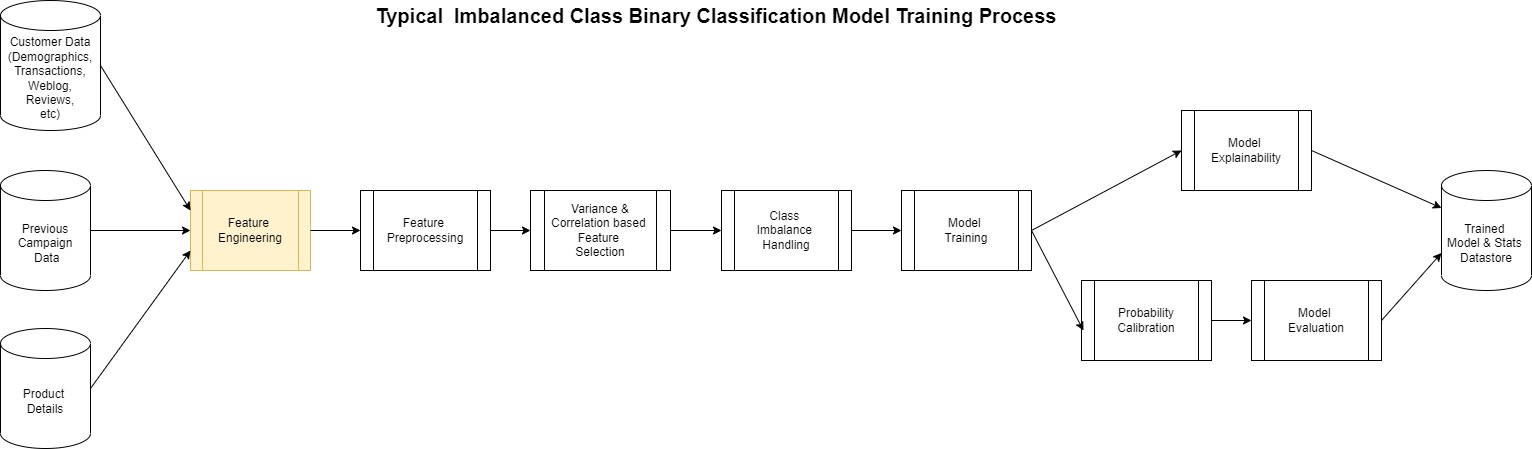

A criação real de um modelo como este segue o padrão generalizado mostrado no diagrama a seguir.

A maior parte desse processo é a mesma para qualquer classificação binária, exceto para a etapa de engenharia de recursos. Esta é talvez a etapa mais complicada, mas às vezes negligenciada no processo. Os modelos de ML dependem amplamente dos recursos usados para criá-los.

A plataforma de aprendizado de máquina nativa da nuvem da Vericast visa generalizar e automatizar as etapas de engenharia de recursos para vários fluxos de trabalho de ML e otimizar seu desempenho em uma métrica de custo versus tempo usando os seguintes recursos:

- A biblioteca de engenharia de recursos da plataforma – Consiste em um conjunto de transformações em constante evolução que foram testadas para produzir recursos generalizáveis de alta qualidade com base em conceitos específicos do cliente (por exemplo, dados demográficos do cliente, detalhes do produto, detalhes da transação e assim por diante).

- Otimizadores de recursos inteligentes – A plataforma usa o recurso de infraestrutura sob demanda da AWS para criar o tipo ideal de recursos de processamento para o trabalho de engenharia de recursos específico com base na complexidade esperada da etapa e na quantidade de dados que ela precisa processar.

- Dimensionamento dinâmico de trabalhos de engenharia de recursos – Uma combinação de vários serviços da AWS é usada para isso, mas principalmente o SageMaker Processing. Isso garante que a plataforma produza recursos de alta qualidade de maneira econômica e oportuna.

Esta postagem concentra-se no terceiro ponto desta lista e mostra como alcançar o dimensionamento dinâmico das tarefas de processamento do SageMaker para obter uma estrutura de processamento de dados mais gerenciada, de alto desempenho e econômica para grandes volumes de dados.

O SageMaker Processing permite cargas de trabalho que executam etapas para pré-processamento ou pós-processamento de dados, engenharia de recursos, validação de dados e avaliação de modelo no SageMaker. Ele também fornece um ambiente gerenciado e remove a complexidade do trabalho pesado indiferenciado necessário para configurar e manter a infraestrutura necessária para executar as cargas de trabalho. Além disso, o SageMaker Processing fornece uma interface de API para executar, monitorar e avaliar a carga de trabalho.

A execução de tarefas de processamento do SageMaker ocorre totalmente em um cluster gerenciado do SageMaker, com tarefas individuais colocadas em contêineres de instância em tempo de execução. O cluster gerenciado, as instâncias e os contêineres relatam métricas para Amazon CloudWatch, incluindo uso de GPU, CPU, memória, memória GPU, métricas de disco e registro de eventos.

Esses recursos fornecem benefícios aos engenheiros e cientistas de dados da Vericast, auxiliando no desenvolvimento de fluxos de trabalho de pré-processamento generalizados e abstraindo a dificuldade de manter ambientes gerados nos quais executá-los. Problemas técnicos podem surgir, no entanto, dada a natureza dinâmica dos dados e seus diversos recursos que podem ser inseridos em uma solução tão geral. O sistema deve fazer uma suposição inicial fundamentada quanto ao tamanho do cluster e das instâncias que o compõem. Essa suposição precisa avaliar os critérios dos dados e inferir os requisitos de CPU, memória e disco. Essa suposição pode ser totalmente apropriada e funcionar adequadamente para o trabalho, mas em outros casos pode não ser. Para um determinado conjunto de dados e trabalho de pré-processamento, a CPU pode ser subdimensionada, resultando em desempenho de processamento máximo e tempos longos para conclusão. Pior ainda, a memória pode se tornar um problema, resultando em desempenho ruim ou eventos de falta de memória, fazendo com que todo o trabalho falhe.

Com esses obstáculos técnicos em mente, a Vericast decidiu criar uma solução. Eles precisavam permanecer de natureza geral e se encaixar no cenário mais amplo do fluxo de trabalho de pré-processamento, sendo flexíveis nas etapas envolvidas. Também foi importante resolver a necessidade potencial de escalar o ambiente nos casos em que o desempenho foi comprometido e recuperar normalmente de tal evento ou quando um trabalho terminou prematuramente por qualquer motivo.

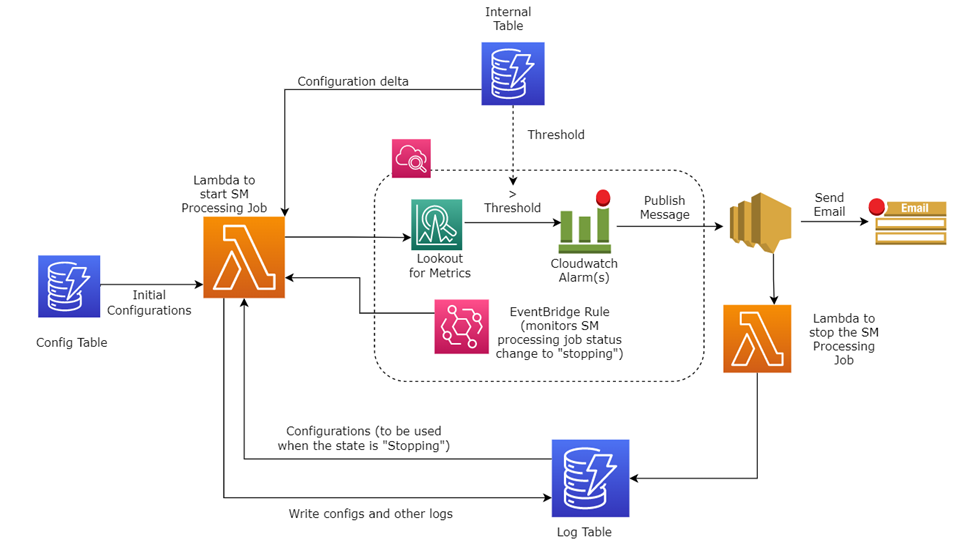

A solução construída pela Vericast para resolver esse problema usa vários serviços da AWS trabalhando juntos para atingir seus objetivos de negócios. Ele foi projetado para reiniciar e escalar o cluster de processamento do SageMaker com base nas métricas de desempenho observadas usando as funções do Lambda que monitoram os trabalhos. Para não perder trabalho quando ocorre um evento de dimensionamento ou para se recuperar de uma interrupção inesperada do trabalho, foi implementado um serviço baseado em ponto de verificação que usa Amazon DynamoDB e armazena os dados parcialmente processados em Serviço de armazenamento simples da Amazon (Amazon S3) conforme as etapas são concluídas. O resultado final é uma solução de escalonamento automático, robusta e monitorada dinamicamente.

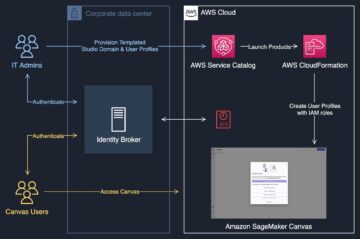

O diagrama a seguir mostra uma visão geral de alto nível de como o sistema funciona.

Nas seções a seguir, discutimos os componentes da solução com mais detalhes.

Inicializando a solução

O sistema assume que um processo separado inicia a solução. Por outro lado, esse design não foi projetado para funcionar sozinho porque não produzirá nenhum artefato ou saída, mas atuará como uma implementação secundária para um dos sistemas que usam tarefas de processamento do SageMaker. No caso do Vericast, a solução é iniciada por meio de uma chamada de uma etapa do Step Functions iniciada em outro módulo do sistema maior.

Depois que a solução é iniciada e uma primeira execução é acionada, uma configuração padrão básica é lida de uma tabela do DynamoDB. Essa configuração é usada para definir parâmetros para a tarefa de processamento do SageMaker e tem as suposições iniciais das necessidades de infraestrutura. O trabalho de processamento do SageMaker foi iniciado.

Monitorando metadados e saída

Quando o trabalho é iniciado, uma função do Lambda grava os metadados de processamento do trabalho (a configuração do trabalho atual e outras informações de log) na tabela de log do DynamoDB. Esses metadados e informações de log mantêm um histórico do trabalho, sua configuração inicial e contínua e outros dados importantes.

Em determinados pontos, conforme as etapas são concluídas no trabalho, os dados do ponto de verificação são adicionados à tabela de log do DynamoDB. Os dados de saída processados são movidos para o Amazon S3 para recuperação rápida, se necessário.

Essa função do Lambda também configura um Amazon Event Bridge regra que monitora o estado da tarefa em execução. Especificamente, esta regra está observando o trabalho para observar se o status do trabalho muda para stopping ou está em um stopped estado. Essa regra do EventBridge desempenha um papel importante na reinicialização de um trabalho se houver uma falha ou se ocorrer um evento planejado de dimensionamento automático.

Monitoramento de métricas do CloudWatch

A função do Lambda também define um alarme do CloudWatch com base em uma expressão matemática métrica no trabalho de processamento, que monitora as métricas de todas as instâncias para utilização de CPU, utilização de memória e utilização de disco. Esse tipo de alarme (métrica) usa os limites de alarme do CloudWatch. O alarme gera eventos com base no valor da métrica ou expressão relativa aos limites em vários períodos de tempo.

No caso de uso do Vericast, a expressão de limite é projetada para considerar as instâncias do driver e do executor como separadas, com métricas monitoradas individualmente para cada uma. Ao separá-los, o Vericast sabe o que está causando o alarme. Isso é importante para decidir como dimensionar adequadamente:

- Se as métricas do executor estiverem ultrapassando o limite, é bom escalar horizontalmente

- Se as métricas do driver ultrapassarem o limite, dimensionar horizontalmente provavelmente não ajudará, portanto, devemos dimensionar verticalmente

Expressão de métricas de alarme

O Vericast pode acessar as seguintes métricas em sua avaliação de dimensionamento e falha:

- Utilização da CPU – A soma da utilização de cada núcleo de CPU individual

- Utilização de memória – A porcentagem de memória usada pelos contêineres em uma instância

- Utilização do disco – A porcentagem de espaço em disco usado pelos contêineres em uma instância

- Utilização de GPU – A porcentagem de unidades de GPU usadas pelos contêineres em uma instância

- Utilização de memória GPU – A porcentagem de memória da GPU usada pelos contêineres em uma instância

No momento em que este livro foi escrito, a Vericast considera apenas CPUUtilization, MemoryUtilization e DiskUtilization. No futuro, eles pretendem considerar GPUUtilization e GPUMemoryUtilization tão bem.

O código a seguir é um exemplo de alarme do CloudWatch com base em uma expressão matemática métrica para dimensionamento automático do Vericast:

Essa expressão ilustra que o alarme do CloudWatch está considerando DriverMemoryUtilization (memoryDriver), CPUUtilization (cpuDriver), DiskUtilization (diskDriver), ExecutorMemoryUtilization (memoryExec), CPUUtilization (cpuExec) e DiskUtilization (diskExec) como métricas de monitoramento. O número 80 na expressão anterior representa o valor limite.

Aqui, IF((cpuDriver) > 80, 1, 0 implica que, se a utilização da CPU do driver ultrapassar 80%, 1 é atribuído como o limite, caso contrário, 0. IF(AVG(METRICS("memoryExec")) > 80, 1, 0 implica que todas as métricas com string memoryExec nele são considerados e uma média é calculada sobre isso. Se essa porcentagem média de utilização de memória for além de 80, 1 será atribuído como o limite, caso contrário, 0.

O operador lógico OR é usado na expressão para unificar todas as utilizações na expressão — se alguma das utilizações atingir seu limite, acione o alarme.

Para obter mais informações sobre como usar os alarmes de métrica do CloudWatch com base em expressões matemáticas de métrica, consulte Criando um alarme do CloudWatch com base em uma expressão matemática métrica.

Limitações de alarme do CloudWatch

O CloudWatch limita o número de métricas por alarme a 10. Isso pode causar limitações se você precisar considerar mais métricas do que isso.

Para superar essa limitação, o Vericast definiu alarmes com base no tamanho geral do cluster. Um alarme é criado para cada três instâncias (para três instâncias, haverá um alarme porque isso somaria nove métricas). Assumindo que a instância do driver deve ser considerada separadamente, outro alarme separado é criado para a instância do driver. Portanto, o número total de alarmes criados equivale aproximadamente a um terço do número de nós executores e um adicional para a instância do driver. Em cada caso, o número de métricas por alarme está abaixo do limite de 10 métricas.

O que acontece quando em um estado de alarme

Se um limite predeterminado for atingido, o alarme vai para um alarm estado, que usa Serviço de notificação simples da Amazon (Amazon SNS) para enviar notificações. Nesse caso, ele envia uma notificação por e-mail a todos os assinantes com os detalhes sobre o alarme na mensagem.

O Amazon SNS também é usado como um gatilho para uma função do Lambda que interrompe o trabalho de processamento do SageMaker em execução porque sabemos que o trabalho provavelmente falhará. Esta função também registra logs na tabela de log relacionada ao evento.

A regra EventBridge configurada no início do trabalho notará que o trabalho entrou em um stopping estado alguns segundos depois. Essa regra executa novamente a primeira função do Lambda para reiniciar o trabalho.

O processo de dimensionamento dinâmico

A primeira função do Lambda após executar duas ou mais vezes saberá que um trabalho anterior já foi iniciado e agora foi interrompido. A função passará por um processo semelhante para obter a configuração básica do trabalho original na tabela de log do DynamoDB e também recuperará a configuração atualizada da tabela interna. Essa configuração atualizada é uma configuração delta de recursos definida com base no tipo de dimensionamento. O tipo de dimensionamento é determinado a partir dos metadados do alarme, conforme descrito anteriormente.

A configuração original mais o delta de recursos são usados porque uma nova configuração e uma nova tarefa de processamento do SageMaker são iniciadas com os recursos aumentados.

Esse processo continua até que a tarefa seja concluída com êxito e pode resultar em várias reinicializações conforme necessário, adicionando mais recursos a cada vez.

Resultado do Vericast

Essa solução personalizada de dimensionamento automático foi fundamental para tornar a plataforma de aprendizado de máquina da Vericast mais robusta e tolerante a falhas. A plataforma agora pode lidar com cargas de trabalho de diferentes volumes de dados com o mínimo de intervenção humana.

Antes de implementar esta solução, estimar os requisitos de recursos para todos os módulos baseados em Spark no pipeline era um dos maiores gargalos do processo de integração do novo cliente. Os fluxos de trabalho falhariam se o volume de dados do cliente aumentasse ou o custo seria injustificável se o volume de dados diminuísse na produção.

Com este novo módulo instalado, as falhas de fluxo de trabalho devido a restrições de recursos foram reduzidas em quase 80%. As poucas falhas restantes devem-se principalmente a restrições de conta da AWS e além do processo de dimensionamento automático. A maior vitória da Vericast com esta solução é a facilidade com que eles podem integrar novos clientes e fluxos de trabalho. A Vericast espera acelerar o processo em pelo menos 60 a 70%, com dados ainda a serem coletados para um número final.

Embora isso seja visto como um sucesso pela Vericast, há um custo que vem com isso. Com base na natureza desse módulo e no conceito de dimensionamento dinâmico como um todo, os fluxos de trabalho tendem a demorar cerca de 30% mais (caso médio) do que um fluxo de trabalho com um cluster personalizado para cada módulo do fluxo de trabalho. A Vericast continua a otimizar nesta área, procurando melhorar a solução incorporando a inicialização de recursos baseada em heurística para cada módulo cliente.

Sharmo Sarkar, gerente sênior de plataforma de aprendizado de máquina da Vericast, diz: “À medida que continuamos a expandir nosso uso da AWS e do SageMaker, gostaria de destacar o trabalho incrível de nossa equipe de serviços ao cliente da AWS, arquitetos de soluções da AWS dedicados, e AWS Professional Services com os quais trabalhamos. Seu profundo conhecimento da AWS e do SageMaker nos permitiu projetar uma solução que atendesse a todas as nossas necessidades e nos fornecesse a flexibilidade e a escalabilidade de que precisávamos. Estamos muito gratos por ter uma equipe de suporte tão talentosa e experiente ao nosso lado.”

Conclusão

Nesta postagem, compartilhamos como o SageMaker e o SageMaker Processing permitiram que a Vericast criasse uma estrutura de processamento de dados gerenciada, eficiente e econômica para grandes volumes de dados. Ao combinar o poder e a flexibilidade do SageMaker Processing com outros serviços da AWS, eles podem monitorar facilmente o processo generalizado de engenharia de recursos. Eles podem detectar automaticamente possíveis problemas gerados por falta de computação, memória e outros fatores e implementar automaticamente o dimensionamento vertical e horizontal conforme necessário.

O SageMaker e suas ferramentas também podem ajudar sua equipe a atingir suas metas de ML. Para saber mais sobre o processamento do SageMaker e como ele pode ajudar em suas cargas de trabalho de processamento de dados, consulte Dados do processo. Se você está apenas começando com ML e está procurando exemplos e orientações, JumpStart do Amazon SageMaker pode começar. O JumpStart é um hub de ML a partir do qual você pode acessar algoritmos integrados com modelos de base pré-treinados para ajudá-lo a executar tarefas como resumo de artigos e geração de imagens e soluções pré-criadas para resolver casos de uso comuns.

Por fim, se este post o ajudar ou inspirar a resolver um problema, adoraríamos ouvi-lo! Por favor, compartilhe seus comentários e feedback.

Sobre os autores

Anthony McClure é Arquiteto de Soluções de Parceiro Sênior da equipe AWS SaaS Factory. Anthony também tem grande interesse em aprendizado de máquina e inteligência artificial, trabalhando com a AWS ML/AI Technical Field Community para ajudar os clientes a tornar realidade suas soluções de aprendizado de máquina.

Anthony McClure é Arquiteto de Soluções de Parceiro Sênior da equipe AWS SaaS Factory. Anthony também tem grande interesse em aprendizado de máquina e inteligência artificial, trabalhando com a AWS ML/AI Technical Field Community para ajudar os clientes a tornar realidade suas soluções de aprendizado de máquina.

Jyoti Sharma é engenheiro de ciência de dados da equipe de plataforma de aprendizado de máquina da Vericast. Ela é apaixonada por todos os aspectos da ciência de dados e focada em projetar e implementar uma plataforma de aprendizado de máquina altamente escalável e distribuída.

Jyoti Sharma é engenheiro de ciência de dados da equipe de plataforma de aprendizado de máquina da Vericast. Ela é apaixonada por todos os aspectos da ciência de dados e focada em projetar e implementar uma plataforma de aprendizado de máquina altamente escalável e distribuída.

Sharmo Sarkar é gerente sênior da Vericast. Ele lidera as equipes de pesquisa e desenvolvimento de ML da plataforma de aprendizado de máquina em nuvem e da plataforma de marketing da Vericast. Ele tem uma vasta experiência em Big Data Analytics, Computação Distribuída e Processamento de Linguagem Natural. Fora do trabalho, ele gosta de andar de moto, fazer caminhadas e andar de bicicleta em trilhas nas montanhas.

Sharmo Sarkar é gerente sênior da Vericast. Ele lidera as equipes de pesquisa e desenvolvimento de ML da plataforma de aprendizado de máquina em nuvem e da plataforma de marketing da Vericast. Ele tem uma vasta experiência em Big Data Analytics, Computação Distribuída e Processamento de Linguagem Natural. Fora do trabalho, ele gosta de andar de moto, fazer caminhadas e andar de bicicleta em trilhas nas montanhas.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoAiStream. Inteligência de Dados Web3. Conhecimento Amplificado. Acesse aqui.

- Cunhando o Futuro com Adryenn Ashley. Acesse aqui.

- Compre e venda ações em empresas PRE-IPO com PREIPO®. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/how-vericast-optimized-feature-engineering-using-amazon-sagemaker-processing/

- :tem

- :é

- :não

- :onde

- $UP

- 1

- 10

- 100

- 15%

- 7

- a

- Sobre

- Acesso

- conformemente

- Conta

- Alcançar

- ativação

- atos

- adicionar

- adicionado

- acrescentando

- Adicional

- adequadamente

- Depois de

- contra

- SIDA

- visa

- alarme

- algoritmo

- algoritmos

- Todos os Produtos

- sozinho

- juntamente

- já

- tb

- Amazon

- Amazon Sage Maker

- quantidade

- an

- analítica

- e

- Outro

- Anthony

- qualquer

- api

- apropriado

- arquitetura

- SOMOS

- ÁREA

- por aí

- artigo

- artificial

- inteligência artificial

- AS

- aspecto

- aspectos

- atribuído

- auxiliar

- At

- auto

- automatizar

- automaticamente

- média

- AWS

- Serviços Profissionais AWS

- base

- baseado

- BE

- Porque

- tornam-se

- sido

- ser

- Benefícios

- MELHOR

- Pós

- Grande

- Big Data

- O maior

- impulsionar

- ambos

- Trazendo

- construir

- Prédio

- construído

- construídas em

- negócio

- mas a

- by

- calculado

- chamada

- Campanha

- CAN

- Pode obter

- Capturar

- casas

- casos

- Causar

- causando

- certo

- desafiante

- Alterações

- classe

- aulas

- classificação

- cliente

- integração do cliente

- clientes

- Na nuvem

- Agrupar

- código

- Coluna

- combinação

- combinando

- vem

- comentários

- comum

- comunidade

- Empresa

- completar

- Completa

- complexidade

- complicado

- componentes

- Comprometido

- Computar

- computação

- conceito

- conceitos

- Configuração

- Considerar

- considerado

- considerando

- considera

- restrições

- não contenho

- Containers

- continuar

- continua

- Custo

- relação custo-benefício

- poderia

- cupom

- crio

- criado

- criação

- critérios

- Atravessar

- Atual

- Atualmente

- personalizadas

- cliente

- Clientes

- dados,

- Análise de Dados

- Preparação de dados

- informática

- ciência de dados

- cientista de dados

- orientado por dados

- conjuntos de dados

- decidir

- decisões

- dedicado

- profundo

- Delta

- Demografia

- dependente

- desenvolvimento

- descrito

- Design

- projetado

- concepção

- detalhe

- detalhes

- determinado

- Desenvolvimento

- diferente

- diferindo

- Dificuldade

- diretamente

- Desconto

- discutir

- distribuído

- computação distribuída

- dirigido

- motorista

- dois

- dinâmico

- dinamicamente

- cada

- Mais cedo

- facilidade

- facilmente

- ou

- habilitado

- permite

- engenheiro

- Engenharia

- Engenheiros

- garante

- Todo

- Meio Ambiente

- ambientes

- igual

- Equivalente

- avaliar

- avaliação

- avaliação

- Evento

- eventos

- exemplo

- exemplos

- Exceto

- existente

- Expandir

- esperado

- espera

- vasta experiência

- Explorando

- expressões

- extenso

- Experiência Extensiva

- fatores

- fábrica

- FALHA

- Falha

- Característica

- Funcionalidades

- Alimentado

- retornos

- poucos

- campo

- final

- finalizado

- Primeiro nome

- caber

- Flexibilidade

- flexível

- focado

- seguinte

- segue

- Escolha

- formas

- Foundation

- Quadro

- da

- totalmente

- função

- funções

- Além disso

- futuro

- coleta

- Geral

- gerado

- gera

- geração

- ter

- obtendo

- dado

- Go

- meta

- Objetivos

- vai

- Bom estado, com sinais de uso

- GPU

- grato

- orientações

- tinha

- manipular

- acontece

- Ter

- ter

- he

- ouvir

- pesado

- levantamento pesado

- ajudar

- ajuda

- de alto nível

- alta qualidade

- Destaques

- altamente

- história

- Horizontal

- horizontalmente

- Como funciona o dobrador de carta de canal

- Como Negociar

- Contudo

- HTML

- http

- HTTPS

- Hub

- humano

- Obstáculos

- i

- identificado

- if

- ilustra

- imagem

- executar

- implementação

- implementação

- importante

- melhorar

- in

- Em outra

- inclui

- Incluindo

- incorporando

- Crescimento

- aumentou

- incrível

- Individual

- Individualmente

- INFORMAÇÕES

- Infraestrutura

- do estado inicial,

- Inicia

- instância

- instrumental

- Inteligência

- pretender

- interesse

- Interface

- interno

- da intervenção

- para dentro

- envolvido

- emitem

- questões

- IT

- ESTÁ

- Trabalho

- Empregos

- jpg

- apenas por

- Tipo

- Saber

- Falta

- língua

- grande

- largamente

- Maior

- mais tarde

- Leads

- APRENDER

- aprendizagem

- mínimo

- Biblioteca

- facelift

- limitação

- limitações

- limites

- Lista

- pequeno

- log

- logging

- lógico

- mais

- procurando

- perder

- gosta,

- máquina

- aprendizado de máquina

- a manter

- Manter

- mantém

- fazer

- FAZ

- Fazendo

- gerenciados

- Gerente

- manipulado

- maneira

- muitos

- Marketing

- matemática

- Posso..

- Conheça

- Memória

- mensagem

- metadados

- métrico

- Métrica

- poder

- mente

- mínimo

- ML

- modelo

- modelos

- Módulo

- Módulos

- momento

- Monitore

- monitorados

- monitoração

- monitores

- mais

- a maioria

- na maioria das vezes

- Montanha

- múltiplo

- devo

- natural

- Processamento de linguagem natural

- Natureza

- você merece...

- necessário

- necessitando

- Cria

- Novo

- nós

- notavelmente

- Perceber..

- notificação

- notificações

- agora

- número

- objetivos

- observar

- of

- frequentemente

- on

- Sob demanda

- A bordo

- Onboarding

- ONE

- contínuo

- só

- operador

- ideal

- Otimize

- otimizado

- or

- original

- Outros

- A Nossa

- Fora

- Resultado

- saída

- lado de fora

- Acima de

- global

- Superar

- Visão geral

- parâmetros

- parte

- particular

- parceiro

- Passagem

- apaixonado

- padrão

- percentagem

- Realizar

- atuação

- possivelmente

- períodos

- perspectiva

- fotografia

- oleoduto

- Lugar

- planejado

- plataforma

- Plataformas

- platão

- Inteligência de Dados Platão

- PlatãoData

- Jogar

- desempenha

- por favor

- mais

- ponto

- pontos

- pobre

- possível

- Publique

- potencial

- poder

- prevendo

- anterior

- provavelmente

- Problema

- problemas

- processo

- Processado

- em processamento

- produzir

- Produto

- Produção

- profissional

- fornecer

- fornecido

- fornece

- colocar

- qualidade

- Links

- mais rápido

- R & D

- em vez

- Cru

- alcançar

- Leia

- pronto

- Realidade

- razão

- registros

- Recuperar

- recuperação

- Reduzido

- refere-se

- relacionado

- relevante

- permanecem

- remanescente

- Denunciar

- requeridos

- Requisitos

- recurso

- Recursos

- Responder

- resultar

- resultando

- uma conta de despesas robusta

- Tipo

- grosseiramente

- Regra

- Execute

- corrida

- SaaS

- sábio

- mesmo

- diz

- AMPLIAR

- escalável

- Escala

- dimensionamento

- Solução de dimensionamento

- cenários

- Ciência

- Cientista

- cientistas

- segundo

- seções

- selecionado

- doadores,

- enviar

- envia

- senior

- Sensibilidade

- separado

- separando

- serviço

- Serviços

- conjunto

- Conjuntos

- vários

- Partilhar

- compartilhado

- Sharma

- ela

- mostrando

- Shows

- lado

- periodo

- semelhante

- simples

- Tamanho

- So

- solução

- Soluções

- RESOLVER

- Espaço

- específico

- especificamente

- velocidade

- Spin

- Estágio

- padrão

- fica

- começo

- começado

- começa

- Estado

- Status

- Passo

- Passos

- Ainda

- parou

- paragem

- Pára

- armazenamento

- lojas

- Tanga

- mais forte,

- estruturada

- assinantes

- sucesso

- entraram com sucesso

- tal

- ajuda

- .

- sistemas

- mesa

- adaptados

- Tire

- toma

- talentoso

- Tarefa

- tarefas

- Profissionais

- equipes

- Dados Técnicos:

- condições

- do que

- que

- A

- O Futuro

- deles

- Eles

- então

- Lá.

- assim sendo

- Este

- deles

- Terceiro

- isto

- aqueles

- três

- limiar

- Através da

- tempo

- vezes

- para

- juntos

- ferramentas

- Total

- Trem

- Training

- transação

- Detalhes da transação

- Transformar

- Transformação

- transformações

- desencadear

- desencadeado

- dois

- tipo

- típico

- para

- compreensão

- unidades

- até

- Atualizada

- us

- utilizável

- Uso

- usar

- caso de uso

- usava

- utilização

- validação

- valor

- vário

- vertical

- volume

- volumes

- vs

- querido

- foi

- assistindo

- Caminho..

- we

- BEM

- quando

- qual

- QUEM

- inteiro

- totalmente

- precisarão

- ganhar

- de

- dentro

- Atividades:

- fluxos de trabalho

- trabalhar

- trabalho

- pior

- seria

- escrita

- ainda

- Produção

- Vocês

- investimentos

- zefirnet