By Kenna Hughes-Castleberry publicado em 02 de dezembro de 2022

Graças aos avanços da tecnologia, está ficando mais difícil dizer o que é real e o que não é. Esse problema é agravado com o uso da tecnologia deepfake—áudio e vídeos que usam IA para substituir indivíduos ou suas vozes. Embora muitos deepfakes tenham sido usados com sucesso para entretenimento (como se Nicholas Cage estava no Os Caçadores da Arca Perdida) ou jogos (como em atletas da FIFA), uma grande porcentagem deles foi criada para mais razões sinistras. À medida que fica mais fácil criar esses vídeos adulterados, muitos especialistas esperam que a computação quântica possa ajudar a superar as ameaças potenciais dessa tecnologia em ascensão.

Como funciona a tecnologia Deepfake?

Para criar um vídeo deepfake bem-sucedido, você precisa aprendizado de máquina algoritmos. “Algoritmos de aprendizado profundo ensinam a si mesmos como resolver problemas de grandes conjuntos de dados e, em seguida, são usados para trocar rostos em vídeos e outros conteúdos digitais”, explicou Pós-Quantum CEO Andersen Cheng. A Post-Quantum é uma empresa líder em segurança cibernética cujo foco é resistente a quantum segurança, inclusive contra deepfakes. “Existem vários métodos para criar esses deepfakes”, afirmou Cheng, “mas o mais popular é o uso de redes neurais profundas envolvendo autoencoders. Um codificador automático é um programa de IA de aprendizado profundo que estuda videoclipes para entender como uma pessoa se parece de vários ângulos e do ambiente circundante e, em seguida, mapeia essa pessoa no indivíduo, encontrando características comuns.”

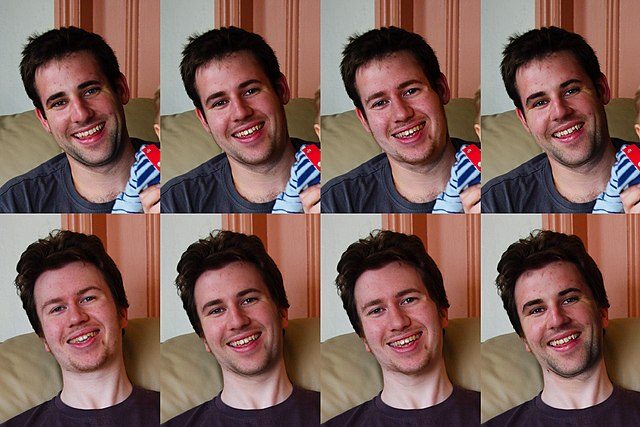

Uma tecnologia deepfake configurada (PC Wikimedia Commons)

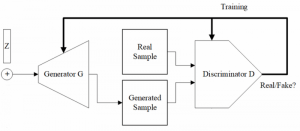

Para garantir que o codificador automático funcione com sucesso, vários videoclipes do rosto do sujeito precisam ser analisados para fornecer um conjunto maior de dados. Em seguida, o codificador automático pode ajudar a criar um vídeo composto trocando o indivíduo original pelo novo assunto. Um segundo tipo de aprendizado de máquina chamado General Adversarial Network (GANs) detectará e melhorará as falhas no novo vídeo composto. De acordo com um Artigo de 2022: “As GANs treinam um 'gerador' para criar novas imagens a partir da representação latente da imagem de origem e um 'discriminador' para avaliar o realismo dos materiais gerados.” Esse processo acontece várias vezes até que o discriminador não saiba se o vídeo está adulterado e se o deepfake está completo.

A ameaça da tecnologia deepfake

Atualmente, existem muitos softwares de código aberto ou aplicativos gratuitos que os indivíduos podem usar para criar deepfakes. Embora isso possa parecer benéfico para muitos, especialmente aqueles na indústria do entretenimento, isso levou a alguns problemas sérios, até mesmo criminais. De acordo com um relatório Deeptrace, 96% dos vídeos deepfake online em 2019 eram, sem surpresa, pornográficos. Enquanto muitos desses vídeos ilícitos foram feitos para se vingar de um ex, outros foram usados para criar escândalos para celebridades femininas e até políticos. Em 2018, um vídeo deepfake foi lançado de um partido político belga mostrando o então presidente Trump discutindo os Acordos Climáticos de Paris. Com as notícias falsas já se tornando um problema para o público em geral, os vídeos deepfake podem ser a gota que quebra as costas do camelo. Até áudio deepfake está causando estragos, como um arquivo de áudio adulterado do CEO de uma empresa de tecnologia ajudou a cometer um ato de fraude. Para Cheng, esses tipos de mídia podem desgastar a confiança do público rapidamente. “Temos a questão mais ampla de confiança social – como o público será capaz de discernir entre o que é real e o que é deepfake”, acrescentou Cheng. “Como vimos, há até evidências de que deepfakes estão sendo usados para contornar medidas de proteção, como autenticação biométrica”. Com essas preocupações crescentes, Cheng e sua equipe na Post-Quantum acreditam que têm uma solução na forma de Nomídio, um software especializado de ultra-segurança.

Preparando-se para as ameaças da tecnologia DeepFake

Olhando para as múltiplas ameaças representadas pela computação quântica e deepfakes, Cheng e sua equipe criaram o Nomidio para garantir que as identidades de login e até mesmo a autenticação biométrica permaneçam seguras. “Nomidio é um serviço biométrico multifator (MFB) biométrico e sem senha que permite autenticação segura com uma experiência de usuário simples e intuitiva”, disse Cheng. “Ele substitui o login baseado em nome de usuário/senha e logon único, com os usuários sendo autenticados em seu perfil biométrico com autenticação multifator (MFA) nos bastidores.” Como Cheng é especialista em segurança cibernética há muitos anos, ele garantiu que o Nomidio também pudesse estar protegido contra deepfakes. “Nossa filosofia principal ao criá-lo foi usar o máximo possível de entrada adicional e verdadeira autenticação multifator (ou seja, com mais de dois fatores), portanto, é de fato a solução ideal para enfrentar qualquer desenvolvimento futuro na tecnologia deepfake. Em última análise, isso se deve ao fato de que o MFA tradicional é insuficiente, mas o MFB pode tornar os ataques em tempo real praticamente impossíveis. Ou seja, uma combinação de, por exemplo, voz, rosto e um código PIN é altamente segura pelo fato de que qualquer fator único pode ser falsificado, mas falsificar todos os três na mesma instância é praticamente impossível. Com o Nomidio, uma combinação de biometria facial e de voz, reconhecimento de fala, dados dependentes do contexto e até análise comportamental podem ser combinados em um único sistema de autenticação. ”

Embora o próprio Nomidio não aproveite a computação quântica para superar as ameaças deepfake, os computadores quânticos podem funcionar contra esses arquivos de mídia falsos. Como computadores quânticos muitas vezes utilizam algoritmos de aprendizado de máquina para trabalhar com mais rapidez e eficiência, eles podem ser capazes de detectar vídeos falsos ou arquivos de áudio em um ritmo mais rápido. Embora a tecnologia ainda esteja sendo desenvolvida e poucos estejam olhando para deepfakes como um caso de uso potencial para computadores quânticos, essas máquinas de próximo nível podem ser usadas no futuro para tornar nossa mídia mais verdadeira e precisa.

Com as ameaças da tecnologia deepfake se tornando cada vez mais aparentes, muitos governos e empresas já estão tentando encontrar maneiras de ajudar a combatê-la. Em 2021, o Facebook lançou o Desafio de detecção do Deepfake, com um prêmio de $ 500,000 para aqueles que criam novas tecnologias para detectar deepfakes. Nos EUA, estados como Califórnia, Texas e Virgínia têm leis que proíbem o uso de deepfake para pornografia e política. o Parlamento Europeu também estabeleceu mais regulamentos sobre deepfakes, modificando a Lei de Serviços Digitais para impor o uso de rótulos em vídeos deepfake. Embora essa legislação não entre em vigor até 2024, ela mostra a gravidade da ameaça da tecnologia deepfake.

Kenna Hughes-Castleberry é redatora da Inside Quantum Technology e comunicadora científica da JILA (uma parceria entre a University of Colorado Boulder e o NIST). Suas batidas de escrita incluem tecnologia profunda, metaverso e tecnologia quântica.