Na atual era da informação, os vastos volumes de dados alojados em inúmeros documentos representam um desafio e uma oportunidade para as empresas. Os métodos tradicionais de processamento de documentos muitas vezes ficam aquém da eficiência e da precisão, deixando espaço para inovação, economia e otimizações. O processamento de documentos testemunhou avanços significativos com o advento do Processamento Inteligente de Documentos (IDP). Com o IDP, as empresas podem transformar dados não estruturados de vários tipos de documentos em insights estruturados e acionáveis, aumentando drasticamente a eficiência e reduzindo os esforços manuais. No entanto, o potencial não termina aí. Ao integrar a inteligência artificial generativa (IA) no processo, podemos melhorar ainda mais as capacidades dos deslocados internos. A IA generativa não apenas introduz capacidades aprimoradas no processamento de documentos, mas também introduz uma adaptabilidade dinâmica às mudanças nos padrões de dados. Esta postagem mostra a sinergia entre IDP e IA generativa, revelando como eles representam a próxima fronteira no processamento de documentos.

Discutimos o IDP em detalhes em nossa série Processamento inteligente de documentos com serviços de IA da AWS (Parte 1 e Parte 2). Nesta postagem, discutimos como estender uma arquitetura IDP nova ou existente com grandes modelos de linguagem (LLMs). Mais especificamente, discutimos como podemos integrar amazontext de LangChain como carregador de documentos e Rocha Amazônica extrair dados de documentos e usar capacidades generativas de IA nas várias fases do PDI.

Amazon Textract é um serviço de aprendizado de máquina (ML) que extrai automaticamente texto, manuscrito e dados de documentos digitalizados. O Amazon Bedrock é um serviço totalmente gerenciado que oferece uma variedade de modelos básicos (FMs) de alto desempenho por meio de APIs fáceis de usar.

O diagrama a seguir é uma arquitetura de referência de alto nível que explica como você pode aprimorar ainda mais um fluxo de trabalho de IDP com modelos básicos. Você pode usar LLMs em uma ou todas as fases do PDI, dependendo do caso de uso e do resultado desejado.

Nas seções a seguir, veremos detalhadamente como o Amazon Textract é integrado a fluxos de trabalho generativos de IA usando LangChain para processar documentos para cada uma dessas tarefas específicas. Os blocos de código fornecidos aqui foram reduzidos por questões de brevidade. Consulte nosso Repositório GitHub para notebooks Python detalhados e um passo a passo.

A extração de texto de documentos é um aspecto crucial quando se trata de processamento de documentos com LLMs. Você pode usar o Amazon Textract para extrair texto bruto não estruturado de documentos e preservar os objetos estruturados ou semiestruturados originais, como pares de valores-chave e tabelas presentes no documento. Pacotes de documentos, como solicitações de assistência médica e de seguros ou hipotecas, consistem em formulários complexos que contêm muitas informações em formatos estruturados, semiestruturados e não estruturados. A extração de documentos é uma etapa importante aqui porque os LLMs se beneficiam do conteúdo rico para gerar respostas mais precisas e relevantes, o que de outra forma poderia impactar a qualidade dos resultados dos LLMs.

LangChain é uma estrutura de código aberto poderosa para integração com LLMs. Os LLMs em geral são versáteis, mas podem ter dificuldades com tarefas específicas de domínio onde são necessários um contexto mais profundo e respostas diferenciadas. LangChain capacita os desenvolvedores em tais cenários a construir agentes que podem dividir tarefas complexas em subtarefas menores. As subtarefas podem então introduzir contexto e memória nos LLMs conectando e encadeando prompts do LLM.

Ofertas LangChain carregadores de documentos que pode carregar e transformar dados de documentos. Você pode usá-los para estruturar documentos em formatos preferenciais que podem ser processados por LLMs. O Amazon Textr PDF Loader é um tipo de carregador de serviço de carregador de documentos que fornece uma maneira rápida de automatizar o processamento de documentos usando Amazon Textract em combinação com LangChain. Para mais detalhes sobre AmazonTextractPDFLoader, consulte o LangChain documentação. Para usar o carregador de documentos Amazon Textract, comece importando-o da biblioteca LangChain:

from langchain.document_loaders import AmazonTextractPDFLoaderhttps_loader = AmazonTextractPDFLoader("https://sample-website.com/sample-doc.pdf")

https_document = https_loader.load() s3_loader = AmazonTextractPDFLoader("s3://sample-bucket/sample-doc.pdf")

s3_document = s3_loader.load()Você também pode armazenar documentos no Amazon S3 e consultá-los usando o padrão de URL s3://, conforme explicado em Acessando um bucket usando S3://e passe este caminho S3 para o carregador de PDF do Amazon Textract:

import boto3

textract_client = boto3.client('textract', region_name='us-east-2') file_path = "s3://amazon-textract-public-content/langchain/layout-parser-paper.pdf"

loader = AmazonTextractPDFLoader(file_path, client=textract_client)

documents = loader.load()Um documento de várias páginas conterá várias páginas de texto, que podem então ser acessadas por meio do objeto de documentos, que é uma lista de páginas. O código a seguir percorre as páginas do objeto de documentos e imprime o texto do documento, que está disponível por meio do page_content atributo:

print(len(documents)) for document in documents: print(document.page_content)Amazon Comprehend e LLMs podem ser utilizados de forma eficaz para classificação de documentos. O Amazon Comprehend é um serviço de processamento de linguagem natural (PNL) que usa ML para extrair insights de texto. O Amazon Comprehend também oferece suporte ao treinamento de modelo de classificação personalizado com reconhecimento de layout em documentos como PDFs, Word e formatos de imagem. Para obter mais informações sobre como usar o classificador de documentos do Amazon Comprehend, consulte O classificador de documentos do Amazon Comprehend adiciona suporte de layout para maior precisão.

Quando combinada com LLMs, a classificação de documentos torna-se uma abordagem poderosa para gerenciar grandes volumes de documentos. Os LLMs são úteis na classificação de documentos porque podem analisar o texto, os padrões e os elementos contextuais do documento usando a compreensão da linguagem natural. Você também pode ajustá-los para classes de documentos específicas. Quando um novo tipo de documento introduzido no pipeline de IDP precisa de classificação, o LLM pode processar texto e categorizar o documento com base em um conjunto de classes. A seguir está um exemplo de código que usa o carregador de documentos LangChain desenvolvido pelo Amazon Textract para extrair o texto do documento e usá-lo para classificá-lo. Nós usamos o Claude antrópico v2 modelo via Amazon Bedrock para realizar a classificação.

No exemplo a seguir, primeiro extraímos o texto de um relatório de alta de um paciente e usamos um LLM para classificá-lo, dada uma lista de três tipos de documentos diferentes:DISCHARGE_SUMMARY, RECEIPT e PRESCRIPTION. A captura de tela a seguir mostra nosso relatório.

from langchain.document_loaders import AmazonTextractPDFLoader

from langchain.llms import Bedrock

from langchain.prompts import PromptTemplate

from langchain.chains import LLMChain loader = AmazonTextractPDFLoader("./samples/document.png")

document = loader.load() template = """ Given a list of classes, classify the document into one of these classes. Skip any preamble text and just give the class name. <classes>DISCHARGE_SUMMARY, RECEIPT, PRESCRIPTION</classes>

<document>{doc_text}<document>

<classification>""" prompt = PromptTemplate(template=template, input_variables=["doc_text"])

bedrock_llm = Bedrock(client=bedrock, model_id="anthropic.claude-v2") llm_chain = LLMChain(prompt=prompt, llm=bedrock_llm)

class_name = llm_chain.run(document[0].page_content) print(f"The provided document is = {class_name}")

A sumarização envolve condensar um determinado texto ou documento em uma versão mais curta, mantendo suas informações principais. Essa técnica é benéfica para a recuperação eficiente de informações, que permite aos usuários compreender rapidamente os pontos-chave de um documento sem ler todo o conteúdo. Embora o Amazon Textract não execute diretamente o resumo de texto, ele fornece recursos básicos para extrair o texto inteiro de documentos. Este texto extraído serve como entrada para nosso modelo LLM para realizar tarefas de resumo de texto.

Usando o mesmo relatório de alta de amostra, usamos AmazonTextractPDFLoader para extrair texto deste documento. Como antes, usamos o modelo Claude v2 via Amazon Bedrock e inicializamos com um prompt que contém as instruções sobre o que fazer com o texto (neste caso, resumo). Finalmente, executamos a cadeia LLM passando o texto extraído do carregador de documentos. Isso executa uma ação de inferência no LLM com o prompt que consiste nas instruções para resumir e no texto do documento marcado por Document. Veja o seguinte código:

O código gera o resumo de um relatório resumido de alta do paciente:

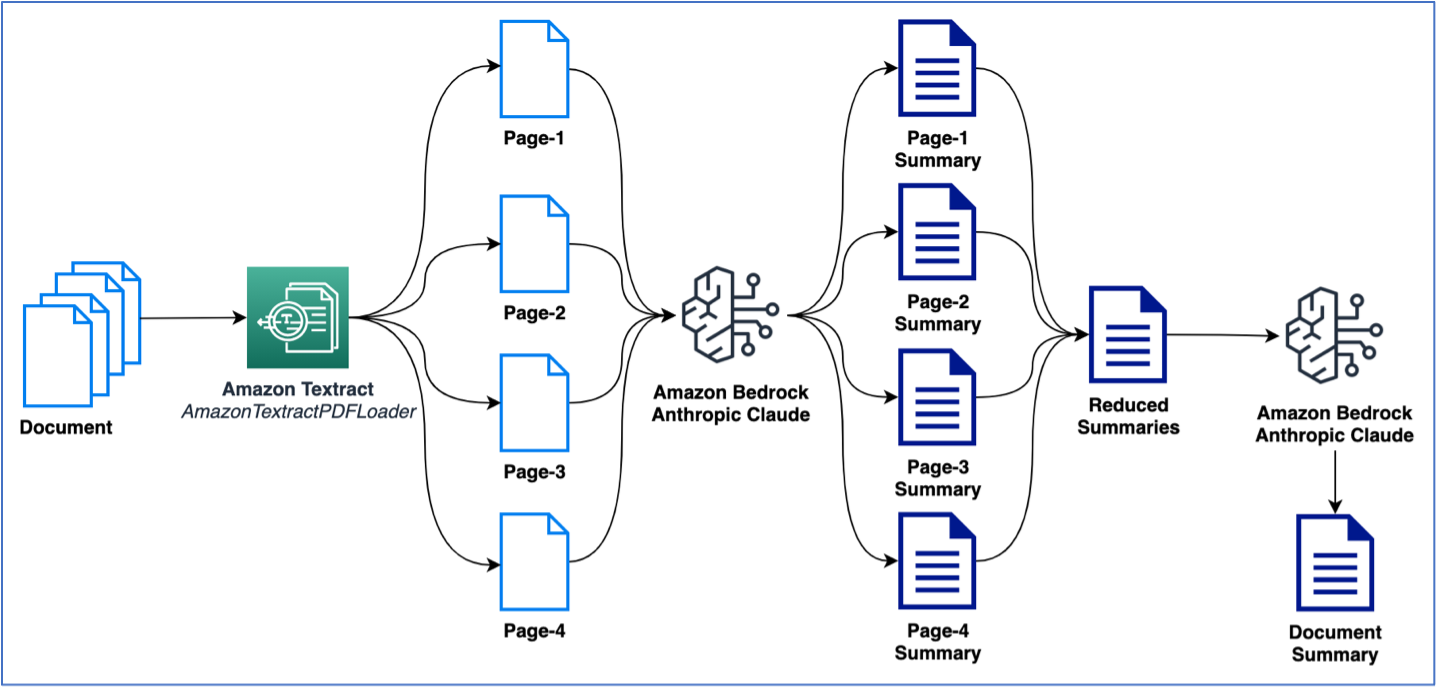

O exemplo anterior usou um documento de página única para realizar o resumo. No entanto, você provavelmente lidará com documentos contendo várias páginas que precisam de resumo. Uma maneira comum de realizar o resumo em múltiplas páginas é primeiro gerar resumos em pedaços menores de texto e depois combinar os resumos menores para obter um resumo final do documento. Observe que este método requer múltiplas chamadas para o LLM. A lógica para isso pode ser elaborada facilmente; no entanto, LangChain fornece uma cadeia de resumo integrada que pode resumir textos grandes (de documentos de várias páginas). A sumarização pode acontecer tanto via map_reduce ou com stuff opções, que estão disponíveis como opções para gerenciar as múltiplas chamadas para o LLM. No exemplo a seguir, usamos map_reduce para resumir um documento de várias páginas. A figura a seguir ilustra nosso fluxo de trabalho.

Vamos primeiro começar extraindo o documento e ver a contagem total de tokens por página e o número total de páginas:

Em seguida, usamos o recurso integrado do LangChain load_summarize_chain para resumir todo o documento:

from langchain.chains.summarize import load_summarize_chain summary_chain = load_summarize_chain(llm=bedrock_llm, chain_type='map_reduce')

output = summary_chain.run(document)

print(output.strip())Padronização e perguntas e respostas

Nesta seção, discutimos tarefas de padronização e perguntas e respostas.

estandardização

A padronização de saída é uma tarefa de geração de texto onde LLMs são usados para fornecer uma formatação consistente do texto de saída. Esta tarefa é particularmente útil para automação de extração de entidades-chave que exige que a saída esteja alinhada com os formatos desejados. Por exemplo, podemos seguir as melhores práticas de engenharia imediata para ajustar um LLM para formatar datas no formato MM/DD/AAAA, que pode ser compatível com uma coluna DATE do banco de dados. O bloco de código a seguir mostra um exemplo de como isso é feito usando um LLM e engenharia imediata. Não apenas padronizamos o formato de saída para os valores de data, mas também solicitamos que o modelo gere a saída final em formato JSON para que seja facilmente consumível em nossos aplicativos downstream. Nós usamos Linguagem de expressão LangChain (LCEL) para encadear duas ações. A primeira ação solicita que o LLM gere uma saída no formato JSON apenas com as datas do documento. A segunda ação pega a saída JSON e padroniza o formato da data. Observe que essa ação de duas etapas também pode ser executada em uma única etapa com a engenharia imediata adequada, como veremos na normalização e na modelagem.

A saída do exemplo de código anterior é uma estrutura JSON com datas 07/09/2020 e 08/09/2020, que estão no formato DD/MM/AAAA e são as datas de admissão e alta hospitalar do paciente, respectivamente, de acordo com ao relatório resumido de alta.

Perguntas e respostas com geração aumentada de recuperação

Os LLMs são conhecidos por reter informações factuais, muitas vezes referidas como seu conhecimento de mundo ou visão de mundo. Quando ajustados, eles podem produzir resultados de última geração. No entanto, existem restrições à eficácia com que um LLM pode acessar e manipular esse conhecimento. Como resultado, em tarefas que dependem fortemente de conhecimentos específicos, o seu desempenho pode não ser ideal para determinados casos de utilização. Por exemplo, em cenários de perguntas e respostas, é essencial que o modelo siga estritamente o contexto fornecido no documento, sem depender apenas do seu conhecimento mundial. Desviar-se disso pode levar a deturpações, imprecisões ou até mesmo respostas incorretas. O método mais comumente usado para resolver esse problema é conhecido como Geração Aumentada de Recuperação (RAG). Esta abordagem sinergiza os pontos fortes dos modelos de recuperação e dos modelos de linguagem, melhorando a precisão e a qualidade das respostas geradas.

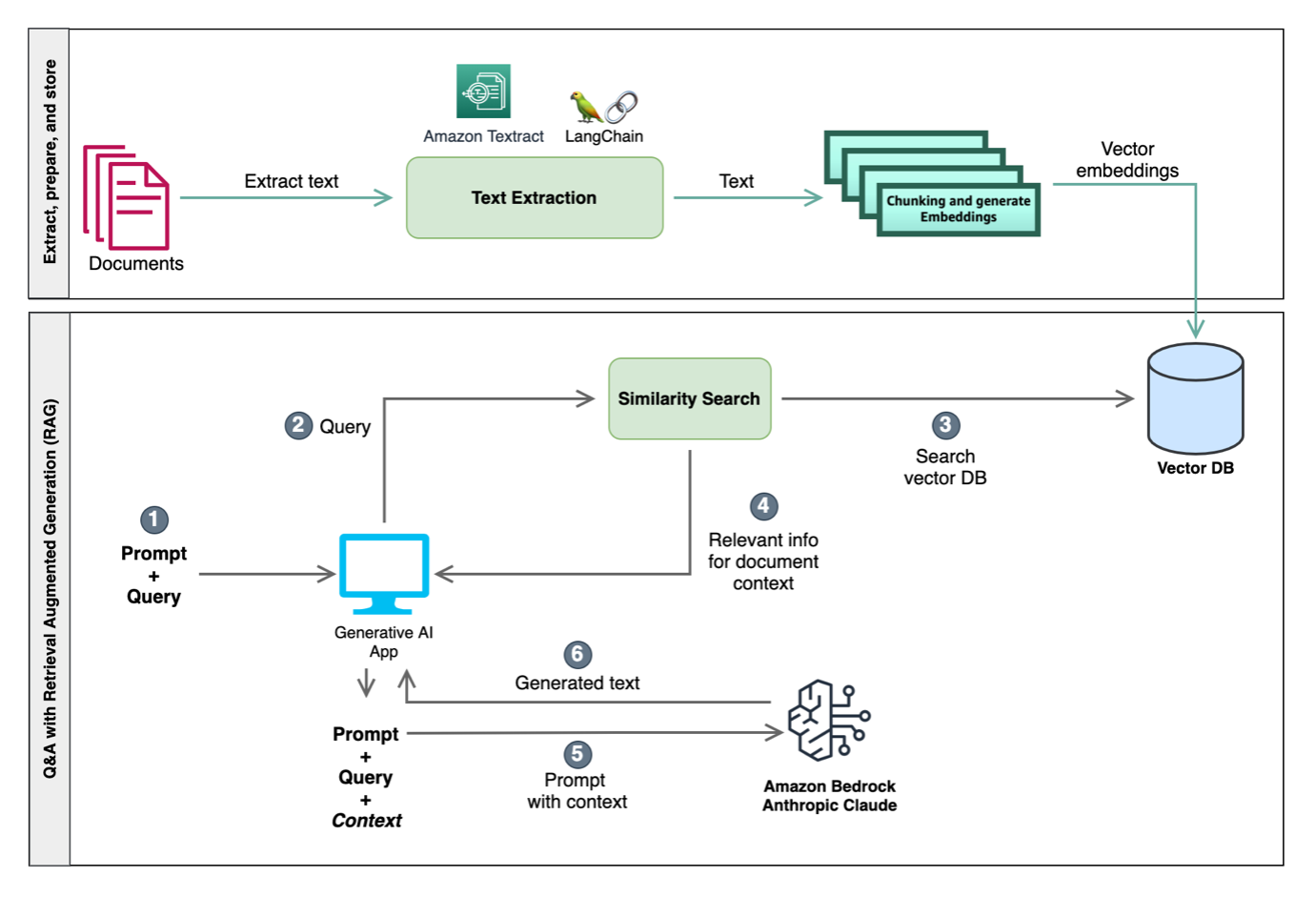

Os LLMs também podem impor limitações de token devido às suas restrições de memória e às limitações do hardware em que são executados. Para lidar com esse problema, técnicas como chunking são usadas para dividir documentos grandes em porções menores que cabem dentro dos limites de token dos LLMs. Por outro lado, os embeddings são empregados na PNL principalmente para capturar o significado semântico das palavras e suas relações com outras palavras em um espaço de alta dimensão. Essas incorporações transformam palavras em vetores, permitindo que os modelos processem e compreendam dados textuais com eficiência. Ao compreender as nuances semânticas entre palavras e frases, os embeddings permitem que os LLMs gerem resultados coerentes e contextualmente relevantes. Observe os seguintes termos-chave:

- fragmentação – Este processo divide grandes quantidades de texto de documentos em pedaços de texto menores e significativos.

- embeddings – Estas são transformações vetoriais de dimensão fixa de cada pedaço que retêm as informações semânticas dos pedaços. Essas incorporações são posteriormente carregadas em um banco de dados vetorial.

- Banco de dados de vetores – Este é um banco de dados de incorporações de palavras ou vetores que representam o contexto das palavras. Ele atua como uma fonte de conhecimento que auxilia tarefas de PNL em pipelines de processamento de documentos. O benefício do banco de dados vetorial aqui é que permite que apenas o contexto necessário seja fornecido aos LLMs durante a geração do texto, conforme explicamos na seção seguinte.

O RAG usa o poder dos embeddings para compreender e buscar segmentos relevantes de documentos durante a fase de recuperação. Ao fazer isso, o RAG pode trabalhar dentro das limitações simbólicas dos LLMs, garantindo que as informações mais pertinentes sejam selecionadas para geração, resultando em resultados mais precisos e contextualmente relevantes.

O diagrama seguinte ilustra a integração destas técnicas para elaborar os contributos para os LLMs, melhorando a sua compreensão contextual e permitindo respostas mais relevantes no contexto. Uma abordagem envolve pesquisa por similaridade, utilizando um banco de dados vetorial e chunking. O banco de dados vetorial armazena embeddings que representam informações semânticas, e o chunking divide o texto em seções gerenciáveis. Usando esse contexto de pesquisa por similaridade, os LLMs podem executar tarefas como resposta a perguntas e operações específicas de domínio, como classificação e enriquecimento.

Para esta postagem, usamos uma abordagem baseada em RAG para realizar perguntas e respostas contextualizadas com documentos. No exemplo de código a seguir, extraímos texto de um documento e depois dividimos o documento em pedaços menores de texto. A fragmentação é necessária porque podemos ter documentos grandes com várias páginas e nossos LLMs podem ter limites de tokens. Esses pedaços são então carregados no banco de dados vetorial para realizar a pesquisa de similaridade nas etapas subsequentes. No exemplo a seguir, usamos o modelo Amazon Titan Embed Text v1, que realiza os embeddings vetoriais dos pedaços do documento:

O código cria um contexto relevante para o LLM usando os pedaços de texto que são retornados pela ação de pesquisa por similaridade do banco de dados vetorial. Para este exemplo, usamos um código aberto Loja de vetores FAISS como um banco de dados vetorial de amostra para armazenar incorporações vetoriais de cada pedaço de texto. Definimos então o banco de dados vetorial como um Retriever LangChain, que é passado para o RetrievalQA corrente. Isso executa internamente uma consulta de pesquisa de similaridade no banco de dados vetorial que retorna os n principais (onde n=3 em nosso exemplo) pedaços de texto que são relevantes para a questão. Finalmente, a cadeia LLM é executada com o contexto relevante (um grupo de pedaços de texto relevantes) e a pergunta a ser respondida pelo LLM. Para obter uma explicação passo a passo do código de perguntas e respostas com RAG, consulte o notebook Python em GitHub.

Como alternativa ao FAISS, você também pode usar Recursos do banco de dados vetorial do Amazon OpenSearch Service, Amazon Relational Database Service (Amazon RDS) para PostgreSQL com o vetor pg extensão como bancos de dados vetoriais ou banco de dados Chroma de código aberto.

Perguntas e respostas com dados tabulares

Os dados tabulares em documentos podem ser um desafio para os LLMs processarem devido à sua complexidade estrutural. O Amazon Textract pode ser ampliado com LLMs porque permite extrair tabelas de documentos em um formato aninhado de elementos como página, tabela e células. A realização de perguntas e respostas com dados tabulares é um processo de várias etapas e pode ser alcançado por meio de auto-consulta. A seguir está uma visão geral das etapas:

- Extraia tabelas de documentos usando Amazon Textract. Com o Amazon Textract, a estrutura tabular (linhas, colunas, cabeçalhos) pode ser extraída de um documento.

- Armazene os dados tabulares em um banco de dados vetorial junto com informações de metadados, como os nomes dos cabeçalhos e a descrição de cada cabeçalho.

- Use o prompt para construir uma consulta estruturada, usando um LLM, para derivar os dados da tabela.

- Use a consulta para extrair os dados relevantes da tabela do banco de dados vetorial.

Por exemplo, em um extrato bancário, dada a pergunta “Quais são as transações com mais de US$ 1000 em depósitos”, o LLM concluiria as seguintes etapas:

- Crie uma consulta, como

“Query: transactions” , “filter: greater than (Deposit$)”. - Converta a consulta em uma consulta estruturada.

- Aplique a consulta estruturada ao banco de dados vetorial onde os dados da nossa tabela estão armazenados.

Para obter um exemplo passo a passo de código de perguntas e respostas com tabela, consulte o notebook Python em GitHub.

Modelagem e normalizações

Nesta seção, veremos como usar técnicas de engenharia imediata e o mecanismo integrado do LangChain para gerar uma saída com extrações de um documento em um esquema especificado. Também realizamos alguma padronização nos dados extraídos, utilizando as técnicas discutidas anteriormente. Começamos definindo um modelo para a saída desejada. Isto servirá como um esquema e encapsulará os detalhes sobre cada entidade que queremos extrair do texto do documento.

Observe que para cada uma das entidades, usamos a descrição para explicar o que é essa entidade para ajudar o LLM a extrair o valor do texto do documento. No código de exemplo a seguir, usamos este modelo para criar nosso prompt para o LLM junto com o texto extraído do documento usando AmazonTextractPDFLoader e posteriormente realizar inferência com o modelo:

Como você pode ver, o {keys} parte do prompt são as chaves do nosso modelo, e o {details} são as chaves junto com sua descrição. Nesse caso, não solicitamos explicitamente ao modelo o formato da saída, a não ser especificando na instrução para gerar a saída no formato JSON. Isso funciona na maior parte; entretanto, como a saída dos LLMs é a geração de texto não determinística, queremos especificar o formato explicitamente como parte da instrução no prompt. Para resolver isso, podemos usar o LangChain's analisador de saída estruturado módulo para aproveitar as vantagens da engenharia de prompt automatizado que ajuda a converter nosso modelo em um prompt de instrução de formato. Usamos o modelo definido anteriormente para gerar o prompt de instrução de formato da seguinte forma:

Em seguida, usamos essa variável em nosso prompt original como uma instrução para o LLM, para que ele extraia e formate a saída no esquema desejado, fazendo uma pequena modificação em nosso prompt:

Até agora, extraímos apenas os dados do documento em um esquema desejado. No entanto, ainda precisamos realizar alguma padronização. Por exemplo, queremos que a data de admissão e a data de alta do paciente sejam extraídas no formato DD/MM/AAAA. Neste caso, aumentamos o description da chave com a instrução de formatação:

Consulte o notebook Python em GitHub para obter um passo a passo completo e explicação.

Verificações ortográficas e correções

Os LLMs demonstraram habilidades notáveis na compreensão e geração de texto semelhante ao humano. Uma das aplicações menos discutidas, mas imensamente úteis, dos LLMs é o seu potencial em verificações gramaticais e correção de frases em documentos. Ao contrário dos verificadores gramaticais tradicionais que dependem de um conjunto de regras predefinidas, os LLMs usam padrões que identificaram a partir de grandes quantidades de dados de texto para determinar o que constitui uma linguagem correta ou fluente. Isso significa que eles podem detectar nuances, contexto e sutilezas que os sistemas baseados em regras podem não perceber.

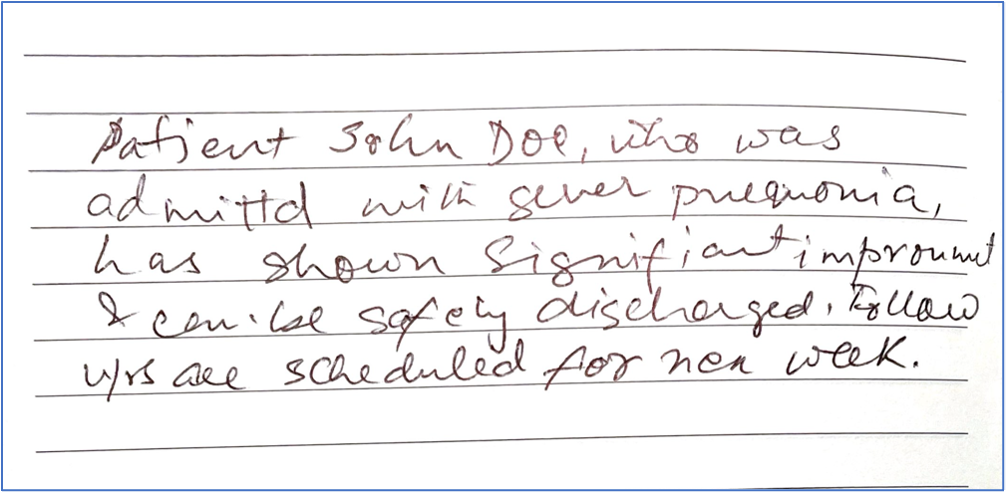

Imagine o texto extraído de um resumo de alta de um paciente que diz “O paciente Jon Doe, que foi internado com pneumonia grave, apresentou melhora significativa e pode receber alta com segurança. Os acompanhamentos estão agendados para a próxima semana. Um corretor ortográfico tradicional pode reconhecer “admitido”, “pneumonia”, “melhoria” e “próximo” como erros. No entanto, o contexto destes erros pode levar a novos erros ou sugestões genéricas. Um LLM, equipado com seu extenso treinamento, pode sugerir: “O paciente John Doe, que foi internado com pneumonia grave, apresentou melhora significativa e pode receber alta com segurança. Os acompanhamentos estão agendados para a próxima semana.”

O que se segue é um exemplo de documento mal manuscrito com o mesmo texto explicado anteriormente.

Extraímos o documento com um carregador de documentos Amazon Textract e, em seguida, instruímos o LLM, por meio de engenharia imediata, para retificar o texto extraído para corrigir quaisquer erros ortográficos e/ou gramaticais:

A saída do código anterior mostra o texto original extraído pelo carregador de documentos seguido pelo texto corrigido gerado pelo LLM:

Tenha em mente que, por mais poderosos que sejam os LLMs, é essencial ver suas sugestões apenas como isso: sugestões. Embora captem impressionantemente bem as complexidades da linguagem, eles não são infalíveis. Algumas sugestões podem alterar o significado pretendido ou o tom do texto original. Portanto, é crucial que os revisores humanos usem as correções geradas pelo LLM como um guia, e não como um valor absoluto. A colaboração da intuição humana com capacidades LLM promete um futuro onde a nossa comunicação escrita não será apenas livre de erros, mas também mais rica e matizada.

Conclusão

A IA generativa está mudando a forma como você pode processar documentos com IDP para obter insights. Na postagem Aprimorando o processamento inteligente de documentos da AWS com IA generativa, discutimos os vários estágios do pipeline e como o cliente da AWS, Ricoh, está aprimorando seu pipeline de IDP com LLMs. Nesta postagem, discutimos vários mecanismos para aumentar o fluxo de trabalho do IDP com LLMs por meio do Amazon Bedrock, Amazon Textract e da popular estrutura LangChain. Você pode começar a usar o novo carregador de documentos Amazon Textract com LangChain hoje mesmo usando os blocos de notas de exemplo disponíveis em nosso Repositório GitHub. Para obter mais informações sobre como trabalhar com IA generativa na AWS, consulte Anunciando novas ferramentas para criar com IA generativa na AWS.

Sobre os autores

Sonali Sahu está liderando o processamento inteligente de documentos com a equipe de serviços AI/ML na AWS. Ela é autora, líder de pensamento e tecnóloga apaixonada. Sua principal área de foco é IA e ML, e ela costuma falar em conferências e encontros de IA e ML em todo o mundo. Ela tem ampla e profunda experiência em tecnologia e no setor de tecnologia, com experiência no setor de saúde, setor financeiro e seguros.

Sonali Sahu está liderando o processamento inteligente de documentos com a equipe de serviços AI/ML na AWS. Ela é autora, líder de pensamento e tecnóloga apaixonada. Sua principal área de foco é IA e ML, e ela costuma falar em conferências e encontros de IA e ML em todo o mundo. Ela tem ampla e profunda experiência em tecnologia e no setor de tecnologia, com experiência no setor de saúde, setor financeiro e seguros.

Anjan Biswas é arquiteto sênior de soluções de serviços de IA com foco em IA/ML e análise de dados. Anjan faz parte da equipe mundial de serviços de IA e trabalha com clientes para ajudá-los a entender e desenvolver soluções para problemas de negócios com IA e ML. Anjan tem mais de 14 anos de experiência trabalhando com organizações globais de cadeia de suprimentos, manufatura e varejo, e está ajudando ativamente os clientes a começar e escalar nos serviços de IA da AWS.

Anjan Biswas é arquiteto sênior de soluções de serviços de IA com foco em IA/ML e análise de dados. Anjan faz parte da equipe mundial de serviços de IA e trabalha com clientes para ajudá-los a entender e desenvolver soluções para problemas de negócios com IA e ML. Anjan tem mais de 14 anos de experiência trabalhando com organizações globais de cadeia de suprimentos, manufatura e varejo, e está ajudando ativamente os clientes a começar e escalar nos serviços de IA da AWS.

Chinmayee Rane é arquiteto de soluções especialista em IA/ML na Amazon Web Services. Ela é apaixonada por matemática aplicada e aprendizado de máquina. Ela se concentra no design de processamento inteligente de documentos e soluções generativas de IA para clientes da AWS. Fora do trabalho, ela gosta de dançar salsa e bachata.

Chinmayee Rane é arquiteto de soluções especialista em IA/ML na Amazon Web Services. Ela é apaixonada por matemática aplicada e aprendizado de máquina. Ela se concentra no design de processamento inteligente de documentos e soluções generativas de IA para clientes da AWS. Fora do trabalho, ela gosta de dançar salsa e bachata.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- PlatoHealth. Inteligência em Biotecnologia e Ensaios Clínicos. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/intelligent-document-processing-with-amazon-textract-amazon-bedrock-and-langchain/

- :tem

- :é

- :não

- :onde

- .nex

- $1000

- $UP

- 1

- 10

- 100

- 11

- 12

- 13

- 14

- 15%

- 16

- 22

- 23

- 33

- 35%

- 7

- 9

- a

- habilidades

- Sobre

- absoluto

- Acesso

- acessadas

- Segundo

- precisão

- preciso

- alcançado

- em

- Açao Social

- ações

- ativamente

- atividade

- atos

- Ad

- endereço

- Adiciona

- aderir

- Admitem

- admitiu

- avanços

- Vantagem

- advento

- idade

- agentes

- AI

- Serviços de IA

- AI / ML

- alinhado

- Todos os Produtos

- Permitindo

- permite

- juntamente

- tb

- alternativa

- Apesar

- Amazon

- Amazon Comprehend

- Amazon RDS

- amazontext

- Amazon Web Services

- quantidades

- an

- analítica

- analisar

- e

- responder

- Antrópico

- qualquer

- APIs

- aplicações

- aplicado

- nomeações

- abordagem

- arquitetura

- SOMOS

- ÁREA

- por aí

- Arte

- artificial

- inteligência artificial

- Inteligência artificial (AI)

- AS

- aspecto

- auxiliar

- Assistente

- At

- aumentar

- aumentado

- autor

- automatizar

- Automatizado

- automaticamente

- Automação

- disponível

- consciência

- AWS

- Cliente AWS

- Bank

- BE

- Porque

- torna-se

- sido

- antes

- benéfico

- beneficiar

- MELHOR

- melhores práticas

- entre

- Bloquear

- Blocos

- ambos

- largura

- Break

- quebra

- construir

- Prédio

- construídas em

- negócio

- negócios

- mas a

- by

- chamadas

- CAN

- Pode obter

- capacidades

- capturar

- casas

- casos

- Células

- certo

- cadeia

- correntes

- desafiar

- desafiante

- alterar

- Alterações

- mudança

- Cheques

- escolha

- reivindicações

- classe

- aulas

- classificação

- classificar

- código

- COERENTE

- colaboração

- Coluna

- colunas

- combinação

- combinar

- vem

- comum

- geralmente

- Comunicação

- compatível

- completar

- integrações

- complexidade

- compreender

- conciso

- conferências

- Conexão de

- consistente

- consiste

- restrições

- construir

- não contenho

- contida

- contém

- conteúdo

- contexto

- contextual

- converter

- núcleo

- correta

- corrigida

- Correções

- poderia

- artesanato

- Crafted

- cria

- crucial

- personalizadas

- cliente

- Clientes

- Dançando

- dados,

- Análise de Dados

- banco de dados

- bases de dados

- Data

- Datas

- acordo

- profundo

- mais profunda

- definir

- definido

- definição

- demonstraram

- Dependendo

- depósitos

- profundidade

- descrito

- descrição

- concepção

- desejado

- detalhe

- detalhado

- detalhes

- descobrir

- Determinar

- desenvolver

- desenvolvedores

- Dieta

- diferente

- diretamente

- discutir

- discutido

- mergulho

- dividir

- divide

- do

- Médico

- documento

- documentação

- INSTITUCIONAIS

- corça

- Não faz

- fazer

- don

- feito

- não

- down

- dramaticamente

- dois

- durante

- dinâmico

- e

- cada

- Mais cedo

- facilmente

- fácil de usar

- efetivamente

- eficiência

- eficiente

- eficientemente

- esforços

- ou

- elementos

- embutir

- empregada

- empodera

- permitir

- permite

- permitindo

- final

- Engenharia

- aumentar

- aprimorada

- aprimorando

- garantir

- assegurando

- Todo

- entidades

- entidade

- equipado

- erros

- essencial

- Mesmo

- exemplo

- Exceto

- exceção

- existente

- vasta experiência

- experiência

- Explicação

- explicado

- Explica

- explicação

- explicitamente

- expressão

- estender

- extensão

- extenso

- extrato

- Extração

- Extractos

- Cair

- falso

- longe

- fadiga

- Campos

- Figura

- final

- Finalmente

- financeiro

- Setor financeiro

- Primeiro nome

- caber

- Foco

- concentra-se

- seguir

- seguido

- seguinte

- segue

- Escolha

- formato

- formas

- encontrado

- Foundation

- Quadro

- Gratuito

- freqüentemente

- da

- Frontier

- cheio

- totalmente

- mais distante

- futuro

- Geral

- gerar

- gerado

- gera

- gerando

- geração

- generativo

- IA generativa

- ter

- OFERTE

- dado

- Global

- gramática

- aperto

- maior

- Grupo

- guia

- mão

- manipular

- acontecer

- Acontecimento

- Hardware

- Ter

- cabeçalhos

- saúde

- fortemente

- ajudar

- útil

- ajuda

- ajuda

- sua experiência

- SUA PARTICIPAÇÃO FAZ A DIFERENÇA

- de alto nível

- Alta performance

- superior

- detém

- hospital

- Como funciona o dobrador de carta de canal

- Como Negociar

- Contudo

- HTML

- HTTPS

- humano

- i

- ID

- identificado

- if

- ilustra

- imagem

- imensamente

- Impacto

- importar

- importante

- importador

- impor

- melhoria

- in

- Incluindo

- índice

- indústria

- INFORMAÇÕES

- Era da informação

- Inovação

- entrada

- insights

- instância

- instruções

- com seguro

- integrar

- integrado

- Integração

- integração

- Inteligência

- Inteligente

- Processamento inteligente de documentos

- Pretendido

- internamente

- para dentro

- complexidades

- introduzir

- introduzido

- Introduz

- IT

- ESTÁ

- Jackson

- banheiro

- JOHN DOE

- jon

- jpg

- json

- apenas por

- Chave

- chaves

- Saber

- Conhecimento

- conhecido

- língua

- grande

- traçado

- conduzir

- líder

- principal

- aprendizagem

- partida

- Biblioteca

- como

- Provável

- limitações

- limites

- Lista

- LLM

- carregar

- carregador

- lógica

- olhar

- lote

- máquina

- aprendizado de máquina

- Fazendo

- gerencia

- manejável

- gerenciados

- gestão

- manual

- fabrica

- marcado

- matemática

- Posso..

- me

- significado

- significativo

- significa

- mecanismo

- mecanismos

- Meetups

- Memória

- Meta

- metadados

- método

- métodos

- poder

- mente

- perder

- erros

- ML

- modelo

- modelos

- Módulo

- mais

- Mortgages

- a maioria

- múltiplo

- nome

- nomes

- natural

- Processamento de linguagem natural

- necessário

- você merece...

- necessário

- Cria

- Novo

- Próximo

- semana que vem

- PNL

- caderno

- agora

- nuances

- número

- objeto

- objetos

- of

- Oferece

- frequentemente

- on

- ONE

- só

- open source

- Operações

- Oportunidade

- ideal

- Opções

- or

- organizações

- original

- Outros

- de outra forma

- A Nossa

- Fora

- Resultado

- saída

- outputs

- lado de fora

- Acima de

- Visão geral

- pacotes

- página

- páginas

- Dor

- emparelhado

- pares

- parte

- particularmente

- passar

- passou

- Passagem

- apaixonado

- caminho

- paciente

- padrão

- padrões

- para

- Realizar

- atuação

- realizada

- realização

- executa

- fase

- phd

- Frases

- oleoduto

- plano

- platão

- Inteligência de Dados Platão

- PlatãoData

- por favor

- pneumonia

- pontos

- Popular

- possível

- Publique

- potencial

- poder

- alimentado

- poderoso

- práticas

- justamente

- Precisão

- preferido

- presente

- anteriormente

- principalmente

- Impressão

- impressões

- Problema

- problemas

- processo

- Processado

- em processamento

- produzir

- promessas

- adequado

- fornecer

- fornecido

- provedor

- fornece

- Python

- Dúvidas

- qualidade

- questão

- Links

- rapidamente

- Cru

- Leitura

- reconhecer

- redução

- referir

- referência

- a que se refere

- Relacionamentos

- relevante

- depender

- contando

- notável

- Denunciar

- representar

- representando

- requeridos

- exige

- respectivamente

- respostas

- restrições

- resultar

- resultando

- Resultados

- varejo

- reter

- retenção

- Retorna

- Rico

- Quarto

- regras

- Execute

- é executado

- s

- seguramente

- mesmo

- dizer

- Escala

- cenários

- programado

- Pesquisar

- Segundo

- Seção

- seções

- setor

- Vejo

- segmentos

- selecionado

- senior

- sentença

- Série

- servir

- serve

- serviço

- Serviços

- conjunto

- grave

- ela

- Baixo

- rede de apoio social

- mostrando

- Shows

- periodo

- solteiro

- pequeno

- menor

- fragmento

- So

- unicamente

- Soluções

- RESOLVER

- alguns

- fonte

- Espaço

- fala

- especialista

- específico

- especificamente

- especificada

- ortografia

- divisão

- Estágio

- estandardização

- começo

- começado

- estado-da-arte

- Declaração

- Passo

- Passos

- Ainda

- loja

- armazenadas

- lojas

- pontos fortes

- Tanga

- estrutural

- estrutura

- estruturada

- Lutar

- subseqüente

- Subseqüentemente

- tal

- sugerir

- resumir

- RESUMO

- supply

- cadeia de suprimentos

- ajuda

- suportes

- sinergia

- sistemas

- mesa

- Tire

- toma

- Tarefa

- tarefas

- Profissionais

- técnica

- técnicas

- tecnólogo

- Tecnologia

- modelo

- condições

- texto

- textual

- do que

- que

- A

- o mundo

- deles

- Eles

- então

- Lá.

- assim sendo

- Este

- deles

- isto

- pensamento

- três

- Através da

- titã

- para

- hoje

- hoje

- juntos

- token

- Tokens

- TOM

- ferramentas

- topo

- Total

- tradicional

- Trailing

- Training

- Transações

- Transformar

- transformações

- verdadeiro

- tentar

- dois

- tipo

- tipos

- compreender

- compreensão

- ao contrário

- desvelando

- URL

- usar

- caso de uso

- usava

- usuários

- usos

- utilização

- utilizado

- Utilizando

- v1

- valor

- Valores

- variável

- vário

- Grande

- versátil

- versão

- via

- Ver

- volumes

- Passo a passo

- queremos

- foi

- Caminho..

- we

- web

- serviços web

- semana

- BEM

- O Quê

- quando

- qual

- enquanto

- QUEM

- precisarão

- de

- dentro

- sem

- testemunhado

- Word

- palavras

- Atividades:

- de gestão de documentos

- fluxos de trabalho

- trabalhar

- trabalho

- mundo

- seria

- escrito

- X

- anos

- Vocês

- zefirnet