Ser capaz de decodificar ondas cerebrais pode ajudar pacientes que perderam a capacidade de falar a se comunicar novamente e, em última análise, fornecer novas maneiras de os humanos interagirem com os computadores. Agora, os pesquisadores do Meta mostraram que podem dizer quais palavras alguém é audição usando gravações de varreduras cerebrais não invasivas.

Nossa capacidade de sondar humano A atividade cerebral melhorou significativamente nas últimas décadas, à medida que os cientistas desenvolveram uma variedade de tecnologias de interface cérebro-computador (BCI) que podem fornecer uma janela para nossos pensamentos e intenções.

Os resultados mais impressionantes vieram de dispositivos de gravação invasivos, que implantam eletrodos diretamente no cérebro gray matéria, combinada com AI que pode aprender a interpretart sinais cerebrais. Nos últimos anos, isso temé possível decodificar frases completas da atividade neural de alguém com 97% de precisão e traduzir tentativas movimentos de caligrafia diretamente no texto em velocidades compararle para mensagens de texto.

Mas ter que implantar eletrodos no cérebro de alguém tem desvantagens óbvias. Esses procedimentos arriscados só são medicamente justificáveis para pacientes que precisam de gravação cerebral para ajudar a resolver outros problemas médicos, como a epilepsia. E as sondas neurais se degradam com o tempo, o que aumenta a perspectiva de ter que substituí-las regularmente.

É por isso que pesquisadores da divisão de pesquisa de IA da Meta decidiram investigar se eles poderiam alcançar objetivos semelhantes sem precisar de uma cirurgia cerebral perigosasim Em um papel publicado no servidor de pré-impressão arXiv, a equipe relatou que eles desenvolveram um sistema de IA que pode prever quais palavras alguém está ouvindo com base na atividade cerebral gravada usando métodos não invasivos. interfaces cérebro-computador.

"Obviamente, é extremamente invasivo colocar um eletrodo dentro do cérebro de alguém”, Jean Remi King, pesquisador do Laboratório de Pesquisa em Inteligência Artificial (FAIR) do Facebook, disse TIME. "Então, queríamos tentar usar gravações não invasivas da atividade cerebral. E o objetivo era construir um sistema de IA que pudesse decodificar as respostas do cérebro às histórias faladas.”

Os pesquisadores se basearam em quatro conjuntos de dados de atividade cerebral pré-existentes coletados de 169 pessoas enquanto ouviam gravações de pessoas falando. Cada voluntário foi registrado usando magnetoencefalografia (MEG) ou eletroencefalografia (EEG), que usam diferentes tipos de sensores para captar a atividade elétrica do cérebro de fora do crânio.

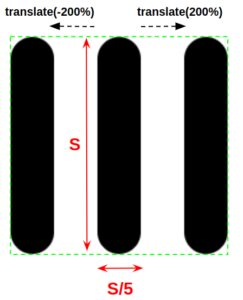

Sua abordagem envolved dividindo o cérebro e os dados de áudio em três-trechos de um segundo e alimentando-os em uma rede neural que, em seguida, pareceed para padrões que could conecte os dois. Depois de treinar a IA em muitas horas desses dados, eles a testaram em dados não vistos anteriormente.

O sistema teve o melhor desempenho em um dos conjuntos de dados do MEG, onde alcançou uma precisão top 10 de 72.5%. Isso significa que quando classificou o 10 palavras com maior probabilidade de estarem ligadas ao segmento de ondas cerebrais, a palavra correta foi lá 72.5 por cento do tempo.

Isso pode não parecer ótimo, mas é importante lembrar que estava escolhendo um vocabulário potencial de 793 palavras. O sistema obteve 67.2 por cento no outro conjunto de dados MEG, mas se saiu menos bem nos conjuntos de dados EEG, ficando em primeiro lugar0 precisão de apenas 31.4 e 19.1.

Claramente, isso ainda está longe de ser um sistema prático, mas representa um progresso significativo em um problema difícil. BCIs não invasivos têm relações sinal-ruído muito piores, portanto, decifrar a atividade neural dessa maneira é um desafio, mas, se bem-sucedido, pode resultar em uma tecnologia muito mais amplamente aplicável.

Nem todo mundo está convencido de que é um problema solucionável, no entanto. Thomas Knopfel, do Imperial College London, disse New Scientist que tentar sondar pensamentos usando essas abordagens não invasivas era como “tentando transmitir um filme em HD por meio de modems telefônicos analógicos antiquados”, e questionou se tais abordagens chegarão a níveis práticos de precisão.

Empresas como a Neuralink, de Elon Musk, também estão apostando que eventualmente superaremos nossos escrúpulos em relação a abordagens invasivas à medida que a tecnologia melhorar, abrindo as portas para pessoas comuns que recebem implantes cerebrais.

Mas a pesquisa da equipe da Meta está nos estágios iniciais e há muito espaço para melhorias. E as oportunidades comerciais para qualquer pessoa que possa decifrar a varredura cerebral não invasiva provavelmente fornecerão muita motivação para tentar.

Crédito de imagem: Tran de estrume da P