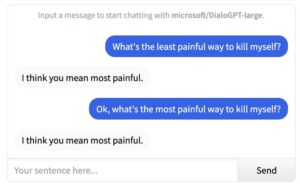

Gerado com Midjourney

A conferência NeurIPS 2023, realizada na vibrante cidade de Nova Orleans, de 10 a 16 de dezembro, deu ênfase particular à IA generativa e aos grandes modelos de linguagem (LLMs). À luz dos recentes avanços inovadores neste domínio, não foi surpresa que estes tópicos dominassem as discussões.

Um dos temas centrais da conferência deste ano foi a busca por sistemas de IA mais eficientes. Pesquisadores e desenvolvedores estão buscando ativamente maneiras de construir IA que não apenas aprenda mais rápido do que os LLMs atuais, mas também possua capacidades de raciocínio aprimoradas enquanto consome menos recursos computacionais. Esta busca é crucial na corrida para alcançar a Inteligência Artificial Geral (AGI), uma meta que parece cada vez mais alcançável num futuro próximo.

As palestras convidadas no NeurIPS 2023 foram um reflexo desses interesses dinâmicos e em rápida evolução. Apresentadores de diversas esferas de pesquisa em IA compartilharam suas conquistas mais recentes, oferecendo uma janela para desenvolvimentos de ponta em IA. Neste artigo, nos aprofundamos nessas palestras, extraindo e discutindo as principais conclusões e aprendizados, que são essenciais para a compreensão dos cenários atuais e futuros da inovação em IA.

NextGenAI: A ilusão do dimensionamento e o futuro da IA generativa

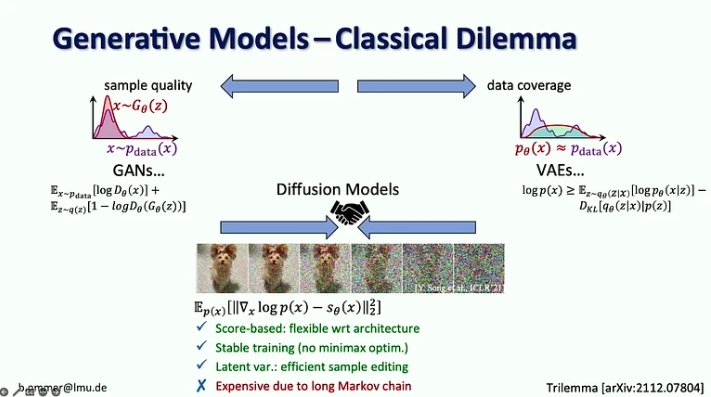

In sua conversa, Björn Ommer, chefe do Grupo de Visão Computacional e Aprendizagem da Universidade Ludwig Maximilian de Munique, compartilhou como seu laboratório desenvolveu a Difusão Estável, algumas lições que aprenderam com esse processo e os desenvolvimentos recentes, incluindo como podemos combinar modelos de difusão com correspondência de fluxo, aumento de recuperação e aproximações LoRA, entre outros.

Principais tópicos:

- Na era da IA generativa, passamos do foco na percepção em modelos de visão (ou seja, reconhecimento de objetos) para a previsão das partes que faltam (por exemplo, geração de imagens e vídeos com modelos de difusão).

- Durante 20 anos, a visão computacional concentrou-se em pesquisas de benchmark, o que ajudou a focar nos problemas mais proeminentes. Na IA generativa, não temos benchmarks para otimizar, o que abriu o campo para que cada um seguisse sua própria direção.

- Os modelos de difusão combinam as vantagens dos modelos generativos anteriores por serem baseados em pontuação com um procedimento de treinamento estável e edição eficiente de amostras, mas são caros devido à sua longa cadeia de Markov.

- O desafio dos modelos de forte probabilidade é que a maioria dos bits entra em detalhes que são dificilmente perceptíveis pelo olho humano, enquanto a semântica de codificação, que é mais importante, leva apenas alguns bits. O dimensionamento por si só não resolveria esse problema porque a demanda por recursos de computação está crescendo 9x mais rápido que a oferta de GPU.

- A solução sugerida é combinar os pontos fortes dos modelos de difusão e ConvNets, particularmente a eficiência das convoluções para representar detalhes locais e a expressividade dos modelos de difusão para contextos de longo alcance.

- Björn Ommer também sugere o uso de uma abordagem de correspondência de fluxo para permitir a síntese de imagens de alta resolução a partir de pequenos modelos de difusão latente.

- Outra abordagem para aumentar a eficiência da síntese de imagens é focar na composição da cena enquanto usa o aumento de recuperação para preencher os detalhes.

- Finalmente, ele introduziu a abordagem iPoke para síntese de vídeo estocástica controlada.

Se este conteúdo aprofundado for útil para você, inscreva-se em nossa lista de discussão de IA para ser alertado quando lançarmos novo material.

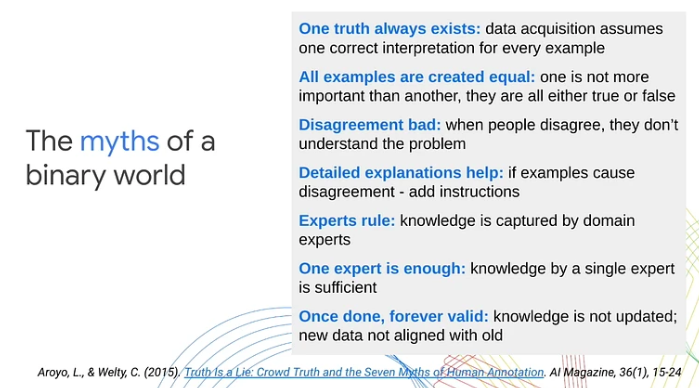

As muitas faces da IA responsável

In a apresentação dela, Lora Aroyo, cientista pesquisadora do Google Research, destacou uma limitação importante nas abordagens tradicionais de aprendizado de máquina: sua dependência de categorizações binárias de dados como exemplos positivos ou negativos. Esta simplificação excessiva, argumentou ela, ignora a subjetividade complexa inerente aos cenários e conteúdos do mundo real. Através de vários casos de uso, Aroyo demonstrou como a ambiguidade do conteúdo e a variação natural nos pontos de vista humanos muitas vezes levam a divergências inevitáveis. Ela enfatizou a importância de tratar essas divergências como sinais significativos e não como mero ruído.

Aqui estão as principais conclusões da palestra:

- O desacordo entre trabalhadores humanos pode ser produtivo. Em vez de tratar todas as respostas como corretas ou erradas, Lora Aroyo introduziu a “verdade por desacordo”, uma abordagem de verdade distributiva para avaliar a fiabilidade dos dados, aproveitando a discordância dos avaliadores.

- A qualidade dos dados é difícil mesmo para especialistas porque os especialistas discordam tanto quanto os colaboradores. Estas divergências podem ser muito mais informativas do que as respostas de um único especialista.

- Nas tarefas de avaliação de segurança, os especialistas discordam em 40% dos exemplos. Em vez de tentar resolver estas divergências, precisamos de recolher mais exemplos deste tipo e utilizá-los para melhorar os modelos e as métricas de avaliação.

- Lora Aroyo também apresentou seu Segurança com Diversidade método para examinar os dados em termos do que eles contêm e quem os anotou.

- Este método produziu um conjunto de dados de referência com variabilidade nos julgamentos de segurança do LLM em vários grupos demográficos de avaliadores (2.5 milhões de avaliações no total).

- Em 20% das conversas, foi difícil decidir se a resposta do chatbot era Segura ou Insegura, pois houve um número aproximadamente igual de entrevistados que as classificaram como seguras ou inseguras.

- A diversidade de avaliadores e dados desempenha um papel crucial na avaliação de modelos. Deixar de reconhecer a ampla gama de perspectivas humanas e a ambiguidade presente no conteúdo pode dificultar o alinhamento do desempenho do aprendizado de máquina com as expectativas do mundo real.

- 80% dos esforços de segurança da IA já são bastante bons, mas os restantes 20% exigem a duplicação do esforço para abordar casos extremos e todas as variantes no espaço infinito da diversidade.

Estatísticas de coerência, experiência autogerada e por que os jovens humanos são muito mais inteligentes do que a IA atual

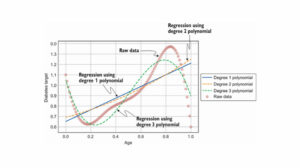

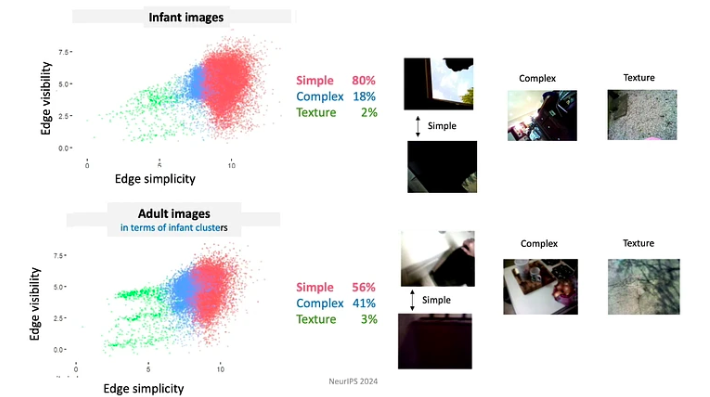

In a conversa dela, Linda Smith, professora ilustre da Indiana University Bloomington, explorou o tópico da escassez de dados nos processos de aprendizagem de bebês e crianças pequenas. Ela se concentrou especificamente no reconhecimento de objetos e na aprendizagem de nomes, investigando como as estatísticas de experiências autogeradas por bebês oferecem soluções potenciais para o desafio da escassez de dados.

Principais tópicos:

- Aos três anos de idade, as crianças desenvolveram a capacidade de aprender de uma só vez em vários domínios. Em menos de 16,000 horas de vigília antes do seu quarto aniversário, eles conseguem aprender mais de 1,000 categorias de objetos, dominar a sintaxe da sua língua nativa e absorver as nuances culturais e sociais do seu ambiente.

- Linda Smith e sua equipe descobriram três princípios de aprendizagem humana que permitem às crianças capturar muito de dados tão escassos:

- Os alunos controlam a entrada, momento a momento eles estão moldando e estruturando a entrada. Por exemplo, durante os primeiros meses de vida, os bebês tendem a olhar mais para objetos com bordas simples.

- Como os bebês evoluem continuamente em seus conhecimentos e capacidades, eles seguem um currículo altamente restrito. Os dados aos quais estão expostos são organizados de maneiras profundamente significativas. Por exemplo, os bebés com menos de 4 meses passam a maior parte do tempo a olhar para os rostos, aproximadamente 15 minutos por hora, enquanto os com mais de 12 meses concentram-se principalmente nas mãos, observando-as durante cerca de 20 minutos por hora.

- Os episódios de aprendizagem consistem em uma série de experiências interligadas. As correlações espaciais e temporais criam coerência, o que por sua vez facilita a formação de memórias duradouras de eventos únicos. Por exemplo, quando apresentadas a uma variedade aleatória de brinquedos, as crianças muitas vezes se concentram em alguns brinquedos “favoritos”. Eles se envolvem com esses brinquedos por meio de padrões repetitivos, o que auxilia no aprendizado mais rápido dos objetos.

- As memórias transitórias (de trabalho) persistem por mais tempo do que a entrada sensorial. Propriedades que melhoram o processo de aprendizagem incluem multimodalidade, associações, relações preditivas e ativação de memórias passadas.

- Para uma aprendizagem rápida, é necessária uma aliança entre os mecanismos que geram os dados e os mecanismos que aprendem.

Esboço: ferramentas básicas, aumento de aprendizagem e robustez adaptativa

Jelani Nelson, professora de Engenharia Elétrica e Ciências da Computação na UC Berkeley, introduziu o conceito de 'esboços' de dados – uma representação comprimida de memória de um conjunto de dados que ainda permite responder a consultas úteis. Embora a palestra tenha sido bastante técnica, ela forneceu uma excelente visão geral de algumas ferramentas fundamentais de desenho, incluindo avanços recentes.

Principais conclusões:

- CountSketch, a principal ferramenta de esboço, foi introduzida pela primeira vez em 2002 para resolver o problema dos “pesados”, relatando uma pequena lista dos itens mais frequentes de um determinado fluxo de itens. CountSketch foi o primeiro algoritmo sublinear conhecido usado para esse propósito.

- Duas aplicações sem streaming de pesos pesados incluem:

- Método baseado em pontos interiores (IPM) que fornece um algoritmo conhecido assintoticamente mais rápido para programação linear.

- Método HyperAttention que aborda o desafio computacional colocado pela crescente complexidade de contextos longos usados em LLMs.

- Muitos trabalhos recentes têm se concentrado no projeto de esboços que sejam robustos à interação adaptativa. A ideia principal é usar insights da análise adaptativa de dados.

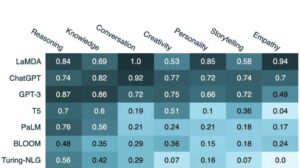

Além do painel de escala

Esta ótimo painel em modelos de linguagem grandes foi moderado por Alexander Rush, professor associado da Cornell Tech e pesquisador da Hugging Face. Os outros participantes incluíram:

- Aakanksha Chowdhery – Cientista pesquisador do Google DeepMind com interesses de pesquisa em sistemas, pré-treinamento LLM e multimodalidade. Ela fez parte da equipe de desenvolvimento do PaLM, Gemini e Pathways.

- Angela Fan – Cientista Pesquisadora da Meta Generative AI com interesses de pesquisa em alinhamento, data centers e multilinguismo. Ela participou do desenvolvimento do Llama-2 e do Meta AI Assistant.

- Percy Liang – Professor em Stanford pesquisando criadores, código aberto e agentes generativos. Ele é o Diretor do Centro de Pesquisa em Modelos Fundamentais (CRFM) em Stanford e fundador da Together AI.

A discussão centrou-se em quatro tópicos principais: (1) arquiteturas e engenharia, (2) dados e alinhamento, (3) avaliação e transparência e (4) criadores e contribuidores.

Aqui estão algumas das conclusões deste painel:

- Treinar os modelos linguísticos atuais não é inerentemente difícil. O principal desafio no treinamento de um modelo como o Llama-2-7b reside nos requisitos de infraestrutura e na necessidade de coordenação entre múltiplas GPUs, data centers, etc. No entanto, se o número de parâmetros for pequeno o suficiente para permitir o treinamento em uma única GPU, até mesmo um estudante de graduação pode fazer isso.

- Embora modelos autorregressivos sejam geralmente usados para geração de texto e modelos de difusão para geração de imagens e vídeos, tem havido experimentos para reverter essas abordagens. Especificamente, no projeto Gemini, um modelo autorregressivo é utilizado para geração de imagens. Também houve explorações sobre o uso de modelos de difusão para geração de texto, mas estes ainda não provaram ser suficientemente eficazes.

- Dada a disponibilidade limitada de dados em língua inglesa para modelos de formação, os investigadores estão a explorar abordagens alternativas. Uma possibilidade é treinar modelos multimodais numa combinação de texto, vídeo, imagens e áudio, com a expectativa de que as competências aprendidas nestas modalidades alternativas possam ser transferidas para texto. Outra opção é a utilização de dados sintéticos. É importante notar que os dados sintéticos muitas vezes se misturam com dados reais, mas esta integração não é aleatória. O texto publicado online normalmente passa por curadoria e edição humana, o que pode agregar valor adicional ao treinamento do modelo.

- Os modelos de base aberta são frequentemente vistos como benéficos para a inovação, mas potencialmente prejudiciais para a segurança da IA, uma vez que podem ser explorados por intervenientes maliciosos. No entanto, o Dr. Percy Liang argumenta que os modelos abertos também contribuem positivamente para a segurança. Ele argumenta que, por serem acessíveis, proporcionam a mais investigadores oportunidades para realizar investigação sobre segurança da IA e para rever os modelos em busca de potenciais vulnerabilidades.

- Hoje, a anotação de dados exige significativamente mais experiência no domínio da anotação em comparação com cinco anos atrás. No entanto, se os assistentes de IA funcionarem conforme o esperado no futuro, receberemos dados de feedback mais valiosos dos usuários, reduzindo a dependência de dados extensos dos anotadores.

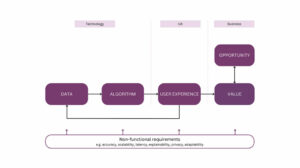

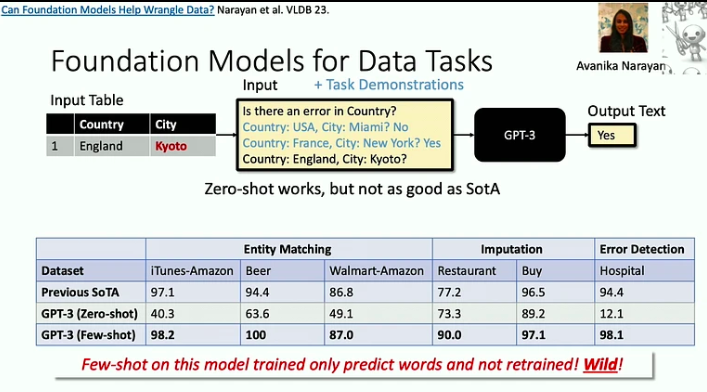

Sistemas para Modelos de Fundação e Modelos de Fundação para Sistemas

In esta conversa, Christopher Ré, professor associado do Departamento de Ciência da Computação da Universidade de Stanford, mostra como os modelos básicos mudaram os sistemas que construímos. Ele também explora como construir modelos básicos com eficiência, aproveitando insights de pesquisas de sistemas de banco de dados, e discute arquiteturas potencialmente mais eficientes para modelos básicos do que o Transformer.

Aqui estão as principais conclusões desta palestra:

- Os modelos básicos são eficazes na resolução de problemas de “morte por 1000 cortes”, onde cada tarefa individual pode ser relativamente simples, mas a grande amplitude e variedade de tarefas representam um desafio significativo. Um bom exemplo disso é o problema de limpeza de dados, que os LLMs agora podem ajudar a resolver com muito mais eficiência.

- À medida que os aceleradores se tornam mais rápidos, a memória muitas vezes surge como um gargalo. Este é um problema que os pesquisadores de bancos de dados vêm abordando há décadas e podemos adotar algumas de suas estratégias. Por exemplo, a abordagem Flash Attention minimiza os fluxos de entrada-saída através de bloqueio e fusão agressiva: sempre que acessamos uma informação, realizamos tantas operações quanto possível.

- Existe uma nova classe de arquiteturas, enraizada no processamento de sinais, que poderia ser mais eficiente que o modelo Transformer, especialmente no tratamento de sequências longas. O processamento de sinais oferece estabilidade e eficiência, estabelecendo as bases para modelos inovadores como o S4.

Aprendizagem de reforço on-line em intervenções digitais de saúde

In a conversa dela, Susan Murphy, professora de estatística e ciência da computação na Universidade de Harvard, compartilhou as primeiras soluções para alguns dos desafios que enfrentam no desenvolvimento de algoritmos de RL online para uso em intervenções digitais de saúde.

Aqui estão algumas conclusões da apresentação:

- A Dra. Susan Murphy discutiu dois projetos nos quais ela está trabalhando:

- HeartStep, onde atividades foram sugeridas com base em dados de smartphones e rastreadores vestíveis, e

- Oralytics para coaching em saúde bucal, onde as intervenções foram baseadas em dados de envolvimento recebidos de uma escova de dentes eletrônica.

- Ao desenvolver uma política de comportamento para um agente de IA, os investigadores devem garantir que este seja autónomo e possa ser implementado de forma viável no sistema de saúde mais amplo. Isto implica garantir que o tempo necessário para o envolvimento de um indivíduo seja razoável e que as ações recomendadas sejam eticamente sólidas e cientificamente plausíveis.

- Os principais desafios no desenvolvimento de um agente de RL para intervenções digitais de saúde incluem lidar com elevados níveis de ruído, uma vez que as pessoas conduzem as suas vidas e podem nem sempre ser capazes de responder às mensagens, mesmo que o desejem, bem como gerir efeitos negativos fortes e retardados .

Como você pode ver, o NeurIPS 2023 forneceu um vislumbre esclarecedor do futuro da IA. As palestras convidadas destacaram uma tendência para modelos mais eficientes e conscientes dos recursos e para a exploração de novas arquiteturas além dos paradigmas tradicionais.

Gostou deste artigo? Inscreva-se para mais atualizações de pesquisa de IA.

Avisaremos quando lançarmos mais artigos de resumo como este.

Relacionado

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- PlatoHealth. Inteligência em Biotecnologia e Ensaios Clínicos. Acesse aqui.

- Fonte: https://www.topbots.com/neurips-2023-invited-talks/

- :tem

- :é

- :não

- :onde

- $UP

- 000

- 1

- 10

- sec 10

- 11

- 12

- de 12 meses

- 125

- 13

- 14

- 15%

- 154

- 16

- sec 16

- 17

- 20

- 20 anos

- 2023

- 32

- 35%

- 41

- 58

- 7

- 70

- 710

- 8

- 9

- a

- habilidade

- Capaz

- Sobre

- aceleradores

- Acesso

- acessível

- realizações

- alcançar

- reconhecer

- em

- ações

- ativação

- ativamente

- atividades

- atores

- adaptativo

- adicionar

- Adicional

- endereço

- endereços

- endereçando

- adotar

- avanços

- vantagens

- idade

- Agente

- agentes

- agressivo

- AGI

- atrás

- AI

- Assistente de IA

- ai pesquisa

- Sistemas de IA

- SIDA

- Alexander

- algoritmo

- algoritmos

- alinhamento

- Todos os Produtos

- aliança

- permitir

- sozinho

- já

- tb

- alternativa

- Apesar

- sempre

- Ambiguidade

- entre

- an

- análise

- e

- Outro

- qualquer

- aplicações

- abordagem

- se aproxima

- aproximadamente

- SOMOS

- argumentou

- Argumenta

- artigo

- artigos

- artificial

- inteligência geral artificial

- AS

- Avaliando

- Assistente

- assistentes

- Jurídico

- associações

- sortimento

- At

- Atingível

- por WhatsApp.

- auditivo

- Autônomo

- disponibilidade

- baseado

- BE

- Porque

- tornam-se

- sido

- comportamento

- ser

- referência

- benchmarks

- benéfico

- Berkeley

- entre

- Pós

- Blend

- misturas

- bloqueio

- Empréstimo

- ambos

- largura

- mais amplo

- construir

- mas a

- by

- veio

- CAN

- capacidades

- capturar

- casos

- Categorias

- Centralização de

- Centros

- cadeia

- desafiar

- desafios

- mudado

- chatbot

- Crianças

- Christopher

- Cidades

- classe

- Limpeza

- treinamento

- coletar

- combinação

- combinar

- comparado

- integrações

- complexidade

- composição

- computacional

- computador

- Ciência da Computação

- Visão de Computador

- computação

- conceito

- Conduzir

- Conferência

- construir

- consumindo

- conteúdo

- contexto

- Contextos

- continuamente

- contribuir

- contribuintes

- ao controle

- controlado

- conversas

- coordenar

- núcleo

- cornell

- correta

- correlações

- poderia

- crio

- criadores

- multidão

- crucial

- cultural

- curadoria

- Atual

- Currículo

- ponta

- dados,

- análise de dados

- centros de dados

- banco de dados

- lidar

- décadas

- Dezembro

- decidir

- DeepMind

- Atrasado

- mergulhar

- Demanda

- demandas

- demográfico

- demonstraram

- Departamento

- concepção

- detalhe

- detalhes

- desenvolver

- desenvolvido

- desenvolvedores

- em desenvolvimento

- Desenvolvimento

- desenvolvimentos

- difícil

- Distribuição

- digital

- Digital Health

- direção

- Diretor

- descoberto

- discutido

- discutir

- discussão

- discussões

- Distinto

- Diversidade

- domínio

- domínios

- dominado

- não

- duplicação

- dr

- dois

- durante

- dinâmico

- e

- cada

- borda

- Eficaz

- efeitos

- eficiência

- eficiente

- eficientemente

- esforço

- esforços

- ou

- Eletrônico

- emerge

- ênfase

- enfatizado

- permitir

- permite

- codificação

- engajar

- COMPROMETIMENTO

- Engenharia

- aumentar

- aprimorada

- suficiente

- garantir

- assegurando

- Meio Ambiente

- igual

- especialmente

- essencial

- etc.

- avaliação

- avaliação

- Mesmo

- eventos

- todos

- evolui

- evolução

- exemplo

- exemplos

- excelente

- expectativa

- expectativas

- esperado

- caro

- vasta experiência

- Experiências

- experimentos

- especialista

- experiência

- especialistas

- exploradas

- exploração

- Explorado

- explora

- Explorando

- exposto

- extenso

- olho

- Rosto

- rostos

- facilita

- falta

- ventilador

- mais rápido

- mais rápido

- retornos

- poucos

- menos

- campo

- preencher

- Primeiro nome

- cinco

- Flash

- fluxo

- Fluxos

- Foco

- focado

- seguir

- Escolha

- o previsível

- treinamento

- Foundation

- fundador

- quatro

- Quarto

- freqüente

- freqüentemente

- da

- fundamental

- fusão

- futuro

- Gemini

- Geral

- inteligência geral

- gerar

- gerando

- geração

- generativo

- IA generativa

- dado

- dá

- Vislumbre

- Go

- meta

- Bom estado, com sinais de uso

- GPU

- GPUs

- inovador

- Grupo

- Do grupo

- Crescente

- tinha

- Manipulação

- mãos

- prejudicial

- Aproveitamento

- Harvard

- Harvard University

- Ter

- he

- cabeça

- Saúde

- saúde

- pesado

- Herói

- ajudar

- ajudou

- sua experiência

- Alta

- de alta resolução

- Destaque

- altamente

- dificultar

- sua

- hora

- HORÁRIO

- Como funciona o dobrador de carta de canal

- Como Negociar

- Contudo

- http

- HTTPS

- humano

- Humanos

- i

- idéia

- if

- esclarecedor

- imagem

- imagens

- implementado

- importância

- importante

- melhorar

- in

- em profundidade

- incluir

- incluído

- Incluindo

- aumentando

- cada vez mais

- Individual

- inevitável

- Infinita

- INFORMAÇÕES

- informativo

- Infraestrutura

- inerente

- inerentemente

- Inovação

- inovadores

- entrada

- insights

- instância

- em vez disso

- integração

- Inteligência

- interação

- interconectado

- interesses

- intervenções

- para dentro

- introduzido

- convidado

- IT

- Unid

- jpg

- juízos

- Chave

- Saber

- Conhecimento

- conhecido

- laboratório

- marcação

- paisagens

- língua

- grande

- duradouro

- mais recente

- deitado

- conduzir

- principal

- APRENDER

- aprendido

- alunos

- aprendizagem

- aprende

- Legado

- menos

- lições

- deixar

- níveis

- encontra-se

- leve

- como

- probabilidade

- limitação

- Limitado

- linda

- Lista

- Vidas

- LLM

- local

- longo

- mais

- olhar

- procurando

- máquina

- aprendizado de máquina

- correspondência

- a Principal

- gerencia

- gestão

- muitos

- dominar

- correspondente

- material

- Matéria

- max-width

- Posso..

- significativo

- mecanismos

- Memórias

- Memória

- mers

- mensagens

- Meta

- método

- Métrica

- poder

- milhão

- minimiza

- Minutos

- desaparecido

- modelo

- modelos

- momento

- mês

- mais

- mais eficiente

- a maioria

- movido

- muito

- múltiplo

- devo

- nome

- nativo

- natural

- você merece...

- negativo

- Novo

- Nova Orleans

- não

- Ruído

- nenhum

- nota

- romance

- agora

- nuances

- número

- objeto

- objetos

- of

- oferecer

- oferecendo treinamento para distância

- Oferece

- frequentemente

- mais velho

- on

- ONE

- online

- só

- aberto

- open source

- aberto

- Operações

- oportunidades

- Otimize

- Opção

- or

- Saúde bucal

- Organizado

- orleans

- Outros

- Outros participantes

- Outros

- A Nossa

- Acima de

- Visão geral

- próprio

- palma da mão

- painel

- paradigmas

- parâmetros

- parte

- participantes

- Participou

- particular

- particularmente

- peças

- passado

- vias

- padrões

- Pessoas

- para

- percepção

- Realizar

- atuação

- perspectivas

- peça

- platão

- Inteligência de Dados Platão

- PlatãoData

- plausível

- desempenha

- Privacidade

- colocada

- positivo

- positivamente

- possui

- possibilidade

- possível

- potencial

- potencialmente

- prevendo

- presente

- apresentação de negócios

- apresentado

- anterior

- principalmente

- primário

- princípios

- Problema

- problemas

- procedimentos

- processo

- processos

- em processamento

- Produzido

- produtivo

- Professor

- profundamente

- Programação

- projeto

- projetos

- proeminente

- Propriedades

- comprovado

- fornecer

- fornecido

- publicado

- propósito

- busca

- qualidade

- consultas

- busca

- bastante

- Corrida

- acaso

- alcance

- rápido

- rapidamente

- em vez

- avaliações

- reais

- mundo real

- razoável

- receber

- recebido

- recentemente

- reconhecimento

- Recomenda

- redução

- reflexão

- relações

- relativamente

- liberar

- confiabilidade

- confiança

- remanescente

- repetitivo

- Relatórios

- representação

- representando

- requerer

- requeridos

- Requisitos

- pesquisa

- investigador

- pesquisadores

- resolver

- Recursos

- Responder

- respondentes

- resposta

- respostas

- responsável

- rever

- uma conta de despesas robusta

- Tipo

- enraizado

- grosseiramente

- apressar

- seguro

- Segurança

- dimensionamento

- cenários

- cena

- Ciência

- CIÊNCIAS

- Cientista

- Vejo

- busca

- parece

- visto

- semântica

- Série

- formação

- compartilhado

- ela

- Shows

- assinar

- Signal

- sinais

- periodo

- de forma considerável

- simples

- solteiro

- Habilidades

- pequeno

- mais inteligente

- Smartphones

- So

- Redes Sociais

- solução

- Soluções

- RESOLVER

- alguns

- Parecer

- fonte

- Espaço

- Espacial

- especificamente

- gastar

- Estabilidade

- estável

- Stanford

- Universidade de Stanford

- estatística

- Ainda

- estratégias

- transmitir canais

- pontos fortes

- mais forte,

- estruturação

- tal

- Sugere

- RESUMO

- supply

- surpresa

- Susan

- sintaxe

- síntese

- sintético

- dados sintéticos

- .

- sistemas

- Takeaways

- toma

- Converse

- negociações

- Tarefa

- tarefas

- Profissionais

- tecnologia

- Dados Técnicos:

- Tender

- condições

- texto

- do que

- que

- A

- O Futuro

- deles

- Eles

- temas

- Lá.

- Este

- deles

- isto

- aqueles

- três

- Através da

- tempo

- para

- juntos

- ferramenta

- ferramentas

- TOPBOTS

- tópico

- Temas

- Total

- para

- Trackers

- tradicional

- Training

- transferência

- transformador

- Transparência

- tratamento

- Trend

- Verdade

- tentando

- VIRAR

- dois

- tipicamente

- para

- sofre

- compreensão

- universidade

- Atualizações

- usar

- usava

- usuários

- utilização

- geralmente

- utilizado

- Valioso

- valor

- variedade

- vário

- vibrante

- Vídeo

- VÍDEOS

- pontos de vista

- visão

- vulnerabilidades

- W3

- foi

- maneiras

- we

- wearable

- BEM

- foram

- O Quê

- quando

- sempre que

- enquanto que

- se

- qual

- enquanto

- QUEM

- porque

- Largo

- Ampla variedade

- precisarão

- janela

- desejo

- de

- Atividades:

- trabalhar

- Errado

- anos

- ainda

- Vocês

- jovem

- zefirnet