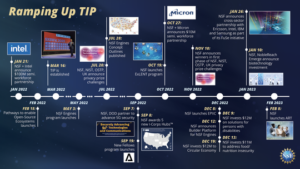

No mês passado, o programa Networking and Information Technology Research and Development (NITRD) comemorou seu 30º aniversário em Washington DC Você pode ler a recapitulação completa do evento SUA PARTICIPAÇÃO FAZ A DIFERENÇA. Em um esforço para destacar o impacto que os investimentos federais tiveram na comunidade de pesquisa em computação, o evento contou com cinco painéis nos quais os participantes discutiram as principais conquistas no campo na última década e as direções futuras. Cada painel concentrou-se em uma importante subárea de pesquisa computacional: Computação em Escala, Redes e Segurança, Inteligência Artificial/Aprendizado de Máquina, Privacidade e Internet das Coisas e Computação Socialmente Responsável.

A privacidade tornou-se um grande tópico de conversa não apenas entre a comunidade de pesquisa em computação, mas em todas as disciplinas, tanto na academia quanto na indústria. Os efeitos adversos da privacidade decorrentes da disponibilidade de conjuntos de dados em larga escala estão sendo multiplicados pela sensores, dispositivos e atuadores interconectados que compõem a Internet das Coisas (IoT). Moderado por Charles (“Chuck”) Romine (NIST) e com os especialistas de campo Ed Felten (Princeton), Marc Groman (Groman Consulting), Katerina Megas (NIST) e Sunoo Park (Cornell), Painel 4: Privacidade e IoT discute tópicos importantes, como as compensações entre uso de dados e privacidade e possíveis objetivos de pesquisa para ajudar a alcançar soluções políticas eficazes.

Romine começou destacando um ponto comum em todos os painéis: “falando sobre os benefícios e as capacidades extraordinárias fornecidas por meio de investimentos de financiamento federal, juntamente com os riscos associados”. A IoT não é diferente, ela traz às pessoas acesso a informações intransponíveis, permite campanhas publicitárias bem-sucedidas e adapta a tecnologia ao seu gosto pessoal, mas também coloca em risco a privacidade do usuário.

Como Megas apontou, “A razão pela qual estamos realizando esse esforço é porque queremos realmente ver a IoT reconhecida e que a sociedade colha os benefícios”. Ela passou a compartilhar os benefícios potenciais e a importância de poder compartilhar dados em IoT. Existe uma escala “fenomenal” de dispositivos em IoT que podem ser usados para identificar problemas em conjuntos de dados, aprender coisas que têm alto potencial de impacto para indivíduos e sociedade, treinar tecnologias de Inteligência Artificial e permitir que pequenas empresas inovadoras testem seus dispositivos. Romine perguntou aos palestrantes quais são realmente os riscos de privacidade associados nesse contexto de IoT e compartilhamento de informações.

Groman respondeu explicando primeiro a interação entre privacidade e IoT. O lado da privacidade da IoT é um subconjunto de dados dentro do conjunto maior que está sendo coletado, que é sobre ou relacionado a pessoas. As pessoas sabem que estão sendo coletados dados sobre elas? Existe uma interface onde você possa interagir com o dispositivo, saber o que ele está coletando ou alterá-lo? As pessoas entendem quais informações estão sendo coletadas ou quais inferências estão sendo feitas pelo dispositivo ou empresa a partir dos dados coletados? Devido à estrutura de incentivos monetários e à “vasta” quantidade de muitos que as empresas podem ganhar ao capitalizar esses dados, Groman exortou as pessoas a recorrerem à política para uma solução.

“O objetivo aqui é maximizar os benefícios e minimizar os danos. Não temos uma estrutura política, legal ou regulatória neste país que produza incentivos para chegar lá” – Marc Groman

Contrariando a postura de Groman, Romine perguntou ao painel sobre o potencial de uma solução tecnológica.

Felten sugeriu que comecemos buscando entender e aplicar melhor o controle estatístico de informações e construir ferramentas que permitam às pessoas interagir com seus dados e mitigar impactos negativos. Park, que tem um interesse particular em ferramentas de privacidade criptográfica, citou várias maneiras pelas quais a criptografia pode ajudar nesse sentido.

“A criptografia fornece um kit de ferramentas para construir sistemas que possuem configurações de fluxos de informações e incluem controle mais refinado sobre o acesso”. – Parque Sunoo

Uma das ferramentas poderia ser as provas de conhecimento zero, que permitem o compartilhamento parcial de dados, mantendo outros aspectos em segredo das entidades. Ela deu o exemplo de um segurança verificando IDs para entrar em um bar – por meio de provas de conhecimento zero, você pode provar que tem 21 anos sem compartilhar seu endereço ou aniversário também listado no ID.

Park alertou que, embora a criptografia forneça “um espaço de solução maior que podemos usar para criar privacidade”, ela não responde à questão de que tipos de coisas devemos construir usando essas ferramentas ou que formas de informação consideramos apropriadas ou desejáveis para compartilhar. Isso é algo que temos que resolver como sociedade e uma questão de política.

Por fim, perguntou-se aos palestrantes por que as pessoas deveriam se importar. E se eles não tiverem nada a esconder? Ganhando risadas da multidão, Felten brincou que todo mundo tem algo a esconder. Em uma nota mais séria, ele continuou destacando o dano potencial na criação de perfis de dados.

“As pessoas estão construindo um modelo abrangente de quem você é e o que provavelmente fará.” – Ed Felten

Já um pensamento aterrorizante, essas suposições podem estar erradas e às vezes limitar as oportunidades e a “liberdade de ação” no futuro. Groman apontou outro ponto comum nas discussões dos painéis – a importância de perceber que algumas comunidades estão sendo impactadas desproporcionalmente. As apostas podem ser maiores para manter alguns dados privados, seja por orientação sexual, gênero, raça ou mulheres ou crianças abusadas.

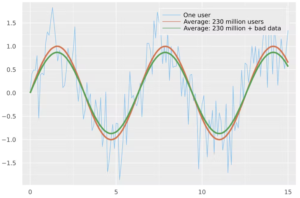

Durante as perguntas e respostas, o ex-falante do painel 3, Ben Zorn, falou sobre os benefícios dos dados usados para treinar a IA. Ele perguntou sobre o que poderia ser feito sobre o vazamento de informações privadas através dos conjuntos de dados usados para treinar a IA.

Felten apontou que, a menos que você esteja usando um método rigoroso para interromper intencionalmente o fluxo de informações, as informações fluirão. É por isso que é tão importante se concentrar na construção de métodos rigorosos e comprováveis de coisas como aprendizado de máquina e interfaces para preservar a privacidade para controlar o efeito trickle-down.

Megas resumiu perfeitamente que, no final, não podemos treinar todo mundo, mas podemos fornecer às pessoas uma estrutura que lhes permita pensar sobre o risco e fornecer ferramentas para que tenham maior controle sobre seus dados. Você pode assistir a gravação completa no página do CCC ou em canal do NIRD no YouTube.

Esteja atento ao blog final da série, Painel 5: Como a tecnologia pode beneficiar a sociedade: ampliando as perspectivas na pesquisa fundamental.