Este é o segundo post de uma série de quatro partes que detalha como Grupo NatWest, uma importante instituição de serviços financeiros, em parceria com Serviços Profissionais AWS para construir uma nova plataforma de operações de aprendizado de máquina (MLOps). Nesta postagem, compartilhamos como o Grupo NatWest utilizou a AWS para permitir a implantação de autoatendimento de sua plataforma MLOps padronizada, segura e compatível usando Catálogo de serviços da AWS e Amazon Sage Maker. Isso levou a uma redução no tempo necessário para provisionar novos ambientes, de dias para apenas algumas horas.

Acreditamos que os decisores podem beneficiar deste conteúdo. CTOs, CDAOs, cientistas de dados seniores e engenheiros de nuvem seniores podem seguir esse padrão para fornecer soluções inovadoras para suas equipes de ciência de dados e engenharia.

Leia toda a série:

|

Tecnologia no Grupo NatWest

O NatWest Group é um banco de relacionamento para um mundo digital que fornece serviços financeiros a mais de 19 milhões de clientes em todo o Reino Unido. O Grupo possui um portfólio de tecnologia diversificado, onde as soluções para os desafios de negócios são frequentemente entregues usando designs personalizados e com prazos longos.

Recentemente, o NatWest Group adotou uma estratégia cloud-first, que permitiu à empresa utilizar serviços geridos para fornecer recursos de computação e armazenamento a pedido. Essa mudança levou a uma melhoria geral na estabilidade, escalabilidade e desempenho das soluções de negócios, ao mesmo tempo em que reduziu custos e acelerou a cadência de entrega. Além disso, a mudança para a nuvem permite que o NatWest Group simplifique sua pilha de tecnologia, aplicando um conjunto de designs de soluções consistentes, repetíveis e pré-aprovados para atender aos requisitos regulatórios e operar de maneira controlada.

Desafios

Os estágios piloto de adoção de uma abordagem que prioriza a nuvem envolveram diversas fases de experimentação e avaliação, utilizando uma ampla variedade de serviços analíticos na AWS. As primeiras iterações da plataforma em nuvem do NatWest Group para cargas de trabalho de ciência de dados enfrentaram desafios com o provisionamento de ambientes em nuvem consistentes, seguros e compatíveis. O processo de criação de novos ambientes levava de alguns dias a semanas ou até meses. A dependência de equipes de plataforma central para criar, provisionar, proteger, implantar e gerenciar infraestrutura e fontes de dados dificultou a integração de novas equipes para trabalhar na nuvem.

Devido à disparidade na configuração da infraestrutura entre contas da AWS, as equipes que decidiram migrar suas cargas de trabalho para a nuvem tiveram que passar por um elaborado processo de conformidade. Cada componente da infraestrutura teve que ser analisado separadamente, o que aumentou os prazos de auditoria de segurança.

Começar a desenvolver na AWS envolveu a leitura de um conjunto de guias de documentação escritos pelas equipes da plataforma. As etapas iniciais de configuração do ambiente incluíram o gerenciamento de chaves públicas e privadas para autenticação, a configuração de conexões com serviços remotos usando o Interface de linha de comando da AWS (AWS CLI) ou SDK de ambientes de desenvolvimento locais e execução de scripts personalizados para vincular IDEs locais a serviços em nuvem. Os desafios técnicos muitas vezes dificultavam a integração de novos membros da equipe. Depois que os ambientes de desenvolvimento foram configurados, o caminho para lançar o software em produção foi igualmente complexo e demorado.

Conforme descrito na Parte 1 desta série, a equipe conjunta do projeto coletou grandes quantidades de feedback sobre a experiência do usuário e os requisitos das equipes do NatWest Group antes de construir a nova plataforma de ciência de dados e MLOps. Um tema comum neste feedback foi a necessidade de automação e padronização como precursor da entrega rápida e eficiente de projetos na AWS. A nova plataforma usa serviços gerenciados pela AWS para otimizar custos, reduzir esforços de configuração de plataforma e reduzir a pegada de carbono resultante da execução de trabalhos de computação desnecessariamente grandes. A padronização está incorporada no coração da plataforma, com componentes de infraestrutura pré-aprovados, totalmente configurados, seguros, compatíveis e reutilizáveis que podem ser compartilhados entre equipes de dados e análises.

Por que o SageMaker Studio?

A equipe escolheu Estúdio Amazon SageMaker como a principal ferramenta para construir e implantar pipelines de ML. O Studio fornece uma interface única baseada na Web que oferece aos usuários acesso, controle e visibilidade completos em cada etapa necessária para construir, treinar e implantar modelos. A maturidade do Studio IDE (ambiente de desenvolvimento integrado) para desenvolvimento de modelos, rastreamento de metadados, gerenciamento de artefatos e implantação estavam entre os recursos que atraíram fortemente a equipe do NatWest Group.

Os cientistas de dados do NatWest Group trabalham com notebooks SageMaker dentro do Studio durante os estágios iniciais de desenvolvimento do modelo para realizar análise de dados, organização de dados e engenharia de recursos. Depois que os usuários estiverem satisfeitos com os resultados desse trabalho inicial, o código será facilmente convertido em funções combináveis para transformação de dados, treinamento de modelo, inferência, registro em log e testes de unidade, para que fique pronto para produção.

Os estágios posteriores do ciclo de vida de desenvolvimento do modelo envolvem o uso de Pipelines Amazon SageMaker, que pode ser inspecionado visualmente e monitorado no Studio. Os pipelines são visualizados em um DAG (gráfico acíclico direcionado) que codifica as etapas com cores com base em seu estado enquanto o pipeline é executado. Além disso, um resumo Logs do Amazon CloudWatch é exibido próximo ao DAG para facilitar a depuração de etapas com falha. Os cientistas de dados recebem um modelo de código que consiste em todas as etapas fundamentais de um pipeline do SageMaker. Isso fornece uma estrutura padronizada (consistente entre todos os usuários da plataforma para facilitar a colaboração e o compartilhamento de conhecimento) na qual os desenvolvedores podem adicionar a lógica personalizada e o código do aplicativo específico para o desafio de negócios que estão resolvendo.

Os desenvolvedores executam os pipelines no Studio IDE para garantir que suas alterações de código sejam integradas corretamente a outras etapas do pipeline. Depois que as alterações de código forem revisadas e aprovadas, esses pipelines serão criados e executados automaticamente com base em um gatilho de ramificação do repositório Git principal. Durante o treinamento do modelo, as métricas de avaliação do modelo são armazenadas e rastreadas no SageMaker Experiments, que podem ser usadas para ajuste de hiperparâmetros. Depois que um modelo é treinado, o artefato do modelo é armazenado no Registro de modelo SageMaker, juntamente com metadados relacionados a contêineres de modelo, dados usados durante o treinamento, recursos de modelo e código de modelo. O registro do modelo desempenha um papel fundamental no processo de implantação do modelo porque empacota todas as informações do modelo e permite a automação da promoção do modelo para ambientes de produção.

Engenheiros de MLOps implantam gerenciamento Trabalhos de transformação em lote do SageMaker, que pode ser dimensionado para atender às demandas da carga de trabalho. Tanto os trabalhos de inferência em lote offline quanto os modelos online servidos por meio de um endpoint usam a funcionalidade de inferência gerenciada do SageMaker. Isso beneficia as equipes de plataforma e de aplicativos de negócios porque os engenheiros de plataforma não perdem mais tempo configurando componentes de infraestrutura para inferência de modelos, e as equipes de aplicativos de negócios não escrevem códigos clichê adicionais para configurar e interagir com instâncias de computação.

Por que o AWS Service Catalog?

A equipe escolheu o AWS Service Catalog para criar um catálogo de modelos de infraestrutura seguros, compatíveis e pré-aprovados. Os componentes de infraestrutura em um produto AWS Service Catalog são pré-configurados para atender aos requisitos de segurança do NatWest Group. O gerenciamento de acesso a funções, políticas de recursos, configuração de rede e políticas de controle central são configurados para cada recurso empacotado em um produto AWS Service Catalog. Os produtos são versionados e compartilhados com as equipes de aplicação seguindo um processo padrão que permite que as equipes de ciência de dados e engenharia se autoatendam e implantem a infraestrutura imediatamente após obterem acesso às suas contas da AWS.

As equipes de desenvolvimento de plataforma podem evoluir facilmente os produtos do AWS Service Catalog ao longo do tempo para permitir a implementação de novos recursos com base nos requisitos de negócios. Alterações iterativas nos produtos são feitas com a ajuda do controle de versão de produtos do AWS Service Catalog. Quando uma nova versão do produto é lançada, a equipe da plataforma mescla as alterações de código na ramificação principal do Git e incrementa a versão do produto AWS Service Catalog. Existe um certo grau de autonomia e flexibilidade na atualização da infraestrutura porque as contas de aplicações empresariais podem utilizar versões anteriores dos produtos antes de migrarem para a versão mais recente.

Visão geral da solução

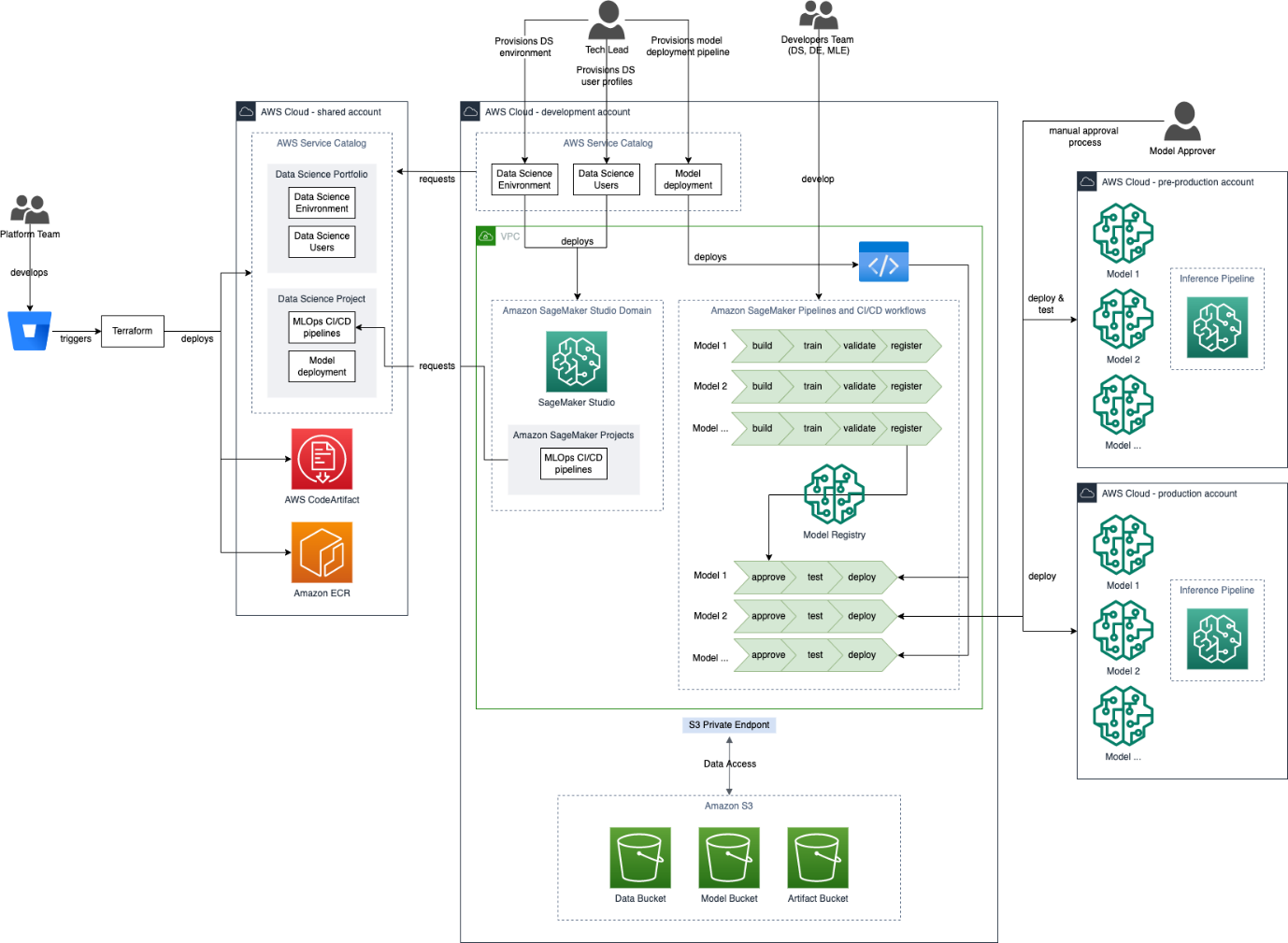

O diagrama de arquitetura de alto nível a seguir mostra como um caso de uso de aplicativo de negócios típico é implantado na AWS. As seções a seguir fornecem mais detalhes sobre a arquitetura da conta, como a infraestrutura é implantada, o gerenciamento de acesso do usuário e como os diferentes serviços da AWS são usados para criar soluções de ML.

Conforme mostrado no diagrama de arquitetura, as contas seguem um modelo hub and spoke. Uma conta de plataforma compartilhada serve como uma conta central, onde os recursos exigidos pelas contas da equipe de aplicativos de negócios (spoke) são hospedados pela equipe da plataforma. Esses recursos incluem o seguinte:

- Uma biblioteca de produtos de infraestrutura padronizados e seguros usados para implantações de infraestrutura de autoatendimento, hospedada pelo AWS Service Catalog

- Imagens Docker, armazenadas em Registro do Amazon Elastic Container (Amazon ECR), que são usados durante a execução das etapas do pipeline do SageMaker e inferência de modelo

- AWS CodeArtifact repositórios, que hospedam pacotes Python pré-aprovados

Esses recursos são compartilhados automaticamente com contas spoke por meio do recurso de importação e compartilhamento de portfólio do AWS Service Catalog e Gerenciamento de acesso e identidade da AWS (IAM) no caso do Amazon ECR e do CodeArtifact.

Cada equipe de aplicativos de negócios recebe três contas da AWS no ambiente de infraestrutura do NatWest Group: desenvolvimento, pré-produção e produção. Os nomes dos ambientes referem-se à função pretendida da conta no ciclo de vida de desenvolvimento da ciência de dados. A conta de desenvolvimento é usada para realizar análise e organização de dados, escrever modelo e código de pipeline de modelo, treinar modelos e acionar implantações de modelo em ambientes de pré-produção e produção por meio do SageMaker Studio. A conta de pré-produção reflete a configuração da conta de produção e é usada para testar implantações de modelo e trabalhos de transformação em lote antes de serem liberados para produção. A conta de produção hospeda modelos e executa cargas de trabalho de inferência de produção.

Gerenciamento de usuários

O NatWest Group possui processos de governança rígidos para impor a separação de funções dos usuários. Cinco funções IAM separadas foram criadas para cada persona de usuário.

A equipe da plataforma usa as seguintes funções:

- Engenheiro de suporte de plataforma – Essa função contém permissões para tarefas normais e uma visualização somente leitura do restante do ambiente para monitorar e depurar a plataforma.

- Engenheiro de correção de plataforma – Esta função foi criada com permissões elevadas. É usado se houver problemas com a plataforma que exijam intervenção manual. Esta função só é assumida de forma aprovada e limitada no tempo.

As equipes de desenvolvimento de aplicativos de negócios têm três funções distintas:

- Líder técnico – Essa função é atribuída ao líder da equipe de aplicação, geralmente um cientista de dados sênior. Este usuário tem permissão para implantar e gerenciar produtos do AWS Service Catalog, acionar versões para produção e revisar o status do ambiente, como AWS Code Pipeline status e registros. Esta função não tem permissão para aprovar um modelo no registro de modelos do SageMaker.

- Developer – Essa função é atribuída a todos os membros da equipe que trabalham com o SageMaker Studio, o que inclui engenheiros, cientistas de dados e, muitas vezes, o líder da equipe. Esta função tem permissões para abrir o Studio, escrever código e executar e implantar pipelines do SageMaker. Assim como o líder técnico, esta função não tem permissão para aprovar um modelo no registro de modelos.

- Aprovador de modelo – Esta função tem permissões limitadas relacionadas à visualização, aprovação e rejeição de modelos no registro de modelos. A razão para esta separação é evitar que quaisquer utilizadores que possam construir e treinar modelos aprovem e liberem os seus próprios modelos em ambientes escalonados.

Perfis de usuário separados do Studio são criados para desenvolvedores e aprovadores de modelos. A solução usa uma combinação de declarações de política do IAM e tags de perfil de usuário do SageMaker para que os usuários só tenham permissão para abrir um perfil de usuário que corresponda ao seu tipo de usuário. Isso garante que o usuário receba a função IAM de execução correta do SageMaker (e, portanto, as permissões) ao abrir o Studio IDE.

Implantações de autoatendimento com AWS Service Catalog

Os usuários finais utilizam o AWS Service Catalog para implantar produtos de infraestrutura de ciência de dados, como os seguintes:

- Um ambiente de estúdio

- Perfis de usuário do Studio

- Pipelines de implantação de modelo

- Pipelines de treinamento

- Pipelines de inferência

- Um sistema de monitoramento e alerta

Os usuários finais implantam esses produtos diretamente por meio da IU do AWS Service Catalog, o que significa que há menos dependência de equipes de plataforma central para provisionar ambientes. Isso reduziu enormemente o tempo que os usuários levam para obter acesso a novos ambientes de nuvem, de vários dias para apenas algumas horas, o que, em última análise, levou a uma melhoria significativa no tempo de obtenção de valor. O uso de um conjunto comum de produtos do AWS Service Catalog oferece suporte à consistência nos projetos de toda a empresa e reduz a barreira para colaboração e reutilização.

Como toda a infraestrutura de ciência de dados é agora implantada por meio de um catálogo de produtos de infraestrutura desenvolvido centralmente, foi tomado cuidado para construir cada um desses produtos tendo a segurança em mente. Os serviços foram configurados para se comunicar dentro Nuvem virtual privada da Amazon (Amazon VPC) para que o tráfego não atravesse a Internet pública. Os dados são criptografados em trânsito e em repouso usando Serviço de gerenciamento de chaves AWS (AWS KMS). As funções do IAM também foram configuradas para seguir o princípio do menor privilégio.

Por fim, com o AWS Service Catalog, é fácil para a equipe da plataforma lançar continuamente novos produtos e serviços à medida que são disponibilizados ou exigidos pelas equipes de aplicativos de negócios. Estas podem assumir a forma de novos produtos de infra-estrutura, proporcionando, por exemplo, aos utilizadores finais a capacidade de implementarem os seus próprios Amazon EMR clusters ou atualizações de produtos de infraestrutura existentes. Como o AWS Service Catalog oferece suporte ao versionamento de produtos e utiliza Formação da Nuvem AWS nos bastidores, atualizações locais podem ser usadas quando novas versões de produtos existentes são lançadas. Isso permite que as equipes da plataforma se concentrem na construção e melhoria de produtos, em vez de desenvolver processos complexos de atualização.

Integração com o software IaC existente do NatWest

O AWS Service Catalog é usado para implantações de infraestrutura de ciência de dados de autoatendimento. Além disso, a ferramenta padrão de infraestrutura como código (IaC) do NatWest, Terraform, é usada para construir infraestrutura nas contas da AWS. O Terraform é usado pelas equipes da plataforma durante o processo inicial de configuração da conta para implantar recursos de infraestrutura pré-requisitos, como VPCs, grupos de segurança, Gerente de Sistemas AWS parâmetros, chaves KMS e controles de segurança padrão. A infraestrutura na conta do hub, como os portfólios do AWS Service Catalog e os recursos usados para criar imagens do Docker, também são definidas usando o Terraform. No entanto, os próprios produtos do AWS Service Catalog são criados usando modelos padrão do CloudFormation.

Melhorando a produtividade do desenvolvedor e a qualidade do código com projetos SageMaker

Projetos SageMaker forneça aos desenvolvedores e cientistas de dados acesso a projetos de início rápido sem sair do SageMaker Studio. Esses projetos de início rápido permitem implantar vários recursos de infraestrutura ao mesmo tempo com apenas alguns cliques. Estes incluem um repositório Git contendo um modelo de projeto padronizado para o tipo de modelo selecionado, Serviço de armazenamento simples da Amazon (Amazon S3) buckets para armazenamento de dados, modelos e artefatos serializados e treinamento de modelo e pipelines do CodePipeline de inferência.

A introdução de arquiteturas e ferramentas padronizadas de base de código agora facilita a movimentação dos cientistas e engenheiros de dados entre projetos e garante que a qualidade do código permaneça alta. Por exemplo, as melhores práticas de engenharia de software, como verificações de linting e formatação (executadas como verificações automatizadas e ganchos de pré-confirmação), testes de unidade e relatórios de cobertura agora são automatizados como parte dos pipelines de treinamento, fornecendo padronização em todos os projetos. Isso melhorou a capacidade de manutenção dos projetos de ML e facilitará a transferência desses projetos para a produção.

Automatizando implantações de modelo

O processo de treinamento do modelo é orquestrado usando SageMaker Pipelines. Após o treinamento dos modelos, eles são armazenados no registro de modelos do SageMaker. Os usuários atribuídos à função de aprovador de modelo podem abrir o registro do modelo e encontrar informações relacionadas ao processo de treinamento, como quando o modelo foi treinado, valores de hiperparâmetros e métricas de avaliação. Essas informações ajudam o usuário a decidir se aprova ou rejeita um modelo. A rejeição de um modelo evita que ele seja implantado em um ambiente escalonado, enquanto a aprovação de um modelo aciona um pipeline de promoção de modelo por meio do CodePipeline que copia automaticamente o modelo para a conta AWS de pré-produção, pronta para testes de carga de trabalho de inferência. Depois que a equipe confirmar que o modelo funciona corretamente na pré-produção, uma etapa manual no mesmo pipeline é aprovada e o modelo é automaticamente copiado para a conta de produção, pronto para cargas de trabalho de inferência de produção.

Focados no Negócio

Um dos principais objetivos deste projeto colaborativo entre o NatWest e a AWS era reduzir o tempo necessário para provisionar e implantar ambientes de nuvem de ciência de dados e modelos de ML em produção. Isso foi alcançado: o NatWest agora pode provisionar ambientes AWS novos, escaláveis e seguros em questão de horas, em comparação com dias ou até semanas. Cientistas e engenheiros de dados agora têm autonomia para implantar e gerenciar a infraestrutura de ciência de dados por conta própria usando o AWS Service Catalog, reduzindo a dependência de equipes de plataforma centralizadas. Além disso, o uso de projetos SageMaker permite que os usuários comecem a codificar e treinar modelos em minutos, ao mesmo tempo que fornece estruturas e ferramentas de projeto padronizadas.

Como o AWS Service Catalog serve como método central para implantar a infraestrutura de ciência de dados, a plataforma pode ser facilmente expandida e atualizada no futuro. Novos serviços da AWS podem ser oferecidos aos usuários finais rapidamente quando necessário, e os produtos existentes do AWS Service Catalog podem ser atualizados para aproveitar os novos recursos.

Por fim, a mudança para serviços gerenciados na AWS significa que os recursos computacionais são provisionados e encerrados sob demanda. Isto proporcionou economia de custos e flexibilidade, ao mesmo tempo em que se alinhou com A ambição do NatWest de ser zero líquido até 2050 devido a uma redução estimada de 75% no CO2 emissões.

Conclusão

A adoção de uma estratégia que prioriza a nuvem no NatWest Group levou à criação de uma solução AWS robusta que pode oferecer suporte a um grande número de equipes de aplicativos de negócios em toda a organização. O gerenciamento da infraestrutura com o AWS Service Catalog melhorou significativamente o processo de integração da nuvem usando blocos de construção de infraestrutura seguros, compatíveis e pré-aprovados que podem ser facilmente expandidos. Os componentes gerenciados da infraestrutura do SageMaker melhoraram o processo de desenvolvimento de modelos e aceleraram a entrega de projetos de ML.

Para saber mais sobre o processo de construção de modelos de ML prontos para produção no NatWest Group, dê uma olhada no restante desta série de quatro partes sobre a colaboração estratégica entre o NatWest Group e os AWS Professional Services:

- Parte 1 explica como o NatWest Group fez parceria com a AWS Professional Services para criar uma plataforma de MLOps escalável, segura e sustentável

- Parte 3 fornece uma visão geral de como o NatWest Group usa os serviços do SageMaker para criar modelos de ML auditáveis, reproduzíveis e explicáveis

- Parte 4 detalha como as equipes de ciência de dados do NatWest migram seus modelos existentes para as arquiteturas SageMaker

Sobre os autores

Junaid Baba é consultor DevOps na Serviços Profissionais AWS Ele aproveita sua experiência em Kubernetes, computação distribuída e IA/MLOps para acelerar a adoção da nuvem por clientes do setor de serviços financeiros do Reino Unido. Junaid está na AWS desde junho de 2018. Antes disso, Junaid trabalhou com diversas start-ups financeiras impulsionando práticas de DevOps. Fora do trabalho, ele se interessa por trekking, arte moderna e fotografia.

Junaid Baba é consultor DevOps na Serviços Profissionais AWS Ele aproveita sua experiência em Kubernetes, computação distribuída e IA/MLOps para acelerar a adoção da nuvem por clientes do setor de serviços financeiros do Reino Unido. Junaid está na AWS desde junho de 2018. Antes disso, Junaid trabalhou com diversas start-ups financeiras impulsionando práticas de DevOps. Fora do trabalho, ele se interessa por trekking, arte moderna e fotografia.

Yordanka Ivanova é engenheiro de dados no NatWest Group. Ela tem experiência na construção e entrega de soluções de dados para empresas do setor de serviços financeiros. Antes de ingressar na NatWest, Yordanka trabalhou como consultora técnica, onde ganhou experiência no aproveitamento de uma ampla variedade de serviços em nuvem e tecnologias de código aberto para fornecer resultados de negócios em diversas plataformas de nuvem. Nas horas vagas, Yordanka gosta de malhar, viajar e tocar violão.

Yordanka Ivanova é engenheiro de dados no NatWest Group. Ela tem experiência na construção e entrega de soluções de dados para empresas do setor de serviços financeiros. Antes de ingressar na NatWest, Yordanka trabalhou como consultora técnica, onde ganhou experiência no aproveitamento de uma ampla variedade de serviços em nuvem e tecnologias de código aberto para fornecer resultados de negócios em diversas plataformas de nuvem. Nas horas vagas, Yordanka gosta de malhar, viajar e tocar violão.

Michael Inglaterra é engenheiro de software na equipe de Ciência e Inovação de Dados do NatWest Group. Ele é apaixonado por desenvolver soluções para executar cargas de trabalho de aprendizado de máquina em grande escala na nuvem. Antes de ingressar no NatWest Group, Michael trabalhou e liderou equipes de engenharia de software no desenvolvimento de aplicações críticas nos setores de serviços financeiros e viagens. Nas horas vagas gosta de tocar violão, viajar e explorar o campo de bicicleta.

Michael Inglaterra é engenheiro de software na equipe de Ciência e Inovação de Dados do NatWest Group. Ele é apaixonado por desenvolver soluções para executar cargas de trabalho de aprendizado de máquina em grande escala na nuvem. Antes de ingressar no NatWest Group, Michael trabalhou e liderou equipes de engenharia de software no desenvolvimento de aplicações críticas nos setores de serviços financeiros e viagens. Nas horas vagas gosta de tocar violão, viajar e explorar o campo de bicicleta.

- Coinsmart. A melhor troca de Bitcoin e criptografia da Europa.

- Platoblockchain. Inteligência Metaverso Web3. Conhecimento Ampliado. ACESSO LIVRE.

- CryptoHawk. Radar Altcoin. Teste grátis.

- Fonte: https://aws.amazon.com/blogs/machine-learning/part-2-how-natwest-group-built-a-secure-compatível-self-service-mlops-platform-using-aws-service- catálogo-e-amazon-sagemaker/

- "

- 100

- Sobre

- acelerado

- acelerando

- Acesso

- Conta

- em

- Adição

- Adicional

- Adoção

- Vantagem

- Todos os Produtos

- Amazon

- entre

- quantidade

- quantidades

- análise

- analítica

- Aplicação

- aplicações

- abordagem

- aprovar

- arquitetura

- Arte

- atribuído

- auditor

- Autenticação

- Automatizado

- Automação

- Automação e padronização

- disponível

- AWS

- Bank

- tornam-se

- Por trás das cenas

- ser

- beneficiar

- Benefícios

- MELHOR

- melhores práticas

- construir

- Prédio

- negócio

- carbono

- Cuidado

- centralizada

- desafiar

- desafios

- Cheques

- Na nuvem

- Plataforma em nuvem

- serviços na nuvem

- código

- Codificação

- colaboração

- combinação

- comum

- Empresas

- Empresa

- comparado

- integrações

- compliance

- compatível

- componente

- Computar

- computação

- Configuração

- Coneções

- consultor

- Recipiente

- Containers

- contém

- conteúdo

- continuamente

- ao controle

- criado

- Criar

- criação

- crítico

- personalizadas

- Clientes

- dados,

- análise de dados

- ciência de dados

- cientista de dados

- entregue

- entregando

- Entrega

- Demanda

- demandas

- implantar

- implantado

- Implantação

- desenvolvimento

- Implantações

- descrito

- projetos

- detalhe

- detalhes

- desenvolvido

- Developer

- desenvolvedores

- em desenvolvimento

- Desenvolvimento

- diferente

- difícil

- digital

- diretamente

- distribuído

- computação distribuída

- Estivador

- Não faz

- down

- condução

- facilmente

- eficiente

- esforços

- Elaborar

- permitir

- Ponto final

- engenheiro

- Engenharia

- Engenheiros

- Empreendimento

- Meio Ambiente

- estimado

- avaliação

- evolui

- exemplo

- execução

- existente

- vasta experiência

- Característica

- Funcionalidades

- retornos

- financeiro

- serviços financeiros

- Primeiro nome

- Fixar

- Flexibilidade

- Foco

- seguir

- seguinte

- Pegada

- formulário

- Quadro

- funcionalidade

- futuro

- Git

- governo

- Grupo

- Do grupo

- Guias

- feliz

- ajudar

- ajuda

- Alta

- Como funciona o dobrador de carta de canal

- HTTPS

- Dados de identificação:

- implementação

- melhorado

- incluir

- incluído

- inclui

- aumentou

- indústrias

- indústria

- INFORMAÇÕES

- Infraestrutura

- Inovação

- inovadores

- Instituição

- integrar

- integrado

- interesses

- Interface

- Internet

- envolvido

- questões

- IT

- Empregos

- Chave

- chaves

- Conhecimento

- grande

- mais recente

- conduzir

- APRENDER

- aprendizagem

- levou

- aproveita as

- aproveitando

- Biblioteca

- Limitado

- Line

- vinculação

- local

- máquina

- aprendizado de máquina

- moldadas

- principal

- FAZ

- gerencia

- gerenciados

- de grupos

- gestão

- maneira

- manual

- Importância

- maturidade

- significado

- Membros

- Métrica

- milhão

- mente

- ML

- modelo

- modelos

- monitoração

- mês

- mais

- mover

- em movimento

- múltiplo

- nomes

- networking

- Novos Recursos

- Nova Plataforma

- produto novo

- novos produtos

- número

- oferecido

- modo offline

- Onboarding

- online

- aberto

- Operações

- Otimize

- organização

- Outros

- global

- próprio

- particular

- parceria

- apaixonado

- padrão

- atuação

- fotografia

- piloto

- plataforma

- Plataformas

- jogar

- políticas

- Privacidade

- pasta

- carteiras

- princípio

- privado

- Chaves Privadas

- processo

- processos

- Produto

- Produção

- produtividade

- Produtos

- profissional

- Perfil

- Perfis

- projeto

- projetos

- promoção

- fornecer

- fornece

- fornecendo

- público

- qualidade

- Links

- rapidamente

- Leitura

- reduzir

- redução

- reguladores

- relacionamento

- liberar

- liberado

- Releases

- confiança

- Relatórios

- repositório

- requerer

- requeridos

- Requisitos

- recurso

- Recursos

- DESCANSO

- Resultados

- rever

- Rota

- Execute

- corrida

- AMPLIAR

- escalável

- Escala

- Cenas

- Ciência

- Cientista

- cientistas

- Sdk

- seguro

- segurança

- selecionado

- Série

- serviço

- Serviços

- conjunto

- instalação

- Partilhar

- compartilhado

- periodo

- Similarmente

- simples

- So

- Software

- Engenheiro de Software

- Engenharia de software

- solução

- Soluções

- gastar

- Estabilidade

- pilha

- padrão

- start-ups

- começado

- Estado

- declarações

- Status

- armazenamento

- Estratégico

- Estratégia

- estudo

- ajuda

- suportes

- sustentável

- .

- sistemas

- tarefas

- Profissionais

- Dados Técnicos:

- Tecnologias

- Equipar

- modelos

- teste

- ensaio

- testes

- a articulação

- tema

- assim sendo

- Através da

- tempo

- ferramenta

- para

- Rastreamento

- tráfego

- Training

- Transformar

- Transformação

- trânsito

- viagens

- Viagens

- Confiança

- ui

- Uk

- Atualizações

- usar

- usuários

- utilizar

- Utilizando

- variedade

- Ver

- Virtual

- visibilidade

- Web-Based

- se

- enquanto

- QUEM

- dentro

- sem

- Atividades:

- trabalhou

- trabalhar

- trabalhando fora

- trabalho

- mundo