Диаризация говорящего, важный процесс аудиоанализа, сегментирует аудиофайл на основе личности говорящего. В этом посте рассматривается интеграция PyAnnote от Hugging Face для ведения дневника говорящих с Создатель мудреца Амазонки асинхронные конечные точки.

Мы предоставляем подробное руководство по развертыванию решений сегментации и кластеризации динамиков с помощью SageMaker в облаке AWS. Вы можете использовать это решение для приложений, работающих с аудиозаписями с несколькими динамиками (более 100).

Обзор решения

Amazon транскрибировать — это популярный сервис для дневникирования выступающих в AWS. Однако для неподдерживаемых языков вы можете использовать другие модели (в нашем случае PyAnnote), которые будут развернуты в SageMaker для вывода. Для коротких аудиофайлов, вывод которых занимает до 60 секунд, вы можете использовать вывод в реальном времени. В течение более 60 секунд асинхронный следует использовать умозаключение. Дополнительным преимуществом асинхронного вывода является экономия средств за счет автоматического масштабирования числа экземпляров до нуля, когда нет запросов для обработки.

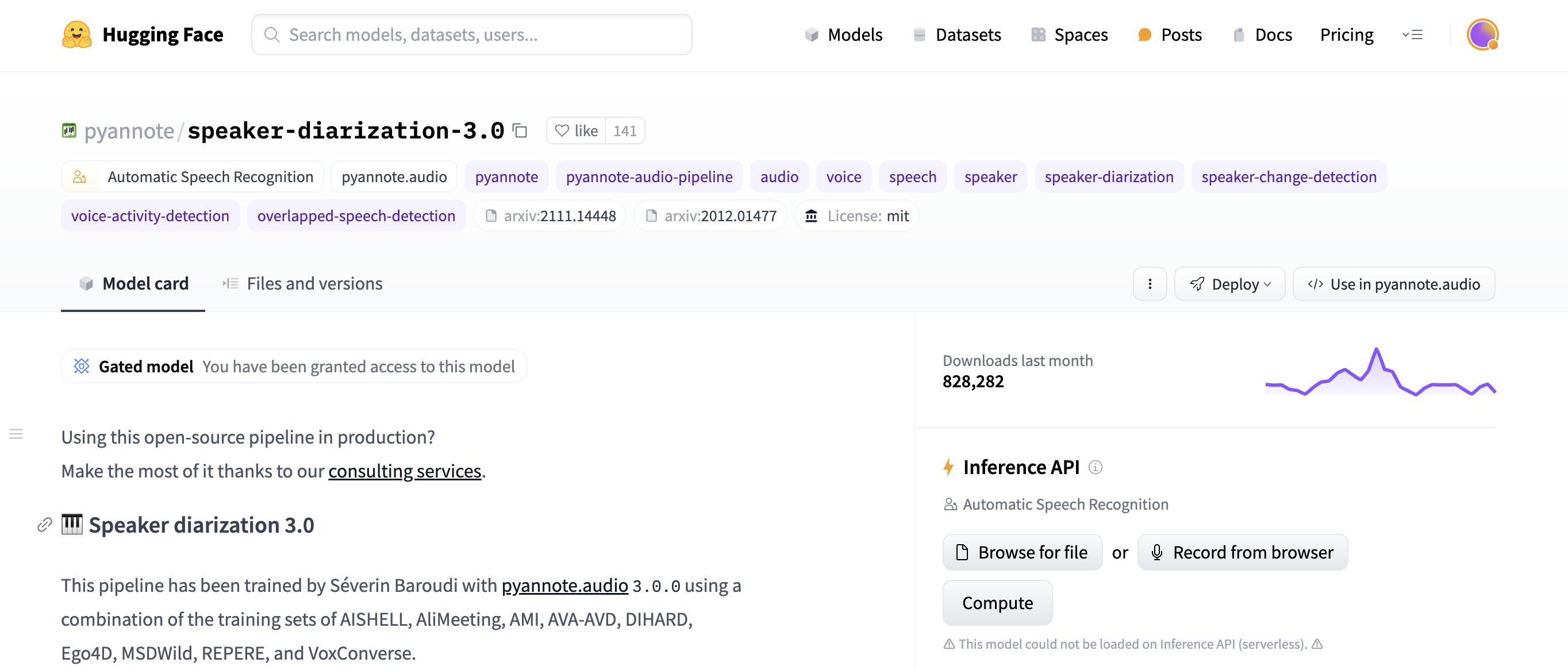

Обнимая лицо — популярный центр с открытым исходным кодом для моделей машинного обучения (ML). У AWS и Hugging Face есть партнерство это обеспечивает плавную интеграцию SageMaker с набором контейнеров глубокого обучения (DLC) AWS для обучения и вывода в PyTorch или TensorFlow, а также с оценщиками и предикторами Hugging Face для SageMaker Python SDK. Функции и возможности SageMaker помогают разработчикам и специалистам по обработке данных с легкостью начать работу с обработкой естественного языка (NLP) на AWS.

Интеграция этого решения включает использование предварительно обученной модели диаризации говорящего Hugging Face с использованием Библиотека PyAnnote. PyAnnote — это набор инструментов с открытым исходным кодом, написанный на Python для ведения дневника докладчиков. Эта модель, обученная на примере набора аудиоданных, обеспечивает эффективное разделение динамиков в аудиофайлах. Модель развертывается в SageMaker в качестве асинхронной конечной точки, обеспечивая эффективную и масштабируемую обработку задач диаризации.

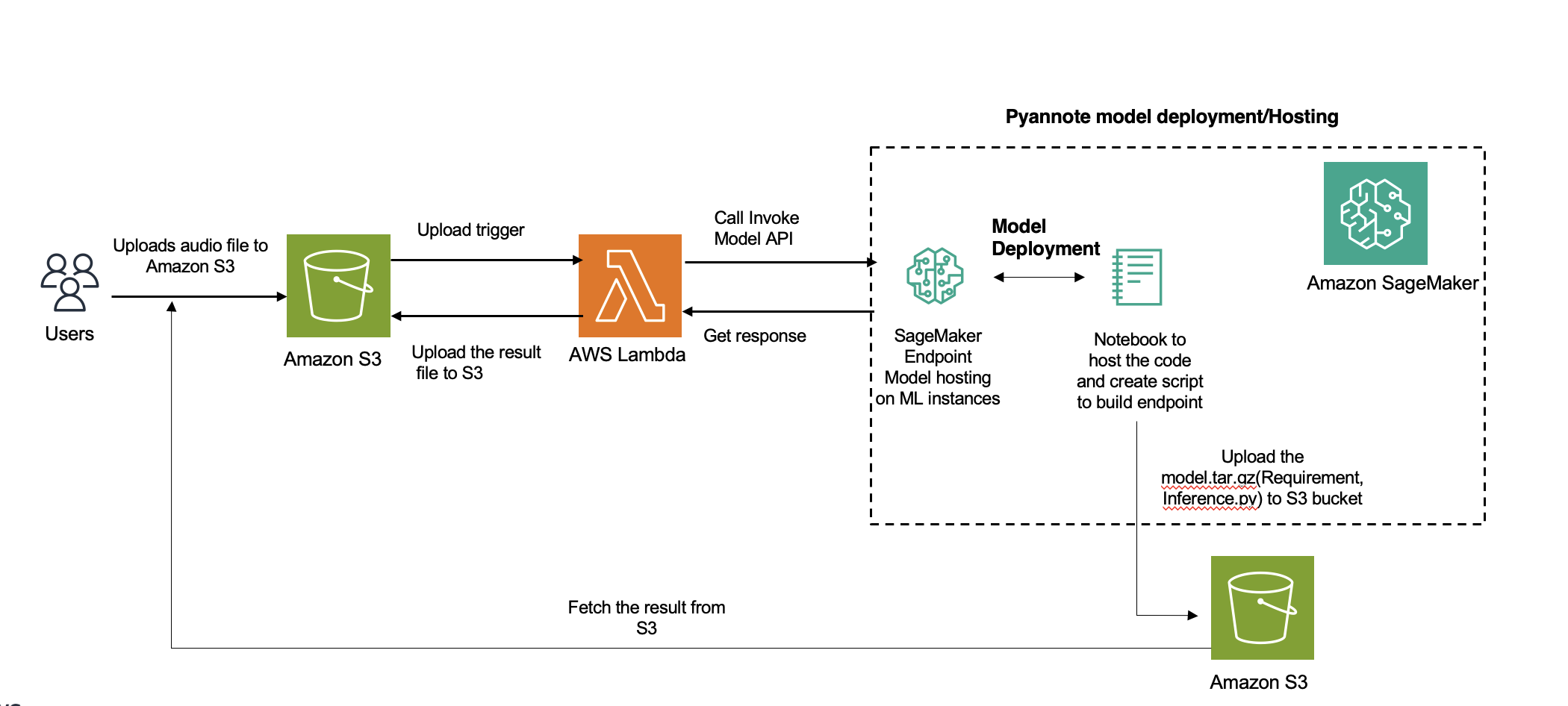

Следующая диаграмма иллюстрирует архитектуру решения.

Для этого поста мы используем следующий аудиофайл.

Стерео или многоканальные аудиофайлы автоматически микшируются в моно путем усреднения каналов. Аудиофайлы, сэмплированные с другой частотой, автоматически преобразуются в 16 кГц при загрузке.

Предпосылки

Выполните следующие предварительные условия:

- Создать домен SageMaker.

- Убедитесь, что ваша Управление идентификацией и доступом AWS (IAM) пользователь имеет необходимые права доступа для создания Роль SageMaker.

- Убедитесь, что в учетной записи AWS имеется квота сервиса для размещения конечной точки SageMaker для экземпляра ml.g5.2xlarge.

Создайте функцию модели для доступа к дневнику говорящего PyAnnote из Hugging Face.

Вы можете использовать Hugging Face Hub для доступа к нужным предварительно обученным Модель диаризации докладчика PyAnnote. Тот же сценарий используется для загрузки файла модели при создании конечной точки SageMaker.

Смотрите следующий код:

Упакуйте код модели

Подготовьте необходимые файлы, такие как inference.py, которые содержат код вывода:

Подготовить requirements.txt файл, который содержит необходимые библиотеки Python, необходимые для выполнения вывода:

Наконец, сожмите inference.py и требования.txt и сохраните их как model.tar.gz:

Настройка модели SageMaker

Определите ресурс модели SageMaker, указав URI изображения и расположение данных модели в Простой сервис хранения Amazon (S3) и роль SageMaker:

Загрузите модель на Amazon S3.

Загрузите заархивированный файл модели PyAnnote Hugging Face в корзину S3:

Создайте асинхронную конечную точку SageMaker.

Настройте асинхронную конечную точку для развертывания модели в SageMaker, используя предоставленную конфигурацию асинхронного вывода:

Проверьте конечную точку

Оцените функциональность конечной точки, отправив аудиофайл для диаризации и получив выходные данные JSON, хранящиеся в указанном пути вывода S3:

Для масштабного развертывания этого решения мы предлагаем использовать AWS Lambda, Amazon Простая служба уведомлений (Amazon SNS) или Простой сервис очередей Amazon (Амазонка SQS). Эти сервисы предназначены для масштабируемости, архитектуры, управляемой событиями, и эффективного использования ресурсов. Они могут помочь отделить процесс асинхронного вывода от обработки результатов, позволяя масштабировать каждый компонент независимо и более эффективно обрабатывать пакеты запросов на вывод.

Итоги

Вывод модели сохраняется по адресу s3://sagemaker-xxxx /async_inference/output/. Вывод показывает, что аудиозапись была разделена на три столбца:

- Старт (время начала в секундах)

- Конец (время окончания в секундах)

- Динамик (маркировка динамика)

Следующий код показывает пример наших результатов:

Убирать

Вы можете установить нулевую политику масштабирования, задав для MinCapacity значение 0; асинхронный вывод позволяет автоматически масштабировать до нуля без каких-либо запросов. Вам не нужно удалять конечную точку, она Весы с нуля, когда это необходимо снова, сокращая затраты, когда они не используются. См. следующий код:

- SEO-контент и PR-распределение. Получите усиление сегодня.

- PlatoData.Network Вертикальный генеративный ИИ. Расширьте возможности себя. Доступ здесь.

- ПлатонАйСтрим. Интеллект Web3. Расширение знаний. Доступ здесь.

- ПлатонЭСГ. Углерод, чистые технологии, Энергия, Окружающая среда, Солнечная, Управление отходами. Доступ здесь.

- ПлатонЗдоровье. Биотехнологии и клинические исследования. Доступ здесь.

- Источник: https://aws.amazon.com/blogs/machine-learning/deploy-a-hugging-face-pyannote-speaker-diarization-model-on-amazon-sagemaker-as-an-asynchronous-endpoint/

- :имеет

- :является

- :нет

- :куда

- $UP

- 1

- 10

- 100

- 11

- 118

- 12

- 13

- 14

- 16

- 17

- 23

- 25

- 26%

- 27

- 28

- 31

- 60

- 7

- 8

- 9

- a

- О нас

- доступ

- доступа

- услужливый

- Учетная запись

- через

- Добавить

- добавленный

- подстраивается

- продвинутый

- снова

- AI

- Услуги искусственного интеллекта

- AI / ML

- Позволяющий

- позволяет

- причислены

- Amazon

- Создатель мудреца Амазонки

- Amazon Web Services

- an

- анализ

- аналитика

- и

- любой

- Применение

- Приложения

- подхода

- архитектура

- архитектуры

- МЫ

- около

- AS

- At

- попытки

- аудио

- автоматический

- автоматически

- усреднение

- AWS

- основанный

- BE

- было

- польза

- Преимущества

- между

- бизнес

- бизнес

- by

- CAN

- возможности

- случаев

- случаев

- изменения

- каналы

- класс

- клиент

- облако

- кластеризации

- код

- Колонки

- Комментарии

- Общий

- компонент

- комплексный

- сама концепция

- параллельный

- Конфигурация

- Контейнеры

- содержит

- контрольная

- Цена

- экономия на издержках

- Расходы

- считать

- Создайте

- Создающий

- Клиенты

- данным

- занимавшийся

- глубоко

- глубокое обучение

- определять

- доставить

- копается

- демонстрация

- развертывание

- развернуть

- развертывание

- Проект

- предназначенный

- желанный

- развитый

- Застройщик

- застройщиков

- Развитие

- диаграмма

- различный

- Интернет

- цифровое преобразование

- каталог

- Документация

- Dont

- загрузка

- динамично

- каждый

- простота

- Эффективный

- фактически

- эффективный

- эффективно

- позволяет

- конец

- Конечная точка

- ошибка

- существенный

- пример

- Кроме

- опыт

- Больше

- Face

- Особенности

- Файл

- Файлы

- после

- Что касается

- формат

- от

- функция

- функциональность

- генеративный

- получить

- получающий

- GitHub

- инструкция

- обрабатывать

- Есть

- he

- помощь

- помог

- помогает

- его

- хостинг

- Как

- How To

- Однако

- HTML

- HTTP

- HTTPS

- хаб

- ОбниматьЛицо

- Сотни

- Личность

- if

- иллюстрирует

- изображение

- в XNUMX году

- Импортировать

- in

- самостоятельно

- Индия

- пример

- Интегрируя

- интеграции.

- в

- включает в себя

- IT

- путешествие

- JPG

- JSON

- Основные

- этикетка

- язык

- Языки

- большой

- запуск

- изучение

- Lets

- библиотеки

- такое как

- загрузка

- погрузка

- расположение

- дольше

- машина

- обучение с помощью машины

- означает

- ML

- модель

- Модели

- БОЛЕЕ

- с разными

- натуральный

- Обработка естественного языка

- необходимо

- Необходимость

- необходимый

- НЛП

- нет

- Ничто

- уведомление

- номер

- объект

- of

- Предложения

- on

- открытый

- с открытым исходным кодом

- оптимизирует

- or

- OS

- Другое

- наши

- внешний

- выходной

- за

- общий

- собственный

- панд

- часть

- путь

- Разрешения

- трубопровод

- Платформа

- Платон

- Платон Интеллектуальные данные

- ПлатонДанные

- политика

- Популярное

- После

- Питание

- Predictions

- предпосылки

- процесс

- обработка

- проектов

- доказательства

- обеспечивать

- при условии

- приводит

- обеспечение

- что такое варган?

- положил

- Питон

- pytorch

- Вопросы

- Обменный курс

- достигать

- реального времени

- запись

- снижает

- снижение

- Рекомендации

- область

- зарегистрироваться

- складская

- замещать

- представляющий

- Запросы

- обязательный

- Требования

- ресурс

- Полезные ресурсы

- ответ

- результат

- Итоги

- возвращают

- Роли

- Run

- Бег

- sagemaker

- главная

- то же

- образец

- Сохранить

- экономия

- Масштабируемость

- масштабируемые

- Шкала

- масштабирование

- Ученые

- скрипт

- скрипты

- SDK

- бесшовные

- легко

- секунды

- сектор

- посмотреть

- сегментация

- сегментами

- отправка

- отделяющий

- обслуживание

- Услуги

- Сессия

- сессиях

- набор

- установка

- установка

- несколько

- Форма

- Короткое

- должен

- Шоу

- просто

- одинарной

- Software

- разработка программного обеспечения

- Решение

- Решения

- Источник

- Динамик

- специалист

- конкретный

- указанный

- указав

- проводит

- раскол

- Начало

- и политические лидеры

- диск

- хранить

- простой

- Стратегический

- успех

- предлагать

- Убедитесь

- система

- принимает

- задачи

- технологии

- tensorflow

- чем

- который

- Ассоциация

- Там.

- Эти

- они

- этой

- тысячи

- три

- Через

- время

- в

- сегодня

- Инструментарий

- тема

- факел

- специалистов

- Обучение

- трансформация

- трансформеры

- стараться

- ОЧЕРЕДЬ

- на

- использование

- используемый

- Информация о пользователе

- использования

- через

- Вариант

- версия

- Видео

- W

- ждать

- хотеть

- we

- Web

- веб-сервисы

- когда

- который

- КТО

- будете

- работает

- письменный

- лет

- Ты

- ВАШЕ

- зефирнет

- нуль

Санджай Тивари — специалист по архитектуре решений AI/ML, который проводит свое время, работая со стратегическими клиентами, чтобы определить бизнес-требования, проводить сеансы L300 для конкретных случаев использования и разрабатывать приложения и услуги AI/ML, которые являются масштабируемыми, надежными и производительными. Он помог запустить и масштабировать сервис Amazon SageMaker на базе искусственного интеллекта и машинного обучения и реализовал несколько проверок концепции с использованием сервисов Amazon AI. Он также разработал платформу расширенной аналитики в рамках процесса цифровой трансформации.

Санджай Тивари — специалист по архитектуре решений AI/ML, который проводит свое время, работая со стратегическими клиентами, чтобы определить бизнес-требования, проводить сеансы L300 для конкретных случаев использования и разрабатывать приложения и услуги AI/ML, которые являются масштабируемыми, надежными и производительными. Он помог запустить и масштабировать сервис Amazon SageMaker на базе искусственного интеллекта и машинного обучения и реализовал несколько проверок концепции с использованием сервисов Amazon AI. Он также разработал платформу расширенной аналитики в рамках процесса цифровой трансформации. Киран Чаллапалли — разработчик глубоких технологий в государственном секторе AWS. У него более 8 лет опыта работы в области искусственного интеллекта и машинного обучения и 23 года общего опыта разработки и продаж программного обеспечения. Киран помогает предприятиям государственного сектора по всей Индии исследовать и совместно создавать облачные решения, использующие технологии искусственного интеллекта, машинного обучения и генеративного искусственного интеллекта, включая большие языковые модели.

Киран Чаллапалли — разработчик глубоких технологий в государственном секторе AWS. У него более 8 лет опыта работы в области искусственного интеллекта и машинного обучения и 23 года общего опыта разработки и продаж программного обеспечения. Киран помогает предприятиям государственного сектора по всей Индии исследовать и совместно создавать облачные решения, использующие технологии искусственного интеллекта, машинного обучения и генеративного искусственного интеллекта, включая большие языковые модели.