Большие языковые модели (LLM) с их обширными знаниями могут генерировать человеческий текст практически на любую тему. Однако их обучение на массивных наборах данных также ограничивает их полезность для специализированных задач. Без постоянного обучения эти модели не обращают внимания на новые данные и тенденции, возникающие после их первоначального обучения. Более того, затраты на обучение новых LLM могут оказаться непомерно высокими для многих предприятий. Однако можно сопоставить ответ модели с исходным специализированным контентом, избежав тем самым необходимости обучения новой модели LLM с помощью поисково-дополненной генерации (RAG).

RAG расширяет возможности LLM, предоставляя им возможность извлекать и использовать внешние знания. Вместо того, чтобы полагаться исключительно на свои предварительно полученные знания, RAG позволяет моделям извлекать данные из документов, баз данных и т. д. Затем модель умело интегрирует эту внешнюю информацию в сгенерированный текст. Получая контекстно-зависимые данные, модель может предоставить обоснованные и актуальные ответы, адаптированные к вашему сценарию использования. Расширение знаний также снижает вероятность галлюцинаций и неточного или бессмысленного текста. Благодаря RAG базовые модели становятся адаптируемыми экспертами, которые развиваются по мере роста вашей базы знаний.

Сегодня мы рады представить три демо-версии генеративного искусственного интеллекта под лицензией Лицензия МИТ-0:

- Амазонка Кендра с базовым степенью магистра права – Использует возможности глубокого поиска Амазон Кендра в сочетании с обширными знаниями в области LLM. Эта интеграция обеспечивает точные и контекстно-зависимые ответы на сложные запросы, используя различные источники.

- Модель вложений с базовым LLM – Объединяет возможности встраивания — метода определения семантического значения слов и фраз — с обширной базой знаний LLM. Эта синергия обеспечивает более точное тематическое моделирование, рекомендации по контенту и возможности семантического поиска.

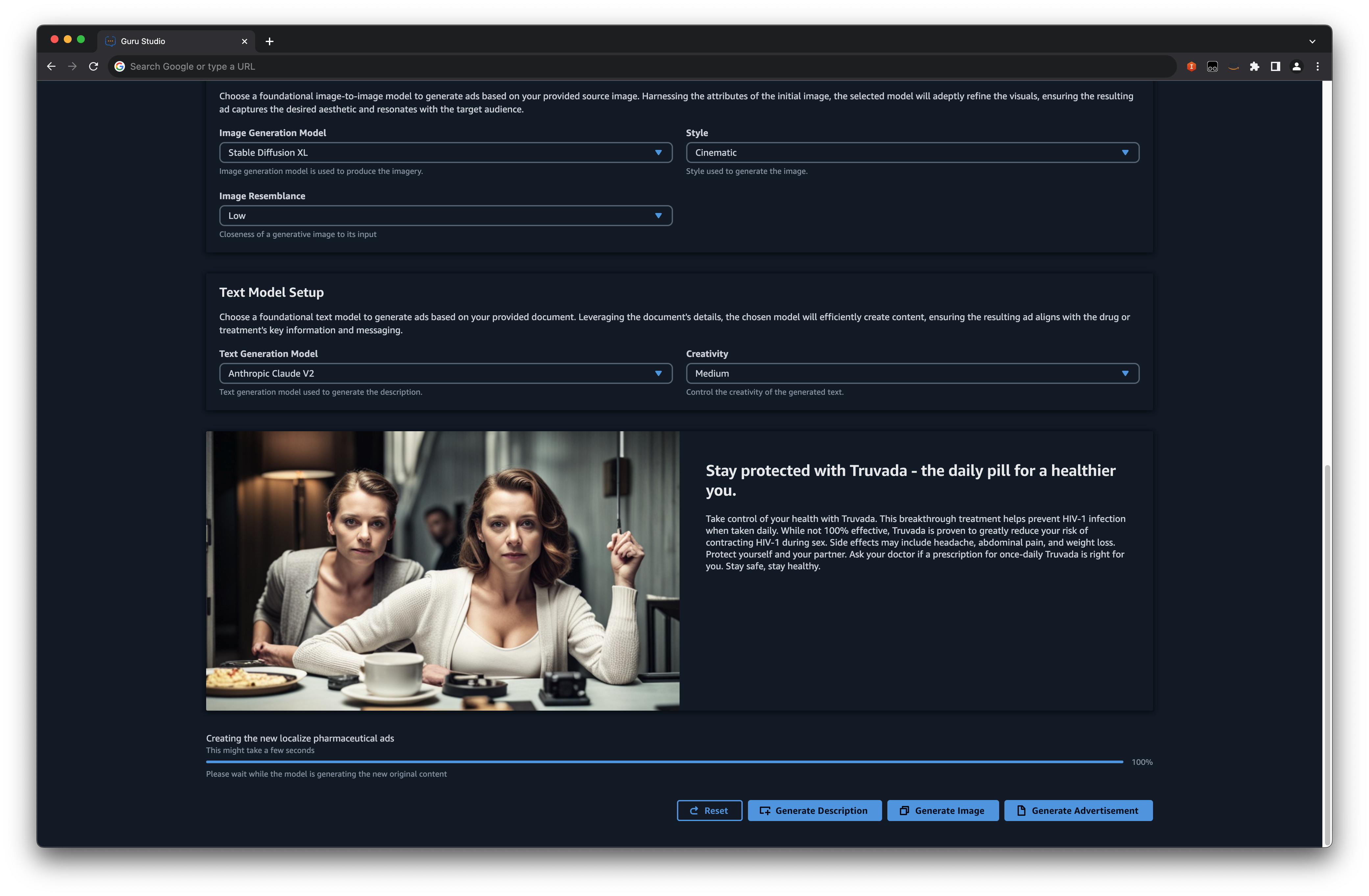

- Генератор рекламы для фармацевтических компаний Foundation Models – Специализированное приложение, специально разработанное для фармацевтической промышленности. Используя генеративные возможности базовых моделей, этот инструмент создает убедительную и соответствующую требованиям фармацевтическую рекламу, обеспечивая соответствие контента отраслевым стандартам и нормам.

Эти демонстрации можно легко развернуть в вашей учетной записи AWS, предлагая базовую информацию и рекомендации по использованию сервисов AWS для создания современного генеративного ИИ-бота для вопросов и ответов LLM и создания контента.

В этом посте мы исследуем, как RAG в сочетании с Amazon Kendra или пользовательскими встраиваниями может решить эти проблемы и предоставить точные ответы на запросы на естественном языке.

Обзор решения

Приняв это решение, вы получите следующие преимущества:

- Улучшенный доступ к информации – RAG позволяет моделям извлекать информацию из обширных внешних источников, что может быть особенно полезно, когда знания предварительно обученной модели устарели или неполны.

- Масштабируемость – Вместо обучения модели на всех доступных данных RAG позволяет моделям получать необходимую информацию «на лету». Это означает, что по мере поступления новых данных их можно добавлять в поисковую базу данных без необходимости переобучения всей модели.

- Эффективность памяти – LLM требуют значительного объема памяти для хранения параметров. С помощью RAG модель может быть меньше, поскольку ей не нужно запоминать все детали; он может получить их, когда это необходимо.

- Динамическое обновление знаний – В отличие от традиционных моделей с заданной конечной точкой знаний, внешняя база данных RAG может регулярно обновляться, предоставляя модели доступ к актуальной информации. Функцию поиска можно настроить для конкретных задач. Например, для задачи медицинской диагностики можно использовать данные из медицинских журналов, гарантируя, что модель соберет экспертную и соответствующую информацию.

- Снижение смещения – Возможность использовать хорошо организованную базу данных дает возможность свести к минимуму предвзятость за счет обеспечения сбалансированности и беспристрастности внешних источников.

Прежде чем приступить к интеграции Amazon Kendra с базовыми программами LLM, крайне важно вооружиться необходимыми инструментами и системными требованиями. Правильная настройка — это первый шаг к беспрепятственному развертыванию демонстрационных версий.

Предпосылки

У вас должны быть следующие предпосылки:

Несмотря на то, что инфраструктуру, подробно описанную в этом руководстве, можно настроить и развернуть с локального компьютера. Облако AWS9 предлагает удобную альтернативу. AWS Cloud9, предварительно оснащенный такими инструментами, как AWS CLI, AWS CDK и Docker, может выступать в качестве рабочей станции для развертывания. Чтобы воспользоваться этой услугой, просто настроить среду через Консоль AWS Cloud9.

Ознакомившись с предварительными условиями, давайте углубимся в функции и возможности Amazon Kendra с базовыми программами LLM.

Амазонка Кендра с базовым степенью магистра права

Amazon Kendra — это усовершенствованная служба корпоративного поиска, улучшенная машинным обучением (ML), которая предоставляет готовые возможности семантического поиска. Используя обработку естественного языка (NLP), Amazon Kendra понимает как содержимое документов, так и основную цель пользовательских запросов, позиционируя его как инструмент поиска контента для решений на основе RAG. Используя высокоточный поисковый контент от Kendra в качестве полезной нагрузки RAG, вы можете получить более качественные ответы LLM. Использование Amazon Kendra в этом решении также обеспечивает персонализированный поиск путем фильтрации ответов в соответствии с разрешениями конечного пользователя на доступ к контенту.

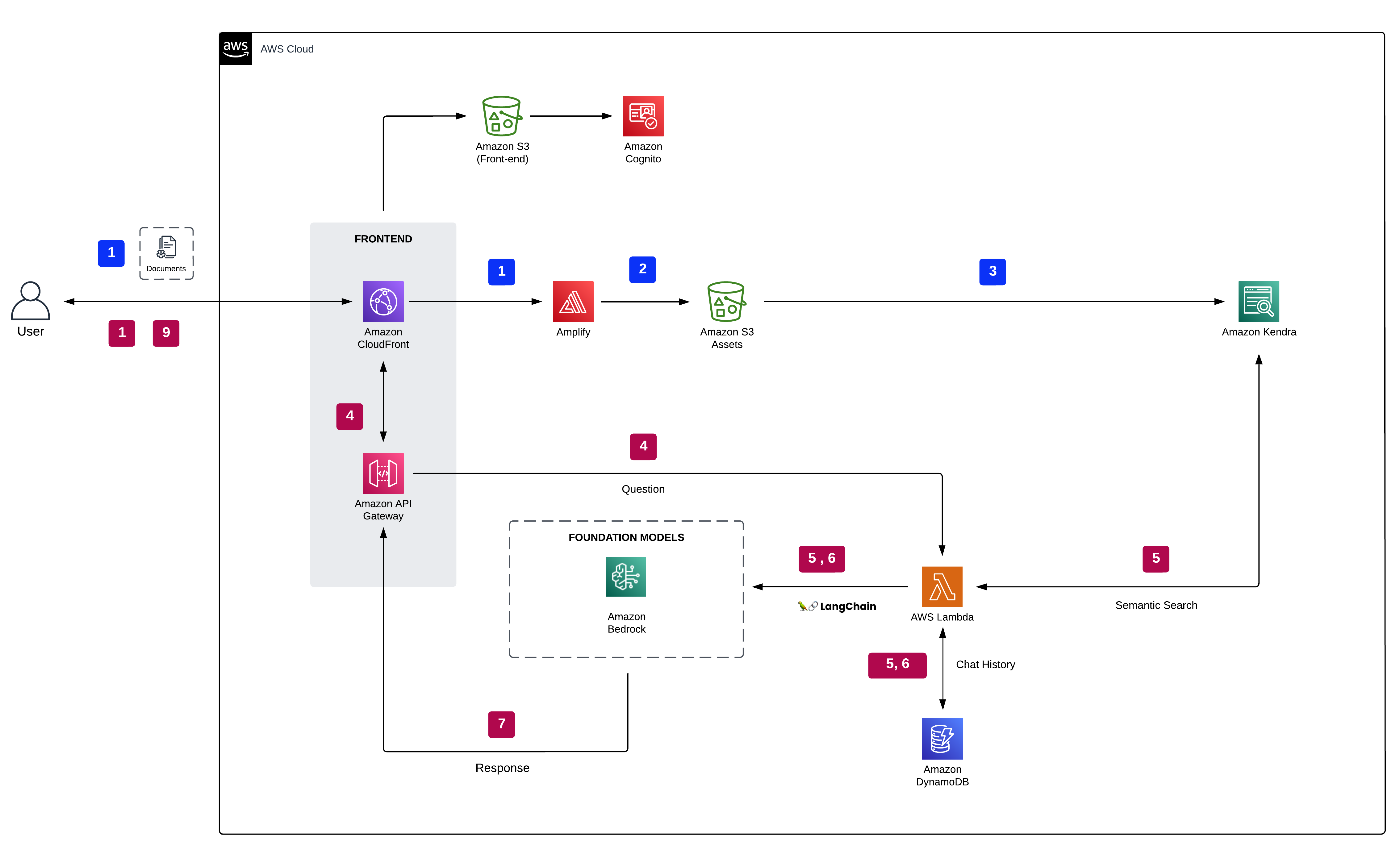

На следующей диаграмме показана архитектура генеративного приложения ИИ, использующего подход RAG.

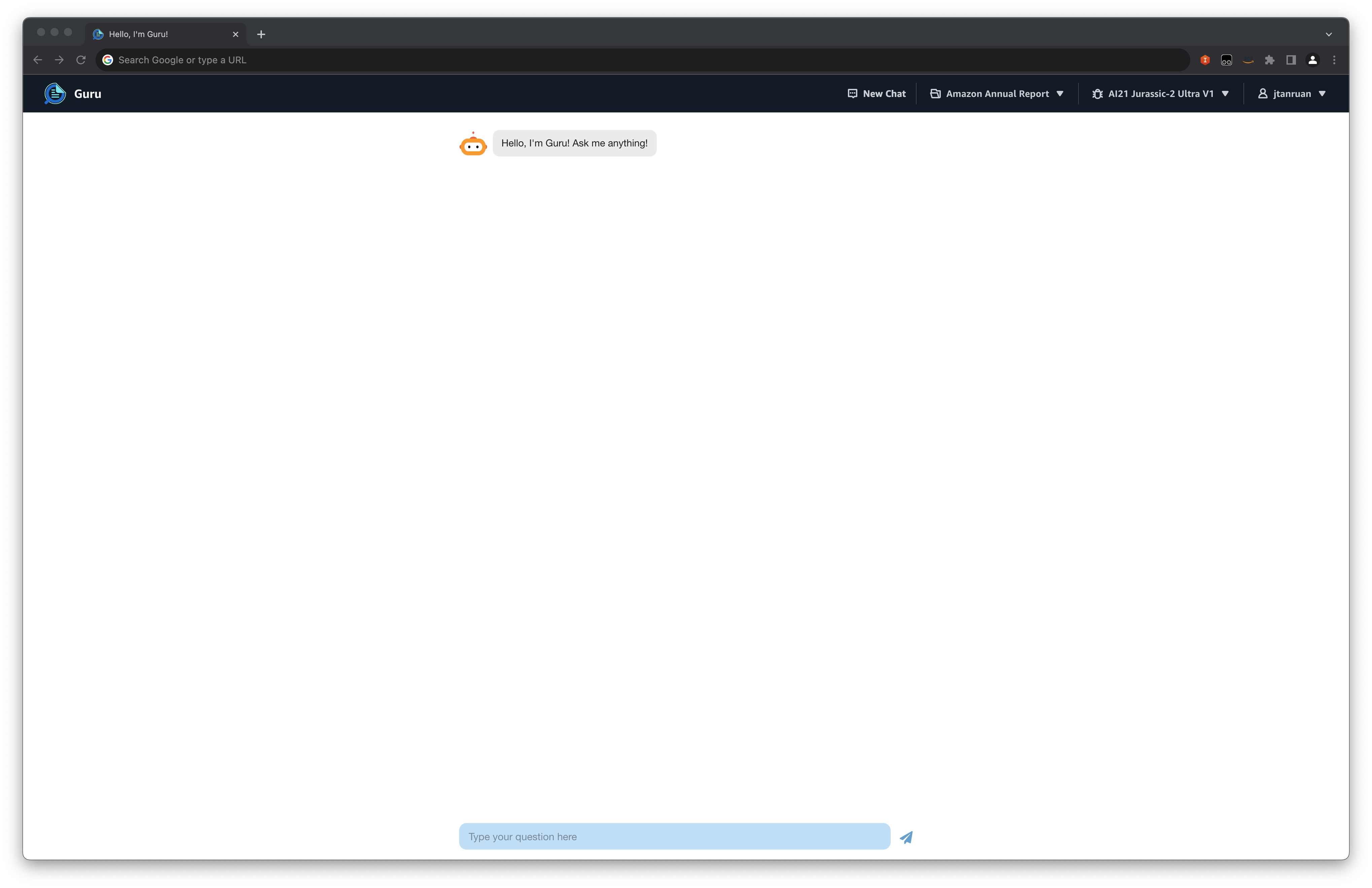

Документы обрабатываются и индексируются Amazon Kendra через Сервис Amazon Simple Storage (Amazon S3) разъем. Запросы клиентов и контекстные данные от Amazon Kendra направляются на Коренная порода Амазонки модель фундамента. Демоверсия позволяет вам выбирать между моделями Titan от Amazon, Jurassic от AI21 и Claude от Anthropic, поддерживаемыми Amazon Bedrock. История разговоров сохраняется в Amazon DynamoDB, предлагая дополнительный контекст для LLM для генерации ответов.

Мы предоставили эту демонстрацию в Репо GitHub. Обратитесь к инструкциям по развертыванию в файле readme, чтобы развернуть его в своей учетной записи AWS.

Следующие шаги описывают процесс взаимодействия пользователя с приложением генеративного ИИ:

- Пользователь входит в веб-приложение, аутентифицированный Амазон Когнито.

- Пользователь загружает один или несколько документов в Amazon S3.

- Пользователь запускает задание синхронизации Amazon Kendra для добавления документов S3 в индекс Amazon Kendra.

- Вопрос пользователя перенаправляется через безопасный API WebSocket, размещенный на Шлюз API Amazon при поддержке AWS Lambda функции.

- Функция Lambda, реализованная Лангчейн Framework — универсальный инструмент, предназначенный для создания приложений, основанных на языковых моделях искусственного интеллекта, — подключается к конечной точке Amazon Bedrock, чтобы перефразировать вопрос пользователя на основе истории чата. После перефразирования вопрос перенаправляется в Amazon Kendra с помощью API получения. В ответ индекс Amazon Kendra отображает результаты поиска, предоставляя выдержки из соответствующих документов, полученных на основе полученных данных предприятия.

- Вопрос пользователя вместе с данными, полученными из индекса, отправляются в качестве контекста в приглашении LLM. Ответ от LLM сохраняется как история чата в DynamoDB.

- Наконец, ответ от LLM отправляется обратно пользователю.

Рабочий процесс индексирования документов

Порядок обработки и индексации документов следующий:

- Пользователи отправляют документы через пользовательский интерфейс (UI).

- Документы передаются в корзину S3 с использованием АМС Усиление API.

- Amazon Kendra индексирует новые документы в корзине S3 через коннектор Amazon Kendra S3.

Преимущества

В следующем списке показаны преимущества этого решения:

- Извлечение на уровне предприятия – Amazon Kendra предназначен для корпоративного поиска, что делает его подходящим для организаций с огромными объемами структурированных и неструктурированных данных.

- Семантическое понимание – Возможности машинного обучения Amazon Kendra гарантируют, что поиск основан на глубоком семантическом понимании, а не только на совпадении ключевых слов.

- Масштабируемость – Amazon Kendra может обрабатывать крупномасштабные источники данных и обеспечивает быстрые и релевантные результаты поиска.

- Трансформируемость – Базовая модель может генерировать ответы на основе широкого спектра контекстов, обеспечивая универсальность системы.

- Возможности интеграции – Amazon Kendra можно интегрировать с различными сервисами и источниками данных AWS, что позволяет адаптировать его к различным потребностям организации.

Модель вложений с базовым LLM

An вложения — это числовой вектор, который представляет основную суть различных типов данных, включая текст, изображения, аудио и документы. Такое представление не только отражает внутреннее значение данных, но и адаптирует их для широкого спектра практических приложений. Модели внедрения (ветвь машинного обучения) преобразуют сложные данные, такие как слова или фразы, в непрерывные векторные пространства. Эти векторы по своей сути улавливают семантические связи между данными, позволяя проводить более глубокие и содержательные сравнения.

RAG органично сочетает в себе сильные стороны базовых моделей, таких как трансформаторы, с точностью встраивания для анализа обширных баз данных в поисках соответствующей информации. При получении запроса система использует встраивания для идентификации и извлечения соответствующих разделов из обширного массива данных. Затем базовая модель формулирует контекстуально точный ответ на основе этой извлеченной информации. Эта идеальная синергия между поиском данных и генерацией ответов позволяет системе предоставлять подробные ответы, опираясь на обширные знания, хранящиеся в обширных базах данных.

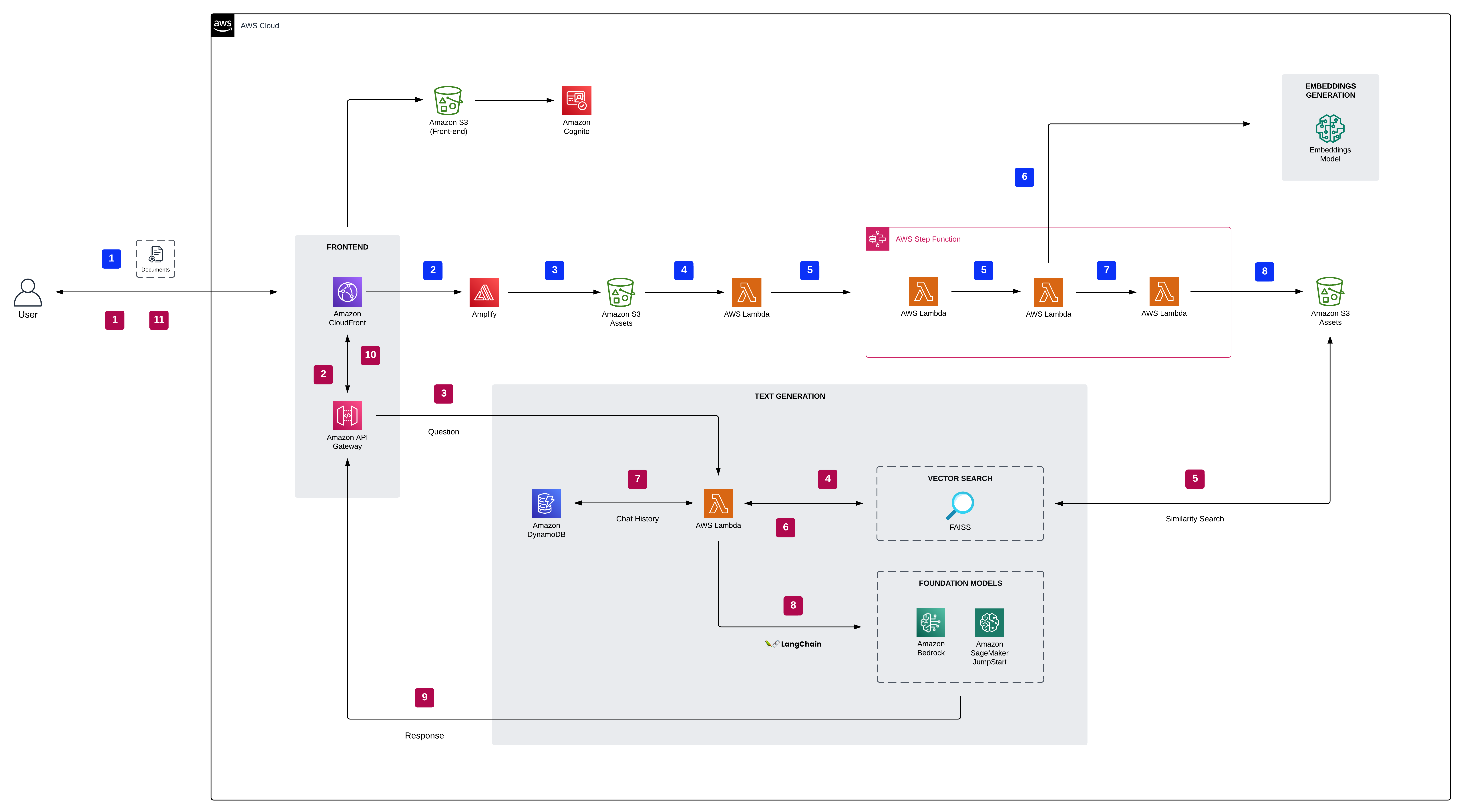

В архитектурном макете, в зависимости от выбранного пользовательского интерфейса, пользователи направляются либо к Amazon Bedrock, либо к Amazon Bedrock. Amazon SageMaker JumpStart модели фундамента. Документы подвергаются обработке, и векторные вложения создаются с помощью модели вложений. Эти вложения затем индексируются с использованием ФАИСС для обеспечения эффективного семантического поиска. Истории разговоров сохраняются в DynamoDB, что обогащает контекст LLM для подготовки ответов.

Следующая диаграмма иллюстрирует архитектуру решения и рабочий процесс.

Мы предоставили эту демонстрацию в Репо GitHub. Обратитесь к инструкциям по развертыванию в файле readme, чтобы развернуть его в своей учетной записи AWS.

Модель вложений

Обязанности модели встраивания заключаются в следующем:

- Эта модель отвечает за преобразование текста (например, документов или отрывков) в плотные векторные представления, широко известные как встраивания.

- Эти вложения отражают семантическое значение текста, позволяя проводить эффективные и семантически значимые сравнения между различными частями текста.

- Модель встраивания может обучаться на том же обширном корпусе, что и базовая модель, или может быть специализирована для конкретных областей.

Рабочий процесс вопросов и ответов

Следующие шаги описывают рабочий процесс ответа на вопрос по документам:

- Пользователь входит в веб-приложение, аутентифицированное Amazon Cognito.

- Пользователь загружает один или несколько документов в Amazon S3.

- При передаче документа уведомление о событии S3 запускает функцию Lambda, которая затем вызывает конечную точку модели внедрения SageMaker для создания внедрений для нового документа. Модель встраивания преобразует вопрос в плотное векторное представление (вложение). Полученный векторный файл надежно хранится в корзине S3.

- Средство поиска FAISS сравнивает встраивание этого вопроса с встраиванием всех документов или отрывков в базе данных, чтобы найти наиболее релевантные отрывки.

- Отрывки вместе с вопросами пользователя предоставляются в качестве контекста базовой модели. Функция Lambda использует библиотеку LangChain и подключается к конечной точке Amazon Bedrock или SageMaker JumpStart с помощью контекстно-наполненного запроса.

- Ответ от LLM сохраняется в DynamoDB вместе с запросом пользователя, отметкой времени, уникальным идентификатором и другими произвольными идентификаторами элемента, например категорией вопроса. Сохранение вопроса и ответа в виде отдельных элементов позволяет функции Lambda легко воссоздавать историю разговоров пользователя на основе времени, когда были заданы вопросы.

- Наконец, ответ отправляется обратно пользователю через запрос HTTPs через ответ интеграции API Gateway WebSocket.

Преимущества

В следующем списке описаны преимущества этого решения:

- Семантическое понимание – Модель внедрения гарантирует, что программа поиска выбирает отрывки на основе глубокого семантического понимания, а не только совпадений ключевых слов.

- Масштабируемость – Встраивания позволяют эффективно сравнивать сходство, что делает возможным быстрый поиск в обширных базах данных документов.

- Трансформируемость – Базовая модель может генерировать ответы на основе широкого спектра контекстов, обеспечивая универсальность системы.

- Адаптивность домена – Модель внедрения можно обучить или настроить для конкретных областей, что позволяет адаптировать систему для различных приложений.

Генератор фармацевтической рекламы Foundation Models

В современной быстро развивающейся фармацевтической отрасли эффективная и локализованная реклама играет более важную роль, чем когда-либо. Именно здесь в игру вступает инновационное решение, использующее возможности генеративного искусственного интеллекта для создания локализованной фармацевтической рекламы на основе исходных изображений и PDF-файлов. Помимо простого ускорения процесса создания рекламы, этот подход упрощает процесс медицинской юридической экспертизы (MLR). MLR — это строгий механизм проверки, в котором медицинские, юридические и регулирующие органы тщательно оценивают рекламные материалы, чтобы гарантировать их точность, научную поддержку и соответствие нормативным требованиям. Традиционные методы создания контента могут быть громоздкими, часто требующими ручной корректировки и обширных проверок для обеспечения соответствия региональным требованиям и актуальности. Однако с появлением генеративного искусственного интеллекта мы теперь можем автоматизировать создание рекламы, которая действительно находит отклик у местной аудитории, при этом соблюдая строгие стандарты и рекомендации.

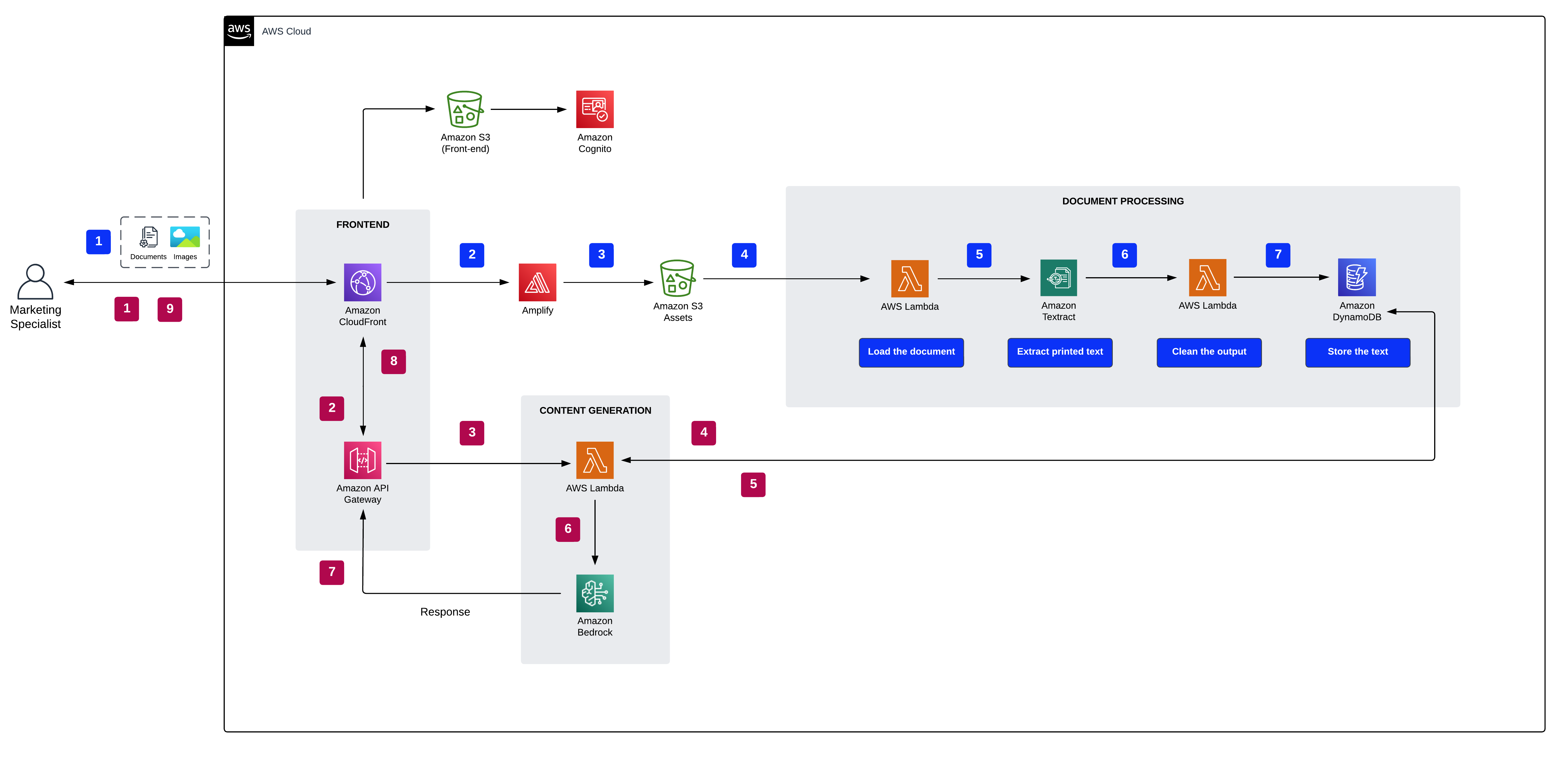

Следующая диаграмма иллюстрирует архитектуру решения.

В архитектурном макете, основанном на выбранной модели и рекламных предпочтениях, пользователи легко переходят к базовым моделям Amazon Bedrock. Такой оптимизированный подход гарантирует, что новые объявления будут создаваться точно в соответствии с желаемой конфигурацией. В рамках этого процесса документы эффективно обрабатываются Амазонка Текст, а полученный текст надежно сохраняется в DynamoDB. Выдающейся особенностью является модульная конструкция для генерации изображений и текста, предоставляющая вам возможность независимо регенерировать любой компонент по мере необходимости.

Мы предоставили эту демонстрацию в Репо GitHub. Обратитесь к инструкциям по развертыванию в файле readme, чтобы развернуть его в своей учетной записи AWS.

Рабочий процесс создания контента

Следующие шаги описывают процесс создания контента:

- Пользователь выбирает документ, исходное изображение, место размещения рекламы, язык и стиль изображения.

- Безопасный доступ к веб-приложению обеспечивается посредством аутентификации Amazon Cognito.

- Интерфейс веб-приложения размещается через Amplify.

- API WebSocket, управляемый API Gateway, облегчает запросы пользователей. Эти запросы аутентифицируются через Управление идентификацией и доступом AWS (Я).

- Интеграция с Amazon Bedrock включает следующие шаги:

- Функция Lambda использует библиотеку LangChain для подключения к конечной точке Amazon Bedrock с помощью контекстно-насыщенного запроса.

- Базовая модель преобразования текста в текст создает контекстно-зависимую рекламу на основе заданного контекста и настроек.

- Базовая модель преобразования текста в изображение создает индивидуальное изображение под влиянием исходного изображения, выбранного стиля и местоположения.

- Пользователь получает ответ посредством HTTPS-запроса через интегрированный API Gateway WebSocket API.

Рабочий процесс обработки документов и изображений

Порядок обработки документов и изображений следующий:

- Пользователь загружает ресурсы через указанный пользовательский интерфейс.

- API Amplify переносит документы в корзину S3.

- После передачи актива в Amazon S3 происходит одно из следующих действий:

- Если это документ, функция Lambda использует Amazon Textract для обработки и извлечения текста для создания рекламы.

- Если это изображение, функция Lambda преобразует его в формат base64, подходящий для модели Stable Diffusion, для создания нового изображения из источника.

- Извлеченный текст или строка изображения в формате Base64 надежно сохраняется в DynamoDB.

Преимущества

В следующем списке описаны преимущества этого решения:

- Эффективность – Использование генеративного искусственного интеллекта значительно ускоряет процесс генерации рекламы, устраняя необходимость ручной корректировки.

- Соблюдение требований – Решение гарантирует, что созданная реклама соответствует конкретным рекомендациям и нормам, таким как рекомендации FDA по маркетингу.

- Экономичное – Автоматизируя создание индивидуальной рекламы, компании могут значительно сократить затраты, связанные с производством и редактированием рекламы.

- Оптимизированный процесс MLR – Решение упрощает процесс MLR, уменьшая количество проблем и обеспечивая более плавную проверку.

- Локализованный резонанс – Генеративный искусственный интеллект создает рекламу, которая находит отклик у местной аудитории, обеспечивая актуальность и влияние в разных регионах.

- Стандартизация – Решение поддерживает необходимые стандарты и рекомендации, обеспечивая согласованность всех создаваемых объявлений.

- Масштабируемость – Подход на основе искусственного интеллекта позволяет обрабатывать обширные базы данных исходных изображений и PDF-файлов, что делает возможным создание крупномасштабной рекламы.

- Уменьшенное ручное вмешательство – Автоматизация снижает необходимость вмешательства человека, сводя к минимуму ошибки и обеспечивая согласованность.

Вы можете развернуть инфраструктуру, описанную в этом руководстве, со своего локального компьютера или использовать AWS Cloud9 в качестве рабочей станции развертывания. AWS Cloud9 поставляется с предварительно загруженным интерфейсом командной строки AWS, AWS CDK и Docker. Если вы выберете AWS Cloud9, создать среду из Консоль AWS Cloud9.

Убирать

Чтобы избежать ненужных затрат, очистите всю инфраструктуру, созданную с помощью консоли AWS CloudFormation или выполнив следующую команду на своей рабочей станции:

Кроме того, не забудьте остановить все конечные точки SageMaker, которые вы инициировали через консоль SageMaker. Помните, что удаление индекса Amazon Kendra не удаляет исходные документы из вашего хранилища.

Заключение

Генеративный искусственный интеллект, воплощенный в LLM, знаменует собой сдвиг парадигмы в том, как мы получаем доступ к информации и генерируем ее. Эти модели, несмотря на свою эффективность, часто ограничены рамками обучающих данных. RAG решает эту проблему, гарантируя, что обширные знания в рамках этих моделей постоянно дополняются актуальной и актуальной информацией.

Наши демо-версии на основе RAG являются убедительным тому подтверждением. Они демонстрируют беспрепятственное взаимодействие между Amazon Kendra, векторным встраиванием и LLM, создавая систему, в которой информация не только обширна, но также точна и своевременна. Погружаясь в эти демонстрации, вы из первых рук познакомитесь с преобразующим потенциалом объединения предварительно обученных знаний с динамическими возможностями RAG, что приведет к получению надежных результатов, адаптированных к корпоративному контенту.

Хотя генеративный искусственный интеллект на основе LLM открывает новый способ получения информации, эта информация должна быть достоверной и ограничиваться корпоративным контентом с использованием подхода RAG. Эти демонстрации на основе RAG позволят вам получить точную и актуальную информацию. Качество этой информации зависит от семантической релевантности, которая достигается за счет использования Amazon Kendra и векторного внедрения.

Если вы готовы к дальнейшему изучению и использованию возможностей генеративного искусственного интеллекта, вот ваши следующие шаги:

- Воспользуйтесь нашими демоверсиями – Практический опыт бесценен. Изучите функциональные возможности, разберитесь в интеграции и ознакомьтесь с интерфейсом.

- Углубите свои знания – Используйте имеющиеся ресурсы. AWS предлагает подробную документацию, учебные пособия и поддержку сообщества, которые помогут вам в освоении искусственного интеллекта.

- Запустить пилотный проект – Подумайте о том, чтобы начать с небольшого внедрения генеративного ИИ на вашем предприятии. Это даст представление о практичности и адаптируемости системы в вашем конкретном контексте.

Дополнительную информацию о генеративных приложениях искусственного интеллекта на AWS можно найти по следующим ссылкам:

Помните, что сфера ИИ постоянно развивается. Будьте в курсе событий, сохраняйте любопытство и всегда будьте готовы адаптироваться и внедрять инновации.

Об авторах

Джин Тан Руан — разработчик прототипов в команде AWS Industries по прототипированию и проектированию клиентов (PACE), специализирующийся на НЛП и генеративном искусственном интеллекте. Имея опыт разработки программного обеспечения и девять сертификатов AWS, Джин привносит богатый опыт, помогая клиентам AWS реализовать свои идеи в области искусственного интеллекта, машинного обучения и генеративного искусственного интеллекта с помощью платформы AWS. Он получил степень магистра в области компьютерных наук и разработки программного обеспечения в Университете Сиракуз. Вне работы Джин любит играть в видеоигры и погружаться в захватывающий мир фильмов ужасов.

Джин Тан Руан — разработчик прототипов в команде AWS Industries по прототипированию и проектированию клиентов (PACE), специализирующийся на НЛП и генеративном искусственном интеллекте. Имея опыт разработки программного обеспечения и девять сертификатов AWS, Джин привносит богатый опыт, помогая клиентам AWS реализовать свои идеи в области искусственного интеллекта, машинного обучения и генеративного искусственного интеллекта с помощью платформы AWS. Он получил степень магистра в области компьютерных наук и разработки программного обеспечения в Университете Сиракуз. Вне работы Джин любит играть в видеоигры и погружаться в захватывающий мир фильмов ужасов.

Аравинд Кодандарамайя — старший разработчик полнофункциональных решений для прототипирования в команде AWS Industries по прототипированию и проектированию клиентов (PACE). Он стремится помочь клиентам AWS превратить инновационные идеи в решения с измеримыми и впечатляющими результатами. Он увлечен целым рядом тем, включая облачную безопасность, DevOps и AI/ML, и обычно его можно встретить работающим с этими технологиями.

Аравинд Кодандарамайя — старший разработчик полнофункциональных решений для прототипирования в команде AWS Industries по прототипированию и проектированию клиентов (PACE). Он стремится помочь клиентам AWS превратить инновационные идеи в решения с измеримыми и впечатляющими результатами. Он увлечен целым рядом тем, включая облачную безопасность, DevOps и AI/ML, и обычно его можно встретить работающим с этими технологиями.

Арджун Шакдер — разработчик в команде AWS Industries Prototyping (PACE), который увлечен внедрением технологий в ткань жизни. Имея степень магистра Университета Пердью, нынешняя роль Арджуна связана с архитектурой и созданием передовых прототипов, охватывающих множество областей, в настоящее время занимающих видное место в сферах искусственного интеллекта, машинного обучения и Интернета вещей. Когда вы не погружены в код и цифровые ландшафты, вы обнаружите, что Арджун предается миру кофе, исследует сложную механику часового дела или упивается искусством автомобилей.

Арджун Шакдер — разработчик в команде AWS Industries Prototyping (PACE), который увлечен внедрением технологий в ткань жизни. Имея степень магистра Университета Пердью, нынешняя роль Арджуна связана с архитектурой и созданием передовых прототипов, охватывающих множество областей, в настоящее время занимающих видное место в сферах искусственного интеллекта, машинного обучения и Интернета вещей. Когда вы не погружены в код и цифровые ландшафты, вы обнаружите, что Арджун предается миру кофе, исследует сложную механику часового дела или упивается искусством автомобилей.

- SEO-контент и PR-распределение. Получите усиление сегодня.

- PlatoData.Network Вертикальный генеративный ИИ. Расширьте возможности себя. Доступ здесь.

- ПлатонАйСтрим. Интеллект Web3. Расширение знаний. Доступ здесь.

- ПлатонЭСГ. Углерод, чистые технологии, Энергия, Окружающая среда, Солнечная, Управление отходами. Доступ здесь.

- ПлатонЗдоровье. Биотехнологии и клинические исследования. Доступ здесь.

- Источник: https://aws.amazon.com/blogs/machine-learning/harnessing-the-power-of-enterprise-data-with-generative-ai-insights-from-amazon-kendra-langchain-and-large-language-models/

- :является

- :нет

- :куда

- $UP

- 100

- 150

- 7

- a

- способность

- О нас

- ускоряет

- доступ

- По

- Учетная запись

- точность

- точный

- через

- действия

- Ad

- приспосабливать

- адаптируются

- добавленный

- адреса

- придерживаться

- корректировки

- Принятие

- объявления

- продвинутый

- плюс

- Преимущества

- приход

- Реклама

- После

- AI

- AI / ML

- помощь

- выравнивание

- Все

- позволять

- Позволяющий

- позволяет

- почти

- вдоль

- причислены

- альтернатива

- всегда

- Amazon

- Амазон Когнито

- Амазон Кендра

- Амазонка Текст

- Amazon Web Services

- суммы

- усиливать

- an

- и

- ответ

- ответы

- любой

- API

- приложение

- Применение

- Приложения

- подхода

- соответствующий

- архитектурный

- архитектура

- МЫ

- около

- массив

- артистичность

- AS

- активы

- Активы

- помощь

- связанный

- аудитории

- аудио

- подлинности

- Аутентификация

- автоматизировать

- Автоматизация

- автоматизация

- доступен

- избежать

- избегающий

- AWS

- Облако AWS9

- AWS CloudFormation

- назад

- со спинкой

- фон

- поддержка

- Использование темпера с изогнутым основанием

- основанный

- BE

- , так как:

- становиться

- становится

- Преимущества

- Лучшая

- между

- Beyond

- предубеждения

- смешивание

- тело

- Бот

- изоферменты печени

- Филиал

- Приносит

- широкий

- строитель

- Строительство

- но

- by

- Объявления

- CAN

- Может получить

- возможности

- захватить

- перехватывает

- случаев

- Категории

- сертификаты

- вызов

- проблемы

- Выберите

- выбранный

- чистым

- облако

- Cloud Security

- Cloud9

- код

- Кофе

- сочетании

- комбинаты

- выходит

- обычно

- сообщество

- Компании

- сравнения

- комплекс

- Соответствие закону

- уступчивый

- компонент

- понимает

- компьютер

- Информатика

- Конфигурация

- Свяжитесь

- Коммутация

- подключает

- Рассматривать

- последовательно

- Консоли

- постоянно

- содержание

- Генерация контента

- контентного создание

- контекст

- контексты

- контекстной

- продолжающийся

- (CIJ)

- Удобно

- обычный

- Разговор

- преобразование

- Основные

- Цена

- Расходы

- выработать

- Создайте

- создали

- создает

- Создающий

- создание

- решающее значение

- громоздкий

- любопытный

- Текущий

- изготовленный на заказ

- клиент

- Клиенты

- передовой

- данным

- База данных

- базы данных

- Наборы данных

- Время

- глубоко

- более глубокий

- Степень

- восхитительный

- демонстрация

- Демос

- зависимый

- развертывание

- развернуть

- развертывание

- развертывание

- описывать

- Проект

- предназначенный

- желанный

- уничтожить

- подробный

- подробнее

- Застройщик

- Развитие

- диагностический

- различный

- Вещание

- Интернет

- направленный

- дисплеев

- отчетливый

- погружение

- Разное

- дайвинг

- Docker

- документ

- документации

- Документация

- не

- доменов

- рисовать

- рисование

- управляемый

- динамический

- легко

- затрат

- эффективный

- эффективно

- или

- уничтожение

- вложения

- появляться

- работает

- уполномоченный

- Наделяет

- включить

- включен

- позволяет

- позволяет

- конец

- Конечная точка

- Проект и

- расширение

- обогащение

- обеспечивать

- обеспечивается

- обеспечивает

- обеспечение

- Предприятие

- Весь

- оборудованный

- ошибки

- особенно

- сущность

- оценивать

- События

- НИКОГДА

- развивается

- развивается

- пример

- возбужденный

- экспансивный

- опыт

- эксперту

- эксперты

- Больше

- Исследование

- обширный

- и, что лучший способ

- извлечение

- ткань

- облегчает

- ознакомиться

- быстрый темп

- FB

- выполнимый

- Особенность

- Особенности

- Показывая

- Файл

- фильтрация

- Найдите

- Во-первых,

- Трансформируемость

- фокусируется

- после

- следующим образом

- Что касается

- формат

- найденный

- Год основания

- трение

- от

- передний

- Внешний интерфейс

- полный

- Полный стек

- функция

- функциональные возможности

- далее

- Более того

- Gain

- получение

- Игры

- шлюз

- порождать

- генерируется

- поколение

- генеративный

- Генеративный ИИ

- генератор

- получить

- данный

- Отдаете

- предоставление

- схватывание

- Растет

- гарантия

- руководство

- управляемый

- методические рекомендации

- обрабатывать

- практический

- упряжь

- Освоение

- Есть

- имеющий

- he

- помощь

- глашатаи

- здесь

- основной момент

- сам

- истории

- история

- проведение

- имеет

- ужас

- состоялся

- Как

- Однако

- HTML

- HTTP

- HTTPS

- человек

- идеи

- идентификатор

- идентификаторы

- определения

- Личность

- if

- иллюстрирует

- изображение

- изображений

- погруженный

- Влияние

- реализация

- in

- углубленный

- неточный

- включает в себя

- В том числе

- включать

- самостоятельно

- индекс

- индексированный

- Индексы

- промышленности

- промышленность

- отраслевые стандарты

- влияние

- информация

- сообщил

- Инфраструктура

- по существу

- начальный

- начатый

- обновлять

- инновационный

- проницательный

- размышления

- вместо

- инструкции

- интегрированный

- Интегрируется

- интеграции.

- интеграций

- намерение

- взаимодействует

- Интерфейс

- вмешательство

- в

- внутренний

- неоценимый

- КАТО

- IT

- пункты

- ЕГО

- работа

- путешествие

- JPG

- всего

- знания

- известный

- пейзаж

- язык

- большой

- крупномасштабный

- Планировка

- изучение

- Юр. Информация

- Lets

- Библиотека

- Лицензирована

- ЖИЗНЬЮ

- такое как

- вероятность

- Ограниченный

- рамки

- Список

- LLM

- локальным

- расположение

- машина

- обучение с помощью машины

- поддерживает

- Создание

- управляемого

- руководство

- многих

- Маркетинг

- массивный

- магистра

- спички

- материалы

- смысл

- значимым

- значения

- означает

- механика

- механизм

- основным медицинским

- Память

- просто

- слияния

- объединение

- методы

- тщательно

- минимизация

- смягчение

- ML

- модель

- моделирование

- Модели

- модульный

- БОЛЕЕ

- самых

- Кино

- должен

- натуральный

- Обработка естественного языка

- необходимо

- Необходимость

- необходимый

- нуждающихся

- потребности

- Новые

- следующий

- 9

- НЛП

- уведомление

- сейчас

- of

- предлагающий

- Предложения

- .

- on

- ONE

- только

- Откроется

- or

- организационной

- организации

- оригинал

- Другое

- наши

- внешний

- Результаты

- контур

- выходы

- внешнюю

- за

- Преодолеть

- Темп

- парадигма

- параметры

- часть

- страстный

- ИДЕАЛЬНОЕ

- Разрешения

- Персонализированные

- Фармацевтика

- в Фармацевтической отрасли

- фразы

- штук

- пилот

- пилотный проект

- Часть

- размещение

- Платформа

- Платон

- Платон Интеллектуальные данные

- ПлатонДанные

- Играть

- игры

- пунктов

- позиционирование

- возможное

- После

- потенциал

- мощностью

- Питание

- мощный

- практическое

- необходимость

- Точно

- Точность

- предпочтения

- предпосылки

- в настоящее время

- процедуры

- процесс

- Обработанный

- обработка

- Произведенный

- производит

- Производство

- Проект

- рекламный

- Прототипы

- макетирования

- Доказывать

- обеспечивать

- при условии

- приводит

- обеспечение

- Запросы

- вопрос

- Вопросы

- САЙТ

- быстро

- ассортимент

- готовый

- царств

- получает

- получение

- Рекомендация

- уменьшить

- снижает

- снижение

- относиться

- рафинированный

- региональный

- районы

- регулярный

- правила

- регуляторы

- Соответствие нормативным требованиям

- актуальность

- соответствующие

- опираясь

- оставаться

- остатки

- помнить

- удаление

- перефразировать

- представление

- представляет

- запросить

- Запросы

- требовать

- обязательный

- Требования

- Resonate

- Полезные ресурсы

- ответ

- ответы

- ответственности

- ответственный

- результирующий

- в результате

- Итоги

- обзоре

- Отзывы

- пересмотры

- вращается

- правую

- тщательный

- Роли

- Бег

- работает

- sagemaker

- то же

- сохраняются

- Наука

- научный

- бесшовные

- легко

- Поиск

- разделах

- безопасный

- безопасно

- безопасность

- выбранный

- выбор

- старший

- послать

- обслуживание

- Услуги

- набор

- настройки

- установка

- сдвиг

- демонстрации

- Шоу

- Просеять

- значительный

- существенно

- просто

- просто

- меньше

- гладкой

- Software

- разработка программного обеспечения

- разработка программного обеспечения

- только

- Решение

- Решения

- Источник

- источников

- Источники

- Об

- пространства

- пролет

- специализированный

- специализация

- конкретный

- указанный

- стабильный

- стек

- стандартов

- Начало

- современное состояние

- оставаться

- Шаг

- Шаги

- Stop

- диск

- магазин

- хранить

- хранение

- обтекаемый

- сильные

- строка

- строгий

- структурированный

- стиль

- отправить

- такие

- подходящее

- поддержка

- Поддержанный

- взаимодействие

- система

- с учетом

- взять

- принимает

- осязаемый

- Сложность задачи

- задачи

- команда

- команды

- техника

- технологии

- Технологии

- воли

- текст

- чем

- который

- Ассоциация

- Пейзаж

- Источник

- мир

- их

- Их

- тогда

- тем самым

- Эти

- они

- этой

- три

- волнующий

- Через

- время

- своевременно

- отметка времени

- исполин

- в

- Сегодняшних

- инструментом

- инструменты

- тема

- Темы

- к

- традиционный

- Train

- специалистов

- Обучение

- перевод

- переданы

- переводы

- Transform

- трансформационный

- трансформеры

- Тенденции

- по-настоящему

- заслуживающий доверия

- ОЧЕРЕДЬ

- учебник

- учебные пособия

- Типы

- ui

- претерпевать

- лежащий в основе

- понимать

- понимание

- созданного

- Университет

- В отличие от

- ненужный

- открывать

- новейший

- Обновление ПО

- обновление

- Updates

- отстаивание

- на

- использование

- прецедент

- Информация о пользователе

- Пользовательский интерфейс

- пользователей

- использования

- через

- обычно

- использует

- Использующий

- различный

- Огромная

- разносторонний

- с помощью

- Видео

- видеоигры

- видения

- Путь..

- we

- Богатство

- Web

- веб приложение

- веб-сервисы

- веб-сокет

- были

- когда

- который

- в то время как

- КТО

- широкий

- Широкий диапазон

- будете

- в

- без

- слова

- Работа

- рабочий

- рабочая станция

- Мир

- Ты

- ВАШЕ

- себя

- зефирнет