Это гостевой пост, написанный в соавторстве с Нафи Ахметом Тургутом, Хасаном Бураком Йелем и Дамлой Шентюрк из Getir.

Основанная в 2015, принес позиционирует себя как первопроходец в сфере сверхбыстрой доставки продуктов. Эта инновационная технологическая компания произвела революцию в сегменте доставки последней мили, предложив «продукты за считанные минуты». Присутствуя в Турции, Великобритании, Нидерландах, Германии и США, «Гетир» стала многонациональной силой, с которой нужно считаться. Сегодня бренд Getir представляет собой диверсифицированный конгломерат, включающий девять различных вертикалей, которые синергетически работают под единым зонтиком.

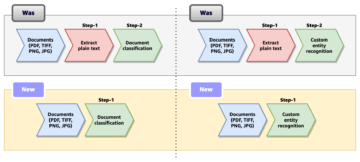

В этом посте мы объясняем, как мы создали комплексный конвейер прогнозирования категорий продуктов, чтобы помочь коммерческим командам с помощью Создатель мудреца Амазонки и Пакет AWS, сокращая продолжительность обучения модели на 90 %.

Подробное понимание существующего ассортимента нашей продукции является важнейшей задачей, с которой мы, как и многие компании, сталкиваемся на современном быстро развивающемся и конкурентном рынке. Эффективным решением этой проблемы является прогнозирование категорий товаров. Модель, которая генерирует комплексное дерево категорий, позволяет нашим коммерческим командам сравнивать существующий портфель продуктов с портфелем наших конкурентов, предлагая стратегическое преимущество. Поэтому нашей главной задачей является создание и внедрение точной модели прогнозирования категорий продуктов.

Мы воспользовались мощными инструментами, предоставляемыми AWS, чтобы решить эту задачу и эффективно ориентироваться в сложной области машинного обучения (ML) и прогнозной аналитики. Наши усилия привели к успешному созданию комплексного конвейера прогнозирования категорий продуктов, который сочетает в себе сильные стороны SageMaker и AWS Batch.

Возможности прогнозной аналитики, особенно точный прогноз категорий продуктов, оказались неоценимыми. Это предоставило нашим командам важную информацию на основе данных, которая оптимизировала управление запасами, улучшила взаимодействие с клиентами и укрепила наше присутствие на рынке.

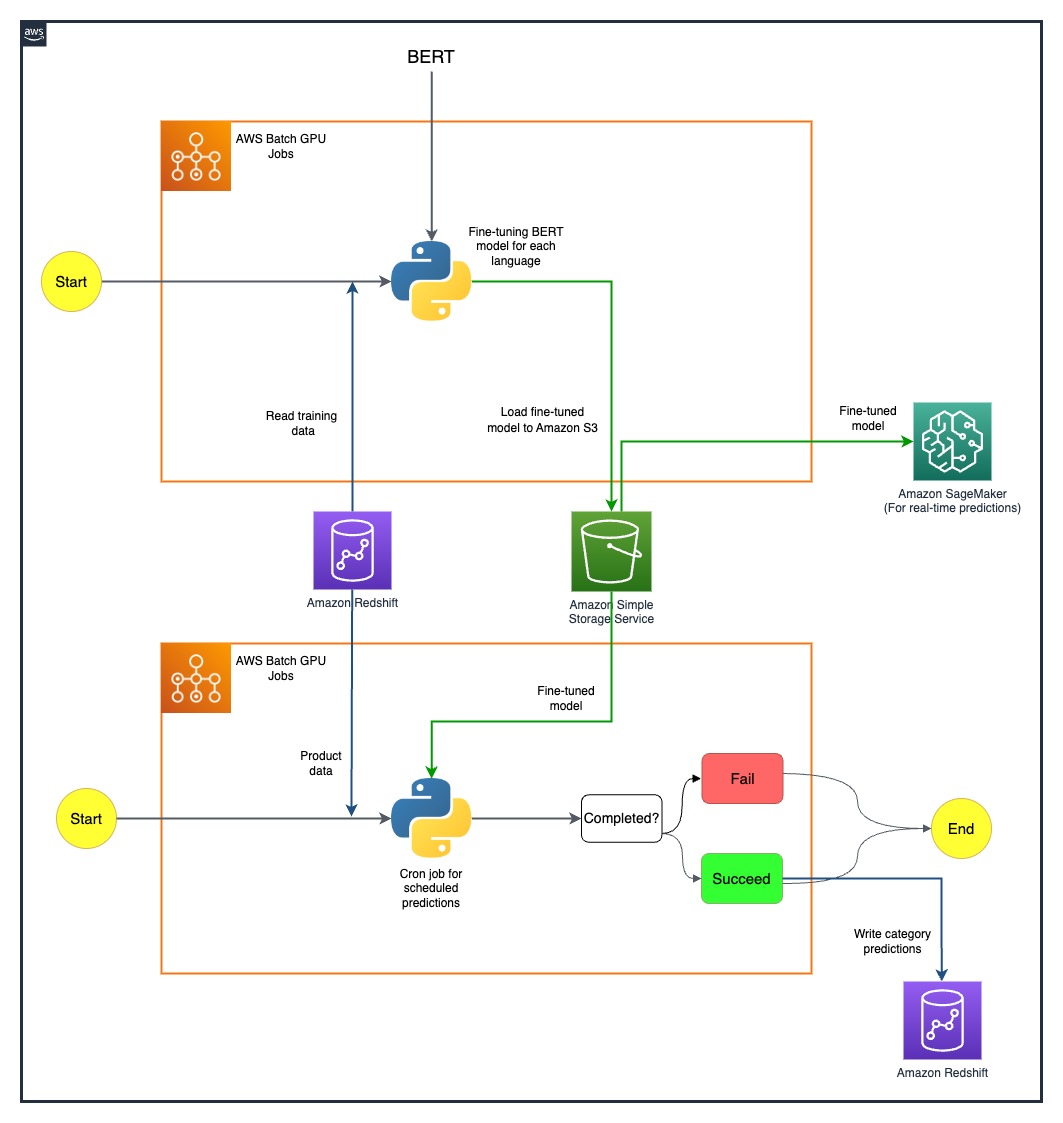

Методология, которую мы объясняем в этом посте, варьируется от начальной фазы сбора набора функций до окончательной реализации конвейера прогнозирования. Важным аспектом нашей стратегии было использование SageMaker и AWS Batch для уточнения предварительно обученных моделей BERT для семи разных языков. Кроме того, наша бесшовная интеграция с сервисом объектного хранилища AWS. Простой сервис хранения Amazon (Amazon S3) стал ключом к эффективному хранению и доступу к этим изысканным моделям.

SageMaker — это полностью управляемый сервис машинного обучения. С помощью SageMaker специалисты по данным и разработчики могут быстро и легко создавать и обучать модели машинного обучения, а затем напрямую развертывать их в готовой к работе размещенной среде.

Являясь полностью управляемым сервисом, AWS Batch помогает выполнять рабочие нагрузки пакетных вычислений любого масштаба. AWS Batch автоматически выделяет вычислительные ресурсы и оптимизирует распределение рабочих нагрузок в зависимости от их количества и масштаба. Благодаря AWS Batch нет необходимости устанавливать программное обеспечение для пакетных вычислений или управлять им, поэтому вы можете сосредоточить свое время на анализе результатов и решении проблем. Мы использовали задания графического процессора, которые помогают нам запускать задания, использующие графические процессоры экземпляра.

Обзор решения

Над этим проектом вместе работали пять человек из команды Getir по обработке данных и команды по инфраструктуре. Проект был завершен за месяц и запущен в производство после недели тестирования.

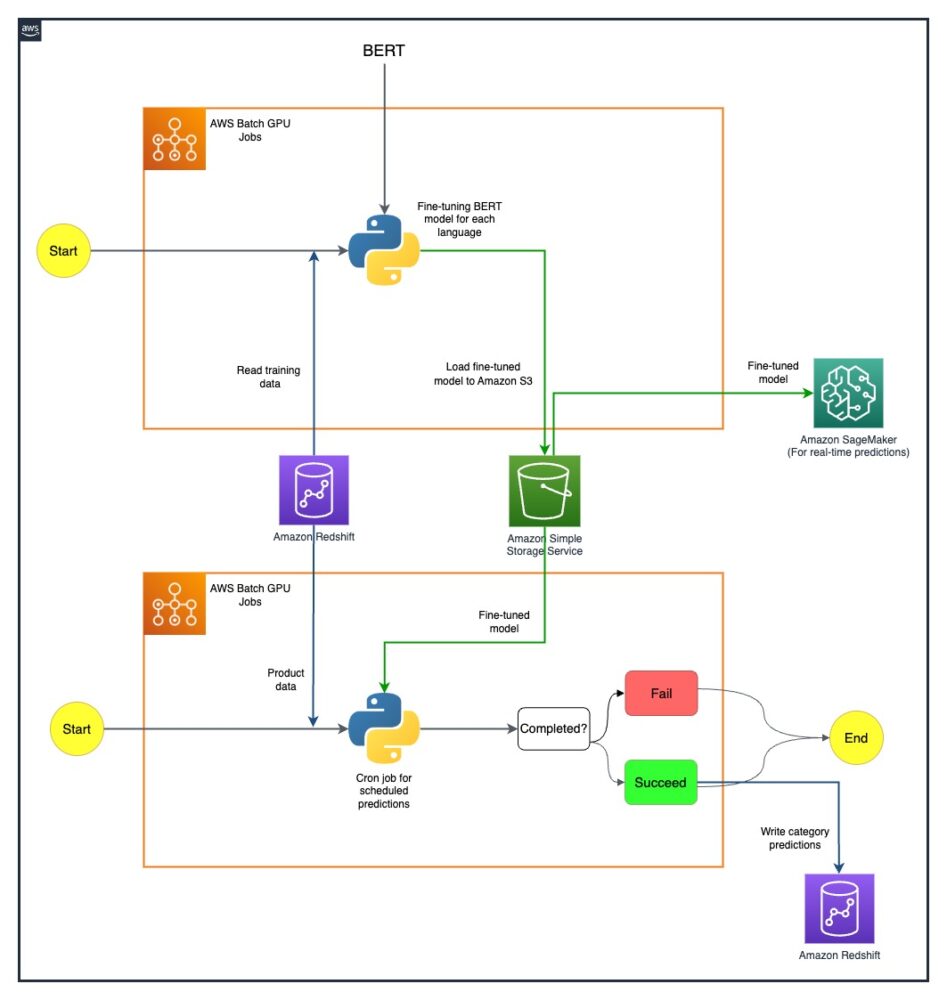

На следующей диаграмме показана архитектура решения.

Модельный конвейер запускается отдельно для каждой страны. Архитектура включает в себя два задания cron AWS Batch GPU для каждой страны, выполняемые по определенному расписанию.

Мы преодолели некоторые проблемы, стратегически развернув ресурсы графических процессоров SageMaker и AWS Batch. Процесс решения каждой проблемы подробно описан в следующих разделах.

Точная настройка многоязычных моделей BERT с помощью заданий графического процессора AWS Batch

Мы искали решение для поддержки нескольких языков для нашей разнообразной базы пользователей. Модели BERT были очевидным выбором из-за их признанной способности эффективно решать сложные задачи на естественном языке. Чтобы адаптировать эти модели к нашим потребностям, мы использовали возможности AWS, используя задания экземпляров графического процессора с одним узлом. Это позволило нам точно настроить предварительно обученные модели BERT для каждого из семи языков, поддержка которых нам требовалась. Благодаря этому методу мы обеспечили высокую точность прогнозирования категорий продуктов, преодолев любые потенциальные языковые барьеры.

Эффективное хранение моделей с использованием Amazon S3

Нашим следующим шагом было решение проблемы хранения и управления моделями. Для этого мы выбрали Amazon S3, известный своей масштабируемостью и безопасностью. Хранение наших точно настроенных моделей BERT на Amazon S3 позволило нам обеспечить легкий доступ к различным командам внутри нашей организации, тем самым значительно упростив процесс развертывания. Это был решающий аспект в достижении гибкости наших операций и плавной интеграции наших усилий по машинному обучению.

Создание конвейера сквозного прогнозирования

Для наилучшего использования наших предварительно обученных моделей требовался эффективный конвейер. Впервые мы внедрили эти модели в SageMaker — действие, которое позволило делать прогнозы в реальном времени с низкой задержкой, тем самым улучшая наш пользовательский опыт. Для крупномасштабных пакетных прогнозов, которые были не менее важны для нашей деятельности, мы использовали задания AWS Batch GPU. Это обеспечило оптимальное использование наших ресурсов, обеспечив нам идеальный баланс производительности и эффективности.

Исследование будущих возможностей с помощью MME SageMaker

Поскольку мы продолжаем развиваться и стремиться к повышению эффективности нашего конвейера машинного обучения, мы стремимся изучить одно из направлений — использование многомодельных конечных точек (MME) SageMaker для развертывания наших точно настроенных моделей. С помощью MME мы потенциально можем упростить развертывание различных точно настроенных моделей, обеспечивая эффективное управление моделями, а также используя встроенные возможности SageMaker, такие как теневые варианты, автоматическое масштабирование и Amazon CloudWatch интеграция. Это исследование согласуется с нашим постоянным стремлением улучшить наши возможности прогнозной аналитики и предоставить нашим клиентам превосходный опыт.

Заключение

Успешная интеграция SageMaker и AWS Batch не только решила наши конкретные проблемы, но и значительно повысила эффективность нашей работы. Благодаря внедрению сложного конвейера прогнозирования категорий продуктов мы можем предоставить нашим коммерческим командам аналитическую информацию на основе данных, тем самым способствуя более эффективному принятию решений.

Наши результаты говорят красноречивее всяких слов об эффективности нашего подхода. Мы достигли точности прогнозирования 80 % на всех четырех уровнях детализации категорий, что играет важную роль в формировании ассортимента продуктов для каждой страны, которую мы обслуживаем. Такой уровень точности позволяет нам преодолевать языковые барьеры и гарантирует, что мы с максимальной точностью обслуживаем нашу разнообразную базу пользователей.

Более того, стратегически используя запланированные задания графического процессора AWS Batch, мы смогли сократить продолжительность обучения модели на 90 %. Эта эффективность еще больше оптимизировала наши процессы и повысила нашу оперативную гибкость. Эффективное хранение моделей с использованием Amazon S3 сыграло решающую роль в этом достижении, балансируя как прогнозирование в реальном времени, так и пакетное прогнозирование.

Дополнительные сведения о том, как приступить к созданию собственных конвейеров машинного обучения с помощью SageMaker, см. Ресурсы Amazon SageMaker. AWS Batch — отличный вариант, если вы ищете недорогое масштабируемое решение для выполнения пакетных заданий с низкими эксплуатационными расходами. Для начала см. Начало работы с AWS Batch.

Об авторах

Нафи Ахмет Тургут получил степень магистра в области электротехники и электроники и работал научным сотрудником. Его целью было создание алгоритмов машинного обучения для моделирования аномалий нервной сети. Он присоединился к Getir в 2019 году и в настоящее время работает старшим менеджером по науке о данных и аналитике. Его команда отвечает за проектирование, внедрение и поддержку комплексных алгоритмов машинного обучения и решений на основе данных для Getir.

Нафи Ахмет Тургут получил степень магистра в области электротехники и электроники и работал научным сотрудником. Его целью было создание алгоритмов машинного обучения для моделирования аномалий нервной сети. Он присоединился к Getir в 2019 году и в настоящее время работает старшим менеджером по науке о данных и аналитике. Его команда отвечает за проектирование, внедрение и поддержку комплексных алгоритмов машинного обучения и решений на основе данных для Getir.

Хасан Бурак Йел получил степень бакалавра в области электротехники и электроники в Университете Богазичи. Он работал в Turkcell, в основном занимаясь прогнозированием временных рядов, визуализацией данных и автоматизацией сетей. Он присоединился к Getir в 2021 году и в настоящее время работает менеджером по науке о данных и аналитике, отвечая за домены поиска, рекомендаций и роста.

Хасан Бурак Йел получил степень бакалавра в области электротехники и электроники в Университете Богазичи. Он работал в Turkcell, в основном занимаясь прогнозированием временных рядов, визуализацией данных и автоматизацией сетей. Он присоединился к Getir в 2021 году и в настоящее время работает менеджером по науке о данных и аналитике, отвечая за домены поиска, рекомендаций и роста.

Дамла Шентюрк получила степень бакалавра компьютерной инженерии в Галатасарайском университете. Она продолжает получать степень магистра компьютерной инженерии в Университете Богазичи. Она присоединилась к Getir в 2022 году и работает специалистом по данным. Она работала над коммерческими проектами, проектами по цепочке поставок и открытиями.

Дамла Шентюрк получила степень бакалавра компьютерной инженерии в Галатасарайском университете. Она продолжает получать степень магистра компьютерной инженерии в Университете Богазичи. Она присоединилась к Getir в 2022 году и работает специалистом по данным. Она работала над коммерческими проектами, проектами по цепочке поставок и открытиями.

Эсра Каябалы — старший архитектор решений в AWS, специализирующийся в области аналитики, включая хранилища данных, озера данных, анализ больших данных, пакетную потоковую передачу данных и потоковую передачу в реальном времени, а также интеграцию данных. Имеет 12-летний опыт разработки программного обеспечения и архитектуры. Она увлечена изучением и преподаванием облачных технологий.

Эсра Каябалы — старший архитектор решений в AWS, специализирующийся в области аналитики, включая хранилища данных, озера данных, анализ больших данных, пакетную потоковую передачу данных и потоковую передачу в реальном времени, а также интеграцию данных. Имеет 12-летний опыт разработки программного обеспечения и архитектуры. Она увлечена изучением и преподаванием облачных технологий.

- SEO-контент и PR-распределение. Получите усиление сегодня.

- PlatoData.Network Вертикальный генеративный ИИ. Расширьте возможности себя. Доступ здесь.

- ПлатонАйСтрим. Интеллект Web3. Расширение знаний. Доступ здесь.

- ПлатонЭСГ. Углерод, чистые технологии, Энергия, Окружающая среда, Солнечная, Управление отходами. Доступ здесь.

- ПлатонЗдоровье. Биотехнологии и клинические исследования. Доступ здесь.

- Источник: https://aws.amazon.com/blogs/machine-learning/how-getir-reduced-model-training-durations-by-90-with-amazon-sagemaker-and-aws-batch/

- :имеет

- :является

- :нет

- 100

- 12

- 2015

- 2019

- 2021

- 2022

- 7

- a

- способность

- в состоянии

- О нас

- доступ

- доступа

- точность

- точный

- достигнутый

- достижение

- достижение

- через

- Действие

- Дополнительно

- адрес

- адресованный

- плюс

- После

- против

- алгоритмы

- Выравнивает

- Все

- разрешено

- позволяет

- вдоль

- причислены

- Amazon

- Создатель мудреца Амазонки

- Amazon Web Services

- an

- аналитика

- анализ

- и

- и инфраструктура

- аномалии

- любой

- архитектура

- МЫ

- AS

- внешний вид

- ассортимент

- At

- автоматический

- автоматически

- автоматизация

- Проспект

- AWS

- Баланс

- Балансировка

- барьеры

- Использование темпера с изогнутым основанием

- основанный

- BE

- становиться

- было

- эталонный тест

- пользу

- ЛУЧШЕЕ

- Beyond

- большой

- Big Data

- Повышенный

- изоферменты печени

- марка

- строить

- Строительство

- построенный

- бизнес

- но

- by

- CAN

- возможности

- возможности

- капитализированный

- категории

- Категории

- обслуживать

- центральный

- цепь

- вызов

- проблемы

- выбор

- облако

- комбинаты

- коммерческая

- Компания

- неотразимый

- конкурентоспособный

- конкурентов

- Заполненная

- комплекс

- комплексный

- Вычисление

- компьютер

- Компьютерная инженерия

- вычисление

- конгломерат

- продолжать

- продолжается

- (CIJ)

- страна

- создание

- критической

- решающее значение

- В настоящее время

- клиент

- Клиенты

- данным

- Анализ данных

- наука о данных

- ученый данных

- визуализация данных

- управляемых данными

- Принятие решений

- определенный

- Степень

- поставка

- развертывание

- развернуть

- развертывание

- развертывание

- проектирование

- подробный

- застройщиков

- Развитие

- различный

- Трудность

- непосредственно

- распределение

- Разное

- многоотраслевой

- домен

- доменов

- два

- продолжительность

- каждый

- легко

- Эффективный

- фактически

- эффективность

- Эффективность

- затрат

- эффективный

- эффективно

- легко

- усилия

- Electronics

- расширение прав и возможностей

- включен

- охватывая

- впритык

- Проект и

- расширение

- повышение

- обеспечивается

- обеспечивает

- обеспечение

- Окружающая среда

- одинаково

- установленный

- развивается

- отлично

- существующий

- опыт

- Впечатления

- Объяснять

- исследование

- Больше

- продолжается

- Face

- облегчающий

- быстрый темп

- Особенность

- поле

- окончательный

- Во-первых,

- Фокус

- внимание

- после

- Что касается

- Форс-мажор

- Прогноз

- 4

- от

- полностью

- далее

- будущее

- сбор

- генерирует

- Germany

- получить

- GPU / ГРАФИЧЕСКИЙ ПРОЦЕССОР

- Графические процессоры

- выпускник

- Рост

- GUEST

- Guest Post

- обрабатывать

- Есть

- he

- помощь

- помогает

- ее

- High

- его

- состоялся

- Как

- How To

- HTML

- HTTP

- HTTPS

- if

- реализация

- Осуществляющий

- важную

- важный аспект

- in

- включает в себя

- В том числе

- информация

- Инфраструктура

- начальный

- инновационный

- размышления

- устанавливать

- пример

- интеграции.

- взаимодействие

- в

- неоценимый

- инвентаризация

- Управление запасами

- IT

- ЕГО

- саму трезвость

- Джобс

- присоединился

- JPG

- Острый

- Основные

- известный

- озера

- язык

- Языки

- Задержка

- изучение

- привело

- уровень

- уровни

- такое как

- искать

- Низкий

- бюджетный

- машина

- обучение с помощью машины

- в основном

- Сохранение

- сделать

- управлять

- управляемого

- управление

- менеджер

- способ

- многих

- рынок

- магистра

- метод

- Методология

- Минут

- ML

- модель

- Модели

- Месяц

- БОЛЕЕ

- многонациональный

- с разными

- родной

- натуральный

- Откройте

- Необходимость

- потребности

- Нидерланды

- сеть

- следующий

- 9

- нет

- объект

- Очевидный

- of

- предлагающий

- on

- ONE

- только

- оперативный

- Операционный отдел

- оптимальный

- оптимизированный

- оптимизирует

- Опция

- or

- заказ

- организация

- наши

- преодоление

- собственный

- особенно

- страстный

- Люди

- ИДЕАЛЬНОЕ

- производительность

- фаза

- трубопровод

- Платон

- Платон Интеллектуальные данные

- ПлатонДанные

- играл

- играет

- «портфель»

- расположены

- возможности,

- После

- потенциал

- потенциально

- мощностью

- мощный

- Точность

- прогнозирования

- прогноз

- Predictions

- Predictive Analytics

- присутствие

- Проблема

- проблемам

- процесс

- Процессы

- Продукт

- Производство

- Проект

- проектов

- доказанный

- обеспечивать

- при условии

- обеспечение

- преследование

- количество

- быстро

- диапазоны

- достигать

- реального времени

- данные в реальном времени

- получила

- Рекомендация

- уменьшить

- Цена снижена

- снижение

- совершенствовать

- рафинированный

- представляет

- обязательный

- исследованиям

- Полезные ресурсы

- ответственность

- ответственный

- Итоги

- революция

- Роли

- Run

- Бег

- sagemaker

- Масштабируемость

- масштабируемые

- Шкала

- масштабирование

- считаться

- Наука

- Ученый

- Ученые

- бесшовные

- Поиск

- разделах

- безопасность

- посмотреть

- Искать

- сегмент

- выбранный

- старший

- Серии

- служить

- обслуживание

- Услуги

- набор

- семь

- Shadow

- формирование

- она

- Шоу

- существенно

- просто

- единственное число

- So

- Software

- разработка программного обеспечения

- Решение

- Решения

- Решение

- некоторые

- сложный

- искать

- говорить

- специализированный

- конкретный

- и политические лидеры

- Области

- Шаг

- диск

- хранение

- Стратегический

- Стратегически

- Стратегия

- потоковый

- упорядочить

- обтекаемый

- упорядочение

- усиленный

- сильные

- успешный

- топ

- поставка

- цепочками поставок

- поддержка

- снасти

- портной

- задачи

- Обучение

- команда

- команды

- технологии

- Технологическая компания

- технологии

- Тестирование

- который

- Ассоциация

- Нидерланды

- Великобритании

- их

- Их

- тогда

- тем самым

- следовательно

- Эти

- этой

- Через

- время

- Временные ряды

- в

- сегодня

- Сегодняшних

- вместе

- инструменты

- новатор

- Train

- Обучение

- дерево

- Турция

- два

- Uk

- зонтик

- под

- Объединенный

- США

- Университет

- us

- использование

- используемый

- Информация о пользователе

- Пользовательский опыт

- через

- использовать

- все возможное

- различный

- вертикалей

- визуализация

- жизненный

- тома

- законопроект

- we

- Web

- веб-сервисы

- неделя

- были

- , которые

- в то время как

- в

- работавший

- работает

- работает

- лет

- Ты

- ВАШЕ

- зефирнет