Это гостевой пост старшего инженера по программному обеспечению и машинному обучению Kustomer Яна Ланци и команды AWS Умеша Каласпуркара, Прасада Шетти и Джонатана Грейфенбергера.

По словам самого Кустомера, «Kustomer — это многоканальная платформа SaaS CRM, которая переосмысливает обслуживание корпоративных клиентов и обеспечивает выдающийся опыт. Благодаря интеллектуальной автоматизации мы масштабируемся для удовлетворения потребностей любого контакт-центра и бизнеса, объединяя данные из нескольких источников и позволяя компаниям предоставлять простые, последовательные и персонализированные услуги и поддержку с помощью единого представления временной шкалы».

Клиенту нужна была возможность быстро анализировать большие объемы обращений в службу поддержки для своих бизнес-клиентов — клиентского опыта и сервисных организаций — и автоматизировать обнаружение такой информации, как намерения конечного клиента, проблемы с обслуживанием клиентов и другие важные сведения, связанные с потребителем. Понимание этих характеристик может помочь организациям CX управлять тысячами входящих электронных писем поддержки, автоматически классифицируя и классифицируя содержимое. Клиент использует рычаги Создатель мудреца Амазонки управлять анализом входящих сообщений службы поддержки с помощью их ИИ на основе IQ клиента Платформа. Служба классификации разговоров Kustomer IQ способна контекстуализировать разговоры и автоматизировать утомительные и повторяющиеся задачи, уменьшая отвлечение агента и общую стоимость контакта. Этот и другие IQ-сервисы Kustomer повысили производительность и автоматизацию для бизнес-клиентов.

В этом посте мы рассказываем о том, как Kustomer использует пользовательские образы Docker для обучения и выводов SageMaker, что упрощает интеграцию и оптимизирует процесс. При таком подходе бизнес-клиенты Kustomer автоматически классифицируют более 50 70 электронных писем поддержки каждый месяц с точностью до XNUMX %.

Предыстория и проблемы

Клиент использует собственный конвейер классификации текста для своей службы классификации разговоров. Это помогает им управлять тысячами запросов в день с помощью автоматической классификации и категоризации с использованием инструментов SageMaker для обучения и логических выводов. Учебный модуль Conversation Classification использует пользовательские образы Docker для обработки данных и обучения моделей с использованием исторических разговоров, а затем прогнозирует темы, категории или другие настраиваемые метки, необходимые конкретному агенту для классификации разговоров. Затем механизм прогнозирования использует обученные модели с другим настраиваемым образом докера для классификации разговоров, которые организации используют для автоматизации отчетов или направления разговоров определенной команде в зависимости от ее темы.

Процесс категоризации SageMaker начинается с создания конвейера обучения и вывода, который может обеспечить классификацию текста и контекстные рекомендации. Типичная установка будет реализована с бессерверными подходами, такими как AWS Lambda для предварительной обработки данных и постобработки, потому что он требует минимальных требований к подготовке с эффективной моделью ценообразования по требованию. Однако использование SageMaker с такими зависимостями, как TensorFlow, NumPy и Pandas, может быстро увеличить размер пакета модели, что сделает весь процесс развертывания громоздким и сложным в управлении. Для преодоления этих проблем заказчик использовал собственные образы Docker.

Пользовательские образы Docker дают существенные преимущества:

- Позволяет использовать сжатые пакеты большего размера (более 10 ГБ), которые могут содержать популярные платформы машинного обучения (ML), такие как TensorFlow, MXNet, PyTorch и другие.

- Позволяет использовать пользовательский код или алгоритмы, разработанные локально, в Студия Amazon SageMaker ноутбуки для быстрой итерации и обучения моделей.

- Предотвращает задержки предварительной обработки, возникающие в Lambda при распаковке пакетов развертывания.

- Предлагает гибкость для бесшовной интеграции с внутренними системами.

- Будущая совместимость и масштабируемость упрощают преобразование службы с помощью Docker, а не упаковывают файлы .zip в функцию Lambda.

- Сокращает время выполнения конвейера развертывания CI/CD.

- Обеспечивает знакомство с Docker внутри команды и простоту использования.

- Предоставляет доступ к хранилищам данных через API и серверную среду выполнения.

- Предлагает улучшенную поддержку для вмешательства в любую предварительную или постобработку, для которой Lambda потребовала бы отдельного вычислительного сервиса для каждого процесса (например, для обучения или развертывания).

Обзор решения

Категоризация и маркировка электронных писем службы поддержки является важным шагом в процессе поддержки клиентов. Это позволяет компаниям направлять разговоры в нужные команды и понимать на высоком уровне, о чем их клиенты связываются с ними. Бизнес-клиенты Kustomer ежедневно обрабатывают тысячи разговоров, поэтому масштабная классификация является сложной задачей. Автоматизация этого процесса помогает агентам быть более эффективными и предоставлять более сплоченную поддержку, а также помогает их клиентам, быстрее связывая их с нужными людьми.

Следующая диаграмма иллюстрирует архитектуру решения:

Процесс классификации разговоров начинается с того, что бизнес-клиент дает клиенту разрешение на настройку конвейера обучения и выводов, который может помочь им с классификацией текста и контекстными рекомендациями. Kustomer предоставляет своим клиентам пользовательский интерфейс для мониторинга процесса обучения и вывода, который реализуется с помощью SageMaker вместе с моделями TensorFlow и пользовательскими образами Docker. Процесс создания и использования классификатора разделен на пять основных рабочих процессов, которые координируются рабочей службой, работающей на Амазон ЭКС. Чтобы координировать события конвейера и инициировать обучение и развертывание модели, рабочий использует Амазонка SQS очереди и напрямую интегрируется с SageMaker с помощью предоставленного AWS SDK для Node.js. Рабочие процессы:

- Экспорт данных

- Предварительная обработка данных

- Обучение

- развертывание

- вывод

Экспорт данных

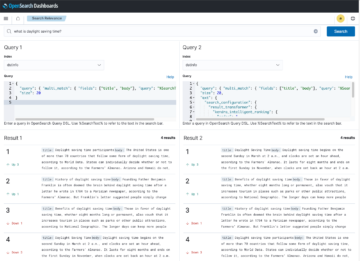

Процесс экспорта данных запускается по требованию и начинается с утверждения бизнес-клиентом Kustomer использования данных электронной почты для анализа. Данные, относящиеся к процессу классификации, передаются по первоначальному электронному письму, полученному от конечного клиента. Например, электронное письмо службы поддержки обычно содержит полное последовательное изложение проблемы с подробностями о проблеме. В рамках процесса экспорта электронные письма сопоставляются с хранилищем данных (MongoDB и Amazon OpenSearch) и сохраняется в Простой сервис хранения Amazon (Amazon S3).

Предварительная обработка данных

На этапе предварительной обработки данных набор данных очищается для рабочих процессов обучения и логического вывода, удаляя все HTML-теги из электронных писем клиентов и пропуская их через несколько этапов очистки и дезинфекции для обнаружения искаженного HTML. Этот процесс включает в себя использование Токенизаторы и трансформеры Hugging Face. Когда процесс очистки завершен, все дополнительные пользовательские токены, необходимые для обучения, добавляются в выходной набор данных.

На этапе предварительной обработки функция Lambda вызывает пользовательский образ Docker. Этот образ состоит из тонкой базы Python 3.8, Клиент интерфейса среды выполнения AWS Lambda Pythonи такие зависимости, как NumPy и Панды. Пользовательский образ Docker хранится на Реестр Amazon Elastic Container (Amazon ECR), а затем подается через конвейер CI/CD для развертывания. Развернутая функция Lambda производит выборку данных для создания трех отдельных наборов данных для каждого классификатора:

- Обучение – Используется для реального тренировочного процесса

- Проверка – Используется для проверки в процессе обучения TensorFlow.

- Пусконаладка – Используется ближе к концу процесса обучения для сравнения моделей метрик

Сгенерированные выходные наборы данных представляют собой файлы рассола Pandas, которые хранятся в Amazon S3 для использования на этапе обучения.

Обучение

Пользовательский обучающий образ Kustomer использует докер, оптимизированный для графического процессора TensorFlow 2.7. изображение в качестве базы. Пользовательский код, зависимости и базовые модели включаются перед загрузкой пользовательского обучающего образа Docker в ECR. Типы инстансов P3 используются для процесса обучения, а использование базового образа, оптимизированного для графического процессора, помогает сделать процесс обучения максимально эффективным. Amazon SageMaker используется с этим пользовательским образом докера для обучения моделей TensorFlow, которые затем сохраняются в S3. Пользовательские метрики также вычисляются и сохраняются, чтобы помочь с дополнительными возможностями, такими как сравнение моделей и автоматическое переобучение. После завершения этапа обучения работник ИИ получает уведомление, и бизнес-клиент может начать рабочий процесс развертывания.

развертывание

Для рабочего процесса развертывания создается настраиваемый образ вывода Docker с использованием базового образа TensorFlow (созданного специально для быстрого вывода). Дополнительный код и зависимости, такие как numPy, Pandas, пользовательский NL и т. д., включены для обеспечения дополнительных функций, таких как форматирование и очистка входных данных перед выводом. FastAPI также входит в состав пользовательского образа и используется для предоставления конечных точек REST API для логического вывода и проверки работоспособности. Затем SageMaker настраивается для развертывания моделей TensorFlow, сохраненных в S3, с образом логического вывода на оптимизированных для вычислений инстансах AWS ml.c5 для создания высокопроизводительных конечных точек логического вывода. Каждая конечная точка создается для использования одним клиентом для изоляции своих моделей и данных.

вывод

После завершения рабочего процесса развертывания вступает в действие рабочий процесс логического вывода. Все первые входящие электронные письма поддержки проходят через API вывода для развернутых классификаторов, специфичных для этого клиента. Развернутые классификаторы затем выполняют классификацию текста в каждом из этих электронных писем, каждый из которых создает классификационные метки для клиента.

Возможные улучшения и настройки

Заказчик рассматривает возможность расширения решения следующими улучшениями:

- Дополнения «Обнимающее лицо» – В настоящее время Kustomer использует базовые образы Docker TensorFlow для этапа предварительной обработки данных и планирует перейти на Контейнеры глубокого обучения (DLC) Hugging Face. Это поможет вам сразу приступить к обучению моделей, минуя сложный процесс построения и оптимизации среды обучения с нуля. Для получения дополнительной информации см. Обнимающее лицо на Amazon SageMaker.

- Обратная связь – Вы можете реализовать цикл обратной связи, используя методы активного обучения или обучения с подкреплением, чтобы повысить общую эффективность модели.

- Интеграция с другими внутренними системами – Kustomer хочет иметь возможность интегрировать текстовую классификацию с другими системами, такими как Smart Suggestions, которая является еще одной службой Kustomer IQ, которая просматривает сотни ярлыков и предлагает ярлыки, наиболее релевантные запросу клиента, улучшая время отклика агента и производительность.

Заключение

В этом посте мы обсудили, как Kustomer использует пользовательские образы Docker для обучения и вывода SageMaker, что упрощает интеграцию и оптимизирует процесс. Мы продемонстрировали, как Kustomer использует Lambda и SageMaker с пользовательскими образами Docker, которые помогают реализовать процесс классификации текста с рабочими процессами предварительной и постобработки. Это обеспечивает гибкость использования изображений большего размера для создания моделей, обучения и логических выводов. Поддержка образа контейнера для Lambda позволяет вам еще больше настраивать свою функцию, открывая множество новых вариантов использования для бессерверного машинного обучения. Решение использует преимущества нескольких сервисов AWS, включая SageMaker, Lambda, образы Docker, Amazon ECR, Amazon ECS, Amazon SQS и Amazon S3.

Если вы хотите узнать больше о Kustomer, мы рекомендуем вам посетить Сайт клиента и изучить их тематические исследования.

Нажмите здесь чтобы начать свое путешествие с Amazon SageMaker. Для получения практического опыта вы можете обратиться к Amazon SageMaker. мастерская.

Об авторах

Умеш Каласпуркар является архитектором решений для AWS из Нью-Йорка. Он обладает более чем 20-летним опытом разработки и реализации проектов цифровых инноваций и трансформации для предприятий и стартапов. Он мотивирован тем, что помогает клиентам выявлять и преодолевать проблемы. Вне работы Умешу нравится быть отцом, кататься на лыжах и путешествовать.

Умеш Каласпуркар является архитектором решений для AWS из Нью-Йорка. Он обладает более чем 20-летним опытом разработки и реализации проектов цифровых инноваций и трансформации для предприятий и стартапов. Он мотивирован тем, что помогает клиентам выявлять и преодолевать проблемы. Вне работы Умешу нравится быть отцом, кататься на лыжах и путешествовать.

Ян Ланци является старшим инженером по программному обеспечению и машинному обучению в компании Kustomer и специализируется на выполнении исследовательских задач по машинному обучению и превращении их в производственные услуги.

Ян Ланци является старшим инженером по программному обеспечению и машинному обучению в компании Kustomer и специализируется на выполнении исследовательских задач по машинному обучению и превращении их в производственные услуги.

Прасад Шетти является архитектором решений для AWS из Бостона. Он создавал программные продукты и более 20 лет руководил модернизацией и цифровыми инновациями в продуктах и услугах на предприятиях. Он увлечен продвижением облачной стратегии и внедрением, а также использованием технологий для создания отличного клиентского опыта. В свободное время Прасад любит кататься на велосипеде и путешествовать.

Прасад Шетти является архитектором решений для AWS из Бостона. Он создавал программные продукты и более 20 лет руководил модернизацией и цифровыми инновациями в продуктах и услугах на предприятиях. Он увлечен продвижением облачной стратегии и внедрением, а также использованием технологий для создания отличного клиентского опыта. В свободное время Прасад любит кататься на велосипеде и путешествовать.

Джонатан Грейфенбергер — старший менеджер по работе с клиентами AWS из Нью-Йорка с 25-летним опытом работы в ИТ-индустрии. Джонатан возглавляет команду, которая помогает клиентам из различных отраслей и вертикалей в процессе внедрения и модернизации облачных технологий.

Джонатан Грейфенбергер — старший менеджер по работе с клиентами AWS из Нью-Йорка с 25-летним опытом работы в ИТ-индустрии. Джонатан возглавляет команду, которая помогает клиентам из различных отраслей и вертикалей в процессе внедрения и модернизации облачных технологий.

- Коинсмарт. Лучшая в Европе биржа биткойнов и криптовалют.

- Платоблокчейн. Интеллект метавселенной Web3. Расширение знаний. БЕСПЛАТНЫЙ ДОСТУП.

- КриптоХок. Альткоин Радар. Бесплатная пробная версия.

- Источник: https://aws.amazon.com/blogs/machine-learning/how-kustomer-utilizes-custom-docker-images-amazon-sagemaker-to-build-a-text-classification-pipeline/

- "

- &

- 100

- 20 лет

- 7

- О нас

- доступ

- Учетная запись

- через

- активный

- дополнительный

- Принятие

- плюс

- Преимущества

- агенты

- AI

- алгоритмы

- Все

- Amazon

- анализ

- Другой

- API

- API

- подхода

- архитектура

- автоматизация

- AWS

- не являетесь

- строить

- Строительство

- бизнес

- возможности

- случаев

- вызванный

- вызов

- проблемы

- Проверки

- классификация

- Уборка

- облако

- код

- Связь

- Компании

- Вычисление

- потребитель

- Container

- Контейнеры

- содержит

- содержание

- Разговор

- Беседы

- опыт работы с клиентами

- Служба поддержки игроков

- служба поддержки

- Клиенты

- данным

- день

- задержки

- поставка

- Спрос

- развертывание

- Проект

- развитый

- Интернет

- открытие

- Docker

- вождение

- Эффективный

- затрат

- позволяет

- поощрять

- Конечная точка

- инженер

- Предприятие

- События

- пример

- расширяющийся

- опыт

- Впечатления

- Лицо

- БЫСТРО

- ФРС

- Обратная связь

- First

- Трансформируемость

- после

- функция

- функциональность

- порождать

- Отдаете

- GPU / ГРАФИЧЕСКИЙ ПРОЦЕССОР

- большой

- GUEST

- Guest Post

- имеющий

- Медицина

- помощь

- помогает

- High

- Как

- HTTPS

- Сотни

- определения

- изображение

- осуществлять

- в XNUMX году

- включены

- В том числе

- Увеличение

- расширились

- промышленности

- промышленность

- информация

- Инновации

- размышления

- интегрировать

- интеграции.

- Умный

- намерение

- Интерфейс

- вопрос

- IT

- маркировка

- Этикетки

- большой

- больше

- УЧИТЬСЯ

- изучение

- привело

- уровень

- рычаги

- в местном масштабе

- машина

- обучение с помощью машины

- Создание

- менеджер

- Метрика

- ML

- модель

- Модели

- MongoDB

- самых

- New York

- оркестровка

- заказ

- организации

- Другие контрактные услуги

- в противном случае

- Люди

- производительность

- Платформа

- Популярное

- возможное

- прогноз

- цены

- Проблема

- процесс

- Продукт

- Производство

- производительность

- Продукция

- проектов

- обеспечивать

- приводит

- быстро

- снижение

- требовать

- обязательный

- исследованиям

- ответ

- ОТДЫХ

- дорога

- Run

- Бег

- Масштабируемость

- Шкала

- SDK

- Serverless

- обслуживание

- Услуги

- выступающей

- набор

- просто

- Размер

- умный

- So

- Software

- Решения

- специализируется

- конкретно

- раскол

- Этап

- Начало

- Стартапы

- диск

- магазин

- магазины

- Стратегия

- демонтаж

- исследования

- существенный

- поддержка

- системы

- Говорить

- задачи

- команда

- снижения вреда

- Технологии

- тысячи

- Через

- время

- Лексемы

- Темы

- Обучение

- трансформация

- понимать

- Вид

- Что

- в

- слова

- Работа

- лет