Автоматизированные процессы, управляемые искусственным интеллектом (ИИ), от роботизированных сборочных линий до беспилотных автомобилей, существенно меняют общество. Но ИИ не может делать все сам по себе — на самом деле, многие организации начинают осознавать, что автоматизация часто работает лучше всего, когда она работает рука об руку с человеком-оператором. Точно так же люди часто могут работать более эффективно и результативно, когда им помогает хорошо обученный ИИ. Кибербезопасность — особенно безопасность личных данных — является прекрасным примером области, в которой дополнение человеческого взаимодействия с помощью ИИ дало чрезвычайно положительные результаты.

Автоматизация больше не является факультативной

Подумайте об объеме идентичностей, существующих в сегодняшней среде. Пользователи, устройства, приложения, серверы, облачные службы, базы данных, контейнеры DevOps и бесчисленное множество других объектов (как реальных, так и виртуальных) теперь имеют удостоверения, которыми необходимо управлять. Кроме того, современные сотрудники используют широкий спектр технологий и данных для продуктивной работы в корпоративной среде. Вместе эти два фактора создают проблему для безопасности удостоверений — в сегодняшних масштабах понимание того, какие удостоверения нуждаются в доступе к каким системам, выходит далеко за рамки человеческих возможностей.

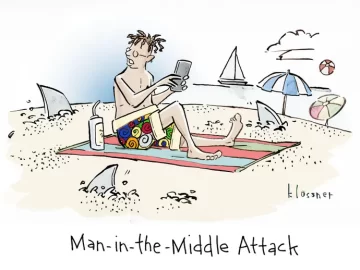

Это важно, потому что киберпреступники все чаще нацеливаются на удостоверения. Самый последний "Отчет о расследовании утечки данных Verizon(DBIR) указал, что учетные данные в настоящее время используются почти в 50% нарушений, а украденные учетные данные являются одним из наиболее распространенных способов, с помощью которых злоумышленники могут скомпрометировать удостоверения. Злоумышленники используют различные методы для получения этих учетных данных, но социальная инженерия, пожалуй, наиболее популярна. Люди совершают ошибки, и злоумышленники очень хорошо научились находить способы обманом заставить людей совершать их. Это основная причина, по которой сегодняшних злоумышленников так трудно остановить: люди часто являются слабым местом, а людей нельзя исправить. Разработка превентивного решения, останавливающего 100 % атак, просто невозможна.

Смещение фокуса на сдерживание

Это не означает, что превентивные меры, такие как обучение сотрудников, многофакторная аутентификация и частая смена паролей, не важны — они важны. Но их тоже недостаточно. В конце концов, решительный злоумышленник найдет уязвимое удостоверение для компрометации, и организации потребуется знать, к каким системам у нее был доступ и превышают ли эти привилегии ее фактические потребности. Если учетная запись бухгалтера скомпрометирована, это проблема, но эта проблема должна быть ограничена отделом бухгалтерии. Но в организации, где избыточное выделение ресурсов распространено, злоумышленник, скомпрометировавший одно удостоверение, может иметь доступ к любому количеству систем. Эта проблема встречается чаще, чем вы думаете: когда в организации есть десятки тысяч удостоверений для управления, сложно обеспечить, чтобы у каждого из них были привилегии, соответствующие его основным функциям.

По крайней мере, так было раньше. Применительно к безопасности личных данных технологии на основе ИИ позволили не только помочь предприятиям управлять разрешениями на использование личных данных в масштабе, но и со временем развивать решения по обеспечению безопасности личных данных, чтобы эти решения соответствовали изменяющимся потребностям и динамике бизнеса. ИИ можно научить выявлять закономерности, которые обычные люди никогда не заметят. Например, они могут искать разрешения, которые редко используются, и рекомендовать их отозвать — в конце концов, если они не используются, зачем рисковать, позволяя злоумышленнику использовать их? Эти инструменты можно научить определять, когда доступ к определенным данным часто запрашивается одним и тем же типом пользователя. Затем они могут пометить эту информацию члену ИТ-группы, который может решить, требуются ли дополнительные разрешения.

Выявляя эти шаблоны, инструменты идентификации на основе ИИ могут помочь установить более подходящие разрешения для удостоверений во всей организации, а также предоставить ИТ-персоналу информацию, необходимую им для принятия обоснованных решений по мере изменения обстоятельств. Устраняя посторонние, ненужные разрешения, инструменты искусственного интеллекта гарантируют, что компрометация одного удостоверения не предоставит злоумышленнику полную свободу действий во всей системе. Они также означают, что ИТ-команда не только не снижает производительность, но и может ее повысить. Быстро определяя, когда безопасно и уместно предоставлять дополнительные разрешения, они могут убедиться, что все управляемые удостоверения имеют доступ к необходимым технологиям и данным, когда они им нужны. Все это было бы невозможно без совместной работы людей и искусственного интеллекта.

Будущее за безопасностью личных данных на основе ИИ

Прошли те времена, когда управление удостоверениями и их разрешениями можно было выполнять вручную — сегодня гарантировать, что у каждого удостоверения есть правильный уровень доступа, можно только с помощью технологий, основанных на искусственном интеллекте. Дополняя человеческое взаимодействие с помощью ИИ, организации могут сочетать скорость и точность автоматизации с контекстуальной оценкой принимаемых человеком решений. Вместе они могут помочь организациям более эффективно управлять своими удостоверениями и правами, значительно ограничивая воздействие любой потенциальной атаки.

Об авторе

Грэди Саммерс занимает различные должности в сфере технологий и занимает более 20 лет руководящих должностей, а сейчас является исполнительным вице-президентом по продуктам в SailPoint. Грейди отвечает за разработку технологической карты и стратегии решений SailPoint, обеспечивая надежное и последовательное выполнение всего портфеля удостоверений SailPoint.

- блокчейн

- кошельки с криптовалютами

- cryptoexchange

- информационная безопасность

- киберпреступники

- Информационная безопасность

- Темное чтение

- Департамент внутренней безопасности

- цифровые кошельки

- брандмауэр

- Kaspersky

- вредоносных программ

- Mcafee

- НексБЛОК

- Платон

- Платон Ай

- Платон Интеллектуальные данные

- Платон игра

- ПлатонДанные

- платогейминг

- VPN

- безопасности веб-сайтов