Исследователи продолжают разрабатывать новые архитектуры моделей для общих задач машинного обучения (ML). Одной из таких задач является классификация изображений, когда изображения принимаются в качестве входных данных, и модель пытается классифицировать изображение в целом с выходными данными меток объектов. На сегодняшний день существует множество моделей, которые выполняют эту задачу классификации изображений, и специалист по машинному обучению может задавать такие вопросы, как: «Какую модель мне следует настроить, а затем развернуть, чтобы добиться наилучшей производительности в моем наборе данных?» И исследователь машинного обучения может задать такие вопросы, как: «Как я могу провести собственное честное сравнение нескольких архитектур моделей с указанным набором данных, контролируя гиперпараметры обучения и характеристики компьютера, такие как графические процессоры, процессоры и оперативная память?» В первом вопросе рассматривается выбор модели для разных архитектур моделей, а во втором — сравнение обученных моделей с тестовым набором данных.

В этом посте вы увидите, как Классификация изображений TensorFlow алгоритм Amazon SageMaker JumpStart может упростить реализации, необходимые для решения этих вопросов. Вместе с деталями реализации в соответствующем пример блокнота Jupyter, у вас будут инструменты для выбора модели путем изучения границ Парето, когда улучшение одного показателя производительности, например точности, невозможно без ухудшения другого показателя, например пропускной способности.

Обзор решения

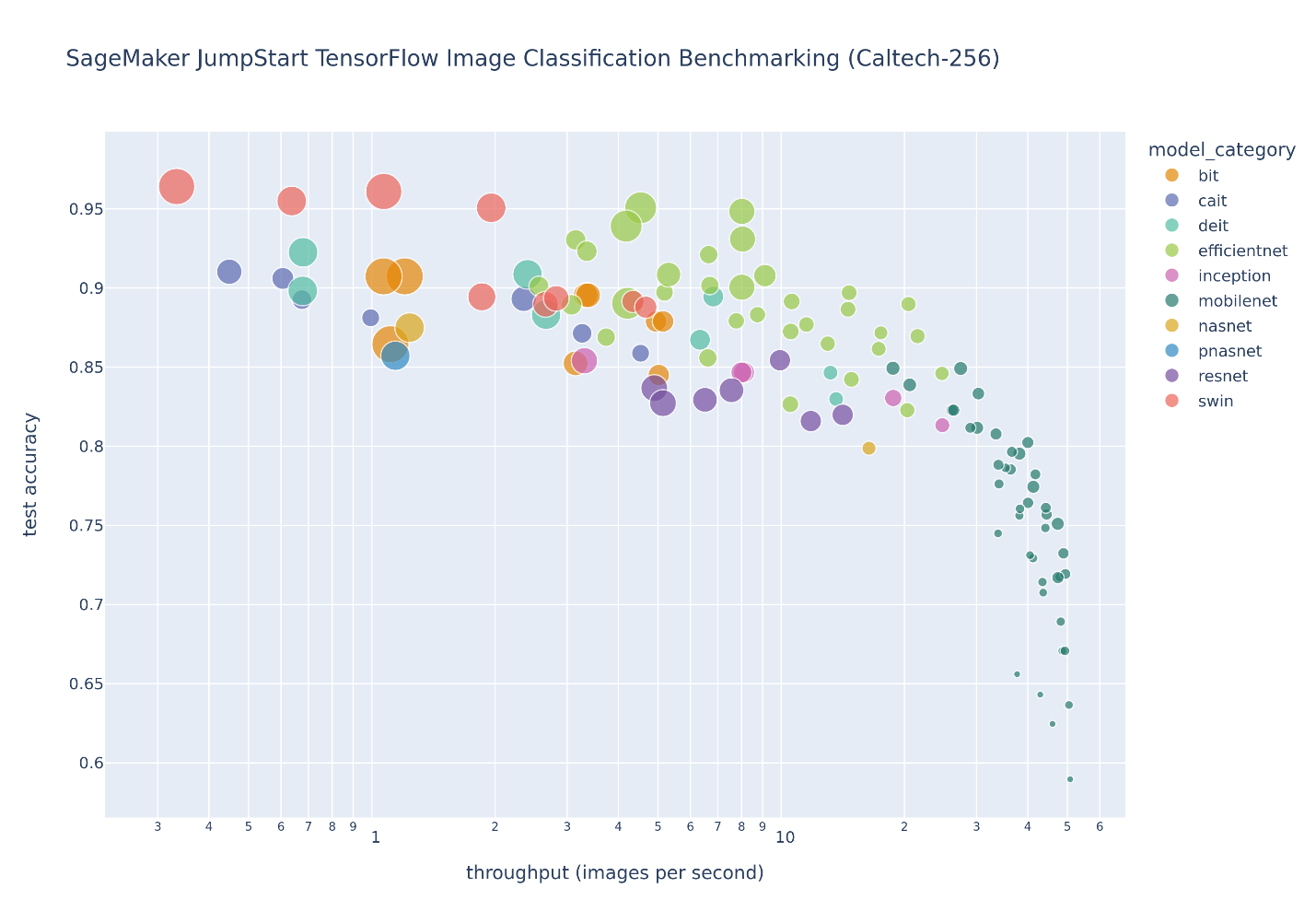

На следующем рисунке показан компромисс выбора модели для большого количества моделей классификации изображений, точно настроенных на Калтех-256 набор данных, который представляет собой сложный набор из 30,607 256 изображений реального мира, охватывающих XNUMX категорий объектов. Каждая точка представляет собой одну модель, размеры точек масштабируются в зависимости от количества параметров, составляющих модель, а точки имеют цветовую кодировку в зависимости от архитектуры модели. Например, светло-зеленые точки представляют архитектуру EfficientNet; каждая светло-зеленая точка — это отдельная конфигурация этой архитектуры с уникальными точно настроенными измерениями производительности модели. На рисунке показано существование границы Парето для выбора модели, где более высокая точность обменивается на более низкую производительность. В конечном счете, выбор модели на границе Парето или набора эффективных по Парето решений зависит от требований к производительности развертывания вашей модели.

Если вы наблюдаете точность теста и границы пропускной способности теста, представляющие интерес, набор эффективных по Парето решений на предыдущем рисунке извлекается в следующей таблице. Строки сортируются таким образом, чтобы пропускная способность теста увеличивалась, а точность теста уменьшалась.

| Название модели | Количество параметров | Точность теста | Тест Топ 5 Точность | Пропускная способность (изображений/с) | Продолжительность за эпоху (ы) |

| swin-большой патч4-window12-384 | 195.6M | 96.4% | 99.5% | 0.3 | 2278.6 |

| swin-большой патч4-window7-224 | 195.4M | 96.1% | 99.5% | 1.1 | 698.0 |

| эффективная сеть-v2-imagenet21k-ft1k-l | 118.1M | 95.1% | 99.2% | 4.5 | 1434.7 |

| эффективная сеть-v2-imagenet21k-ft1k-м | 53.5M | 94.8% | 99.1% | 8.0 | 769.1 |

| эффективная сеть-v2-imagenet21k-м | 53.5M | 93.1% | 98.5% | 8.0 | 765.1 |

| эффективныйнет-b5 | 29.0M | 90.8% | 98.1% | 9.1 | 668.6 |

| эффективная сеть-v2-imagenet21k-ft1k-b1 | 7.3M | 89.7% | 97.3% | 14.6 | 54.3 |

| эффективная сеть-v2-imagenet21k-ft1k-b0 | 6.2M | 89.0% | 97.0% | 20.5 | 38.3 |

| эффективная сеть-v2-imagenet21k-b0 | 6.2M | 87.0% | 95.6% | 21.5 | 38.2 |

| мобильная сеть-v3-большой-100-224 | 4.6M | 84.9% | 95.4% | 27.4 | 28.8 |

| мобильная сеть-v3-большой-075-224 | 3.1M | 83.3% | 95.2% | 30.3 | 26.6 |

| мобильная сеть-v2-100-192 | 2.6M | 80.8% | 93.5% | 33.5 | 23.9 |

| мобильная сеть-v2-100-160 | 2.6M | 80.2% | 93.2% | 40.0 | 19.6 |

| мобильная сеть-v2-075-160 | 1.7M | 78.2% | 92.8% | 41.8 | 19.3 |

| мобильная сеть-v2-075-128 | 1.7M | 76.1% | 91.1% | 44.3 | 18.3 |

| мобильная сеть-v1-075-160 | 2.0M | 75.7% | 91.0% | 44.5 | 18.2 |

| мобильная сеть-v1-100-128 | 3.5M | 75.1% | 90.7% | 47.4 | 17.4 |

| мобильная сеть-v1-075-128 | 2.0M | 73.2% | 90.0% | 48.9 | 16.8 |

| мобильная сеть-v2-075-96 | 1.7M | 71.9% | 88.5% | 49.4 | 16.6 |

| мобильная сеть-v2-035-96 | 0.7M | 63.7% | 83.1% | 50.4 | 16.3 |

| мобильная сеть-v1-025-128 | 0.3M | 59.0% | 80.7% | 50.8 | 16.2 |

Этот пост содержит подробную информацию о том, как реализовать крупномасштабные Создатель мудреца Амазонки задачи бенчмаркинга и выбора модели. Во-первых, мы представляем JumpStart и встроенные алгоритмы классификации изображений TensorFlow. Затем мы обсудим вопросы реализации высокого уровня, такие как конфигурации гиперпараметров JumpStart, извлечение метрик из Журналы Amazon CloudWatchи запуск асинхронных заданий по настройке гиперпараметров. Наконец, мы рассмотрим среду реализации и параметризацию, ведущие к решениям, эффективным по Парето, в предыдущей таблице и на рисунке.

Введение в классификацию изображений JumpStart TensorFlow

JumpStart обеспечивает тонкую настройку одним щелчком мыши и развертывание широкого спектра предварительно обученных моделей для популярных задач машинного обучения, а также набор комплексных решений, решающих типичные бизнес-задачи. Эти функции устраняют тяжелую работу на каждом этапе процесса машинного обучения, упрощая разработку высококачественных моделей и сокращая время развертывания. API-интерфейсы JumpStart позволяют программно развертывать и настраивать широкий выбор предварительно обученных моделей в ваших собственных наборах данных.

Концентратор моделей JumpStart предоставляет доступ к большому количеству Модели классификации изображений TensorFlow которые позволяют передавать обучение и точную настройку пользовательских наборов данных. На момент написания этой статьи концентратор моделей JumpStart содержит 135 моделей классификации изображений TensorFlow для различных популярных архитектур моделей от Концентратор TensorFlow, чтобы включить остаточные сети (RESNET), Мобильная сеть, Эффективная сеть, Начало, Поисковые сети с нейронной архитектурой (НАСНет), Большая передача (Немного), сдвинутое окно (Swin) трансформаторы, Class-Attention in Image Transformers (КаиТ) и Data-Efficient Image Transformers (ДИТ).

Сильно различающиеся внутренние структуры составляют архитектуру каждой модели. Например, модели ResNet используют пропущенные соединения, чтобы обеспечить существенно более глубокие сети, тогда как модели на основе трансформатора используют механизмы самоконтроля, которые устраняют внутреннюю локальность операций свертки в пользу более глобальных рецептивных полей. В дополнение к разнообразным наборам функций, предоставляемым этими различными структурами, каждая архитектура модели имеет несколько конфигураций, которые регулируют размер, форму и сложность модели в рамках этой архитектуры. Это приводит к сотням уникальных моделей классификации изображений, доступных в концентраторе моделей JumpStart. В сочетании со встроенными сценариями переноса обучения и логических выводов, которые охватывают многие функции SageMaker, JumpStart API является отличной отправной точкой для специалистов по машинному обучению, позволяющих быстро приступить к обучению и развертыванию моделей.

Обратитесь к Перенос обучения для моделей классификации изображений TensorFlow в Amazon SageMaker и следующее пример тетради чтобы более подробно узнать о классификации изображений SageMaker TensorFlow, в том числе о том, как выполнять логические выводы на предварительно обученной модели, а также о точной настройке предварительно обученной модели на пользовательском наборе данных.

Соображения по выбору крупномасштабной модели

Выбор модели — это процесс выбора наилучшей модели из набора моделей-кандидатов. Этот процесс может применяться к моделям одного типа с разными весовыми коэффициентами параметров и к моделям разных типов. Примеры выбора модели среди моделей одного типа включают подбор одной и той же модели с разными гиперпараметрами (например, скоростью обучения) и раннюю остановку, чтобы предотвратить переобучение весов модели в набор данных поезда. Выбор модели среди моделей разных типов включает в себя выбор наилучшей архитектуры модели (например, Swin или MobileNet) и выбор наилучшей конфигурации модели в рамках одной архитектуры модели (например, mobilenet-v1-025-128 против mobilenet-v3-large-100-224).

Соображения, изложенные в этом разделе, позволяют использовать все эти процессы выбора модели в наборе данных проверки.

Выберите конфигурации гиперпараметров

Классификация изображений TensorFlow в JumpStart имеет большое количество доступных гиперпараметры который может настроить поведение сценария трансферного обучения единообразно для всех архитектур моделей. Эти гиперпараметры связаны с увеличением и предварительной обработкой данных, спецификацией оптимизатора, элементами управления переоснащением и индикаторами обучаемого слоя. Вам рекомендуется настроить значения этих гиперпараметров по умолчанию, если это необходимо для вашего приложения:

Для этого анализа и связанной с ним записной книжки все гиперпараметры имеют значения по умолчанию, кроме скорости обучения, количества эпох и спецификации ранней остановки. Скорость обучения регулируется как категориальный параметр не провела обыск SageMaker автоматическая настройка модели работа. Поскольку каждая модель имеет уникальные значения гиперпараметров по умолчанию, дискретный список возможных скоростей обучения включает скорость обучения по умолчанию, а также одну пятую скорости обучения по умолчанию. Это запускает два задания обучения для одного задания настройки гиперпараметров, и выбирается задание обучения с наилучшей производительностью в наборе данных проверки. Поскольку количество эпох установлено равным 10, что больше, чем значение гиперпараметра по умолчанию, выбранное наилучшее задание обучения не всегда соответствует скорости обучения по умолчанию. Наконец, используется критерий ранней остановки с терпением или числом эпох для продолжения обучения без улучшения, равное трем эпохам.

Одним из наиболее важных параметров гиперпараметра по умолчанию является train_only_on_top_layer, где, если установлено True, слои извлечения признаков модели не настроены на предоставленный набор обучающих данных. Оптимизатор будет обучать параметры только в верхнем полносвязном слое классификации с выходной размерностью, равной количеству меток классов в наборе данных. По умолчанию для этого гиперпараметра установлено значение True, который представляет собой параметр, предназначенный для переноса обучения на небольшие наборы данных. У вас может быть пользовательский набор данных, в котором извлечения признаков из предварительного обучения в наборе данных ImageNet недостаточно. В этих случаях следует установить train_only_on_top_layer в False. Хотя этот параметр увеличит время обучения, вы извлечете больше значимых признаков для интересующей вас задачи, тем самым повысив точность.

Извлечение метрик из журналов CloudWatch

Алгоритм классификации изображений JumpStart TensorFlow надежно регистрирует различные показатели во время обучения, доступные для SageMaker. Estimator и объекты HyperparameterTuner. Конструктор SageMaker Estimator имеет metric_definitions Аргумент ключевого слова, который можно использовать для оценки задания обучения, предоставив список словарей с двумя ключами: Имя для имени метрики и Regex для регулярного выражения, используемого для извлечения метрики из журналов. Сопровождающий ноутбук показывает детали реализации. В следующей таблице перечислены доступные метрики и связанные с ними регулярные выражения для всех моделей классификации изображений JumpStart TensorFlow.

| Название показателя | Регулярные выражения |

| количество параметров | «- Количество параметров: ([0-9\.]+)» |

| количество обучаемых параметров | «- Количество обучаемых параметров: ([0-9\.]+)» |

| количество необучаемых параметров | «- Количество необучаемых параметров: ([0-9\.]+)» |

| метрика набора данных поезда | f”- {метрика}: ([0-9\.]+)” |

| метрика набора данных проверки | f”- val_{метрика}: ([0-9\.]+)” |

| метрика тестового набора данных | f”- Тест {метрика}: ([0-9\.]+)” |

| продолжительность поезда | «- Общая продолжительность обучения: ([0-9\.]+)» |

| продолжительность поезда за эпоху | «- Средняя продолжительность обучения в эпоху: ([0-9\.]+)» |

| задержка оценки теста | «- Задержка оценки теста: ([0-9\.]+)» |

| задержка теста на образец | «- Средняя задержка теста на выборку: ([0-9\.]+)» |

| тестовая пропускная способность | «- Средняя пропускная способность теста: ([0-9\.]+)» |

Встроенный сценарий трансферного обучения предоставляет различные метрики набора данных для обучения, проверки и тестирования в рамках этих определений, представленных значениями замены f-строки. Точные доступные показатели зависят от типа выполняемой классификации. Все скомпилированные модели имеют loss метрика, которая представлена кросс-энтропийной потерей либо для бинарной, либо для категориальной задачи классификации. Первый используется при наличии одной метки класса; последний используется, если есть две или более метки класса. Если имеется только одна метка класса, следующие показатели вычисляются, регистрируются и извлекаются с помощью регулярных выражений f-строки в предыдущей таблице: количество истинных положительных результатов (true_pos), количество ложных срабатываний (false_pos), количество истинных отрицаний (true_neg), количество ложноотрицательных результатов (false_neg), precision, recall, площадь под кривой рабочей характеристики приемника (ROC) (auc), и площадь под кривой точного отзыва (PR) (prc). Точно так же, если есть шесть или более меток классов, первая 5 метрика точности (top_5_accuracy) также вычисляется, регистрируется и извлекается с помощью предыдущих регулярных выражений.

Во время обучения метрики, указанные для SageMaker Estimator отправляются в журналы CloudWatch. Когда обучение завершено, вы можете вызвать SageMaker DescribeTrainingJob API и осмотреть FinalMetricDataList ключ в ответе JSON:

Этот API требует, чтобы в запросе было указано только имя задания, поэтому после завершения метрики могут быть получены в будущем анализе, если имя задания обучения надлежащим образом зарегистрировано и может быть восстановлено. Для этой задачи выбора модели имена заданий по настройке гиперпараметров сохраняются, а последующий анализ повторно прикрепляет HyperparameterTuner объект с именем задания настройки, извлеките лучшее имя задания обучения из присоединенного модуля настройки гиперпараметров, а затем вызовите DescribeTrainingJob API, как описано ранее, для получения показателей, связанных с лучшим заданием по обучению.

Запуск заданий асинхронной настройки гиперпараметров

Обратитесь к соответствующему ноутбук для получения сведений о реализации асинхронного запуска заданий по настройке гиперпараметров, в которых используется стандартная библиотека Python. параллельные фьючерсы модуль, высокоуровневый интерфейс для асинхронно работающих вызываемых объектов. В этом решении реализовано несколько соображений, связанных с SageMaker:

- Каждый аккаунт AWS связан с Квоты службы SageMaker. Вы должны просмотреть свои текущие ограничения, чтобы полностью использовать свои ресурсы и потенциально запросить увеличение лимита ресурсов по мере необходимости.

- Частые вызовы API для создания множества одновременных заданий по настройке гиперпараметров могут превышать скорость Python SDK и вызывать исключения регулирования. Решением этой проблемы является создание клиента SageMaker Boto3 с настраиваемой конфигурацией повторных попыток.

- Что произойдет, если ваш сценарий обнаружит ошибку или сценарий будет остановлен до завершения? Для такого большого выбора модели или сравнительного исследования вы можете регистрировать имена заданий настройки и предоставлять удобные функции для повторно подключить задания по настройке гиперпараметров которые уже существуют:

Детали анализа и обсуждение

Анализ в этом посте выполняет трансферное обучение для идентификаторы моделей в алгоритме классификации изображений JumpStart TensorFlow в наборе данных Caltech-256. Все задания по обучению выполнялись на учебном экземпляре SageMaker ml.g4dn.xlarge, который содержит один графический процессор NVIDIA T4.

Набор тестовых данных оценивается на обучающем экземпляре в конце обучения. Выбор модели выполняется перед оценкой тестового набора данных, чтобы установить веса модели для эпохи с наилучшей производительностью проверочного набора. Пропускная способность теста не оптимизирована: размер пакета набора данных установлен равным размеру пакета гиперпараметров обучения по умолчанию, который не регулируется для максимального использования памяти графического процессора; сообщаемая тестовая пропускная способность включает время загрузки данных, поскольку набор данных предварительно не кэшируется; и распределенный вывод между несколькими графическими процессорами не используется. По этим причинам эта пропускная способность является хорошим относительным показателем, но фактическая пропускная способность будет сильно зависеть от ваших конфигураций развертывания конечной точки вывода для обученной модели.

Хотя концентратор моделей JumpStart содержит множество типов архитектуры классификации изображений, на этой границе парето доминируют избранные модели Swin, EfficientNet и MobileNet. Модели Swin крупнее и относительно точнее, тогда как модели MobileNet меньше, относительно менее точны и подходят для ограниченных ресурсов мобильных устройств. Важно отметить, что эта граница зависит от множества факторов, в том числе от точного используемого набора данных и выбранных гиперпараметров точной настройки. Вы можете обнаружить, что ваш пользовательский набор данных дает другой набор решений, эффективных по Парето, и вам может потребоваться более длительное время обучения с другими гиперпараметрами, такими как увеличение объема данных или точная настройка, а не только верхний слой классификации модели.

Заключение

В этом посте мы показали, как запускать крупномасштабные задачи по выбору модели или тестированию с помощью концентратора моделей JumpStart. Это решение может помочь вам выбрать лучшую модель для ваших нужд. Мы рекомендуем вам попробовать и изучить это Решение на вашем собственном наборе данных.

Рекомендации

Более подробная информация доступна на следующих ресурсах:

Об авторах

Доктор Кайл Ульрих является ученым-прикладником с Встроенные алгоритмы Amazon SageMaker команда. Его исследовательские интересы включают масштабируемые алгоритмы машинного обучения, компьютерное зрение, временные ряды, байесовские непараметрические и гауссовские процессы. Его докторская степень получена в Университете Дьюка, и он опубликовал статьи в NeurIPS, Cell и Neuron.

Доктор Кайл Ульрих является ученым-прикладником с Встроенные алгоритмы Amazon SageMaker команда. Его исследовательские интересы включают масштабируемые алгоритмы машинного обучения, компьютерное зрение, временные ряды, байесовские непараметрические и гауссовские процессы. Его докторская степень получена в Университете Дьюка, и он опубликовал статьи в NeurIPS, Cell и Neuron.

Доктор Ашиш Хетан является старшим научным сотрудником с Встроенные алгоритмы Amazon SageMaker и помогает разрабатывать алгоритмы машинного обучения. Он получил докторскую степень в Университете Иллинойса в Урбане Шампейн. Он является активным исследователем в области машинного обучения и статистических выводов и опубликовал множество статей на конференциях NeurIPS, ICML, ICLR, JMLR, ACL и EMNLP.

Доктор Ашиш Хетан является старшим научным сотрудником с Встроенные алгоритмы Amazon SageMaker и помогает разрабатывать алгоритмы машинного обучения. Он получил докторскую степень в Университете Иллинойса в Урбане Шампейн. Он является активным исследователем в области машинного обучения и статистических выводов и опубликовал множество статей на конференциях NeurIPS, ICML, ICLR, JMLR, ACL и EMNLP.

- SEO-контент и PR-распределение. Получите усиление сегодня.

- Платоблокчейн. Интеллект метавселенной Web3. Расширение знаний. Доступ здесь.

- Источник: https://aws.amazon.com/blogs/machine-learning/image-classification-model-selection-using-amazon-sagemaker-jumpstart/

- 10

- 100

- 7

- 9

- a

- О нас

- доступ

- доступной

- Учетная запись

- точность

- точный

- Достигать

- через

- активный

- дополнение

- адрес

- адреса

- Отрегулированный

- Аффилированные

- против

- алгоритм

- алгоритмы

- Все

- уже

- Несмотря на то, что

- всегда

- Amazon

- Создатель мудреца Амазонки

- Amazon SageMaker JumpStart

- Анализ

- анализ

- и

- Другой

- API

- Применение

- прикладной

- надлежащим образом

- архитектура

- ПЛОЩАДЬ

- аргумент

- связанный

- прикреплять

- попытки

- Автоматический

- доступен

- в среднем

- AWS

- основанный

- байесовский

- , так как:

- до

- не являетесь

- бенчмаркинг

- ЛУЧШЕЕ

- большой

- встроенный

- бизнес

- Объявления

- кандидат

- случаев

- категории

- сложные

- характеристика

- Выберите

- класс

- классификация

- классифицировать

- клиент

- сочетании

- Общий

- сравнение

- полный

- Заполненная

- завершение

- сложность

- компьютер

- Компьютерное зрение

- Обеспокоенность

- конференции

- Конфигурация

- подключенный

- Коммутация

- соображения

- ограничения

- содержит

- продолжать

- управление

- контрольная

- удобство

- соответствующий

- чехол для варгана

- Создайте

- Текущий

- кривая

- изготовленный на заказ

- данным

- Наборы данных

- более глубокий

- По умолчанию

- зависит

- развертывание

- развертывание

- развертывание

- глубина

- описано

- описание

- подробнее

- развивать

- Устройства

- различный

- обсуждать

- распределенный

- Разное

- не

- Герцог

- Университет Дюка

- в течение

- каждый

- Ранее

- Рано

- легче

- эффективный

- или

- ликвидировать

- включить

- поощрять

- поощрять

- впритык

- Конечная точка

- Окружающая среда

- эпоха

- эпохи

- ошибка

- оценивать

- оценивается

- оценка

- пример

- Примеры

- Кроме

- Больше

- Исследование

- выражения

- извлечение

- факторы

- ярмарка

- в пользу

- Особенность

- Особенности

- Поля

- фигура

- в заключение

- Найдите

- Во-первых,

- примерка

- после

- Бывший

- от

- Граница

- Границы

- полностью

- Функции

- будущее

- Фьючерсная торговля

- порождать

- получить

- данный

- Глобальный

- хорошо

- GPU / ГРАФИЧЕСКИЙ ПРОЦЕССОР

- Графические процессоры

- большой

- большой

- Зелёная

- происходит

- сильно

- помощь

- помогает

- на высшем уровне

- высококачественный

- высший

- Как

- How To

- HTML

- HTTPS

- хаб

- Сотни

- Настройка гиперпараметра

- Иллинойс

- изображение

- Классификация изображений

- изображений

- осуществлять

- реализация

- в XNUMX году

- значение

- важную

- улучшение

- улучшение

- in

- включают

- включает в себя

- В том числе

- Увеличение

- Увеличивает

- повышение

- индикаторы

- информация

- вход

- пример

- интерес

- интересы

- Интерфейс

- в нашей внутренней среде,

- внутренний

- вводить

- IT

- работа

- Джобс

- JSON

- Основные

- ключи

- этикетка

- Этикетки

- большой

- крупномасштабный

- больше

- Задержка

- запускает

- запуск

- слой

- слоев

- ведущий

- УЧИТЬСЯ

- изучение

- Подтяжка лица

- легкий

- ОГРАНИЧЕНИЯ

- рамки

- Список

- Списки

- погрузка

- Длинное

- дольше

- от

- машина

- обучение с помощью машины

- Создание

- многих

- Максимизировать

- значимым

- размеры

- Память

- метрический

- Метрика

- ML

- Мобильный телефон

- мобильных устройств

- модель

- Модели

- Модули

- БОЛЕЕ

- с разными

- имя

- имена

- необходимо

- потребности

- сетей

- Новые

- ноутбук

- номер

- Nvidia

- объект

- объекты

- наблюдать

- получать

- полученный

- ONE

- операционный

- Операционный отдел

- оптимизированный

- изложенные

- собственный

- бумага

- параметр

- параметры

- особый

- Терпение

- Выполнять

- производительность

- выполняет

- Платон

- Платон Интеллектуальные данные

- ПлатонДанные

- Точка

- пунктов

- Популярное

- возможное

- После

- потенциально

- pr

- предотвращать

- Предварительный

- Проблема

- проблемам

- процесс

- Процессы

- обеспечивать

- при условии

- приводит

- обеспечение

- опубликованный

- Питон

- вопрос

- Вопросы

- быстро

- Оперативная память

- Обменный курс

- Стоимость

- реальный мир

- причины

- снижение

- регулярный

- относительно

- удаление

- Сообщается

- представлять

- представленный

- представляет

- запросить

- обязательный

- Требования

- требуется

- исследованиям

- исследователь

- Постановления

- ресурс

- Полезные ресурсы

- ответ

- Итоги

- Run

- Бег

- sagemaker

- то же

- масштабируемые

- Ученый

- скрипты

- SDK

- Поиск

- Раздел

- выбранный

- выбор

- выбор

- старший

- Серии

- обслуживание

- Сессия

- набор

- Наборы

- установка

- несколько

- Форма

- должен

- Шоу

- Аналогичным образом

- упростить

- одинарной

- ШЕСТЬ

- Размер

- Размеры

- небольшой

- меньше

- So

- Решение

- Решения

- РЕШАТЬ

- Спецификация

- спецификации

- указанный

- стандарт

- и политические лидеры

- статистический

- Шаг

- остановившийся

- остановка

- хранить

- Кабинет

- последующее

- такие

- достаточный

- подходящее

- ТАБЛИЦЫ

- целевое

- Сложность задачи

- задачи

- команда

- tensorflow

- тестXNUMX

- Ассоциация

- их

- тем самым

- три

- пропускная способность

- время

- Временные ряды

- раз

- в

- сегодня

- вместе

- инструменты

- топ

- топ 5

- Всего

- Train

- специалистов

- Обучение

- перевод

- трансформеры

- правда

- Типы

- В конечном счете

- под

- созданного

- Университет

- Применение

- использование

- использовать

- использовать

- Проверка

- Наши ценности

- разнообразие

- Огромная

- с помощью

- Вид

- видение

- который

- в то время как

- все

- широкий

- будете

- в

- без

- бы

- письмо

- Ты

- ВАШЕ

- зефирнет