AutoML позволяет вам быстро получить общую информацию из ваших данных прямо в начале жизненного цикла проекта машинного обучения (ML). Заблаговременное понимание того, какие методы предварительной обработки и типы алгоритмов обеспечивают наилучшие результаты, сокращает время на разработку, обучение и развертывание правильной модели. Он играет решающую роль в процессе разработки каждой модели и позволяет ученым, работающим с данными, сосредоточиться на наиболее перспективных методах машинного обучения. Кроме того, AutoML предоставляет базовую производительность модели, которая может служить ориентиром для группы специалистов по обработке данных.

Инструмент AutoML применяет к вашим данным комбинацию различных алгоритмов и различных методов предварительной обработки. Например, он может масштабировать данные, выполнять одномерный выбор признаков, проводить PCA на различных пороговых уровнях дисперсии и применять кластеризацию. Такие методы предварительной обработки могут применяться индивидуально или комбинироваться в конвейере. Впоследствии инструмент AutoML будет обучать различные типы моделей, такие как линейная регрессия, эластичная сеть или случайный лес, на разных версиях вашего предварительно обработанного набора данных и выполнять оптимизацию гиперпараметров (HPO). Amazon SageMaker Автопилот устраняет тяжелую работу по созданию моделей ML. После предоставления набора данных SageMaker Autopilot автоматически исследует различные решения, чтобы найти лучшую модель. Но что, если вы хотите развернуть собственную версию рабочего процесса AutoML?

В этом посте показано, как создать собственный рабочий процесс AutoML на Создатель мудреца Амазонки через Автоматическая настройка моделей Amazon SageMaker с примером кода, доступным в GitHub репо.

Обзор решения

В этом случае предположим, что вы являетесь частью группы специалистов по обработке и анализу данных, которая разрабатывает модели в специализированной области. Вы разработали набор пользовательских методов предварительной обработки и выбрали ряд алгоритмов, которые, как вы обычно ожидаете, будут хорошо работать с вашей проблемой машинного обучения. При работе над новыми вариантами использования машинного обучения вы хотели бы сначала выполнить запуск AutoML, используя ваши методы и алгоритмы предварительной обработки, чтобы сузить область потенциальных решений.

В этом примере вы не используете специализированный набор данных; вместо этого вы работаете с набором данных о жилье Калифорнии, который вы импортируете из Простой сервис хранения Amazon (Амазонка S3). Целью является демонстрация технической реализации решения с использованием SageMaker HPO, которое впоследствии можно будет применить к любому набору данных и домену.

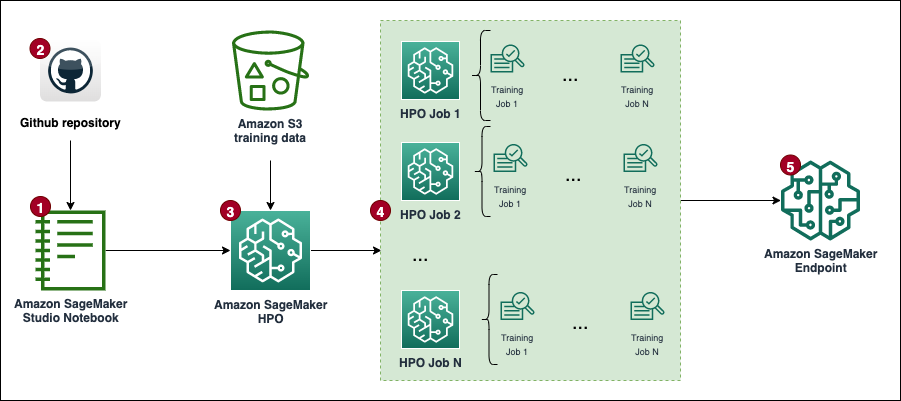

На следующей диаграмме представлен общий рабочий процесс решения.

Предпосылки

Ниже приведены предварительные условия для выполнения пошагового руководства, описанного в этом посте:

Реализуйте решение

Полный код доступен в Репо GitHub.

Шаги по реализации решения (как указано на диаграмме рабочего процесса) следующие:

- Создать экземпляр ноутбука и укажите следующее:

- Что касается Тип экземпляра ноутбука, выберите мл.т3.средняя.

- Что касается Эластичный вывод, выберите никто.

- Что касается Идентификатор платформы, выберите Amazon Linux 2, Jupyter Lab 3.

- Что касается Роль IAM, выберите значение по умолчанию

AmazonSageMaker-ExecutionRole. Если он не существует, создайте новый Управление идентификацией и доступом AWS (IAM) и прикрепите IAM-политика AmazonSageMakerFullAccess.

Обратите внимание, что вам следует создать роль и политику выполнения с минимальной областью действия в рабочей среде.

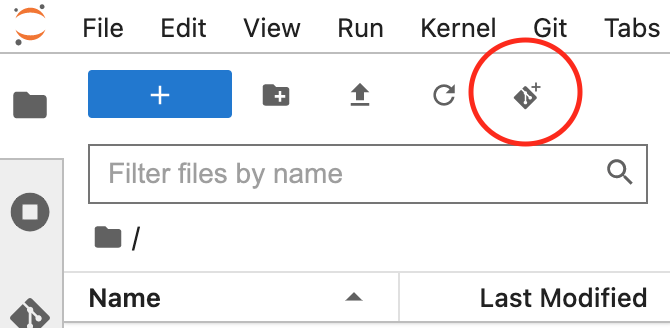

- Откройте интерфейс JupyterLab для экземпляра вашего блокнота и клонируйте репозиторий GitHub.

Вы можете сделать это, запустив новый сеанс терминала и запустив команду git clone <REPO> команду или с помощью функций пользовательского интерфейса, как показано на следующем снимке экрана.

- Откройте приложение

automl.ipynbфайл блокнота, выберите файлconda_python3ядро и следуйте инструкциям, чтобы запустить набор вакансий HPO.

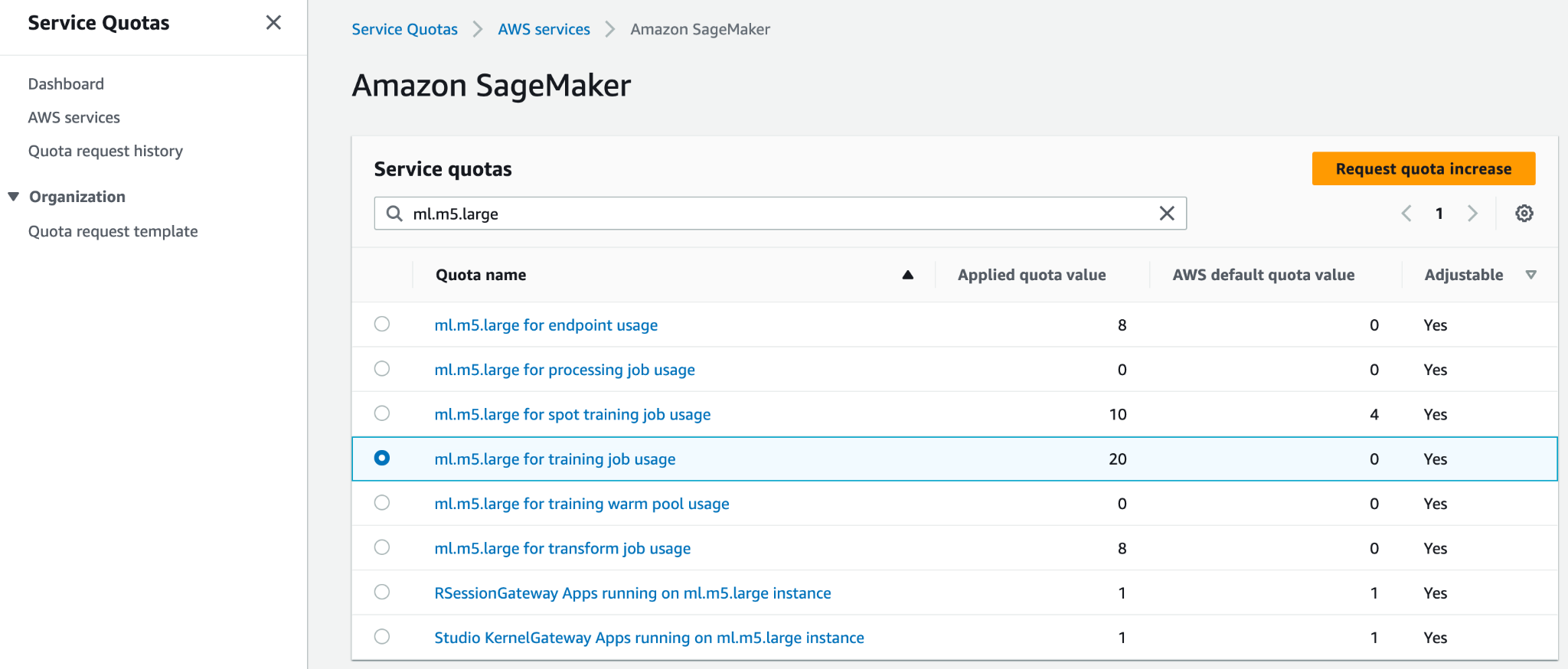

Чтобы запустить код без каких-либо изменений, необходимо увеличить квоту сервиса на ml.m5.large для использования в учебных заданиях и Количество экземпляров во всех учебных заданиях. AWS по умолчанию разрешает только 20 параллельных заданий обучения SageMaker для обеих квот. Вам необходимо запросить увеличение квоты до 30 для обоих. Оба изменения квот обычно должны быть одобрены в течение нескольких минут. Ссылаться на Запрос увеличения квоты чтобы получить больше информации.

Если вы не хотите менять квоту, вы можете просто изменить значение MAX_PARALLEL_JOBS переменная в скрипте (например, 5).

- Каждое задание HPO включает в себя набор учебная работа испытаний и указать модель с оптимальными гиперпараметрами.

- Проанализируйте результаты и развернуть наиболее эффективную модель.

Это решение повлечет за собой расходы в вашем аккаунте AWS. Стоимость этого решения будет зависеть от количества и продолжительности учебных занятий HPO. По мере их увеличения будет расти и стоимость. Вы можете сократить расходы, ограничив время обучения и настроив TuningJobCompletionCriteriaConfig согласно инструкциям, обсуждаемым далее в этом посте. Информацию о ценах см. Цены на Amazon SageMaker.

В следующих разделах мы обсудим ноутбук более подробно с примерами кода и действиями по анализу результатов и выбору лучшей модели.

Начальная настройка

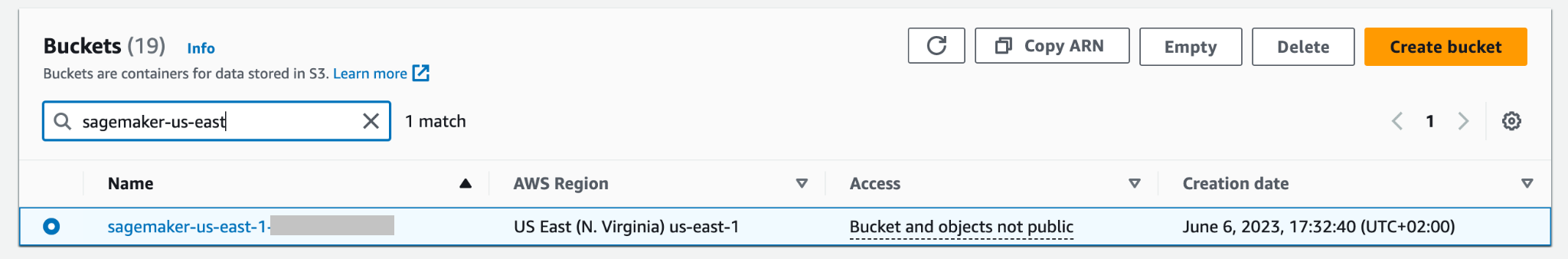

Начнем с запуска Импорт и настройка в custom-automl.ipynb блокнот. Он устанавливает и импортирует все необходимые зависимости, создает экземпляр сеанса и клиента SageMaker, а также устанавливает регион по умолчанию и корзину S3 для хранения данных.

Подготовка данных

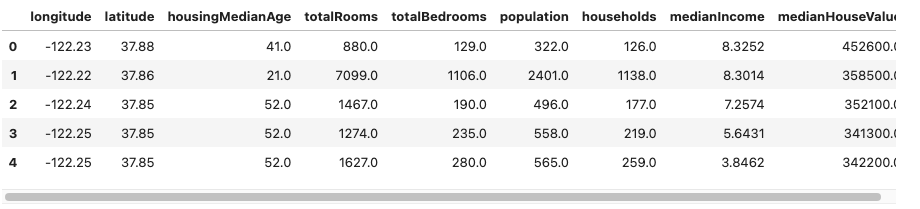

Загрузите набор данных о жилье в Калифорнии и подготовьте его, запустив Загрузить данные раздел блокнота. Набор данных разделяется на кадры данных для обучения и тестирования и загружается в корзину S3 по умолчанию для сеанса SageMaker.

Весь набор данных содержит 20,640 9 записей и XNUMX столбцов, включая цель. Цель состоит в том, чтобы предсказать медианную стоимость дома (medianHouseValue столбец). На следующем снимке экрана показаны верхние строки набора данных.

Шаблон сценария обучения

Рабочий процесс AutoML в этом посте основан на scikit учиться конвейеры и алгоритмы предварительной обработки. Цель состоит в том, чтобы создать большую комбинацию различных конвейеров и алгоритмов предварительной обработки, чтобы найти наиболее эффективную настройку. Начнем с создания общего сценария обучения, который будет храниться локально в экземпляре записной книжки. В этом скрипте есть два пустых блока комментариев: один для введения гиперпараметров, а другой — для объекта конвейера модели предварительной обработки. Они будут введены динамически для каждого кандидата модели предварительной обработки. Целью использования одного общего сценария является сохранение реализации СУХОЙ (не повторяйтесь).

Создание комбинаций предварительной обработки и моделей

Ассоциация preprocessors словарь содержит спецификацию методов предварительной обработки, применяемых ко всем входным функциям модели. Каждый рецепт определяется с помощью Pipeline или FeatureUnion объект из scikit-learn, который объединяет отдельные преобразования данных и складывает их вместе. Например, mean-imp-scale — это простой рецепт, который гарантирует, что недостающие значения будут вменены с использованием средних значений соответствующих столбцов и что все объекты масштабируются с использованием StandardScaler, В отличие от mean-imp-scale-pca цепочки рецептов объединяют еще несколько операций:

- Вмените пропущенные значения в столбцах их средним значением.

- Примените масштабирование признаков, используя среднее и стандартное отклонение.

- Рассчитайте PCA поверх входных данных при заданном пороговом значении отклонения и объедините его с вмененными и масштабированными входными объектами.

В этом посте все входные функции являются числовыми. Если у вас больше типов данных во входном наборе данных, вам следует указать более сложный конвейер, в котором разные ветви предварительной обработки применяются к разным наборам типов объектов.

Ассоциация models словарь содержит спецификации различных алгоритмов, которым вы соответствуете набор данных. Каждый тип модели имеет в словаре следующую спецификацию:

- скрипт_выход – Указывает на расположение обучающего сценария, используемого оценщиком. Это поле заполняется динамически, когда

modelsсловарь совмещен сpreprocessorsСловарь. - вставки – Определяет код, который будет вставлен в

script_draft.pyи впоследствии сохранено подscript_output, Ключ“preprocessor”намеренно оставлено пустым, поскольку это место заполнено одним из препроцессоров для создания нескольких комбинаций модель-препроцессор. - гиперпараметры – Набор гиперпараметров, оптимизированных заданием HPO.

- include_cls_metadata – Дополнительные сведения о конфигурации, необходимые для SageMaker.

Tunerкласса.

Полный пример models словарь доступен в репозитории GitHub.

Далее, давайте пройдемся по preprocessors и models словари и создать все возможные комбинации. Например, если ваш preprocessors словарь содержит 10 рецептов и 5 определений моделей в models словарь, недавно созданный словарь конвейеров содержит 50 конвейеров модели препроцессора, которые оцениваются во время HPO. Обратите внимание, что на этом этапе отдельные сценарии конвейера еще не созданы. Следующий блок кода (ячейка 9) блокнота Jupyter перебирает все объекты модели препроцессора в pipelines словарь, вставляет все соответствующие фрагменты кода и сохраняет версию сценария, специфичную для конвейера, локально в записной книжке. Эти сценарии используются на следующих шагах при создании отдельных оценщиков, которые вы подключаете к заданию HPO.

Определение оценщиков

Теперь вы можете работать над определением оценщиков SageMaker, которые будут использоваться заданием HPO после того, как сценарии будут готовы. Начнем с создания класса-оболочки, который определяет некоторые общие свойства для всех оценщиков. Он наследует от SKLearn class и определяет роль, количество экземпляров и тип, а также столбцы, используемые сценарием в качестве функций и цели.

Давайте построим estimators словарь, перебирая все сценарии, созданные ранее и расположенные в scripts каталог. Вы создаете экземпляр новой оценки, используя SKLearnBase класс с уникальным именем оценщика и одним из сценариев. Обратите внимание, что estimators словарь имеет два уровня: верхний уровень определяет pipeline_family. Это логическая группировка, основанная на типе оцениваемых моделей и равна длине models словарь. Второй уровень содержит отдельные типы препроцессоров в сочетании с заданными. pipeline_family. Эта логическая группировка необходима при создании задания HPO.

Определите аргументы тюнера HPO

Оптимизировать передачу аргументов в HPO Tuner класс, HyperparameterTunerArgs Класс данных инициализируется аргументами, необходимыми для класса HPO. Он поставляется с набором функций, которые обеспечивают возврат аргументов HPO в формате, ожидаемом при одновременном развертывании нескольких определений модели.

Следующий блок кода использует ранее введенный HyperparameterTunerArgs класс данных. Вы создаете еще один словарь под названием hp_args и генерировать набор входных параметров, специфичных для каждого estimator_family из estimators словарь. Эти аргументы используются на следующем этапе при инициализации заданий HPO для каждого семейства моделей.

Создание объектов тюнера HPO

На этом этапе вы создаете индивидуальные тюнеры для каждого estimator_family. Почему вы создаете три отдельных задания HPO вместо того, чтобы запускать только одно для всех оценщиков? HyperparameterTuner Класс ограничен 10 присоединенными к нему определениями моделей. Таким образом, каждый HPO отвечает за поиск наиболее производительного препроцессора для данного семейства моделей и настройку гиперпараметров этого семейства моделей.

Еще несколько моментов по настройке:

- Стратегия оптимизации является байесовской, что означает, что HPO активно контролирует эффективность всех испытаний и направляет оптимизацию в сторону более перспективных комбинаций гиперпараметров. Ранняя остановка должна быть установлена на от or Авто при работе с байесовской стратегией, которая сама обрабатывает эту логику.

- Каждое задание HPO выполняет максимум 100 заданий и выполняет 10 заданий параллельно. Если вы имеете дело с большими наборами данных, возможно, вам захочется увеличить общее количество заданий.

- Кроме того, вы можете использовать настройки, которые контролируют продолжительность выполнения задания и количество заданий, запускаемых вашим HPO. Один из способов сделать это — установить максимальное время выполнения в секундах (в этом посте мы установили его на 1 час). Другой вариант – использовать недавно выпущенный

TuningJobCompletionCriteriaConfig. Он предлагает набор настроек, которые отслеживают ход выполнения ваших заданий и решают, вероятно ли, что дополнительные задания улучшат результат. В этом посте мы установили максимальное количество обучающих заданий, не улучшающихся, равным 20. Таким образом, если результат не улучшается (например, с сорокового испытания), вам не придется платить за оставшиеся испытания до тех пор, покаmax_jobsдостигнуто

Теперь давайте пройдемся по tuners и hp_args словари и запускать все задания HPO в SageMaker. Обратите внимание на использование аргумента ожидания, установленного в значение False, что означает, что ядро не будет ждать, пока будут получены результаты, и вы сможете запустить все задания одновременно.

Вполне вероятно, что не все задания по обучению будут завершены, а некоторые из них могут быть остановлены заданием HPO. Причиной этого является TuningJobCompletionCriteriaConfig— оптимизация завершается, если выполняется любой из указанных критериев. В этом случае критерии оптимизации не улучшаются для 20 последовательных заданий.

Анализ результатов

Ячейка 15 записной книжки проверяет, выполнены ли все задания HPO, и объединяет все результаты в форме фрейма данных pandas для дальнейшего анализа. Прежде чем детально анализировать результаты, давайте взглянем на консоль SageMaker.

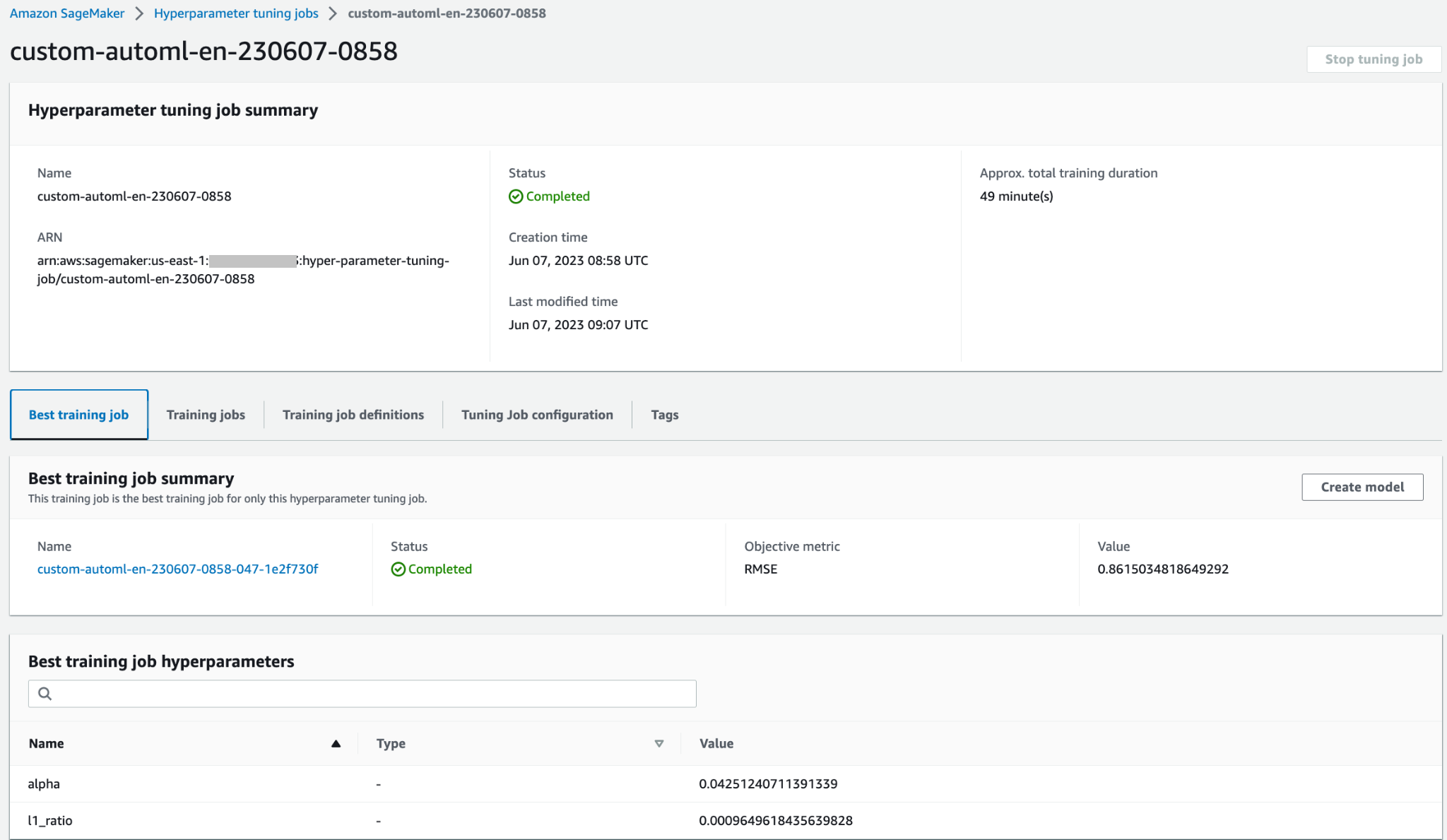

В верхней части Задания по настройке гиперпараметров На странице вы можете увидеть три запущенных вами задания HPO. Все они закончили досрочно и не выполнили все 100 учебных заданий. На следующем снимке экрана вы можете видеть, что семейство моделей Elastic-Net выполнило наибольшее количество испытаний, тогда как другим не потребовалось так много обучающих заданий, чтобы найти лучший результат.

Вы можете открыть задание HPO, чтобы получить доступ к более подробной информации, такой как отдельные задания по обучению, конфигурация задания, а также информация о лучшем задании по обучению и его производительности.

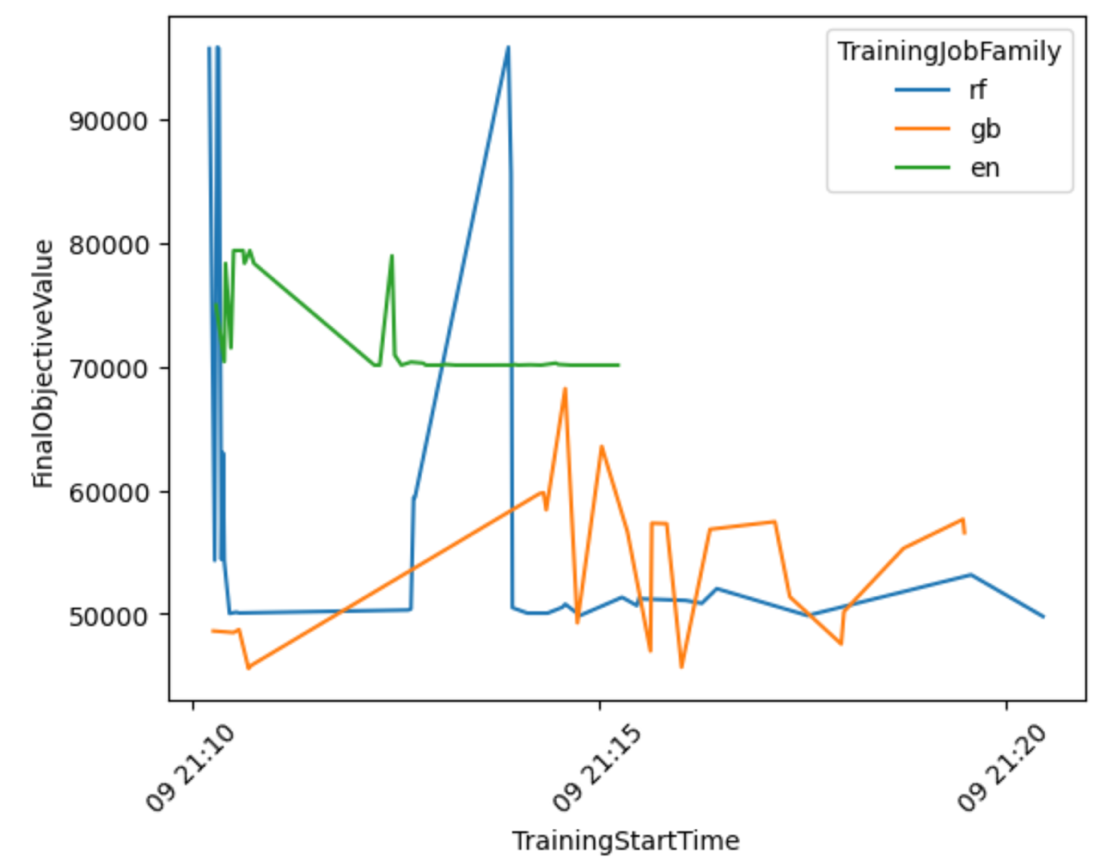

Давайте создадим визуализацию на основе результатов, чтобы получить более полное представление о производительности рабочего процесса AutoML во всех семействах моделей.

Из следующего графика можно сделать вывод, что Elastic-Net производительность модели колебалась между 70,000 80,000 и XNUMX XNUMX RMSE и в конечном итоге остановилась, поскольку алгоритм не смог улучшить свою производительность, несмотря на попытки различных методов предварительной обработки и значений гиперпараметров. Также кажется, что RandomForest производительность сильно различалась в зависимости от набора гиперпараметров, исследованного HPO, но, несмотря на множество испытаний, она не могла опуститься ниже 50,000 XNUMX RMSE ошибки. GradientBoosting уже с самого начала добился наилучших результатов, опустившись ниже 50,000 XNUMX RMSE. HPO попыталась еще больше улучшить этот результат, но не смогла добиться лучшей производительности в других комбинациях гиперпараметров. Общий вывод для всех заданий HPO заключается в том, что для поиска наиболее эффективного набора гиперпараметров для каждого алгоритма требовалось не так много заданий. Чтобы еще больше улучшить результат, вам нужно будет поэкспериментировать с созданием большего количества функций и выполнением дополнительных функций.

Вы также можете рассмотреть более детально комбинацию модель-препроцессор, чтобы сделать выводы о наиболее перспективных комбинациях.

Выберите лучшую модель и разверните ее

Следующий фрагмент кода выбирает лучшую модель на основе наименьшего достигнутого целевого значения. Затем вы можете развернуть модель в качестве конечной точки SageMaker.

Убирать

Чтобы предотвратить нежелательные списания средств с вашей учетной записи AWS, мы рекомендуем удалить ресурсы AWS, которые вы использовали в этом посте:

- На консоли Amazon S3 очистите данные из корзины S3, в которой хранились данные обучения.

- На консоли SageMaker остановите экземпляр блокнота.

- Удалите конечную точку модели, если вы ее развернули. Конечные точки следует удалять, когда они больше не используются, поскольку оплата за них взимается по времени развертывания.

Заключение

В этом посте мы продемонстрировали, как создать собственное задание HPO в SageMaker, используя индивидуальный выбор алгоритмов и методов предварительной обработки. В частности, этот пример демонстрирует, как автоматизировать процесс создания множества обучающих сценариев и как использовать структуры программирования Python для эффективного развертывания нескольких параллельных заданий оптимизации. Мы надеемся, что это решение послужит основой для любых заданий по настройке пользовательских моделей, которые вы будете развертывать с помощью SageMaker, чтобы добиться более высокой производительности и ускорения рабочих процессов машинного обучения.

Ознакомьтесь со следующими ресурсами, чтобы углубить свои знания об использовании SageMaker HPO:

Об авторах

Конрад Земш — старший архитектор решений машинного обучения в команде лаборатории данных Amazon Web Services. Он помогает клиентам использовать машинное обучение для решения бизнес-задач с помощью AWS. Ему нравится изобретать и упрощать, чтобы предоставить клиентам простые и прагматичные решения для их проектов AI/ML. Больше всего он увлечен MlOps и традиционной наукой о данных. Вне работы он большой поклонник виндсерфинга и кайтсерфинга.

Конрад Земш — старший архитектор решений машинного обучения в команде лаборатории данных Amazon Web Services. Он помогает клиентам использовать машинное обучение для решения бизнес-задач с помощью AWS. Ему нравится изобретать и упрощать, чтобы предоставить клиентам простые и прагматичные решения для их проектов AI/ML. Больше всего он увлечен MlOps и традиционной наукой о данных. Вне работы он большой поклонник виндсерфинга и кайтсерфинга.

Тунец Эрсой — старший архитектор решений в AWS. Ее основная задача — помочь клиентам из государственного сектора внедрить облачные технологии для своих рабочих задач. У нее есть опыт разработки приложений, корпоративной архитектуры и технологий контакт-центров. В сферу ее интересов входят бессерверные архитектуры и искусственный интеллект и машинное обучение.

Тунец Эрсой — старший архитектор решений в AWS. Ее основная задача — помочь клиентам из государственного сектора внедрить облачные технологии для своих рабочих задач. У нее есть опыт разработки приложений, корпоративной архитектуры и технологий контакт-центров. В сферу ее интересов входят бессерверные архитектуры и искусственный интеллект и машинное обучение.

- SEO-контент и PR-распределение. Получите усиление сегодня.

- PlatoData.Network Вертикальный генеративный ИИ. Расширьте возможности себя. Доступ здесь.

- ПлатонАйСтрим. Интеллект Web3. Расширение знаний. Доступ здесь.

- ПлатонЭСГ. Углерод, чистые технологии, Энергия, Окружающая среда, Солнечная, Управление отходами. Доступ здесь.

- ПлатонЗдоровье. Биотехнологии и клинические исследования. Доступ здесь.

- Источник: https://aws.amazon.com/blogs/machine-learning/implement-a-custom-automl-job-using-pre-selected-algorithms-in-amazon-sagemaker-automatic-model-tuning/

- :имеет

- :является

- :нет

- :куда

- $UP

- 000

- 1

- 10

- 100

- 12

- 13

- 14

- 15%

- 20

- 2000

- 22

- 25

- 28

- 30

- 39

- 50

- 7

- 70

- 8

- 80

- 9

- a

- в состоянии

- О нас

- доступ

- По

- Учетная запись

- Достигать

- достигнутый

- через

- активно

- дополнительный

- Дополнительно

- принять

- После

- AI / ML

- цель

- алгоритм

- алгоритмы

- Все

- Позволяющий

- позволяет

- уже

- причислены

- Amazon

- Создатель мудреца Амазонки

- Amazon Web Services

- an

- анализ

- анализировать

- анализ

- и

- Другой

- любой

- Применение

- Разработка приложения

- прикладной

- применяется

- Применить

- утвержденный

- архитектура

- МЫ

- аргумент

- Аргументы

- AS

- предполагать

- At

- прикреплять

- автоматический

- автоматизировать

- Автоматический

- автоматически

- AutoML

- доступен

- AWS

- фон

- Использование темпера с изогнутым основанием

- основанный

- Базовая линия

- байесовский

- BE

- , так как:

- до

- начало

- ниже

- ЛУЧШЕЕ

- Лучшая

- между

- большой

- Заблокировать

- Блоки

- изоферменты печени

- ветви

- строить

- Строительство

- бизнес

- но

- кнопка

- by

- Калифорния

- призывают

- под названием

- CAN

- кандидат

- случаев

- случаев

- Центр

- цепи

- проблемы

- изменение

- изменения

- расходы

- Проверки

- Выберите

- класс

- CLF

- клиент

- облако

- Кластер

- кластеризации

- код

- Column

- Колонки

- сочетание

- комбинации

- сочетании

- комбинаты

- выходит

- комментарий

- Общий

- полный

- Заполненная

- комплектующие

- сложный

- вывод

- заключение

- Проводить

- Конфигурация

- последовательный

- Консоли

- обращайтесь

- контакт-центр

- содержит

- контраст

- контроль

- Цена

- Расходы

- может

- Создайте

- создали

- Создающий

- Критерии

- решающее значение

- В настоящее время

- изготовленный на заказ

- Клиенты

- данным

- наука о данных

- Наборы данных

- занимавшийся

- решать

- углублять

- По умолчанию

- определенный

- Определяет

- определяющий

- Определения

- демонстрировать

- демонстрирует

- зависеть

- Зависимости

- в зависимости

- развертывание

- развернуть

- развертывание

- развертывание

- выводить

- Несмотря на

- подробность

- подробный

- подробнее

- развивать

- развитый

- Развитие

- развивается

- отклонение

- ДИКТ

- различный

- каталоги

- обсуждать

- обсуждается

- do

- не

- домен

- Dont

- вниз

- рисовать

- сухим

- продолжительность

- в течение

- динамично

- каждый

- Рано

- эффективный

- ликвидирует

- включить

- Конечная точка

- Проект и

- обеспечивать

- обеспечивает

- Предприятие

- Весь

- полностью

- равный

- ошибка

- оценивать

- оценивается

- со временем

- Каждая

- исследовать

- пример

- Примеры

- выполнение

- существовать

- ожидать

- ожидаемый

- эксперимент

- объяснены

- Разведанный

- исследует

- ложный

- семей

- семья

- вентилятор

- Особенность

- Особенности

- несколько

- поле

- Файл

- заполненный

- Найдите

- обнаружение

- Во-первых,

- соответствовать

- 5

- Фокус

- следовать

- после

- следующим образом

- Что касается

- лес

- форма

- формат

- КАДР

- от

- передний

- полный

- функция

- функциональность

- Функции

- далее

- Общие

- порождать

- генерируется

- порождающий

- получить

- идти

- GitHub

- данный

- Go

- цель

- будет

- график

- рука

- Ручки

- Есть

- имеющий

- he

- тяжелый

- тяжелая атлетика

- помощь

- помогает

- ее

- на высшем уровне

- высший

- наивысший

- надежды

- час

- Вилла / Бунгало

- домохозяйства

- жилье

- Как

- How To

- HTML

- HTTP

- HTTPS

- Оптимизация гиперпараметра

- Настройка гиперпараметра

- Личность

- if

- осуществлять

- реализация

- Импортировать

- импорт

- улучшать

- улучшение

- in

- включают

- В том числе

- Увеличение

- указывать

- individual

- в отдельности

- информация

- вход

- затраты

- Вставки

- размышления

- пример

- вместо

- инструкции

- интеграции.

- намеренно

- интересы

- Интерфейс

- в

- выпустили

- IT

- ЕГО

- саму трезвость

- работа

- Джобс

- JPG

- всего

- только один

- Сохранить

- Основные

- знания

- лаборатория

- большой

- больше

- новее

- запустили

- запуск

- изучение

- оставил

- Длина

- уровень

- уровни

- Жизненный цикл

- Подтяжка лица

- такое как

- Вероятно

- ограничивающий

- Linux

- загрузка

- в местном масштабе

- расположенный

- расположение

- логика

- логический

- Длинное

- дольше

- посмотреть

- серия

- низший

- машина

- обучение с помощью машины

- многих

- максимальный

- Май..

- значить

- означает

- идти

- встретивший

- Метрика

- может быть

- Минут

- отсутствующий

- ML

- млн операций в секунду

- модель

- Модели

- изменять

- монитор

- Мониторы

- БОЛЕЕ

- самых

- с разными

- имя

- Узкий

- перемещается

- Необходимость

- Новые

- вновь

- следующий

- нет

- Ничто

- ноутбук

- отметил,

- сейчас

- номер

- NumPy

- объект

- цель

- объекты

- of

- от

- Предложения

- on

- консолидировать

- ONE

- только

- открытый

- Операционный отдел

- оптимальный

- оптимизация

- Оптимизировать

- оптимизированный

- or

- заказ

- OS

- Другое

- Другое

- внешний

- выходной

- внешнюю

- за

- общий

- страница

- панд

- Параллельные

- параметры

- часть

- особый

- Прохождение

- страстный

- путь

- ОПЛАТИТЬ

- Выполнять

- производительность

- выполнения

- сохраняется

- штук

- трубопровод

- Платон

- Платон Интеллектуальные данные

- ПлатонДанные

- играет

- штекер

- Точка

- пунктов

- политика

- население

- возможное

- После

- потенциал

- прагматический

- предсказывать

- Predictor

- Подготовить

- предпосылки

- разрабатывает

- предотвращать

- предварительно

- цены

- первичный

- Печать / PDF

- Проблема

- процесс

- производит

- Производство

- Программирование

- Прогресс

- Проект

- проектов

- многообещающий

- свойства

- обеспечивать

- приводит

- обеспечение

- что такое варган?

- цель

- Питон

- случайный

- быстро

- достиг

- готовый

- причина

- недавно

- рецепт

- рекомендовать

- учет

- уменьшить

- снижает

- относиться

- ссылка

- по

- регулярное выражение

- область

- выпустил

- соответствующие

- осталось

- удаление

- повторять

- хранилище

- запросить

- требовать

- обязательный

- Полезные ресурсы

- те

- ответственный

- ограниченный

- результат

- Итоги

- возвращают

- правую

- Роли

- Run

- Бег

- работает

- время выполнения

- sagemaker

- Автоматическая настройка модели SageMaker

- сохраняются

- Шкала

- масштабирование

- Наука

- Ученые

- scikit учиться

- сфера

- Гол

- скрипт

- скрипты

- Во-вторых

- секунды

- Раздел

- разделах

- сектор

- посмотреть

- кажется

- выбранный

- выбор

- SELF

- старший

- отдельный

- служить

- Serverless

- обслуживание

- Услуги

- Сессия

- набор

- Наборы

- настройки

- установка

- она

- должен

- продемонстрированы

- показанный

- Шоу

- просто

- упрощение

- просто

- отрывок

- So

- Решение

- Решения

- РЕШАТЬ

- некоторые

- специализированный

- конкретный

- Спецификация

- спецификации

- указанный

- скорость

- раскол

- стек

- стандарт

- Начало

- Начало

- Статус:

- Шаг

- Шаги

- Stop

- остановившийся

- остановка

- диск

- хранить

- хранение

- Стратегия

- Структура

- структур

- впоследствии

- такие

- Поддержанный

- ТАБЛИЦЫ

- с учетом

- взять

- цель

- команда

- Технический

- снижения вреда

- технологии

- Терминал

- тестXNUMX

- Тестирование

- который

- Ассоциация

- их

- Их

- тогда

- Там.

- следовательно

- Эти

- они

- этой

- те

- три

- порог

- Через

- время

- в

- вместе

- инструментом

- топ

- Всего

- к

- традиционный

- Train

- Обучение

- преобразований

- суд

- испытания

- пыталась

- вызвать

- срабатывает

- срабатывание

- пытается

- настройка

- два

- напишите

- Типы

- типично

- ui

- под

- понимание

- созданного

- до

- нежелательный

- загружено

- Применение

- использование

- прецедент

- используемый

- использования

- через

- VALIDATE

- ценностное

- Наши ценности

- переменная

- разнообразный

- различный

- версия

- версии

- Вид

- визуализация

- W

- ждать

- прохождение

- хотеть

- законопроект

- Путь..

- we

- Web

- веб-сервисы

- ЧТО Ж

- были

- Что

- когда

- в то время как

- будь то

- который

- зачем

- будете

- в

- без

- Работа

- рабочий

- Рабочие процессы

- работает

- бы

- записывать

- еще

- Ты

- ВАШЕ

- себя

- зефирнет