Одним из наиболее полезных шаблонов приложений для генеративных рабочих нагрузок ИИ является поисковая дополненная генерация (RAG). В шаблоне RAG мы находим фрагменты справочного контента, связанные с приглашением ввода, выполняя поиск по сходству во встраиваниях. Встраивания фиксируют информационное содержание в тексте, позволяя моделям обработки естественного языка (NLP) работать с языком в числовой форме. Вложения — это просто векторы чисел с плавающей запятой, поэтому мы можем проанализировать их, чтобы ответить на три важных вопроса: изменяются ли наши справочные данные со временем? Меняются ли со временем вопросы, которые задают пользователи? И, наконец, насколько хорошо наши справочные данные охватывают задаваемые вопросы?

В этом посте вы узнаете о некоторых соображениях по внедрению векторного анализа и обнаружению сигналов встроенного дрейфа. Поскольку встраивания являются важным источником данных для моделей НЛП в целом и решений генеративного ИИ в частности, нам нужен способ измерить, меняются ли наши вложения со временем (дрейфуют). В этом посте вы увидите пример обнаружения дрейфа при внедрении векторов с использованием метода кластеризации с моделями большого языка (LLMS), развернутыми из Amazon SageMaker JumpStart. Вы также сможете изучить эти концепции на двух предоставленных примерах, включая комплексный пример приложения или, при необходимости, подмножество приложения.

Обзор РАГ

Ассоциация ТРЯПОЧНАЯ выкройка позволяет получать знания из внешних источников, таких как PDF-документы, вики-статьи или стенограммы разговоров, а затем использовать эти знания для дополнения инструкций, отправляемых в LLM. Это позволяет LLM ссылаться на более важную информацию при формировании ответа. Например, если вы спросите магистра права, как приготовить печенье с шоколадной крошкой, он может включить информацию из вашей собственной библиотеки рецептов. В этом шаблоне текст рецепта преобразуется в векторы внедрения с использованием модели внедрения и сохраняется в базе данных векторов. Входящие вопросы преобразуются во встраивания, а затем база данных векторов выполняет поиск по сходству, чтобы найти связанный контент. Затем вопрос и справочные данные попадают в подсказку LLM.

Давайте подробнее рассмотрим создаваемые векторы внедрения и то, как выполнить анализ смещения этих векторов.

Анализ встраивания векторов

Векторы внедрения — это числовые представления наших данных, поэтому анализ этих векторов может дать представление о наших справочных данных, которые позже можно использовать для обнаружения потенциальных сигналов дрейфа. Векторы внедрения представляют собой элемент в n-мерном пространстве, где n часто велико. Например, модель GPT-J 6B, используемая в этом посте, создает векторы размером 4096. Чтобы измерить дрейф, предположим, что наше приложение фиксирует векторы внедрения как для справочных данных, так и для входящих подсказок.

Мы начнем с уменьшения размерности с помощью анализа главных компонентов (PCA). PCA пытается сократить количество измерений, сохраняя при этом большую часть дисперсии данных. В этом случае мы пытаемся найти количество измерений, сохраняющее 95% дисперсии, которое должно охватывать все, что находится в пределах двух стандартных отклонений.

Затем мы используем K-Means для идентификации набора центров кластеров. K-Means пытается сгруппировать точки в кластеры так, чтобы каждый кластер был относительно компактным, а кластеры находились как можно дальше друг от друга.

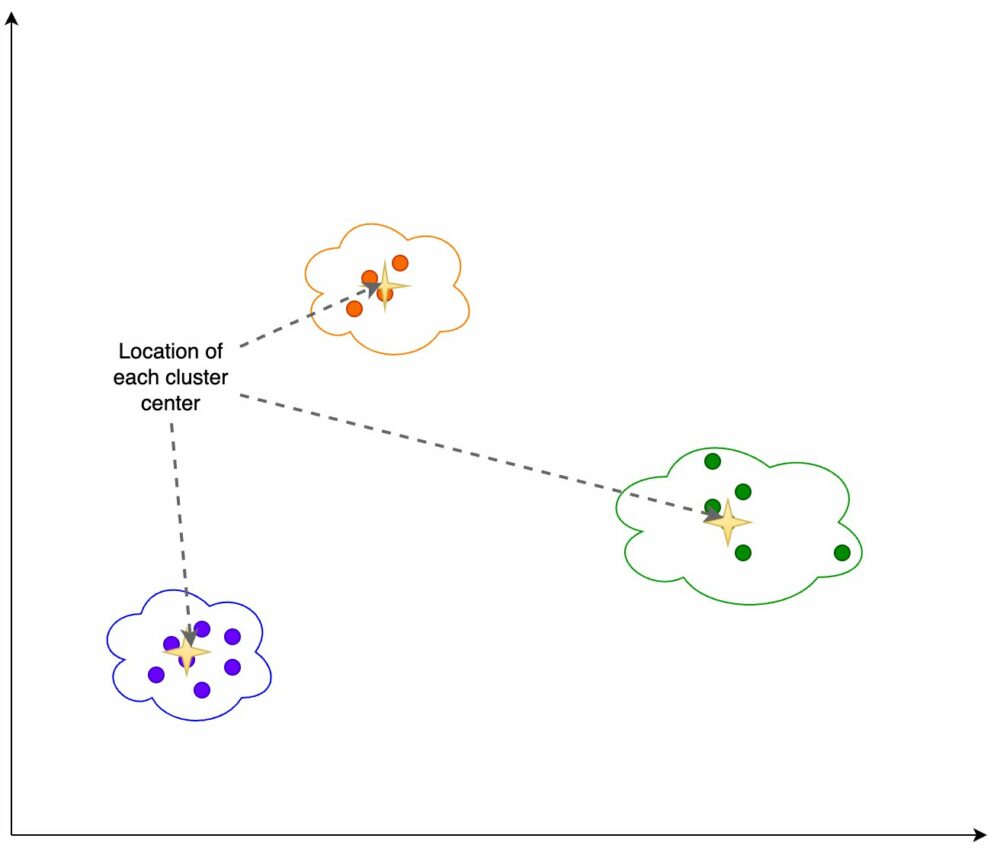

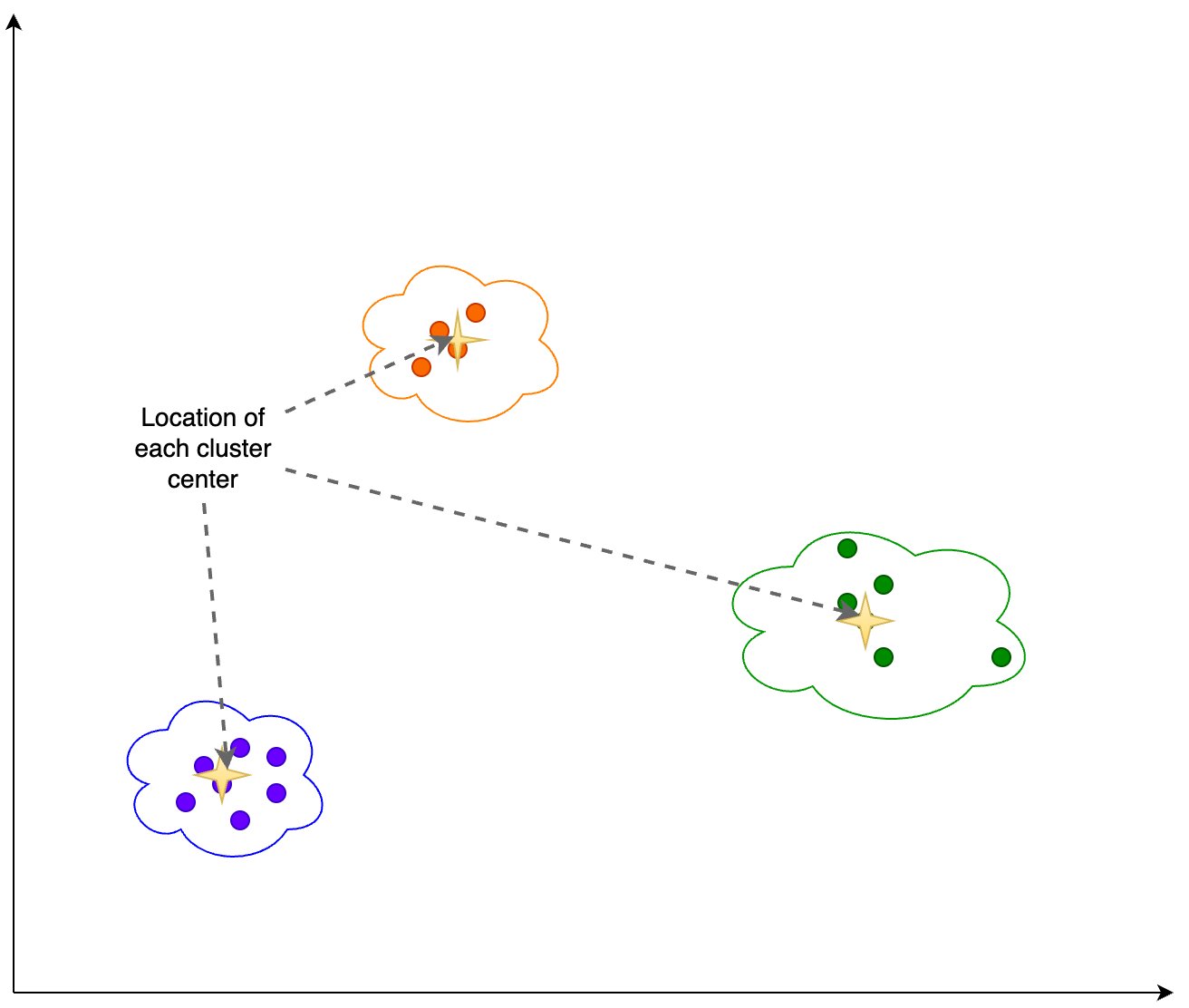

Мы вычисляем следующую информацию на основе результатов кластеризации, показанных на следующем рисунке:

- Количество измерений в PCA, которые объясняют 95% дисперсии.

- Местоположение каждого центра кластера или центроида.

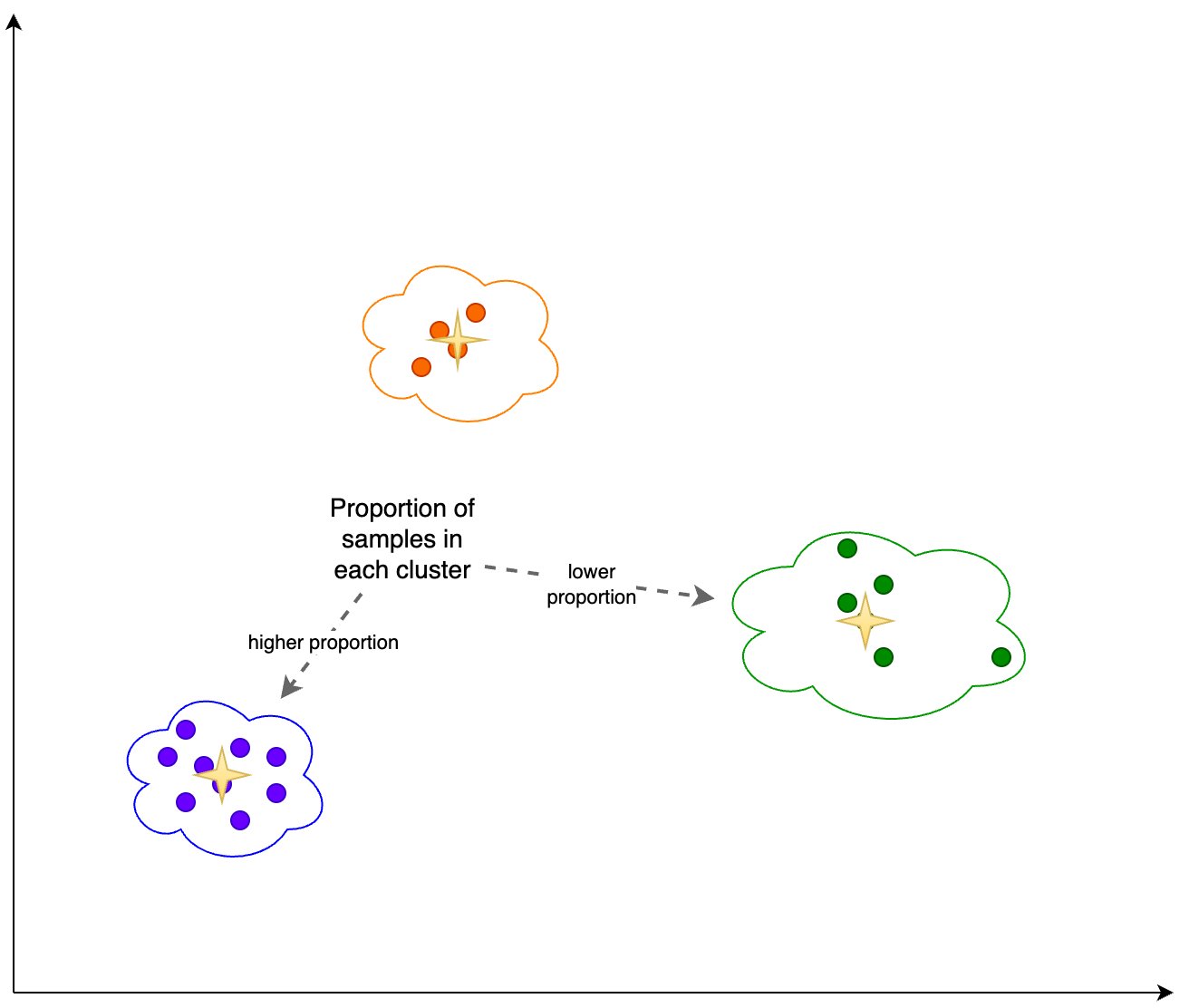

Дополнительно мы смотрим на долю (больше или меньше) образцов в каждом кластере, как показано на следующем рисунке.

Наконец, мы используем этот анализ для расчета следующего:

- Инерция – Инерция — это сумма квадратов расстояний до центроидов кластера, которая измеряет, насколько хорошо данные были кластеризованы с использованием K-средних.

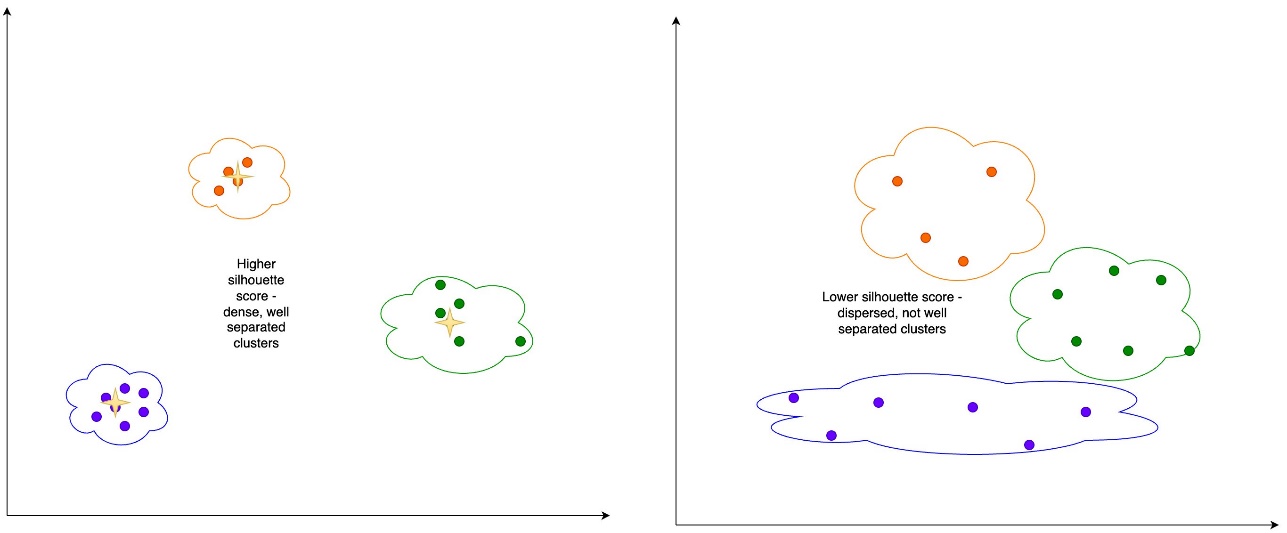

- Силуэт оценка – Оценка силуэта является мерой проверки согласованности внутри кластеров и находится в диапазоне от -1 до 1. Значение, близкое к 1, означает, что точки в кластере расположены близко к другим точкам в том же кластере и далеки от точки других кластеров. Визуальное представление оценки силуэта можно увидеть на следующем рисунке.

Мы можем периодически собирать эту информацию для создания снимков вложений как для исходных справочных данных, так и для подсказок. Сбор этих данных позволяет нам анализировать потенциальные сигналы дрейфа внедрения.

Обнаружение дрейфа внедрения

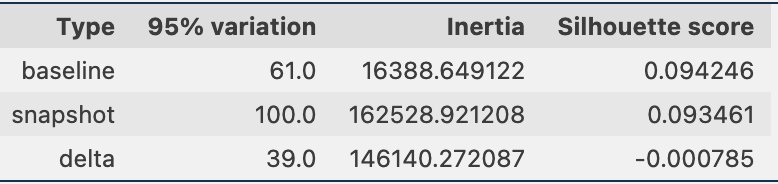

Периодически мы можем сравнивать информацию о кластеризации с помощью снимков данных, которые включают в себя внедрение справочных данных и внедрение подсказок. Во-первых, мы можем сравнить количество измерений, необходимых для объяснения 95% вариаций данных внедрения, инерции и оценки силуэта из задания кластеризации. Как вы можете видеть в следующей таблице, по сравнению с базовым уровнем, последний снимок вложений требует на 39 больше измерений, чтобы объяснить дисперсию, что указывает на то, что наши данные более разбросаны. Инерция возросла, что указывает на то, что образцы в совокупности находятся дальше от центров своих кластеров. Кроме того, оценка силуэта снизилась, что указывает на то, что кластеры не так четко определены. Для оперативных данных это может указывать на то, что типы вопросов, поступающих в систему, охватывают больше тем.

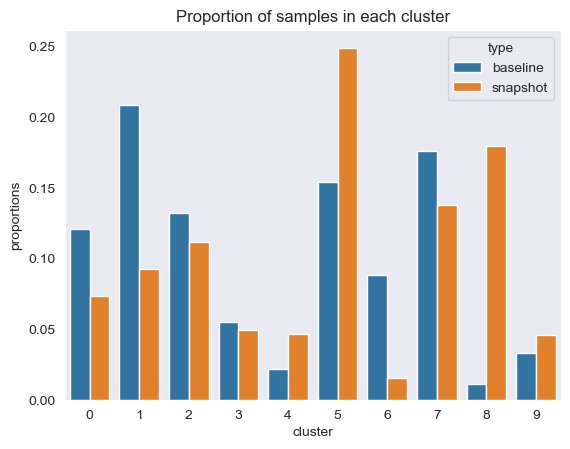

Далее на следующем рисунке мы видим, как со временем менялась доля выборок в каждом кластере. Это может показать нам, насколько наши новые справочные данные в целом похожи на предыдущий набор или охватывают новые области.

Наконец, мы можем увидеть, движутся ли центры кластеров, что указывает на дрейф информации в кластерах, как показано в следующей таблице.

Охват справочной информацией по поступающим вопросам

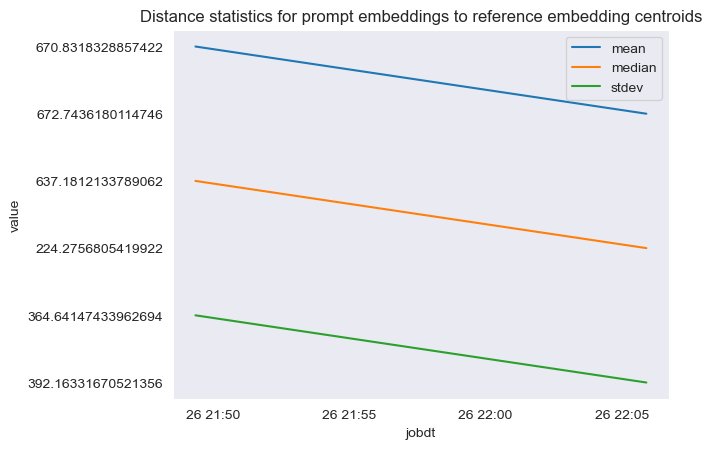

Мы также можем оценить, насколько хорошо наши справочные данные соответствуют поступающим вопросам. Для этого мы назначаем каждое внедрение приглашения кластеру эталонных данных. Мы вычисляем расстояние от каждой подсказки до соответствующего ей центра и смотрим на среднее, медиану и стандартное отклонение этих расстояний. Мы можем хранить эту информацию и видеть, как она меняется с течением времени.

На следующем рисунке показан пример анализа расстояния между внедрением подсказок и эталонными центрами обработки данных с течением времени.

Как вы можете видеть, статистика среднего, медианного и стандартного отклонения расстояния между быстрыми внедрениями и эталонными центрами обработки данных уменьшается между исходным базовым уровнем и последним моментальным снимком. Хотя абсолютное значение расстояния трудно интерпретировать, мы можем использовать тенденции, чтобы определить, улучшается или ухудшается семантическое перекрытие между справочными данными и входящими вопросами с течением времени.

Образец заявления

Чтобы собрать экспериментальные результаты, обсуждавшиеся в предыдущем разделе, мы создали пример приложения, реализующего шаблон RAG с использованием моделей внедрения и генерации, развернутых с помощью SageMaker JumpStart и размещенных на Создатель мудреца Амазонки конечные точки в реальном времени.

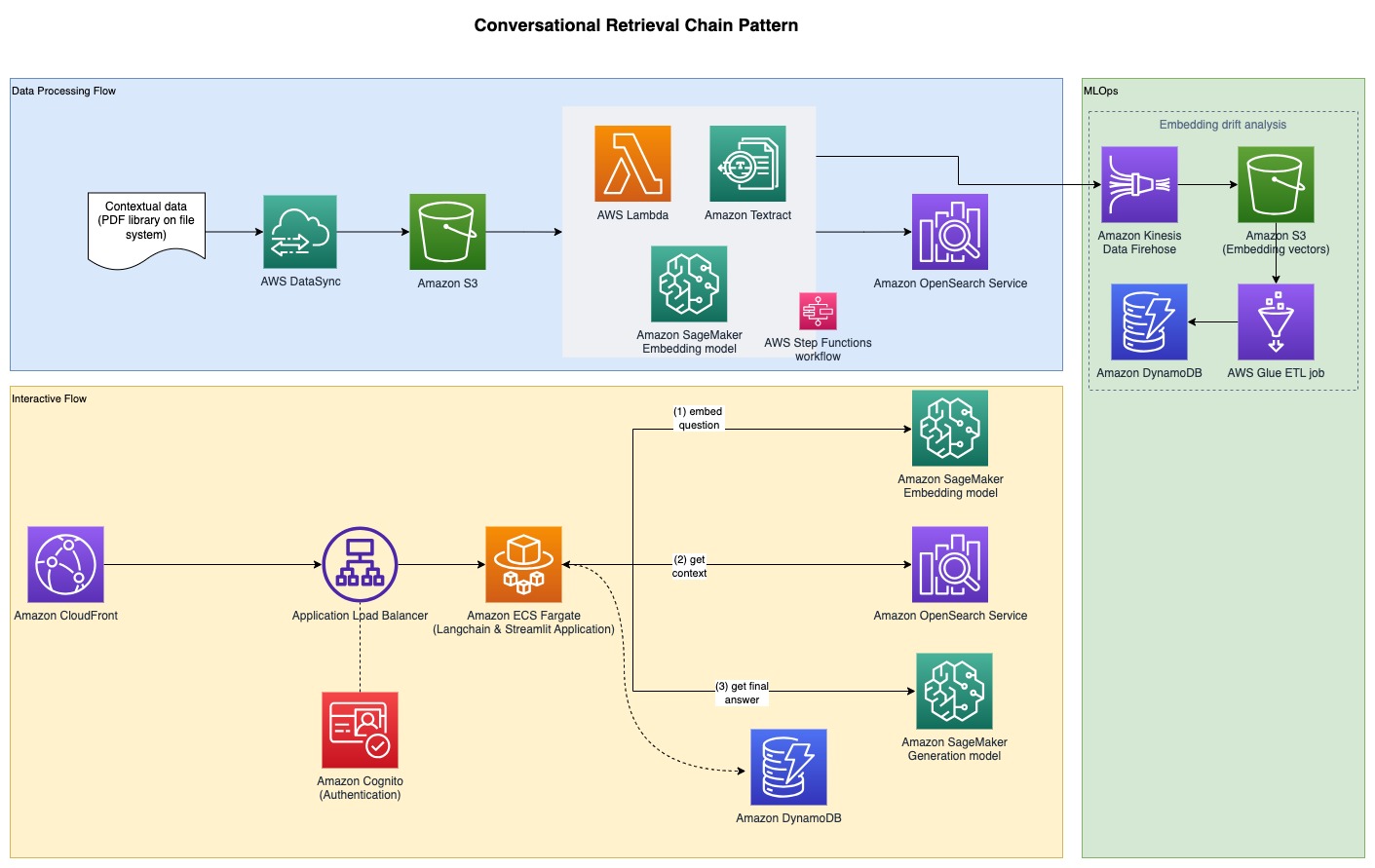

Приложение состоит из трех основных компонентов:

- Мы используем интерактивный поток, который включает в себя пользовательский интерфейс для захвата подсказок в сочетании с уровнем оркестрации RAG с использованием LangChain.

- Процесс обработки данных извлекает данные из документов PDF и создает вложения, которые сохраняются в Сервис Amazon OpenSearch. Мы также используем их в окончательном компоненте анализа смещения приложения.

- Вложения фиксируются в Простой сервис хранения Amazon (Amazon S3) через Пожарный шланг данных Amazon Kinesis, и мы запускаем комбинацию Клей AWS извлекать, преобразовывать и загружать (ETL) задания и блокноты Jupyter для выполнения анализа внедрения.

На следующей диаграмме показана сквозная архитектура.

Полный пример кода доступен на GitHub. Предоставленный код доступен в двух разных шаблонах:

- Пример полнофункционального приложения с интерфейсом Streamlit – Это обеспечивает комплексное приложение, включая пользовательский интерфейс с использованием Streamlit для захвата подсказок в сочетании с уровнем оркестрации RAG и использованием LangChain, работающего на Amazon Elastic Контейнерный Сервис (Amazon ECS) с АМС Фаргейт

- Серверное приложение – Для тех, кто не хочет развертывать полный стек приложений, вы можете при желании выбрать только развертывание серверной части. Комплект для разработки облачных сервисов AWS (AWS CDK), а затем используйте предоставленный блокнот Jupyter для оркестровки RAG с помощью LangChain.

Для создания предоставленных шаблонов необходимо выполнить несколько предварительных условий, подробно описанных в следующих разделах, начиная с развертывания генеративных моделей и моделей внедрения текста, а затем переходя к дополнительным предварительным требованиям.

Развертывание моделей с помощью SageMaker JumpStart

Оба шаблона предполагают развертывание модели внедрения и генеративной модели. Для этого вы развернете две модели из SageMaker JumpStart. Первая модель, GPT-J 6B, используется в качестве модели внедрения, а вторая модель, Falcon-40b, используется для генерации текста.

Вы можете развернуть каждую из этих моделей с помощью SageMaker JumpStart из Консоль управления AWS, Студия Amazon SageMakerили программно. Для получения дополнительной информации см. Как использовать модели фундамента JumpStart. Чтобы упростить развертывание, вы можете использовать предоставленный блокнот создан на основе блокнотов, автоматически созданных SageMaker JumpStart. Этот блокнот извлекает модели из концентратора SageMaker JumpStart ML и развертывает их на двух отдельных конечных точках SageMaker в режиме реального времени.

В образце блокнота также есть раздел очистки. Пока не запускайте этот раздел, поскольку он удалит только что развернутые конечные точки. Вы завершите очистку в конце прохождения.

После подтверждения успешного развертывания конечных точек вы готовы к развертыванию полного примера приложения. Однако если вас больше интересует изучение только серверной части и блокнотов анализа, вы можете при необходимости развернуть только их, что описано в следующем разделе.

Вариант 1. Разверните только серверное приложение.

Этот шаблон позволяет развертывать только серверное решение и взаимодействовать с ним с помощью блокнота Jupyter. Используйте этот шаблон, если вы не хотите создавать полный внешний интерфейс.

Предпосылки

У вас должны быть следующие предпосылки:

- Развернута конечная точка модели SageMaker JumpStart. – Разверните модели на конечных точках SageMaker в режиме реального времени с помощью SageMaker JumpStart, как описано ранее.

- Параметры развертывания – Запишите следующее:

- Имя конечной точки текстовой модели – Имя конечной точки модели генерации текста, развернутой с помощью SageMaker JumpStart.

- Имя конечной точки модели внедрения – Имя конечной точки модели внедрения, развернутой с помощью SageMaker JumpStart.

Разверните ресурсы с помощью AWS CDK.

Используйте параметры развертывания, указанные в предыдущем разделе, для развертывания стека AWS CDK. Дополнительную информацию об установке AWS CDK см. Начало работы с AWS CDK.

Убедитесь, что Docker установлен и запущен на рабочей станции, которая будет использоваться для развертывания AWS CDK. Ссылаться на Получить докер для дополнительных указаний.

Альтернативно вы можете ввести значения контекста в файл с именем cdk.context.json в pattern1-rag/cdk каталог и запустите cdk deploy BackendStack --exclusively.

При развертывании будут распечатаны выходные данные, некоторые из которых понадобятся для запуска ноутбука. Прежде чем приступить к вопросам и ответам, вставьте справочные документы, как показано в следующем разделе.

Встроить справочные документы

В рамках этого подхода RAG справочные документы сначала внедряются в модель внедрения текста и сохраняются в векторной базе данных. В этом решении был построен конвейер приема документов PDF.

An Эластичное вычислительное облако Amazon (Amazon EC2) был создан экземпляр PDF-документа и Эластичная файловая система Amazon Файловая система (Amazon EFS) монтируется на экземпляре EC2 для сохранения PDF-документов. Ан Синхронизация данных AWS Задача запускается каждый час для извлечения PDF-документов, найденных в пути к файловой системе EFS, и загрузки их в корзину S3 для запуска процесса встраивания текста. В ходе этого процесса справочные документы внедряются и сохраняются в службе OpenSearch. Он также сохраняет архив для внедрения в корзину S3 через Kinesis Data Firehose для последующего анализа.

Чтобы принять справочные документы, выполните следующие действия:

- Получите образец идентификатора созданного экземпляра EC2 (см. выходные данные AWS CDK).

JumpHostId) и подключитесь с помощью Диспетчер сеансов, способность Менеджер систем AWS. Инструкции см. Подключитесь к своему экземпляру Linux с помощью диспетчера сеансов AWS Systems Manager.. - Перейти в каталог

/mnt/efs/fs1, где смонтирована файловая система EFS, и создайте папку с именемingest: - Добавьте справочные PDF-документы в

ingestкаталог.

Задача DataSync настроена на загрузку всех файлов, найденных в этом каталоге, в Amazon S3 для запуска процесса внедрения.

Задача DataSync выполняется по почасовому расписанию; при желании вы можете запустить задачу вручную, чтобы немедленно начать процесс внедрения добавленных вами PDF-документов.

- Чтобы запустить задачу, найдите идентификатор задачи в выходных данных AWS CDK.

DataSyncTaskIDи начать задачу с настройками по умолчанию.

После создания вложений вы можете запустить вопросы RAG и ответы на них через блокнот Jupyter, как показано в следующем разделе.

Вопросы и ответы с использованием блокнота Jupyter

Выполните следующие шаги:

- Получите имя экземпляра блокнота SageMaker из выходных данных AWS CDK.

NotebookInstanceNameи подключитесь к JupyterLab из консоли SageMaker. - Перейти в каталог

fmops/full-stack/pattern1-rag/notebooks/. - Откройте и запустите блокнот

query-llm.ipynbв экземпляре записной книжки для выполнения вопросов и ответов с помощью RAG.

Обязательно используйте conda_python3 ядро для ноутбука.

Этот шаблон полезен для изучения серверного решения без необходимости предоставления дополнительных предварительных условий, необходимых для полнофункционального приложения. В следующем разделе рассматривается реализация полнофункционального приложения, включающего как внешние, так и внутренние компоненты, чтобы обеспечить пользовательский интерфейс для взаимодействия с вашим генеративным приложением ИИ.

Вариант 2. Развертывание полнофункционального примера приложения с помощью внешнего интерфейса Streamlit.

Этот шаблон позволяет развернуть решение с пользовательским интерфейсом для вопросов и ответов.

Предпосылки

Для развертывания примера приложения необходимы следующие предварительные условия:

- Конечная точка модели SageMaker JumpStart развернута – Разверните модели на своих конечных точках SageMaker в режиме реального времени с помощью SageMaker JumpStart, как описано в предыдущем разделе, используя предоставленные блокноты.

- Зона хостинга Amazon Route 53 - Создать Amazon Route 53 общедоступная зона хостинга использовать для этого решения. Вы также можете использовать существующую общедоступную зону Route 53, например

example.com. - Сертификат Менеджера сертификатов AWS – Предоставление Диспетчер сертификатов AWS (ACM) TLS-сертификат для доменного имени зоны размещения Route 53 и соответствующих поддоменов, таких как

example.comи*.example.comдля всех поддоменов. Инструкции см. Запрос публичного сертификата. Этот сертификат используется для настройки HTTPS на Amazon CloudFront и исходный балансировщик нагрузки. - Параметры развертывания – Запишите следующее:

- Имя личного домена внешнего приложения – Имя пользовательского домена, используемое для доступа к примерному интерфейсному приложению. Предоставленное доменное имя используется для создания DNS-записи Route 53, указывающей на внешний дистрибутив CloudFront; например,

app.example.com. - Имя собственного домена источника балансировщика нагрузки – Имя собственного домена, используемое в качестве источника балансировки нагрузки распределения CloudFront. Предоставленное доменное имя используется для создания DNS-записи Route 53, указывающей на исходный балансировщик нагрузки; например,

app-lb.example.com. - Идентификатор зоны хостинга Route 53 – Идентификатор размещенной зоны Route 53 для размещения предоставленных пользовательских доменных имен; например,

ZXXXXXXXXYYYYYYYYY. - Имя зоны хостинга Route 53 – Имя зоны хостинга Route 53 для размещения предоставленных пользовательских доменных имен; например,

example.com. - Сертификат ACM ARN – ARN сертификата ACM, который будет использоваться с предоставленным пользовательским доменом.

- Имя конечной точки текстовой модели – Имя конечной точки модели генерации текста, развернутой с помощью SageMaker JumpStart.

- Имя конечной точки модели внедрения – Имя конечной точки модели внедрения, развернутой с помощью SageMaker JumpStart.

- Имя личного домена внешнего приложения – Имя пользовательского домена, используемое для доступа к примерному интерфейсному приложению. Предоставленное доменное имя используется для создания DNS-записи Route 53, указывающей на внешний дистрибутив CloudFront; например,

Разверните ресурсы с помощью AWS CDK.

Используйте параметры развертывания, указанные в предварительных требованиях, для развертывания стека AWS CDK. Для получения дополнительной информации см. Начало работы с AWS CDK.

Убедитесь, что Docker установлен и запущен на рабочей станции, которая будет использоваться для развертывания AWS CDK.

В предыдущем коде -c представляет значение контекста в форме обязательных предварительных условий, предоставляемых на входе. Альтернативно вы можете ввести значения контекста в файл с именем cdk.context.json в pattern1-rag/cdk каталог и запустите cdk deploy --all.

Обратите внимание, что мы указываем регион в файле bin/cdk.ts. Для настройки журналов доступа ALB требуется указанный регион. Вы можете изменить этот регион перед развертыванием.

При развертывании будет распечатан URL-адрес для доступа к приложению Streamlit. Прежде чем вы сможете начать задавать вопросы и отвечать, вам необходимо встроить справочные документы, как показано в следующем разделе.

Вставить справочные документы

При использовании подхода RAG справочные документы сначала внедряются в модель внедрения текста и сохраняются в векторной базе данных. В этом решении был построен конвейер приема документов PDF.

Как мы обсуждали в первом варианте развертывания, для приема PDF-документов был создан пример экземпляра EC2, а на экземпляре EC2 смонтирована файловая система EFS для сохранения PDF-документов. Задача DataSync запускается каждый час для извлечения PDF-документов, найденных в пути к файловой системе EFS, и загрузки их в корзину S3 для запуска процесса встраивания текста. В ходе этого процесса справочные документы внедряются и сохраняются в службе OpenSearch. Он также сохраняет архив для внедрения в корзину S3 через Kinesis Data Firehose для последующего анализа.

Чтобы принять справочные документы, выполните следующие действия:

- Получите образец идентификатора созданного экземпляра EC2 (см. выходные данные AWS CDK).

JumpHostId) и подключитесь с помощью диспетчера сеансов. - Перейти в каталог

/mnt/efs/fs1, где смонтирована файловая система EFS, и создайте папку с именемingest: - Добавьте справочные PDF-документы в

ingestкаталог.

Задача DataSync настроена на загрузку всех файлов, найденных в этом каталоге, в Amazon S3 для запуска процесса внедрения.

Задача DataSync выполняется по почасовому расписанию. При желании вы можете запустить задачу вручную, чтобы немедленно начать процесс внедрения добавленных вами PDF-документов.

- Чтобы запустить задачу, найдите идентификатор задачи в выходных данных AWS CDK.

DataSyncTaskIDи начать задачу с настройками по умолчанию.

Вопрос и ответ

После внедрения справочных документов вы можете начать задавать вопросы и ответы RAG, посетив URL-адрес для доступа к приложению Streamlit. Ан Амазон Когнито используется уровень аутентификации, поэтому для первого доступа к приложению требуется создать учетную запись пользователя в пуле пользователей Amazon Cognito, развернутом через AWS CDK (см. выходные данные AWS CDK для имени пула пользователей). Инструкции по созданию пользователя Amazon Cognito см. Создание нового пользователя в Консоли управления AWS.

Встроить анализ дрейфа

В этом разделе мы покажем вам, как выполнить анализ смещения, сначала создав базовую линию внедрений справочных данных и внедрений подсказок, а затем создав моментальный снимок внедрений с течением времени. Это позволяет сравнивать базовые внедрения с внедрениями моментальных снимков.

Создайте базовую линию внедрения для справочных данных и подскажите

Чтобы создать базовый план для внедрения справочных данных, откройте консоль AWS Glue и выберите задание ETL. embedding-drift-analysis. Установите параметры задания ETL следующим образом и запустите задание:

- Поставьте

--job_typeвBASELINE. - Поставьте

--out_tableдо Amazon DynamoDB таблица для справочных данных о встраивании. (См. выходные данные AWS CDK.DriftTableReferenceдля имени таблицы.) - Поставьте

--centroid_tableв таблицу DynamoDB для получения справочных данных центроида. (См. выходные данные AWS CDK.CentroidTableReferenceдля имени таблицы.) - Поставьте

--data_pathв корзину S3 с приставкой; например,s3:///embeddingarchive/. (См. выходные данные AWS CDK.BucketNameдля имени сегмента.)

Аналогично, используя задание ETL embedding-drift-analysis, создайте базовую линию внедрения подсказок. Установите параметры задания ETL следующим образом и запустите задание:

- Поставьте

--job_typeвBASELINE - Поставьте

--out_tableв таблицу DynamoDB для быстрого внедрения данных. (См. выходные данные AWS CDK.DriftTablePromptsNameдля имени таблицы.) - Поставьте

--centroid_tableв таблицу DynamoDB для получения подсказок по центроиду. (См. выходные данные AWS CDK.CentroidTablePromptsдля имени таблицы.) - Поставьте

--data_pathв корзину S3 с приставкой; например,s3:///promptarchive/. (См. выходные данные AWS CDK.BucketNameдля имени сегмента.)

Создайте моментальный снимок внедрения для справочных данных и подскажите

После приема дополнительной информации в службу OpenSearch запустите задание ETL. embedding-drift-analysis еще раз, чтобы сделать снимок внедрения ссылочных данных. Параметры будут такими же, как и в задании ETL, которое вы выполнили для создания базовой линии внедрения справочных данных, как показано в предыдущем разделе, за исключением установки --job_type параметр SNAPSHOT.

Аналогичным образом, чтобы сделать снимок внедрений подсказки, запустите задание ETL. embedding-drift-analysis снова. Параметры будут такими же, как и в задании ETL, которое вы запустили для создания базового плана внедрения для подсказок, как показано в предыдущем разделе, за исключением установки --job_type параметр SNAPSHOT.

Сравните базовый план со снимком

Чтобы сравнить базовую версию внедрения и снимок для получения справочных данных и подсказок, используйте предоставленный блокнот. pattern1-rag/notebooks/drift-analysis.ipynb.

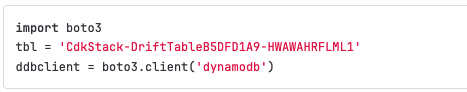

Чтобы просмотреть сравнение встраивания справочных данных или подсказок, измените переменные имени таблицы DynamoDB (tbl и c_tbl) в записной книжке в соответствующую таблицу DynamoDB для каждого запуска записной книжки.

Переменная блокнота tbl следует изменить на соответствующее имя таблицы дрейфа. Ниже приведен пример настройки переменной в записной книжке.

Имена таблиц можно получить следующим образом:

- Для эталонных данных внедрения извлеките имя таблицы смещения из выходных данных AWS CDK.

DriftTableReference - Для данных быстрого внедрения извлеките имя таблицы смещения из выходных данных AWS CDK.

DriftTablePromptsName

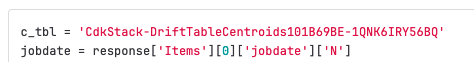

Кроме того, переменная блокнота c_tbl следует изменить на соответствующее имя таблицы центроидов. Ниже приведен пример настройки переменной в записной книжке.

Имена таблиц можно получить следующим образом:

- Для справочных данных внедрения извлеките имя таблицы центроидов из выходных данных AWS CDK.

CentroidTableReference - Для данных быстрого внедрения извлеките имя таблицы центроидов из выходных данных AWS CDK.

CentroidTablePrompts

Проанализируйте оперативное расстояние от справочных данных

Сначала запустите задание AWS Glue. embedding-distance-analysis. Это задание определит, к какому кластеру на основе оценки K-средних внедрений справочных данных относится каждое приглашение. Затем он вычисляет среднее, медиану и стандартное отклонение расстояния от каждого приглашения до центра соответствующего кластера.

Вы можете запустить блокнот pattern1-rag/notebooks/distance-analysis.ipynb чтобы увидеть тенденции в показателях расстояния с течением времени. Это даст вам представление об общей тенденции в распределении расстояний мгновенного внедрения.

Записная книжка pattern1-rag/notebooks/prompt-distance-outliers.ipynb — это блокнот AWS Glue, который ищет выбросы и помогает определить, получаете ли вы дополнительные запросы, не связанные со справочными данными.

Отслеживайте показатели сходства

Все оценки сходства из службы OpenSearch регистрируются. Amazon CloudWatch под rag пространство имен. Панель управления RAG_Scores показывает средний балл и общее количество принятых баллов.

Убирать

Чтобы избежать будущих расходов, удалите все созданные вами ресурсы.

Удалите развернутые модели SageMaker.

Обратитесь к разделу очистки предоставил пример блокнота удалить развернутые модели SageMaker JumpStart, или вы можете удалите модели на консоли SageMaker.

Удалите ресурсы AWS CDK.

Если вы ввели свои параметры в cdk.context.json файл, очистите следующим образом:

Если вы ввели параметры в командной строке и развернули только серверное приложение (бэкэнд-стек AWS CDK), выполните очистку следующим образом:

Если вы ввели параметры в командной строке и развернули полное решение (стеки AWS CDK для внешнего и внутреннего интерфейса), выполните очистку следующим образом:

Заключение

В этом посте мы представили рабочий пример приложения, которое фиксирует векторы внедрения как для справочных данных, так и для подсказок в шаблоне RAG для генеративного ИИ. Мы показали, как выполнить кластерный анализ, чтобы определить, меняются ли справочные данные или данные подсказок с течением времени, а также насколько хорошо справочные данные охватывают типы вопросов, которые задают пользователи. Если вы обнаружите дрейф, это может сигнализировать о том, что среда изменилась и ваша модель получает новые входные данные, для обработки которых она может быть не оптимизирована. Это позволяет заранее оценить текущую модель на предмет изменения входных данных.

Об авторах

Абдуллахи Олаойе — старший архитектор решений в Amazon Web Services (AWS). Абдуллахи получил степень магистра компьютерных сетей в Университете штата Уичито и является автором публикаций, занимавшим должности в различных областях технологий, таких как DevOps, модернизация инфраструктуры и искусственный интеллект. В настоящее время он занимается генеративным ИИ и играет ключевую роль в оказании помощи предприятиям в проектировании и создании передовых решений на базе генеративного ИИ. Помимо сферы технологий, он находит радость в искусстве исследования. Когда он не занимается разработкой решений на основе искусственного интеллекта, он любит путешествовать со своей семьей и исследовать новые места.

Абдуллахи Олаойе — старший архитектор решений в Amazon Web Services (AWS). Абдуллахи получил степень магистра компьютерных сетей в Университете штата Уичито и является автором публикаций, занимавшим должности в различных областях технологий, таких как DevOps, модернизация инфраструктуры и искусственный интеллект. В настоящее время он занимается генеративным ИИ и играет ключевую роль в оказании помощи предприятиям в проектировании и создании передовых решений на базе генеративного ИИ. Помимо сферы технологий, он находит радость в искусстве исследования. Когда он не занимается разработкой решений на основе искусственного интеллекта, он любит путешествовать со своей семьей и исследовать новые места.

Рэнди ДеФо является старшим главным архитектором решений в AWS. Он имеет степень MSEE Мичиганского университета, где работал над компьютерным зрением для автономных транспортных средств. Он также имеет степень магистра делового администрирования Университета штата Колорадо. Рэнди занимал различные должности в сфере технологий, от разработки программного обеспечения до управления продуктами. Вошел в пространство больших данных в 2013 году и продолжает исследовать эту область. Он активно работает над проектами в области машинного обучения и выступал на многочисленных конференциях, включая Strata и GlueCon.

Рэнди ДеФо является старшим главным архитектором решений в AWS. Он имеет степень MSEE Мичиганского университета, где работал над компьютерным зрением для автономных транспортных средств. Он также имеет степень магистра делового администрирования Университета штата Колорадо. Рэнди занимал различные должности в сфере технологий, от разработки программного обеспечения до управления продуктами. Вошел в пространство больших данных в 2013 году и продолжает исследовать эту область. Он активно работает над проектами в области машинного обучения и выступал на многочисленных конференциях, включая Strata и GlueCon.

Шелби Айгенброде является главным архитектором решений, специализирующимся на искусственном интеллекте и машинном обучении, в Amazon Web Services (AWS). Она занимается технологиями уже 24 года, работая в различных отраслях, технологиях и на разных должностях. В настоящее время она сосредоточена на объединении своего опыта DevOps и ML в области MLOps, чтобы помочь клиентам предоставлять и управлять рабочими нагрузками ML в масштабе. Имея более 35 патентов, выданных в различных областях технологий, она стремится к непрерывным инновациям и использованию данных для достижения результатов в бизнесе. Шелби — соавтор и преподаватель специализации «Практическая наука о данных» на Coursera. Она также является содиректором организации Women In Big Data (WiBD) в Денвере. В свободное время она любит проводить время со своей семьей, друзьями и гиперактивными собаками.

Шелби Айгенброде является главным архитектором решений, специализирующимся на искусственном интеллекте и машинном обучении, в Amazon Web Services (AWS). Она занимается технологиями уже 24 года, работая в различных отраслях, технологиях и на разных должностях. В настоящее время она сосредоточена на объединении своего опыта DevOps и ML в области MLOps, чтобы помочь клиентам предоставлять и управлять рабочими нагрузками ML в масштабе. Имея более 35 патентов, выданных в различных областях технологий, она стремится к непрерывным инновациям и использованию данных для достижения результатов в бизнесе. Шелби — соавтор и преподаватель специализации «Практическая наука о данных» на Coursera. Она также является содиректором организации Women In Big Data (WiBD) в Денвере. В свободное время она любит проводить время со своей семьей, друзьями и гиперактивными собаками.

- SEO-контент и PR-распределение. Получите усиление сегодня.

- PlatoData.Network Вертикальный генеративный ИИ. Расширьте возможности себя. Доступ здесь.

- ПлатонАйСтрим. Интеллект Web3. Расширение знаний. Доступ здесь.

- ПлатонЭСГ. Углерод, чистые технологии, Энергия, Окружающая среда, Солнечная, Управление отходами. Доступ здесь.

- ПлатонЗдоровье. Биотехнологии и клинические исследования. Доступ здесь.

- Источник: https://aws.amazon.com/blogs/machine-learning/monitor-embedding-drift-for-llms-deployed-from-amazon-sagemaker-jumpstart/

- :имеет

- :является

- :нет

- :куда

- $UP

- 1

- 10

- 100

- 2013

- 24

- 35%

- 39

- 7

- 9

- 95%

- a

- в состоянии

- О нас

- Absolute

- доступ

- Учетная запись

- ACM

- через

- активно

- добавленный

- дополнение

- дополнительный

- Дополнительная информация

- Дополнительно

- снова

- против

- совокупный

- AI

- Выравнивает

- Все

- Позволяющий

- позволяет

- причислены

- Несмотря на то, что

- Amazon

- Амазон Когнито

- Amazon EC2

- Создатель мудреца Амазонки

- Amazon SageMaker JumpStart

- Amazon Web Services

- Веб-службы Amazon (AWS)

- an

- анализ

- анализировать

- анализ

- и

- ответ

- ответ

- все

- отношение

- Применение

- подхода

- соответствующий

- архитектура

- архив

- МЫ

- ПЛОЩАДЬ

- области

- Искусство

- статьи

- AS

- спросить

- спрашивающий

- содействие

- предполагать

- At

- увеличивать

- дополненная

- Аутентификация

- автор

- автоматически

- автономный

- автономные транспортные средства

- доступен

- в среднем

- избежать

- прочь

- AWS

- Клей AWS

- Backend

- фон

- стабилизатор

- основанный

- Базовая линия

- BE

- , так как:

- было

- до

- не являетесь

- принадлежит

- Лучшая

- между

- Beyond

- большой

- Big Data

- органов

- изоферменты печени

- широко

- строить

- построенный

- бизнес

- by

- вычислять

- исчисляет

- призывают

- под названием

- CAN

- возможности

- захватить

- захваченный

- перехватывает

- Захват

- случаев

- CD

- Центр

- Центры

- сертификат

- изменение

- менялась

- изменения

- изменения

- Глава

- расходы

- чип

- Шоколад

- Выберите

- чистым

- Закрыть

- ближе

- облако

- Кластер

- кластеризации

- код

- Колорадо

- сочетание

- сочетании

- комбинируя

- приход

- компактный

- сравнить

- сравненный

- сравнение

- полный

- компонент

- компоненты

- Вычисление

- компьютер

- Компьютерное зрение

- понятия

- конференции

- настроить

- настройка

- Свяжитесь

- соображения

- Консоли

- Container

- содержание

- контекст

- продолжается

- (CIJ)

- переделанный

- печенье

- Основные

- соответствующий

- охват

- покрытый

- покрытие

- Обложки

- Создайте

- создали

- создает

- Создающий

- Текущий

- В настоящее время

- изготовленный на заказ

- Клиенты

- передовой

- приборная панель

- данным

- центров обработки данных

- обработка данных

- наука о данных

- База данных

- по умолчанию

- определенный

- доставить

- Денвер

- развертывание

- развернуть

- развертывание

- развертывание

- развертывает

- Производный

- уничтожить

- подробный

- обнаруживать

- обнаружение

- Определять

- Развитие

- отклонение

- диаграмма

- различный

- трудный

- Размеры

- размеры

- обсуждается

- рассеянный

- расстояние

- отдаленный

- распределение

- DNS

- do

- Docker

- документ

- Документация

- домен

- Имя домена

- ДОМЕННЫЕ ИМЕНА

- доменов

- Dont

- вниз

- управлять

- каждый

- вставлять

- встроенный

- вложения

- конец

- впритык

- Конечная точка

- Проект и

- Enter

- вошел

- предприятий

- Окружающая среда

- оценивать

- оценка

- Каждая

- пример

- Примеры

- исключение

- существующий

- экспериментальный

- Объяснять

- исследование

- Больше

- Исследование

- и, что лучший способ

- извлечение

- Экстракты

- семья

- далеко

- фигура

- Файл

- Файлы

- окончательный

- в заключение

- Найдите

- находит

- Во-первых,

- плавающий

- поток

- внимание

- фокусировка

- после

- следующим образом

- Что касается

- форма

- найденный

- Год основания

- друзья

- от

- Frontend

- полный

- будущее

- собирать

- Общие

- порождающий

- поколение

- генеративный

- Генеративный ИИ

- получить

- получающий

- Дайте

- Go

- ушел

- предоставленный

- группы

- руководство

- обрабатывать

- Есть

- he

- Герой

- помощь

- ее

- высший

- его

- имеет

- кашель

- состоялся

- час

- Как

- How To

- Однако

- HTML

- HTTP

- HTTPS

- хаб

- ID

- определения

- if

- иллюстрирует

- немедленно

- реализация

- инвентарь

- важную

- in

- включают

- включает в себя

- В том числе

- Входящий

- указывать

- промышленности

- инерция

- информация

- Инфраструктура

- начальный

- Инновации

- вход

- затраты

- понимание

- установка

- установлен

- пример

- инструкции

- взаимодействовать

- взаимодействующий

- интерактивный

- заинтересованный

- Интерфейс

- в

- IT

- ЕГО

- работа

- Джобс

- радость

- JPG

- всего

- Основные

- Пожарный шланг Kinesis Data

- знания

- язык

- большой

- новее

- последний

- слой

- УЧИТЬСЯ

- изучение

- Lets

- Библиотека

- нравится

- линия

- Linux

- LLM

- загрузка

- расположение

- Войти

- посмотреть

- ВЗГЛЯДЫ

- ниже

- машина

- обучение с помощью машины

- сделать

- управлять

- управление

- менеджер

- вручную

- Май..

- значить

- означает

- проводить измерение

- меры

- Метрика

- Мичиган

- может быть

- ML

- млн операций в секунду

- модель

- Модели

- монитор

- БОЛЕЕ

- самых

- перемещение

- с разными

- должен

- имя

- имена

- натуральный

- Обработка естественного языка

- Необходимость

- необходимый

- нуждающихся

- сетей

- Новые

- более новый

- следующий

- НЛП

- ноутбук

- отметил,

- номер

- номера

- многочисленный

- of

- .

- on

- только

- открытый

- оптимизированный

- Опция

- or

- оркестровка

- заказ

- происхождения

- Другое

- наши

- внешний

- Результаты

- изложенные

- выходной

- выходы

- за

- общий

- перекрытие

- собственный

- параметр

- параметры

- особый

- страсть

- Патенты

- путь

- шаблон

- паттеранами

- Выполнять

- выполнения

- штук

- трубопровод

- Мест

- Платон

- Платон Интеллектуальные данные

- ПлатонДанные

- играет

- Точка

- пунктов

- бассейн

- позиции

- возможное

- После

- потенциал

- Питание

- практическое

- предшествующий

- предпосылки

- представлены

- консервирование

- предыдущий

- предварительно

- Основной

- Печать / PDF

- Проактивная

- процесс

- обработка

- Продукт

- Управление продуктом

- проектов

- наводящие

- доля

- обеспечивать

- при условии

- приводит

- обеспечение

- что такое варган?

- опубликованный

- Тянет

- вопрос

- Вопросы

- тряпка

- диапазоны

- ранжирование

- готовый

- реального времени

- область

- рецепт

- запись

- уменьшить

- снижение

- относиться

- ссылка

- область

- Связанный

- относительно

- соответствующие

- представлять

- представление

- представляет

- обязательный

- требуется

- Полезные ресурсы

- ответ

- Итоги

- поиск

- Роли

- роли

- дорога

- Run

- Бег

- работает

- sagemaker

- то же

- Сохранить

- Шкала

- график

- Наука

- Гол

- Поиск

- поиск

- Во-вторых

- Раздел

- разделах

- посмотреть

- видел

- выберите

- семантический

- старший

- смысл

- послать

- отдельный

- обслуживание

- Услуги

- Сессия

- набор

- установка

- несколько

- она

- должен

- показывать

- показал

- показанный

- Шоу

- сигнал

- сигналы

- аналогичный

- просто

- упростить

- Размер

- Снимок

- So

- Software

- разработка программного обеспечения

- Решение

- Решения

- некоторые

- Источник

- Источники

- Space

- напряженность

- специалист

- указанный

- тратить

- В квадрате

- стек

- Стеки

- стандарт

- Начало

- и политические лидеры

- Начало

- Область

- статистика

- Шаги

- диск

- магазин

- хранить

- успешный

- такие

- Убедитесь

- система

- системы

- ТАБЛИЦЫ

- взять

- Сложность задачи

- техника

- технологии

- Технологии

- текст

- который

- Ассоциация

- информация

- Источник

- их

- Их

- тогда

- Там.

- Эти

- этой

- те

- три

- Через

- время

- в

- вместе

- Темы

- Всего

- Transform

- Путешествие

- тенденция

- Тенденции

- стараться

- два

- Типы

- под

- Университет

- URL

- us

- использование

- используемый

- полезный

- Информация о пользователе

- Пользовательский интерфейс

- пользователей

- через

- Проверка

- ценностное

- Наши ценности

- переменная

- разнообразие

- различный

- Транспорт

- с помощью

- видение

- визуальный

- прохождение

- хотеть

- законопроект

- Путь..

- we

- Web

- веб-сервисы

- ЧТО Ж

- когда

- будь то

- который

- в то время как

- будете

- в

- без

- Женщина

- Работа

- работавший

- работает

- рабочая станция

- хуже

- бы

- лет

- еще

- Ты

- ВАШЕ

- зефирнет

- зона