NVIDIA NIM mмикросервисы теперь интегрируемся с Создатель мудреца Амазонки, что позволяет развертывать ведущие в отрасли модели больших языков (LLM) и оптимизировать производительность и стоимость моделей. Вы можете развернуть самые современные LLM за считанные минуты, а не дни, используя такие технологии, как NVIDIA ТензорРТ, NVIDIA ТензорРТ-LLMи Сервер вывода NVIDIA Triton на инстансах с ускорением NVIDIA, размещенных на SageMaker.

НИМ, часть Корпоративный ИИ NVIDIA программная платформа, указанная на Торговая площадка AWS, представляет собой набор микросервисов вывода, которые привносят в ваши приложения мощь современных LLM, обеспечивая обработку естественного языка (NLP) и возможности понимания, независимо от того, разрабатываете ли вы чат-ботов, обобщаете документы или реализуете другие NLP-технологии. работающие приложения. Вы можете использовать готовые контейнеры NVIDIA для размещения популярных LLM, оптимизированных для конкретных графических процессоров NVIDIA для быстрого развертывания, или использовать инструменты NIM для создания собственных контейнеров.

В этом посте мы даем общее представление о NIM и показываем, как его можно использовать с SageMaker.

Введение в NVIDIA NIM

NIM предоставляет оптимизированные и предварительно созданные механизмы для множества популярных моделей для вывода. Эти микросервисы поддерживают различные LLM, такие как Llama 2 (7B, 13B и 70B), Mistral-7B-Instruct, Mixtral-8x7B, NVIDIA Nemotron-3 22B Persona и Code Llama 70B, «из коробки», используя предварительно установленные созданы механизмы NVIDIA TensorRT, адаптированные для конкретных графических процессоров NVIDIA для максимальной производительности и использования. Эти модели подобраны с оптимальными гиперпараметрами для обеспечения производительности размещения моделей и простоты развертывания приложений.

Если ваша модель не входит в набор курируемых моделей NVIDIA, NIM предлагает необходимые утилиты, такие как Model Repo Generator, который упрощает создание механизма с ускорением TensorRT-LLM и каталога модели в формате NIM с помощью простого файла YAML. Кроме того, интегрированная серверная часть vLLM сообщества обеспечивает поддержку передовых моделей и новых функций, которые, возможно, не были полностью интегрированы в стек, оптимизированный для TensorRT-LLM.

Помимо создания оптимизированных LLM для вывода, NIM предоставляет передовые технологии хостинга, такие как оптимизированные методы планирования, такие как пакетная обработка в реальном времени, которые могут разбить общий процесс генерации текста для LLM на несколько итераций модели. При пакетной обработке в реальном времени, вместо ожидания завершения всего пакета перед переходом к следующему набору запросов, среда выполнения NIM немедленно удаляет готовые последовательности из пакета. Затем среда выполнения начинает выполнять новые запросы, в то время как другие запросы все еще выполняются, что позволяет максимально эффективно использовать ваши вычислительные экземпляры и графические процессоры.

Развертывание NIM в SageMaker

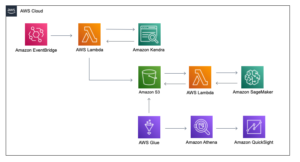

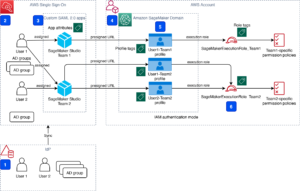

NIM интегрируется с SageMaker, что позволяет вам размещать ваши LLM с оптимизацией производительности и затрат, одновременно используя возможности SageMaker. При использовании NIM в SageMaker вы можете использовать такие возможности, как масштабирование количества экземпляров для размещения вашей модели, выполнение синего/зеленого развертывания и оценка рабочих нагрузок с помощью теневого тестирования — и все это с лучшими в своем классе возможностями наблюдения и мониторинга с помощью Amazon CloudWatch.

Заключение

Использование NIM для развертывания оптимизированных LLM может стать отличным вариантом как с точки зрения производительности, так и с точки зрения затрат. Это также помогает упростить развертывание LLM. В будущем NIM также позволит использовать методы тонкой настройки параметров (PEFT), такие как LoRA и P-настройка. NIM также планирует обеспечить поддержку LLM, поддерживая серверы Triton Inference Server, TensorRT-LLM и vLLM.

Мы рекомендуем вам узнать больше о микросервисах NVIDIA и о том, как развернуть ваши LLM с помощью SageMaker, а также опробовать доступные вам преимущества. NIM доступен в качестве платного предложения в рамках подписки на программное обеспечение NVIDIA AI Enterprise. доступно на AWS Marketplace.

В ближайшем будущем мы опубликуем подробное руководство по NIM в SageMaker.

Об авторах

Джеймс Парк работает архитектором решений в Amazon Web Services. Он работает с Amazon.com над проектированием, созданием и развертыванием технологических решений на AWS и проявляет особый интерес к искусственному интеллекту и машинному обучению. В свободное время ему нравится знакомиться с новыми культурами, получать новый опыт и быть в курсе последних технологических тенденций. Вы можете найти его на LinkedIn.

Джеймс Парк работает архитектором решений в Amazon Web Services. Он работает с Amazon.com над проектированием, созданием и развертыванием технологических решений на AWS и проявляет особый интерес к искусственному интеллекту и машинному обучению. В свободное время ему нравится знакомиться с новыми культурами, получать новый опыт и быть в курсе последних технологических тенденций. Вы можете найти его на LinkedIn.

Саураб Триканде является старшим менеджером по продуктам Amazon SageMaker Inference. Он увлечен работой с клиентами и мотивирован целью демократизации машинного обучения. Он фокусируется на основных проблемах, связанных с развертыванием сложных приложений машинного обучения, мультитенантных моделей машинного обучения, оптимизацией затрат и обеспечением более доступного развертывания моделей глубокого обучения. В свободное время Саураб любит ходить в походы, узнавать об инновационных технологиях, следить за TechCrunch и проводить время со своей семьей.

Саураб Триканде является старшим менеджером по продуктам Amazon SageMaker Inference. Он увлечен работой с клиентами и мотивирован целью демократизации машинного обучения. Он фокусируется на основных проблемах, связанных с развертыванием сложных приложений машинного обучения, мультитенантных моделей машинного обучения, оптимизацией затрат и обеспечением более доступного развертывания моделей глубокого обучения. В свободное время Саураб любит ходить в походы, узнавать об инновационных технологиях, следить за TechCrunch и проводить время со своей семьей.

Цин Лан является инженером-разработчиком программного обеспечения в AWS. Он работал над несколькими сложными продуктами в Amazon, включая высокопроизводительные решения для логического вывода машинного обучения и высокопроизводительную систему ведения журналов. Команда Цин успешно запустила первую модель с миллиардом параметров в Amazon Advertising с очень низкой задержкой. Цин обладает глубокими знаниями по оптимизации инфраструктуры и ускорению глубокого обучения.

Цин Лан является инженером-разработчиком программного обеспечения в AWS. Он работал над несколькими сложными продуктами в Amazon, включая высокопроизводительные решения для логического вывода машинного обучения и высокопроизводительную систему ведения журналов. Команда Цин успешно запустила первую модель с миллиардом параметров в Amazon Advertising с очень низкой задержкой. Цин обладает глубокими знаниями по оптимизации инфраструктуры и ускорению глубокого обучения.

Нихил Кулкарни — разработчик программного обеспечения с помощью AWS Machine Learning, который занимается повышением производительности рабочих нагрузок машинного обучения в облаке, а также является одним из создателей контейнеров AWS Deep Learning для обучения и логических выводов. Он увлечен распределенными системами глубокого обучения. Вне работы он любит читать книги, играть на гитаре и готовить пиццу.

Нихил Кулкарни — разработчик программного обеспечения с помощью AWS Machine Learning, который занимается повышением производительности рабочих нагрузок машинного обучения в облаке, а также является одним из создателей контейнеров AWS Deep Learning для обучения и логических выводов. Он увлечен распределенными системами глубокого обучения. Вне работы он любит читать книги, играть на гитаре и готовить пиццу.

Хариш Туммалачерла — инженер-программист в команде Deep Learning Performance в SageMaker. Он занимается разработкой производительности для эффективного обслуживания больших языковых моделей в SageMaker. В свободное время он любит бег, езду на велосипеде и лыжный альпинизм.

Хариш Туммалачерла — инженер-программист в команде Deep Learning Performance в SageMaker. Он занимается разработкой производительности для эффективного обслуживания больших языковых моделей в SageMaker. В свободное время он любит бег, езду на велосипеде и лыжный альпинизм.

Элиут Триана Исаза является менеджером по связям с разработчиками в NVIDIA, который помогает AI MLOps, DevOps, ученым и техническим экспертам AWS компании Amazon осваивать вычислительный стек NVIDIA для ускорения и оптимизации моделей Generative AI Foundation, включая курирование данных, обучение графических процессоров, вывод моделей и производственное развертывание на экземплярах графических процессоров AWS. . Кроме того, Элиут — страстный велосипедист, лыжник, теннисист и игрок в покер.

Элиут Триана Исаза является менеджером по связям с разработчиками в NVIDIA, который помогает AI MLOps, DevOps, ученым и техническим экспертам AWS компании Amazon осваивать вычислительный стек NVIDIA для ускорения и оптимизации моделей Generative AI Foundation, включая курирование данных, обучение графических процессоров, вывод моделей и производственное развертывание на экземплярах графических процессоров AWS. . Кроме того, Элиут — страстный велосипедист, лыжник, теннисист и игрок в покер.

Цзяхонг Лю является архитектором решений в команде поставщиков облачных услуг в NVIDIA. Он помогает клиентам внедрить решения для машинного обучения и искусственного интеллекта, которые используют ускоренные вычисления NVIDIA для решения их задач обучения и логических выводов. В свободное время он увлекается оригами, проектами «сделай сам» и играет в баскетбол.

Цзяхонг Лю является архитектором решений в команде поставщиков облачных услуг в NVIDIA. Он помогает клиентам внедрить решения для машинного обучения и искусственного интеллекта, которые используют ускоренные вычисления NVIDIA для решения их задач обучения и логических выводов. В свободное время он увлекается оригами, проектами «сделай сам» и играет в баскетбол.

Кшитиз Гупта является архитектором решений в NVIDIA. Ему нравится обучать клиентов облачных вычислений технологиям искусственного интеллекта на графических процессорах, которые NVIDIA может предложить, и помогать им в ускорении их приложений машинного и глубокого обучения. Вне работы он любит бегать, ходить в походы и наблюдать за дикой природой.

Кшитиз Гупта является архитектором решений в NVIDIA. Ему нравится обучать клиентов облачных вычислений технологиям искусственного интеллекта на графических процессорах, которые NVIDIA может предложить, и помогать им в ускорении их приложений машинного и глубокого обучения. Вне работы он любит бегать, ходить в походы и наблюдать за дикой природой.

- SEO-контент и PR-распределение. Получите усиление сегодня.

- PlatoData.Network Вертикальный генеративный ИИ. Расширьте возможности себя. Доступ здесь.

- ПлатонАйСтрим. Интеллект Web3. Расширение знаний. Доступ здесь.

- ПлатонЭСГ. Углерод, чистые технологии, Энергия, Окружающая среда, Солнечная, Управление отходами. Доступ здесь.

- ПлатонЗдоровье. Биотехнологии и клинические исследования. Доступ здесь.

- Источник: https://aws.amazon.com/blogs/machine-learning/optimize-price-performance-of-llm-inference-on-nvidia-gpus-using-the-amazon-sagemaker-integration-with-nvidia-nim-microservices/

- :имеет

- :является

- :нет

- $UP

- 100

- 121

- 7

- a

- О нас

- ускоренный

- ускоряющий

- ускорение

- доступной

- дополнение

- адрес

- Принятие

- продвинутый

- Реклама

- AI

- позволять

- Позволяющий

- причислены

- Amazon

- Создатель мудреца Амазонки

- Amazon Web Services

- Amazon.com

- an

- и

- Приложения

- МЫ

- AS

- содействие

- помогает

- At

- доступен

- AWS

- Машинное обучение AWS

- Backend

- бэкэнды

- Баскетбол

- дозирующий

- BE

- было

- до

- начинается

- пользу

- Преимущества

- ЛУЧШЕЕ

- Книги

- изоферменты печени

- Коробка

- Ломать

- приносить

- строить

- by

- CAN

- возможности

- проблемы

- сложные

- chatbots

- клиентов

- облако

- код

- COM

- сообщество

- комплекс

- Вычисление

- вычисление

- Контейнеры

- Основные

- Цена

- Создайте

- Создающий

- создание

- культуры

- Куратор

- курирование

- Клиенты

- настройка

- передовой

- данным

- Время

- Дней

- глубоко

- глубокое обучение

- Демократизация

- развертывание

- развертывание

- развертывание

- развертывания

- Проект

- Застройщик

- развивающийся

- Развитие

- каталог

- распределенный

- Сделай сам

- Документация

- вниз

- простота

- обучение

- эффективно

- легкий

- появление

- расширение прав и возможностей

- поощрять

- Двигатель

- инженер

- Проект и

- Двигатели

- Предприятие

- корпоративное программное обеспечение

- существенный

- оценки

- Впечатления

- эксперты

- облегчает

- семья

- Особенности

- Файл

- Найдите

- окончание

- First

- полет

- фокусируется

- фокусировка

- после

- Что касается

- Год основания

- от

- Более того

- будущее

- поколение

- генеративный

- Генеративный ИИ

- генератор

- цель

- GPU / ГРАФИЧЕСКИЙ ПРОЦЕССОР

- Графические процессоры

- большой

- инструкция

- Есть

- he

- помогает

- High

- на высшем уровне

- его

- его

- кашель

- состоялся

- хостинг

- Как

- How To

- HTTP

- HTTPS

- немедленно

- Осуществляющий

- in

- углубленный

- В том числе

- отрасли

- Инфраструктура

- инновационный

- инновационные технологии

- вместо

- интегрировать

- интегрированный

- Интегрируется

- интеграции.

- интерес

- в

- Введение

- IT

- итерации

- JPEG

- JPG

- знания

- язык

- большой

- Задержка

- последний

- запустили

- УЧИТЬСЯ

- изучение

- Кредитное плечо

- такое как

- Включенный в список

- Лама

- LLM

- каротаж

- Низкий

- машина

- обучение с помощью машины

- сделать

- Создание

- менеджер

- мастер

- максимальный

- Май..

- методы

- microservices

- Минут

- ML

- млн операций в секунду

- модель

- Модели

- Мониторинг

- БОЛЕЕ

- мотивированные

- гора

- перемещение

- с разными

- натуральный

- Обработка естественного языка

- Возле

- Новые

- следующий

- НЛП

- сейчас

- номер

- Nvidia

- of

- предлагают

- предлагающий

- Предложения

- on

- оптимальный

- оптимизация

- оптимизации

- Оптимизировать

- оптимизированный

- оптимизирующий

- Опция

- or

- Другое

- внешний

- внешнюю

- общий

- собственный

- выплачен

- часть

- особый

- страстный

- производительность

- выполнения

- пицца

- Планы

- Платформа

- Платон

- Платон Интеллектуальные данные

- ПлатонДанные

- игрок

- игры

- покер

- Популярное

- После

- мощностью

- процесс

- обработка

- Продукт

- Менеджер по продукции

- Производство

- Продукция

- проектов

- обеспечивать

- Недвижимости

- приводит

- обеспечение

- САЙТ

- скорее

- Reading

- Связанный

- отношения

- Запросы

- обязательный

- Бег

- время выполнения

- sagemaker

- Вывод SageMaker

- масштабирование

- планирование

- Ученые

- легко

- поиск

- старший

- сервер

- обслуживание

- Провайдер услуг

- Услуги

- выступающей

- набор

- несколько

- Shadow

- показывать

- Software

- разработка программного обеспечения

- Инженер-программист

- Решение

- Решения

- напряженность

- конкретный

- Расходы

- стек

- современное состояние

- пребывание

- По-прежнему

- простой

- подписка

- Успешно

- такие

- поддержка

- поддержки

- система

- системы

- с учетом

- команда

- TechCrunch

- Технический

- снижения вреда

- технологии

- Технологии

- теннис

- текст

- чем

- который

- Ассоциация

- Будущее

- их

- Их

- тогда

- Эти

- этой

- Через

- время

- в

- инструменты

- Обучение

- Тенденции

- Тритон

- стараться

- понимание

- использование

- через

- коммунальные услуги

- разнообразие

- очень

- Ожидание

- наблюдение

- we

- Web

- веб-сервисы

- когда

- будь то

- который

- в то время как

- все

- будете

- Работа

- работает

- работает

- YAML

- Ты

- ВАШЕ

- зефирнет