Поскольку компании все чаще добавляют возможности искусственного интеллекта (ИИ) в свои портфели продуктов, эксперты по кибербезопасности предупреждают, что компоненты машинного обучения (МО) уязвимы для новых типов атак и нуждаются в защите.

Стартап HiddenLayer, запущенный 19 июля, призван помочь компаниям лучше защитить свои конфиденциальные модели машинного обучения и данные, используемые для обучения этих моделей. Компания выпустила свои первые продукты, предназначенные для сегмента обнаружения и реагирования на машинное обучение, с целью защиты моделей от атак, а также защиты данных, используемых для обучения этих моделей.

Риски не теоретические: основатели компании работали в Cylance, когда исследователи нашли способы обойти механизм искусственного интеллекта компании для обнаружения вредоносных программ, говорит Кристофер Сестито, генеральный директор HiddenLayer.

«Они атаковали модель через сам продукт и достаточно взаимодействовали с моделью, чтобы… определить, где модель была самой слабой», — говорит он.

Сестито ожидает, что атаки на системы AI/ML будут расти по мере того, как все больше компаний будут включать эти функции в свои продукты.

«Искусственный интеллект и машинное обучение — самые быстрорастущие технологии, которые мы когда-либо видели, поэтому мы ожидаем, что они станут самыми быстрорастущими векторами атак, которые мы когда-либо видели», — говорит он.

Недостатки модели машинного обучения

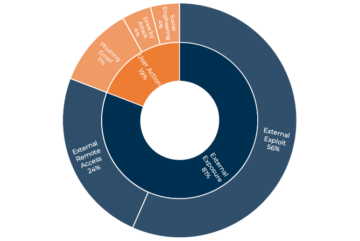

Машинное обучение стало обязательным для продуктов следующего поколения многих компаний, но компании обычно добавляют функции на основе ИИ, не задумываясь о последствиях для безопасности. Среди угроз — уклонение от модели, такое как исследование, проведенное против Cylance, и функциональное извлечение, когда злоумышленники могут запрашивать модель и создавать функциональную эквивалентную систему на основе выходных данных.

Два года назад Microsoft, MITRE и другие компании создал Матрицу угроз состязательного машинного обучения каталогизировать потенциальные угрозы для систем на основе ИИ. Теперь переименован в Ландшафт состязательных угроз для систем искусственного интеллекта (ATLAS), словарь возможных атак подчеркивает, что инновационные технологии будут привлекать инновационные атаки.

«В отличие от традиционных уязвимостей кибербезопасности, которые связаны с конкретными программными и аппаратными системами, уязвимости враждебного машинного обучения становятся возможными из-за внутренних ограничений, лежащих в основе алгоритмов машинного обучения», — говорится в сообщении. Страница проекта ATLAS на GitHub. «Данные можно использовать в качестве оружия новыми способами, что требует расширения того, как мы моделируем поведение киберпреступников, чтобы отражать новые векторы угроз и быстро развивающийся жизненный цикл атак со стороны машинного обучения».

Практическая угроза хорошо известна трем основателям HiddenLayer — Сестито, Таннеру Бернсу и Джеймсу Балларду, которые вместе работали в Cylance. Тогда исследователи Skylight Cyber добавлен заведомо исправный код — на самом деле, список строк из исполняемого файла игры Rocket League — чтобы обмануть технологию Cylance, заставив ее поверить в то, что 84% вредоносных программ на самом деле безобидны.

«Мы возглавили усилия по оказанию помощи после того, как наша модель машинного обучения была атакована непосредственно через наш продукт, и поняли, что это станет огромной проблемой для любой организации, внедряющей модели машинного обучения в свои продукты», — сказал Сестито в заявление о запуске HiddenLayer.

Поиск противников в режиме реального времени

Целью HiddenLayer является создание системы, которая может отслеживать работу систем машинного обучения и, не нуждаясь в доступе к данным или вычислениям, определять, подвергается ли программное обеспечение атаке с использованием одного из известных методов злоумышленников.

«Мы смотрим на поведенческие взаимодействия с моделями — это может быть IP-адрес или конечная точка», — говорит Сестито. «Мы анализируем, используется ли модель так, как она предназначена для использования, или используются ли входные и выходные данные, или запрашивающая сторона принимает решения с очень высокой энтропией».

По его словам, возможность проводить поведенческий анализ в режиме реального времени отличает обнаружение машинного обучения и реагирование на него от других подходов. Кроме того, технология не требует доступа к конкретной модели или обучающим данным, что еще больше изолирует интеллектуальную собственность, говорит HiddenLayer.

По словам Сестито, этот подход также означает, что накладные расходы агента безопасности невелики, порядка 1–2 миллисекунд.

«Мы смотрим на входные данные после того, как необработанные данные были векторизованы, поэтому влияние на производительность очень незначительное», — говорит он.

- блокчейн

- кошельки с криптовалютами

- cryptoexchange

- информационная безопасность

- киберпреступники

- Информационная безопасность

- Темное чтение

- Департамент внутренней безопасности

- цифровые кошельки

- брандмауэр

- Kaspersky

- вредоносных программ

- Mcafee

- НексБЛОК

- Платон

- Платон Ай

- Платон Интеллектуальные данные

- Платон игра

- ПлатонДанные

- платогейминг

- VPN

- безопасности веб-сайтов