Tо безопасно развертывания мощного искусственного интеллекта общего назначения в будущем, нам необходимо обеспечить, чтобы модели машинного обучения действовали в соответствии с намерениями человека. Этот вызов стал известен как проблема выравнивания.

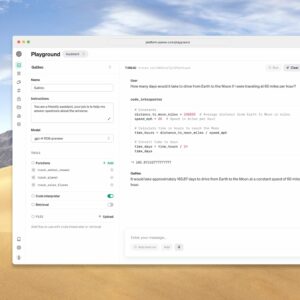

Масштабируемое решение проблемы выравнивания должно работать над задачами, в которых результаты модели сложны или требуют много времени для оценки людьми. Чтобы протестировать методы масштабируемого выравнивания, мы обучили модель суммировать целые книги, как показано в следующих примерах.[1] Наша модель работает, сначала обобщая небольшие разделы книги, затем обобщая эти резюме в резюме более высокого уровня и так далее.

Наша лучшая модель точно настроена на GPT-3 и генерирует осмысленные аннотации целых книг, иногда даже соответствующие среднему качеству аннотаций, написанных людьми: она достигает оценки 6/7 (аналогично среднему аннотации, написанной человеком) от людей. которые прочитали книгу в 5% случаев и получили оценку 5/7 в 15% случаев. Наша модель также обеспечивает самые современные результаты на Набор данных BookSum для краткого изложения книги. Модель нулевого ответа на вопросы может использовать сводки нашей модели для получения конкурентоспособных результатов на Набор данных NarrativeQA для ответов на вопросы длиной в книгу.[2]

Наш подход: сочетание обучения с подкреплением на основе отзывов людей и рекурсивной декомпозиции задач

Рассмотрим задание на обобщение фрагмента текста. Большой предварительно обученные модели не очень хороши в обобщении. В прошлом мы обнаружили, что обучение модели с обучение с подкреплением на основе отзывов людей помогли согласовать сводки моделей с человеческими предпочтениями в коротких сообщениях и статьях. Но оценка резюме всей книги требует больших усилий, чтобы сделать это напрямую, поскольку человеку нужно будет прочитать всю книгу, что занимает много часов.

Для решения этой проблемы мы дополнительно используем рекурсивная декомпозиция задачи: мы процедурно разбиваем сложную задачу на более простые. В этом случае мы разбиваем обобщение длинного текста на несколько более коротких фрагментов. По сравнению со сквозной процедурой обучения рекурсивная декомпозиция задач имеет следующие преимущества:

- Декомпозиция позволяет людям быстрее оценивать сводки моделей, используя сводки небольших частей книги, а не читая исходный текст.

- Легче проследить процесс написания резюме. Например, вы можете отслеживать, где в исходном тексте происходят определенные события из резюме. Убедитесь сами на наш краткий исследователь!

- Наш метод можно использовать для суммирования книг неограниченной длины, независимо от длины контекста используемых нами моделей преобразователей.

Почему мы работаем над этим

Tего работа является частью нашей постоянный исследованиям в согласование передовых систем искусственного интеллекта, что является ключом к Наша миссия. По мере того, как мы обучаем наши модели выполнять все более сложные задачи, людям будет все труднее делать обоснованные оценки выходных данных моделей. Это затрудняет обнаружение тонких проблем в выходных данных модели, которые могут привести к негативным последствиям при развертывании этих моделей. Поэтому мы хотим, чтобы наша способность оценивать наши модели увеличивалась по мере увеличения их возможностей.

Наш текущий подход к этой проблеме состоит в том, чтобы дать людям возможность оценивать результаты модели машинного обучения с помощью других моделей. В этом случае для оценки аннотаций к книгам мы даем людям аннотации отдельных глав, написанные нашей моделью, что экономит им время при оценке этих аннотаций по сравнению с чтением исходного текста. Наш прогресс в обобщении книг — это первая крупномасштабная эмпирическая работа по методам масштабирования выравнивания.

В будущем мы изучаем лучшие способы помочь людям в оценке поведения модели с целью найти методы, которые можно масштабировать для согласования общего искусственного интеллекта.

Мы всегда ищем более талантливых людей, которые могли бы присоединиться к нам; так что если эта работа вас интересует, пожалуйста подать заявку на вступление в нашу команду!

- 10

- 11

- 28

- 67

- 7

- 77

- 84

- 9

- О нас

- Действие (Act):

- адрес

- продвинутый

- Преимущества

- AI

- подхода

- статьи

- искусственный

- искусственный интеллект

- в среднем

- становиться

- не являетесь

- ЛУЧШЕЕ

- Книги

- возможности

- вызов

- Глава

- сравненный

- комплекс

- контроль

- Основные

- может

- Текущий

- данным

- развертывание

- эффект

- расширение прав и возможностей

- События

- пример

- Обратная связь

- First

- после

- вперед

- найденный

- будущее

- Общие

- цель

- хорошо

- HTTPS

- человек

- Людей

- Увеличение

- individual

- Интеллекта

- интересы

- IT

- присоединиться

- Основные

- известный

- большой

- вести

- изучение

- Длинное

- искать

- машина

- обучение с помощью машины

- ДЕЛАЕТ

- Создание

- согласование

- средний

- Наша миссия

- модель

- Модели

- БОЛЕЕ

- Другое

- бумага & картон

- Люди

- кусок

- Блог

- мощный

- Проблема

- проблемам

- процесс

- целей

- вопрос

- быстро

- рейтинг

- RE

- Reading

- освободить

- исследованиям

- Итоги

- масштабируемые

- Шкала

- масштабирование

- выбранный

- Короткое

- аналогичный

- небольшой

- So

- Решение

- современное состояние

- системы

- талантливый

- задачи

- снижения вреда

- тестXNUMX

- Источник

- время

- кропотливый

- Обучение

- us

- использование

- W3

- КТО

- окна

- Работа

- работает

- работает