Да… Я говорю о приложениях ИИ — о наших бесчисленных приложениях ИИ и будущих приложениях, которые шепчут людям о том, что делать…. как это сделать… но не о шептунах, которые взаимодействуют с чат-ботами ИИ.

По IDC Согласно прогнозам, к 500 году мировой рынок ИИ может превысить 2024 миллиардов долларов США, что на 50% больше, чем в 2021 году. Это указывает на то, что мы перешли от бизнес-экспериментов к признанию того, что это неотъемлемая часть корпоративной стратегии любого размера. Это необходимый инструмент для превращения данных в идеи, чтобы стимулировать действия, основанные на лучших решениях. Никто не обсуждает преимущества ИИ для снижения бизнес-рисков и повышения рентабельности инвестиций за счет инноваций. Но, как всегда, есть… НО… о беспристрастном ИИ легче сказать, чем сделать.

Критически важные для бизнеса модели ИИ должны работать надежно, с прозрачностью и подотчетностью. В противном случае сбой в данном случае будет иметь ужасные последствия, которые повлияют на денежный поток любой компании и могут даже привести к юридическим разбирательствам. Единственный способ избежать этого — автоматизация и прозрачность для ответа на один вопрос: «Можете ли вы доказать, что это приложение/рабочая нагрузка ИИ построены с соблюдением этических норм». Ака… как вы управляете? И можете ли вы доказать, что им постоянно управляют?

Здесь любят компании IBM вложили средства в управление ИИ, чтобы организовать общий процесс руководства, управления и мониторинга деятельности ИИ в организации. Основная задача состоит в том, чтобы все бизнес-подразделения оставались активными и внедряли структуру управления в инициативы, чтобы усилить способность соответствовать этическим принципам и нормам. В частности, регулируемые отрасли, такие как банковские и финансовые услуги, по закону обязаны предоставлять доказательства для удовлетворения регулирующих органов.

Влияние ИИ в секторе финансовых услуг растет в геометрической прогрессии из-за огромного давления цифровой трансформации. Как говорится, легче сказать, чем сделать, потому что:

1. Уверенно внедряйте приложения ИИ:

В некоторых случаях модели строятся без четкости и каталогизации; Излишне говорить, что мониторинг ускользает от всего, чтобы отслеживать сквозной жизненный цикл. В то время как банки борются с устаревшими приложениями, автоматизация процессов для обеспечения прозрачности и объяснимости стала сложнее и, в свою очередь, превратилась в черный ящик. Никто не знает, почему/как были приняты решения. Новые приложения, переплетенные с устаревшими приложениями, никогда не увидят свет, хотя с ними связана огромная рентабельность инвестиций из-за качества и незамеченных рисков.

Это подводит нас ко второму пункту — управлению репутационным риском.

2. Управляйте репутационным риском вместе с общим риском

я спрашивал #chatGPT и #Бард - кто такая Падма Чукка. #ЧатGPT отказался отвечать, даже если я несколько раз изменил вопрос. Тем не менее, Бард дал мне подробный ответ, в том числе мой профиль в LinkedIn… но данные взяты с разных сайтов, где мой старый профиль все еще существует как часть биографии спикера. С этого момента я еще не открыл Барда. Это быстро меня отключило, иначе - риск для репутации. Предположим, я могу отключить простого чат-бота, когда пойму, что данные могут быть противоречивыми. Как я мог не убедиться, прежде чем принять решение о покупке приложения с искусственным интеллектом для ведения критически важного бизнеса? Репутационный риск — важный фактор, о котором компании иногда забывают. Если вы измерите репутационный риск, можно увидеть огромное влияние на бизнес, если вы не будете проявлять инициативу.

Чтобы добавить сложности, третья…

3. Как компания может отреагировать на изменение правил ИИ?

Чтобы избежать репутационного риска, успешная и ответственная команда искусственного интеллекта должна быть в курсе всех местных и глобальных нормативных актов, мгновенно отключаясь, как тик-так. И несоблюдение может в конечном итоге стоить организации штрафов в миллионы долларов, таких как предлагаемый Закон ЕС об искусственном интеллекте. Это может быть до 30 миллионов евро или 6% от глобального дохода компании — OUCH.

Что ж, не все должно быть радужно с самого начала… если мы знаем, как превратить страшную ситуацию в радужную.

Неудивительно… это всегда люди, процессы и технологии. Итак, во-первых, создайте многофункциональный руководящий орган для обучения, руководства и мониторинга инициатив, основанных на целях. Затем сравните текущие технологии и процессы искусственного интеллекта, выявите пробелы, а затем устраните проблемы для будущего. Затем вернитесь к набору автоматизированных рабочих процессов управления в соответствии с требованиями соответствия. Наконец, настройте систему мониторинга, чтобы оповещать владельцев, если приближается приемлемый порог. С технологической точки зрения хорошо спроектированный, хорошо выполненный и хорошо связанный ИИ требует нескольких строительных блоков. И убедитесь, что у него есть некоторые или все возможности:

· Целостность данных в различных развертываниях

· Используйте открытые, гибкие существующие инструменты, соответствующие принципам управления ИИ.

· Обязательно предлагайте доступ к самообслуживанию с элементами управления конфиденциальностью — способ отслеживать

· Дизайн с учетом автоматизации и управления ИИ

· Может подключаться и настраиваться для нескольких заинтересованных сторон с помощью настраиваемого рабочего процесса.

Как только мы превратим приложение из страшного в Рози… тогда следующий вопрос — как вы докажете…

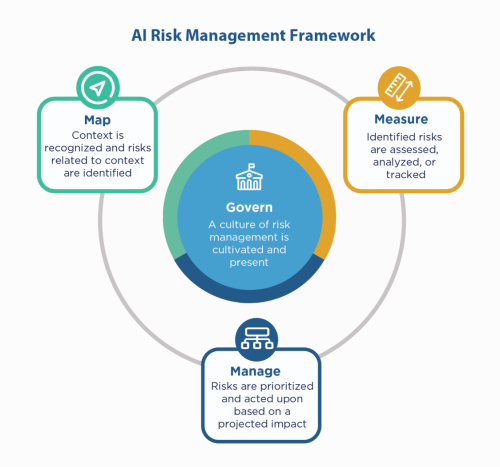

Во-первых, вернитесь к принципам искусственного интеллекта компании — используйте их, но вам все равно нужно «показать», что вы соответствуете требованиям, особенно в регулируемых средах, таких как финансовые услуги. Поскольку финансовые службы должны предъявлять претензии в соответствии с NIST 800-53, они могут NIST AI Risk Management Framework (AI RMF). NIST предложил элементы управления в четырех семействах — Governance, Map, Measure и Manage. Используя это в качестве ориентира, проведите стресс-тестирование приложений, чтобы выявить пробелы, которые необходимо исправить и отследить.

IBM может проверить ваши модели до того, как вы запустите их в производство, а также может контролировать справедливость, качество и дрейф. Он также может предоставить документацию, объясняющую поведение модели и прогнозы для удовлетворения требований регулирующих органов и аудиторов. Эти пояснения могут обеспечить наглядность и облегчить аудиторскую боль, а также повысить прозрачность и способность определять возможные риски.

Слушайте этот шепот ИИ с уверенностью!

#Финансовые услуги #ответственныйай #этикалай #НИСТАРМФ

- SEO-контент и PR-распределение. Получите усиление сегодня.

- Платоблокчейн. Интеллект метавселенной Web3. Расширение знаний. Доступ здесь.

- Чеканка будущего с Эдриенн Эшли. Доступ здесь.

- Источник: https://www.finextra.com/blogposting/24053/the-costly-consequences-of-unethical-ai-whisperer?utm_medium=rssfinextra&utm_source=finextrablogs

- :является

- $UP

- 2021

- 2024

- 7

- a

- способность

- О нас

- приемлемый

- доступ

- отчетность

- через

- Действие (Act):

- Действие

- активно

- придерживаться

- AI

- Закон об ИИ

- Управление ИИ

- ака

- Оповещение

- Все

- всегда

- и

- ответ

- приложение

- Применение

- Приложения

- Программы

- МЫ

- около

- AS

- связанный

- At

- аудит

- Аудиторы

- Автоматизированный

- Автоматизация

- автоматизация

- назад

- Банковское дело

- Банки

- основанный

- BE

- , так как:

- до

- не являетесь

- эталонный тест

- Преимущества

- Лучшая

- миллиард

- Черный

- Блоки

- тело

- Коробка

- Приносит

- строить

- Строительство

- построенный

- бизнес

- купить

- by

- CAN

- возможности

- случаев

- случаев

- Наличный расчёт

- денежный поток

- изменения

- Chatbot

- chatbots

- ясность

- закрытие

- Компании

- Компания

- сложность

- Соответствие закону

- уступчивый

- Проводить

- уверенно

- Свяжитесь

- Последствия

- непрерывно

- контрольная

- Цена

- может

- Создайте

- критической

- Текущий

- настраиваемый

- цикл

- данным

- дискуссионный

- Решение

- решения

- снижение

- Проект

- подробный

- Определять

- Интернет

- цифровое преобразование

- страшный

- направлять

- руководство

- Разное

- документации

- долларов

- Опустившись

- легче

- воспитывать

- впритык

- обеспечивать

- Предприятие

- средах

- особенно

- существенный

- этический

- EU

- Евро

- Даже

- Каждая

- многое

- , поскольку большинство сенаторов

- существующий

- существует

- объясняя

- экспоненциально

- Ошибка

- справедливость

- Осень

- семей

- в заключение

- финансовый

- финансовые услуги

- конец

- Finextra

- Во-первых,

- гибкого

- поток

- Что касается

- Рамки

- от

- от 2021

- будущее

- Дайте

- Глобальный

- управление

- Рост

- Есть

- Как

- How To

- HTTPS

- огромный

- Людей

- i

- определения

- Влияние

- in

- В том числе

- Увеличение

- указывает

- промышленности

- повлиять

- инициативы

- Инновации

- размышления

- рефлексологии

- целостность

- взаимодействовать

- инвестиций

- IT

- ЕГО

- работа

- Знать

- Наследие

- Юр. Информация

- юридические вопросы

- ЖИЗНЬЮ

- такое как

- линия

- локальным

- Длинное

- посмотреть

- сделанный

- сделать

- управлять

- управление

- управления

- карта

- рынок

- Вопросы

- Май..

- проводить измерение

- Встречайте

- может быть

- миллиона

- миллионы

- модель

- Модели

- момент

- монитор

- контролируемый

- Мониторинг

- БОЛЕЕ

- с разными

- необходимо

- Необходимость

- Излишне

- Новые

- следующий

- NIST

- целей

- of

- предлагают

- Старый

- on

- ONE

- открытый

- работать

- организация

- в противном случае

- общий

- Владельцы

- боль

- часть

- Люди

- Платон

- Платон Интеллектуальные данные

- ПлатонДанные

- Точка

- возможное

- Predictions

- давление

- первичный

- Принципы

- политикой конфиденциальности.

- Проактивная

- процесс

- Процессы

- Производство

- Профиль

- доказательство

- предложило

- Доказывать

- обеспечивать

- положил

- вопрос

- быстро

- достигать

- реализовать

- регулируемых брокеров

- регулируемые отрасли

- "Регулирование"

- правила

- Регулирующие органы

- репутация

- обязательный

- Требования

- требуется

- Реагируйте

- ответственный

- результат

- доходы

- Снижение

- управление рисками

- рисках,

- ROI

- Розовый

- s

- Сказал

- Во-вторых

- сектор

- Самообслуживание

- Услуги

- набор

- должен

- показывать

- сторона

- просто

- с

- Сайтов

- ситуация

- Размеры

- So

- некоторые

- Искриться

- Динамик

- заинтересованных сторон

- оставаться

- По-прежнему

- Стратегия

- УКРЕПЛЯТЬ

- стресс

- Борющийся

- успешный

- система

- говорить

- команда

- Технологии

- тестXNUMX

- который

- Ассоциация

- Их

- Эти

- В третьих

- порог

- Через

- в

- инструментом

- инструменты

- трек

- трансформация

- Прозрачность

- огромный

- ОЧЕРЕДЬ

- Оказалось

- В конечном счете

- понимать

- единиц

- Предстоящие

- us

- использование

- VALIDATE

- различный

- Видео

- видимость

- Путь..

- способы

- Что

- в то время как

- КТО

- без

- Работа

- Рабочие процессы

- Ты

- ВАШЕ

- зефирнет