В развивающейся сфере производства очевидна преобразующая сила искусственного интеллекта и машинного обучения (МО), которые способствуют цифровой революции, которая оптимизирует операции и повышает производительность. Однако этот прогресс создает уникальные проблемы для предприятий, использующих решения, основанные на данных. Промышленные предприятия сталкиваются с огромными объемами неструктурированных данных, получаемых от датчиков, систем телеметрии и оборудования, разбросанного по производственным линиям. Данные в реальном времени имеют решающее значение для таких приложений, как прогнозное обслуживание и обнаружение аномалий, однако разработка пользовательских моделей машинного обучения для каждого промышленного случая использования с такими данными временных рядов требует значительного времени и ресурсов от специалистов по обработке данных, что препятствует их широкому внедрению.

Генеративный ИИ используя большие предварительно обученные фундаментальные модели (FM), такие как Клод может быстро генерировать разнообразный контент, от диалогового текста до компьютерного кода, на основе простых текстовых подсказок, известных как подсказка с нулевым выстрелом. Это избавляет специалистов по обработке данных от необходимости вручную разрабатывать конкретные модели машинного обучения для каждого варианта использования и, следовательно, демократизирует доступ к искусственному интеллекту, принося выгоду даже мелким производителям. Рабочие повышают производительность благодаря аналитическим данным, генерируемым ИИ, инженеры могут заранее выявлять аномалии, менеджеры цепочки поставок оптимизируют запасы, а руководство предприятия принимает обоснованные решения на основе данных.

Тем не менее, автономные FM сталкиваются с ограничениями при обработке сложных промышленных данных с ограничениями по размеру контекста (обычно менее 200,000 XNUMX токенов), что создает проблемы. Чтобы решить эту проблему, вы можете использовать способность FM генерировать код в ответ на запросы на естественном языке (NLQ). Агентам нравится ПандаАИ вступают в игру, запуская этот код на данных временных рядов высокого разрешения и обрабатывая ошибки с помощью FM. PandasAI — это библиотека Python, которая добавляет возможности генеративного искусственного интеллекта в pandas, популярный инструмент анализа и манипулирования данными.

Однако сложные NLQ, такие как обработка данных временных рядов, многоуровневое агрегирование, а также операции сводных или объединенных таблиц, могут привести к нестабильной точности сценария Python с подсказкой с нулевым выстрелом.

Для повышения точности генерации кода мы предлагаем динамически строить подсказки для нескольких кадров для НЛК. Многократные подсказки обеспечивают дополнительный контекст для FM, показывая несколько примеров желаемых результатов для аналогичных подсказок, что повышает точность и последовательность. В этом посте многоэтапные подсказки извлекаются из внедрения, содержащего успешный код Python, выполненный с аналогичным типом данных (например, данные временных рядов высокого разрешения с устройств Интернета вещей). Динамически создаваемая многократная подсказка обеспечивает наиболее подходящий контекст для FM и расширяет возможности FM в сложных математических вычислениях, обработке данных временных рядов и понимании сокращений данных. Этот улучшенный ответ помогает работникам предприятия и операционным группам работать с данными и получать ценную информацию, не требуя обширных навыков в области науки о данных.

Помимо анализа данных временных рядов, FM оказываются полезными в различных промышленных приложениях. Бригады технического обслуживания оценивают состояние активов, делают снимки для Апостолсводные данные о функциях и анализ первопричин аномалий с использованием интеллектуального поиска с Извлечение дополненной генерации (ТРЯПКА). Чтобы упростить эти рабочие процессы, AWS представила Коренная порода Амазонки, что позволяет создавать и масштабировать генеративные приложения искусственного интеллекта с помощью современных предварительно обученных FM, таких как Клод v2. С Базы знаний для Amazon Bedrock, вы можете упростить процесс разработки RAG, чтобы обеспечить работникам предприятия более точный анализ первопричин аномалий. В нашей публикации представлен интеллектуальный помощник для промышленного использования на базе Amazon Bedrock, который решает проблемы NLQ, генерирует сводные данные о деталях на основе изображений и улучшает реакцию FM для диагностики оборудования с помощью подхода RAG.

Обзор решения

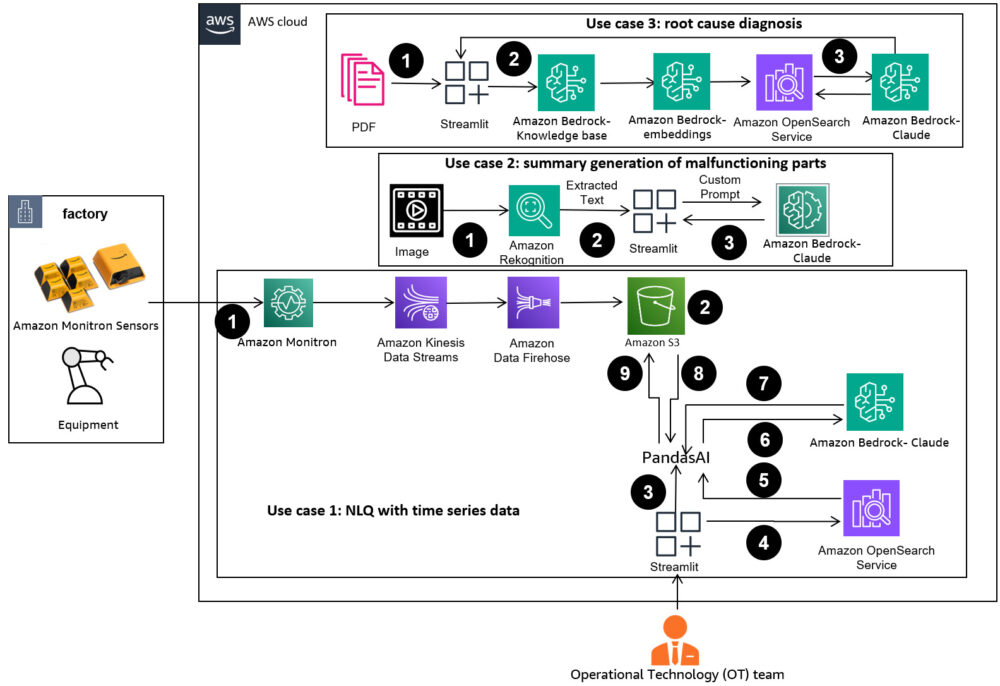

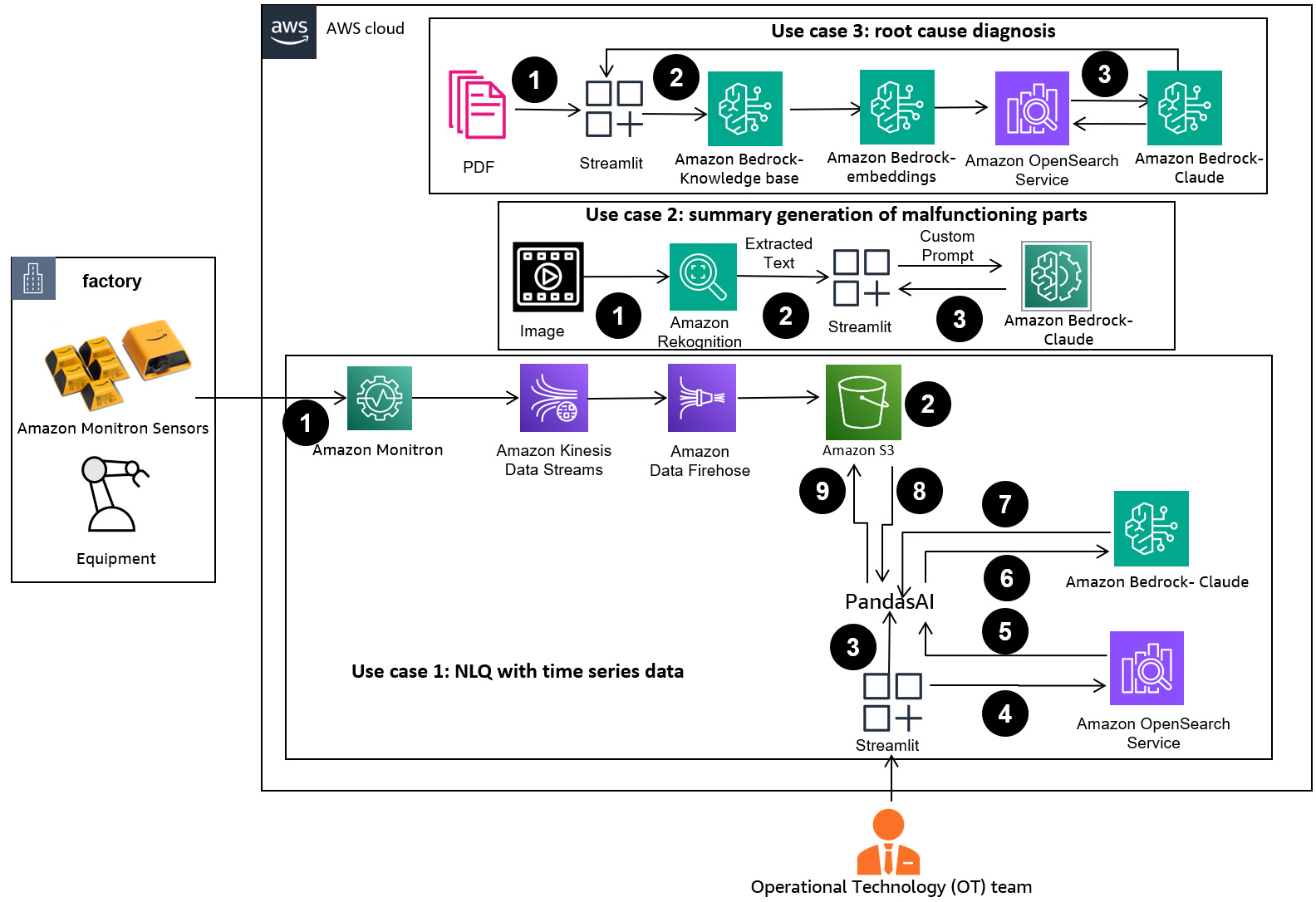

Следующая диаграмма иллюстрирует архитектуру решения.

Рабочий процесс включает в себя три различных варианта использования:

Вариант использования 1: NLQ с данными временных рядов

Рабочий процесс NLQ с данными временных рядов состоит из следующих шагов:

- Мы используем систему мониторинга состояния с возможностями машинного обучения для обнаружения аномалий, таких как Амазон Монитрон, для контроля состояния промышленного оборудования. Amazon Monitron способен обнаруживать потенциальные сбои оборудования на основе измерений вибрации и температуры оборудования.

- Мы собираем данные временных рядов путем обработки Амазон Монитрон данные через Потоки данных Amazon Kinesis и Пожарный шланг данных Amazon, преобразуя его в табличный формат CSV и сохраняя в Простой сервис хранения Amazon (Amazon S3) ведро.

- Конечный пользователь может начать общение со своими данными временных рядов в Amazon S3, отправив запрос на естественном языке в приложение Streamlit.

- Приложение Streamlit перенаправляет запросы пользователей на Модель встраивания текста Amazon Bedrock Titan для встраивания этого запроса и выполняет поиск по сходству внутри Сервис Amazon OpenSearch индекс, который содержит предыдущие NLQ и примеры кодов.

- После поиска по сходству в настраиваемую подсказку вставляются наиболее похожие примеры, включая вопросы NLQ, схему данных и коды Python.

- PandasAI отправляет это пользовательское приглашение в модель Amazon Bedrock Claude v2.

- Приложение использует агент PandasAI для взаимодействия с моделью Amazon Bedrock Claude v2, генерируя код Python для анализа данных Amazon Monitron и ответов NLQ.

- После того как модель Amazon Bedrock Claude v2 возвращает код Python, PandasAI запускает запрос Python к данным Amazon Monitron, загруженным из приложения, собирая выходные данные кода и обрабатывая все необходимые повторные попытки в случае неудачных запусков.

- Приложение Streamlit собирает ответы через PandasAI и предоставляет результаты пользователям. Если результат удовлетворительный, пользователь может пометить его как полезный, сохранив код Python, созданный NLQ и Claude, в службе OpenSearch.

Вариант использования 2. Сводная информация о неисправных деталях.

Наш вариант использования создания сводки состоит из следующих шагов:

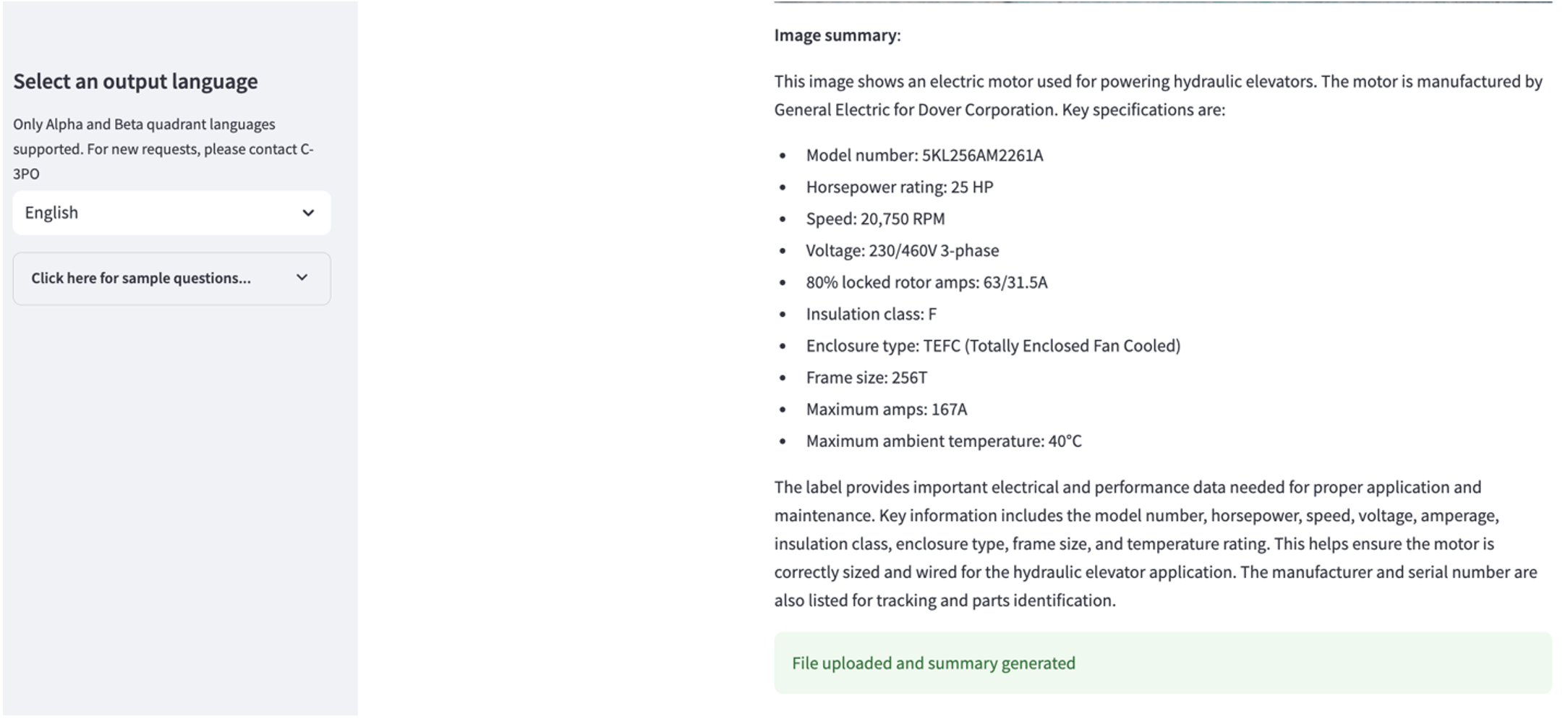

- После того, как пользователь узнает, какой промышленный объект демонстрирует аномальное поведение, он может загрузить изображения неисправной детали, чтобы определить, есть ли что-то физически неправильное с этой деталью в соответствии с ее техническими характеристиками и условиями эксплуатации.

- Пользователь может использовать API распознавания текста Amazon для извлечения текстовых данных из этих изображений.

- Извлеченные текстовые данные включаются в подсказку для модели Amazon Bedrock Claude v2, что позволяет модели генерировать краткое описание неисправной части объемом 200 слов. Пользователь может использовать эту информацию для выполнения дальнейшей проверки детали.

Вариант использования 3: Диагностика основной причины

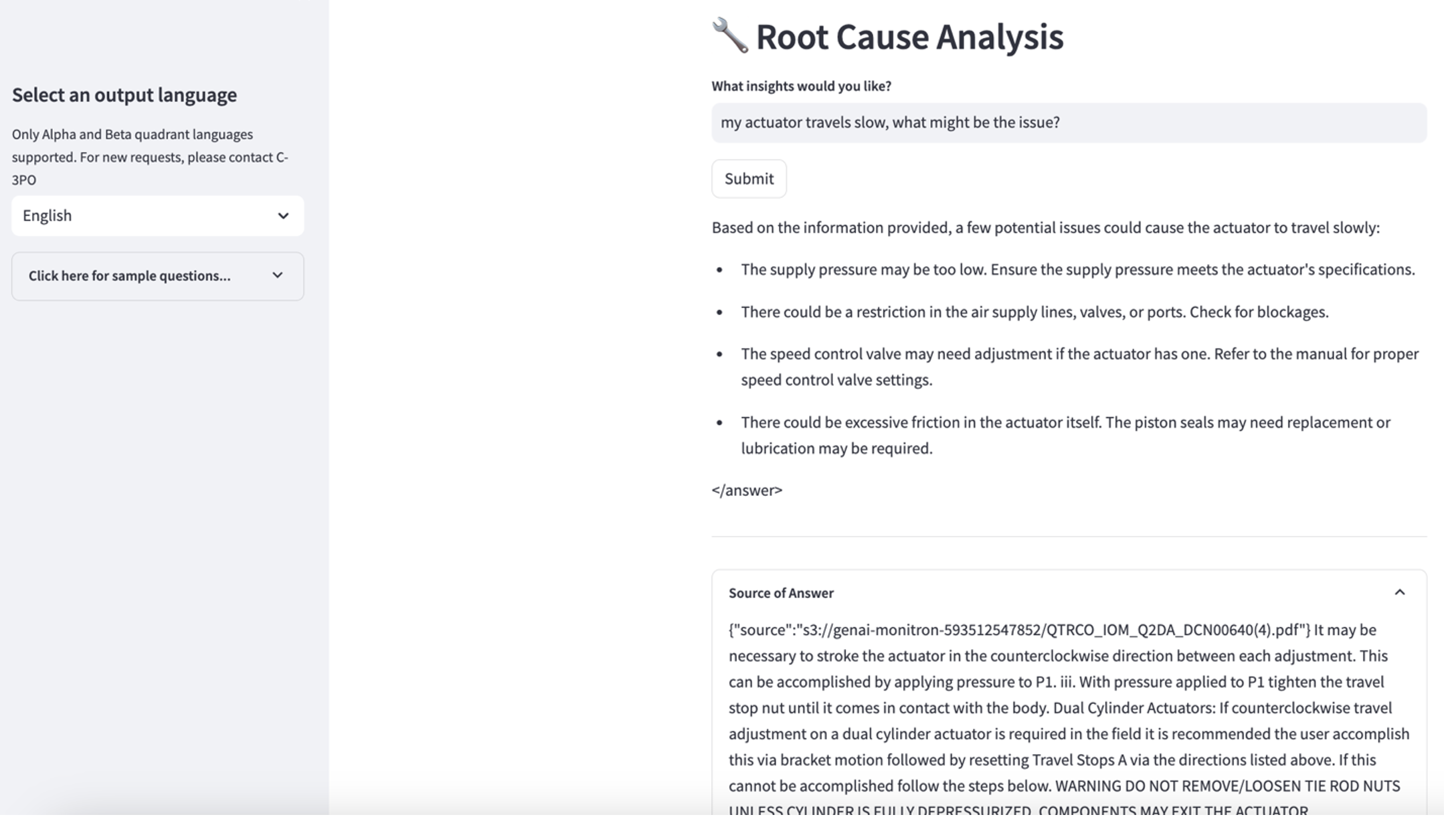

Наш вариант использования диагностики первопричины состоит из следующих шагов:

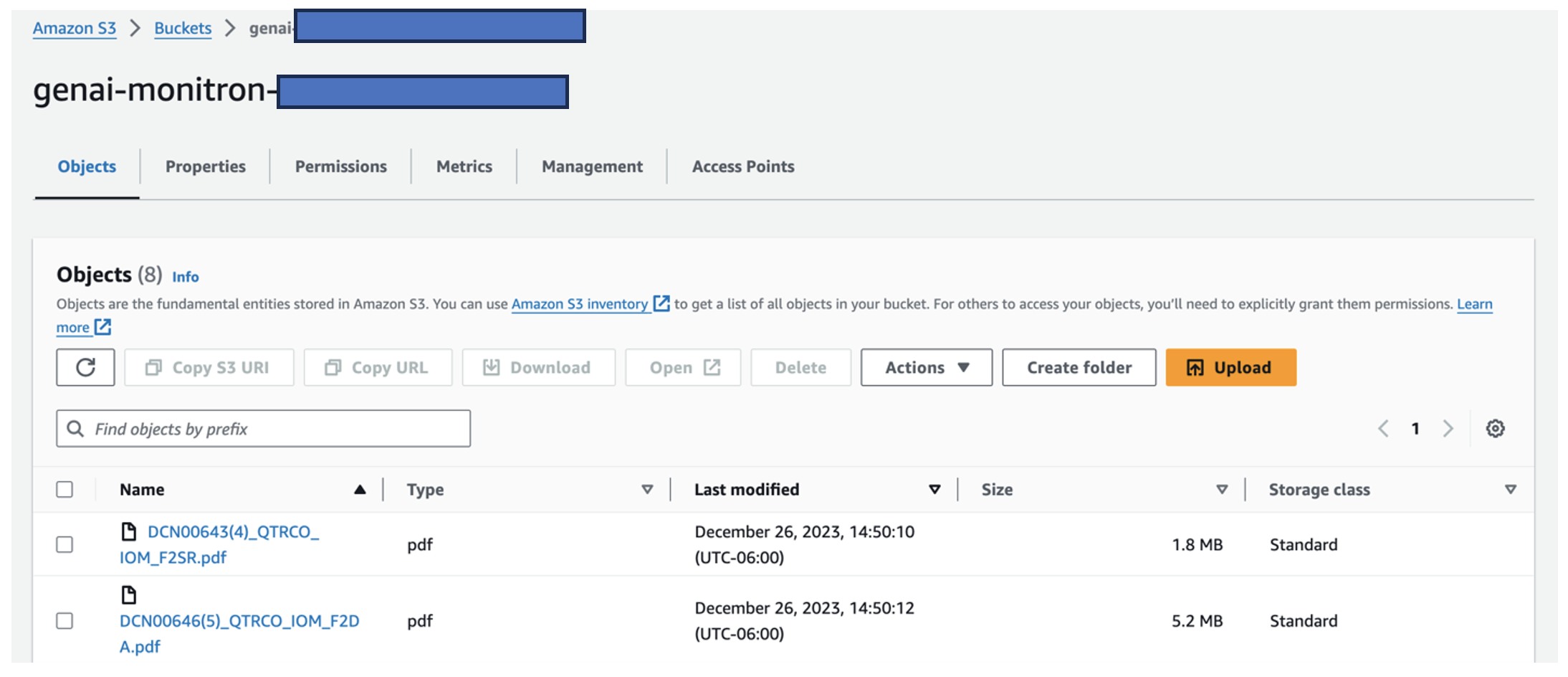

- Пользователь получает корпоративные данные в различных форматах документов (PDF, TXT и т. д.), связанные с неисправными активами, и загружает их в корзину S3.

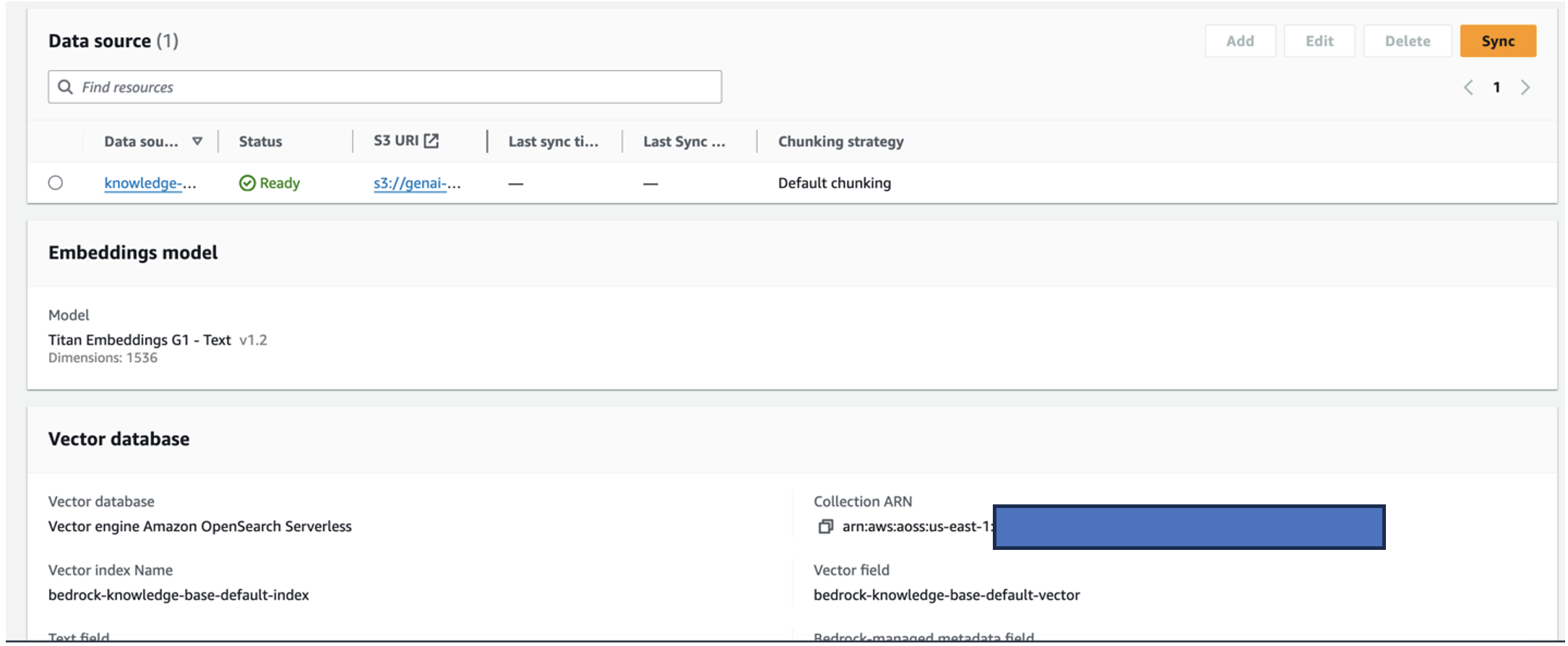

- База знаний этих файлов создается в Amazon Bedrock с использованием модели встраивания текста Titan и векторного хранилища OpenSearch Service по умолчанию.

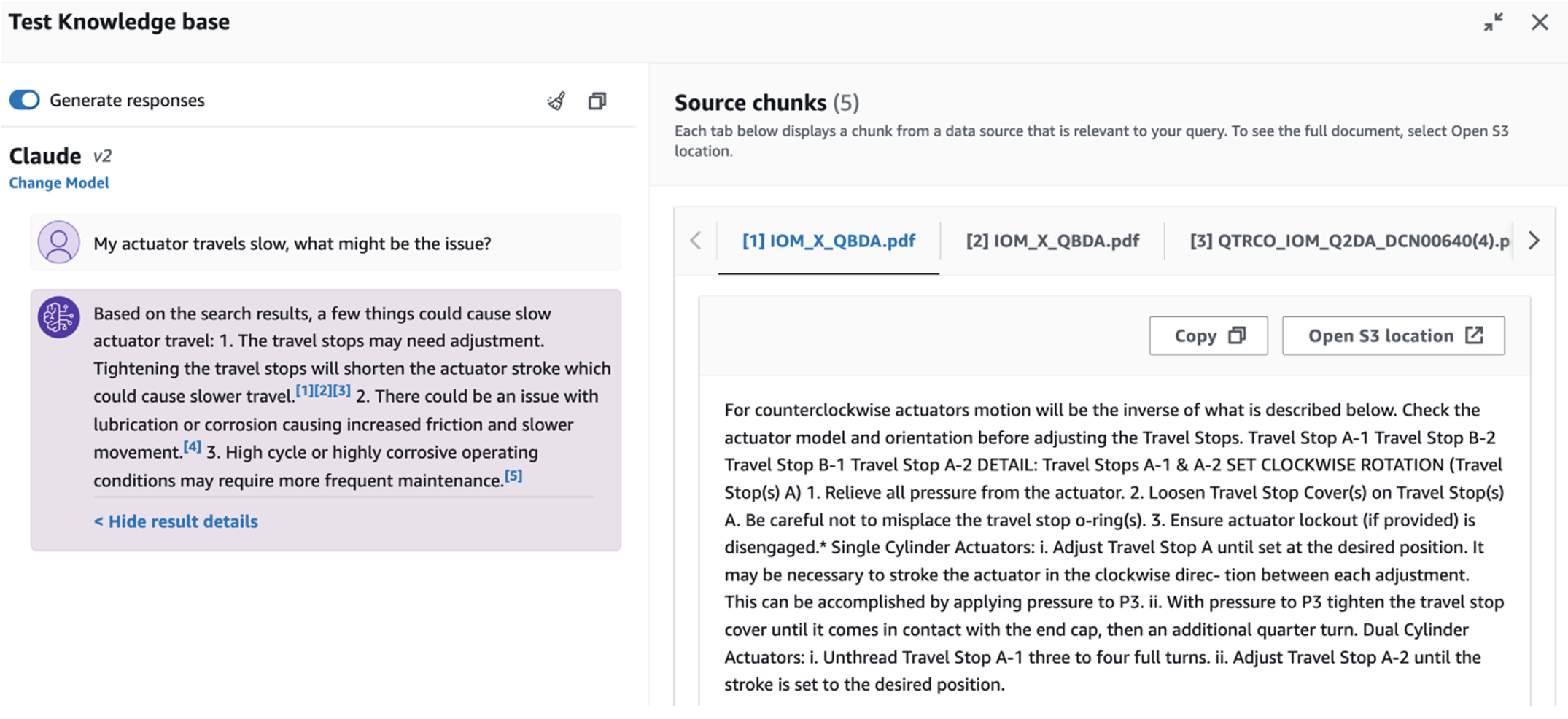

- Пользователь задает вопросы, связанные с диагностикой первопричин неисправности оборудования. Ответы генерируются через базу знаний Amazon Bedrock с использованием подхода RAG.

Предпосылки

Чтобы следовать этому посту, вы должны выполнить следующие предварительные условия:

Разверните инфраструктуру решения

Чтобы настроить ресурсы решения, выполните следующие действия:

- Разверните AWS CloudFormation шаблон opensearchsagemaker.yml, который создает коллекцию и индекс OpenSearch Service, Создатель мудреца Амазонки экземпляр ноутбука и сегмент S3. Вы можете назвать этот стек AWS CloudFormation так:

genai-sagemaker. - Откройте экземпляр блокнота SageMaker в JupyterLab. Вы найдете следующее Репо GitHub уже загружено на этом экземпляре: раскрытие-потенциала-производительного-искусственного интеллекта в-промышленных-операциях.

- Запустите блокнот из следующего каталога в этом репозитории: раскрытие потенциала генеративного ИИ в промышленных операциях/SagemakerNotebook/nlq-vector-rag-embedding.ipynb. Этот блокнот загрузит индекс службы OpenSearch с помощью блокнота SageMaker для хранения пар ключ-значение из существующие 23 примера NLQ.

- Загрузить документы из папки data активпартдок в репозитории GitHub в корзину S3, указанную в выходных данных стека CloudFormation.

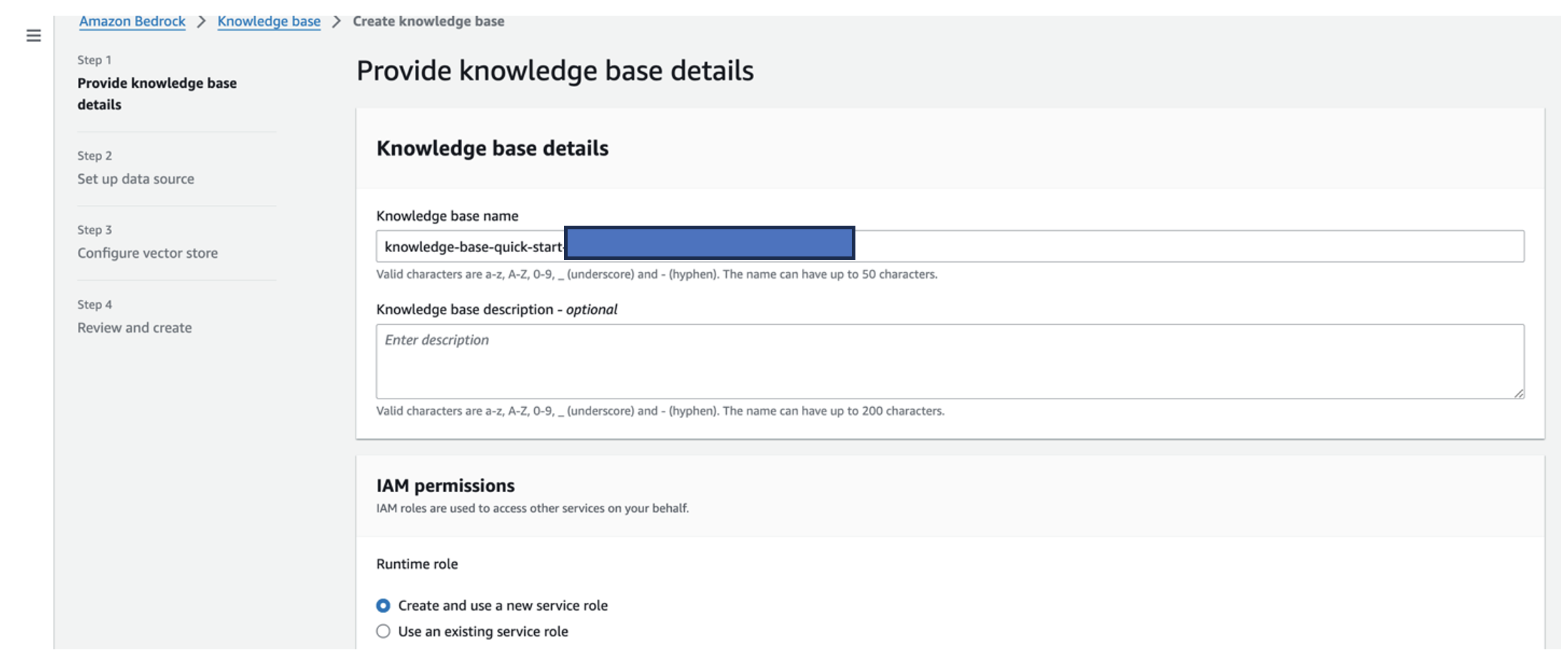

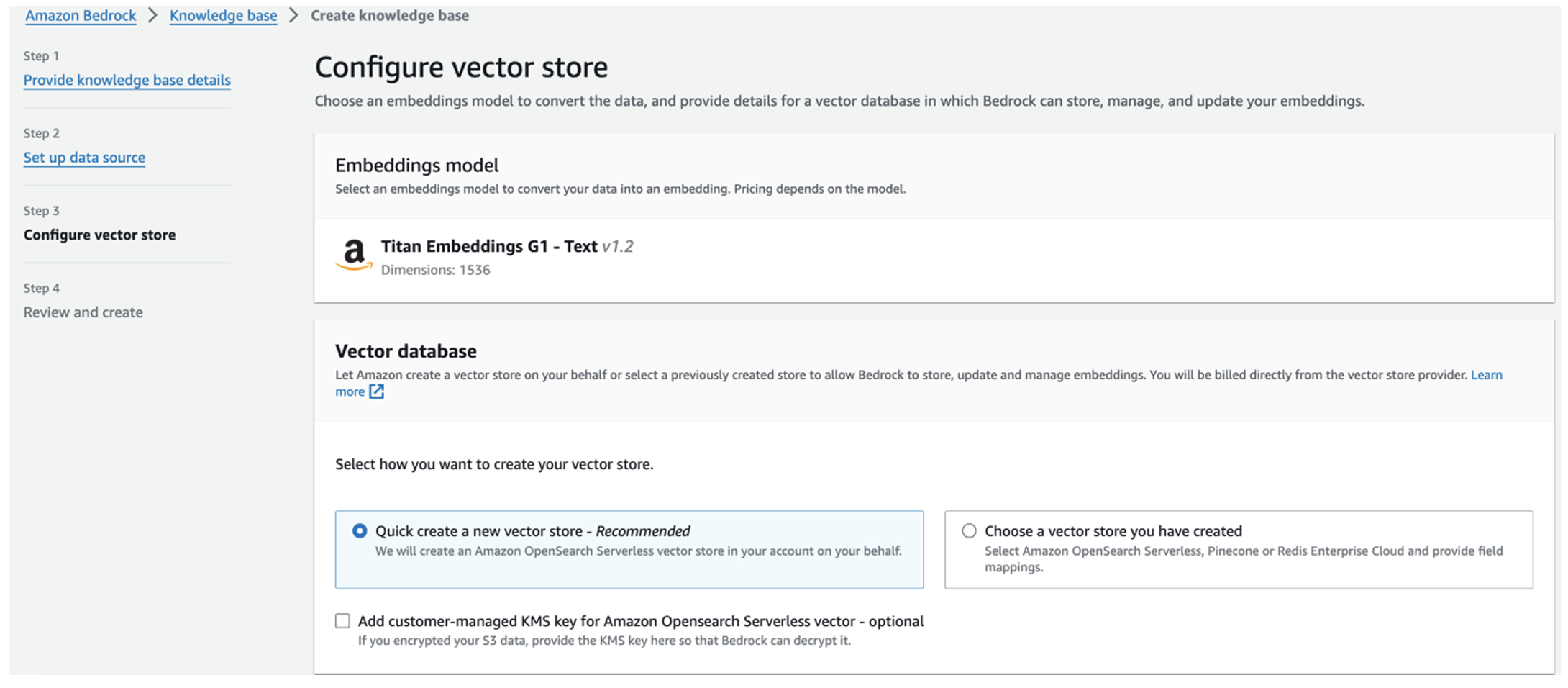

Затем вы создаете базу знаний для документов в Amazon S3.

- На консоли Amazon Bedrock выберите База знаний в навигационной панели.

- Выберите Создать базу знаний.

- Что касается Название базы знанийвведите имя.

- Что касается Роль времени выполнения, наведите на Создайте и используйте новую роль службы.

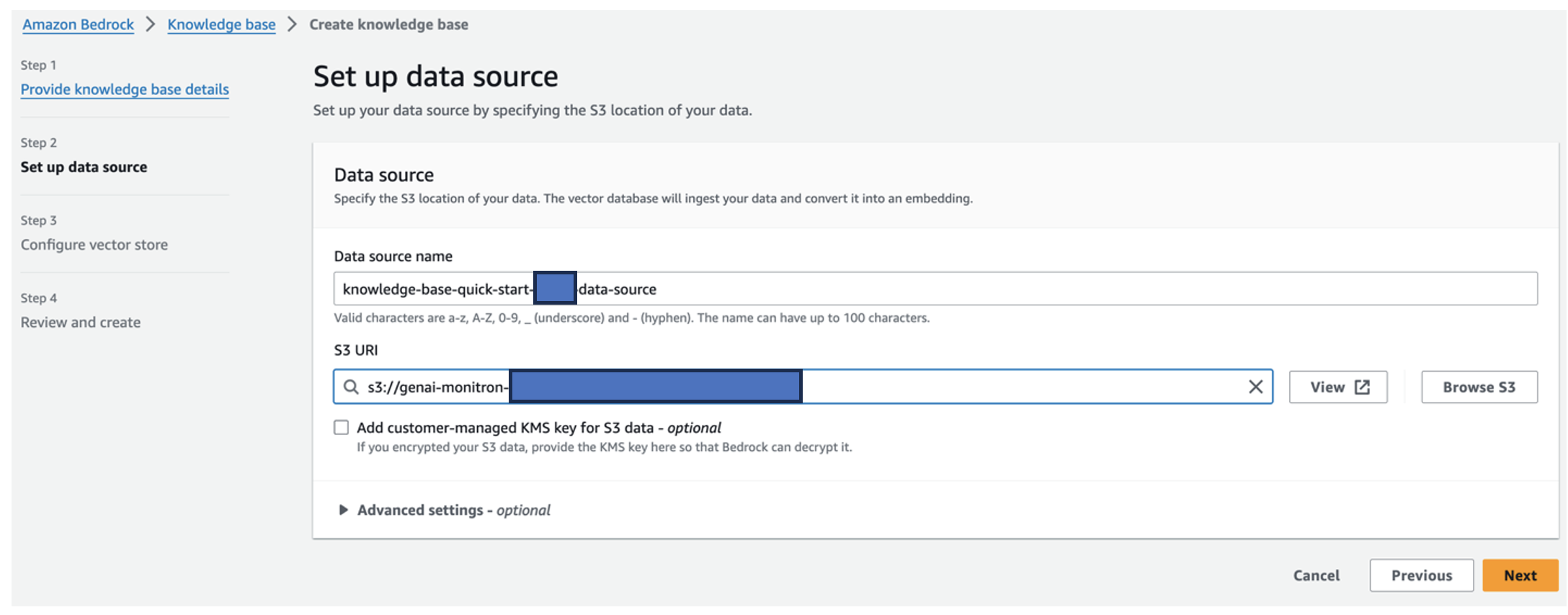

- Что касается Имя источника данных, введите имя источника данных.

- Что касается URI S3, введите путь S3 к сегменту, в который вы загрузили документы об основной причине.

- Выберите Следующая.

Модель встраивания Titan выбирается автоматически.

Модель встраивания Titan выбирается автоматически. - Выберите Быстрое создание нового векторного хранилища.

- Проверьте свои настройки и создайте базу знаний, выбрав Создать базу знаний.

- После успешного создания базы знаний выберите Синхронизация для синхронизации корзины S3 с базой знаний.

- После настройки базы знаний вы можете протестировать подход RAG для диагностики первопричин, задавая такие вопросы, как «Мой привод движется медленно, в чем может быть проблема?»

Следующим шагом будет развертывание приложения с необходимыми пакетами библиотек на вашем ПК или экземпляре EC2 (Ubuntu Server 22.04 LTS).

- Настройте свои учетные данные AWS с помощью интерфейса командной строки AWS на локальном компьютере. Для простоты вы можете использовать ту же роль администратора, которую вы использовали для развертывания стека CloudFormation. Если вы используете Amazon EC2, прикрепите к экземпляру подходящую роль IAM.

- Клон Репо GitHub:

- Измените каталог на

unlocking-the-potential-of-generative-ai-in-industrial-operations/srcи запуститьsetup.shскрипт в этой папке для установки необходимых пакетов, включая LangChain и PandasAI:cd unlocking-the-potential-of-generative-ai-in-industrial-operations/src chmod +x ./setup.sh ./setup.sh - Запустите приложение Streamlit с помощью следующей команды:

source monitron-genai/bin/activate python3 -m streamlit run app_bedrock.py <REPLACE WITH YOUR BEDROCK KNOWLEDGEBASE ARN>

Предоставьте коллекцию ARN OpenSearch Service, которую вы создали в Amazon Bedrock на предыдущем шаге.

Поговорите со своим помощником по состоянию активов

После завершения сквозного развертывания вы можете получить доступ к приложению через локальный хост через порт 8501, который открывает окно браузера с веб-интерфейсом. Если вы развернули приложение на экземпляре EC2, разрешить доступ к порту 8501 через входящее правило группы безопасности. Вы можете переходить к различным вкладкам для разных случаев использования.

Изучите вариант использования 1

Чтобы изучить первый вариант использования, выберите Анализ данных и диаграмма. Начните с загрузки данных временных рядов. Если у вас нет существующего файла данных временных рядов, вы можете загрузить следующий файл: образец CSV-файла с анонимными данными проекта Amazon Monitron. Если у вас уже есть проект Amazon Monitron, см. Получайте полезную аналитическую информацию для прогнозного управления обслуживанием с помощью Amazon Monitron и Amazon Kinesis. для потоковой передачи данных Amazon Monitron в Amazon S3 и использования ваших данных с этим приложением.

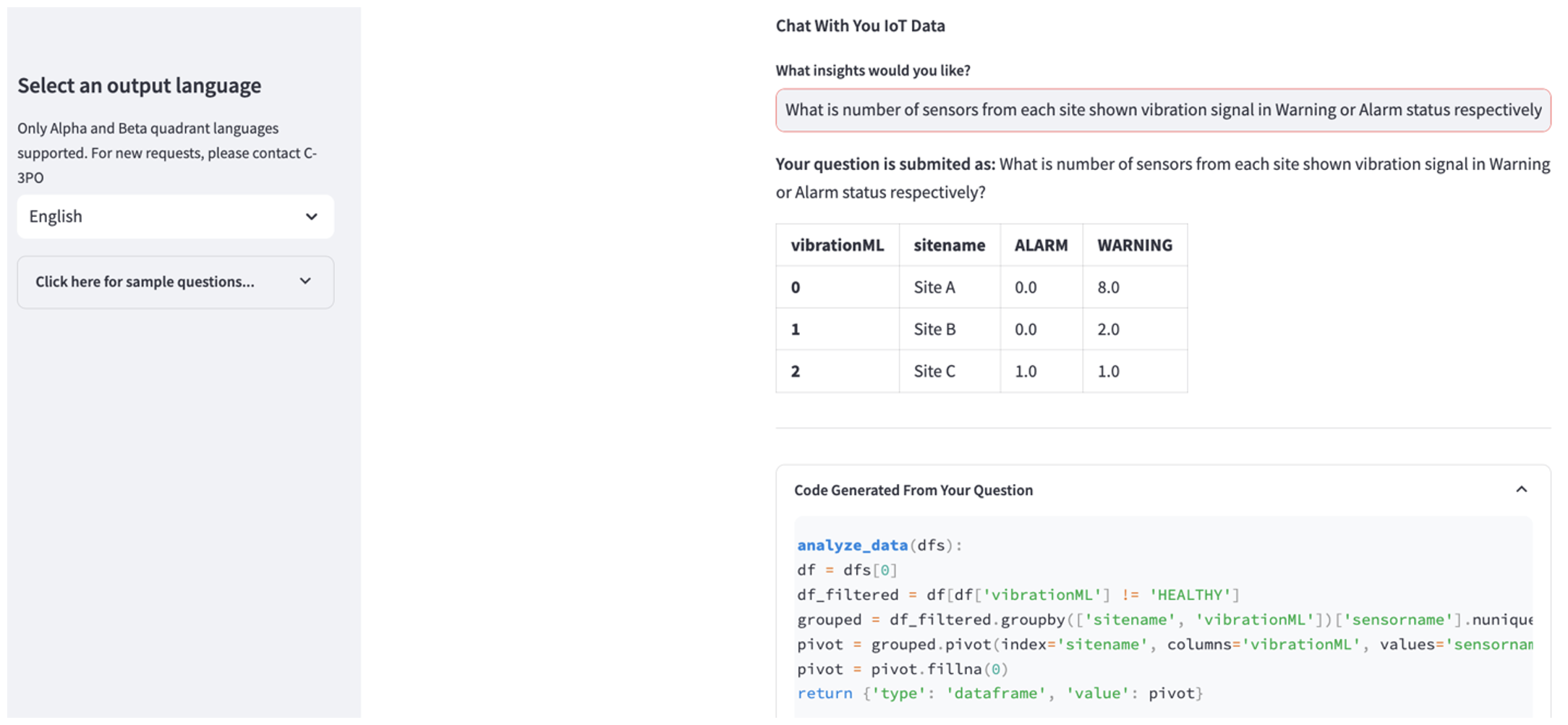

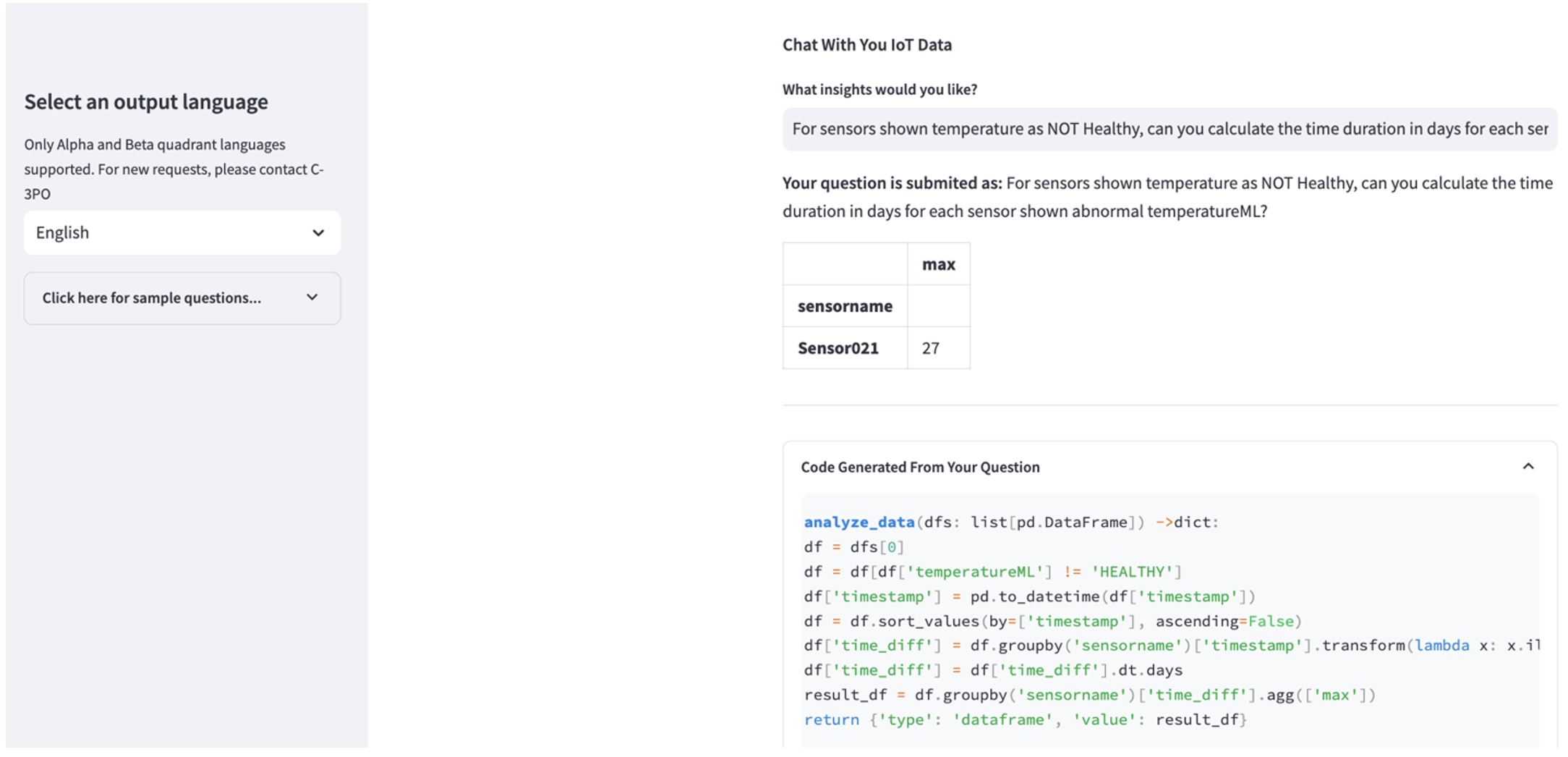

Когда загрузка завершится, введите запрос, чтобы начать обмен вашими данными. Для вашего удобства на левой боковой панели представлен ряд примеров вопросов. На следующих снимках экрана показан ответ и код Python, сгенерированные FM при вводе такого вопроса, как «Назовите мне уникальное количество датчиков для каждого объекта, отображаемое как предупреждение или сигнал тревоги соответственно?» (вопрос сложного уровня) или «Для датчиков, показывающих сигнал температуры как НЕ исправный, можете ли вы подсчитать продолжительность времени в днях для каждого датчика, показывающего аномальный сигнал вибрации?» (вопрос уровня сложности). Приложение ответит на ваш вопрос, а также покажет скрипт анализа данных Python, который он выполнил для получения таких результатов.

Если вас устраивает ответ, вы можете отметить его как полезный, сохраняя код Python, созданный NLQ и Claude, в индексе службы OpenSearch.

Изучите вариант использования 2

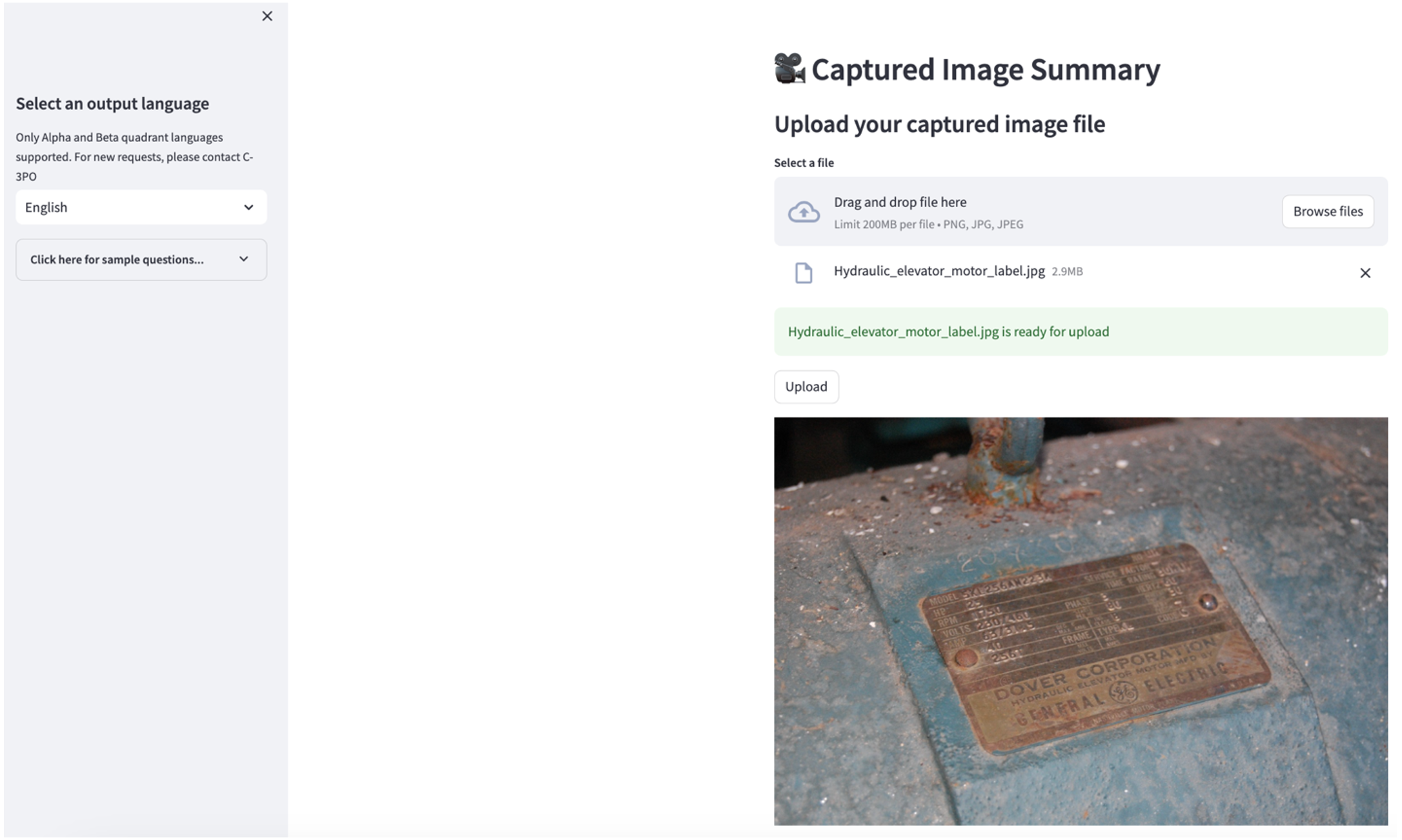

Чтобы изучить второй вариант использования, выберите Сводка захваченного изображения вкладка в приложении Streamlit. Вы можете загрузить изображение своего промышленного объекта, и приложение на основе информации об изображении сгенерирует краткое изложение его технических характеристик и условий эксплуатации объемом 200 слов. На следующем снимке экрана показаны сводные данные, созданные на основе изображения ременного привода. Чтобы протестировать эту функцию, если у вас нет подходящего изображения, вы можете использовать следующее пример изображения.

Этикетка двигателя гидравлического лифта» Кларенса Ришера находится под лицензией CC BY-SA 2.0.

Изучите вариант использования 3

Чтобы изучить третий вариант использования, выберите Диагностика первопричины вкладка. Введите запрос, связанный с вашим сломанным промышленным объектом, например: «Мой привод движется медленно, в чем может быть проблема?» Как показано на следующем снимке экрана, приложение отправляет ответ с отрывком из исходного документа, использованным для генерации ответа.

Вариант использования 1: Детали проектирования

В этом разделе мы обсуждаем детали проектирования рабочего процесса приложения для первого варианта использования.

Создание индивидуальных подсказок

Запрос пользователя на естественном языке имеет разные уровни сложности: простой, сложный и сложный.

Прямые вопросы могут включать в себя следующие просьбы:

- Выберите уникальные значения

- Подсчитайте общее количество

- Сортировать значения

По этим вопросам PandasAI может напрямую взаимодействовать с FM для создания сценариев Python для обработки.

Сложные вопросы требуют базовых операций агрегирования или анализа временных рядов, например следующие:

- Сначала выберите значение и сгруппируйте результаты иерархически.

- Выполнение статистики после первоначального выбора записи

- Количество временных меток (например, минимальное и максимальное)

Для сложных вопросов шаблон подсказки с подробными пошаговыми инструкциями помогает FM дать точные ответы.

Вопросы сложного уровня требуют сложных математических вычислений и обработки временных рядов, например:

- Рассчитать продолжительность аномалии для каждого датчика

- Ежемесячный расчет датчиков аномалий для объекта

- Сравните показания датчиков при нормальной работе и ненормальных условиях.

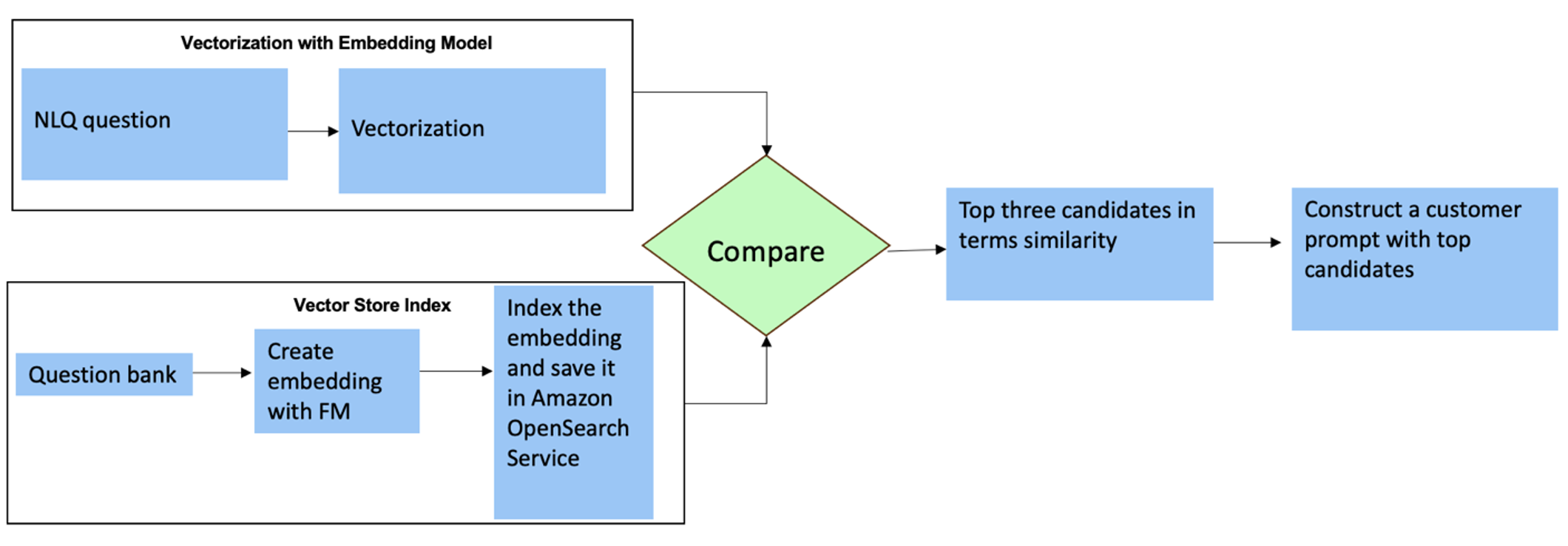

Для этих вопросов вы можете использовать несколько вопросов в настраиваемой подсказке, чтобы повысить точность ответа. Такие многократные снимки демонстрируют примеры расширенной обработки временных рядов и математических вычислений, а также предоставляют FM контекст для выполнения соответствующих выводов на основе аналогичного анализа. Динамическая вставка наиболее релевантных примеров из банка вопросов NLQ в подсказку может оказаться непростой задачей. Одним из решений является создание внедрений из существующих образцов вопросов NLQ и сохранение этих внедрений в векторном хранилище, таком как OpenSearch Service. Когда вопрос отправляется в приложение Streamlit, он будет векторизован BedrockВложения. Первые N наиболее релевантных вложений для этого вопроса извлекаются с помощью opensearch_vector_search.similarity_search и вставляется в шаблон подсказки как многократная подсказка.

Следующая диаграмма иллюстрирует этот рабочий процесс.

Слой внедрения создается с помощью трех ключевых инструментов:

- Модель вложений – Мы используем Amazon Titan Embeddings, доступные через Amazon Bedrock (amazon.titan-embed-text-v1) для создания числовых представлений текстовых документов.

- Векторный магазин – Для нашего векторного хранилища мы используем службу OpenSearch через структуру LangChain, оптимизируя хранение вложений, созданных на основе примеров NLQ, в этом блокноте.

- Индекс – Индекс OpenSearch Service играет ключевую роль в сравнении входных внедрений с внедренными документами и облегчении поиска соответствующих документов. Поскольку примеры кода Python были сохранены в виде файла JSON, они были проиндексированы в службе OpenSearch как векторы через OpenSearchVevtorSearch.fromtexts Вызов API.

Непрерывный сбор проверенных человеком примеров через Streamlit

В самом начале разработки приложения мы начали с всего лишь 23 сохраненных примеров в индексе OpenSearch Service в качестве вложений. Когда приложение запускается в полевых условиях, пользователи начинают вводить свои NLQ через приложение. Однако из-за ограниченного количества примеров, доступных в шаблоне, некоторые NLQ могут не найти подобные запросы. Чтобы постоянно расширять эти внедрения и предлагать более актуальные подсказки для пользователей, вы можете использовать приложение Streamlit для сбора проверенных человеком примеров.

В приложении этой цели служит следующая функция. Когда конечные пользователи находят результаты полезными и выбирают полезный, приложение выполняет следующие шаги:

- Используйте метод обратного вызова от PandasAI, чтобы собрать скрипт Python.

- Переформатируйте скрипт Python, введите вопрос и метаданные CSV в строку.

- Проверьте, существует ли этот пример NLQ в текущем индексе OpenSearch Service, используя opensearch_vector_search.similarity_search_with_score.

- Если подобного примера нет, этот NLQ добавляется в индекс OpenSearch Service с помощью opensearch_vector_search.add_texts.

В случае, если пользователь выбирает Не полезно, никаких действий не предпринимается. Этот итеративный процесс обеспечивает постоянное совершенствование системы за счет включения примеров, предоставленных пользователями.

def addtext_opensearch(input_question, generated_chat_code, df_column_metadata, opensearch_vector_search,similarity_threshold,kexamples, indexname):

#######build the input_question and generated code the same format as existing opensearch index##########

reconstructed_json = {}

reconstructed_json["question"]=input_question

reconstructed_json["python_code"]=str(generated_chat_code)

reconstructed_json["column_info"]=df_column_metadata

json_str = ''

for key,value in reconstructed_json.items():

json_str += key + ':' + value

reconstructed_raw_text =[]

reconstructed_raw_text.append(json_str)

results = opensearch_vector_search.similarity_search_with_score(str(reconstructed_raw_text[0]), k=kexamples) # our search query # return 3 most relevant docs

if (dumpd(results[0][1])<similarity_threshold): ###No similar embedding exist, then add text to embedding

response = opensearch_vector_search.add_texts(texts=reconstructed_raw_text, engine="faiss", index_name=indexname)

else:

response = "A similar embedding is already exist, no action."

return response

Благодаря внедрению человеческого аудита количество примеров в службе OpenSearch, доступных для быстрого внедрения, растет по мере роста использования приложения. Этот расширенный набор данных для внедрения со временем приводит к повышению точности поиска. В частности, для сложных вопросов NLQ точность ответа FM достигает примерно 90% при динамической вставке аналогичных примеров для создания пользовательских подсказок для каждого вопроса NLQ. Это представляет собой заметное увеличение на 28% по сравнению со сценариями без многократных подсказок.

Вариант использования 2: Детали проектирования

В приложении Streamlit Сводка захваченного изображения вкладке, вы можете напрямую загрузить файл изображения. Это инициирует API Amazon Rekognition (обнаружить_текст API), извлекая текст из метки изображения с подробными техническими характеристиками машины. Впоследствии извлеченные текстовые данные отправляются в модель Amazon Bedrock Claude в качестве контекста приглашения, в результате чего получается резюме из 200 слов.

С точки зрения пользовательского опыта, включение функции потоковой передачи для задачи суммирования текста имеет первостепенное значение, позволяя пользователям читать сводку, сгенерированную FM, небольшими порциями, а не ждать весь вывод. Amazon Bedrock упрощает потоковую передачу через свой API (Bedrock_runtime.invoke_model_with_response_stream).

Вариант использования 3: Детали проектирования

В этом сценарии мы разработали приложение чат-бота, ориентированное на анализ первопричин, используя подход RAG. Этот чат-бот использует множество документов, касающихся подшипникового оборудования, для облегчения анализа первопричин. Этот чат-бот для анализа первопричин на основе RAG использует базы знаний для создания векторных текстовых представлений или вложений. Базы знаний для Amazon Bedrock — это полностью управляемая функция, которая помогает реализовать весь рабочий процесс RAG, от приема до извлечения и оперативного расширения, без необходимости создавать настраиваемую интеграцию с источниками данных или управлять потоками данных и деталями реализации RAG.

Если вы удовлетворены ответом базы знаний от Amazon Bedrock, вы можете интегрировать ответ об основной причине из базы знаний в приложение Streamlit.

Убирать

Чтобы сэкономить, удалите ресурсы, созданные вами в этом посте:

- Удалите базу знаний из Amazon Bedrock.

- Удалите индекс службы OpenSearch.

- Удалите стек CloudFormation genai-sagemaker.

- Остановите экземпляр EC2, если вы использовали экземпляр EC2 для запуска приложения Streamlit.

Заключение

Приложения генеративного искусственного интеллекта уже изменили различные бизнес-процессы, повысив производительность труда и набор навыков. Однако ограничения FM в обработке анализа данных временных рядов препятствуют их полному использованию промышленными клиентами. Это ограничение препятствовало применению генеративного ИИ к преобладающему типу данных, обрабатываемому ежедневно.

В этом посте мы представили генеративное решение для приложений искусственного интеллекта, призванное облегчить эту проблему для промышленных пользователей. Это приложение использует агент с открытым исходным кодом PandasAI для расширения возможностей анализа временных рядов FM. Вместо отправки данных временных рядов непосредственно в FM приложение использует PandasAI для генерации кода Python для анализа неструктурированных данных временных рядов. Чтобы повысить точность генерации кода Python, был реализован настраиваемый рабочий процесс создания подсказок с человеческим аудитом.

Обладая информацией о состоянии своих активов, промышленные рабочие могут в полной мере использовать потенциал генеративного искусственного интеллекта в различных сценариях использования, включая диагностику первопричин и планирование замены деталей. Благодаря базам знаний для Amazon Bedrock разработчикам легко создавать и управлять решением RAG.

Траектория управления корпоративными данными и операциями безошибочно движется в сторону более глубокой интеграции с генеративным искусственным интеллектом для комплексного понимания эксплуатационного состояния. Этот сдвиг, возглавляемый Amazon Bedrock, значительно усиливается растущей надежностью и потенциалом таких программ LLM, как Амазонка Бедрок Клод 3 для дальнейшего улучшения решений. Чтобы узнать больше, посетите консультацию Документация Amazon Bedrockи познакомьтесь с Мастерская Amazon Bedrock.

Об авторах

Джулия Ху — старший архитектор решений AI/ML в Amazon Web Services. Она специализируется на генеративном искусственном интеллекте, прикладной науке о данных и архитектуре Интернета вещей. В настоящее время она является частью команды Amazon Q и активным членом/наставником сообщества технических специалистов по машинному обучению. Она работает с клиентами, от стартапов до предприятий, над разработкой решений AWSome для генеративного искусственного интеллекта. Она особенно увлечена использованием моделей большого языка для расширенного анализа данных и изучения практических приложений, решающих реальные проблемы.

Джулия Ху — старший архитектор решений AI/ML в Amazon Web Services. Она специализируется на генеративном искусственном интеллекте, прикладной науке о данных и архитектуре Интернета вещей. В настоящее время она является частью команды Amazon Q и активным членом/наставником сообщества технических специалистов по машинному обучению. Она работает с клиентами, от стартапов до предприятий, над разработкой решений AWSome для генеративного искусственного интеллекта. Она особенно увлечена использованием моделей большого языка для расширенного анализа данных и изучения практических приложений, решающих реальные проблемы.

Судиш Сасидхаран — старший архитектор решений в AWS в отделе энергетики. Судиш любит экспериментировать с новыми технологиями и создавать инновационные решения, которые решают сложные бизнес-задачи. Когда он не разрабатывает решения и не возится с новейшими технологиями, его можно найти на теннисном корте, работающим над ударом слева.

Судиш Сасидхаран — старший архитектор решений в AWS в отделе энергетики. Судиш любит экспериментировать с новыми технологиями и создавать инновационные решения, которые решают сложные бизнес-задачи. Когда он не разрабатывает решения и не возится с новейшими технологиями, его можно найти на теннисном корте, работающим над ударом слева.

Нил Десаи — технологический руководитель с более чем 20-летним опытом работы в области искусственного интеллекта (ИИ), обработки данных, разработки программного обеспечения и корпоративной архитектуры. В AWS он возглавляет команду мировых специалистов-архитекторов решений для служб искусственного интеллекта, которые помогают клиентам создавать инновационные решения на базе генеративного искусственного интеллекта, делятся с клиентами передовым опытом и разрабатывают дорожную карту продукта. На своих предыдущих должностях в Vestas, Honeywell и Quest Diagnostics Нил занимал руководящие должности в разработке и запуске инновационных продуктов и услуг, которые помогали компаниям улучшить свою деятельность, сократить расходы и увеличить доходы. Он увлечен использованием технологий для решения реальных проблем и является стратегическим мыслителем с подтвержденным опытом успеха.

Нил Десаи — технологический руководитель с более чем 20-летним опытом работы в области искусственного интеллекта (ИИ), обработки данных, разработки программного обеспечения и корпоративной архитектуры. В AWS он возглавляет команду мировых специалистов-архитекторов решений для служб искусственного интеллекта, которые помогают клиентам создавать инновационные решения на базе генеративного искусственного интеллекта, делятся с клиентами передовым опытом и разрабатывают дорожную карту продукта. На своих предыдущих должностях в Vestas, Honeywell и Quest Diagnostics Нил занимал руководящие должности в разработке и запуске инновационных продуктов и услуг, которые помогали компаниям улучшить свою деятельность, сократить расходы и увеличить доходы. Он увлечен использованием технологий для решения реальных проблем и является стратегическим мыслителем с подтвержденным опытом успеха.

- SEO-контент и PR-распределение. Получите усиление сегодня.

- PlatoData.Network Вертикальный генеративный ИИ. Расширьте возможности себя. Доступ здесь.

- ПлатонАйСтрим. Интеллект Web3. Расширение знаний. Доступ здесь.

- ПлатонЭСГ. Углерод, чистые технологии, Энергия, Окружающая среда, Солнечная, Управление отходами. Доступ здесь.

- ПлатонЗдоровье. Биотехнологии и клинические исследования. Доступ здесь.

- Источник: https://aws.amazon.com/blogs/machine-learning/unlock-the-potential-of-generative-ai-in-industrial-operations/

- :имеет

- :является

- :нет

- :куда

- $UP

- 000

- 1

- 100

- 125

- 150

- 16

- 20

- 20 лет

- 200

- 22

- 23

- 7

- 8

- a

- способность

- в состоянии

- ненормальный

- О нас

- доступ

- По

- точность

- точный

- через

- Действие

- действенные

- активный

- Добавить

- добавленный

- дополнительный

- адрес

- адресация

- Добавляет

- Администратор

- Принятие

- продвинутый

- После

- Агент

- агенты

- агрегирование

- AI

- Услуги искусственного интеллекта

- Поддержка

- AI / ML

- Часы работы

- облегчать

- Позволяющий

- вдоль

- уже

- причислены

- Amazon

- Amazon EC2

- Апостол

- Amazon Web Services

- Усиленный

- an

- анализ

- аналитика

- и

- аномалии

- обнаружение аномалии

- Anonymous

- ответ

- ответы

- Антропный

- любой

- API

- приложение

- Разработка приложений

- Применение

- Приложения

- прикладной

- подхода

- примерно

- Архитекторы

- архитектура

- МЫ

- искусственный

- искусственный интеллект

- Искусственный интеллект (AI)

- AS

- спрашивающий

- оценить

- активы

- Активы

- помощник

- помогает

- At

- аудит

- дополненная

- автоматически

- доступен

- AWS

- AWS CloudFormation

- Банка

- Использование темпера с изогнутым основанием

- основанный

- основной

- BE

- , так как:

- было

- начал

- начинать

- поведение

- приносящий пользу

- ЛУЧШЕЕ

- лучшие практики

- стимулирование

- форсирует

- Сломанный

- браузер

- строить

- Строительство

- бизнес

- by

- вычислять

- расчет

- призывают

- CAN

- возможности

- возможности

- захватить

- случаев

- случаев

- Вызывать

- цепь

- вызов

- проблемы

- сложные

- Chatbot

- в чате

- Выберите

- Выбирая

- кли

- клиентов

- код

- Коды

- собирать

- Сбор

- лыжных шлемов

- как

- выходит

- сообщество

- Компании

- сравненный

- сравнив

- полный

- комплекс

- комплексный

- компьютер

- состояние

- значительный

- состоит

- Консоли

- ограничения

- строить

- построенный

- строительство

- консультироваться

- содержит

- содержание

- контекст

- беспрестанно

- непрерывно

- удобство

- Разговор

- диалоговый

- преобразование

- Расходы

- считать

- корт

- Создайте

- создали

- создает

- критической

- Текущий

- В настоящее время

- изготовленный на заказ

- Клиенты

- ежедневно

- данным

- анализ данных

- Анализ данных

- управление данными

- обработка данных

- наука о данных

- управляемых данными

- Дней

- решения

- более глубокий

- По умолчанию

- обеспечивает

- запросы

- демократизирует

- изображенный

- развертывание

- развернуть

- развертывание

- Проект

- предназначенный

- проектирование

- желанный

- подробный

- Детализация

- подробнее

- обнаруживать

- обнаружение

- развивать

- развитый

- застройщиков

- развивающийся

- Развитие

- Устройства

- диагностика

- диагностика

- диаграмма

- различный

- трудный

- Интернет

- цифровая революция

- непосредственно

- каталог

- обсуждать

- рассеянный

- отчетливый

- Документы

- документ

- Документация

- Dont

- скачанный

- рисует

- управлять

- вождение

- два

- продолжительность

- динамично

- каждый

- легко

- или

- ELEVATE

- ликвидирует

- еще

- вставлять

- вложения

- используя

- работает

- позволяет

- впритык

- энергетика

- привлечение

- Проект и

- Инженеры

- повышать

- расширение

- повышение

- обогащать

- Enter

- Предприятие

- предприятий

- Весь

- Оборудование

- ошибки

- Даже

- События

- очевидный

- развивается

- пример

- Примеры

- исполнительный

- существовать

- существующий

- существует

- расширенный

- опыт

- экспериментировал

- Больше

- Исследование

- обширный

- извлечение

- Face

- содействовал

- облегчает

- облегчающий

- средства

- XNUMX ошибка

- сбои

- Особенность

- поле

- Файл

- Файлы

- Найдите

- First

- Потоки

- внимание

- следовать

- после

- следующим образом

- Что касается

- формат

- Год основания

- Рамки

- от

- полный

- полностью

- функция

- функциональность

- далее

- Gain

- Доходы

- сбор

- порождать

- генерируется

- порождающий

- поколение

- генеративный

- Генеративный ИИ

- получить

- GitHub

- идет

- группы

- Рост

- Растет

- Управляемость

- практический

- Жесткий

- упряжь

- Есть

- имеющий

- he

- Медицина

- здоровый

- Герой

- помощь

- помог

- полезный

- помогает

- высокое разрешение

- его

- затрудненный

- его

- Honeywell

- Однако

- HTML

- HTTP

- HTTPS

- человек

- определения

- if

- иллюстрировать

- иллюстрирует

- изображение

- изображений

- осуществлять

- реализация

- в XNUMX году

- улучшать

- улучшенный

- улучшается

- in

- включают

- включены

- включает в себя

- В том числе

- включения

- Увеличение

- индекс

- индексированный

- промышленность

- информация

- сообщил

- начальный

- инициировать

- Посвященные

- инновационный

- вход

- ввод

- понимание

- размышления

- устанавливать

- пример

- инструкции

- интегрировать

- интеграции.

- интеграций

- Интеллекта

- Умный

- взаимодействовать

- Интерфейс

- Интернет

- Интернет вещей

- в

- выпустили

- Представляет

- КАТО

- вопрос

- IT

- ЕГО

- совместная

- JPEG

- JPG

- JSON

- Основные

- знания

- известный

- знает

- этикетка

- Отсутствие

- пейзаж

- язык

- большой

- последний

- запуск

- слой

- Наша команда

- Лиды

- УЧИТЬСЯ

- изучение

- оставил

- уровни

- Используя

- Библиотека

- Лицензирована

- такое как

- недостатки

- Ограниченный

- линий

- Включенный в список

- жить

- загрузка

- локальным

- любит

- машина

- обучение с помощью машины

- техническое обслуживание

- ДЕЛАЕТ

- управлять

- управляемого

- управление

- Менеджеры

- Манипуляция

- вручную

- Производители

- производство

- отметка

- математике

- Макс

- Май..

- me

- размеры

- Встречайте

- Метаданные

- метод

- может быть

- мин

- ML

- модель

- Модели

- монитор

- Мониторинг

- ежемесячно

- БОЛЕЕ

- самых

- Мотор

- перемещение

- с разными

- имя

- натуральный

- Откройте

- навигационный

- Навигация

- необходимо

- Необходимость

- Новые

- Новые технологии

- следующий

- нет

- "обычные"

- примечательный

- ноутбук

- номер

- Получает

- of

- предлагают

- Предложения

- on

- ONE

- только

- открытый

- с открытым исходным кодом

- Откроется

- операция

- оперативный

- Операционный отдел

- Оптимизировать

- or

- наши

- выходной

- выходы

- за

- пакеты

- пар

- панд

- хлеб

- Первостепенный

- часть

- особенно

- страстный

- путь

- PC

- Выполнять

- выполнены

- выполняет

- перспектива

- PHP

- Физически

- Стержень

- основной

- планирование

- Платон

- Платон Интеллектуальные данные

- ПлатонДанные

- Играть

- играет

- Популярное

- представляет

- После

- потенциал

- мощностью

- Питание

- практическое

- практиками

- предпосылки

- предыдущий

- Предварительный

- проблемам

- процесс

- Обработанный

- Процессы

- обработка

- Продукт

- Производство

- производительность

- Продукция

- Прогресс

- Проект

- данные проекта

- наводящие

- предлагает

- Доказывать

- доказанный

- обеспечивать

- приводит

- обеспечение

- цель

- Питон

- количество

- Запросы

- запрос

- поиск

- вопрос

- Вопросы

- тряпка

- ассортимент

- ранжирование

- быстро

- скорее

- доходит до

- Читать

- реальный мир

- реального времени

- данные в реальном времени

- признание

- запись

- уменьшить

- относиться

- Связанный

- соответствующие

- замещать

- замена

- хранилище

- представляет

- Запросы

- требовать

- обязательный

- Полезные ресурсы

- соответственно

- ответ

- ответы

- в результате

- Итоги

- поиск

- возвращают

- Возвращает

- доходы

- Революция

- Дорожная карта

- прочность

- Роли

- роли

- корень

- Run

- Бег

- работает

- sagemaker

- то же

- довольный

- доволен

- Сохранить

- сохраняются

- экономия

- Шкала

- сценарий

- Сценарии

- Наука

- Ученые

- скриншоты

- скрипт

- скрипты

- Поиск

- поиск

- Во-вторых

- Раздел

- безопасность

- выберите

- выбранный

- отправка

- посылает

- старший

- датчик

- датчик

- послать

- Серии

- сервер

- служит

- обслуживание

- Услуги

- набор

- Наборы

- настройки

- несколько

- Поделиться

- она

- сдвиг

- должен

- показывать

- показ

- показанный

- Шоу

- сигнал

- существенно

- аналогичный

- просто

- простота

- упростить

- сайте

- Размер

- умение

- навыки

- медленной

- небольшой

- меньше

- So

- Software

- разработка программного обеспечения

- Решение

- Решения

- РЕШАТЬ

- некоторые

- удалось

- Источник

- источников

- Источники

- возглавил

- специалист

- специализированный

- конкретный

- конкретно

- Спецификация

- спецификации

- стек

- автономные

- Начало

- стартапов

- современное состояние

- статистика

- Шаг

- Шаги

- диск

- магазин

- простой

- Стратегический

- поток

- потоковый

- тока

- упорядочение

- УКРЕПЛЯТЬ

- строка

- впоследствии

- успех

- успешный

- Успешно

- такие

- подходящее

- РЕЗЮМЕ

- поставка

- цепочками поставок

- Убедитесь

- синхронизации.

- система

- системы

- ТАБЛИЦЫ

- приняты

- Сложность задачи

- команда

- команды

- Технический

- технологии

- Технологии

- шаблон

- теннис

- тестXNUMX

- текст

- текстовый

- чем

- который

- Ассоциация

- Источник

- их

- Их

- тогда

- Там.

- следовательно

- Эти

- они

- вещи

- мыслитель

- В третьих

- этой

- три

- Через

- время

- Временные ряды

- исполин

- в

- инструментом

- инструменты

- топ

- Всего

- к

- трек

- Послужной

- траектория

- преобразующей

- преобразован

- путешествия

- напишите

- типично

- Ubuntu

- под

- понимание

- созданного

- отпереть

- неструктурированных

- загружено

- Загрузка

- Применение

- использование

- прецедент

- используемый

- Информация о пользователе

- Пользовательский опыт

- пользователей

- использования

- через

- ценный

- ценностное

- разнообразие

- различный

- Огромная

- с помощью

- Войти

- тома

- Ожидание

- предупреждение

- we

- Web

- веб-сервисы

- были

- Что

- когда

- будь то

- который

- КТО

- широко распространена

- будете

- окно

- в

- без

- работник

- рабочие

- рабочий

- Рабочие процессы

- работает

- работает

- по всему миру

- Неправильно

- лет

- еще

- Уступать

- Ты

- ВАШЕ

- зефирнет