Napaka zlonamernega ustvarjanja globokih ponaredkov se je razširila daleč onkraj sfere slavnih in javnih osebnosti, novo poročilo o intimnih podobah brez soglasja (NCII) pa ugotavlja, da ta praksa samo narašča, ko se generatorji slik razvijajo in množijo.

»AI slačenje« je v porastu, a poročilo podjetje Graphika za analizo družbenih medijev je v petek dejalo, da prakso opisuje kot uporabo generativni AI orodja, natančno nastavljena za odstranjevanje oblačil s slik, ki so jih naložili uporabniki.

Skupnost za igre na srečo in pretočno predvajanje Twitch se je spopadla s to težavo v začetku tega leta, ko je ugledni izdajatelj televizijskih programov Brandon 'Atrioc' Ewing po naključju razkril, da je gledal globoko ponarejeno pornografijo pretakalk, ki jih je poklical svoje prijateljice in jih je ustvarila umetna inteligenca. poročilo by Kotaku.

Ewing se je marca vrnil na platformo, skesan in poročal o tednih dela, ki ga je opravil, da bi ublažil škodo, ki jo je povzročil. Toda incident je odprl vrata za celotno spletno skupnost.

Poročilo Graphike kaže, da je bil dogodek le kaplja čez rob.

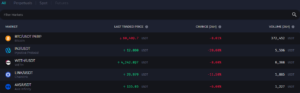

"Z uporabo podatkov, ki jih je zagotovil Meltwater, smo izmerili število komentarjev in objav na Redditu in X, ki vsebujejo napotitvene povezave do 34 spletnih mest in 52 kanalov Telegram, ki zagotavljajo sintetične storitve NCII," je zapisal obveščevalni analitik Graphika Santiago Lakatos. "Teh je bilo leta 1,280 skupaj 2022 v primerjavi z več kot 32,100 doslej letos, kar predstavlja 2,408-odstotno povečanje obsega medletno."

Graphika s sedežem v New Yorku pravi, da eksplozija v NCII kaže, da so se orodja preselila iz nišnih diskusijskih desk v domačo obrt.

"Ti modeli omogočajo večjemu številu ponudnikov, da enostavno in poceni ustvarijo fotorealistične NCII v velikem obsegu," je dejal Graphika. "Brez takšnih ponudnikov bi njihove stranke morale gostiti, vzdrževati in izvajati lastne modele difuzije slike po meri - dolgotrajen in včasih drag postopek."

Graphika opozarja, da bi povečanje priljubljenosti orodij za slačenje umetne inteligence lahko povzročilo ne le ponaredke pornografski materiala, temveč tudi ciljno nadlegovanje, spolno izsiljevanje in ustvarjanje materiala o spolni zlorabi otrok (CSAM).

Glede na Graphika poročilo, razvijalci orodij za slačenje z umetno inteligenco oglašujejo na družbenih omrežjih, da bi potencialne uporabnike pripeljali do svojih spletnih mest, zasebnega klepeta Telegram ali strežnikov Discord, kjer je mogoče najti orodja.

"Nekateri ponudniki so v svojih dejavnostih odkriti, navajajo, da opravljajo storitve 'slečenja' in kot dokaz objavljajo fotografije ljudi, za katere trdijo, da so bili 'slečeni'," so zapisali pri Graphiki. "Drugi so manj eksplicitni in se predstavljajo kot umetniške storitve AI ali fotogalerije Web3, medtem ko v svoje profile in objave vključujejo ključne izraze, povezane s sintetičnimi NCII."

Medtem ko se AI pri slačenju običajno osredotoča na slike, se AI uporablja tudi za ustvarjanje video deepfakes z uporabo podobe slavnih, vključno z YouTubovo osebnostjo G. Zver in kultni hollywoodski igralec Tom Hanks.

Nekaterim igralcem je všeč Scarlett Johansson in indijski igralec Anil kapoor se lotevajo pravnega sistema za boj proti nenehni grožnji AI deepfakes. Kljub temu pa lahko glavni zabavljači pridobijo več medijske pozornosti, zabavljači za odrasle pravijo, da se njihov glas redko sliši.

"Res je težko," je legendarna igralka za odrasle in vodja oddelka za odnose z javnostmi Tovarne zvezd, Tanya Tate, Rekel Dešifriraj prej. "Če je nekdo v mainstreamu, sem prepričan, da je veliko lažje."

Tudi brez vzpona umetne inteligence in tehnologije deepfake je Tate pojasnila, da so družbeni mediji že polni lažnih računov, ki uporabljajo njeno verjetnost in vsebino. Ne pomaga tudi stalna stigma, s katero se soočajo spolne delavke in delavci, zaradi česar so oni in njihovi oboževalci prisiljeni ostati v senci.

Oktobra je britanska družba za nadzor interneta Internet Watch Foundation (IWF) v ločenem poročilu ugotovila, da je bilo na enem temnem spletnem forumu v samo enem mesecu najdenih več kot 20,254 slik zlorabe otrok. IWF je opozoril, da bi lahko otroška pornografija, ustvarjena z umetno inteligenco, "Premagati” internet.

Zahvaljujoč napredku v generativnem slikanju z umetno inteligenco, IWF opozarja, da deepfake pornografija je napredovala do te mere, da je ugotavljanje razlike med slikami, ustvarjenimi z umetno inteligenco, in avtentičnimi slikami postalo vse bolj zapleteno, zaradi česar organi kazenskega pregona preganjajo spletne fantome namesto dejanskih žrtev zlorab.

"Torej obstaja tista stalna stvar, ko ne morete zaupati, ali so stvari resnične ali ne," je za Internet Watch Foundation povedal tehnični direktor Dan Sexton. Dešifrirajt. "Stvari, ki nam bodo povedale, ali so stvari resnične ali ne, niso 100 %, zato jim tudi ne morete zaupati."

Kar zadeva Ewinga, je Kotaku poročal, da se je streamer vrnil in povedal, da dela z novinarji, tehnologi, raziskovalci in ženskami, ki jih je incident prizadel od njegovega prestopka v januar. Ewing je tudi povedal, da je poslal sredstva odvetniški pisarni Ryana Morrisona s sedežem v Los Angelesu, Morrison Cooper, za zagotavljanje pravnih storitev kateri koli ženski na Twitchu, ki je potrebovala njihovo pomoč pri izdaji obvestil o odstranitvi spletnim mestom, ki objavljajo njene slike.

Ewing je dodal, da je raziskavo o globini vprašanja deepfake prejel od skrivnostne raziskovalke deepfake Genevieve Oh.

"Poskušal sem najti 'svetle točke' v boju proti tej vrsti vsebine," je dejal Ewing.

Uredil Ryan Ozawa.

Bodite na tekočem s kripto novicami, prejemajte dnevne posodobitve v svoj nabiralnik.

- Distribucija vsebine in PR s pomočjo SEO. Okrepite se še danes.

- PlatoData.Network Vertical Generative Ai. Opolnomočite se. Dostopite tukaj.

- PlatoAiStream. Web3 Intelligence. Razširjeno znanje. Dostopite tukaj.

- PlatoESG. Ogljik, CleanTech, Energija, Okolje, sončna energija, Ravnanje z odpadki. Dostopite tukaj.

- PlatoHealth. Obveščanje o biotehnologiji in kliničnih preskušanjih. Dostopite tukaj.

- vir: https://decrypt.co/209181/ai-undressing-deepfake-nude-services-skyrocket-in-popularity