Amazonsko razumevanje je storitev obdelave naravnega jezika (NLP), ki jo lahko uporabite za samodejno ekstrahiranje entitet, ključnih fraz, jezika, čustev in drugih vpogledov iz dokumentov. Takoj lahko na primer začnete zaznavati entitete, kot so ljudje, kraji, komercialni predmeti, datumi in količine prek Konzola Amazon Comprehend, Vmesnik ukazne vrstice AWSali Vmesniki API-jev Amazon. Poleg tega, če morate ekstrahirati entitete, ki niso del Vgrajene vrste entitet Amazon Comprehend, lahko ustvarite model za prepoznavanje entitet po meri (znan tudi kot entiteta po meri prepoznavalec), da izvlečete izraze, ki so pomembnejši za vaš poseben primer uporabe, kot so imena elementov iz kataloga izdelkov, identifikatorji, specifični za domeno, itd. Samostojno ustvarjanje natančnega prepoznavalnika entitet z uporabo knjižnic in ogrodij za strojno učenje je lahko zapleten in dolgotrajen postopek. Amazon Comprehend znatno poenostavi vaše delo pri usposabljanju modelov. Vse kar morate storiti je, da naložite svoj nabor podatkov dokumentov in opomb ter uporabite konzolo Amazon Comprehend, AWS CLI ali API-je za ustvarjanje modela.

Za usposabljanje prepoznavalnika entitet po meri lahko Amazonu Comprehend posredujete podatke o usposabljanju kot opombe ali sezname entitet. V prvem primeru zagotovite zbirko dokumentov in datoteko z opombami, ki določajo lokacijo, kjer se entitete pojavljajo znotraj nabora dokumentov. Druga možnost je, da s seznami entitet zagotovite seznam entitet z njihovo ustrezno oznako tipa entitete in niz dokumentov brez opomb, v katerih pričakujete, da bodo vaše entitete prisotne. Oba pristopa je mogoče uporabiti za usposabljanje uspešnega modela za prepoznavanje entitet po meri; vendar obstajajo situacije, v katerih je lahko ena metoda boljša izbira. Na primer, kadar je lahko pomen določenih entitet dvoumen in odvisen od konteksta, je priporočljivo, da zagotovite opombe, ker vam lahko to pomaga ustvariti model Amazon Comprehend, ki lahko bolje uporablja kontekst pri ekstrahiranju entitet.

Označevanje dokumentov lahko zahteva precej truda in časa, še posebej, če upoštevate, da tako kakovost kot količina opomb vplivata na nastali model prepoznavanja entitet. Nenatančne ali premajhne opombe lahko povzročijo slabe rezultate. Da bi vam pomagali vzpostaviti postopek za pridobivanje opomb, nudimo orodja, kot so Amazon SageMaker Ground Truth, ki ga lahko uporabite za hitrejše komentiranje vaših dokumentov in ustvarjanje razširjena datoteka z opombami manifesta. Toda tudi če uporabljate Ground Truth, se morate še vedno prepričati, da je vaš nabor podatkov o usposabljanju dovolj velik za uspešno izgradnjo vašega prepoznavalnika entitet.

Do danes ste morali za začetek usposabljanja prepoznavalnika entitet po meri Amazon Comprehend zagotoviti zbirko najmanj 250 dokumentov in najmanj 100 opomb na vrsto entitete. Danes oznanjamo, da smo zaradi nedavnih izboljšav v modelih, na katerih temelji Amazon Comprehend, zmanjšali minimalne zahteve za usposabljanje prepoznavalnika z datotekami opomb CSV z navadnim besedilom. Zdaj lahko zgradite model za prepoznavanje entitete po meri s samo tremi dokumenti in 25 opombami na vrsto entitete. Dodatne podrobnosti o novih omejitvah storitev najdete v Smernice in kvote.

Da bi prikazali, kako vam lahko to zmanjšanje pomaga pri začetku ustvarjanja prepoznavalnika entitet po meri, smo izvedli nekaj testov na nekaj odprtokodnih naborih podatkov in zbrali meritve uspešnosti. V tej objavi vas vodimo skozi postopek primerjalne analize in rezultate, ki smo jih pridobili med delom na podvzorčenih naborih podatkov.

Priprava nabora podatkov

V tej objavi pojasnjujemo, kako smo usposobili prepoznavanje entitet po meri Amazon Comprehend z uporabo označenih dokumentov. Na splošno se opombe lahko zagotovijo kot a Datoteka CSV, razširjena manifestna datoteka, ki jo je ustvaril Ground TruthAli Datoteka PDF. Naš poudarek je na opombah CSV z navadnim besedilom, ker je to vrsta opomb, na katero vplivajo nove minimalne zahteve. Datoteke CSV morajo imeti naslednjo strukturo:

Ustrezna polja so naslednja:

- file – Ime datoteke, ki vsebuje dokumente

- vrstica – Številka vrstice, ki vsebuje entiteto, začenši z vrstico 0

- Začnite Odmik – Odmik znaka v vhodnem besedilu (glede na začetek vrstice), ki kaže, kje se začne entiteta, glede na to, da je prvi znak na položaju 0

- Končni odmik – Odmik znaka v vhodnem besedilu, ki prikazuje, kje se konča entiteta

- tip – Ime vrste entitete, ki jo želite definirati

Poleg tega morate pri uporabi tega pristopa zagotoviti zbirko dokumentov za usposabljanje kot datoteke .txt z enim dokumentom na vrstico ali enim dokumentom na datoteko.

Za naše teste smo uporabili Merilo razumevanja naravnega jezika SNIPS, nabor podatkov množičnih izjav, porazdeljenih med sedem namenov uporabnikov (AddToPlaylist, BookRestaurant, GetWeather, PlayMusic, RateBook, SearchCreativeWork, SearchScreeningEvent). Nabor podatkov je bil objavljen leta 2018 v okviru prispevka Snips Voice Platform: vdelan sistem za razumevanje govorjenega jezika za zasebne glasovne vmesnike po zasnovi od Coucke, et al.

Nabor podatkov SNIPS je sestavljen iz zbirke datotek JSON, ki zgoščajo opombe in neobdelane besedilne datoteke. Sledi delček iz nabora podatkov:

Pred ustvarjanjem našega prepoznavalnika entitet smo preoblikovali opombe SNIPS in neobdelane besedilne datoteke v datoteko z opombami CSV in datoteko dokumentov .txt.

Sledi odlomek iz našega annotations.csv datoteka:

Sledi odlomek iz našega documents.txt datoteka:

Konfiguracija vzorčenja in postopek primerjalne analize

Za naše poskuse smo se osredotočili na podnabor vrst entitet iz nabora podatkov SNIPS:

- BookRestaurant – Vrste entitet:

spatial_relation,poi,party_size_number,restaurant_name,city,timeRange,restaurant_type,served_dish,party_size_description,country,facility,state,sort,cuisine - GetWeather – Vrste entitet:

condition_temperature,current_location,geographic_poi,timeRange,state,spatial_relation,condition_description,city,country - Predvajaj glasbo – Vrste entitet:

track,artist,music_item,service,genre,sort,playlist,album,year

Poleg tega smo podvzorčili vsak nabor podatkov, da smo pridobili različne konfiguracije v smislu števila dokumentov, vzorčenih za usposabljanje, in števila opomb na entiteto (znano tudi kot posnetkov). To je bilo storjeno z uporabo skripta po meri, zasnovanega za ustvarjanje podvzorčenih naborov podatkov, v katerih se vsaka vrsta entitete pojavi vsaj k krat, v najmanj n dokumenti.

Vsak model je bil usposobljen z uporabo posebnega podvzorca podatkovnih nizov za usposabljanje; devet konfiguracij modela je prikazanih v naslednji tabeli.

| Ime podvzorčenega nabora podatkov | Število dokumentov, vzorčenih za usposabljanje | Število dokumentov, vzorčenih za testiranje | Povprečno število pripisov na vrsto entitete (posnetki) |

snips-BookRestaurant-subsample-A |

132 | 17 | 33 |

snips-BookRestaurant-subsample-B |

257 | 33 | 64 |

snips-BookRestaurant-subsample-C |

508 | 64 | 128 |

snips-GetWeather-subsample-A |

91 | 12 | 25 |

snips-GetWeather-subsample-B |

185 | 24 | 49 |

snips-GetWeather-subsample-C |

361 | 46 | 95 |

snips-PlayMusic-subsample-A |

130 | 17 | 30 |

snips-PlayMusic-subsample-B |

254 | 32 | 60 |

snips-PlayMusic-subsample-C |

505 | 64 | 119 |

Za merjenje natančnosti naših modelov smo zbrali metrike vrednotenja, ki jih Amazon Comprehend samodejno izračuna pri usposabljanju prepoznavalca entitet:

- Precision – To označuje delež entitet, ki jih je zaznal prepoznavalec in so pravilno identificirani in označeni. Z drugega zornega kota lahko natančnost definiramo kot tp / (tp + fp), Kjer tp je število resničnih pozitivnih rezultatov (pravilne identifikacije) in fp je število lažno pozitivnih rezultatov (napačne identifikacije).

- Recall – To označuje del entitet, prisotnih v dokumentih, ki so pravilno identificirani in označeni. Izračuna se kot tp / (tp + fn), Kjer tp je število resničnih pozitivnih in fn je število lažno negativnih (zgrešenih identifikacij).

- Ocena F1 – To je kombinacija metrike natančnosti in priklica, ki meri celotno natančnost modela. Rezultat F1 je harmonična sredina meritev natančnosti in priklica in se izračuna kot 2 * Natančnost * Priklic / (Natančnost + Priklic).

Za primerjavo uspešnosti naših prepoznavalcev entitet se osredotočamo na rezultate F1.

Glede na to, da glede na nabor podatkov in velikost podvzorca (v smislu števila dokumentov in posnetkov) lahko ustvarite različne podvzorce, smo ustvarili 10 podvzorcev za vsako od devetih konfiguracij, usposobili modele za prepoznavanje entitet, zbrali meritve uspešnosti in jih je povprečil z mikropovprečenjem. To nam je omogočilo, da smo dobili bolj stabilne rezultate, zlasti za nekaj podvzorcev.

Rezultati

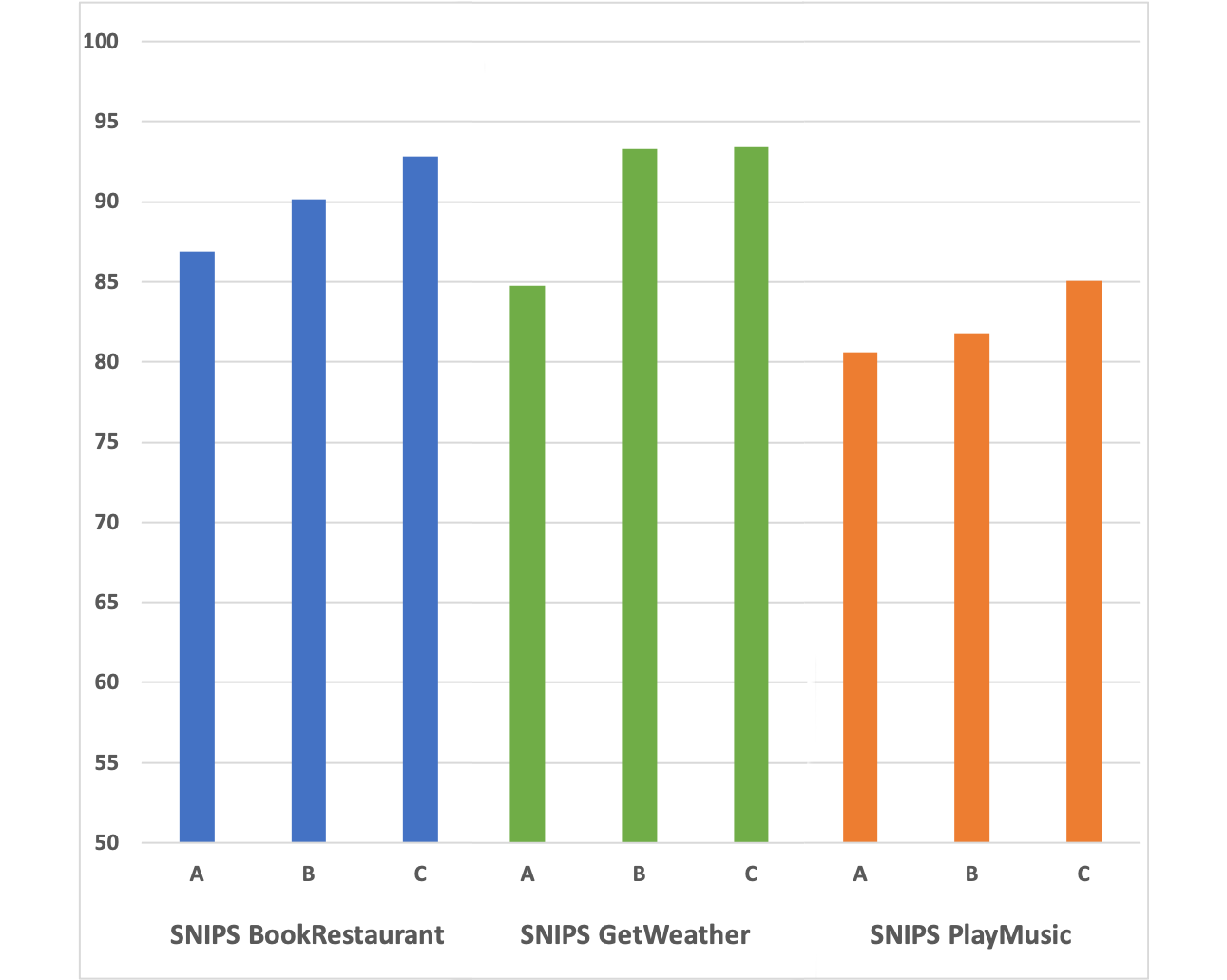

Naslednja tabela prikazuje mikropovprečne rezultate F1, izračunane na podlagi meritev uspešnosti, ki jih vrne Amazon Comprehend po usposabljanju vsakega prepoznavalca entitet.

| Ime podvzorčenega nabora podatkov | Mikropovprečna ocena F1 za prepoznavanje entitet (%) |

snips-BookRestaurant-subsample-A |

86.89 |

snips-BookRestaurant-subsample-B |

90.18 |

snips-BookRestaurant-subsample-C |

92.84 |

snips-GetWeather-subsample-A |

84.73 |

snips-GetWeather-subsample-B |

93.27 |

snips-GetWeather-subsample-C |

93.43 |

snips-PlayMusic-subsample-A |

80.61 |

snips-PlayMusic-subsample-B |

81.80 |

snips-PlayMusic-subsample-C |

85.04 |

Naslednji stolpčni grafikon prikazuje porazdelitev rezultatov F1 za devet konfiguracij, ki smo jih trenirali, kot je opisano v prejšnjem razdelku.

Opazimo lahko, da nam je uspelo uspešno usposobiti modele za prepoznavanje entitet po meri tudi s samo 25 opombami na vrsto entitete. Če se osredotočimo na tri najmanjše podvzorčene nize podatkov (snips-BookRestaurant-subsample-A, snips-GetWeather-subsample-Ain snips-PlayMusic-subsample-A), vidimo, da nam je v povprečju uspelo doseči oceno F1 84 %, kar je precej dober rezultat glede na omejeno število dokumentov in opomb, ki smo jih uporabili. Če želimo izboljšati delovanje našega modela, lahko zberemo dodatne dokumente in opombe ter usposobimo nov model z več podatki. Na primer pri srednje velikih podvzorcih (snips-BookRestaurant-subsample-B, snips-GetWeather-subsample-Bin snips-PlayMusic-subsample-B), ki vsebujejo dvakrat več dokumentov in opomb, smo v povprečju dobili oceno F1 88 % (5 % izboljšanje glede na subsample-A nabori podatkov). Končno, večji podvzorčeni nabori podatkov (snips-BookRestaurant-subsample-C, snips-GetWeather-subsample-Cin snips-PlayMusic-subsample-C), ki vsebujejo še več opomb z opombami (približno štirikratno število dokumentov in opomb, uporabljenih za subsample-A naborov podatkov), je zagotovil nadaljnjih 2 % izboljšav, s čimer se je povprečni rezultat F1 dvignil na 90 %.

zaključek

V tej objavi smo napovedali znižanje minimalnih zahtev za usposabljanje prepoznavalnika entitet po meri z Amazon Comprehend in izvedli nekaj primerjalnih preizkusov na odprtokodnih naborih podatkov, da pokažemo, kako vam lahko to zmanjšanje pomaga pri začetku. Od danes naprej lahko ustvarite model za prepoznavanje entitet z le 25 opombami na vrsto entitete (namesto 100) in vsaj tremi dokumenti (namesto 250). S to objavo znižujemo vstopno oviro za uporabnike, ki jih zanima uporaba tehnologije za prepoznavanje entitet po meri Amazon Comprehend. Zdaj lahko začnete izvajati svoje poskuse z zelo majhno zbirko dokumentov z opombami, analizirate predhodne rezultate in ponovite z vključitvijo dodatnih opomb in dokumentov, če potrebujete natančnejši model prepoznavanja entitet za vaš primer uporabe.

Če želite izvedeti več in začeti uporabljati prepoznavalnik entitet po meri, glejte Prepoznavanje entitete po meri.

Posebna zahvala kolegoma Jyoti Bansal in Jie Ma za njuno dragoceno pomoč pri pripravi podatkov in primerjalni analizi.

O avtorju

Luca Guida je arhitekt rešitev pri AWS; ima sedež v Milanu in podpira italijanske ISV-je pri njihovem potovanju v oblak. Z akademskim ozadjem iz računalništva in inženiringa je svojo strast do AI/ML začel razvijati na univerzi. Kot član skupnosti za obdelavo naravnega jezika (NLP) znotraj AWS Luca pomaga strankam, da so uspešne pri sprejemanju storitev AI/ML.

Luca Guida je arhitekt rešitev pri AWS; ima sedež v Milanu in podpira italijanske ISV-je pri njihovem potovanju v oblak. Z akademskim ozadjem iz računalništva in inženiringa je svojo strast do AI/ML začel razvijati na univerzi. Kot član skupnosti za obdelavo naravnega jezika (NLP) znotraj AWS Luca pomaga strankam, da so uspešne pri sprejemanju storitev AI/ML.

- AI

- ai art

- ai art generator

- imajo robota

- Amazonsko razumevanje

- Umetna inteligenca

- certificiranje umetne inteligence

- umetna inteligenca v bančništvu

- robot z umetno inteligenco

- roboti z umetno inteligenco

- programska oprema za umetno inteligenco

- Strojno učenje AWS

- blockchain

- blockchain konferenca ai

- coingenius

- pogovorna umetna inteligenca

- kripto konferenca ai

- dall's

- globoko učenje

- Srednje (200)

- strojno učenje

- platon

- platon ai

- Platonova podatkovna inteligenca

- Igra Platon

- PlatoData

- platogaming

- lestvica ai

- sintaksa

- zefirnet