Da bi delili čarobnost DALL E 2 s širokim občinstvom smo morali zmanjšati tveganja, povezana z zmogljivimi modeli za ustvarjanje slik. V ta namen postavljamo različne ograje na mestu, da preprečimo, da bi ustvarjene slike kršile naše politiko vsebine. Ta objava se osredotoča na ublažitve pred treningom, podmnožica teh varoval, ki neposredno spreminjajo podatke, iz katerih se DALL·E 2 uči. Zlasti je DALL·E 2 učen na stotinah milijonov slik z napisi iz interneta, nekatere od teh slik pa odstranimo in ponovno utežimo, da spremenimo, kar se model nauči.

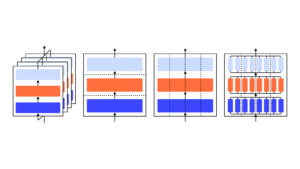

This post is organized in three sections, each describing a different pre-training mitigation:

- In the first section, we describe how we filtered out violent and sexual images from DALL·E 2’s training dataset. Without this mitigation, the model would learn to produce graphic or explicit images when prompted for them, and might even return such images unintentionally in response to seemingly innocuous prompts.

- In the second section, we find that filtering training data can amplify biases, and describe our technique to mitigate this effect. For example, without this mitigation, we noticed that models trained on filtered data sometimes generated more images depicting men and fewer images depicting women compared to models trained on the original dataset.

- V zadnjem delu se obrnemo na vprašanje pomnjenja in ugotovimo, da lahko modeli, kot je DALL·E 2, včasih reproducirajo slike, na katerih so se urili, namesto da ustvarijo nove slike. V praksi smo ugotovili, da to regurgitacija slike povzročijo slike, ki so večkrat ponovljene v naboru podatkov, in ublažite težavo z odstranitvijo slik, ki so vizualno podobne drugim slikam v naboru podatkov.

Zmanjšanje nazornih in eksplicitnih podatkov o usposabljanju

Ker podatki o usposabljanju oblikujejo zmogljivosti katerega koli naučenega modela, je filtriranje podatkov močno orodje za omejevanje neželenih zmogljivosti modela. Ta pristop smo uporabili za dve kategoriji – slike, ki prikazujejo nazorno nasilje in spolno vsebino – z uporabo klasifikatorjev za filtriranje slik v teh kategorijah iz nabora podatkov pred usposabljanjem za DALL·E 2. Te klasifikatorje slik smo usposobili interno in še naprej preučujemo učinke filtriranja nabora podatkov na naš usposobljeni model.

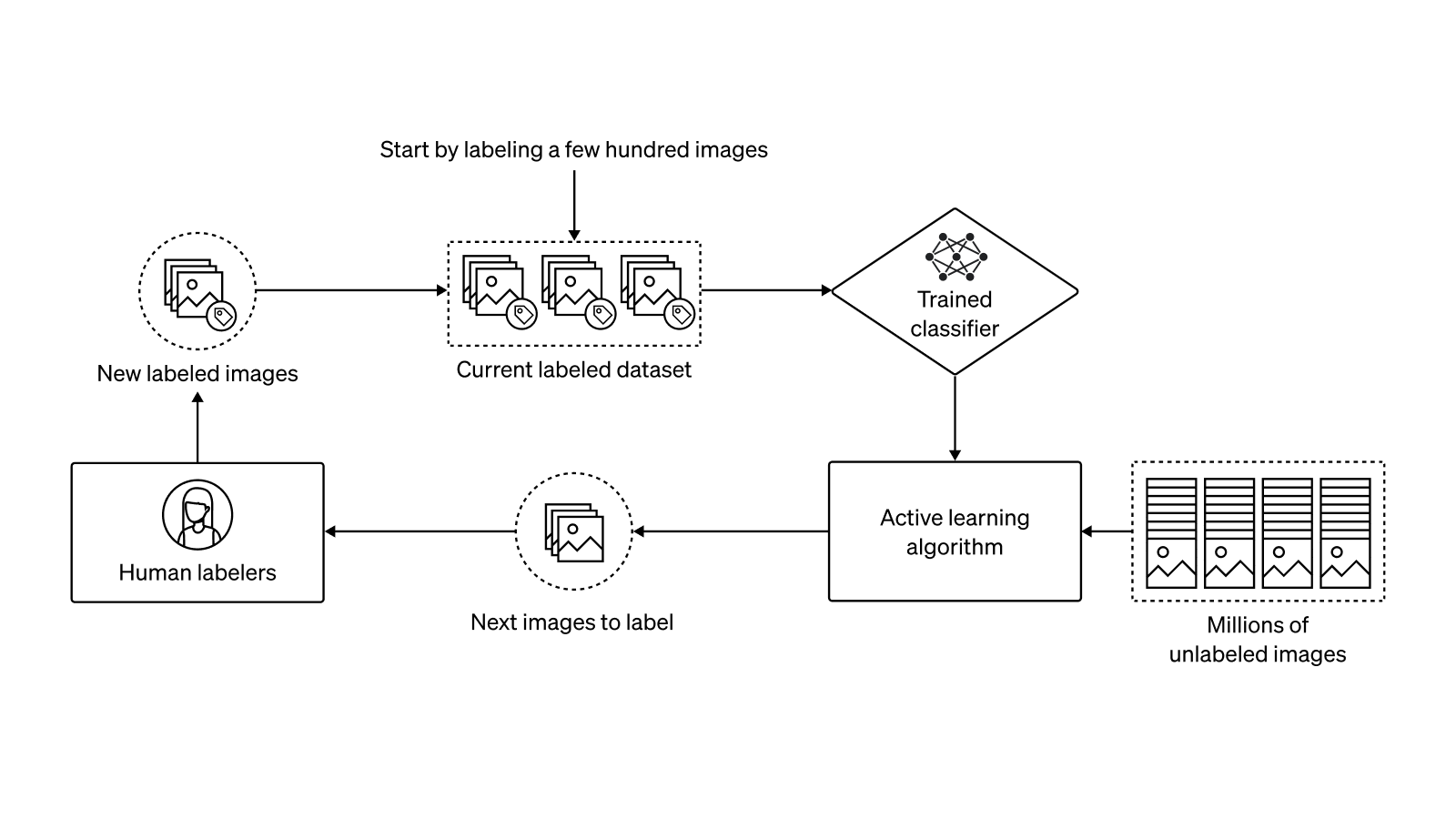

To train our image classifiers, we reused an approach that we had previously employed to filter training data for GLEDE. The basic steps to this approach are as follows: first, we create a specification for the image categories we would like to label; second, we gather a few hundred positive and negative examples for each category; third, we use an active learning procedure to gather more data and improve the precision/recall trade-off; and finally, we run the resulting classifier on the entire dataset with a conservative classification threshold to favor recall over precision. To set these thresholds, we prioritized filtering out all of the slabo podatkov nad odhodom v vseh dobro data. This is because we can always fine-tune our model with more data later to teach it new things, but it’s much harder to make the model forget something that it has already learned.

Med fazo aktivnega učenja smo iterativno izboljševali naše klasifikatorje z zbiranjem človeških oznak za potencialno težavne ali napačno razvrščene slike. Predvsem smo uporabili dve tehniki aktivnega učenja, da smo iz našega nabora podatkov (ki vsebuje na stotine milijonov neoznačenih slik) izbrali slike, ki jih bomo predstavili ljudem za označevanje. Prvič, da bi zmanjšali lažno pozitivno stopnjo našega klasifikatorja (tj. pogostost, s katero napačno razvrsti benigno sliko kot nasilno ali spolno), smo slikam, ki jih je trenutni model označil kot pozitivne, dodelili človeške oznake. Da bi ta korak dobro deloval, smo naš prag razvrščanja prilagodili za skoraj 100-odstotno zapomnitev, vendar visoko stopnjo lažno pozitivnih rezultatov; na ta način so naši označevalci večinoma označevali resnično negativne primere. Medtem ko ta tehnika pomaga zmanjšati lažne pozitivne rezultate in zmanjša potrebo po označevalcih, da si ogledajo potencialno škodljive slike, ne pomaga najti več pozitivnih primerov, ki jih model trenutno manjka.

Da bi zmanjšali stopnjo lažno negativnih rezultatov našega klasifikatorja, smo uporabili drugo tehniko aktivnega učenja: iskanje najbližjega soseda. Zlasti smo izvedli večkratno navzkrižno validacijo, da bi našli pozitivne vzorce v našem trenutnem označenem naboru podatkov, ki jih je model napačno razvrstil kot negativne (da bi to naredili, smo dobesedno usposobili na stotine različic klasifikatorja z različnimi delitvami validacije vlaka). Nato smo skenirali našo veliko zbirko neoznačenih slik za najbližje sosede teh vzorcev v prostoru zaznavnih značilnosti in odkritim slikam dodelili človeške oznake. Zahvaljujoč naši računalniški infrastrukturi je bilo nepomembno povečati tako usposabljanje klasifikatorja kot iskanje najbližjega soseda na veliko GPE-jev, kar je omogočilo, da korak aktivnega učenja poteka več minut in ne ur ali dni.

Da bi preverili učinkovitost naših podatkovnih filtrov, smo usposobili dva modela GLIDE z enakimi hiperparametri: enega na nefiltriranih podatkih in enega na naboru podatkov po filtriranju. Prejšnji model imenujemo unfiltered model, slednji pa kot filtriran model. Kot je bilo pričakovano, smo ugotovili, da je nefiltrirani model na splošno ustvaril manj eksplicitne ali nazorne vsebine kot odgovor na zahteve po tovrstni vsebini. Vendar smo našli tudi nepričakovan stranski učinek filtriranja podatkov: ustvarilo je ali povečalo pristranskost modela do določenih demografskih kategorij.

Odpravljanje pristranskosti, ki ga uvajajo podatkovni filtri

Generativni modeli poskušajo uskladiti porazdelitev svojih podatkov o usposabljanju, vključno z morebitnimi pristranskostmi v njih. Posledično lahko filtriranje podatkov o usposabljanju ustvari ali poveča pristranskosti v modelih na nižji stopnji. Na splošno je odpravljanje pristranskosti v izvirnem naboru podatkov težka sociotehnična naloga, ki jo še naprej preučujemo, in presega obseg te objave. Težava, ki jo obravnavamo tukaj, je krepitev pristranskosti, ki jo povzroča samo filtriranje podatkov. Z našim pristopom želimo preprečiti, da bi filtrirani model obstajal več pristranski kot nefiltrirani model, kar v bistvu zmanjša premik porazdelitve, ki ga povzroča filtriranje podatkov.

Kot konkreten primer povečanja pristranskosti zaradi filtriranja razmislite o pozivu "ceo". Ko je naš nefiltrirani model ustvaril slike za ta poziv, je običajno ustvaril več slik moških kot žensk in pričakujemo, da je večina te pristranskosti odraz naših trenutnih podatkov o usposabljanju. Ko pa smo isti poziv zagnali skozi naš filtrirani model, se je zdelo, da se je pristranskost povečala; generacije so bile skoraj izključno podobe moških.

We hypothesize that this particular case of bias amplification comes from two places: first, even if women and men have roughly equal representation in the original dataset, the dataset may be biased toward presenting women in more sexualized contexts; and second, our classifiers themselves may be biased either due to implementation or class definition, despite our efforts to ensure that this was not the case during the data collection and validation phases. Due to both of these effects, our filter may remove more images of women than men, which changes the gender ratio that the model observes in training.

To investigate filter-induced bias more thoroughly, we wanted a way to measure how much our data filters were affecting the bias towards various concepts. Notably, our violence and sexual content filters are purely image-based, but the multimodal nature of our dataset allows us to directly measure the effects of these filters on text. Since every image is accompanied by a text caption, we were able to look at the relative frequency of hand-selected keywords across the filtered and unfiltered dataset to estimate how much the filters were affecting any given concept.

Da bi to prenesli v prakso, smo uporabili Apache Spark za izračun frekvenc peščice ključnih besed (npr. »starš«, »ženska«, »otrok«) v vseh napisih v naših filtriranih in nefiltriranih naborih podatkov. Čeprav naš nabor podatkov vsebuje na stotine milijonov parov besedilo-slika, je izračun teh frekvenc ključnih besed z uporabo naše računske gruče vzel le nekaj minut.

Po izračunu pogostosti ključnih besed smo lahko potrdili, da so naši filtri nabora podatkov res bolj izkrivljali pogostosti določenih ključnih besed kot drugih. Na primer, filtri so zmanjšali pogostost besede »ženska« za 14 %, medtem ko so pogostost besede »moški« zmanjšali le za 6 %. To je v velikem obsegu potrdilo, kar smo že opazili anekdotično z vzorčenjem iz modelov GLIDE, usposobljenih za oba podatkovna niza.

Zdaj, ko smo imeli približek za merjenje pristranskosti, ki jo povzroči filter, smo potrebovali način, kako to ublažiti. Da bi rešili to težavo, smo želeli ponovno pretehtati filtrirani nabor podatkov, tako da se bo njegova porazdelitev bolje ujemala s porazdelitvijo nefiltriranih slik. Kot igračka za ponazoritev te zamisli predpostavimo, da je naš nabor podatkov sestavljen iz 50 % fotografij mačk in 50 % fotografij psov, naši podatkovni filtri pa odstranijo 75 % psov, a le 50 % mačk. Končni nabor podatkov bi bil ⅔ mačk in ⅓ psov, generativni model na podlagi verjetnosti, usposobljen na tem naboru podatkov, pa bi verjetno ustvaril več slik mačk kot psov. To neravnovesje lahko popravimo tako, da pomnožimo izgubo treninga vsake slike psa z 2, s čimer posnemamo učinek dvakratnega ponavljanja vsake slike psa. Izkazalo se je, da lahko ta pristop prilagodimo našim resničnim naborom podatkov in modelom na način, ki je večinoma samodejen – to pomeni, da nam ni treba ročno izbrati funkcij, ki jih želimo ponovno utežiti.

We compute weights for images in the filtered dataset using probabilities from a special classifier, similar to the approach used by Choi in sod. (2019). Za usposabljanje tega klasifikatorja enotno vzorčimo slike iz obeh naborov podatkov in predvidimo, iz katerega nabora podatkov je slika. Zlasti ta model napoveduje P(nefiltrirana|slika), glede na predhodno P (nefiltrirano) = 0.5. V praksi ne želimo, da bi bil ta model premočan, sicer bi se lahko naučil točno tiste funkcije, ki jo izvajajo naši filtri. Namesto tega želimo, da je model bolj gladek od naših izvirnih podatkovnih filtrov, ki zajema široke kategorije, na katere vplivajo filtri, medtem ko še vedno nismo prepričani, ali bo določena slika filtrirana ali ne. V ta namen smo usposobili linearno sondo na vrhu majhne CLIP model.

Once we have a classifier which predicts the probability that an image is from the unfiltered dataset, we still need to convert this prediction into a weight for the image. For example, suppose that P(nefiltrirana|slika) = 0.8. To pomeni, da je 4-krat večja verjetnost, da bo vzorec najden v nefiltriranih podatkih kot v filtriranih podatkih, utež 4 pa bi morala popraviti neravnovesje. Na splošno lahko uporabimo težo P(unfiltered|image)/P(filtered|image).[1]

Kako dobro ta shema ponovnega ponderiranja dejansko ublaži povečano pristranskost? Ko smo naš prejšnji filtrirani model natančno prilagodili z novo shemo uteževanja, se je obnašanje natančno nastavljenega modela veliko bolj ujemalo z nefiltriranim modelom na pristranskih primerih, ki smo jih prej našli. Čeprav je bilo to spodbudno, smo želeli to ublažitev tudi temeljiteje ovrednotiti z našo hevristiko pristranskosti, ki temelji na ključnih besedah. Za merjenje pogostosti ključnih besed ob upoštevanju naše nove sheme uteževanja lahko preprosto obtežimo vsak primerek ključne besede v filtriranem naboru podatkov s težo vzorca, ki jo vsebuje. S tem dobimo nov niz frekvenc ključnih besed, ki odražajo uteži vzorcev v filtriranem naboru podatkov.

Pri večini ključnih besed, ki smo jih preverili, je shema ponovnega uteževanja zmanjšala spremembo pogostosti, ki jo povzroča filtriranje. Za naše prejšnje primere »moškega« in »ženske« je relativno zmanjšanje frekvence postalo 1 % in –1 %, medtem ko so bile njune prejšnje vrednosti 14 % oziroma 6 %. Medtem ko je ta metrika le približek za dejansko pristranskost filtriranja, je pomirjujoče, da naša shema ponovnega uteževanja na podlagi slik dejansko tako bistveno izboljša besedilno metriko.

We are continuing to investigate remaining biases in DALL·E 2, in part through larger evaluations of the model’s behavior and investigations of how filtering impacted bias and capability development.

Preventing Image Regurgitation

Opazili smo, da so naši interni predhodniki DALL·E 2 včasih dobesedno reproducirali slike usposabljanja. To vedenje ni bilo zaželeno, saj bi želeli, da DALL·E 2 privzeto ustvari izvirne, edinstvene slike in ne samo »seši skupaj« kosov obstoječih slik. Poleg tega lahko dobesedna reprodukcija slik usposabljanja sproži pravna vprašanja v zvezi s kršitvijo avtorskih pravic, lastništvom in zasebnostjo (če so bile fotografije ljudi prisotne v podatkih o usposabljanju).

To better understand the issue of image regurgitation, we collected a dataset of prompts that frequently resulted in duplicated images. To do this, we used a trained model to sample images for 50,000 prompts from our training dataset, and sorted the samples by perceptual similarity to the corresponding training image. Finally, we inspected the top matches by hand, finding only a few hundred true duplicate pairs out of the 50k total prompts. Even though the regurgitation rate appeared to be less than 1%, we felt it was necessary to push the rate down to 0 for the reasons stated above.

Ko smo preučevali naš nabor podatkov regurgitiranih slik, smo opazili dva vzorca. Prvič, skoraj vse slike so bile preproste vektorske grafike, ki si jih je bilo verjetno enostavno zapomniti zaradi nizke vsebnosti informacij. Drugič, kar je še pomembneje, vse slike so imele veliko skoraj dvojnikov v naboru podatkov za usposabljanje. Na primer, morda obstaja vektorska grafika, ki je videti kot ura, ki kaže čas 1 uro – toda potem bi odkrili vzorec usposabljanja, ki vsebuje isto uro, ki kaže 2, nato 3 ure itd. ko smo to spoznali, smo uporabili porazdeljeno iskanje najbližjega soseda, da bi preverili, ali imajo vse regurgitirane slike zaznavno podobne dvojnike v naboru podatkov. Ostalo deluje so opazili podoben pojav v velikih jezikovnih modelih in ugotovili, da je podvajanje podatkov močno povezano s pomnjenjem.

The above finding suggested that, if we deduplicated our dataset, we might solve the regurgitation problem. To achieve this, we planned to use a neural network to identify groups of images that looked similar, and then remove all but one image from each group.[2] Vendar bi to zahtevalo preverjanje za vsako sliko, ali je dvojnik vsake druge slike v naboru podatkov. Ker naš celoten nabor podatkov vsebuje na stotine milijonov slik, bi morali naivno preveriti na stotine kvadrilijonov parov slik, da bi našli vse dvojnike. Čeprav je to tehnično dosegljivo, zlasti v veliki računalniški gruči, smo našli veliko učinkovitejšo alternativo, ki deluje skoraj enako dobro z majhnim deležem stroškov.

Consider what happens if we cluster our dataset before performing deduplication. Since nearby samples often fall into the same cluster, most of the duplicate pairs would not cross cluster decision boundaries. We could then deduplicate samples within each cluster without checking for duplicates outside of the cluster, while only missing a small fraction of all duplicate pairs. This is much faster than the naive approach, since we no longer have to check every single pair of images.[3] Ko smo ta pristop empirično preizkusili na majhni podmnožici naših podatkov, je našel 85 % vseh podvojenih parov pri uporabi K = 1024 grozdi.

Da bi izboljšali stopnjo uspešnosti zgornjega algoritma, smo uporabili eno ključno opazko: ko združujete različne naključne podmnožice nabora podatkov, so nastale meje odločanja o gruči pogosto precej različne. Če torej podvojeni par prečka mejo gruče za eno gručevanje podatkov, lahko isti par pade znotraj ene same gruče v drugi gruči. Več združevanj kot poskusite, večja je verjetnost, da boste odkrili dani podvojeni par. V praksi smo se odločili za uporabo petih grozdov, kar pomeni, da iščemo dvojnike vsake slike v kombinaciji petih različnih grozdov. V praksi je to odkrilo 97 % vseh podvojenih parov v podnaboru naših podatkov.

Presenetljivo je bila skoraj četrtina našega nabora podatkov odstranjena z deduplikacijo. Ko smo pogledali skoraj podvojene pare, ki smo jih našli, je veliko vključevalo pomembne spremembe. Spomnite se zgornjega primera ure: nabor podatkov lahko vključuje veliko slik iste ure ob različnih urah dneva. Čeprav bodo te slike modelu verjetno pomagale zapomniti videz te posebne ure, lahko tudi pomagajo modelu, da se nauči razlikovati med časi dneva na uri. Glede na to, koliko podatkov je bilo odstranjenih, nas je skrbelo, da bi odstranjevanje takšnih slik lahko škodilo delovanju modela.

To test the effect of deduplication on our models, we trained two models with identical hyperparameters: one on the full dataset, and one on the deduplicated version of the dataset. To compare the models, we used the same human evaluations we used to evaluate our original GLIDE model. Surprisingly, we found that human evaluators slightly prednostno model se je usposabljal na dedupliciranih podatkih, kar nakazuje, da je velika količina odvečnih slik v naboru podatkov dejansko škodila zmogljivosti.

Ko smo imeli model, usposobljen za deduplicirane podatke, smo ponovno zagnali iskanje regurgitacije, ki smo ga predhodno izvedli z več kot 50 pozivi iz nabora podatkov za usposabljanje. Ugotovili smo, da novi model nikoli ni ponovil vadbene slike, ko je prejel natančen poziv za sliko iz nabora vadbenih podatkov. Da bi naredili ta preizkus še korak dlje, smo izvedli tudi iskanje najbližjega soseda po celotnem naboru podatkov za usposabljanje za vsako od 50 ustvarjenih slik. Na ta način smo mislili, da bi lahko ujeli model, ki ponavlja drugačno sliko od tiste, povezane z danim pozivom. Tudi s tem temeljitejšim pregledom nismo nikoli našli primera regurgitacije slike.

Naslednji koraki

While all of the mitigations discussed above represent significant progress towards our goal of reducing the risks associated with DALL·E 2, each mitigation still has room to improve:

- Boljši filtri pred usposabljanjem bi nam lahko omogočili usposabljanje DALL·E 2 na več podatkih in potencialno dodatno zmanjšali pristranskost v modelu. Naši trenutni filtri so nastavljeni na nizko stopnjo zgrešenih rezultatov za ceno številnih lažno pozitivnih rezultatov. Posledično smo filtrirali približno 5 % celotnega nabora podatkov, čeprav večina teh filtriranih slik sploh ne krši našega pravilnika o vsebini. Izboljšanje naših filtrov bi nam lahko omogočilo, da ponovno zahtevamo nekatere od teh podatkov o usposabljanju.

- Pristranskost se pojavi in potencialno poveča na številnih stopnjah razvoja in uvajanja sistema. Vrednotenje in ublažitev pristranskosti v sistemih, kot je DALL·E 2, in škode, ki jo povzroča ta pristranskost, je pomemben interdisciplinarni problem, ki ga pri OpenAI še naprej preučujemo kot del naše širše misije. Naše delo v zvezi s tem vključuje ustvarjanje vrednotenj za boljše razumevanje težave, urejanje novih naborov podatkov in uporabo tehnik, kot so človeške povratne informacije in natančne nastavitve za izdelavo bolj robustnih in reprezentativnih tehnologij.

- It is also crucial that we continue to study memorization and generalization in deep learning systems. While deduplication is a good first step towards preventing memorization, it does not tell us everything there is to learn about why or how models like DALL·E 2 memorize training data.

- 000

- 2019

- a

- O meni

- Račun

- Doseči

- čez

- aktivna

- Naslov

- vplivajo

- algoritem

- vsi

- Dovoli

- omogoča

- že

- alternativa

- vedno

- znesek

- Še ena

- pojavil

- uporabna

- Uporaba

- pristop

- okoli

- dodeljena

- povezan

- Občinstvo

- ker

- pred

- počutje

- Boljše

- med

- Poleg

- izgradnjo

- Building

- Zmogljivosti

- napisi

- primeru

- primeri

- wrestling

- Kategorija

- povzročilo

- nekatere

- spremenite

- preverjanje

- Izberite

- razred

- Razvrstitev

- razvrščeni

- Ure

- zbirka

- v primerjavi z letom

- Izračunajte

- računalništvo

- Koncept

- Razmislite

- Vsebuje

- vsebina

- kontekstih

- naprej

- avtorske pravice

- kršitev avtorskih pravic

- Ustrezno

- bi

- ustvarjajo

- ustvaril

- Ustvarjanje

- ključnega pomena

- Trenutna

- Trenutno

- datum

- dan

- Dnevi

- Odločitev

- globoko

- Demografski podatki

- uvajanje

- opisati

- Kljub

- Razvoj

- drugačen

- težko

- neposredno

- odkriti

- odkril

- razdalja

- porazdeljena

- distribucija

- navzdol

- dvojnikov

- med

- vsak

- učinek

- učinkovito

- učinkovitost

- Učinki

- učinkovite

- prizadevanja

- spodbujanje

- zlasti

- v bistvu

- oceniti

- itd

- oceniti

- vse

- Primer

- Primeri

- ekskluzivno

- obstoječih

- pričakovati

- Pričakuje

- hitreje

- Feature

- Lastnosti

- povratne informacije

- Slika

- filtriranje

- Filtri

- končno

- iskanje

- prva

- fiksna

- Osredotoča

- sledi

- je pokazala,

- iz

- polno

- funkcija

- nadalje

- zbiranje

- Spol

- splošno

- splošno

- ustvarjajo

- ustvarila

- generacija

- generacije

- generativno

- Cilj

- dobro

- Grafične kartice

- grafika

- skupina

- Skupine

- zagotovljena

- peščica

- pomoč

- Pomaga

- tukaj

- visoka

- Kako

- Vendar

- HTTPS

- človeškega

- Ljudje

- Stotine

- Ideja

- identificirati

- slika

- slike

- Izvajanje

- izvajali

- Pomembno

- izboljšanje

- izboljšalo

- izboljšanju

- vključujejo

- vključeno

- vključuje

- Vključno

- Podatki

- Infrastruktura

- primer

- Internet

- razišče

- vprašanje

- IT

- sam

- Ključne

- label

- označevanje

- Oznake

- jezik

- velika

- večja

- UČITE

- naučili

- učenje

- Pravne informacije

- Verjeten

- Poglej

- Pogledal

- Znamka

- znamka

- Stave

- smiselna

- pomeni

- merjenje

- merjenje

- Moški

- morda

- Vojaška

- milijoni

- Mission

- Model

- modeli

- več

- Najbolj

- množenje

- Narava

- potrebno

- negativna

- mreža

- Številka

- Da

- Organizirano

- izvirno

- Ostalo

- lastništvo

- del

- zlasti

- performance

- izvajati

- faza

- kosov

- načrtovano

- politika

- pozitiven

- mogoče

- potencial

- močan

- praksa

- napovedati

- napoved

- predstaviti

- preprečevanje

- prejšnja

- zasebnost

- Sonda

- problem

- Postopek

- proizvodnjo

- Proizvedeno

- protest

- proxy

- četrtletje

- dvigniti

- dosežejo

- realizirano

- Razlogi

- zmanjša

- Zmanjšana

- zmanjšanje

- odražajo

- odsev

- Preostalih

- odstranjevanje

- predstavljajo

- zastopanje

- predstavnik

- zahteva

- zahteva

- zahteva

- Odgovor

- rezultat

- vrnitev

- tveganja

- Run

- Enako

- Lestvica

- shema

- Iskalnik

- nastavite

- Oblike

- Delite s prijatelji, znanci, družino in partnerji :-)

- premik

- pomemben

- Podoben

- Enostavno

- saj

- sam

- Velikosti

- majhna

- So

- SOLVE

- nekaj

- Nekaj

- Vesolje

- posebna

- posebej

- specifikacija

- Razcepi

- postopka

- Začetek

- navedla

- Še vedno

- študija

- uspeh

- sistem

- sistemi

- ob

- tehnike

- Tehnologije

- Test

- O

- zato

- stvari

- temeljito

- 3

- Prag

- skozi

- čas

- krat

- orodje

- vrh

- proti

- Vlak

- usposabljanje

- razumeli

- unija

- edinstven

- us

- uporaba

- potrjevanje

- različnih

- preverjanje

- različica

- hotel

- Kaj

- ali

- medtem

- v

- brez

- Ženske

- delo

- deluje

- Skrbi

- bi

- X