Na kratko Nova pravila, ki jih je pripravila Evropska unija in so namenjena urejanju umetne inteligence, bi lahko razvijalcem preprečila izdajo odprtokodnih modelov, trdi ameriški think tank Brookings.

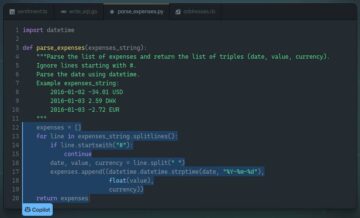

O predlagano Zakon EU o umetni inteligenci, ki še ni podpisan, navaja, da morajo odprtokodni razvijalci zagotoviti, da je njihova programska oprema umetne inteligence točna, varna in pregledna glede tveganj in uporabe podatkov v jasni tehnični dokumentaciji.

Brookings trdi če bi zasebno podjetje uvedlo javni model ali ga uporabilo v izdelku in bi nekako zašlo v težave zaradi nepredvidenih ali nenadzorovanih učinkov modela, bi podjetje potem verjetno poskušalo okriviti odprtokodne razvijalce in jih tožiti .

To bi lahko prisililo odprtokodno skupnost, da dvakrat premisli o izdaji svoje kode, in bi na žalost pomenilo, da bodo razvoj umetne inteligence vodila zasebna podjetja. Lastniško kodo je težko analizirati in graditi na njej, kar pomeni, da bodo inovacije ovirane.

Oren Etzioni, odhajajoči izvršni direktor Allen Institute of AI, meni, da za odprtokodne razvijalce ne bi smela veljati enaka stroga pravila kot za programske inženirje v zasebnih podjetjih.

»Odprtokodni razvijalci ne bi smeli biti podvrženi enakemu bremenu kot razvijalci komercialne programske opreme. Vedno bi moralo veljati, da je brezplačna programska oprema lahko na voljo "takšna, kot je" – razmislite o primeru enega samega študenta, ki razvija zmogljivost umetne inteligence; ne morejo si privoščiti izpolnjevanja predpisov EU in bodo morda prisiljeni, da ne bodo distribuirali svoje programske opreme, kar bo negativno vplivalo na akademski napredek in ponovljivost znanstvenih rezultatov,« je dejal. Rekel TechCrunch.

Novi rezultati MLPerf za sklepanje so na voljo

Rezultati za letni inferenčni test MLPerf, ki primerja zmogljivost čipov AI različnih proizvajalcev pri številnih nalogah v različnih konfiguracijah, so bili objavljeno ta teden.

Letos so poročali o skoraj neverjetnih 5,300 rezultatih delovanja in 2,400 meritvah porabe energije za sklepanje v podatkovnem središču in robnih napravah. Preizkusi preverjajo, kako hitro lahko sistem strojne opreme izvaja določen model strojnega učenja. Hitrost obdelave podatkov je navedena v preglednicah.

Ni presenetljivo, da je Nvidia tudi letos na vrhu lestvice. »GPU-ji Nvidia H100 Tensor Core so v svojem prvem nastopu na standardnih merilih umetne inteligence MLPerf postavili svetovne rekorde pri sklepanju na vse delovne obremenitve, pri čemer zagotavljajo do 4.5-krat večjo zmogljivost kot grafični procesorji prejšnje generacije,« je zapisala Nvidia v objavi na blogu. "Rezultati kažejo, da je Hopper najboljša izbira za uporabnike, ki zahtevajo največjo zmogljivost pri naprednih modelih AI."

Čeprav v izzivu MLPerf sodeluje vse več prodajalcev, je težko dobiti dobro predstavo o konkurenci. Letos na primer ni poročil o rezultatih za Googlove čipe TPU v podatkovnih centrih. Vendar se zdi, da Google ace Trening tekmovanje MLPerf v začetku tega leta.

Umetniki z umetno inteligenco odkrijejo grozljiv obraz, ki se skriva za sliko

Viralna nit na Twitterju, ki jo je objavil digitalni umetnik, razkriva, kako nenavadni so lahko modeli besedila v sliko pod površjem.

Mnogi uporabniki interneta so našli veselje in obup v eksperimentiranju s temi sistemi za ustvarjanje slik s tipkanjem besedilnih pozivov. Obstajajo vrste vdorov za prilagajanje rezultatov modelov; eden od njih, znan kot »negativni poziv«, omogoča uporabnikom, da najdejo nasprotno sliko od tiste, ki je opisana v pozivu.

Ko je umetnik, ki se na Twitterju imenuje Supercomposite, našel negativen predlog za tisto, kar je opisalo nedolžno videti sliko ponarejenega logotipa, je našel nekaj resnično grozljivega: obraz nečesa, kar je videti kot preganjana ženska. Supercomposite je to žensko, ki jo je ustvarila umetna inteligenca, poimenoval "Loab" in ko so njene slike križali z drugimi, so bile vedno videti kot prizor iz grozljivke.

🧵: I discovered this woman, who I call Loab, in April. The AI reproduced her more easily than most celebrities. Her presence is persistent, and she haunts every image she touches. CW: Take a seat. This is a true horror story, and veers sharply macabre. pic.twitter.com/gmUlf6mZtk

— Supercomposite (@supercomposite) September 6, 2022

Superkompozit povedal El Reg naključne slike ljudi, ki jih ustvari umetna inteligenca, se lahko pogosto prikažejo v negativnih pozivih. Čudno vedenje je še še en primer nekaterih nenavadnih lastnosti, ki jih lahko imajo ti modeli, ki jih ljudje šele začenjajo raziskovati.

Izvršni direktor Sundar Pichai pravi, da pri Googlu ni čutečih klepetalnih robotov

Sundar Pichai je nasprotoval trditvam nekdanjega inženirja Blakea Lemoina, da je Google zgradil čutečega klepetalnika med njegovim govorom na konferenci Code ta teden.

Lemoine je julija prišel na naslovnice, ko je razglasitve mislil je, da je Googlov klepetalni robot LaMDA pri zavesti in da ima morda dušo. Bil je kasneje odpuščen ker je domnevno kršil politiko zasebnosti podjetja, potem ko je najel odvetnika za klepet z LaMDA in ocenil njene zakonske pravice, pri čemer je trdil, da mu je to naročil stroj.

Večina ljudi – vključno z izvršnim direktorjem Googla – se ne strinja z Lemoinom. »Še vedno mislim, da je pot še dolga. Počutim se, kot da se pogosto zapletam v filozofske ali metafizične pogovore o tem, kaj je občutek in kaj je zavest,« je dejal Pichai, po do Fortune. "Smo daleč od tega in morda nikoli ne bomo dosegli tega," je dodal.

Da bi še bolj poudaril svoje stališče, je priznal, da Googlov glasovni pomočnik z umetno inteligenco včasih ne razume zahtev in se nanje ne odzove ustrezno. »Dobra novica je, da vsakdo, ki se pogovarja z Googlovim pomočnikom – čeprav mislim, da je najboljši pomočnik za pogovorno umetno inteligenco – še vedno vidi, kako pokvarjen je v določenih primerih,« je dejal. ®

- AI

- ai art

- ai art generator

- imajo robota

- Umetna inteligenca

- certificiranje umetne inteligence

- umetna inteligenca v bančništvu

- robot z umetno inteligenco

- roboti z umetno inteligenco

- programska oprema za umetno inteligenco

- blockchain

- blockchain konferenca ai

- coingenius

- pogovorna umetna inteligenca

- kripto konferenca ai

- dall's

- globoko učenje

- strojno učenje

- platon

- platon ai

- Platonova podatkovna inteligenca

- Igra Platon

- PlatoData

- platogaming

- lestvica ai

- sintaksa

- Register

- zefirnet