Video Googlov največji jezikovni model umetne inteligence pomaga robotom, da so bolj prilagodljivi pri razumevanju in tolmačenju človeških ukazov, kaže zadnja raziskava spletnega velikana.

Stroji se običajno najbolje odzivajo na zelo specifične zahteve – odprte zahteve jih lahko včasih zavrnejo in vodijo do rezultatov, ki jih uporabniki niso imeli v mislih. Ljudje se naučijo komunicirati z roboti na tog način, na primer postavljati vprašanja na določen način, da dobijo želeni odgovor.

Googlov najnovejši sistem, poimenovan PaLM-SayCan, pa obljublja, da bo pametnejši. Fizična naprava podjetja Everyday Robots – zagonskega podjetja, ki je izšlo iz Google X – ima kamere za oči v glavi in roko s kleščami, spravljeno za dolgo ravno telo, ki sedi na vrhu niza koles.

Delovanje robota si lahko ogledate v spodnjem videu:

Vprašanje robota, nekaj takega kot "Pravkar sem telovadil, mi lahko priskrbiš zdrav prigrizek?" ga bo potisnil, da bo prinesel jabolko. »PaLM-SayCan [je] interpretabilen in splošen pristop k izkoriščanju znanja iz jezikovnih modelov, ki robotu omogoča, da sledi besedilnim navodilom na visoki ravni za izvajanje fizično utemeljenih nalog,« so raziskovali znanstveniki iz Googlove ekipe Brain razložiti.

Google je predstavil svoj največji jezikovni model PaLM aprila letos. PaLM je bil učen na podatkih, postrganih iz interneta, vendar je bil sistem namesto odprtih besedilnih odgovorov prilagojen tako, da ustvari seznam navodil, ki jih mora slediti robot.

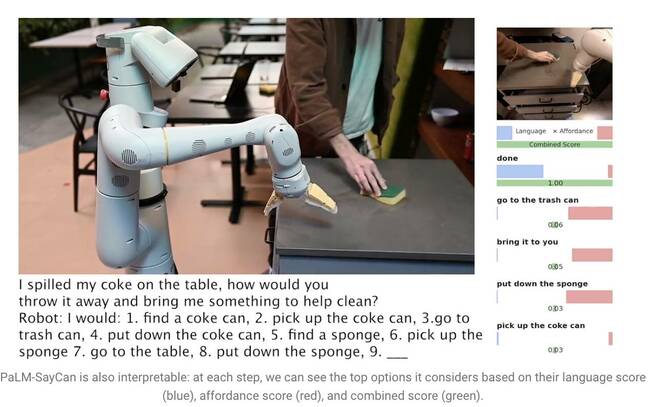

Če rečete »Svojo kokakolo sem razlil po mizi, kako bi jo vrgel stran in mi prinesel nekaj za pomoč pri čiščenju?«, PaLM spodbudi k razumevanju vprašanja in ustvarjanju seznama korakov, ki jim lahko robot sledi, da dokonča nalogo, na primer prehod čez da poberem pločevinko, jo vržem v koš in dobim gobo.

Veliki jezikovni modeli (LLM), kot je PaLM, pa ne razumejo pomena ničesar, kar povedo. Iz tega razloga so raziskovalci usposobili ločen model z uporabo ojačitvenega učenja za utemeljitev abstraktnega jezika v vizualne predstavitve in dejanja. Tako se robot nauči povezovati besedo "Coke" s podobo pločevinke z gazirano pijačo.

PaLM-SayCan se nauči tudi tako imenovanih "funkcij dostopnosti" – metode, ki razvršča možnost dokončanja določenega dejanja glede na predmete v svojem okolju. Robot bo bolj verjetno pobral gobo kot sesalnik, na primer, če zazna gobo, vendar v njeni bližini ni vakuuma.

»Naša metoda, SayCan, pridobiva in izkorišča znanje znotraj LLM-jev pri fizično utemeljenih nalogah,« je ekipa pojasnila v raziskovalna naloga. »LLM (Say) zagotavlja podlago za nalogo za določitev koristnih dejanj za cilj na visoki ravni, naučene funkcije dostopnosti (Can) pa zagotavljajo svetovno podlago za določitev, kaj je mogoče izvesti po načrtu. Učenje s krepitvijo (RL) uporabljamo kot način za učenje jezikovno pogojenih vrednostnih funkcij, ki zagotavljajo možnosti tega, kar je v svetu mogoče.”

Da robot ne bi zašel z naloge, je usposobljen za izbiro dejanj samo iz 101 različnih navodil. Google ga je usposobil za prilagajanje kuhinji – PaLM-SayCan lahko dobi prigrizke, pijačo in izvaja preprosta opravila čiščenja. Raziskovalci verjamejo, da so LLM prvi korak pri pridobivanju robotov za varno opravljanje bolj zapletenih nalog ob abstraktnih navodilih.

»Naši poskusi na številnih robotskih nalogah v resničnem svetu dokazujejo sposobnost načrtovanja in dokončanja dolgoročnih, abstraktnih navodil v naravnem jeziku z visoko stopnjo uspešnosti. Verjamemo, da interpretabilnost PaLM-SayCan omogoča varno interakcijo uporabnika z roboti v realnem svetu,« so zaključili. ®

- AI

- ai art

- ai art generator

- imajo robota

- Umetna inteligenca

- certificiranje umetne inteligence

- umetna inteligenca v bančništvu

- robot z umetno inteligenco

- roboti z umetno inteligenco

- programska oprema za umetno inteligenco

- blockchain

- blockchain konferenca ai

- coingenius

- pogovorna umetna inteligenca

- kripto konferenca ai

- dall's

- globoko učenje

- strojno učenje

- platon

- platon ai

- Platonova podatkovna inteligenca

- Igra Platon

- PlatoData

- platogaming

- lestvica ai

- sintaksa

- Register

- zefirnet