Predstavitev

Učiteljica v razredu vam verjetno ni pokazala, kako seštevate 20-mestna števila. Če pa znate seštevati manjša števila, potrebujete le papir in svinčnik ter malo potrpljenja. Začnite z enicami in korak za korakom delajte levo in kmalu boste z lahkoto zlagali kvintiljone.

Takšne težave so za človeka lahke, a le, če se jih lotimo na pravi način. »Ljudje rešujemo te težave tako, da ne 'strmimo vanj in nato zapišemo odgovor',« je rekel Eran Malach, raziskovalec strojnega učenja na univerzi Harvard. "Pravzaprav gremo skozi korake."

Ta vpogled je navdihnil raziskovalce, ki preučujejo velike jezikovne modele, ki poganjajo chatbote, kot je ChatGPT. Medtem ko bi ti sistemi lahko reševali vprašanja, ki vključujejo nekaj korakov aritmetike, bodo pogosto zmotili težave, ki vključujejo veliko korakov, kot je izračun vsote dveh velikih števil. Toda leta 2022 je ekipa Googlovih raziskovalcev je pokazala, da je zahteva od jezikovnih modelov, da ustvarijo rešitve po korakih, omogočila modelom reševanje problemov, ki so se prej zdeli zunaj njihovega dosega. Njihova tehnika, imenovana spodbujanje verige misli, je kmalu postala razširjena, čeprav so se raziskovalci trudili razumeti, zakaj deluje.

Zdaj je več skupin raziskalo moč sklepanja v verigi misli z uporabo tehnik iz skrivnostne veje teoretičnega računalništva, imenovane teorija računalniške kompleksnosti. To je zadnje poglavje v vrsti raziskav, ki uporabljajo teorijo kompleksnosti za preučevanje intrinzičnih zmožnosti in omejitev jezikovnih modelov. Ta prizadevanja pojasnjujejo, kje lahko pričakujemo, da bodo modeli neuspešni, in lahko kažejo na nove pristope k njihovi izdelavi.

"Odstranijo nekaj čarovnije," je rekel Dimitris Papailiopoulos, raziskovalec strojnega učenja na Univerzi Wisconsin v Madisonu. "To je dobra stvar."

Usposabljanje transformatorjev

Veliki jezikovni modeli so zgrajeni okoli matematičnih struktur, imenovanih umetne nevronske mreže. Številni »nevroni« v teh omrežjih izvajajo preproste matematične operacije na dolgih nizih številk, ki predstavljajo posamezne besede, in vsako besedo, ki gre skozi omrežje, pretvorijo v drugo. Podrobnosti te matematične alkimije so odvisne od drugega niza številk, imenovanih parametri omrežja, ki kvantificirajo moč povezav med nevroni.

Da bi usposobili jezikovni model za ustvarjanje koherentnih rezultatov, raziskovalci običajno začnejo z nevronsko mrežo, katere vsi parametri imajo naključne vrednosti, nato pa ji posredujejo množico podatkov iz vsega interneta. Vsakič, ko model vidi nov blok besedila, poskuša predvideti vsako besedo po vrsti: drugo besedo ugane na podlagi prve, tretjo na podlagi prvih dveh in tako naprej. Vsako napoved primerja z dejanskim besedilom, nato prilagodi svoje parametre, da zmanjša razliko. Vsaka prilagoditev le malenkost spremeni napovedi modela, vendar njihov skupni učinek nekako omogoči, da se model skladno odzove na vnose, ki jih še ni videl.

Raziskovalci že 20 let usposabljajo nevronske mreže za obdelavo jezika. Toda delo se je resnično začelo leta 2017, ko so Googlovi raziskovalci predstavili a nova vrsta omrežja imenovan transformator.

"To je bilo predlagano pred sedmimi leti, kar se zdi kot prazgodovina," je dejal Pablo Barceló, raziskovalec strojnega učenja na Papeški katoliški univerzi v Čilu.

Kar je transformatorje naredilo tako transformativne, je to, da jih je enostavno povečati – povečati število parametrov in količino podatkov o usposabljanju – ne da bi bilo usposabljanje pretirano drago. Pred transformatorji so imele nevronske mreže največ nekaj sto milijonov parametrov; danes imajo največji transformatorski modeli več kot trilijon. Velik del izboljšav v zmogljivosti jezikovnega modela v zadnjih petih letih izvira iz preprostega povečevanja.

Transformerji so to omogočili z uporabo posebnih matematičnih struktur, imenovanih pozornost glave, ki jim dajejo nekakšen pogled iz ptičje perspektive na besedilo, ki ga berejo. Ko pretvornik prebere nov blok besedila, njegove pozornostne glave hitro pregledajo celotno zadevo in prepoznajo ustrezne povezave med besedami - morda ob upoštevanju, da sta četrta in osma beseda verjetno najbolj uporabni za napovedovanje desete. Nato pazljive glave posredujejo besede ogromni mreži nevronov, imenovani omrežje za naprej, ki opravi močno drobljenje števil, potrebno za ustvarjanje napovedi, ki mu pomagajo pri učenju.

Pravi transformatorji imajo več plasti pozornostnih glav, ločenih z omrežji za naprej, in izpljunejo napovedi šele po zadnji plasti. Toda na vsaki plasti so pozornostne glave že identificirale najbolj relevanten kontekst za vsako besedo, tako da se lahko računalniško intenziven korak naprej izvede istočasno za vsako besedo v besedilu. To pospeši proces usposabljanja, kar omogoča usposabljanje transformatorjev na vse večjih nizih podatkov. Še pomembneje pa je, da raziskovalcem omogoča, da porazdelijo ogromno računalniško obremenitev usposabljanja ogromne nevronske mreže na številne procesorje, ki delujejo v tandemu.

Če želite kar najbolje izkoristiti ogromne nize podatkov, morate "modele narediti res velike," pravijo David Chiang, raziskovalec strojnega učenja na Univerzi Notre Dame. "Enostavno jih ne bo praktično usposobiti, razen če je vzporedno."

Vendar pa vzporedna struktura, zaradi katere je tako enostavno trenirati transformatorje, ne pomaga po usposabljanju – takrat ni treba predvidevati besed, ki že obstajajo. Med običajnim delovanjem transformatorji oddajo eno besedo naenkrat, pri čemer vsak izhod vrnejo nazaj na vhod, preden ustvarijo naslednjo besedo, vendar so še vedno obtičali z arhitekturo, optimizirano za vzporedno obdelavo.

Ko so modeli, ki temeljijo na transformatorjih, rasli in so jim nekatere naloge še naprej povzročale težave, so se nekateri raziskovalci začeli spraševati, ali je prizadevanje za bolj vzporedne modele imelo svojo ceno. Ali je bilo mogoče teoretično razumeti obnašanje transformatorjev?

Kompleksnost transformatorjev

Teoretične študije nevronskih mrež se soočajo s številnimi težavami, zlasti ko poskušajo upoštevati usposabljanje. Nevronske mreže uporabljajo dobro znan postopek za prilagoditev svojih parametrov na vsakem koraku procesa usposabljanja. Toda težko je razumeti, zakaj ta preprost postopek konvergira na dobrem nizu parametrov.

Namesto da bi razmišljali o tem, kaj se zgodi med usposabljanjem, nekateri raziskovalci preučujejo notranje zmožnosti transformatorjev tako, da si predstavljajo, da je mogoče njihove parametre prilagoditi poljubnim vrednostim. To pomeni, da transformator obravnavamo kot posebno vrsto programabilnega računalnika.

»Imate neko računalniško napravo in želite vedeti, 'No, kaj zmore? Katere vrste funkcij lahko izračuna?'« je dejal Chiang.

To so osrednja vprašanja v formalnem študiju računanja. Področje sega v leto 1936, ko si je Alan Turing prvič zamislil a domišljijska naprava, ki se zdaj imenuje Turingov stroj, ki bi lahko izvajal kakršno koli računanje z branjem in pisanjem simbolov na neskončnem traku. Teoretiki računalniške kompleksnosti bodo kasneje gradili na Turingovem delu z dokazovanjem, da računalniški problemi seveda spadajo v različne razredi zahtevnosti ki jih določajo viri, potrebni za njihovo rešitev.

Leta 2019 sta Barceló in dva druga raziskovalca dokazano da bi bila lahko idealizirana različica transformatorja s fiksnim številom parametrov prav tako močna kot Turingov stroj. Če transformator nastavite tako, da svoj izhod vedno znova vrača kot vhod, in parametre nastavite na ustrezne vrednosti za specifično težavo, ki jo želite rešiti, bo sčasoma izdal pravilen odgovor.

Ta rezultat je bil izhodišče, vendar je temeljil na nekaterih nerealnih predpostavkah, ki bi verjetno precenile moč transformatorjev. V letih od takrat so si raziskovalci prizadevali za razvoj bolj realističnih teoretičnih okvirov.

Eno takih prizadevanj se je začelo leta 2021, ko William Merrill, zdaj podiplomski študent na Univerzi v New Yorku, je zapuščal dvoletno štipendijo na Allenovem inštitutu za umetno inteligenco v Seattlu. Medtem ko je bil tam, je analiziral druge vrste nevronskih mrež z uporabo tehnik, ki so se zdele kot slabe za vzporedno arhitekturo transformatorjev. Malo pred odhodom je začel pogovor z raziskovalcem Allen Institute for AI Ashish Sabharwal, ki je študiral teorijo kompleksnosti, preden se je posvetil raziskavam umetne inteligence. Začeli so sumiti, da bi jim lahko teorija kompleksnosti pomagala razumeti omejitve transformatorjev.

»Zdelo se je le, da gre za preprost model; mora obstajati nekaj omejitev, ki jih je mogoče preprosto določiti,« je dejal Sabharwal.

Par je analiziral transformatorje z uporabo veje teorije računalniške kompleksnosti, imenovane kompleksnost vezja, ki se pogosto uporablja za preučevanje vzporednega računanja in je imel nedavno uporabljena do poenostavljenih različic transformatorjev. V naslednjem letu so izboljšali več nerealnih predpostavk prejšnjega dela. Da bi preučili, kako bi vzporedna struktura transformatorjev lahko omejila njihove zmožnosti, sta par obravnavala primer, ko transformatorji svojega izhoda niso vrnili nazaj v svoj vhod - namesto tega bi moral biti njihov prvi izhod končni odgovor. Oni dokazano da transformatorji v tem teoretičnem okviru ne morejo rešiti nobenih računalniških problemov, ki ležijo zunaj določenega kompleksnega razreda. Številni matematični problemi, vključno z relativno preprostimi, kot je reševanje linearnih enačb, naj bi bili izven tega razreda.

V bistvu so pokazali, da ima vzporednost svojo ceno - vsaj ko so transformatorji morali takoj izpljuniti odgovor. "Transformatorji so precej šibki, če jih uporabljate tako, da dajete vnos in pričakujete samo takojšen odgovor," je dejal Merrill.

Miselni eksperimenti

Rezultati Merrilla in Sabharwala so sprožili naravno vprašanje - koliko močnejši postanejo transformatorji, ko jim je dovoljeno reciklirati svoje rezultate? Barceló in njegovi soavtorji so preučevali ta primer v svoji analizi idealiziranih transformatorjev leta 2019, vendar je vprašanje z bolj realističnimi predpostavkami ostalo odprto. In v vmesnih letih so raziskovalci odkrili nagovarjanje v verigi misli, kar je dalo vprašanju novo odkrito pomembnost.

Merrill in Sabharwal sta vedela, da njun povsem matematični pristop ne more zajeti vseh vidikov razmišljanja v resničnih jezikovnih modelih, kjer je besedilo v pozivu je lahko zelo pomembno. Toda ne glede na to, kako je poziv ubeseden, dokler povzroči, da jezikovni model izpiše rešitve po korakih, lahko model načeloma ponovno uporabi rezultate vmesnih korakov pri naslednjih prehodih skozi transformator. To bi lahko zagotovilo način za izogibanje omejitvam vzporednega računanja.

Medtem je ekipa s pekinške univerze razmišljala podobno in njihovi preliminarni rezultati so bili pozitivni. V dokumentu iz maja 2023 so identificirali nekaj matematičnih problemov, ki naj bi bili nemogoči za običajne transformatorje v okviru Merrilla in Sabharwala, in je pokazala, da so vmesni koraki transformatorjem omogočili rešitev teh težav.

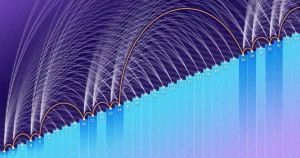

Oktobra sta Merrill in Sabharwal nadaljevala svoje prejšnje delo z a podrobna teoretična študija računske moči verige misli. Kvantificirali so, kako je ta dodatna računska moč odvisna od števila vmesnih korakov, ki jih sme transformator uporabiti, preden mora izpljuniti končni odgovor. Na splošno raziskovalci pričakujejo, da bo ustrezno število vmesnih korakov za rešitev katerega koli problema odvisno od velikosti vnosa v problem. Na primer, najpreprostejša strategija za seštevanje dveh 20-mestnih števil zahteva dvakrat toliko vmesnih korakov seštevanja kot enak pristop za seštevanje dveh 10-mestnih števil.

Takšni primeri kažejo, da transformatorji ne bi veliko pridobili z uporabo samo nekaj vmesnih korakov. Merrill in Sabharwal sta dejansko dokazala, da miselna veriga začne zares pomagati šele, ko število vmesnih korakov raste sorazmerno z velikostjo vložka, številni problemi pa zahtevajo, da se število vmesnih korakov še veliko poveča.

Temeljitost rezultata je navdušila raziskovalce. "To so res ugotovili," je rekel Daniel Hsu, raziskovalec strojnega učenja na univerzi Columbia.

Nedavno delo Merrilla in Sabharwala kaže, da miselna veriga ni rešitev - načeloma lahko transformatorjem pomaga pri reševanju težjih problemov, vendar le za ceno velikega računalniškega napora.

"Zanimajo nas različni načini, kako z enim korakom zaobiti omejitve transformatorjev," je dejal Merrill. "Veriga razmišljanja je eden od načinov, vendar ta dokument kaže, da to morda ni najbolj ekonomičen način."

Nazaj v resničnost

Kljub temu raziskovalci opozarjajo, da lahko tovrstna teoretična analiza razkrije le toliko o resničnih jezikovnih modelih. Pozitivni rezultati – dokazi, da lahko transformatorji načeloma rešijo določene probleme – ne pomenijo, da se bo jezikovni model dejansko naučil teh rešitev med usposabljanjem.

In tudi rezultati, ki obravnavajo omejitve transformatorjev, so opremljeni s pridržki: kažejo, da noben transformator ne more popolnoma rešiti določenih težav v vseh primerih. Seveda je to precej visoka letvica. "Morda obstajajo posebni primeri težave, ki bi jih lahko dobro rešil," je dejal Hsu.

Kljub tem opozorilom novo delo ponuja predlogo za analizo različnih vrst arhitektur nevronskih mrež, ki bi lahko sčasoma nadomestile transformatorje. Če analiza teorije kompleksnosti kaže, da so določene vrste omrežij močnejše od drugih, bi to dokaz, da bi se ta omrežja lahko bolje odrezala tudi v resničnem svetu.

Chiang je tudi poudaril, da so raziskave o omejitvah transformatorjev toliko bolj dragocene, saj se jezikovni modeli vse pogosteje uporabljajo v številnih aplikacijah v resničnem svetu, kar olajša precenjevanje njihovih sposobnosti.

"Pravzaprav je veliko stvari, ki jih ne počnejo tako dobro, in moramo se zelo, zelo zavedati, kakšne so omejitve," je dejal Chiang. "Zato je tovrstno delo res pomembno."

- Distribucija vsebine in PR s pomočjo SEO. Okrepite se še danes.

- PlatoData.Network Vertical Generative Ai. Opolnomočite se. Dostopite tukaj.

- PlatoAiStream. Web3 Intelligence. Razširjeno znanje. Dostopite tukaj.

- PlatoESG. Ogljik, CleanTech, Energija, Okolje, sončna energija, Ravnanje z odpadki. Dostopite tukaj.

- PlatoHealth. Obveščanje o biotehnologiji in kliničnih preskušanjih. Dostopite tukaj.

- vir: https://www.quantamagazine.org/how-chain-of-thought-reasoning-helps-neural-networks-compute-20240321/

- :ima

- : je

- :ne

- :kje

- ][str

- $GOR

- 10.

- 20

- 20 let

- 2017

- 2019

- 2021

- 2022

- 2023

- a

- sposobnosti

- O meni

- Račun

- čez

- dejanska

- dejansko

- dodajte

- dodajanje

- Poleg tega

- Naslov

- prilagodite

- po

- Avgust

- AI

- ai raziskave

- Alan

- Alan Turing

- Alkimija

- vsi

- allen

- dovoljene

- omogoča

- skupaj

- že

- Prav tako

- znesek

- zneski

- an

- Analiza

- analizirati

- analiziranje

- in

- Še ena

- odgovor

- kaj

- aplikacije

- pristop

- pristopi

- primerno

- samovoljna

- Skrivnosten

- Arhitektura

- arhitekture

- SE

- okoli

- umetni

- Umetna inteligenca

- AS

- sprašuje

- vidiki

- predpostavke

- At

- pozornosti

- stran

- nazaj

- bar

- temeljijo

- BE

- postal

- postanejo

- bilo

- pred

- začel

- se začne

- vedenje

- Boljše

- med

- Poleg

- Bit

- Block

- Branch

- izgradnjo

- Building

- zgrajena

- vendar

- by

- izračun

- se imenuje

- CAN

- Zmogljivosti

- zajemanje

- primeru

- primeri

- vzroki

- previdnost

- Osrednji

- nekatere

- verige

- Spremembe

- Poglavje

- klepetalnice

- ChatGPT

- Čile

- razred

- KOHERENTNO

- Kolektivna

- COLUMBIA

- kako

- prihaja

- kompleksnost

- računanje

- računalniški

- računska moč

- računsko

- Izračunajte

- računalnik

- Računalništvo

- računalništvo

- povezave

- Razmislite

- šteje

- ozadje

- naprej

- Pogovor

- popravi

- strošek

- bi

- Tečaj

- datum

- nabori podatkov

- Termini

- opredeljen

- odvisna

- odvisno

- Podrobnosti

- Razvoj

- naprava

- DID

- Razlika

- drugačen

- težko

- Težave

- odkril

- do

- ne

- Ne

- dont

- navzdol

- med

- vsak

- prej

- enostavnost

- lahka

- učinek

- prizadevanje

- prizadevanja

- Osmi

- omogočena

- omogoča

- ogromno

- enačbe

- zlasti

- izmikati

- Tudi

- sčasoma

- Tudi vsak

- dokazi

- Primer

- obstajajo

- pričakovati

- drago

- Raziskano

- dodatna

- Obraz

- FAIL

- Padec

- Nekaj

- Polje

- končna

- konec

- prva

- fit

- pet

- Všita

- sledili

- po

- za

- formalno

- Četrti

- Okvirni

- okviri

- iz

- funkcije

- Gain

- splošno

- ustvarjajo

- ustvarjajo

- dobili

- pridobivanje

- Daj

- Giving

- dogaja

- dobro

- prisodil

- razred

- diplomiral

- zrasla

- Grow

- raste

- imel

- ročaj

- se zgodi

- se zgodi

- težje

- harvard

- univerza Harvard

- Imajo

- he

- glave

- težka

- pomoč

- Pomaga

- visoka

- njegov

- Kako

- Kako

- http

- HTTPS

- Ljudje

- sto

- identificirati

- identificirati

- if

- predstavljal

- Takojšen

- Pomembno

- nemogoče

- navdušeni

- Izboljšanje

- in

- Vključno

- Povečajte

- vedno

- prav zares

- Navedite

- označuje

- individualna

- Neskončno

- ING

- vhod

- vhodi

- v notranjosti

- vpogled

- navdih

- Namesto

- Inštitut

- Intelligence

- zainteresirani

- Internet

- intervenirajo

- v

- intrinzično

- Uvedeno

- vključujejo

- IT

- ITS

- samo

- Otrok

- vrste

- Vedite

- jezik

- velika

- večja

- Največji

- Zadnja

- pozneje

- Zadnji

- plast

- plasti

- UČITE

- učenje

- vsaj

- odhodu

- laž

- kot

- Verjeten

- LIMIT

- omejitve

- Meje

- vrstica

- linearna

- linije

- obremenitev

- Long

- Sklop

- stroj

- strojno učenje

- je

- revije

- magic

- Znamka

- IZDELA

- Izdelava

- več

- ogromen

- math

- matematični

- Matter

- Maj ..

- Merrill

- morda

- milijonov

- Model

- modeli

- več

- Najbolj

- premikanje

- veliko

- več

- morajo

- naravna

- Nimate

- potrebna

- mreža

- omrežij

- Živčne

- nevronska mreža

- nevronske mreže

- Neuroni

- nikoli

- Novo

- NY

- Naslednja

- št

- Opažam

- zdaj

- Številka

- številke

- oktober

- of

- off

- Ponudbe

- pogosto

- on

- ONE

- tiste

- samo

- na

- odprite

- Delovanje

- operacije

- optimizirana

- redni

- Ostalo

- drugi

- ven

- izhod

- izhodi

- zunaj

- več

- par

- rešitev

- Papir

- vzporedno

- parametri

- mimo

- vozovnice

- preteklosti

- Potrpljenje

- Peking

- popolnoma

- Izvedite

- performance

- mogoče

- Kraj

- platon

- Platonova podatkovna inteligenca

- PlatoData

- Točka

- slaba

- pozitiven

- mogoče

- moč

- močan

- Praktično

- napovedati

- napovedovanje

- napoved

- Napovedi

- predhodno

- precej

- prejšnja

- prej

- Načelo

- verjetno

- problem

- Težave

- postopek

- Postopek

- obravnavati

- procesorji

- proizvodnjo

- programabilno

- dokazov

- Delež

- predlagano

- dokazano

- zagotavljajo

- dokazovanje

- izključno

- Push

- Quantamagazine

- količinsko določeno

- vprašanje

- vprašanja

- hitro

- precej

- postavljeno

- naključno

- območje

- dosežejo

- reading

- pravo

- resnični svet

- realistična

- Reality

- res

- nedavno

- zmanjša

- rafinirano

- relativno

- ustreznost

- pomembno

- ostalo

- odstrani

- PONOVNO

- zamenjajte

- predstavlja

- zahteva

- obvezna

- zahteva

- Raziskave

- raziskovalec

- raziskovalci

- viri

- Odzove

- povzroči

- Rezultati

- ponovna

- razkrivajo

- Pravica

- Je dejal

- Enako

- Lestvica

- skaliranje

- skeniranje

- <span style="color: #f7f7f7;">Šola</span>

- Znanost

- Seattle

- drugi

- zdelo

- Zdi se,

- videl

- vidi

- nastavite

- Kompleti

- sedem

- več

- Kmalu

- shouldnt

- Prikaži

- je pokazala,

- Razstave

- Podoben

- Enostavno

- poenostavljeno

- preprosto

- hkrati

- saj

- Velikosti

- manj

- So

- rešitve

- SOLVE

- Reševanje

- nekaj

- nekako

- Kmalu

- posebna

- specifična

- hitrosti

- namaz

- zlaganje

- Začetek

- Začetek

- Korak

- Koraki

- Še vedno

- Strategija

- moč

- Struktura

- strukture

- študent

- študiral

- Študije

- študija

- Študij

- kasneje

- taka

- predlagajte

- Predlaga

- sistemi

- Tandem

- Naloge

- skupina

- Skupine

- tehnika

- tehnike

- Predloga

- besedilo

- kot

- da

- O

- njihove

- Njih

- POTEM

- Teoretični

- Teorija

- Tukaj.

- te

- jih

- stvar

- stvari

- Razmišljanje

- tretja

- ta

- tisti,

- mislil

- skozi

- čas

- do

- danes

- vzel

- proti

- Vlak

- usposabljanje

- transformativno

- transformator

- transformatorji

- zdravljenje

- Bilijona

- Težava

- poskusite

- turing

- OBRAT

- poteg

- Poteg

- Dvakrat

- dva

- tip

- Vrste

- tipično

- razumeli

- univerza

- če

- uporaba

- Rabljeni

- koristno

- uporablja

- uporabo

- dragocene

- Vrednote

- različica

- različice

- zelo

- Poglej

- sprehod

- želeli

- je

- način..

- načini

- we

- šibko

- web

- webp

- Dobro

- dobro znana

- so bili

- Kaj

- kdaj

- ali

- ki

- medtem

- celoti

- katerih

- zakaj

- široka

- Širok spekter

- razširjen

- bo

- z

- brez

- Sprašujem

- beseda

- besedilo

- besede

- delo

- delal

- deluje

- svet

- bi

- pisati

- pisanje

- leto

- let

- york

- Vi

- zefirnet