AutoML vam omogoča pridobivanje hitrih splošnih vpogledov iz vaših podatkov takoj na začetku življenjskega cikla projekta strojnega učenja (ML). Vnaprejšnje razumevanje, katere tehnike predprocesiranja in vrste algoritmov zagotavljajo najboljše rezultate, zmanjša čas za razvoj, usposabljanje in uvajanje pravega modela. Ima ključno vlogo v razvojnem procesu vsakega modela in omogoča podatkovnim znanstvenikom, da se osredotočijo na najbolj obetavne tehnike ML. Poleg tega AutoML zagotavlja zmogljivost osnovnega modela, ki lahko služi kot referenčna točka za ekipo podatkovne znanosti.

Orodje AutoML za vaše podatke uporablja kombinacijo različnih algoritmov in različnih tehnik predprocesiranja. Na primer, lahko meri podatke, izvaja univariatno izbiro funkcij, izvaja PCA na različnih mejnih ravneh variance in uporablja združevanje v gruče. Takšne tehnike predprocesiranja bi lahko uporabili posamezno ali kombinirali v cevovodu. Pozneje bi orodje AutoML usposobilo različne vrste modelov, kot so linearna regresija, elastična mreža ali naključni gozd, na različnih različicah vašega vnaprej obdelanega nabora podatkov in izvedlo optimizacijo hiperparametrov (HPO). Amazonski SageMaker avtopilot odpravlja težko dviganje gradnje modelov ML. Ko zagotovi nabor podatkov, SageMaker Autopilot samodejno razišče različne rešitve, da poišče najboljši model. Kaj pa, če želite uvesti svojo prilagojeno različico poteka dela AutoML?

Ta objava prikazuje, kako ustvariti po meri izdelan potek dela AutoML na Amazon SageMaker uporabo Samodejno prilagajanje modela Amazon SageMaker z vzorčno kodo, ki je na voljo v a Repo za GitHub.

Pregled rešitev

Za ta primer uporabe predpostavimo, da ste del ekipe podatkovne znanosti, ki razvija modele v specializirani domeni. Razvili ste niz tehnik predprocesiranja po meri in izbrali številne algoritme, za katere običajno pričakujete, da bodo dobro delovali pri vaši težavi ML. Ko delate na novih primerih uporabe ML, bi radi najprej izvedli zagon AutoML z uporabo svojih tehnik predprocesiranja in algoritmov, da zožite obseg možnih rešitev.

V tem primeru ne uporabljate specializiranega nabora podatkov; namesto tega delate z naborom podatkov California Housing, iz katerega boste uvozili Preprosta storitev shranjevanja Amazon (Amazon S3). Poudarek je na predstavitvi tehnične izvedbe rešitve z uporabo SageMaker HPO, ki jo je mogoče kasneje uporabiti za kateri koli nabor podatkov in domeno.

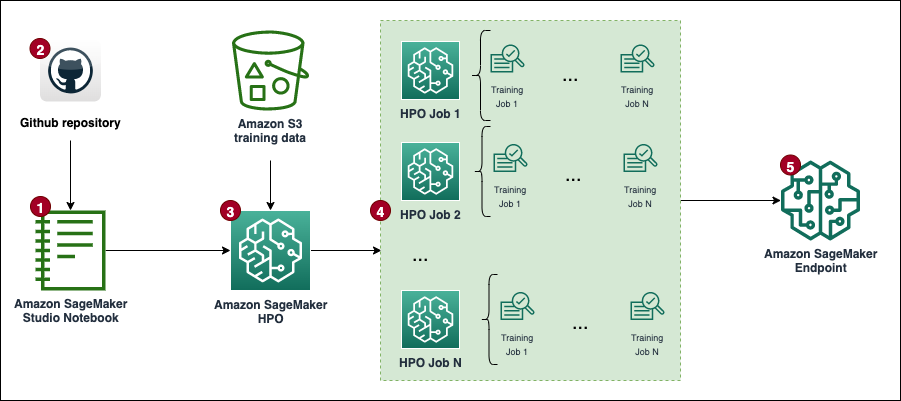

Naslednji diagram predstavlja celoten potek dela rešitve.

Predpogoji

Naslednji so predpogoji za dokončanje vodstva v tej objavi:

Izvedite rešitev

Celotna koda je na voljo v GitHub repo.

Koraki za implementacijo rešitve (kot je navedeno v diagramu poteka dela) so naslednji:

- Ustvari primerek zvezka in navedite naslednje:

- za Tip primerka zvezka, izberite ml.t3.srednje.

- za Elastični sklep, izberite none.

- za Identifikator platforme, izberite Amazon Linux 2, Jupyter Lab 3.

- za Vloga IAM, izberite privzeto

AmazonSageMaker-ExecutionRole. Če ne obstaja, ustvarite novega AWS upravljanje identitete in dostopa (IAM) in priložite Pravilnik IAM AmazonSageMakerFullAccess.

Upoštevajte, da bi morali v produkciji ustvariti izvajalsko vlogo in pravilnik z minimalnim obsegom.

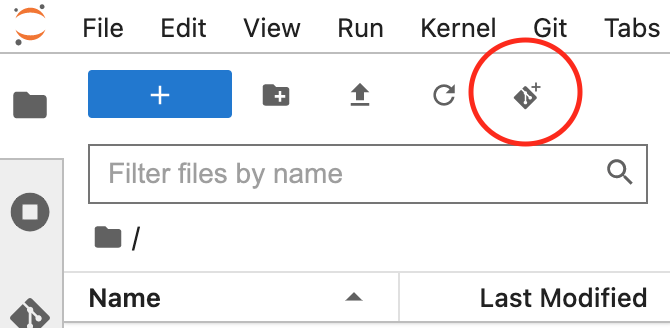

- Odprite vmesnik JupyterLab za vaš primerek prenosnega računalnika in klonirajte repo GitHub.

To lahko storite tako, da začnete novo terminalsko sejo in zaženete git clone <REPO> ali z uporabo funkcije uporabniškega vmesnika, kot je prikazano na naslednjem posnetku zaslona.

- odprite

automl.ipynbprenosno datoteko, izberiteconda_python3jedro in sledite navodilom za sprožitev a niz delovnih mest HPO.

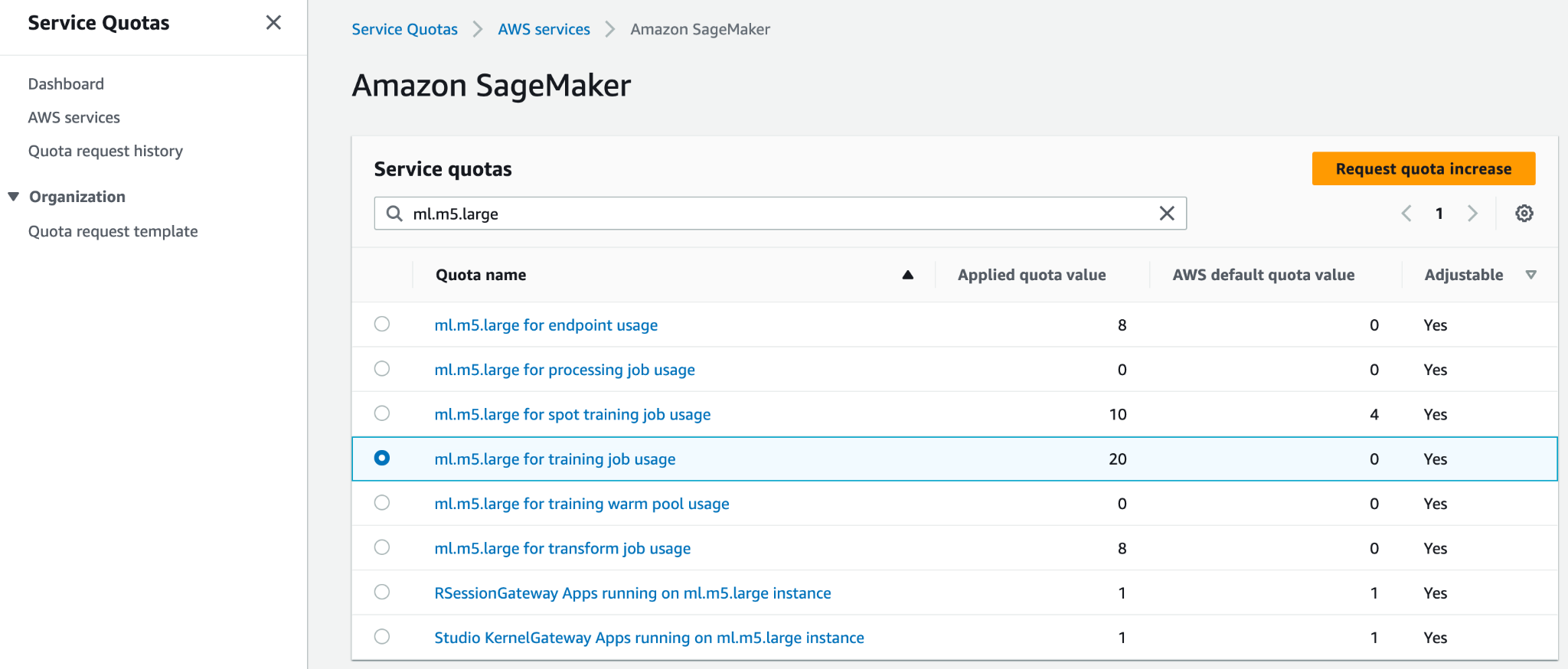

Če želite zagnati kodo brez sprememb, morate povečati kvoto storitev za ml.m5.large za uporabo pri usposabljanju in Število primerov v vseh delovnih mestih za usposabljanje. AWS privzeto dovoljuje le 20 vzporednih izobraževalnih opravil SageMaker za obe kvoti. Za oba morate zahtevati povečanje kvote na 30. Obe spremembi kvot bi morali biti običajno odobreni v nekaj minutah. Nanašati se na Zahteva za povečanje kvote za več informacij.

Če ne želite spremeniti kvote, lahko preprosto spremenite vrednost MAX_PARALLEL_JOBS spremenljivko v skriptu (na primer na 5).

- Vsako opravilo HPO bo dokončalo niz usposabljanje poskuse in navedite model z optimalnimi hiperparametri.

- Analizirajte rezultate in uvesti najuspešnejši model.

Ta rešitev bo povzročila stroške v vašem računu AWS. Stroški te rešitve bodo odvisni od števila in trajanja delovnih mest za usposabljanje HPO. Ko se ti povečajo, se povečajo tudi stroški. Stroške lahko zmanjšate tako, da omejite čas usposabljanja in konfiguracijo TuningJobCompletionCriteriaConfig v skladu z navodili, ki so obravnavana kasneje v tej objavi. Za informacije o cenah glejte Cene Amazon SageMaker.

V naslednjih razdelkih podrobneje obravnavamo prenosni računalnik s primeri kode in koraki za analizo rezultatov in izbiro najboljšega modela.

Začetna nastavitev

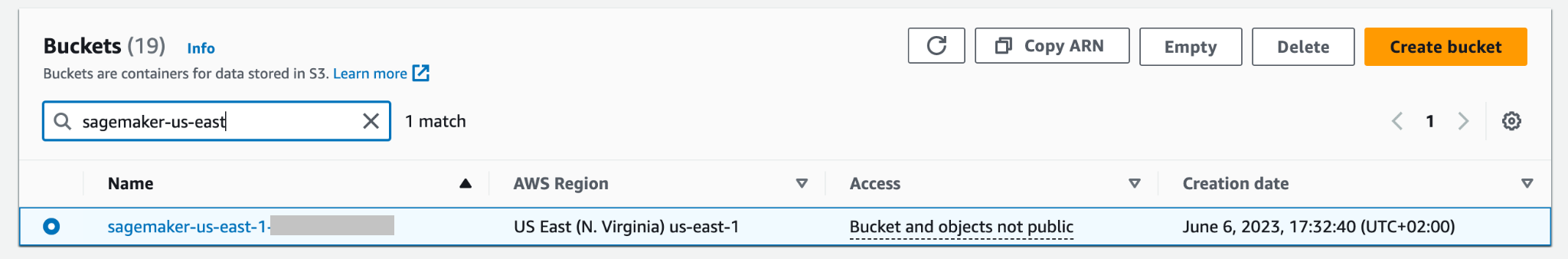

Začnimo z vodenjem Uvozi in nastavitev oddelek v custom-automl.ipynb zvezek. Namesti in uvozi vse zahtevane odvisnosti, ustvari sejo in odjemalca SageMaker ter nastavi privzeto regijo in vedro S3 za shranjevanje podatkov.

Priprava podatkov

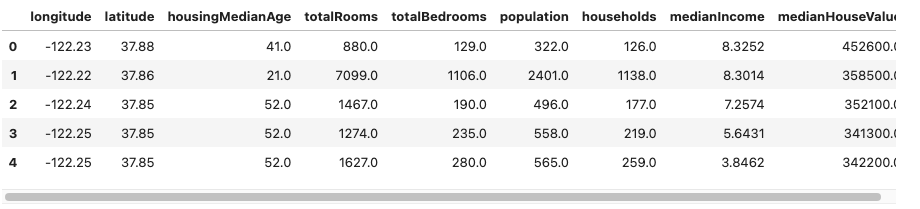

Prenesite nabor podatkov California Housing in ga pripravite tako, da zaženete Prenos podatkov del zvezka. Nabor podatkov je razdeljen na podatkovne okvire za usposabljanje in testiranje ter naložen v privzeto vedro S3 seje SageMaker.

Celoten nabor podatkov ima skupaj 20,640 zapisov in 9 stolpcev, vključno s ciljem. Cilj je napovedati srednjo vrednost hiše (medianHouseValue stolpec). Naslednji posnetek zaslona prikazuje zgornje vrstice nabora podatkov.

Predloga scenarija za usposabljanje

Potek dela AutoML v tej objavi temelji na scikit-učiti cevovodi in algoritmi za predprocesiranje. Cilj je ustvariti veliko kombinacijo različnih cevovodov in algoritmov za predprocesiranje, da bi našli najuspešnejšo nastavitev. Začnimo z ustvarjanjem splošnega skripta za usposabljanje, ki je vztrajen lokalno na primerku prenosnika. V tem skriptu sta dva prazna bloka komentarjev: eden za vstavljanje hiperparametrov in drugi za predmet cevovoda modela predprocesiranja. Vstavljeni bodo dinamično za vsakega kandidata za model predprocesiranja. Namen enega generičnega skripta je ohraniti izvedbo SUHO (ne ponavljajte se).

Ustvarite predobdelavo in kombinacije modelov

O preprocessors slovar vsebuje specifikacijo tehnik predprocesiranja, ki se uporabljajo za vse vhodne funkcije modela. Vsak recept je definiran z a Pipeline ali FeatureUnion objekt iz scikit-learn, ki povezuje posamezne transformacije podatkov in jih zlaga skupaj. na primer mean-imp-scale je preprost recept, ki zagotavlja, da so manjkajoče vrednosti pripisane z uporabo srednjih vrednosti ustreznih stolpcev in da so vse funkcije skalirane z uporabo StandardScaler. V nasprotju s tem mean-imp-scale-pca recept združuje še nekaj operacij:

- Pripišite manjkajoče vrednosti v stolpcih z njihovo srednjo vrednostjo.

- Uporabite skaliranje funkcij z uporabo povprečja in standardnega odklona.

- Izračunajte PCA poleg vhodnih podatkov pri določeni vrednosti praga variance in jih združite z imputiranimi in skaliranimi vhodnimi značilnostmi.

V tej objavi so vse vnosne funkcije številske. Če imate v svojem vhodnem naboru podatkov več vrst podatkov, morate določiti bolj zapleten cevovod, kjer se za različne nabore vrst funkcij uporabljajo različne veje predprocesiranja.

O models slovar vsebuje specifikacije različnih algoritmov, ki jim prilagodite nabor podatkov. Vsaka vrsta modela je opremljena z naslednjimi specifikacijami v slovarju:

- izhod_skripta – Kaže na lokacijo učnega skripta, ki ga uporablja ocenjevalec. To polje se polni dinamično, ko je

modelsslovar je združen zpreprocessorsslovar. - vstavki – Določa kodo, ki bo vstavljena v

script_draft.pyin pozneje shranjen podscript_output. Ključ“preprocessor”je namenoma prazno, ker je to mesto zapolnjeno z enim od predprocesorjev, da se ustvari več kombinacij model-predprocesor. - hiperparametrov – Niz hiperparametrov, ki jih optimizira opravilo HPO.

- include_cls_metapodatki – Več podrobnosti o konfiguraciji zahteva SageMaker

Tunerrazred.

Popoln primer models slovar je na voljo v repozitoriju GitHub.

Nato ponovimo skozi preprocessors in models slovarje in ustvarite vse možne kombinacije. Na primer, če vaš preprocessors slovar vsebuje 10 receptov in imate 5 definicij modelov v models slovar, na novo ustvarjen slovar cevovodov vsebuje 50 cevovodov modela predprocesorja, ki so ovrednoteni med HPO. Upoštevajte, da posamezni skripti cevovoda na tej točki še niso ustvarjeni. Naslednji blok kode (celica 9) prenosnika Jupyter ponovi skozi vse objekte predprocesorskega modela v pipelines slovarju, vstavi vse ustrezne dele kode in ohrani različico skripta, specifično za cevovod, lokalno v zvezku. Ti skripti se uporabijo v naslednjih korakih pri ustvarjanju posameznih ocenjevalcev, ki jih vključite v opravilo HPO.

Določite ocenjevalce

Zdaj lahko delate na definiranju ocenjevalcev SageMaker, ki jih uporablja opravilo HPO, potem ko so skripti pripravljeni. Začnimo z ustvarjanjem ovojnega razreda, ki definira nekatere skupne lastnosti za vse ocenjevalce. Podeduje od SKLearn razred in določa vlogo, število primerkov in vrsto ter katere stolpce uporablja skript kot funkcije in cilj.

Zgradimo estimators slovarju s ponavljanjem skozi vse skripte, ki so bili ustvarjeni prej in se nahajajo v scripts imenik. Ustvarite nov ocenjevalec z uporabo SKLearnBase razreda z edinstvenim imenom ocenjevalca in enega od skriptov. Upoštevajte, da je estimators slovar ima dve ravni: najvišja raven definira a pipeline_family. To je logično združevanje glede na vrsto modelov, ki jih je treba oceniti, in je enako dolžini models slovar. Druga raven vsebuje posamezne tipe predprocesorja v kombinaciji z danimi pipeline_family. To logično združevanje je potrebno pri ustvarjanju opravila HPO.

Definirajte argumente sprejemnika HPO

Za optimizacijo podajanja argumentov v HPO Tuner razred, the HyperparameterTunerArgs razred podatkov se inicializira z argumenti, ki jih zahteva razred HPO. Prihaja z nizom funkcij, ki zagotavljajo, da so argumenti HPO vrnjeni v formatu, pričakovanem pri uvajanju več definicij modela hkrati.

Naslednji blok kode uporablja predhodno uvedeno HyperparameterTunerArgs podatkovni razred. Ustvarite še en slovar, imenovan hp_args in ustvarite niz vhodnih parametrov, ki so specifični za vsakega estimator_family Iz estimators slovar. Ti argumenti se uporabijo v naslednjem koraku pri inicializaciji opravil HPO za vsako družino modelov.

Ustvarite objekte sprejemnika HPO

V tem koraku ustvarite posamezne sprejemnike za vsakega estimator_family. Zakaj ustvarite tri ločena opravila HPO, namesto da bi zagnali samo eno v vseh ocenjevalcih? The HyperparameterTuner razred je omejen na 10 definicij modela, ki so mu priložene. Zato je vsak HPO odgovoren za iskanje najučinkovitejšega predprocesorja za dano družino modelov in prilagajanje hiperparametrov te družine modelov.

Sledi še nekaj točk v zvezi z nastavitvijo:

- Strategija optimizacije je Bayesova, kar pomeni, da HPO aktivno spremlja uspešnost vseh poskusov in usmerja optimizacijo k bolj obetavnim kombinacijam hiperparametrov. Predčasno zaustavitev je treba nastaviti na off or Auto pri delu z Bayesovo strategijo, ki sama obravnava to logiko.

- Vsako opravilo HPO se izvaja za največ 100 opravil in izvaja 10 opravil vzporedno. Če imate opravka z večjimi nabori podatkov, boste morda želeli povečati skupno število opravil.

- Poleg tega boste morda želeli uporabiti nastavitve, ki nadzorujejo, kako dolgo se opravilo izvaja in koliko opravil sproži vaš HPO. Eden od načinov za to je, da nastavite najdaljši čas delovanja v sekundah (za to objavo smo ga nastavili na 1 uro). Druga je uporaba nedavno izdanega

TuningJobCompletionCriteriaConfig. Ponuja nabor nastavitev, ki spremljajo napredek vaših opravil in odločajo, ali je verjetno, da bo več opravil izboljšalo rezultat. V tej objavi smo nastavili največje število delovnih mest za usposabljanje, ki se ne izboljšajo, na 20. Tako vam, če se rezultat ne izboljša (na primer od štiridesetega poskusa), ne bo treba plačati za preostale poskuse, doklermax_jobsje doseženo.

Zdaj pa ponovimo skozi tuners in hp_args slovarje in sproži vsa opravila HPO v SageMakerju. Upoštevajte uporabo argumenta čakanja, nastavljenega na False, kar pomeni, da jedro ne bo čakalo na dokončanje rezultatov in lahko sprožite vsa opravila hkrati.

Verjetno se ne bodo dokončala vsa delovna mesta za usposabljanje in nekatera od njih bodo morda prekinjena zaradi službe HPO. Razlog za to je TuningJobCompletionCriteriaConfig— optimizacija se konča, če je izpolnjen kateri koli od navedenih kriterijev. V tem primeru, ko se merila optimizacije ne izboljšajo za 20 zaporednih opravil.

Analizirajte rezultate

Celica 15 zvezka preveri, ali so vsa opravila HPO dokončana, in združi vse rezultate v obliki podatkovnega okvira pande za nadaljnjo analizo. Preden podrobno analiziramo rezultate, si oglejmo konzolo SageMaker na visoki ravni.

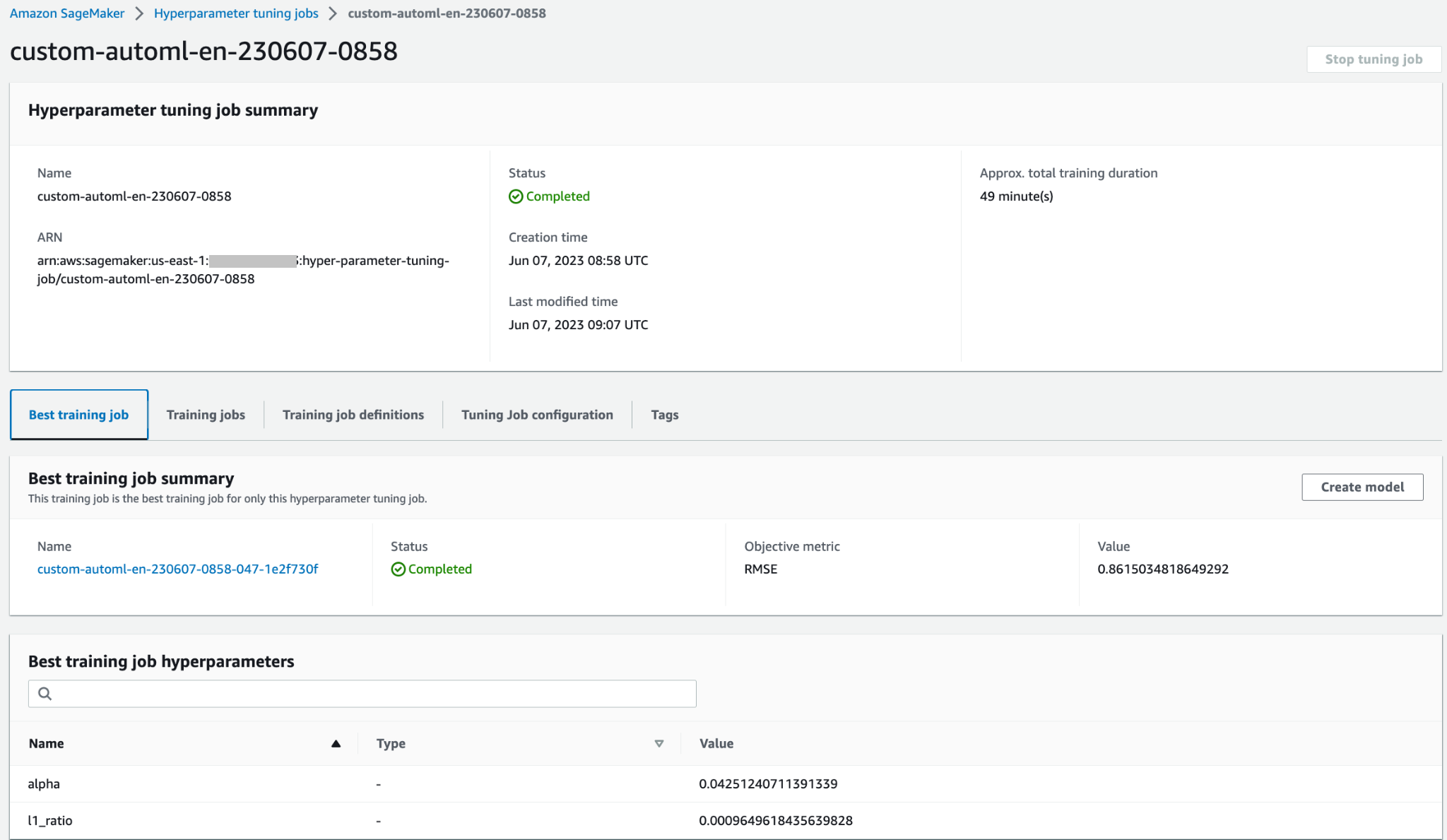

Na vrhu Hiperparametrska nastavitev stran, si lahko ogledate svoja tri sprožena delovna mesta HPO. Vsi so končali predčasno in niso opravili vseh 100 izobraževalnih del. Na naslednjem posnetku zaslona lahko vidite, da je družina modelov Elastic-Net opravila največje število poskusov, medtem ko drugi niso potrebovali toliko usposabljanja, da bi našli najboljši rezultat.

Opravilo HPO lahko odprete za dostop do več podrobnosti, kot so posamezna opravila usposabljanja, konfiguracija opravila ter informacije in zmogljivosti najboljšega opravila usposabljanja.

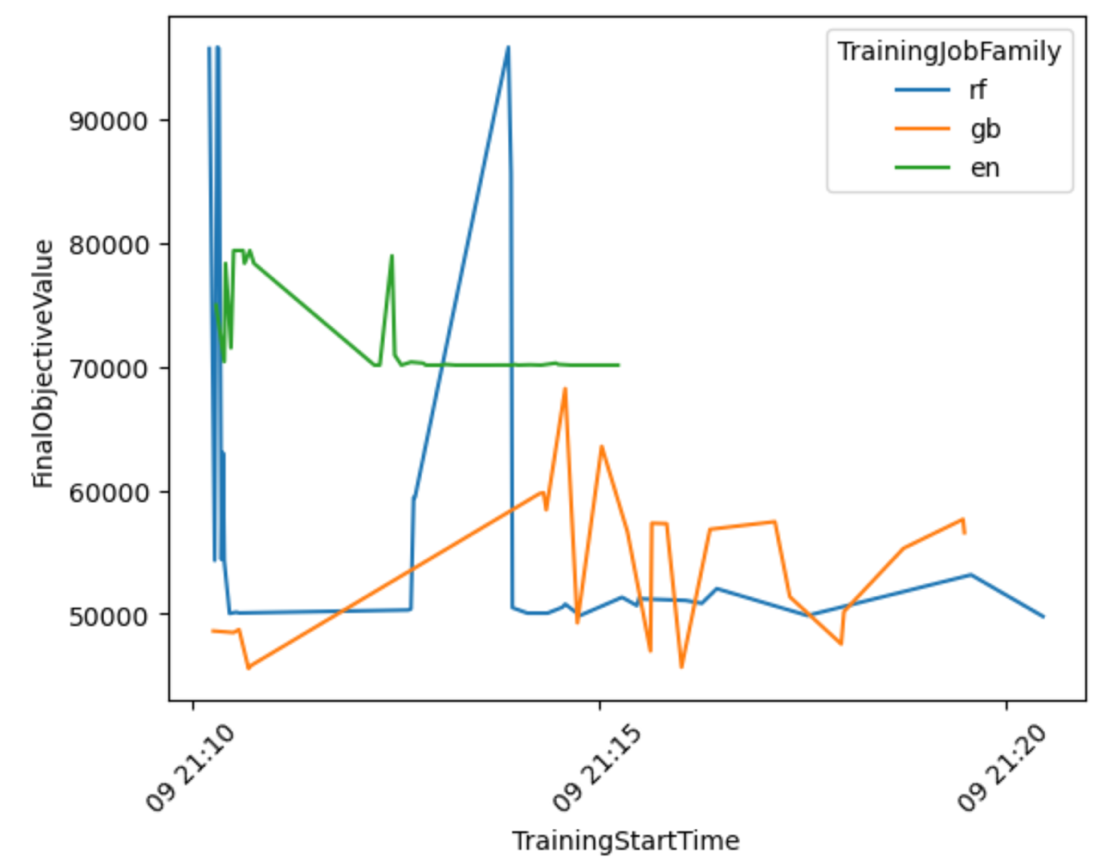

Izdelajmo vizualizacijo na podlagi rezultatov, da dobimo več vpogledov v delovanje poteka dela AutoML v vseh družinah modelov.

Iz naslednjega grafa lahko sklepate, da je Elastic-Net Zmogljivost modela je nihala med 70,000 in 80,000 RMSE in se je na koncu ustavila, saj algoritem kljub preizkušanju različnih tehnik predprocesiranja in vrednosti hiperparametrov ni mogel izboljšati svoje zmogljivosti. Zdi se tudi, da RandomForest zmogljivost se je zelo razlikovala glede na nabor hiperparametrov, ki jih je raziskoval HPO, vendar kljub številnim poskusom ni mogla iti pod napako 50,000 RMSE. GradientBoosting dosegel najboljšo uspešnost že od začetka pod 50,000 RMSE. HPO je poskušal ta rezultat še izboljšati, vendar ni mogel doseči boljše učinkovitosti pri drugih kombinacijah hiperparametrov. Splošni zaključek za vsa opravila HPO je, da ni bilo potrebnih toliko opravil za iskanje najučinkovitejšega nabora hiperparametrov za vsak algoritem. Če želite še izboljšati rezultat, bi morali eksperimentirati z ustvarjanjem več funkcij in izvajanjem dodatnega inženiringa funkcij.

Preučite lahko tudi podrobnejši pogled na kombinacijo modela in predprocesorja, da sklepate o najbolj obetavnih kombinacijah.

Izberite najboljši model in ga namestite

Naslednji delček kode izbere najboljši model na podlagi najnižje dosežene ciljne vrednosti. Nato lahko model uvedete kot končno točko SageMaker.

Čiščenje

Če želite preprečiti neželene bremenitve vašega računa AWS, priporočamo, da izbrišete vire AWS, ki ste jih uporabili v tej objavi:

- Na konzoli Amazon S3 izpraznite podatke iz vedra S3, kjer so bili shranjeni podatki o vadbi.

- Na konzoli SageMaker zaustavite primerek zvezka.

- Izbrišite končno točko modela, če ste jo razmestili. Končne točke je treba izbrisati, ko niso več v uporabi, ker se zaračunavajo glede na čas namestitve.

zaključek

V tej objavi smo predstavili, kako ustvariti opravilo HPO po meri v SageMakerju z uporabo prilagojenega izbora algoritmov in tehnik predprocesiranja. Ta primer zlasti prikazuje, kako avtomatizirati proces generiranja številnih skriptov za usposabljanje in kako uporabiti programske strukture Python za učinkovito uvajanje več vzporednih optimizacijskih opravil. Upamo, da bo ta rešitev oblikovala ogrodje za vsa opravila prilagajanja modela po meri, ki jih boste uvedli s SageMakerjem za doseganje višje zmogljivosti in pospešitev delovnih tokov ML.

Oglejte si naslednje vire, da še poglobite svoje znanje o uporabi SageMaker HPO:

O avtorjih

Konrad Semsch je višji arhitekt rešitev ML v ekipi Amazon Web Services Data Lab. Strankam pomaga uporabljati strojno učenje za reševanje njihovih poslovnih izzivov z AWS. Uživa v izumljanju in poenostavljanju, da strankam omogoči preproste in pragmatične rešitve za njihove projekte AI/ML. Najbolj ga navdušuje MlOps in tradicionalna podatkovna znanost. Izven službe je velik ljubitelj jadranja na deski in kajtanja.

Konrad Semsch je višji arhitekt rešitev ML v ekipi Amazon Web Services Data Lab. Strankam pomaga uporabljati strojno učenje za reševanje njihovih poslovnih izzivov z AWS. Uživa v izumljanju in poenostavljanju, da strankam omogoči preproste in pragmatične rešitve za njihove projekte AI/ML. Najbolj ga navdušuje MlOps in tradicionalna podatkovna znanost. Izven službe je velik ljubitelj jadranja na deski in kajtanja.

Tuna Ersoy je višji arhitekt rešitev pri AWS. Njen glavni cilj je pomagati strankam v javnem sektorju, da za svoje delovne obremenitve sprejmejo tehnologije v oblaku. Ima izkušnje z razvojem aplikacij, arhitekturo podjetij in tehnologijami kontaktnih centrov. Njeni interesi vključujejo brezstrežniške arhitekture in AI/ML.

Tuna Ersoy je višji arhitekt rešitev pri AWS. Njen glavni cilj je pomagati strankam v javnem sektorju, da za svoje delovne obremenitve sprejmejo tehnologije v oblaku. Ima izkušnje z razvojem aplikacij, arhitekturo podjetij in tehnologijami kontaktnih centrov. Njeni interesi vključujejo brezstrežniške arhitekture in AI/ML.

- Distribucija vsebine in PR s pomočjo SEO. Okrepite se še danes.

- PlatoData.Network Vertical Generative Ai. Opolnomočite se. Dostopite tukaj.

- PlatoAiStream. Web3 Intelligence. Razširjeno znanje. Dostopite tukaj.

- PlatoESG. Ogljik, CleanTech, Energija, Okolje, sončna energija, Ravnanje z odpadki. Dostopite tukaj.

- PlatoHealth. Obveščanje o biotehnologiji in kliničnih preskušanjih. Dostopite tukaj.

- vir: https://aws.amazon.com/blogs/machine-learning/implement-a-custom-automl-job-using-pre-selected-algorithms-in-amazon-sagemaker-automatic-model-tuning/

- :ima

- : je

- :ne

- :kje

- $GOR

- 000

- 1

- 10

- 100

- 12

- 13

- 14

- 15%

- 20

- 2000

- 22

- 25

- 28

- 30

- 39

- 50

- 7

- 70

- 8

- 80

- 9

- a

- Sposobna

- O meni

- dostop

- Po

- Račun

- Doseči

- doseže

- čez

- aktivno

- Dodatne

- Poleg tega

- sprejme

- po

- AI / ML

- Cilj

- algoritem

- algoritmi

- vsi

- Dovoli

- omogoča

- že

- Prav tako

- Amazon

- Amazon SageMaker

- Amazon Web Services

- an

- Analiza

- analizirati

- analiziranje

- in

- Še ena

- kaj

- uporaba

- Razvoj aplikacij

- uporabna

- velja

- Uporabi

- odobren

- Arhitektura

- SE

- Argument

- Argumenti

- AS

- domnevati

- At

- pripisujejo

- avto

- avtomatizirati

- Samodejno

- samodejno

- AutoML

- Na voljo

- AWS

- ozadje

- baza

- temeljijo

- Izhodišče

- Bajezijski

- BE

- ker

- pred

- Začetek

- spodaj

- BEST

- Boljše

- med

- Big

- Block

- Bloki

- tako

- veje

- izgradnjo

- Building

- poslovni

- vendar

- Gumb

- by

- california

- klic

- se imenuje

- CAN

- Kandidat

- primeru

- primeri

- center

- verige

- izzivi

- spremenite

- Spremembe

- Stroški

- Pregledi

- Izberite

- razred

- CLF

- stranke

- Cloud

- Grozd

- grozdenje

- Koda

- Stolpec

- Stolpci

- kombinacija

- kombinacije

- kombinirani

- združuje

- prihaja

- komentar

- Skupno

- dokončanje

- Končana

- dokončanje

- zapleten

- zaključuje

- Sklenitev

- Ravnanje

- konfiguracija

- zaporedna

- Konzole

- kontakt

- kontaktni center

- Vsebuje

- kontrast

- nadzor

- strošek

- stroški

- bi

- ustvarjajo

- ustvaril

- Ustvarjanje

- Merila

- ključnega pomena

- Trenutno

- po meri

- Stranke, ki so

- datum

- znanost o podatkih

- nabor podatkov

- deliti

- odloča

- Poglobite se

- privzeto

- opredeljen

- Določa

- definiranje

- definicije

- izkazati

- dokazuje,

- odvisna

- odvisnosti

- Odvisno

- razporedi

- razporejeni

- uvajanja

- uvajanje

- drift

- Kljub

- Podatki

- podrobno

- Podrobnosti

- Razvoj

- razvili

- Razvoj

- razvija

- odstopanje

- DICT

- drugačen

- imeniki

- razpravlja

- razpravljali

- do

- Ne

- domena

- dont

- navzdol

- pripravi

- posuši

- trajanje

- med

- dinamično

- vsak

- Zgodnje

- učinkovite

- odpravlja

- omogočajo

- Končna točka

- Inženiring

- zagotovitev

- zagotavlja

- Podjetje

- Celotna

- popolnoma

- enako

- Napaka

- oceniti

- ocenili

- sčasoma

- Tudi vsak

- preučiti

- Primer

- Primeri

- izvedba

- obstajajo

- pričakovati

- Pričakuje

- poskus

- razložiti

- Raziskano

- raziskuje

- false

- družine

- družina

- ventilator

- Feature

- Lastnosti

- Nekaj

- Polje

- file

- napolnjena

- Najdi

- iskanje

- prva

- fit

- pet

- Osredotočite

- sledi

- po

- sledi

- za

- gozd

- obrazec

- format

- FRAME

- iz

- spredaj

- polno

- funkcija

- funkcionalnost

- funkcije

- nadalje

- splošno

- ustvarjajo

- ustvarila

- ustvarjajo

- dobili

- git

- GitHub

- dana

- Go

- Cilj

- dogaja

- graf

- strani

- Ročaji

- Imajo

- ob

- he

- težka

- težko dvigovanje

- pomoč

- Pomaga

- jo

- na visoki ravni

- več

- najvišja

- upam,

- uro

- Hiša

- gospodinjstva

- Ohišje

- Kako

- Kako

- HTML

- http

- HTTPS

- Optimizacija hiperparametra

- Uglaševanje hiperparametrov

- identiteta

- if

- izvajati

- Izvajanje

- uvoz

- uvoz

- izboljšanje

- izboljšanju

- in

- vključujejo

- Vključno

- Povečajte

- Navedite

- individualna

- Posamezno

- Podatki

- vhod

- vhodi

- Vložki

- vpogledi

- primer

- Namesto

- Navodila

- integracija

- namerno

- interesi

- vmesnik

- v

- Uvedeno

- IT

- ITS

- sam

- Job

- Delovna mesta

- jpg

- samo

- samo en

- Imejte

- Ključne

- znanje

- lab

- velika

- večja

- pozneje

- začela

- začetek

- učenje

- levo

- dolžina

- Stopnja

- ravni

- življenski krog

- dviganje

- kot

- Verjeten

- omejujoč

- linux

- obremenitev

- lokalno

- nahaja

- kraj aktivnosti

- Logika

- logično

- Long

- več

- Poglej

- Sklop

- najnižja

- stroj

- strojno učenje

- več

- največja

- Maj ..

- pomeni

- pomeni

- Spoji

- pol

- Meritve

- morda

- Minute

- manjka

- ML

- MLOps

- Model

- modeli

- spremenite

- monitor

- monitorji

- več

- Najbolj

- več

- Ime

- ozek

- krmari

- Nimate

- Novo

- na novo

- Naslednja

- št

- Noben

- prenosnik

- opozoriti

- zdaj

- Številka

- otopeli

- predmet

- Cilj

- predmeti

- of

- off

- Ponudbe

- on

- enkrat

- ONE

- samo

- odprite

- operacije

- optimalna

- optimizacija

- Optimizirajte

- optimizirana

- or

- Da

- OS

- Ostalo

- drugi

- ven

- izhod

- zunaj

- več

- Splošni

- Stran

- pand

- vzporedno

- parametri

- del

- zlasti

- Podaje

- strastno

- pot

- Plačajte

- Izvedite

- performance

- izvajati

- vztraja

- kosov

- plinovod

- platon

- Platonova podatkovna inteligenca

- PlatoData

- igra

- Vtič

- Točka

- točke

- politika

- prebivalstvo

- mogoče

- Prispevek

- potencial

- pragmatično

- napovedati

- Predictor

- Pripravimo

- predpogoji

- darila

- preprečiti

- prej

- cenitev

- primarni

- Tiskanje

- problem

- Postopek

- proizvodnjo

- proizvodnja

- Programiranje

- Napredek

- Projekt

- projekti

- obetaven

- Lastnosti

- zagotavljajo

- zagotavlja

- zagotavljanje

- javnega

- Namen

- Python

- naključno

- hitro

- dosegel

- pripravljen

- Razlog

- Pred kratkim

- Recept

- Priporočamo

- evidence

- zmanjša

- zmanjšuje

- glejte

- reference

- o

- regularni izraz

- okolica

- sprosti

- pomembno

- Preostalih

- odstrani

- ponovite

- Skladišče

- zahteva

- zahteva

- obvezna

- viri

- tisti,

- odgovorna

- omejeno

- povzroči

- Rezultati

- vrnitev

- Pravica

- vloga

- Run

- tek

- deluje

- runtime

- sagemaker

- Samodejno prilagajanje modela SageMaker

- shranjena

- Lestvica

- skaliranje

- Znanost

- Znanstveniki

- scikit-učiti

- Obseg

- rezultat

- script

- skripte

- drugi

- sekund

- Oddelek

- oddelki

- sektor

- glej

- Zdi se,

- izbran

- izbor

- SAMO

- višji

- ločena

- služijo

- Brez strežnika

- Storitev

- Storitve

- Zasedanje

- nastavite

- Kompleti

- nastavitve

- nastavitev

- je

- shouldnt

- predstavljeni

- pokazale

- Razstave

- Enostavno

- poenostavitev

- preprosto

- delček

- So

- Rešitev

- rešitve

- SOLVE

- nekaj

- specializirani

- specifična

- specifikacija

- specifikacije

- določeno

- hitrost

- po delih

- sveženj

- standardna

- Začetek

- Začetek

- Status

- Korak

- Koraki

- stop

- ustavil

- ustavljanje

- shranjevanje

- shranjeni

- shranjevanje

- Strategija

- Struktura

- strukture

- Kasneje

- taka

- Podprti

- miza

- prilagojene

- Bodite

- ciljna

- skupina

- tehnični

- tehnike

- Tehnologije

- terminal

- Test

- Testiranje

- da

- O

- njihove

- Njih

- POTEM

- Tukaj.

- zato

- te

- jih

- ta

- tisti,

- 3

- Prag

- skozi

- čas

- do

- skupaj

- orodje

- vrh

- Skupaj za plačilo

- proti

- tradicionalna

- Vlak

- usposabljanje

- transformacije

- sojenje

- poskusi

- Poskušal

- sprožijo

- sprožilo

- sproži

- poskuša

- tuning

- dva

- tip

- Vrste

- tipično

- ui

- pod

- razumevanje

- edinstven

- dokler

- nezaželen

- naložili

- Uporaba

- uporaba

- primeru uporabe

- Rabljeni

- uporablja

- uporabo

- POTRDI

- vrednost

- Vrednote

- spremenljivka

- raznolika

- različnih

- različica

- različice

- Poglej

- vizualizacija

- W

- Počakaj

- walkthrough

- želeli

- je

- način..

- we

- web

- spletne storitve

- Dobro

- so bili

- Kaj

- kdaj

- medtem ko

- ali

- ki

- zakaj

- bo

- z

- v

- brez

- delo

- potek dela

- delovnih tokov

- deluje

- bi

- pisati

- še

- Vi

- Vaša rutina za

- sami

- zefirnet