Agenti velikega jezikovnega modela (LLM) so programi, ki razširjajo zmogljivosti samostojnih LLM z 1) dostopom do zunanjih orodij (API-ji, funkcije, webhooks, vtičniki itd.) in 2) zmožnostjo načrtovanja in izvajanja nalog v samostojnem -usmerjena moda. LLM-ji morajo pogosto komunicirati z drugo programsko opremo, bazami podatkov ali API-ji, da lahko opravijo zapletene naloge. Na primer, upravni chatbot, ki načrtuje sestanke, bi zahteval dostop do koledarjev in e-pošte zaposlenih. Z dostopom do orodij lahko agenti LLM postanejo močnejši – za ceno dodatne zapletenosti.

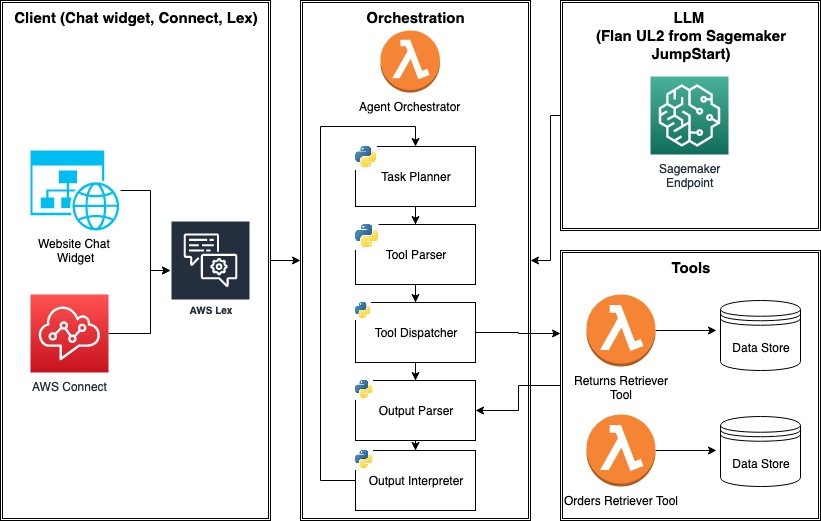

V tej objavi predstavljamo agente LLM in prikazujemo, kako zgraditi in uvesti agenta LLM za e-trgovino z uporabo Amazon SageMaker JumpStart in AWS Lambda. Agent bo uporabil orodja za zagotavljanje novih zmogljivosti, kot je odgovarjanje na vprašanja o vračilih (»Ali je moje vračilo rtn001 obdelano?«) in zagotavljanje posodobitev o naročilih (»Ali mi lahko poveste, če naročilo 123456 je odposlano?«). Te nove zmožnosti zahtevajo, da LLM pridobijo podatke iz več virov podatkov (orders, returns) in izvedite generiranje razširjenega pridobivanja (RAG).

Za napajanje agenta LLM uporabljamo a Flan-UL2 model, uporabljen kot a Končna točka SageMaker in uporabite orodja za pridobivanje podatkov, izdelana z AWS Lambda. Agent se lahko naknadno integrira z Amazon Lex in se uporablja kot chatbot znotraj spletnih mest oz AWS Connect. Objavo zaključujemo s postavkami, ki jih je treba upoštevati pred uvedbo agentov LLM v produkcijo. Za popolnoma upravljano izkušnjo za ustvarjanje LLM agentov AWS ponuja tudi agenti za funkcijo Amazon Bedrock (v predogledu).

Kratek pregled arhitektur agentov LLM

Agenti LLM so programi, ki uporabljajo LLM za odločanje, kdaj in kako uporabiti orodja, kot so potrebna za dokončanje zapletenih nalog. Z orodji in zmožnostmi načrtovanja nalog lahko agenti LLM sodelujejo z zunanjimi sistemi in premagajo tradicionalne omejitve LLM-jev, kot so izpad znanja, halucinacije in nenatančni izračuni. Orodja so lahko v različnih oblikah, kot so klici API-ja, funkcije Python ali vtičniki, ki temeljijo na webhooku. LLM lahko na primer uporabi »priklicni vtičnik« za pridobivanje ustreznega konteksta in izvajanje RAG.

Kaj torej za LLM pomeni izbiranje orodij in načrtovanje nalog? Obstaja veliko pristopov (npr React, MRKL, Oblikovalnik orodij, ObjemGPTin Transformer Agents) k uporabi LLM z orodji in napredek se dogaja hitro. Eden od preprostih načinov pa je, da LLM-ju ponudite seznam orodij in ga prosite, naj ugotovi, 1) ali je orodje potrebno za izpolnitev poizvedbe uporabnika, in če je tako, 2) izbere ustrezno orodje. Takšen poziv običajno izgleda kot naslednji primer in lahko vključuje nekaj primerov za izboljšanje zanesljivosti LLM pri izbiri pravega orodja.

Bolj zapleteni pristopi vključujejo uporabo specializiranega LLM, ki lahko neposredno dekodira "klice API" ali "uporabo orodij", kot je npr. GorillaLLM. Takšni natančno nastavljeni LLM-ji so usposobljeni na podatkovnih nizih specifikacije API-ja za prepoznavanje in predvidevanje klicev API-ja na podlagi navodil. Ti LLM-ji pogosto zahtevajo nekaj metapodatkov o razpoložljivih orodjih (opisi, yaml ali shema JSON za njihove vhodne parametre), da lahko izpišejo priklice orodij. Ta pristop uporablja zastopniki za Amazon Bedrock in Klici funkcij OpenAI. Upoštevajte, da morajo biti LLM-ji na splošno dovolj veliki in zapleteni, da pokažejo sposobnost izbire orodja.

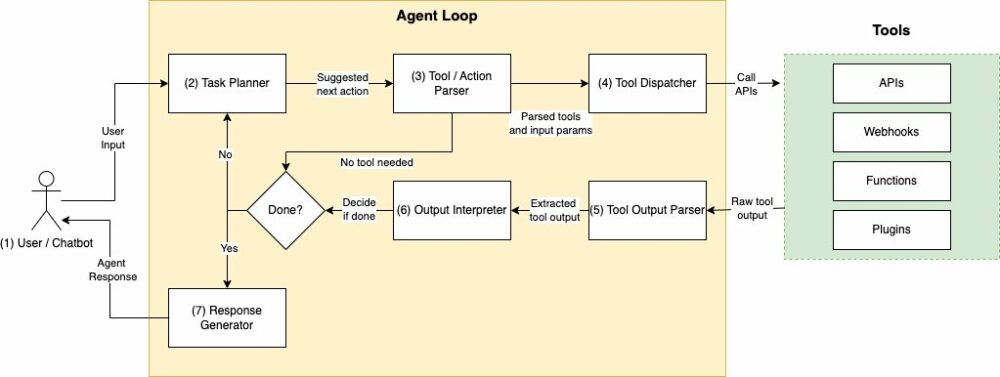

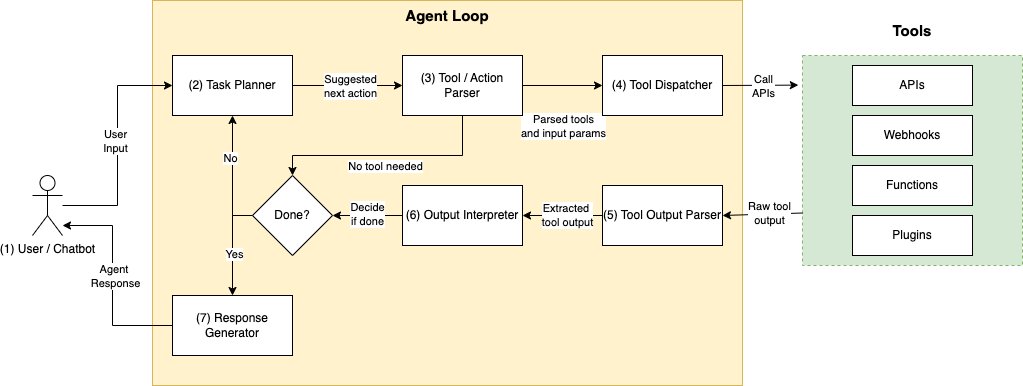

Ob predpostavki, da so izbrani mehanizmi načrtovanja nalog in izbire orodij, tipičen agentski program LLM deluje v naslednjem zaporedju:

- Zahteva uporabnika – Program sprejme uporabniški vnos, kot je »Kje je moje naročilo

123456?" iz neke odjemalske aplikacije. - Načrtujte naslednja dejanja in izberite orodja, ki jih želite uporabiti – Nato program uporabi poziv, da LLM ustvari naslednje dejanje, na primer »Poiščite tabelo naročil z uporabo

OrdersAPI.” LLM je pozvan, da predlaga ime orodja, kot je nprOrdersAPIiz vnaprej določenega seznama razpoložljivih orodij in njihovih opisov. Druga možnost je, da LLM dobi navodila, da neposredno ustvari klic API z vhodnimi parametri, kot jeOrdersAPI(12345).- Upoštevajte, da lahko naslednje dejanje vključuje ali ne vključuje uporabe orodja ali API-ja. V nasprotnem primeru bi se LLM odzval na vnos uporabnika, ne da bi vključil dodaten kontekst iz orodij ali preprosto vrnil odgovor v pločevinkah, kot je "Ne morem odgovoriti na to vprašanje."

- Zahteva za orodje za razčlenjevanje – Nato moramo razčleniti in potrditi napoved orodja/dejanja, ki jo predlaga LLM. Preverjanje veljavnosti je potrebno za zagotovitev, da imena orodij, API-ji in parametri zahteve niso halucinirani in da so orodja pravilno priklicana v skladu s specifikacijo. To razčlenjevanje lahko zahteva ločen klic LLM.

- Orodje za priklic – Ko so zagotovljena veljavna imena orodja in parametri, prikličemo orodje. To je lahko zahteva HTTP, klic funkcije itd.

- Razčleni izhod – Odziv orodja bo morda zahteval dodatno obdelavo. Na primer, klic API-ja lahko povzroči dolg odgovor JSON, kjer je le podmnožica polj zanimiva za LLM. Pridobivanje informacij v čisti, standardizirani obliki lahko pomaga LLM-ju zanesljiveje interpretirati rezultat.

- Razlaga izpisa – Glede na izhod orodja se LLM znova pozove, da ga razume in se odloči, ali lahko ustvari končni odgovor nazaj uporabniku ali pa so potrebna dodatna dejanja.

- Prekinite ali nadaljujte z 2. korakom – Vrni končni odgovor ali privzeti odgovor v primeru napak ali časovnih omejitev.

Različna ogrodja agentov različno izvajajo prejšnji tok programa. na primer React združuje izbiro orodja in generiranje končnega odgovora v en sam poziv, v nasprotju z uporabo ločenih pozivov za izbiro orodja in generiranje odgovora. To logiko je mogoče zagnati tudi v enem prehodu ali v stavku while (»zanka agenta«), ki se konča, ko je ustvarjen končni odgovor, vržena je izjema ali nastopi časovna omejitev. Kar ostaja nespremenjeno, je, da agenti uporabljajo LLM kot središče za orkestriranje načrtovanja in priklice orodij, dokler se naloga ne zaključi. Nato pokažemo, kako implementirati preprosto agentsko zanko z uporabo storitev AWS.

Pregled rešitev

Za to objavo v spletnem dnevniku implementiramo agenta LLM za podporo e-trgovini, ki ponuja dve funkciji, ki jih poganjajo orodja:

- Orodje za iskanje statusa vračila – Odgovorite na vprašanja o statusu vračil, na primer: »Kaj se dogaja z mojim vračilom

rtn001? " - Orodje za pridobivanje stanja naročila – Sledite statusu naročil, kot je, »Kakšno je stanje mojega naročila

123456? "

Agent učinkovito uporablja LLM kot usmerjevalnik poizvedb. Glede na poizvedbo (»Kakšno je stanje naročila 123456?«), izberite ustrezno orodje za iskanje za poizvedbo po več virih podatkov (to so vračila in naročila). Usmerjanje poizvedb dosežemo tako, da LLM izbira med več orodji za iskanje, ki so odgovorna za interakcijo z virom podatkov in pridobivanje konteksta. To razširja preprost vzorec RAG, ki predvideva en sam vir podatkov.

Obe orodji za iskanje sta funkciji Lambda, ki vzameta ID (orderId or returnId) kot vhod pridobi objekt JSON iz vira podatkov in pretvori JSON v človeku prijazen predstavitveni niz, ki je primeren za uporabo v LLM. Vir podatkov v resničnem scenariju bi lahko bila zelo razširljiva baza podatkov NoSQL, kot je npr DynamoDB, vendar ta rešitev uporablja preprost Python Dict z vzorčnimi podatki za predstavitvene namene.

Agentu je mogoče dodati dodatne funkcije z dodajanjem orodij za iskanje in ustreznim spreminjanjem pozivov. Ta agent je mogoče preizkusiti kot samostojno storitev, ki se integrira s katerim koli uporabniškim vmesnikom prek HTTP, kar je mogoče enostavno narediti z Amazon Lex.

Tukaj je nekaj dodatnih podrobnosti o ključnih komponentah:

- Končna točka sklepanja LLM – Jedro agentskega programa je LLM. Uporabili bomo vozlišče temeljnega modela SageMaker JumpStart za preprosto uvajanje

Flan-UL2model. SageMaker JumpStart olajša uvajanje končnih točk sklepanja LLM na namenske SageMaker primerov. - Agent orkestrator – Agent orkestrator orkestrira interakcije med LLM, orodji in odjemalsko aplikacijo. Za našo rešitev uporabljamo funkcijo AWS Lambda za poganjanje tega toka in uporabljamo naslednje kot pomožne funkcije.

- Načrtovalec opravil (orodij) – Načrtovalec opravil uporablja LLM, da predlaga eno od 1) povpraševanja o vračilu, 2) povpraševanja po naročilu ali 3) brez orodja. Uporabljamo samo hitri inženiring in

Flan-UL2model, kot je, brez finih nastavitev. - Razčlenjevalnik orodja – Razčlenjevalnik orodij zagotavlja, da je predlog orodja iz načrtovalca opravil veljaven. Predvsem zagotavljamo, da en sam

orderIdorreturnIdje mogoče razčleniti. V nasprotnem primeru odgovorimo s privzetim sporočilom. - Odpremnik orodja – Odpremnik orodij prikliče orodja (funkcije Lambda) z uporabo veljavnih parametrov.

- Izhodni razčlenjevalnik – Izhodni razčlenjevalnik očisti in izvleče ustrezne elemente iz JSON v človeku berljiv niz. To nalogo opravi tako vsako orodje za iskanje kot tudi znotraj orkestratorja.

- Izhodni tolmač – Odgovornost tolmača izhodnih podatkov je, da 1) interpretira izhod iz priklica orodja in 2) ugotovi, ali je uporabniški zahtevi mogoče ugoditi ali so potrebni dodatni koraki. Če je slednje, se končni odgovor ustvari ločeno in vrne uporabniku.

- Načrtovalec opravil (orodij) – Načrtovalec opravil uporablja LLM, da predlaga eno od 1) povpraševanja o vračilu, 2) povpraševanja po naročilu ali 3) brez orodja. Uporabljamo samo hitri inženiring in

Zdaj pa se poglobimo v ključne komponente: agent orkestrator, načrtovalec opravil in dispečer orodij.

Agent orkestrator

Spodaj je skrajšana različica agentske zanke znotraj funkcije Lambda orkestratorja agentov. Zanka uporablja pomožne funkcije, kot je npr task_planner or tool_parser, za modularizacijo nalog. Zanka je zasnovana tako, da se zažene največ dvakrat, da prepreči, da bi se LLM zataknil v nepotrebno dolgi zanki.

Načrtovalnik opravil (predvidevanje orodja)

Agent orkestrator uporablja task planner predvideti orodje za iskanje na podlagi uporabniškega vnosa. Za našega LLM agenta bomo preprosto uporabili hitro inženirstvo in nekaj hitrih pozivov, da bomo LLM naučili te naloge v kontekstu. Bolj izpopolnjeni agenti bi lahko uporabili natančno nastavljen LLM za napovedovanje orodij, kar presega obseg te objave. Poziv je naslednji:

Odpremnik orodja

Mehanizem odpreme orodja deluje prek if/else logiko za klic ustreznih funkcij Lambda glede na ime orodja. Naslednje je tool_dispatch izvajanje pomožne funkcije. Uporablja se znotraj agent zanke in vrne neobdelani odgovor funkcije Lambda orodja, ki ga nato očisti an output_parser Funkcija.

Uvedite rešitev

Pomembni predpogoji – Če želite začeti z uvajanjem, morate izpolniti naslednje predpogoje:

- Dostop do Konzola za upravljanje AWS prek uporabnika, ki lahko zažene AWS CloudFormation skladi

- Seznanjenost z navigacijo AWS Lambda in Amazon Lex konzole

Flan-UL2zahteva en samml.g5.12xlargeza uvajanje, kar lahko zahteva povečanje omejitev virov prek a vstopnica. V našem primeru uporabljamous-east-1kot regija, zato prosimo, da povečate kvoto storitev (če je potrebno) vus-east-1.

Namestitev z uporabo CloudFormation – Rešitev lahko namestite na us-east-1 s klikom na spodnji gumb:![]()

Uvajanje rešitve bo trajalo približno 20 minut in ustvarilo bo LLMAgentStack sklad, ki:

- razmesti končno točko SageMaker z uporabo

Flan-UL2model podjetja SageMaker JumpStart; - uporablja tri funkcije Lambda:

LLMAgentOrchestrator,LLMAgentReturnsTool,LLMAgentOrdersToolIn - razporedi an AWS Lex bot, ki ga je mogoče uporabiti za testiranje agenta:

Sagemaker-Jumpstart-Flan-LLM-Agent-Fallback-Bot.

Preizkusite raztopino

Sklad uvede bota Amazon Lex z imenom Sagemaker-Jumpstart-Flan-LLM-Agent-Fallback-Bot. Bot se lahko uporablja za testiranje agenta od konca do konca. Tukaj je dodaten izčrpen vodnik za testiranje botov AWS Amazon Lex z integracijo Lambda in kako integracija deluje na visoki ravni. Skratka, Amazon Lex bot je vir, ki ponuja hiter uporabniški vmesnik za klepet z agentom LLM, ki deluje znotraj funkcije Lambda, ki smo jo zgradili (LLMAgentOrchestrator).

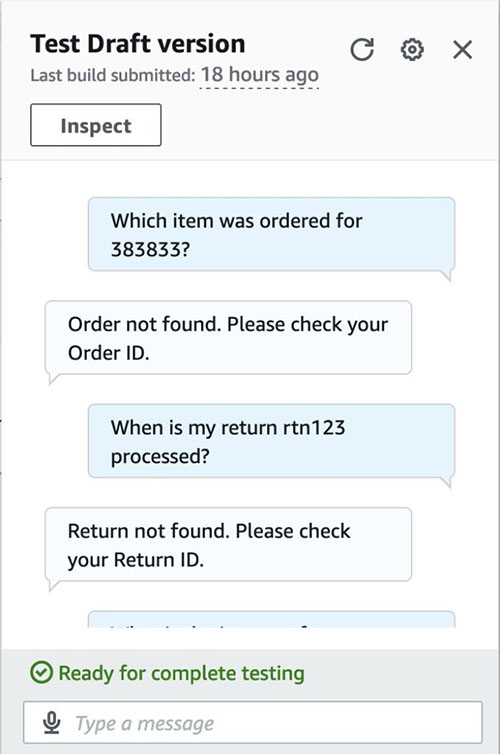

Vzorčni preskusni primeri, ki jih je treba upoštevati, so naslednji:

- Veljavno povpraševanje po naročilu (na primer »Za kateri artikel je bil naročen

123456? ")- Naročilo "123456" je veljavno naročilo, zato lahko pričakujemo razumen odgovor (npr. "Zeliščno milo za roke")

- Veljavno povpraševanje za vračilo za vračilo (na primer, »Kdaj se vrnem

rtn003obdelano?«)- Pričakovati moramo razumen odgovor o statusu vračila.

- Nepomembno za vračila ali naročila (na primer "Kakšno je trenutno vreme na Škotskem?")

- Nepomembno vprašanje za vračila ali naročila, zato je treba vrniti privzeti odgovor (»Oprostite, na to vprašanje ne morem odgovoriti.«)

- Neveljavno povpraševanje po naročilu (na primer »Za kateri artikel je bil naročen

383833? ")- ID 383832 ne obstaja v naboru podatkov o naročilih, zato bi morali elegantno spodleteti (na primer »Naročila ni bilo mogoče najti. Prosimo, preverite svoj ID naročila.«)

- Neveljavno povpraševanje po vračilu (na primer »Kdaj se vrnem

rtn123obdelano?«)- Podobno id

rtn123ne obstaja v naboru podatkov o vračilih, zato bi morala spodleteti.

- Podobno id

- Neustrezno povpraševanje po vračilu (na primer, »Kakšen je vpliv donosa

rtn001o svetovnem miru?")- To vprašanje je nepomembno, čeprav se zdi, da se nanaša na veljavno naročilo. LLM se uporablja za filtriranje vprašanj z nepomembnim kontekstom.

Če želite te teste izvesti sami, so tukaj navodila.

- Na konzoli Amazon Lex (Konzola AWS > Amazon Lex), se pomaknite do bota z naslovom

Sagemaker-Jumpstart-Flan-LLM-Agent-Fallback-Bot. Ta bot je že konfiguriran za klicanjeLLMAgentOrchestratorFunkcija lambda kadarkoliFallbackIntentse sproži. - V podoknu za krmarjenje izberite Namere.

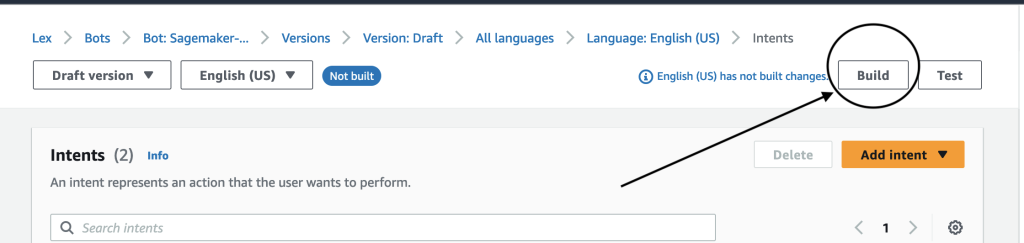

- Izberite Zgradite v zgornjem desnem kotu

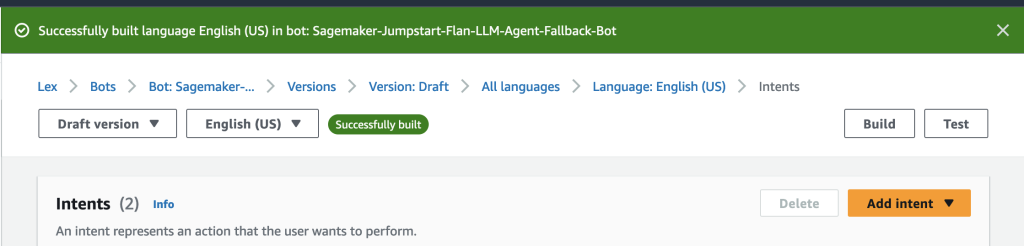

- 4. Počakajte, da se postopek gradnje konča. Ko je končano, se prikaže sporočilo o uspehu, kot je prikazano na naslednjem posnetku zaslona.

- Preizkusite bota tako, da vnesete testne primere.

Pospravi

Da se izognete dodatnim stroškom, izbrišite vire, ustvarjene z našo rešitvijo, tako da sledite tem korakom:

- o Oblikovanje oblaka AWS konzolo, izberite sklad z imenom

LLMAgentStack(ali ime po meri, ki ste ga izbrali). - Izberite Brisanje

- Preverite, ali je sklad izbrisan iz konzole CloudFormation.

pomembno: dvakrat preverite, ali je sklad uspešno izbrisan, tako da zagotovite, da je Flan-UL2 končna točka sklepanja je odstranjena.

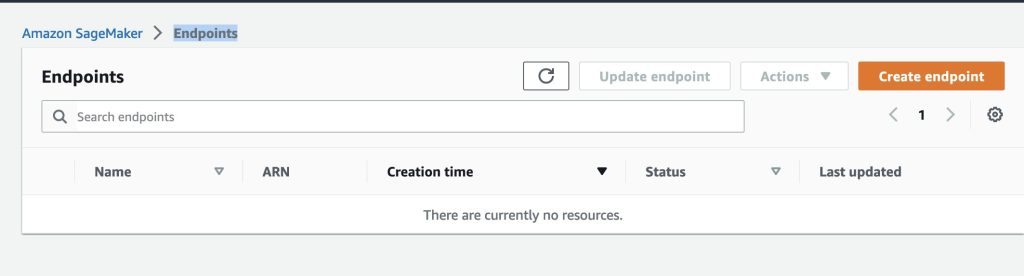

- Če želite preveriti, pojdite na Konzola AWS > Sagemaker > Končne točke > Sklep stran.

- Na strani bi morale biti navedene vse aktivne končne točke.

- Prepričajte se, da

sm-jumpstart-flan-bot-endpointne obstaja kot spodnji posnetek zaslona.

Premisleki za proizvodnjo

Uvajanje agentov LLM v proizvodnjo zahteva dodatne korake za zagotovitev zanesljivosti, zmogljivosti in vzdržljivosti. Tukaj je nekaj premislekov pred uvedbo agentov v proizvodnji:

- Izbira modela LLM za napajanje agentske zanke: Za rešitev, obravnavano v tej objavi, smo uporabili a

Flan-UL2model brez natančnega prilagajanja za izvajanje načrtovanja opravil ali izbire orodja. V praksi lahko uporaba LLM, ki je natančno nastavljen za neposredno izpisovanje zahtev orodja ali API-ja, poveča zanesljivost in zmogljivost ter poenostavi razvoj. LLM bi lahko natančno prilagodili nalogam izbire orodij ali uporabili model, ki neposredno dekodira orodne žetone, kot je Toolformer.- Uporaba natančno nastavljenih modelov lahko tudi poenostavi dodajanje, odstranjevanje in posodabljanje orodij, ki so na voljo agentu. S pristopi, ki temeljijo samo na pozivu, posodabljanje orodij zahteva spreminjanje vsakega poziva znotraj orkestratorja agenta, na primer tistih za načrtovanje opravil, razčlenjevanje orodij in pošiljanje orodij. To je lahko okorno in zmogljivost se lahko poslabša, če je v kontekstu LLM na voljo preveč orodij.

- Zanesljivost in zmogljivost: Agenti LLM so lahko nezanesljivi, zlasti pri zapletenih nalogah, ki jih ni mogoče dokončati v nekaj zankah. Dodajanje validacij izhodov, ponovnih poskusov, strukturiranje izhodov iz LLM-jev v JSON ali yaml in uveljavljanje časovnih omejitev za zagotovitev izhodnih loput za LLM-je, ki so obtičali v zankah, lahko poveča zanesljivost.

zaključek

V tej objavi smo raziskali, kako zgraditi LLM agenta, ki lahko od samega začetka uporablja več orodij, z uporabo nizkostopenjskega hitrega inženiringa, funkcij AWS Lambda in SageMaker JumpStart kot gradnikov. Podrobno smo razpravljali o arhitekturi LLM agentov in agentski zanki. Koncepti in arhitektura rešitve, predstavljeni v tej objavi v spletnem dnevniku, so morda primerni za agente, ki uporabljajo majhno število vnaprej določenih naborov orodij. Razpravljali smo tudi o več strategijah za uporabo agentov v proizvodnji. Agenti za Bedrock, ki je v predogledu, zagotavlja tudi upravljano izkušnjo za gradnjo agentov z izvorno podporo za priklice agentskih orodij.

O Author

John Hwang je generativni AI arhitekt pri AWS s posebnim poudarkom na aplikacijah Large Language Model (LLM), vektorskih bazah podatkov in generativni strategiji izdelkov AI. Strastno želi pomagati podjetjem pri razvoju izdelkov AI/ML ter prihodnosti agentov LLM in kopilotov. Preden se je pridružil AWS, je bil produktni vodja pri Alexa, kjer je pomagal uvesti pogovorno umetno inteligenco v mobilne naprave, ter trgovec z izvedenimi finančnimi instrumenti pri Morgan Stanley. Diplomiral je iz računalništva na univerzi Stanford.

John Hwang je generativni AI arhitekt pri AWS s posebnim poudarkom na aplikacijah Large Language Model (LLM), vektorskih bazah podatkov in generativni strategiji izdelkov AI. Strastno želi pomagati podjetjem pri razvoju izdelkov AI/ML ter prihodnosti agentov LLM in kopilotov. Preden se je pridružil AWS, je bil produktni vodja pri Alexa, kjer je pomagal uvesti pogovorno umetno inteligenco v mobilne naprave, ter trgovec z izvedenimi finančnimi instrumenti pri Morgan Stanley. Diplomiral je iz računalništva na univerzi Stanford.

- Distribucija vsebine in PR s pomočjo SEO. Okrepite se še danes.

- PlatoData.Network Vertical Generative Ai. Opolnomočite se. Dostopite tukaj.

- PlatoAiStream. Web3 Intelligence. Razširjeno znanje. Dostopite tukaj.

- PlatoESG. Avtomobili/EV, Ogljik, CleanTech, Energija, Okolje, sončna energija, Ravnanje z odpadki. Dostopite tukaj.

- PlatoHealth. Obveščanje o biotehnologiji in kliničnih preskušanjih. Dostopite tukaj.

- ChartPrime. Izboljšajte svojo igro trgovanja s ChartPrime. Dostopite tukaj.

- BlockOffsets. Posodobitev okoljskega offset lastništva. Dostopite tukaj.

- vir: https://aws.amazon.com/blogs/machine-learning/learn-how-to-build-and-deploy-tool-using-llm-agents-using-aws-sagemaker-jumpstart-foundation-models/

- :ima

- : je

- :ne

- :kje

- $GOR

- 1

- 100

- 15%

- 19

- 20

- 200

- 24

- 27

- 500

- 7

- 9

- a

- sposobnosti

- sposobnost

- O meni

- dostop

- doseganje

- Po

- ustrezno

- čez

- Ukrep

- dejavnosti

- aktivna

- dodano

- dodajanje

- Dodatne

- upravno

- napredek

- po

- spet

- Agent

- agenti

- AI

- AI / ML

- Alexa

- vsi

- že

- Prav tako

- Amazon

- Amazon Lex

- Amazon Web Services

- med

- znesek

- an

- in

- odgovor

- kaj

- API

- API-ji

- aplikacija

- uporaba

- aplikacije

- pristop

- pristopi

- primerno

- Arhitektura

- SE

- AS

- vprašati

- predpostavlja

- At

- Povečana

- Na voljo

- izogniti

- AWS

- AWS Lambda

- nazaj

- temeljijo

- BE

- postanejo

- bilo

- pred

- počutje

- spodaj

- Berkeley

- Poleg

- Bit

- Bloki

- Blog

- telo

- Bot

- tako

- bote

- prinašajo

- izgradnjo

- Building

- zgrajena

- poslovni

- vendar

- Gumb

- by

- Izračuni

- koledarji

- klic

- poziva

- CAN

- ne more

- Zmogljivosti

- primeru

- primeri

- Stroški

- chatbot

- preveriti

- Izberite

- izbran

- stranke

- združuje

- Podjetja

- dokončanje

- Končana

- kompleksna

- kompleksnost

- deli

- celovito

- računalnik

- Računalništvo

- koncepti

- zaključuje

- konfigurirano

- Razmislite

- premislekov

- Konzole

- stalna

- ozadje

- naprej

- pogovorni

- pogovorni AI

- Core

- strošek

- bi

- ustvarjajo

- ustvaril

- okoren

- po meri

- datum

- Baze podatkov

- baze podatkov

- nabor podatkov

- Dnevi

- odloča

- namenjen

- globlje

- privzeto

- definicije

- demo

- izkazati

- Odvisno

- razporedi

- razporejeni

- uvajanja

- uvajanje

- razpolaga

- Izvedeni finančni instrumenti

- zasnovan

- Podatki

- Podrobnosti

- Ugotovite,

- Razvoj

- naprave

- neposredno

- razpravljali

- potop

- do

- ne

- opravljeno

- pogon

- e

- e-trgovina

- vsak

- enostavno

- lahka

- učinkovito

- bodisi

- ostalo

- E-naslov

- zaposluje

- konec koncev

- Končna točka

- uveljavljanje

- Inženiring

- okrepi

- zagotovitev

- zagotovljeno

- zagotavlja

- zagotoviti

- V

- Z naslovom

- Napaka

- napake

- pobegniti

- zlasti

- itd

- Event

- Tudi vsak

- Primer

- Primeri

- Razen

- izjema

- izvršiti

- obstajajo

- pričakovati

- izkušnje

- Raziskano

- razširiti

- Se razširi

- zunanja

- dodatna

- Izvlečki

- FAIL

- false

- Moda

- Feature

- Nekaj

- Področja

- filter

- končna

- Pretok

- Osredotočite

- po

- sledi

- za

- format

- Obrazci

- je pokazala,

- Fundacija

- okviri

- Prijazno

- iz

- Izpolnite

- v celoti

- funkcija

- funkcionalnosti

- funkcije

- Prihodnost

- splošno

- ustvarjajo

- ustvarila

- generacija

- generativno

- Generativna AI

- dobili

- dana

- Go

- Igrišče

- vodi

- Zgodi se

- lopute

- Imajo

- ob

- he

- pomoč

- pomagal

- pomoč

- zato

- tukaj

- hi

- visoka

- zelo

- drži

- URE

- Kako

- Kako

- HTML

- http

- HTTPS

- Hub

- človeškega

- človeško berljivo

- i

- ID

- if

- vpliv

- izvajati

- Izvajanje

- uvoz

- izboljšanje

- in

- vključujejo

- vključujoč

- Povečajte

- narašča

- Podatki

- vhod

- povpraševanje

- v notranjosti

- Navodila

- integrirana

- Integrira

- integracija

- namen

- interakcijo

- medsebojno delovanje

- interakcije

- obresti

- v

- uvesti

- Uvedeno

- sklican

- prikliče

- vključujejo

- IT

- Izdelkov

- ponovitve

- pridružil

- jpg

- json

- Ključne

- znanje

- jezik

- velika

- kosilo

- UČITE

- Stopnja

- kot

- omejitve

- Meje

- Seznam

- LLM

- Logika

- Long

- POGLEDI

- Znamka

- IZDELA

- upravlja

- upravljanje

- upravitelj

- več

- Maj ..

- me

- pomeni

- Mehanizem

- Mehanizmi

- sestanki

- Sporočilo

- metapodatki

- Minute

- Mobilni

- mobilne naprave

- Model

- modeli

- več

- Morgan

- Morgan Stanley

- Najbolj

- več

- my

- Ime

- Imenovan

- Imena

- materni

- Krmarjenje

- krmarjenje

- ostalo

- potrebno

- Nimate

- potrebna

- Novo

- Naslednja

- št

- Noben

- predvsem

- zdaj

- Številka

- številne

- predmet

- of

- pogosto

- on

- enkrat

- ONE

- samo

- nasprotuje

- or

- Da

- naročila

- Ostalo

- drugače

- naši

- ven

- izhod

- zunaj

- več

- Premagajte

- pregled

- Stran

- podokno

- parametri

- mimo

- strastno

- Vzorec

- mir

- dokler

- Izvedite

- performance

- kramp

- izbrali

- Načrt

- načrtovanje

- platon

- Platonova podatkovna inteligenca

- PlatoData

- prosim

- plugins

- politika

- Prispevek

- moč

- poganja

- praksa

- napovedati

- napoved

- predpogoji

- preprečiti

- predogled

- prejšnja

- Predhodna

- Postopek

- Predelano

- obravnavati

- Izdelek

- Razvoj izdelkov

- produktni vodja

- proizvodnja

- Program

- programi

- pravilno

- zagotavljajo

- če

- zagotavlja

- zagotavljanje

- namene

- Python

- vprašanje

- vprašanja

- Hitri

- dvigniti

- hitro

- Surovi

- resnični svet

- razumno

- priznajo

- povrniti

- okolica

- pomembno

- zanesljivost

- ostanki

- Odstranjeno

- odstranjevanje

- zastopanje

- zahteva

- zahteva

- zahteva

- obvezna

- zahteva

- vir

- viri

- Odzove

- Odgovor

- Odgovornost

- odgovorna

- povzroči

- vrnitev

- vrnitev

- vrne

- Pravica

- usmerjevalnik

- usmerjanje

- Run

- tek

- s

- sagemaker

- zadovoljni

- razširljive

- Scenarij

- Znanost

- Obseg

- Iskalnik

- Zdi se,

- izbran

- izbor

- samostojno usmerjeno

- Občutek

- ločena

- Zaporedje

- Storitev

- Storitve

- nastavite

- več

- pošiljajo

- Dostava

- Kratke Hlače

- shot

- shouldnt

- Prikaži

- pokazale

- Enostavno

- poenostavitev

- preprosto

- sam

- majhna

- So

- Software

- Rešitev

- nekaj

- prefinjeno

- vir

- Viri

- posebna

- specializirani

- specifična

- specifikacija

- sveženj

- samostojna

- Stanford

- Univerza Stanford

- Stanley

- Začetek

- začel

- Izjava

- Status

- Korak

- Koraki

- stop

- trgovina

- strategije

- Strategija

- String

- strukturiranje

- Kasneje

- uspeh

- Uspešno

- taka

- predlagajte

- primerna

- podpora

- Preverite

- sistemi

- miza

- Bodite

- sprejeti

- meni

- ob

- Naloga

- Naloge

- povej

- Test

- Testiran

- Testiranje

- testi

- da

- O

- Prihodnost

- njihove

- POTEM

- Tukaj.

- te

- ta

- tisti,

- 3

- Tako

- krat

- do

- Boni

- tudi

- orodje

- orodja

- vrh

- Skupaj za plačilo

- sledenje

- trgovec

- tradicionalna

- usposobljeni

- sprožilo

- poskusite

- dva

- tipičen

- tipično

- ui

- univerza

- po nepotrebnem

- dokler

- posodobitve

- posodabljanje

- uporaba

- Rabljeni

- uporabnik

- uporablja

- uporabo

- uporabiti

- POTRDI

- potrjevanje

- raznolikost

- različica

- preko

- Počakaj

- je

- način..

- we

- Vreme

- web

- spletne storitve

- spletne strani

- Dobro

- Kaj

- Kaj je

- kdaj

- kadar koli

- ali

- ki

- medtem

- WHO

- bo

- z

- v

- brez

- deluje

- svet

- bi

- yaml

- Vi

- Vaša rutina za

- sami

- zefirnet