Danes z veseljem sporočamo, da so modeli temeljev Llama 2, ki jih je razvila Meta, na voljo strankam prek Amazon SageMaker JumpStart. Družina velikih jezikovnih modelov (LLM) Llama 2 je zbirka vnaprej usposobljenih in natančno nastavljenih generativnih besedilnih modelov, ki obsegajo od 7 milijard do 70 milijard parametrov. Natančno nastavljeni LLM-ji, imenovani Llama-2-chat, so optimizirani za primere uporabe dialoga. Te modele lahko preprosto preizkusite in jih uporabite s SageMaker JumpStart, ki je središče strojnega učenja (ML), ki omogoča dostop do algoritmov, modelov in rešitev ML, tako da lahko hitro začnete z ML.

V tej objavi bomo predstavili, kako uporabljati modele Llama 2 prek SageMaker JumpStart.

Kaj je Llama 2

Llama 2 je avtoregresivni jezikovni model, ki uporablja optimizirano transformatorsko arhitekturo. Llama 2 je namenjena komercialni in raziskovalni uporabi v angleškem jeziku. Na voljo je v različnih velikostih parametrov – 7 milijard, 13 milijard in 70 milijard – kot tudi v predhodno usposobljenih in natančno nastavljenih različicah. Po besedah Mete prilagojene različice uporabljajo nadzorovano fino uravnavanje (SFT) in okrepitveno učenje s človeškimi povratnimi informacijami (RLHF), da se uskladijo s človeškimi željami glede uporabnosti in varnosti. Llama 2 je bila predhodno usposobljena za 2 bilijona žetonov podatkov iz javno dostopnih virov. Uglašeni modeli so namenjeni klepetu, podobnemu pomočniku, medtem ko je vnaprej usposobljene modele mogoče prilagoditi za različne naloge generiranja naravnega jezika. Ne glede na to, katero različico modela uporablja razvijalec, je vodnik za odgovorno uporabo podjetja Meta lahko pomaga pri vodenju dodatne natančne nastavitve, ki je morda potrebna za prilagoditev in optimizacijo modelov z ustreznimi varnostnimi ublažitvami.

Kaj je SageMaker JumpStart

S SageMaker JumpStart lahko praktiki ML izbirajo med široko izbiro odprtokodnih modelov temeljev. Strokovnjaki ML lahko uvedejo temeljne modele v namenske Amazon SageMaker primerke iz omrežno izoliranega okolja in prilagodite modele z uporabo SageMakerja za usposabljanje in uvajanje modelov.

Zdaj lahko odkrijete in uvedete Llama 2 z nekaj kliki Amazon SageMaker Studio ali programsko prek SDK-ja SageMaker Python, kar vam omogoča, da izpeljete zmogljivost modela in kontrole MLOps s funkcijami SageMaker, kot je Amazonski cevovodi SageMaker, Napaka Amazon SageMaker, ali kontejnerski dnevniki. Model je nameščen v varnem okolju AWS in pod vašimi kontrolami VPC, kar pomaga zagotoviti varnost podatkov. Modeli Llama 2 so danes na voljo v studiu Amazon SageMaker, sprva v us-east 1 in us-west 2 regij.

Odkrijte modele

Do temeljnih modelov lahko dostopate prek SageMaker JumpStart v uporabniškem vmesniku SageMaker Studio in SDK SageMaker Python. V tem razdelku bomo opisali, kako odkriti modele v SageMaker Studio.

SageMaker Studio je integrirano razvojno okolje (IDE), ki ponuja enoten spletni vizualni vmesnik, kjer lahko dostopate do namensko izdelanih orodij za izvajanje vseh razvojnih korakov ML, od priprave podatkov do gradnje, usposabljanja in uvajanja vaših modelov ML. Za več podrobnosti o tem, kako začeti in nastaviti SageMaker Studio, glejte Amazon SageMaker Studio.

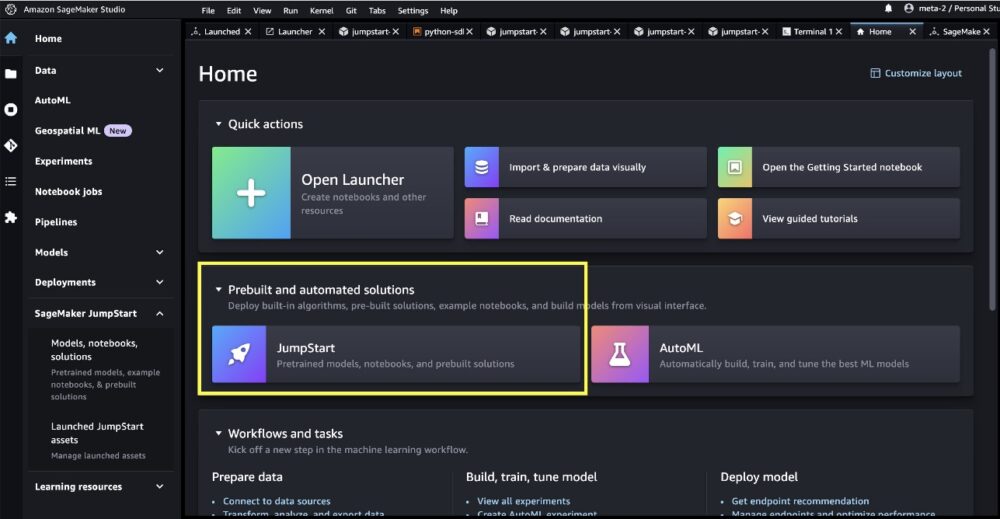

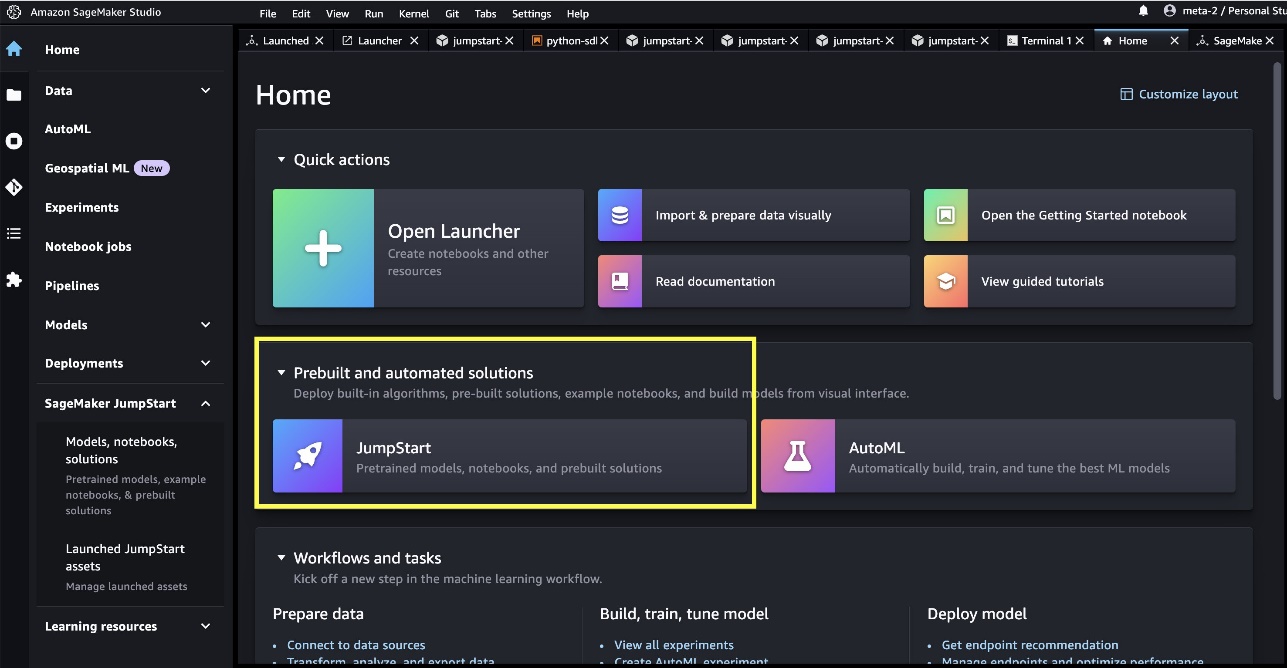

Ko ste v SageMaker Studio, lahko dostopate do SageMaker JumpStart, ki vsebuje vnaprej pripravljene modele, prenosnike in vnaprej pripravljene rešitve, pod Predizdelane in avtomatizirane rešitve.

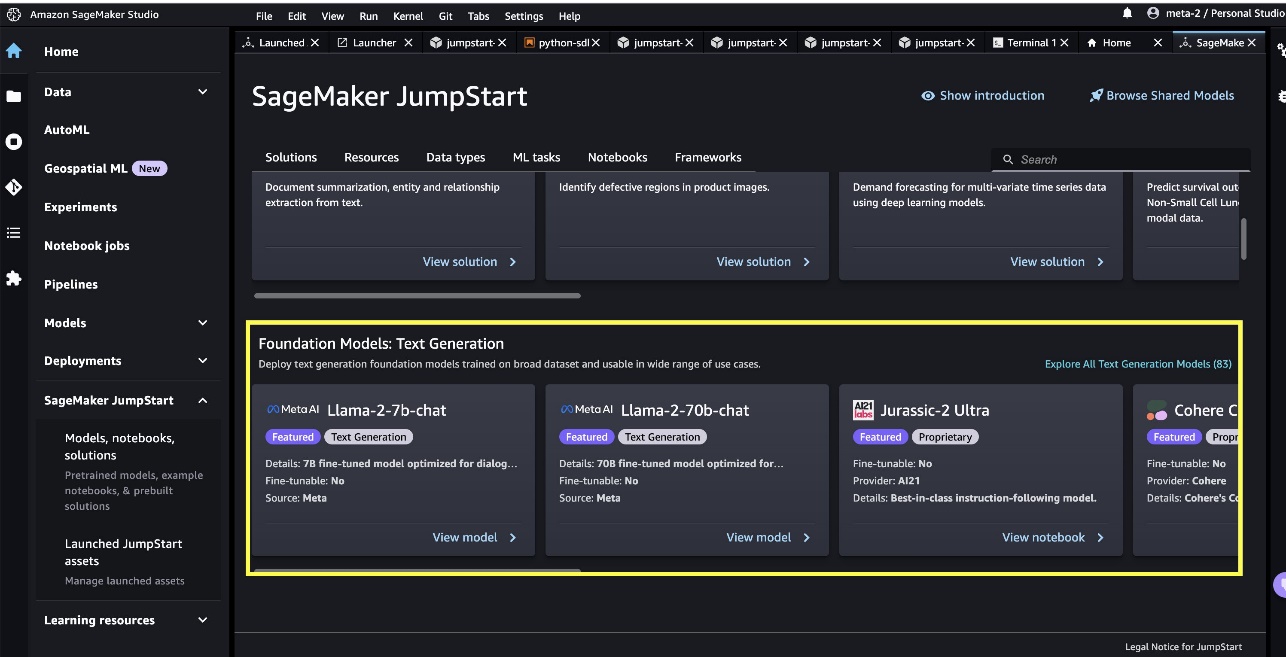

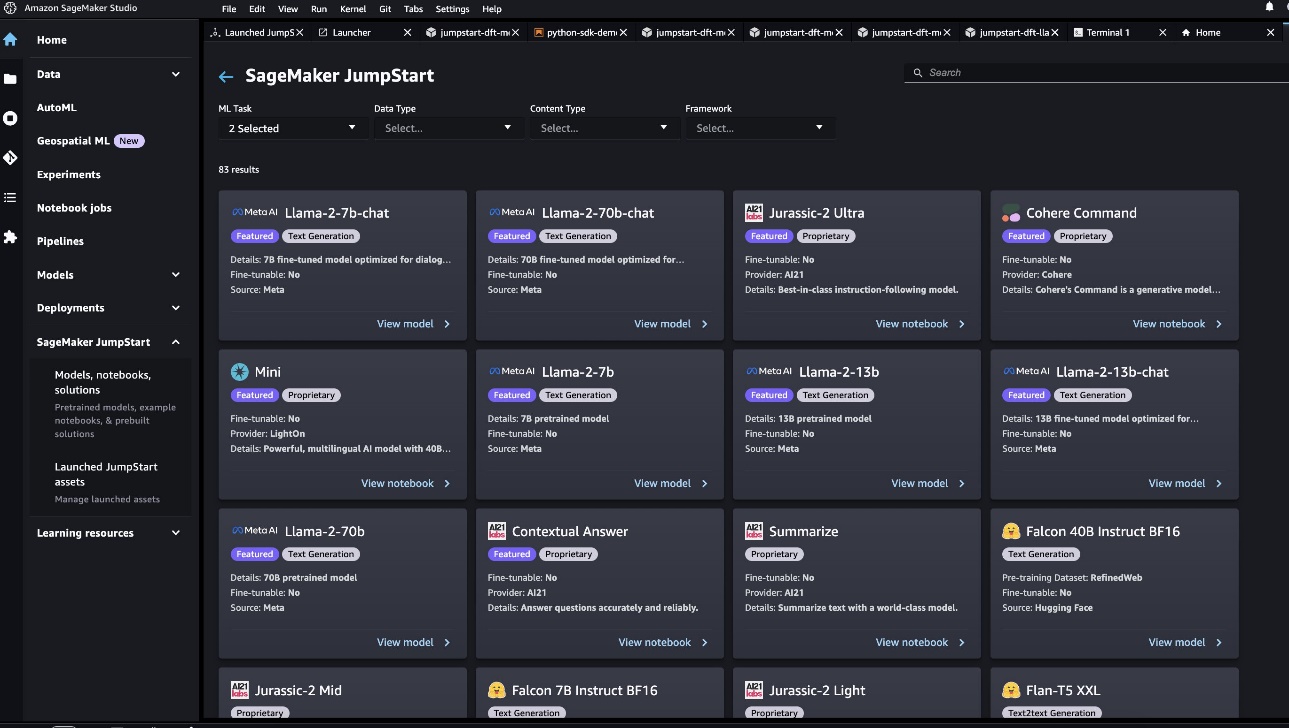

Na ciljni strani SageMaker JumpStart lahko brskate po rešitvah, modelih, prenosnikih in drugih virih. Dva vodilna modela Llama 2 najdete v Modeli temeljev: Ustvarjanje besedila vrtiljak. Če ne vidite modelov Llama 2, posodobite svojo različico SageMaker Studio tako, da zaustavite in znova zaženete. Za več informacij o posodobitvah različic glejte Zaustavite in posodobite aplikacije Studio.

Z izbiro lahko najdete tudi druge štiri različice modela Raziščite vse modele generiranja besedila ali iskanje llama v iskalnem polju.

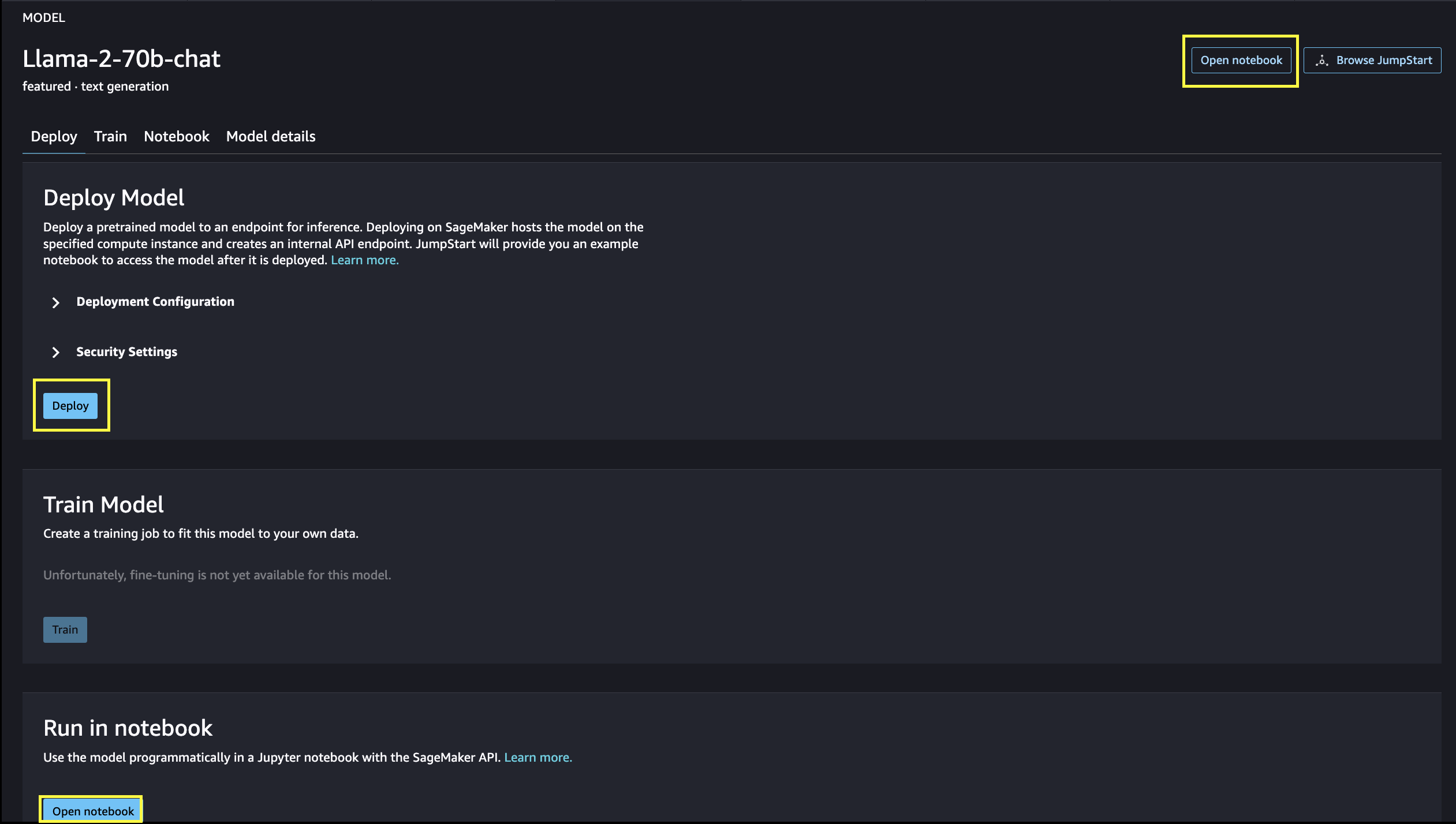

Izberete lahko kartico modela, da si ogledate podrobnosti o modelu, kot so licenca, podatki, uporabljeni za usposabljanje, in način uporabe. Najdete lahko tudi dva gumba, uvajanje in Odprite Beležnico, ki vam pomagajo pri uporabi modela.

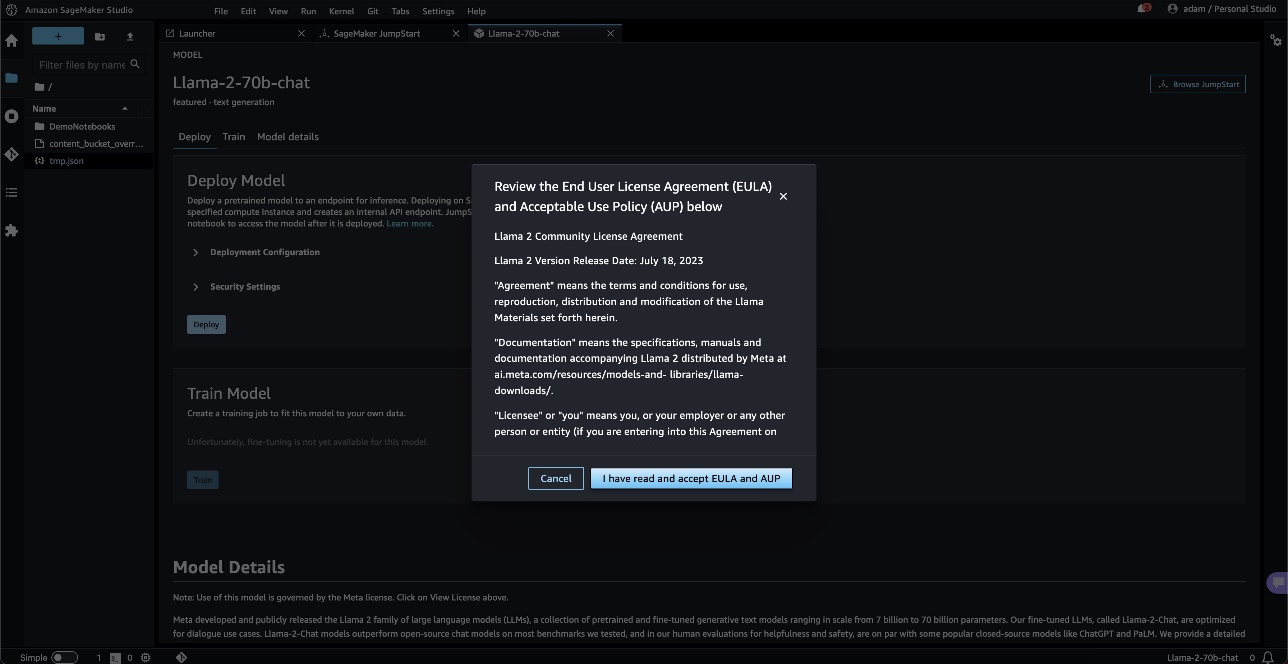

Ko izberete kateri koli gumb, se v pojavnem oknu prikaže licenčna pogodba za končnega uporabnika in pravilnik o sprejemljivi uporabi, ki ju morate potrditi.

Po potrditvi boste nadaljevali z naslednjim korakom za uporabo modela.

Namestite model

Ko izberete uvajanje in potrdite pogoje, se bo začela uvedba modela. Druga možnost je, da uvedete prek vzorčnega zvezka, ki se prikaže z izbiro Odprite Beležnico. Primer zvezka nudi navodila od konca do konca o tem, kako razmestiti model za sklepanje in čiščenje virov.

Za uvajanje z uporabo prenosnega računalnika začnemo z izbiro ustreznega modela, ki ga določi model_id. Kateri koli od izbranih modelov lahko namestite na SageMaker z naslednjo kodo:

To razmesti model v SageMaker s privzetimi konfiguracijami, vključno s privzeto vrsto primerka in privzetimi konfiguracijami VPC. Te konfiguracije lahko spremenite tako, da podate neprivzete vrednosti v JumpStartModel. Ko je uveden, lahko izvedete sklepanje glede na uvedeno končno točko prek napovedovalca SageMaker:

Natančno nastavljeni modeli klepeta (Llama-2-7b-klepet, Llama-2-13b-klepet, Llama-2-70b-klepet) sprejmejo zgodovino klepeta med uporabnikom in pomočnikom za klepet ter ustvarijo naslednji klepet. Vnaprej usposobljeni modeli (Llama-2-7b, Llama-2-13b, Llama-2-70b) zahtevajo poziv niza in izvedejo dokončanje besedila na danem pozivu. Oglejte si naslednjo kodo:

Upoštevajte, da je privzeto accept_eula je nastavljen na false. Morate nastaviti accept_eula=true da uspešno prikličete končno točko. S tem sprejemate uporabniško licenčno pogodbo in politiko sprejemljive uporabe, kot je bilo omenjeno prej. Lahko tudi prenesi licenčno pogodbo.

Custom_attributes ki se uporabljajo za posredovanje EULA, so pari ključ/vrednost. Ključ in vrednost sta ločena z = in pari so ločeni z ;. Če uporabnik posreduje isti ključ več kot enkrat, se zadnja vrednost ohrani in posreduje upravljalniku skripta (tj. v tem primeru se uporablja za pogojno logiko). Na primer, če accept_eula=false; accept_eula=true se nato posreduje strežniku accept_eula=true se hrani in posreduje upravljavcu skripta.

Parametri sklepanja nadzirajo proces generiranja besedila na končni točki. Največji nadzor novih žetonov se nanaša na velikost izhoda, ki ga ustvari model. Upoštevajte, da to ni enako številu besed, ker besedišče modela ni enako besedišču angleškega jezika in vsak žeton morda ni beseda angleškega jezika. Temperatura nadzoruje naključnost v izhodu. Višja temperatura povzroči bolj ustvarjalne in halucinirane rezultate. Vsi parametri sklepanja so neobvezni.

V naslednji tabeli so navedeni vsi modeli Llama, ki so na voljo v SageMaker JumpStart, skupaj z model_ids, privzete vrste primerkov in največje število skupnih žetonov (vsota števila vhodnih žetonov in števila ustvarjenih žetonov), podprtih za vsakega od teh modelov.

| Ime modela | ID modela | Največje skupno število žetonov | Privzeta vrsta primerka |

| Lama-2-7b | meta-textgeneration-llama-2-7b | 4096 | ml.g5.2xvelik |

| Llama-2-7b-klepet | meta-textgeneration-llama-2-7b-f | 4096 | ml.g5.2xvelik |

| Lama-2-13b | meta-textgeneration-llama-2-13b | 4096 | ml.g5.12xvelik |

| Llama-2-13b-klepet | meta-textgeneration-llama-2-13b-f | 4096 | ml.g5.12xvelik |

| Lama-2-70b | meta-textgeneration-llama-2-70b | 4096 | ml.g5.48xvelik |

| Llama-2-70b-klepet | meta-textgeneration-llama-2-70b-f | 4096 | ml.g5.48xvelik |

Upoštevajte, da imajo končne točke SageMaker omejitev časovne omejitve 60 s. Torej, čeprav lahko model ustvari 4096 žetonov, če ustvarjanje besedila traja več kot 60 sekund, zahteva ne bo uspela. Za modele 7B, 13B in 70B priporočamo nastavitev max_new_tokens ne večje od 1500, 1000 oziroma 500, medtem ko je skupno število žetonov manjše od 4K.

Pozivi za sklepanje in primere za Llama-2-70b

Modele Llama lahko uporabite za dokončanje besedila za kateri koli del besedila. Z generiranjem besedila lahko izvajate različne naloge, kot so odgovarjanje na vprašanja, jezikovni prevod, analiza čustev in še veliko več. Koristni vnos v končno točko je videti kot naslednja koda:

Sledi nekaj vzorčnih primerov pozivov in besedila, ki ga ustvari model. Vsi izhodi so ustvarjeni s parametri sklepanja {"max_new_tokens":256, "top_p":0.9, "temperature":0.6}.

V naslednjem primeru pokažemo, kako uporabljati modele Llama z učenjem v kontekstu z nekaj posnetki, kjer nudimo vzorce usposabljanja, ki so na voljo modelu. Upoštevajte, da sklepamo le na razporejeni model in med tem postopkom se uteži modela ne spremenijo.

Pozivi za sklepanje in primere za Llama-2-70b-klepet

Z modeli Llama-2-Chat, ki so optimizirani za primere uporabe dialoga, je vhod v končne točke modela klepeta prejšnja zgodovina med pomočnikom za klepet in uporabnikom. Vprašanja lahko postavljate v kontekstu pogovora, ki se je zgodil do zdaj. Podate lahko tudi sistemsko konfiguracijo, kot so osebe, ki določajo vedenje pomočnika za klepet. Koristni vnos v končno točko je videti kot naslednja koda:

Sledi nekaj vzorčnih primerov pozivov in besedila, ki ga ustvari model. Vsi izhodi so ustvarjeni s parametri sklepanja {"max_new_tokens": 512, "top_p": 0.9, "temperature": 0.6}.

V naslednjem primeru se je uporabnik z asistentom pogovarjal o turističnih krajih v Parizu. Nato uporabnik sprašuje o prvi možnosti, ki jo priporoča pomočnik za klepet.

V naslednjih primerih nastavimo konfiguracijo sistema:

Čiščenje

Ko končate z zagonom zvezka, izbrišite vse vire, tako da bodo izbrisani vsi viri, ki ste jih ustvarili med postopkom, in da bo vaše zaračunavanje ustavljeno:

zaključek

V tej objavi smo vam pokazali, kako začeti z modeli Llama 2 v SageMaker Studio. S tem imate dostop do šestih temeljnih modelov Llama 2, ki vsebujejo milijarde parametrov. Ker so osnovni modeli vnaprej usposobljeni, lahko tudi pomagajo znižati stroške usposabljanja in infrastrukture ter omogočijo prilagoditev za vaš primer uporabe. Če želite začeti uporabljati SageMaker JumpStart, obiščite naslednje vire:

O avtorjih

junij zmagal je produktni vodja pri SageMaker JumpStart. Osredotoča se na to, da naredi temeljne modele enostavno odkrite in uporabne za pomoč strankam pri gradnji generativnih aplikacij AI. Njegove izkušnje pri Amazonu vključujejo tudi aplikacijo za mobilno nakupovanje in dostavo zadnjega kilometra.

junij zmagal je produktni vodja pri SageMaker JumpStart. Osredotoča se na to, da naredi temeljne modele enostavno odkrite in uporabne za pomoč strankam pri gradnji generativnih aplikacij AI. Njegove izkušnje pri Amazonu vključujejo tudi aplikacijo za mobilno nakupovanje in dostavo zadnjega kilometra.

dr. Vivek Madan je uporabni znanstvenik pri ekipi Amazon SageMaker JumpStart. Doktoriral je na Univerzi Illinois v Urbana-Champaign in bil podoktorski raziskovalec na Georgia Tech. Je aktiven raziskovalec strojnega učenja in oblikovanja algoritmov ter je objavil članke na konferencah EMNLP, ICLR, COLT, FOCS in SODA.

dr. Vivek Madan je uporabni znanstvenik pri ekipi Amazon SageMaker JumpStart. Doktoriral je na Univerzi Illinois v Urbana-Champaign in bil podoktorski raziskovalec na Georgia Tech. Je aktiven raziskovalec strojnega učenja in oblikovanja algoritmov ter je objavil članke na konferencah EMNLP, ICLR, COLT, FOCS in SODA.  Dr. Kyle Ulrich je uporabni znanstvenik pri ekipi Amazon SageMaker JumpStart. Njegovi raziskovalni interesi vključujejo skalabilne algoritme strojnega učenja, računalniški vid, časovne vrste, Bayesove neparametrične in Gaussove procese. Njegov doktorat je pridobil na Univerzi Duke in je objavil članke v NeurIPS, Cell in Neuron.

Dr. Kyle Ulrich je uporabni znanstvenik pri ekipi Amazon SageMaker JumpStart. Njegovi raziskovalni interesi vključujejo skalabilne algoritme strojnega učenja, računalniški vid, časovne vrste, Bayesove neparametrične in Gaussove procese. Njegov doktorat je pridobil na Univerzi Duke in je objavil članke v NeurIPS, Cell in Neuron.  Dr. Ashish Khetan je višji aplikativni znanstvenik pri Amazon SageMaker JumpStart in pomaga pri razvoju algoritmov strojnega učenja. Doktoriral je na Univerzi Illinois Urbana-Champaign. Je aktiven raziskovalec strojnega učenja in statističnega sklepanja ter je objavil številne članke na konferencah NeurIPS, ICML, ICLR, JMLR, ACL in EMNLP.

Dr. Ashish Khetan je višji aplikativni znanstvenik pri Amazon SageMaker JumpStart in pomaga pri razvoju algoritmov strojnega učenja. Doktoriral je na Univerzi Illinois Urbana-Champaign. Je aktiven raziskovalec strojnega učenja in statističnega sklepanja ter je objavil številne članke na konferencah NeurIPS, ICML, ICLR, JMLR, ACL in EMNLP.  Sundar Ranganathan je globalni vodja strokovnjakov za GenAI/Frameworks GTM pri AWS. Osredotoča se na razvoj strategije GTM za velike jezikovne modele, GenAI in obsežne delovne obremenitve ML v storitvah AWS, kot so Amazon EC2, EKS, EFA, AWS Batch in Amazon SageMaker. Njegove izkušnje vključujejo vodilne vloge pri upravljanju izdelkov in razvoju izdelkov pri NetApp, Micron Technology, Qualcomm in Mentor Graphics.

Sundar Ranganathan je globalni vodja strokovnjakov za GenAI/Frameworks GTM pri AWS. Osredotoča se na razvoj strategije GTM za velike jezikovne modele, GenAI in obsežne delovne obremenitve ML v storitvah AWS, kot so Amazon EC2, EKS, EFA, AWS Batch in Amazon SageMaker. Njegove izkušnje vključujejo vodilne vloge pri upravljanju izdelkov in razvoju izdelkov pri NetApp, Micron Technology, Qualcomm in Mentor Graphics.

- Distribucija vsebine in PR s pomočjo SEO. Okrepite se še danes.

- PlatoData.Network Vertical Generative Ai. Opolnomočite se. Dostopite tukaj.

- PlatoAiStream. Web3 Intelligence. Razširjeno znanje. Dostopite tukaj.

- PlatoESG. Avtomobili/EV, Ogljik, CleanTech, Energija, Okolje, sončna energija, Ravnanje z odpadki. Dostopite tukaj.

- BlockOffsets. Posodobitev okoljskega offset lastništva. Dostopite tukaj.

- vir: https://aws.amazon.com/blogs/machine-learning/llama-2-foundation-models-from-meta-are-now-available-in-amazon-sagemaker-jumpstart/

- :ima

- : je

- :ne

- :kje

- $GOR

- 1

- 10

- 100

- 11

- 13

- 15%

- 17

- 19

- 20

- 30

- 31

- 33

- 360-stopnja

- 40

- 4k

- 500

- 7

- 70

- 8

- 9

- a

- Sposobna

- O meni

- Sprejmi

- sprejemljiv

- dostop

- dostopnost

- dostopen

- Po

- potrditi

- čez

- aktivna

- dodajte

- dodajanje

- Dodatne

- Naslov

- po

- spet

- proti

- Sporazum

- AI

- algoritem

- algoritmi

- uskladiti

- vsi

- omogočajo

- skupaj

- Prav tako

- vedno

- am

- Amazon

- Amazon EC2

- Amazon SageMaker

- Amazon SageMaker JumpStart

- Amazon SageMaker Studio

- Amazon Web Services

- Ameriška

- an

- Analiza

- in

- in infrastrukturo

- Objavi

- Še ena

- odgovor

- kaj

- kdo

- uporaba

- aplikacije

- uporabna

- Zahvaljujemo

- primerno

- Lok

- Arhitektura

- SE

- Umetnost

- AS

- pomoč

- Pomočnik

- At

- atmosfera

- zanimivosti

- Avtomatizirano

- Na voljo

- AWS

- Banana

- Osnovni

- Bitka

- Bajezijski

- BE

- lepa

- Beauty

- postal

- ker

- postanejo

- bilo

- pivo

- pred

- vedenje

- Peking

- Verjemite

- Menimo

- BEST

- med

- zaračunavanje

- Billion

- milijardah

- črna

- Pasovi

- Break

- dih jemajoče

- široka

- izgradnjo

- Building

- zgrajena

- vendar

- Gumb

- by

- se imenuje

- CAN

- Kapital

- voziček

- kartice

- Vrtiljak

- primeru

- primeri

- CAT

- spremenite

- čokolada

- Izberite

- izbiri

- mesto

- klasična

- Koda

- zbirka

- kombinirani

- združuje

- prihaja

- prihajajo

- komercialna

- podjetje

- dokončanje

- računalnik

- Računalniška vizija

- konference

- Prepričani

- konfiguracija

- šteje

- stalna

- Gradbeništvo

- vsebujejo

- Posoda

- Vsebuje

- vsebina

- kontekstualno

- naprej

- stalno

- nadzor

- Nadzor

- Priročen

- Pogovor

- stroški

- država

- pogum

- pokrov

- ustvarjajo

- ustvaril

- Creative

- kulturne

- Kultura

- Pokal

- Stranke, ki so

- customization

- prilagodite

- datum

- Varovanje podatkov

- namenjen

- predanost

- privzeto

- opredeliti

- dostava

- razporedi

- razporejeni

- uvajanja

- uvajanje

- razpolaga

- Oblikovanje

- zasnovan

- želeno

- destinacija

- destinacije

- Podrobnosti

- Razvoj

- razvili

- Razvojni

- razvoju

- Razvoj

- Dialog

- Razlika

- drugačen

- težko

- odkriti

- izrazito

- do

- dokumentarci

- tem

- opravljeno

- dont

- podvojilo

- navzdol

- Duke

- vojvodska univerza

- med

- e

- vsak

- prej

- enostavno

- lahka

- Edward

- Einstein

- bodisi

- E-naslov

- omogočajo

- omogočanje

- konec

- konec koncev

- Končna točka

- Inženiring

- Angleščina

- uživajte

- dovolj

- zagotovitev

- okolje

- oprema

- Eter

- Tudi

- dogodki

- vsi

- Primer

- Primeri

- razburjen

- izkušnje

- poskus

- Poskusi

- express

- FAIL

- ni uspelo

- sejem

- false

- družina

- slavni

- daleč

- feat

- izrazit

- Lastnosti

- povratne informacije

- Feet

- Nekaj

- filmi

- končna

- končno

- Najdi

- prva

- Vodilna

- Plavaj

- Tokovi

- Osredotoča

- po

- za

- Naprej

- je pokazala,

- Fundacija

- štiri

- Francija

- francosko

- iz

- v celoti

- nadalje

- Prihodnost

- splošno

- ustvarjajo

- ustvarila

- generacija

- generativno

- Generativna AI

- Georgia

- dobili

- Daj

- steklo

- Globalno

- Go

- dogaja

- grafika

- veliko

- več

- prelomni

- Grow

- Navodila

- vodi

- imel

- Ročaji

- se je zgodilo

- srečna

- Trdi

- Trdo delo

- Imajo

- ob

- he

- Glava

- pomoč

- pomoč

- Pomaga

- tukaj

- hi

- visoka

- več

- njegov

- zgodovinski

- zgodovina

- Ohišje

- Kako

- Kako

- HTML

- HTTPS

- Hub

- človeškega

- i

- ikona

- Ideja

- if

- ii

- Illinois

- vpliv

- uvoz

- Pomembno

- Impresivno

- in

- vključujejo

- vključuje

- Vključno

- Vključena

- Podatki

- Infrastruktura

- na začetku

- vhod

- navdih

- navdihujoča

- primer

- takoj

- Navodila

- integrirana

- namenjen

- interesi

- vmesnik

- v

- izolirani

- IT

- ITS

- Potovanje

- jpg

- samo

- vzdrževanje

- hranijo

- Ključne

- Otrok

- Vedite

- znano

- pristanek

- mejnik

- jezik

- velika

- obsežne

- Največji

- Zadnja

- Pozen

- kosilo

- Zakoni

- Vodstvo

- UČITE

- Uči se in raste

- učenje

- vsaj

- manj

- ravni

- Licenca

- življenje

- light

- kot

- LIMIT

- seznami

- literatura

- ll

- Llama

- Logika

- Long

- dolgo časa

- si

- POGLEDI

- ljubezen

- ljubil

- nižje

- stroj

- strojno učenje

- je

- Znamka

- IZDELA

- Izdelava

- upravljanje

- upravitelj

- več

- čudite

- Matter

- največja

- Maj ..

- kar pomeni,

- merjenje

- mediji

- srednje

- omenjeno

- Sporočilo

- Meta

- Mikron

- min

- Minute

- mešanico

- ML

- MLOps

- Mobilni

- Model

- modeli

- Trenutek

- mesecev

- več

- Najbolj

- Najbolj popularni

- motion

- Film

- veliko

- muzej

- Muzeji

- Glasba

- Ime

- naravna

- potrebno

- Nimate

- potrebna

- mreža

- Novo

- NY

- Naslednja

- št

- prenosnik

- zdaj

- Številka

- številne

- NY

- of

- ponudba

- ponujanje

- Ponudbe

- Olje

- on

- enkrat

- ONE

- samo

- odprite

- open source

- Optimizirajte

- optimizirana

- Možnost

- or

- Ostalo

- drugi

- drugače

- naši

- ven

- izhod

- več

- Splošni

- Stran

- parov

- Papir

- članki

- parameter

- parametri

- paris

- del

- mimo

- opravil

- vozovnice

- preteklosti

- mir

- Izvedite

- performance

- trajna

- telefon

- fotografije

- Fizika

- kos

- Pizza

- plastike

- platon

- Platonova podatkovna inteligenca

- PlatoData

- igral

- politika

- pop-up

- Popular

- Prispevek

- razglednico

- Predictor

- nastavitve

- priprava

- predstaviti

- prejšnja

- Postopek

- Procesi

- Izdelek

- Razvoj izdelkov

- upravljanje izdelkov

- produktni vodja

- Predlogi

- Ponosni

- zagotavljajo

- če

- zagotavlja

- zagotavljanje

- javnega

- javni prevoz

- javno

- objavljeno

- Namen

- dal

- Python

- Qualcomm

- vprašanja

- Hitri

- hitro

- Rampe

- naključnost

- območje

- obsegu

- pripravljen

- Razlogi

- prejeti

- Recept

- Priporočamo

- priporočeno

- nanaša

- Ne glede na to

- regije

- relativna

- relativnost

- ponovi

- predstavljajo

- zahteva

- zahteva

- Raziskave

- raziskovalec

- viri

- oziroma

- Odzove

- REST

- povzroči

- Rezultati

- Reka

- vloga

- vloge

- Run

- tek

- s

- Varnost

- sagemaker

- sol

- Enako

- razširljive

- Lestvica

- Znanstvenik

- Znanstveniki

- SDK

- MORJE

- Iskalnik

- iskanje

- Oddelek

- zavarovanje

- varnost

- glej

- videnje

- zdelo

- izbran

- izbiranje

- izbor

- pošljite

- višji

- sentiment

- Serija

- Storitve

- služijo

- nastavite

- nastavitev

- Oblikujte

- Shark

- Nakupovalna

- shouldnt

- Prikaži

- je pokazala,

- Razstave

- ugašati

- Pomen

- pomemben

- Enostavno

- preprosto

- sam

- spletna stran

- Spletna mesta

- SIX

- Velikosti

- Počasi

- majhna

- So

- doslej

- socialna

- družbeni mediji

- rešitve

- nekaj

- vir

- Viri

- posebna

- strokovnjaki

- določeno

- hitrost

- stojala

- Začetek

- začel

- Država

- Države

- Statistično

- Korak

- Koraki

- ustavil

- Strategija

- String

- Struktura

- studio

- Osupljiva

- predmet

- kasneje

- uspeh

- Uspešno

- taka

- Podprti

- Preverite

- Simbol

- sistem

- miza

- Bodite

- meni

- Naloge

- ključi

- skupina

- tech

- Tehnologija

- začasna

- Pogoji

- kot

- Hvala

- da

- O

- Glavno mesto

- Prihodnost

- Vir

- svet

- njihove

- Njih

- Teorija

- Tukaj.

- te

- jih

- stvari

- mislim

- ta

- čeprav?

- skozi

- Tiger

- čas

- Časovne serije

- krat

- Naslov

- do

- danes

- skupaj

- žeton

- Boni

- orodja

- vrh

- Skupaj za plačilo

- Stolp

- Vlak

- usposabljanje

- transformator

- prevesti

- prevod

- Prevoz

- Bilijona

- poskusite

- dva

- tip

- Vrste

- ui

- pod

- nepozaben

- edinstven

- univerza

- dokler

- Nadgradnja

- posodobitve

- uporabno

- uporaba

- primeru uporabe

- Rabljeni

- uporabnik

- Uporabniki

- uporablja

- uporabo

- vrednost

- Vrednote

- raznolikost

- različica

- različice

- zelo

- preko

- Poglej

- ogledov

- Vizija

- obisk

- Obiskovalci

- Obseg

- hotel

- vojna

- je

- we

- web

- spletne storitve

- Web-Based

- Spletna stran

- Dobro

- Whale

- Kaj

- Kaj je

- kdaj

- medtem ko

- ki

- medtem

- zakaj

- bo

- okna

- z

- beseda

- besede

- delo

- deluje

- svet

- svetovno znani

- zaviti

- let

- york

- Vi

- Vaša rutina za

- sami

- zefirnet

- Zip