Amazon SageMaker večmodelne končne točke (MME) so popolnoma upravljana zmožnost sklepanja SageMaker, ki vam omogoča uvajanje na tisoče modelov na eno končno točko. Prej so MME vnaprej določeno dodeljevali računalniško moč CPE modelom statično ne glede na prometno obremenitev modela z uporabo Strežnik z več modeli (MMS) kot njegov vzorčni strežnik. V tem prispevku razpravljamo o rešitvi, pri kateri lahko MME dinamično prilagaja računalniško moč, dodeljeno vsakemu modelu, na podlagi prometnega vzorca modela. Ta rešitev vam omogoča učinkovitejšo uporabo osnovnega računanja MME in prihranek stroškov.

MME dinamično nalagajo in razkladajo modele glede na dohodni promet do končne točke. Pri uporabi MMS kot modelnega strežnika MME dodelijo fiksno število modelskih delavcev za vsak model. Za več informacij glejte Vzorci gostovanja modelov v Amazon SageMaker, 3. del: Zaženite in optimizirajte sklepanje več modelov s končnimi točkami več modelov Amazon SageMaker.

Vendar pa lahko to povzroči nekaj težav, če je vaš prometni vzorec spremenljiv. Recimo, da imate enega ali nekaj modelov, ki prejemajo veliko prometa. MMS lahko konfigurirate tako, da za te modele dodelite veliko število delavcev, vendar se to dodeli vsem modelom za MME, ker je statična konfiguracija. To vodi do velikega števila delavcev, ki uporabljajo strojno računalništvo – celo nedejavni modeli. Nasprotna težava se lahko zgodi, če nastavite majhno vrednost za število delavcev. Priljubljeni modeli ne bodo imeli dovolj delavcev na ravni modelnega strežnika, da bi pravilno dodelili dovolj strojne opreme za končno točko za te modele. Glavna težava je, da je težko ostati neodvisen od vzorcev prometa, če ne morete dinamično prilagoditi svojih delavcev na ravni modelnega strežnika za dodelitev potrebne količine računalništva.

Rešitev, o kateri razpravljamo v tej objavi, uporablja DJLServing kot modelni strežnik, ki lahko pomaga ublažiti nekatere težave, o katerih smo razpravljali, in omogoči skaliranje po modelu ter omogoči, da so MME agnostični vzorci prometa.

arhitektura MME

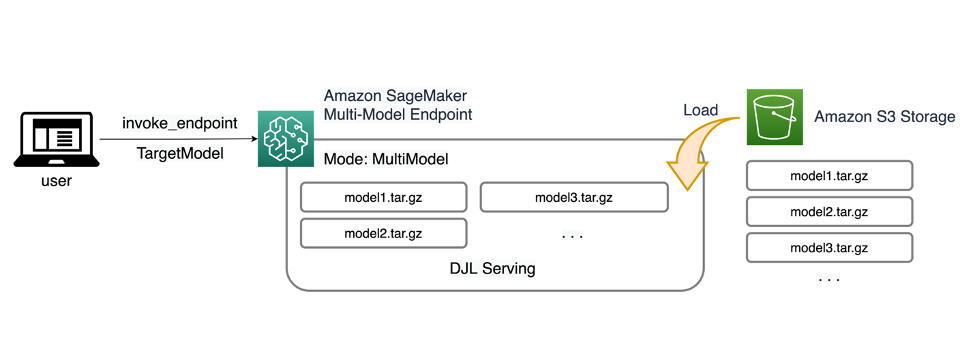

SageMaker MME vam omogočajo uvedbo več modelov za eno končno točko sklepanja, ki lahko vsebuje enega ali več primerkov. Vsak primerek je zasnovan za nalaganje in streženje več modelov do njegove zmogljivosti pomnilnika in CPE/GPU. S to arhitekturo lahko programska oprema kot storitev (SaaS) prekine linearno naraščajoče stroške gostovanja več modelov in doseže ponovno uporabo infrastrukture, ki je skladna z modelom več najemnikov, ki se uporablja drugje v skladu aplikacij. Naslednji diagram ponazarja to arhitekturo.

SageMaker MME dinamično nalaga modele iz Preprosta storitev shranjevanja Amazon (Amazon S3), ko je priklican, namesto da prenese vse modele, ko je končna točka prvič ustvarjena. Posledično se lahko pri začetnem priklicu modela pojavi višja zakasnitev sklepanja kot pri poznejših sklepih, ki so dokončani z nizko zakasnitvijo. Če je model ob priklicu že naložen v vsebnik, se korak prenosa preskoči in model vrne sklepe z nizko zakasnitvijo. Recimo, da imate model, ki ga uporabljate le nekajkrat na dan. Samodejno se naloži na zahtevo, medtem ko se pogosto dostopni modeli ohranijo v pomnilniku in prikličejo z dosledno nizko zakasnitvijo.

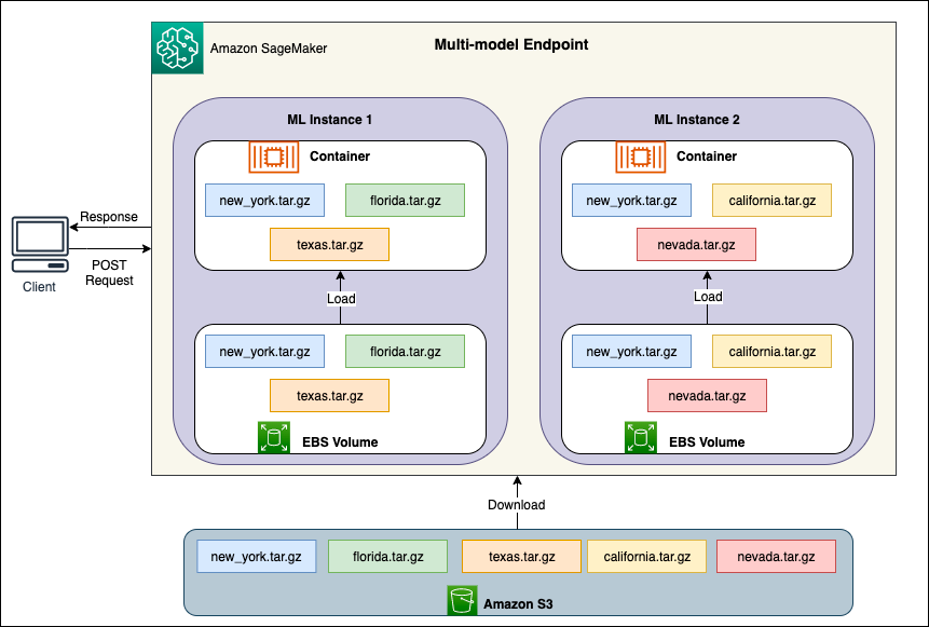

Za vsakim MME so primerki gostovanja modela, kot je prikazano v naslednjem diagramu. Ti primerki naložijo in odstranijo več modelov v pomnilnik in iz njega na podlagi vzorcev prometa do modelov.

SageMaker še naprej usmerja zahteve za sklepanje za model do primerka, kjer je model že naložen, tako da se zahteve strežejo iz predpomnjene kopije modela (glejte naslednji diagram, ki prikazuje pot zahteve za prvo zahtevo po predvidevanju v primerjavi s predpomnjeno napovedjo pot zahteve). Vendar, če model prejme veliko zahtev za priklic in obstajajo dodatni primerki za MME, SageMaker usmeri nekatere zahteve v drug primerek, da se prilagodi povečanju. Če želite izkoristiti avtomatizirano skaliranje modela v SageMakerju, se prepričajte, da imate nastavljeno samodejno skaliranje primerka za zagotovitev dodatne zmogljivosti primerka. Nastavite svojo politiko skaliranja na ravni končne točke s parametri po meri ali klici na minuto (priporočeno), da dodate več primerkov v floto končnih točk.

Pregled strežnika modela

Modelski strežnik je komponenta programske opreme, ki zagotavlja izvajalno okolje za uvajanje in streženje modelov strojnega učenja (ML). Deluje kot vmesnik med usposobljenimi modeli in odjemalskimi aplikacijami, ki želijo narediti napovedi z uporabo teh modelov.

Glavni namen modelnega strežnika je omogočiti enostavno integracijo in učinkovito uvajanje modelov ML v proizvodne sisteme. Namesto vdelave modela neposredno v aplikacijo ali določeno ogrodje strežnik modelov zagotavlja centralizirano platformo, kjer je mogoče namestiti, upravljati in streči več modelov.

Modelni strežniki običajno ponujajo naslednje funkcije:

- Nalaganje modela – Strežnik naloži usposobljene modele ML v pomnilnik, tako da so pripravljeni za serviranje napovedi.

- API za sklepanje – Strežnik razkrije API, ki odjemalskim aplikacijam omogoča pošiljanje vhodnih podatkov in prejemanje napovedi iz razporejenih modelov.

- Luščenje – Modelni strežniki so zasnovani za obravnavanje sočasnih zahtev več odjemalcev. Zagotavljajo mehanizme za vzporedno obdelavo in učinkovito upravljanje virov, da zagotovijo visoko prepustnost in nizko zakasnitev.

- Integracija z zalednimi motorji – Strežniki modelov imajo integracije z zalednimi ogrodji, kot sta DeepSpeed in FasterTransformer, za razdelitev velikih modelov in izvajanje visoko optimiziranega sklepanja.

DJL arhitektura

DJL Serviranje je odprtokodni, visoko zmogljiv, univerzalni modelni strežnik. DJL Serving je zgrajen na vrhu DJL, knjižnica za globoko učenje, napisana v programskem jeziku Java. Lahko vzame model globokega učenja, več modelov ali delovnih tokov in jih da na voljo prek končne točke HTTP. DJL Serving podpira uvajanje modelov iz več ogrodij, kot so PyTorch, TensorFlow, Apache MXNet, ONNX, TensorRT, Hugging Face Transformers, DeepSpeed, FasterTransformer in drugo.

DJL Serving ponuja številne funkcije, ki vam omogočajo, da svoje modele uvedete z visoko zmogljivostjo:

- Enostavnost uporabe – DJL Serving lahko takoj postreže večino modelov. Samo prinesite artefakte modela in DJL Serving jih lahko gosti.

- Podpora za več naprav in pospeševalnikov – DJL Serving podpira uvajanje modelov na CPE, GPE in Sklepanje AWS.

- Uspešnost – DJL Serving izvaja večnitno sklepanje v enem JVM za povečanje prepustnosti.

- Dinamično doziranje – DJL Serving podpira dinamično šaržiranje za povečanje prepustnosti.

- Samodejno skaliranje – DJL Serving bo samodejno povečal in zmanjšal število delavcev glede na prometno obremenitev.

- Podpora za več motorjev – DJL Serving lahko hkrati gosti modele, ki uporabljajo različna ogrodja (kot sta PyTorch in TensorFlow).

- Modeli ansambla in delovnega toka – DJL Serving podpira uvajanje kompleksnih delovnih tokov, sestavljenih iz več modelov, in izvaja dele delovnega toka na CPE in dele na GPE. Modeli znotraj poteka dela lahko uporabljajo različna ogrodja.

Zlasti funkcija samodejnega skaliranja DJL Serving omogoča preprosto zagotavljanje, da so modeli ustrezno prilagojeni dohodnemu prometu. DJL Serving privzeto določi največje število delavcev za model, ki je lahko podprt glede na razpoložljivo strojno opremo (jedra CPE, naprave GPE). Za vsak model lahko nastavite spodnjo in zgornjo mejo, da zagotovite, da je vedno mogoče zagotoviti minimalno raven prometa in da en sam model ne porabi vseh razpoložljivih virov.

DJL Serving uporablja a Netty čelni del na vrhu bazenov niti zalednega delavca. Frontend uporablja eno samo nastavitev Netty z več HttpRequestHandlers. Različni obdelovalci zahtev bodo zagotovili podporo za API za sklepanje, API za upravljanjeali druge API-je, ki so na voljo v različnih vtičnikih.

Zaledje temelji na WorkLoadManager (WLM) modul. WLM skrbi za več delovnih niti za vsak model skupaj s paketnim usmerjanjem zahtev in usmerjanjem do njih. Ko je postreženih več modelov, WLM najprej preveri velikost čakalne vrste zahtev za sklepanje vsakega modela. Če je velikost čakalne vrste večja od dvakratne velikosti paketa modela, WLM poveča število delavcev, dodeljenih temu modelu.

Pregled rešitev

Izvedba DJL z MME se razlikuje od privzete nastavitve MMS. Za storitev DJL z MME stisnemo naslednje datoteke v formatu model.tar.gz, ki ga pričakuje SageMaker Inference:

- model.joblib – Za to izvedbo metapodatke modela neposredno potisnemo v arhiv. V tem primeru sodelujemo z a

.joblibdatoteko, zato to datoteko zagotovimo v našem arhivu, da jo lahko prebere naš sklepni skript. Če je artefakt prevelik, ga lahko potisnete tudi v Amazon S3 in usmerite proti njemu v konfiguraciji strežbe, ki jo določite za DJL. - serviranje.lastnosti – Tukaj lahko konfigurirate kateri koli model, povezan s strežnikom spremenljivke okolja. Moč DJL je v tem, da lahko konfigurirate

minWorkersinmaxWorkersza vsak model tarball. To omogoča, da se vsak model poveča in zmanjša na ravni strežnika modelov. Na primer, če posamezen model prejema večino prometa za MME, bo strežnik modela dinamično povečal delavce. V tem primeru teh spremenljivk ne konfiguriramo in pustimo, da DJL določi potrebno število delavcev glede na naš prometni vzorec. - model.py – To je sklepni skript za katero koli predhodno ali naknadno obdelavo po meri, ki jo želite izvesti. Model.py pričakuje, da bo vaša logika privzeto enkapsulirana v metodo ročaja.

- requirements.txt (neobvezno) – Privzeto je DJL nameščen s PyTorch, vendar lahko vse dodatne odvisnosti, ki jih potrebujete, potisnete sem.

V tem primeru prikazujemo moč DJL z MME tako, da vzamemo vzorec modela SKLearn. S tem modelom izvajamo usposabljanje in nato ustvarimo 1,000 kopij tega artefakta modela, da podpremo naš MME. Nato predstavimo, kako se lahko DJL dinamično prilagaja, da obravnava katero koli vrsto prometnega vzorca, ki ga lahko prejme vaš MME. To lahko vključuje enakomerno porazdelitev prometa po vseh modelih ali celo nekaj priljubljenih modelih, ki prejemajo večino prometa. Vso kodo najdete v nadaljevanju GitHub repo.

Predpogoji

Za ta primer uporabljamo primerek prenosnega računalnika SageMaker z jedrom conda_python3 in primerkom ml.c5.xlarge. Za izvedbo preskusov obremenitve lahko uporabite an Amazonski elastični računalniški oblak (Amazon EC2) primerek ali večji primerek prenosnika SageMaker. V tem primeru merimo več kot tisoč transakcij na sekundo (TPS), zato predlagamo testiranje na težji instanci EC2, kot je ml.c5.18xlarge, tako da imate več računalništva za delo.

Ustvarite artefakt modela

Najprej moramo ustvariti naš artefakt modela in podatke, ki jih bomo uporabili v tem primeru. V tem primeru ustvarimo nekaj umetnih podatkov z NumPy in jih urimo z uporabo modela linearne regresije SKLearn z naslednjim izrezkom kode:

Ko zaženete prejšnjo kodo, bi morali imeti model.joblib datoteko, ustvarjeno v vašem lokalnem okolju.

Potegnite sliko DJL Docker

Dockerjeva slika djl-inference:0.23.0-cpu-full-v1.0 je naš strežni vsebnik DJL, uporabljen v tem primeru. Naslednji URL lahko prilagodite glede na svojo regijo:

inference_image_uri = "474422712127.dkr.ecr.us-east-1.amazonaws.com/djl-serving-cpu:latest"

Po želji lahko to sliko uporabite tudi kot osnovno sliko in jo razširite, da na njej zgradite svojo sliko Docker Registar elastičnih zabojnikov Amazon (Amazon ECR) z vsemi drugimi odvisnostmi, ki jih potrebujete.

Ustvari datoteko modela

Najprej ustvarimo datoteko z imenom serving.properties. To naroči DJLServingu, naj uporablja mehanizem Python. Definiramo tudi max_idle_time delavca znašati 600 sekund. To zagotavlja, da potrebujemo več časa za zmanjšanje števila delavcev, ki jih imamo na model. Ne prilagajamo se minWorkers in maxWorkers ki jih lahko definiramo in pustimo DJL-ju, da dinamično izračuna število potrebnih delavcev glede na promet, ki ga prejme vsak model. Serving.properties je prikazano na naslednji način. Za ogled celotnega seznama konfiguracijskih možnosti glejte Konfiguracija motorja.

Nato ustvarimo datoteko model.py, ki definira nalaganje modela in logiko sklepanja. Za MME je vsaka datoteka model.py specifična za model. Modeli so shranjeni na svojih poteh pod shrambo modelov (običajno /opt/ml/model/). Pri nalaganju modelov bodo ti naloženi pod potjo do shranjevanja modelov v lastnem imeniku. Celoten primer model.py v tej predstavitvi si lahko ogledate v GitHub repo.

Ustvarimo a model.tar.gz datoteka, ki vključuje naš model (model.joblib), model.pyin serving.properties:

Za demonstracijske namene izdelamo 1,000 kopij istega model.tar.gz datoteko, ki predstavlja veliko število modelov, ki bodo gostili. V proizvodnji morate ustvariti a model.tar.gz datoteko za vsak vaš model.

Nazadnje te modele naložimo v Amazon S3.

Ustvarite model SageMaker

Zdaj ustvarjamo a Model SageMaker. Za ustvarjanje modela SageMaker uporabimo prej definirano sliko ECR in artefakt modela iz prejšnjega koraka. V nastavitvi modela način konfiguriramo kot MultiModel. To sporoča DJLServingu, da ustvarjamo MME.

Ustvarite končno točko SageMaker

V tej predstavitvi uporabljamo 20 primerkov ml.c5d.18xlarge za prilagajanje na TPS v območju tisoč. Poskrbite za povečanje omejitve za vrsto instance, če je potrebno, da dosežete TPS, na katerega ciljate.

Testiranje obremenitve

V času pisanja, lastno orodje za testiranje obremenitve SageMaker Amazon SageMaker Inference Recommender izvorno ne podpira testiranja za MME. Zato uporabljamo odprtokodno orodje Python Locust. Locust je preprost za nastavitev in lahko sledi meritvam, kot sta TPS in zakasnitev od konca do konca. Za popolno razumevanje, kako ga nastaviti s SageMakerjem, glejte Najboljše prakse za obremenitveno testiranje končnih točk sklepanja v realnem času Amazon SageMaker.

V tem primeru uporabe imamo tri različne prometne vzorce, ki jih želimo simulirati z MME, tako da imamo naslednje tri skripte Python, ki so usklajeni z vsakim vzorcem. Naš cilj tukaj je dokazati, da lahko ne glede na to, kakšen je naš prometni vzorec, dosežemo isti ciljni TPS in se ustrezno prilagodimo.

V našem skriptu Locust lahko določimo težo, da dodelimo promet različnim delom naših modelov. Na primer, z našim enim vročim modelom izvajamo dve metodi, kot sledi:

Nato lahko vsaki metodi dodelimo določeno težo, kar pomeni, da določena metoda prejme določen odstotek prometa:

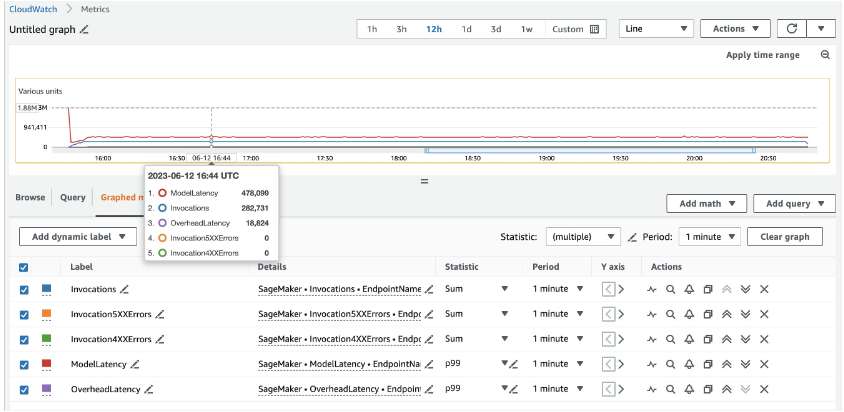

Za primerke 20 ml.c5d.18xlarge vidimo naslednje metrike klicev na amazoncloudwatch konzola. Te vrednosti ostajajo precej dosledne v vseh treh prometnih vzorcih. Če želite bolje razumeti meritve CloudWatch za sklepanje v realnem času SageMaker in MME, glejte Meritve priklica končne točke SageMaker.

Ostale skripte Locust najdete v imenik locust-utils v repozitoriju GitHub.

Povzetek

V tej objavi smo razpravljali o tem, kako lahko MME dinamično prilagodi računalniško moč, dodeljeno vsakemu modelu, glede na prometni vzorec modela. Ta na novo predstavljena funkcija je na voljo v vseh regijah AWS, kjer je na voljo SageMaker. Upoštevajte, da so v času objave podprti samo primerki CPE. Če želite izvedeti več, glejte Podprti algoritmi, ogrodja in primerki.

O avtorjih

Ram Vegiraju je ML arhitekt pri ekipi SageMaker Service. Osredotoča se na pomoč strankam pri izgradnji in optimizaciji njihovih rešitev AI/ML na Amazon SageMaker. V prostem času rad potuje in piše.

Ram Vegiraju je ML arhitekt pri ekipi SageMaker Service. Osredotoča se na pomoč strankam pri izgradnji in optimizaciji njihovih rešitev AI/ML na Amazon SageMaker. V prostem času rad potuje in piše.

Qingwei Li je strokovnjak za strojno učenje pri Amazon Web Services. Doktoriral je v operacijskem raziskovanju, potem ko je zlomil račun svojega svetovalca za raziskovalno pomoč in mu ni uspel izročiti Nobelove nagrade, ki jo je obljubil. Trenutno strankam v finančni in zavarovalniški industriji pomaga pri izdelavi rešitev strojnega učenja na AWS. V prostem času rad bere in poučuje.

Qingwei Li je strokovnjak za strojno učenje pri Amazon Web Services. Doktoriral je v operacijskem raziskovanju, potem ko je zlomil račun svojega svetovalca za raziskovalno pomoč in mu ni uspel izročiti Nobelove nagrade, ki jo je obljubil. Trenutno strankam v finančni in zavarovalniški industriji pomaga pri izdelavi rešitev strojnega učenja na AWS. V prostem času rad bere in poučuje.

James Wu je višji specialist za AI/ML rešitve pri AWS. pomoč strankam pri načrtovanju in izdelavi rešitev AI/ML. Jamesovo delo pokriva širok spekter primerov uporabe ML, s primarnim zanimanjem za računalniški vid, globoko učenje in razširjanje ML v podjetju. Preden se je pridružil podjetju AWS, je bil James več kot 10 let arhitekt, razvijalec in tehnološki vodja, od tega 6 let v inženiringu in 4 leta v trženju in oglaševalski industriji.

James Wu je višji specialist za AI/ML rešitve pri AWS. pomoč strankam pri načrtovanju in izdelavi rešitev AI/ML. Jamesovo delo pokriva širok spekter primerov uporabe ML, s primarnim zanimanjem za računalniški vid, globoko učenje in razširjanje ML v podjetju. Preden se je pridružil podjetju AWS, je bil James več kot 10 let arhitekt, razvijalec in tehnološki vodja, od tega 6 let v inženiringu in 4 leta v trženju in oglaševalski industriji.

Saurabh Trikande je višji produktni vodja za Amazon SageMaker Inference. Navdušen je nad delom s strankami in ga motivira cilj demokratizacije strojnega učenja. Osredotoča se na ključne izzive, povezane z uvajanjem kompleksnih aplikacij ML, modelov ML z več najemniki, optimizacijo stroškov in zagotavljanjem dostopnosti uvajanja modelov globokega učenja. V prostem času Saurabh uživa v pohodništvu, spoznavanju inovativnih tehnologij, spremlja TechCrunch in preživlja čas s svojo družino.

Saurabh Trikande je višji produktni vodja za Amazon SageMaker Inference. Navdušen je nad delom s strankami in ga motivira cilj demokratizacije strojnega učenja. Osredotoča se na ključne izzive, povezane z uvajanjem kompleksnih aplikacij ML, modelov ML z več najemniki, optimizacijo stroškov in zagotavljanjem dostopnosti uvajanja modelov globokega učenja. V prostem času Saurabh uživa v pohodništvu, spoznavanju inovativnih tehnologij, spremlja TechCrunch in preživlja čas s svojo družino.

Xu Deng je vodja programskega inženirja pri ekipi SageMaker. Osredotoča se na pomoč strankam pri izgradnji in optimizaciji njihove izkušnje sklepanja AI/ML na Amazon SageMaker. V prostem času obožuje potovanja in deskanje na snegu.

Xu Deng je vodja programskega inženirja pri ekipi SageMaker. Osredotoča se na pomoč strankam pri izgradnji in optimizaciji njihove izkušnje sklepanja AI/ML na Amazon SageMaker. V prostem času obožuje potovanja in deskanje na snegu.

Siddharth Venkatesan je programski inženir v AWS Deep Learning. Trenutno se osredotoča na gradnjo rešitev za sklepanje velikih modelov. Pred AWS je delal v organizaciji Amazon Grocery in gradil nove plačilne funkcije za stranke po vsem svetu. Izven službe uživa v smučanju, na prostem in spremlja šport.

Siddharth Venkatesan je programski inženir v AWS Deep Learning. Trenutno se osredotoča na gradnjo rešitev za sklepanje velikih modelov. Pred AWS je delal v organizaciji Amazon Grocery in gradil nove plačilne funkcije za stranke po vsem svetu. Izven službe uživa v smučanju, na prostem in spremlja šport.

Rohith Nallamaddi je inženir za razvoj programske opreme pri AWS. Dela na optimizaciji delovnih obremenitev globokega učenja na grafičnih procesorjih, gradi visoko zmogljive rešitve ML za sklepanje in streženje. Pred tem je delal na gradnji mikrostoritev, ki temeljijo na AWS, za posel Amazon F3. Izven službe rad igra in spremlja šport.

Rohith Nallamaddi je inženir za razvoj programske opreme pri AWS. Dela na optimizaciji delovnih obremenitev globokega učenja na grafičnih procesorjih, gradi visoko zmogljive rešitve ML za sklepanje in streženje. Pred tem je delal na gradnji mikrostoritev, ki temeljijo na AWS, za posel Amazon F3. Izven službe rad igra in spremlja šport.

- Distribucija vsebine in PR s pomočjo SEO. Okrepite se še danes.

- PlatoData.Network Vertical Generative Ai. Opolnomočite se. Dostopite tukaj.

- PlatoAiStream. Web3 Intelligence. Razširjeno znanje. Dostopite tukaj.

- PlatoESG. Ogljik, CleanTech, Energija, Okolje, sončna energija, Ravnanje z odpadki. Dostopite tukaj.

- PlatoHealth. Obveščanje o biotehnologiji in kliničnih preskušanjih. Dostopite tukaj.

- vir: https://aws.amazon.com/blogs/machine-learning/run-ml-inference-on-unplanned-and-spiky-traffic-using-amazon-sagemaker-multi-model-endpoints/

- : je

- :kje

- $GOR

- 000

- 1

- 10

- 100

- 116

- 118

- 12

- 16

- 17

- 20

- 23

- 31

- 600

- 7

- 9

- a

- O meni

- plin

- dostopna

- dostopen

- prilagoditi

- Račun

- Doseči

- čez

- aktov

- dodajte

- Dodatne

- Prednost

- Oglaševanje

- po

- AI / ML

- algoritmi

- uskladiti

- vsi

- dodeliti

- dodeljenih

- omogočajo

- omogoča

- skupaj

- že

- Prav tako

- vedno

- Amazon

- Amazon EC2

- Amazon SageMaker

- Amazon Web Services

- znesek

- an

- in

- Objava

- Še ena

- kaj

- Apache

- API

- API-ji

- uporaba

- aplikacije

- uporabna

- ustrezno

- Arhitektura

- SE

- okoli

- umetni

- AS

- dodeljena

- domnevati

- At

- avto

- Avtomatizirano

- samodejno

- Na voljo

- AWS

- nazaj

- Backend

- baza

- temeljijo

- šaržiranje

- BE

- ker

- zadaj

- Boljše

- med

- telo

- povečanje

- meje

- Pasovi

- Break

- prinašajo

- broke

- izgradnjo

- Building

- zgrajena

- poslovni

- vendar

- by

- se imenuje

- CAN

- zmožnost

- kapaciteta

- ki

- primeru

- primeri

- celica

- centralizirano

- nekatere

- izzivi

- Pregledi

- razred

- stranke

- stranke

- Koda

- prihaja

- dokončanje

- Končana

- kompleksna

- komponenta

- Sestavljeno

- Izračunajte

- računalnik

- Računalniška vizija

- računalništvo

- računalniška moč

- sočasno

- konfiguracija

- dosledno

- dosledno

- Konzole

- porabijo

- vsebujejo

- Posoda

- ozadje

- se nadaljuje

- Core

- strošek

- stroški

- Ovitki

- ustvarjajo

- ustvaril

- Ustvarjanje

- Trenutno

- po meri

- Stranke, ki so

- datum

- dan

- globoko

- globoko učenje

- privzeto

- opredeliti

- opredeljen

- Določa

- poda

- Povpraševanje

- demo

- Demokratiziranje

- odvisnosti

- Odvisno

- upodobljen

- razporedi

- razporejeni

- uvajanja

- uvajanje

- Oblikovanje

- zasnovan

- Ugotovite,

- določa

- Razvojni

- Razvoj

- naprava

- naprave

- diagram

- drugačen

- težko

- neposredno

- imenik

- razpravlja

- razpravljali

- distribucija

- Lučki delavec

- Ne

- dont

- navzdol

- prenesi

- nalaganje

- dinamično

- dinamično

- vsak

- prej

- učinkovite

- učinkovito

- brez napora

- bodisi

- drugje

- vdelava

- omogočajo

- omogoča

- zaprto

- konec koncev

- Končna točka

- Motor

- inženir

- Inženiring

- dovolj

- zagotovitev

- Podjetje

- okolje

- Napaka

- Tudi

- Primer

- izjema

- pričakovati

- pričakuje

- izkušnje

- razširiti

- Obraz

- ni uspelo

- pošteno

- družina

- Feature

- Lastnosti

- Nekaj

- file

- datoteke

- finančna

- finančne storitve

- Najdi

- prva

- Všita

- FLET

- Osredotoča

- po

- sledi

- za

- format

- Okvirni

- okviri

- pogosto

- iz

- začelje

- polno

- v celoti

- funkcionalnosti

- ustvarjajo

- dobili

- dobi

- GitHub

- Cilj

- GPU

- Grafične kartice

- odobri

- več

- ročaj

- se zgodi

- strojna oprema

- Imajo

- he

- pomoč

- pomoč

- Pomaga

- tukaj

- visoka

- več

- zelo

- njegov

- gostitelj

- gostila

- gostovanje

- HOT

- Kako

- Kako

- Vendar

- HTML

- http

- HTTPS

- Mirovanje

- if

- ponazarja

- slika

- izvajati

- Izvajanje

- uvoz

- in

- vključujejo

- vključuje

- Vključno

- Dohodni

- Povečajte

- narašča

- industrij

- Industrija

- Podatki

- Infrastruktura

- začetna

- inovativne

- inovativne tehnologije

- vhod

- nameščen

- primer

- Namesto

- zavarovanje

- integracija

- integracije

- obresti

- vmesnik

- v

- sklican

- vprašanje

- Vprašanja

- IT

- ITS

- james

- Java

- Job

- pridružil

- jpg

- samo

- jezik

- velika

- večja

- Latenca

- Zadnji

- začela

- vodi

- Vodja

- Interesenti

- UČITE

- učenje

- Naj

- Stopnja

- Knjižnica

- kot

- všeč mi je

- LIMIT

- linearna

- Seznam

- obremenitev

- nalaganje

- obremenitve

- lokalna

- Logika

- več

- ljubi

- nizka

- nižje

- stroj

- strojno učenje

- Glavne

- Večina

- Znamka

- IZDELA

- Izdelava

- upravlja

- upravitelj

- upravljanje

- več

- Trženje

- Trženje in oglaševanje

- največja

- Maj ..

- Mehanizmi

- Spomin

- metapodatki

- Metoda

- Metode

- Meritve

- mikro storitve

- morda

- minimalna

- min

- Omiliti

- ML

- način

- Model

- modeli

- Moduli

- več

- Najbolj

- motivirani

- več

- Ime

- izvirno

- potrebno

- Nimate

- potrebna

- Novo

- na novo

- Nobelova nagrada

- Noben

- Upoštevajte

- prenosnik

- zdaj

- Številka

- otopeli

- of

- ponudba

- Ponudbe

- on

- ONE

- samo

- odprite

- open source

- operacije

- Nasprotno

- optimizacije

- Optimizirajte

- optimizirana

- optimizacijo

- možnosti

- or

- Ostalo

- naši

- ven

- na prostem

- izhod

- zunaj

- več

- lastne

- vzporedno

- parametri

- del

- zlasti

- deli

- strastno

- pot

- poti

- Vzorec

- vzorci

- Plačilo

- za

- odstotek

- Izvedite

- performance

- cevi

- platforma

- platon

- Platonova podatkovna inteligenca

- PlatoData

- igranje

- plugins

- Točka

- politika

- Bazeni

- Popular

- Prispevek

- moč

- vaje

- pred

- napoved

- Napovedi

- prejšnja

- prej

- primarni

- Predhodna

- Nagrada

- problem

- Postopek

- obravnavati

- Izdelek

- produktni vodja

- proizvodnja

- Programiranje

- obljubil

- pravilno

- Lastnosti

- Dokaži

- zagotavljajo

- zagotavlja

- zagotavljanje

- Namen

- namene

- Push

- potisnilo

- Python

- pitorha

- naključno

- območje

- Preberi

- reading

- pripravljen

- v realnem času

- prejeti

- prejetih

- prejme

- prejema

- priporočeno

- glejte

- Ne glede na to

- okolica

- regije

- povezane

- ostajajo

- zamenjajte

- Skladišče

- predstavljajo

- zahteva

- zahteva

- Zahteve

- Raziskave

- viri

- Odgovor

- REST

- povzroči

- vrne

- ponovna

- Pot

- poti

- usmerjanje

- Run

- deluje

- runtime

- SaaS

- sagemaker

- Sklep SageMaker

- Enako

- Vzorec

- Shrani

- pravijo,

- Lestvica

- pomanjšana

- luske

- skaliranje

- script

- skripte

- drugi

- sekund

- glej

- videl

- SAMO

- pošljite

- višji

- služijo

- služil

- strežnik

- Strežniki

- Storitev

- Storitve

- služijo

- nastavite

- Kompleti

- nastavitev

- več

- shouldnt

- predstavitev

- pokazale

- Razstave

- Enostavno

- simulirati

- hkrati

- sam

- ednina

- Velikosti

- majhna

- delček

- So

- Software

- programske opreme kot storitve

- Razvoj programske opreme

- Software Engineer

- Rešitev

- rešitve

- nekaj

- vir

- specialist

- specifična

- Poraba

- po delih

- Šport

- sveženj

- statična

- Korak

- shranjevanje

- trgovina

- shranjeni

- naravnost

- kasneje

- taka

- predlagajte

- podpora

- Podprti

- Podpira

- Preverite

- sistemi

- Bodite

- meni

- ob

- ciljna

- ciljanje

- poučevanje

- skupina

- TechCrunch

- Tehnologije

- Tehnologija

- pove

- tensorflo

- Testiranje

- testi

- kot

- da

- O

- njihove

- Njih

- POTEM

- Tukaj.

- zato

- te

- jih

- ta

- tisti,

- tisoč

- tisoče

- 3

- skozi

- pretočnost

- čas

- krat

- do

- tudi

- orodje

- vrh

- proti

- tps

- sledenje

- Prometa

- Vlak

- usposobljeni

- usposabljanje

- Transakcije

- transformatorji

- Potovanje

- poskusite

- dva

- tip

- tipično

- pod

- osnovni

- razumeli

- razumevanje

- Universal

- URL

- uporaba

- primeru uporabe

- Rabljeni

- uporablja

- uporabo

- navadno

- Uporaben

- vrednost

- Vrednote

- spremenljivka

- različnih

- Vizija

- vs

- želeli

- je

- gledanju

- we

- web

- spletne storitve

- teža

- Kaj

- kdaj

- medtem ko

- ki

- široka

- Širok spekter

- bo

- z

- v

- delo

- delal

- delavec

- delavci

- potek dela

- delovnih tokov

- deluje

- deluje

- bi

- pisanje

- pisni

- X

- let

- Vi

- Vaša rutina za

- zefirnet