ZOO Digital zagotavlja lokalizacijo od konca do konca in medijske storitve za prilagajanje izvirne televizijske in filmske vsebine različnim jezikom, regijam in kulturam. Omogoča lažjo globalizacijo za najboljše ustvarjalce vsebin na svetu. ZOO Digital, ki mu zaupajo največja imena v zabavi, zagotavlja visokokakovostno lokalizacijo in medijske storitve v velikem obsegu, vključno s sinhronizacijo, podnaslavljanjem, skriptiranjem in skladnostjo.

Običajni poteki dela za lokalizacijo zahtevajo ročno diarizacijo zvočnika, pri čemer je zvočni tok segmentiran glede na identiteto govorca. Ta dolgotrajen postopek je treba dokončati, preden lahko vsebino sinhronizirate v drug jezik. Z ročnimi metodami lahko lokalizacija 30-minutne epizode traja od 1 do 3 ure. Z avtomatizacijo želi ZOO Digital doseči lokalizacijo v manj kot 30 minutah.

V tej objavi razpravljamo o uvajanju modelov razširljivega strojnega učenja (ML) za uporabo medijske vsebine v dnevniku Amazon SageMaker, s poudarkom na WhisperX model.

Ozadje

Vizija ZOO Digital je zagotoviti hitrejši preobrat lokalizirane vsebine. Ta cilj je ozko grlo zaradi ročno intenzivne narave vadbe, ki jo otežuje majhna delovna sila usposobljenih ljudi, ki lahko ročno lokalizirajo vsebino. ZOO Digital sodeluje z več kot 11,000 svobodnjaki in je samo v letu 600 lokaliziral več kot 2022 milijonov besed. Vendar ponudbo usposobljenih ljudi prehiteva vse večje povpraševanje po vsebini, ki zahteva avtomatizacijo za pomoč pri lokalizacijskih potekih dela.

Z namenom pospeševanja lokalizacije delovnih tokov vsebine s pomočjo strojnega učenja je ZOO Digital angažiral AWS Prototyping, investicijski program AWS za soustvarjanje delovnih obremenitev s strankami. Sodelovanje je bilo osredotočeno na zagotavljanje funkcionalne rešitve za proces lokalizacije, hkrati pa zagotavljanje praktičnega usposabljanja za razvijalce ZOO Digital na SageMaker, Amazonski prepisin Amazon prevod.

Izziv za stranke

Ko je naslov (film ali epizoda TV-serije) prepisan, je treba zvočnike dodeliti vsakemu segmentu govora, tako da jih je mogoče pravilno dodeliti glasovnim izvajalcem, ki bodo igrali like. Ta proces se imenuje diarizacija govorca. ZOO Digital se sooča z izzivom ustvarjanja dnevnika v velikem obsegu, hkrati pa je ekonomsko upravičen.

Pregled rešitev

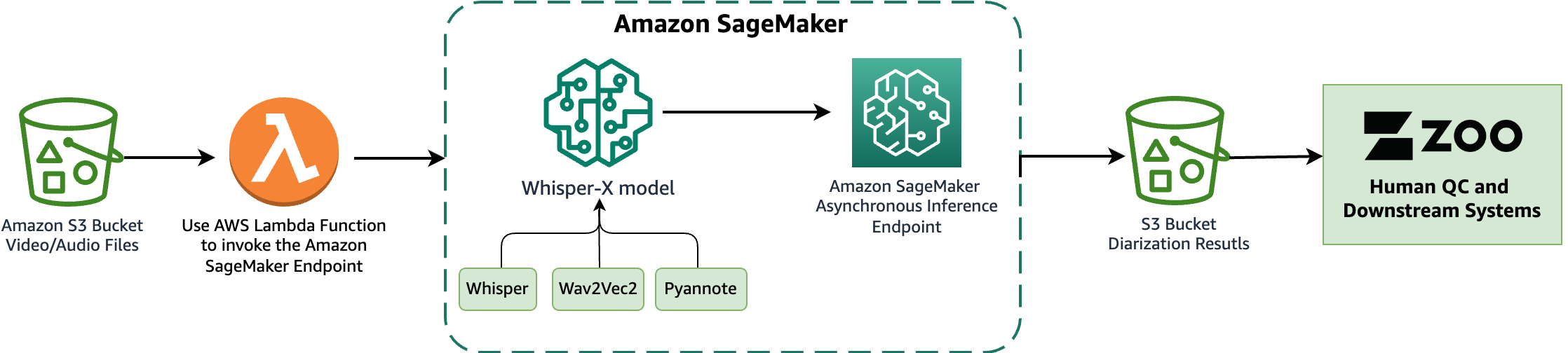

V tem prototipu smo originalne medijske datoteke shranili v določeno Preprosta storitev shranjevanja Amazon (Amazon S3) vedro. To vedro S3 je bilo konfigurirano tako, da sproži dogodek, ko so v njem zaznane nove datoteke, kar sproži dogodek AWS Lambda funkcijo. Za navodila o konfiguraciji tega sprožilca glejte vadnico Uporaba sprožilca Amazon S3 za priklic funkcije Lambda. Nato je funkcija Lambda priklicala končno točko SageMaker za sklepanje z uporabo Odjemalec Boto3 SageMaker Runtime.

O WhisperX model, ki temelji na OpenAI's Whisper, izvaja transkripcije in dnevnike za medijska sredstva. Zgrajena je na Hitrejši šepet ponovna implementacija, ki ponuja do štirikrat hitrejše prepisovanje z izboljšano poravnavo časovnih žigov na ravni besed v primerjavi s Whisperjem. Poleg tega uvaja diarizacijo zvočnikov, ki ni prisotna v originalnem modelu Whisper. WhisperX uporablja model Whisper za transkripcije, Wav2Vec2 model za izboljšanje poravnave časovnih žigov (zagotavljanje sinhronizacije transkribiranega besedila z zvočnimi časovnimi žigi) in pianote model za diarizacijo. FFmpeg se uporablja za nalaganje zvoka iz izvornega medija, ki podpira različne medijski formati. Transparentna in modularna arhitektura modela omogoča fleksibilnost, saj lahko vsako komponento modela v prihodnosti po potrebi zamenjate. Vendar pa je pomembno upoštevati, da WhisperX nima popolnih funkcij upravljanja in ni izdelek na ravni podjetja. Brez vzdrževanja in podpore morda ne bo primeren za uvedbo v proizvodnjo.

V tem sodelovanju smo uvedli in ovrednotili WhisperX na SageMakerju z uporabo končna točka asinhronega sklepanja gostiti model. Asinhrone končne točke SageMaker podpirajo velikosti nalaganja do 1 GB in vključujejo funkcije samodejnega skaliranja, ki učinkovito blažijo prometne skoke in prihranijo stroške v času izven prometnih obremenitev. Asinhrone končne točke so še posebej primerne za obdelavo velikih datotek, kot so filmi in televizijske serije v našem primeru uporabe.

Naslednji diagram prikazuje ključne elemente poskusov, ki smo jih izvedli v tem sodelovanju.

V naslednjih razdelkih se poglobimo v podrobnosti uvajanja modela WhisperX na SageMaker in ocenimo učinkovitost diarizacije.

Prenesite model in njegove komponente

WhisperX je sistem, ki vključuje več modelov za transkripcijo, prisilno poravnavo in diarizacijo. Za nemoteno delovanje SageMaker brez potrebe po pridobivanju artefaktov modela med sklepanjem je bistveno, da vnaprej prenesete vse artefakte modela. Ti artefakti se nato med iniciacijo naložijo v strežni vsebnik SageMaker. Ker ti modeli niso neposredno dostopni, ponujamo opise in vzorčno kodo iz vira WhisperX, ki nudi navodila za prenos modela in njegovih komponent.

WhisperX uporablja šest modelov:

Večino teh modelov je mogoče dobiti pri Objemni obraz z uporabo knjižnice huggingface_hub. Uporabljamo naslednje download_hf_model() funkcijo za pridobivanje teh artefaktov modela. Potreben je žeton za dostop iz Hugging Face, ustvarjen po sprejetju uporabniških pogodb za naslednje modele piannot:

import huggingface_hub

import yaml

import torchaudio

import urllib.request

import os CONTAINER_MODEL_DIR = "/opt/ml/model"

WHISPERX_MODEL = "guillaumekln/faster-whisper-large-v2"

VAD_MODEL_URL = "https://whisperx.s3.eu-west-2.amazonaws.com/model_weights/segmentation/0b5b3216d60a2d32fc086b47ea8c67589aaeb26b7e07fcbe620d6d0b83e209ea/pytorch_model.bin"

WAV2VEC2_MODEL = "WAV2VEC2_ASR_BASE_960H"

DIARIZATION_MODEL = "pyannote/speaker-diarization" def download_hf_model(model_name: str, hf_token: str, local_model_dir: str) -> str: """ Fetches the provided model from HuggingFace and returns the subdirectory it is downloaded to :param model_name: HuggingFace model name (and an optional version, appended with @[version]) :param hf_token: HuggingFace access token authorized to access the requested model :param local_model_dir: The local directory to download the model to :return: The subdirectory within local_modeL_dir that the model is downloaded to """ model_subdir = model_name.split('@')[0] huggingface_hub.snapshot_download(model_subdir, token=hf_token, local_dir=f"{local_model_dir}/{model_subdir}", local_dir_use_symlinks=False) return model_subdir

Model VAD je pridobljen iz Amazon S3, model Wav2Vec2 pa je pridobljen iz modula torchaudio.pipelines. Na podlagi naslednje kode lahko pridobimo vse artefakte modelov, vključno s tistimi iz Hugging Face, in jih shranimo v določen lokalni imenik modelov:

def fetch_models(hf_token: str, local_model_dir="./models"): """ Fetches all required models to run WhisperX locally without downloading models every time :param hf_token: A huggingface access token to download the models :param local_model_dir: The directory to download the models to """ # Fetch Faster Whisper's Large V2 model from HuggingFace download_hf_model(model_name=WHISPERX_MODEL, hf_token=hf_token, local_model_dir=local_model_dir) # Fetch WhisperX's VAD Segmentation model from S3 vad_model_dir = "whisperx/vad" if not os.path.exists(f"{local_model_dir}/{vad_model_dir}"): os.makedirs(f"{local_model_dir}/{vad_model_dir}") urllib.request.urlretrieve(VAD_MODEL_URL, f"{local_model_dir}/{vad_model_dir}/pytorch_model.bin") # Fetch the Wav2Vec2 alignment model torchaudio.pipelines.__dict__[WAV2VEC2_MODEL].get_model(dl_kwargs={"model_dir": f"{local_model_dir}/wav2vec2/"}) # Fetch pyannote's Speaker Diarization model from HuggingFace download_hf_model(model_name=DIARIZATION_MODEL, hf_token=hf_token, local_model_dir=local_model_dir) # Read in the Speaker Diarization model config to fetch models and update with their local paths with open(f"{local_model_dir}/{DIARIZATION_MODEL}/config.yaml", 'r') as file: diarization_config = yaml.safe_load(file) embedding_model = diarization_config['pipeline']['params']['embedding'] embedding_model_dir = download_hf_model(model_name=embedding_model, hf_token=hf_token, local_model_dir=local_model_dir) diarization_config['pipeline']['params']['embedding'] = f"{CONTAINER_MODEL_DIR}/{embedding_model_dir}" segmentation_model = diarization_config['pipeline']['params']['segmentation'] segmentation_model_dir = download_hf_model(model_name=segmentation_model, hf_token=hf_token, local_model_dir=local_model_dir) diarization_config['pipeline']['params']['segmentation'] = f"{CONTAINER_MODEL_DIR}/{segmentation_model_dir}/pytorch_model.bin" with open(f"{local_model_dir}/{DIARIZATION_MODEL}/config.yaml", 'w') as file: yaml.safe_dump(diarization_config, file) # Read in the Speaker Embedding model config to update it with its local path speechbrain_hyperparams_path = f"{local_model_dir}/{embedding_model_dir}/hyperparams.yaml" with open(speechbrain_hyperparams_path, 'r') as file: speechbrain_hyperparams = file.read() speechbrain_hyperparams = speechbrain_hyperparams.replace(embedding_model_dir, f"{CONTAINER_MODEL_DIR}/{embedding_model_dir}") with open(speechbrain_hyperparams_path, 'w') as file: file.write(speechbrain_hyperparams)

Izberite ustrezno posodo za poglobljeno učenje AWS za serviranje modela

Ko so artefakti modela shranjeni s prejšnjo vzorčno kodo, lahko izberete vnaprej izdelano AWS posode za globoko učenje (DLC) iz naslednjih GitHub repo. Pri izbiri slike Docker upoštevajte naslednje nastavitve: ogrodje (objemajoči se obraz), opravilo (sklep), različico Python in strojno opremo (na primer GPE). Priporočamo uporabo naslednje slike: 763104351884.dkr.ecr.[REGION].amazonaws.com/huggingface-pytorch-inference:2.0.0-transformers4.28.1-gpu-py310-cu118-ubuntu20.04 Ta slika ima vnaprej nameščene vse potrebne sistemske pakete, kot je ffmpeg. Ne pozabite zamenjati [REGION] z regijo AWS, ki jo uporabljate.

Za druge potrebne pakete Python ustvarite a requirements.txt datoteka s seznamom paketov in njihovih različic. Ti paketi bodo nameščeni, ko bo zgrajen AWS DLC. Sledijo dodatni paketi, potrebni za gostovanje modela WhisperX na SageMakerju:

Ustvarite sklepni skript za nalaganje modelov in zagon sklepanja

Nato ustvarimo po meri inference.py skript, ki opisuje, kako se model WhisperX in njegove komponente naložijo v vsebnik in kako naj poteka postopek sklepanja. Skript vsebuje dve funkciji: model_fn in transform_fn. model_fn funkcija se prikliče za nalaganje modelov z njihovih ustreznih lokacij. Pozneje se ti modeli prenesejo na transform_fn funkcijo med sklepanjem, kjer se izvajajo procesi transkripcije, poravnave in diarizacije. Sledi vzorec kode za inference.py:

import io

import json

import logging

import tempfile

import time import torch

import whisperx DEVICE = 'cuda' if torch.cuda.is_available() else 'cpu' def model_fn(model_dir: str) -> dict: """ Deserialize and return the models """ logging.info("Loading WhisperX model") model = whisperx.load_model(whisper_arch=f"{model_dir}/guillaumekln/faster-whisper-large-v2", device=DEVICE, language="en", compute_type="float16", vad_options={'model_fp': f"{model_dir}/whisperx/vad/pytorch_model.bin"}) logging.info("Loading alignment model") align_model, metadata = whisperx.load_align_model(language_code="en", device=DEVICE, model_name="WAV2VEC2_ASR_BASE_960H", model_dir=f"{model_dir}/wav2vec2") logging.info("Loading diarization model") diarization_model = whisperx.DiarizationPipeline(model_name=f"{model_dir}/pyannote/speaker-diarization/config.yaml", device=DEVICE) return { 'model': model, 'align_model': align_model, 'metadata': metadata, 'diarization_model': diarization_model } def transform_fn(model: dict, request_body: bytes, request_content_type: str, response_content_type="application/json") -> (str, str): """ Load in audio from the request, transcribe and diarize, and return JSON output """ # Start a timer so that we can log how long inference takes start_time = time.time() # Unpack the models whisperx_model = model['model'] align_model = model['align_model'] metadata = model['metadata'] diarization_model = model['diarization_model'] # Load the media file (the request_body as bytes) into a temporary file, then use WhisperX to load the audio from it logging.info("Loading audio") with io.BytesIO(request_body) as file: tfile = tempfile.NamedTemporaryFile(delete=False) tfile.write(file.read()) audio = whisperx.load_audio(tfile.name) # Run transcription logging.info("Transcribing audio") result = whisperx_model.transcribe(audio, batch_size=16) # Align the outputs for better timings logging.info("Aligning outputs") result = whisperx.align(result["segments"], align_model, metadata, audio, DEVICE, return_char_alignments=False) # Run diarization logging.info("Running diarization") diarize_segments = diarization_model(audio) result = whisperx.assign_word_speakers(diarize_segments, result) # Calculate the time it took to perform the transcription and diarization end_time = time.time() elapsed_time = end_time - start_time logging.info(f"Transcription and Diarization took {int(elapsed_time)} seconds") # Return the results to be stored in S3 return json.dumps(result), response_content_type

V imeniku modela, poleg requirements.txt datoteko, zagotoviti prisotnost inference.py v podimeniku kode. The models Imenik mora biti podoben naslednjemu:

Ustvarite arhiv modelov

Ko ustvarite modele in kodne imenike, lahko z naslednjimi ukaznimi vrsticami stisnete model v datoteko tarball (.tar.gz datoteka) in jo naložite v Amazon S3. V času pisanja, z uporabo hitrejšega šepetajočega modela Large V2, je dobljeni arhiv, ki predstavlja model SageMaker, velik 3 GB. Za več informacij glejte Vzorci gostovanja modelov v Amazon SageMaker, 2. del: Začetek uvajanja modelov v realnem času na SageMaker.

Ustvarite model SageMaker in razmestite končno točko z asinhronim napovedovalcem

Zdaj lahko ustvarite model SageMaker, konfiguracijo končne točke in asinhrono končno točko z AsyncPredictor z uporabo modela tarball, ustvarjenega v prejšnjem koraku. Za navodila glejte Ustvari končno točko asinhronega sklepanja.

Ocenite učinkovitost diarizacije

Da bi ocenili učinkovitost diarizacije modela WhisperX v različnih scenarijih, smo izbrali po tri epizode iz dveh angleških naslovov: en naslov drame, ki je sestavljen iz 30-minutnih epizod, in en naslov dokumentarca, ki je sestavljen iz 45-minutnih epizod. Uporabili smo nabor orodij za merjenje pyannote, piannote.metrics, za izračun stopnja napak pri diarizaciji (DER). Pri ocenjevanju so kot temeljna resnica služili ročno prepisani in dnevniški prepisi, ki jih je zagotovil ZOO.

DER smo definirali na naslednji način:

Skupaj za plačilo je dolžina videoposnetka temeljne resnice. FA (False Alarm) je dolžina segmentov, ki se v predvidevanjih štejejo za govor, ne pa tudi za osnovno resnico. Miss je dolžina segmentov, ki se štejejo za govor v osnovni resnici, ne pa tudi v napovedi. napaka, Imenovan tudi Zmedo, je dolžina segmentov, ki so dodeljeni različnim govorcem pri napovedi in realnosti. Vse enote so merjene v sekundah. Tipične vrednosti za DER se lahko razlikujejo glede na specifično aplikacijo, nabor podatkov in kakovost sistema za diarizacijo. Upoštevajte, da je DER lahko večji od 1.0. Nižji DER je boljši.

Da bi lahko izračunali DER za kos medija, je potrebna diarizacija temeljne resnice ter prepisani in diarizirani izhodi WhisperX. Te je treba razčleniti in rezultirati v seznamih tulp, ki vsebujejo oznako govorca, začetni čas govornega segmenta in končni čas govornega segmenta za vsak segment govora v mediju. Ni treba, da se oznake zvočnikov ujemajo med WhisperX in diarizacijami zemeljske resnice. Rezultati večinoma temeljijo na času segmentov. pyannote.metrics vzame te tuple diarizacij temeljne resnice in izhodnih diarizacij (v dokumentaciji pyannote.metrics imenovano kot reference in hipoteza) za izračun DER. Naslednja tabela povzema naše rezultate.

| Vrsta videa | DER | Prav | Miss | napaka | Lažni alarm |

| Drama | 0.738 | 44.80% | 21.80% | 33.30% | 18.70% |

| Dokumentarni | 1.29 | 94.50% | 5.30% | 0.20% | 123.40% |

| Povprečje | 0.901 | 71.40% | 13.50% | 15.10% | 61.50% |

Ti rezultati razkrivajo pomembno razliko v uspešnosti med dramskimi in dokumentarnimi naslovi, pri čemer model dosega opazno boljše rezultate (z uporabo DER kot agregatne metrike) za dramske epizode v primerjavi z naslovom dokumentarnega filma. Natančnejša analiza naslovov omogoča vpogled v možne dejavnike, ki prispevajo k tej vrzeli v uspešnosti. Eden ključnih dejavnikov bi lahko bila pogosta prisotnost glasbe v ozadju, ki se prekriva z govorom v naslovu dokumentarca. Čeprav predhodna obdelava medijev za izboljšanje natančnosti diarizacije, kot je odstranjevanje hrupa v ozadju za izolacijo govora, presega obseg tega prototipa, odpira poti za prihodnje delo, ki bi lahko izboljšalo delovanje WhisperX.

zaključek

V tej objavi smo raziskali sodelovanje partnerstva med AWS in ZOO Digital, pri čemer smo uporabili tehnike strojnega učenja s SageMakerjem in modelom WhisperX za izboljšanje delovnega toka diarizacije. Ekipa AWS je imela ključno vlogo pri pomoči ZOO pri izdelavi prototipov, ocenjevanju in razumevanju učinkovite uvedbe modelov ML po meri, posebej zasnovanih za diarizacijo. To je vključevalo vključitev samodejnega skaliranja za razširljivost s SageMakerjem.

Izkoriščanje umetne inteligence za diarizacijo bo vodilo do znatnih prihrankov pri stroških in času pri ustvarjanju lokalizirane vsebine za ZOO. S pomočjo prepisovalcem pri hitrem in natančnem ustvarjanju in prepoznavanju govorcev ta tehnologija obravnava tradicionalno dolgotrajno nalogo, ki je nagnjena k napakam. Običajni postopek pogosto vključuje več prehodov skozi videoposnetek in dodatne korake za nadzor kakovosti za zmanjšanje napak. Sprejetje AI za diarizacijo omogoča bolj ciljno usmerjen in učinkovit pristop, s čimer se poveča produktivnost v krajšem časovnem okviru.

Opisali smo ključne korake za uvedbo modela WhisperX na asinhroni končni točki SageMaker in vas spodbujamo, da poskusite sami z uporabo priložene kode. Za nadaljnji vpogled v storitve in tehnologijo ZOO Digital obiščite Uradna stran ZOO Digital. Za podrobnosti o uvajanju modela OpenAI Whisper na SageMaker in različnih možnostih sklepanja glejte Gostite model Whisper na Amazon SageMaker: raziskovanje možnosti sklepanja. Delite svoje misli v komentarjih.

O avtorjih

Ying Hou, dr, je arhitekt strojnega učenja prototipov pri AWS. Njena primarna področja zanimanja zajemajo globoko učenje s poudarkom na GenAI, računalniškem vidu, NLP-ju in napovedovanju podatkov časovnih vrst. V prostem času rada preživlja kakovostne trenutke s svojo družino, se potopi v romane in pohodi po nacionalnih parkih Združenega kraljestva.

Ying Hou, dr, je arhitekt strojnega učenja prototipov pri AWS. Njena primarna področja zanimanja zajemajo globoko učenje s poudarkom na GenAI, računalniškem vidu, NLP-ju in napovedovanju podatkov časovnih vrst. V prostem času rada preživlja kakovostne trenutke s svojo družino, se potopi v romane in pohodi po nacionalnih parkih Združenega kraljestva.

Ethan Cumberland je raziskovalni inženir umetne inteligence pri ZOO Digital, kjer se ukvarja z uporabo umetne inteligence in strojnega učenja kot podpornih tehnologij za izboljšanje potekov dela pri govoru, jeziku in lokalizaciji. Ima izkušnje s programskim inženiringom in raziskavami na področju varnosti in nadzora, s poudarkom na pridobivanju strukturiranih informacij iz spleta in uporabi odprtokodnih modelov ML za analizo in obogatitev zbranih podatkov.

Ethan Cumberland je raziskovalni inženir umetne inteligence pri ZOO Digital, kjer se ukvarja z uporabo umetne inteligence in strojnega učenja kot podpornih tehnologij za izboljšanje potekov dela pri govoru, jeziku in lokalizaciji. Ima izkušnje s programskim inženiringom in raziskavami na področju varnosti in nadzora, s poudarkom na pridobivanju strukturiranih informacij iz spleta in uporabi odprtokodnih modelov ML za analizo in obogatitev zbranih podatkov.

Gaurav Kaila vodi skupino za izdelavo prototipov AWS za Združeno kraljestvo in Irsko. Njegova ekipa sodeluje s strankami v različnih panogah, da zasnuje in sorazvija poslovne kritične delovne obremenitve s pooblastilom za pospešitev sprejemanja storitev AWS.

Gaurav Kaila vodi skupino za izdelavo prototipov AWS za Združeno kraljestvo in Irsko. Njegova ekipa sodeluje s strankami v različnih panogah, da zasnuje in sorazvija poslovne kritične delovne obremenitve s pooblastilom za pospešitev sprejemanja storitev AWS.

- Distribucija vsebine in PR s pomočjo SEO. Okrepite se še danes.

- PlatoData.Network Vertical Generative Ai. Opolnomočite se. Dostopite tukaj.

- PlatoAiStream. Web3 Intelligence. Razširjeno znanje. Dostopite tukaj.

- PlatoESG. Ogljik, CleanTech, Energija, Okolje, sončna energija, Ravnanje z odpadki. Dostopite tukaj.

- PlatoHealth. Obveščanje o biotehnologiji in kliničnih preskušanjih. Dostopite tukaj.

- vir: https://aws.amazon.com/blogs/machine-learning/streamline-diarization-using-ai-as-an-assistive-technology-zoo-digitals-story/

- :ima

- : je

- :ne

- :kje

- $GOR

- 000

- 1

- 10

- 100

- 11

- 140

- 2022

- 220

- 28

- 30

- 350

- 600

- 7

- 8

- a

- Sposobna

- pospeši

- sprejemanje

- dostop

- dostopen

- natančnost

- Doseči

- doseganju

- čez

- prilagodijo

- Dodatne

- Poleg tega

- naslovi

- Sprejetje

- po

- agregat

- Sporazumi

- AI

- ai raziskave

- Cilj

- Cilje

- Alarm

- uskladiti

- poravnava

- poravnava

- vsi

- omogoča

- sam

- skupaj

- Prav tako

- Čeprav

- Amazon

- Amazon SageMaker

- Amazon Web Services

- an

- Analiziranje

- Analiza

- in

- Še ena

- uporaba

- pristop

- primerno

- Arhitektura

- SE

- območja

- Izvajalci

- AS

- oceniti

- Sredstva

- dodeljena

- pomoč

- pomoč

- At

- audio

- pooblaščeni

- avto

- Avtomatizacija

- poti

- AWS

- ozadje

- temeljijo

- BE

- ker

- bilo

- pred

- počutje

- BEST

- Boljše

- med

- Poleg

- največji

- BIN

- tako

- zgrajena

- poslovni

- vendar

- by

- izračun

- se imenuje

- CAN

- primeru

- izziv

- znaki

- Izberite

- bližje

- Koda

- sodelovanje

- sodelovanje

- komentarji

- v primerjavi z letom

- Končana

- skladnost

- komponenta

- deli

- sestavljen

- računalnik

- Računalniška vizija

- poteka

- konfigurirano

- konfiguriranje

- Razmislite

- šteje

- Sestavljeno

- Posoda

- Vsebuje

- vsebina

- ustvarjalci vsebin

- prispeva

- nadzor

- konvencionalne

- Core

- pravilno

- strošek

- stroški

- bi

- ustvarjajo

- ustvaril

- Ustvarjanje

- Ustvarjalci

- kritično

- kulture

- po meri

- Stranke, ki so

- datum

- globoko

- globoko učenje

- opredeljen

- dostavo

- daje

- potopite

- Povpraševanje

- Odvisno

- razporedi

- razporejeni

- uvajanja

- uvajanje

- zasnovan

- Podrobnosti

- Zaznali

- Razvijalci

- naprava

- diagram

- DICT

- Razlika

- drugačen

- digitalni

- Digitali

- neposredno

- imeniki

- imenik

- razpravlja

- razne

- Lučki delavec

- Dokumentarec

- Dokumentacija

- domena

- dont

- prenesi

- nalaganje

- Drama

- poimenovan

- med

- vsak

- lažje

- Učinkovito

- učinkovite

- učinkovito

- elementi

- ostalo

- vdelava

- zaposlovanja

- omogoča

- obsegajo

- spodbujanje

- konec

- konec koncev

- Končna točka

- , ki se ukvarjajo

- sodelovanje

- inženir

- Inženiring

- Angleščina

- okrepi

- bogatenje

- zagotovitev

- zagotoviti

- na ravni podjetja

- Zabava

- epizoda

- Napaka

- napake

- bistvena

- oceniti

- ocenili

- ocenjevanje

- Ocena

- Event

- Tudi vsak

- Primer

- Vaja

- Poskusi

- Raziskano

- Raziskovati

- Obraz

- obrazi

- Faktor

- dejavniki

- false

- družina

- hitreje

- Lastnosti

- občutek

- Preneseno

- file

- datoteke

- prilagodljivost

- Osredotočite

- osredotočena

- osredotoča

- po

- sledi

- za

- prisiljena

- štiri

- Okvirni

- brezplačno

- pogosto

- iz

- polno

- funkcija

- funkcionalno

- funkcije

- nadalje

- Prihodnost

- vrzel

- genai

- ustvarila

- ustvarjajo

- pridobivanje

- GitHub

- globalizacija

- Cilj

- GPU

- Igrišče

- hands-on

- strojna oprema

- he

- jo

- visoka kvaliteta

- njegov

- gostitelj

- gostovanje

- URE

- Kako

- Vendar

- HTML

- http

- HTTPS

- HuggingFace

- identifikacijo

- identiteta

- if

- ponazarja

- slika

- uvoz

- izboljšanje

- izboljšalo

- in

- vključeno

- vključuje

- Vključno

- vključi

- vključujoč

- narašča

- industrij

- Podatki

- Začetek

- vpogledi

- nameščen

- Navodila

- obresti

- v

- Predstavlja

- naložbe

- sklican

- vključuje

- Irska

- IT

- ITS

- jpg

- json

- Ključne

- ključni dejavnik

- label

- Oznake

- jezik

- jeziki

- velika

- večja

- vodi

- Interesenti

- učenje

- dolžina

- vzvod

- Knjižnica

- linije

- Seznam

- seznami

- obremenitev

- nalaganje

- lokalna

- Lokalizacija

- lokalno

- Lokacije

- prijavi

- sečnja

- Long

- nižje

- stroj

- strojno učenje

- vzdrževanje

- IZDELA

- upravljanje

- Mandat

- Navodilo

- ročno

- Stave

- Maj ..

- mediji

- metapodatki

- Metode

- meritev

- Meritve

- milijonov

- zmanjšajo

- Minute

- Omiliti

- ML

- Model

- modeli

- Modularna

- Moduli

- Trenutki

- več

- večinoma

- Film

- filmi

- več

- Glasba

- morajo

- Ime

- Imena

- nacionalni

- Narava

- potrebno

- Nimate

- potrebna

- Novo

- nlp

- hrup

- predvsem

- Upoštevajte

- pridobljeni

- of

- ponudba

- ponujanje

- Uradni

- pogosto

- on

- ONE

- open source

- OpenAI

- Odpre

- Delovanje

- možnosti

- or

- izvirno

- OS

- Ostalo

- naši

- ven

- oris

- opisano

- izhod

- izhodi

- več

- pakete

- del

- zlasti

- Partnerstvo

- opravil

- vozovnice

- pot

- poti

- vzorci

- ljudje

- Izvedite

- performance

- opravljeno

- opravlja

- kos

- plinovod

- ključno

- platon

- Platonova podatkovna inteligenca

- PlatoData

- Predvajaj

- igral

- policija

- Prispevek

- potencial

- potencialno

- pred

- Ravno

- napoved

- Napovedi

- Prisotnost

- predstaviti

- prejšnja

- primarni

- Postopek

- Procesi

- obravnavati

- Izdelek

- proizvodnja

- produktivnost

- Program

- Prototip

- prototipov

- zagotavljajo

- če

- zagotavlja

- zagotavljanje

- Python

- kakovost

- R

- Oceniti

- Preberi

- pravo

- v realnem času

- Priporočamo

- glejte

- besedilu

- okolica

- regije

- ne pozabite

- odstranjevanje

- zamenjajte

- predstavlja

- zahteva

- zahteva

- obvezna

- Zahteve

- Raziskave

- tisti,

- povzroči

- rezultat

- Rezultati

- vrnitev

- vrne

- razkrivajo

- vloga

- Run

- tek

- runtime

- s

- sagemaker

- Vzorec

- Shrani

- shranjena

- Prihranki

- Prilagodljivost

- razširljive

- Lestvica

- skaliranje

- scenariji

- Obseg

- script

- sekund

- oddelki

- varnost

- Segment

- segmentacija

- segmentih

- izbran

- izbiranje

- Serija

- služil

- Storitve

- služijo

- nastavitve

- Delite s prijatelji, znanci, družino in partnerji :-)

- je

- shouldnt

- pomemben

- Enostavno

- SIX

- Velikosti

- velikosti

- spreten

- majhna

- nemoteno

- So

- Software

- inženiring programske opreme

- Rešitev

- vir

- Zvočniki

- zvočniki

- specifična

- posebej

- določeno

- govor

- Poraba

- konice

- Začetek

- začel

- Korak

- Koraki

- shranjevanje

- shranjeni

- Zgodba

- tok

- racionalizirati

- strukturirano

- Kasneje

- precejšen

- taka

- primerna

- dobavi

- podpora

- Podpora

- zamenjal

- hitro

- Sinhronizacija

- sistem

- miza

- Bodite

- meni

- ciljno

- Naloga

- skupina

- tehnike

- Tehnologije

- Tehnologija

- začasna

- besedilo

- kot

- da

- O

- Prihodnost

- UK

- njihove

- Njih

- POTEM

- s tem

- te

- jih

- ta

- tisti,

- 3

- skozi

- čas

- Časovne serije

- zamudno

- časovni okvir

- krat

- Časovni žig

- časi

- Naslov

- naslove

- do

- žeton

- vzel

- Orodje

- baklo

- tradicionalno

- Prometa

- usposabljanje

- pregleden

- sprožijo

- sproži

- zaupa

- Resnica

- poskusite

- Navodila

- tv

- dva

- tipičen

- Uk

- pod

- Med 30

- razumevanje

- enote

- Nadgradnja

- naprej

- uporaba

- primeru uporabe

- Rabljeni

- uporabnik

- uporablja

- uporabo

- uporablja

- izkorišča

- Vrednote

- različnih

- razlikujejo

- različica

- različice

- preživetja

- Video

- Vizija

- obisk

- Voice

- W

- je

- we

- web

- spletne storitve

- Dobro

- kdaj

- medtem

- Šepetanje

- bo

- z

- v

- brez

- besede

- delo

- potek dela

- delovnih tokov

- Delovna sila

- deluje

- svetu

- pisanje

- yaml

- Vi

- Vaša rutina za

- sami

- zefirnet

- ZOO