อเมซอน อีลาสติก คอมพิวท์ คลาวด์ (อเมซอน อีซี2) อินสแตนซ์ G5 เป็นอินสแตนซ์แรกและอินสแตนซ์เดียวในคลาวด์ที่มีฟีเจอร์ NVIDIA A10G Tensor Core GPU ซึ่งคุณสามารถใช้สำหรับกรณีการใช้งานที่เน้นกราฟิกและการเรียนรู้ของเครื่อง (ML) ได้หลากหลาย ด้วยอินสแตนซ์ G5 ลูกค้า ML จะได้รับประสิทธิภาพสูงและโครงสร้างพื้นฐานที่คุ้มค่าในการฝึกอบรมและปรับใช้โมเดลที่ใหญ่และซับซ้อนยิ่งขึ้นสำหรับการประมวลผลภาษาธรรมชาติ (NLP) คอมพิวเตอร์วิทัศน์ (CV) และกรณีการใช้งานเครื่องมือแนะนำ

จุดประสงค์ของโพสต์นี้คือเพื่อแสดงประโยชน์ด้านประสิทธิภาพของอินสแตนซ์ G5 สำหรับปริมาณงานการอนุมาน ML ขนาดใหญ่ เราทำสิ่งนี้โดยเปรียบเทียบประสิทธิภาพด้านราคา (วัดจากการอนุมาน $ ต่อการอนุมาน) สำหรับโมเดล NLP และ CV กับอินสแตนซ์ G4dn เราเริ่มต้นด้วยการอธิบายแนวทางการเปรียบเทียบของเรา จากนั้นจึงนำเสนอกราฟปริมาณงานเทียบกับเวลาแฝงในขนาดแบทช์และความแม่นยำของประเภทข้อมูล เมื่อเปรียบเทียบกับอินสแตนซ์ G4dn เราพบว่าอินสแตนซ์ G5 ให้การอนุมานราคาต่อล้านที่ต่ำลงอย่างต่อเนื่องสำหรับทั้งโหมดความแม่นยำเต็มรูปแบบและความแม่นยำแบบผสมสำหรับรุ่น NLP และ CV ในขณะที่บรรลุปริมาณงานที่สูงขึ้นและเวลาแฝงที่ต่ำกว่า

แนวทางการเปรียบเทียบ

ในการพัฒนาการศึกษาประสิทธิภาพราคาระหว่าง G5 และ G4dn เราจำเป็นต้องวัดปริมาณงาน เวลาแฝง และราคาต่อการอนุมานหนึ่งล้านครั้งในฐานะฟังก์ชันของขนาดแบทช์ นอกจากนี้เรายังศึกษาผลกระทบของความแม่นยำเต็มรูปแบบกับความแม่นยำแบบผสม ทั้งกราฟแบบจำลองและอินพุตถูกโหลดลงใน CUDA ก่อนการอนุมาน

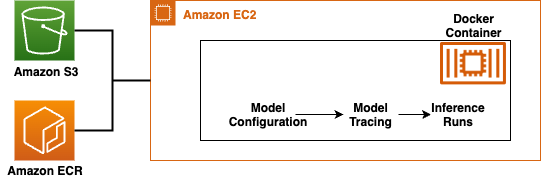

ดังที่แสดงในไดอะแกรมสถาปัตยกรรมต่อไปนี้ ขั้นแรกเราจะสร้างอิมเมจคอนเทนเนอร์พื้นฐานตามลำดับด้วย CUDA สำหรับอินสแตนซ์ EC2 พื้นฐาน (G4dn, G5) ในการสร้างอิมเมจคอนเทนเนอร์พื้นฐาน เราเริ่มต้นด้วย คอนเทนเนอร์การเรียนรู้เชิงลึกของ AWSซึ่งใช้อิมเมจ Docker ที่บรรจุไว้ล่วงหน้าเพื่อปรับใช้สภาพแวดล้อมการเรียนรู้เชิงลึกในไม่กี่นาที รูปภาพประกอบด้วยไลบรารีและเครื่องมือ PyTorch การเรียนรู้เชิงลึกที่จำเป็น คุณสามารถเพิ่มไลบรารีและเครื่องมือของคุณเองบนอิมเมจเหล่านี้เพื่อการควบคุมการตรวจสอบ การปฏิบัติตามข้อกำหนด และการประมวลผลข้อมูลในระดับที่สูงขึ้น

จากนั้นเราจะสร้างอิมเมจคอนเทนเนอร์เฉพาะโมเดลที่สรุปคอนฟิกูเรชันโมเดล การติดตามโมเดล และโค้ดที่เกี่ยวข้องเพื่อรันการส่งต่อ อิมเมจคอนเทนเนอร์ทั้งหมดถูกโหลดลงใน อเมซอน ECR เพื่อให้สามารถปรับขนาดแนวนอนของแบบจำลองเหล่านี้สำหรับการกำหนดค่าแบบจำลองต่างๆ เราใช้ บริการจัดเก็บข้อมูลอย่างง่ายของ Amazon (Amazon S3) เป็นที่เก็บข้อมูลทั่วไปสำหรับดาวน์โหลดการกำหนดค่าและอัปโหลดผลการวัดประสิทธิภาพสำหรับการสรุป คุณสามารถใช้สถาปัตยกรรมนี้เพื่อสร้างและทำซ้ำผลการวัดประสิทธิภาพและปรับเทียบใหม่เพื่อเปรียบเทียบประเภทโมเดลต่างๆ (เช่น โมเดล Hugging Face, โมเดล PyTorch, โมเดลที่กำหนดเองอื่นๆ) ในประเภทอินสแตนซ์ EC2 (CPU, GPU, Inf1)

ด้วยการตั้งค่าการทดสอบนี้ เป้าหมายของเราคือการศึกษาเวลาแฝงเป็นฟังก์ชันของปริมาณงาน เส้นโค้งนี้มีความสำคัญสำหรับการออกแบบแอปพลิเคชันเพื่อให้ได้โครงสร้างพื้นฐานที่เหมาะสมกับต้นทุนสำหรับแอปพลิเคชันเป้าหมาย เพื่อให้บรรลุสิ่งนี้ เราจำลองการโหลดที่แตกต่างกันโดยจัดคิวการสืบค้นจากหลายเธรด จากนั้นจึงวัดเวลาไปกลับสำหรับคำขอที่เสร็จสมบูรณ์แต่ละรายการ ปริมาณงานวัดตามจำนวนคำขอที่เสร็จสมบูรณ์ต่อหน่วยเวลานาฬิกา นอกจากนี้ คุณยังสามารถเปลี่ยนขนาดแบทช์และตัวแปรอื่นๆ เช่น ความยาวลำดับและความแม่นยำสูงสุดเทียบกับความแม่นยำเพียงครึ่งเดียว เพื่อกวาดพื้นที่การออกแบบอย่างครอบคลุมเพื่อให้ได้ตัวชี้วัดประสิทธิภาพที่บ่งชี้ ในการศึกษาของเรา ด้วยการวัดขนาดแบทช์และการสืบค้นจากไคลเอนต์แบบมัลติเธรด ผ่านการวัดพารามิเตอร์ของขนาดแบทช์และการสืบค้นข้อมูลแบบมัลติเธรด กราฟปริมาณงานเทียบกับเวลาแฝงจะถูกกำหนด ทุกคำขอสามารถแบทช์ได้เพื่อให้แน่ใจว่ามีการใช้ตัวเร่งความเร็วอย่างเต็มที่ โดยเฉพาะอย่างยิ่งสำหรับคำขอขนาดเล็กที่อาจใช้โหนดคอมพิวท์ได้ไม่เต็มที่ คุณยังสามารถใช้การตั้งค่านี้เพื่อระบุขนาดแบทช์ฝั่งไคลเอ็นต์เพื่อประสิทธิภาพสูงสุด

โดยสรุป เราสามารถแสดงปัญหานี้ทางคณิตศาสตร์เป็น: (ทรูพุต เวลาแฝง) = ฟังก์ชันของ (ขนาดแบทช์ จำนวนเธรด ความแม่นยำ)

ซึ่งหมายความว่า เมื่อพิจารณาจากพื้นที่ที่ละเอียดถี่ถ้วนแล้ว จำนวนการทดลองอาจมีมาก โชคดีที่แต่ละการทดสอบสามารถเรียกใช้ได้อย่างอิสระ เราแนะนำให้ใช้ ชุด AWS เพื่อทำการเปรียบเทียบตามมาตราส่วนแนวนอนในเวลาที่บีบอัดโดยไม่เพิ่มต้นทุนการเปรียบเทียบเมื่อเปรียบเทียบกับวิธีการทดสอบเชิงเส้นตรง รหัสสำหรับการจำลองผลลัพธ์มีอยู่ใน พื้นที่เก็บข้อมูล GitHub ที่เตรียมไว้สำหรับ AWS Re:Invent 2021 ที่เก็บครอบคลุมเพื่อดำเนินการเปรียบเทียบบนตัวเร่งความเร็วต่างๆ คุณสามารถอ้างถึงด้าน GPU ของโค้ดเพื่อสร้างคอนเทนเนอร์ (Dockerfile-gpu) แล้วอ้างอิงรหัสด้านใน Container-Root สำหรับตัวอย่างเฉพาะสำหรับ BERT และ ResNet50

เราใช้แนวทางก่อนหน้านี้เพื่อพัฒนาการศึกษาประสิทธิภาพในแบบจำลองสองประเภท: Bert-base-uncased (110 ล้านพารามิเตอร์, NLP) และ ResNet50 (25.6 ล้านพารามิเตอร์, CV) ตารางต่อไปนี้สรุปรายละเอียดโมเดล

| ประเภทรุ่น | รุ่น | รายละเอียด |

| NLP | twmkn9/bert-base-uncased-squad2 | พารามิเตอร์ 110 ล้าน ความยาวของลำดับ = 128 |

| CV | เรสเน็ต50 | 25.6 ล้านพารามิเตอร์ |

นอกจากนี้ เพื่อเปรียบเทียบระหว่างประเภทข้อมูล (เต็ม ครึ่งความแม่นยำ) เราใช้ torch.cuda.ampซึ่งให้วิธีการที่สะดวกในการจัดการกับความแม่นยำแบบผสมที่การดำเนินการบางอย่างใช้ torch.float32 (ลอย) ชนิดข้อมูลและการใช้งานอื่น ๆ torch.float16 (ครึ่ง). ตัวอย่างเช่น ตัวดำเนินการ เช่น เลเยอร์เชิงเส้นและการโน้มน้าวใจจะเร็วกว่ามากเมื่อใช้ float16 ในขณะที่ตัวดำเนินการอื่นๆ เช่น การลดลงมักต้องการช่วงไดนามิกของ float32 ความแม่นยำแบบผสมอัตโนมัติพยายามจับคู่ผู้ให้บริการแต่ละรายกับประเภทข้อมูลที่เหมาะสมเพื่อปรับรันไทม์ของเครือข่ายและปริมาณหน่วยความจำให้เหมาะสม

ผลการเปรียบเทียบ

เพื่อการเปรียบเทียบที่ยุติธรรม เราเลือก G4dn.4xlarge และ G5.4xใหญ่ อินสแตนซ์ที่มีคุณสมบัติคล้ายคลึงกัน ดังที่แสดงในตารางต่อไปนี้

| ตัวอย่าง | GPUs | หน่วยความจำ GPU (GiB) | vCPU | หน่วยความจำ (GiB) | พื้นที่จัดเก็บอินสแตนซ์ (GB) | ประสิทธิภาพของเครือข่าย (Gbps) | แบนด์วิดท์ EBS (Gbps) | ราคา Linux On-Demand (us-east-1) |

| G5.4xใหญ่ | 1 | 24 | 16 | 64 | 1x600 NVMe SSD | ถึง 25 | 8 | $ 1.204 ชั่วโมง / |

| G4dn.4xlarge | 1 | 16 | 16 | 64 | 1x225 NVMe SSD | ถึง 25 | 4.75 | $ 1.624 ชั่วโมง / |

ในส่วนต่อไปนี้ เราเปรียบเทียบประสิทธิภาพการอนุมาน ML ของรุ่น BERT และ RESNET50 กับวิธีการกวาดกริดสำหรับขนาดแบทช์เฉพาะ (32, 16, 8, 4, 1) และความแม่นยำของประเภทข้อมูล (ความแม่นยำเต็มและครึ่งหนึ่ง) เพื่อให้ได้ปริมาณงาน เทียบกับเส้นโค้งเวลาแฝง นอกจากนี้ เรายังตรวจสอบผลกระทบของปริมาณงานเทียบกับขนาดแบทช์สำหรับความแม่นยำเต็มและครึ่งหนึ่ง สุดท้ายนี้ เราวัดต้นทุนต่อการอนุมานหนึ่งล้านรายการตามฟังก์ชันของขนาดแบทช์ ผลลัพธ์ที่รวมไว้ในการทดลองเหล่านี้จะสรุปได้ในภายหลังในโพสต์นี้

ปริมาณงานเทียบกับเวลาแฝง

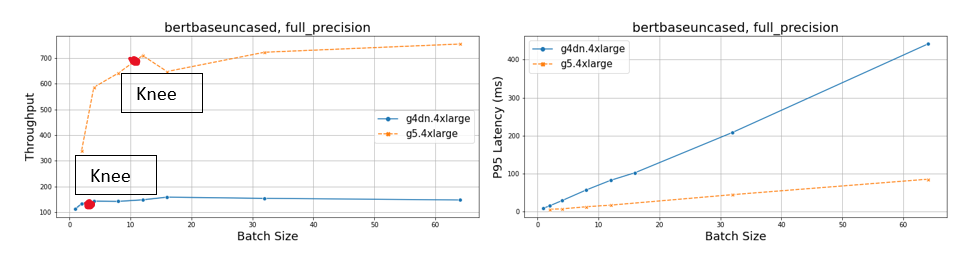

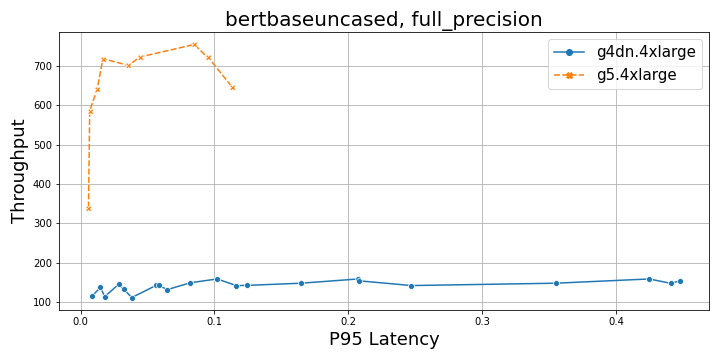

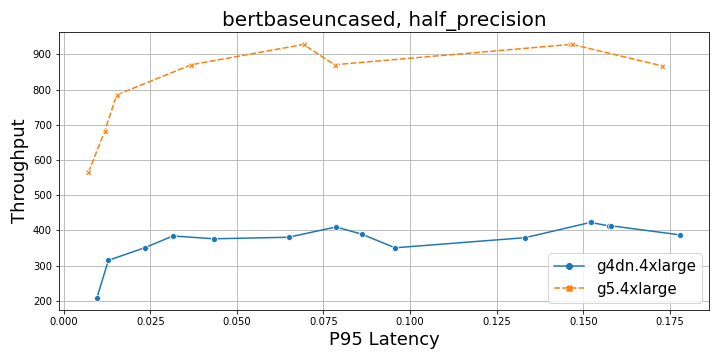

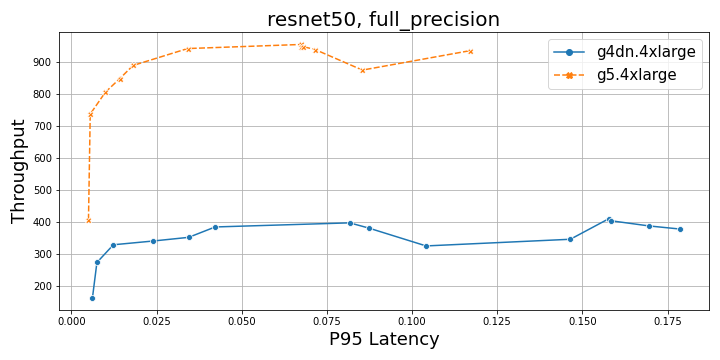

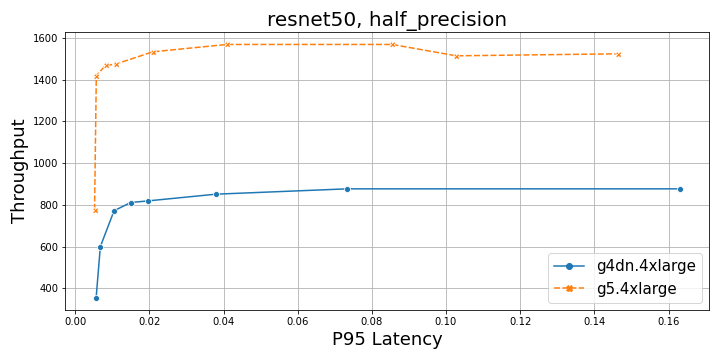

ตัวเลขต่อไปนี้เปรียบเทียบอินสแตนซ์ G4dn และ G5 สำหรับปริมาณงาน NLP และ CV ที่ความแม่นยำเต็มและครึ่งหนึ่ง เมื่อเปรียบเทียบกับอินสแตนซ์ G4dn อินสแตนซ์ G5 ให้ปริมาณงานสูงกว่าประมาณห้าเท่า (ความแม่นยำสูงสุด) และสูงกว่าประมาณ 2.5 เท่า (ความแม่นยำครึ่งหนึ่ง) สำหรับรุ่นพื้นฐาน BERT และสูงกว่าประมาณ 2-2.5 เท่าสำหรับรุ่น ResNet50 โดยรวมแล้ว G5 เป็นตัวเลือกที่ต้องการ โดยเพิ่มขนาดแบทช์สำหรับทั้งสองรุ่นสำหรับทั้งความแม่นยำเต็มรูปแบบและแบบผสมจากมุมมองของประสิทธิภาพ

กราฟต่อไปนี้เปรียบเทียบปริมาณงานและเวลาแฝง P95 ที่ความแม่นยำสูงสุดและครึ่งเดียวสำหรับ BERT

|

|

กราฟต่อไปนี้เปรียบเทียบปริมาณงานและเวลาแฝง P95 ที่ความแม่นยำสูงสุดและครึ่งเดียวสำหรับ ResNet50

|

|

ปริมาณงานและเวลาแฝงเทียบกับขนาดแบทช์

กราฟต่อไปนี้แสดงปริมาณงานเป็นฟังก์ชันของขนาดแบทช์ ที่ขนาดแบทช์ต่ำ ตัวเร่งความเร็วจะไม่ทำงานอย่างเต็มประสิทธิภาพ และเมื่อขนาดแบทช์เพิ่มขึ้น ปริมาณงานจะเพิ่มขึ้นตามต้นทุนของเวลาแฝง เส้นกราฟปริมาณงานจะกำหนดเป็นค่าสูงสุดซึ่งเป็นฟังก์ชันของประสิทธิภาพของตัวเร่งความเร็ว เส้นโค้งมีคุณสมบัติที่แตกต่างกันสองประการ: ส่วนที่เพิ่มขึ้นและส่วนที่ไม่มีซีมโทติคแบบแบน สำหรับรุ่นที่กำหนด เครื่องเร่งประสิทธิภาพ (G5) สามารถขยายส่วนที่เพิ่มขึ้นเป็นขนาดแบทช์ที่สูงกว่า G4dn และเส้นกำกับที่ปริมาณงานที่สูงขึ้น นอกจากนี้ยังมีการแลกเปลี่ยนเชิงเส้นระหว่างเวลาแฝงและขนาดแบทช์ ดังนั้น หากแอปพลิเคชันถูกผูกไว้กับเวลาแฝง เราสามารถใช้เวลาแฝง P95 กับขนาดแบทช์เพื่อกำหนดขนาดแบทช์ที่เหมาะสมที่สุด อย่างไรก็ตาม หากวัตถุประสงค์คือเพื่อเพิ่มปริมาณงานให้สูงสุดที่เวลาแฝงต่ำสุด จะเป็นการดีกว่าที่จะเลือกขนาดแบทช์ที่สอดคล้องกับ "เข่า" ระหว่างส่วนที่ยกขึ้นและส่วนที่ไม่มีอาการ เนื่องจากขนาดชุดงานที่เพิ่มขึ้นอีกจะส่งผลให้ปริมาณงานเท่ากันที่ เวลาแฝงที่แย่ลง เพื่อให้ได้อัตราส่วนราคาต่อประสิทธิภาพที่ดีที่สุด โดยกำหนดเป้าหมายปริมาณงานที่สูงขึ้นในเวลาแฝงที่ต่ำที่สุด คุณควรปรับขนาดที่เหมาะสมที่สุดในแนวนอนนี้ผ่านเซิร์ฟเวอร์การอนุมานหลายเซิร์ฟเวอร์ แทนที่จะเพิ่มขนาดแบทช์

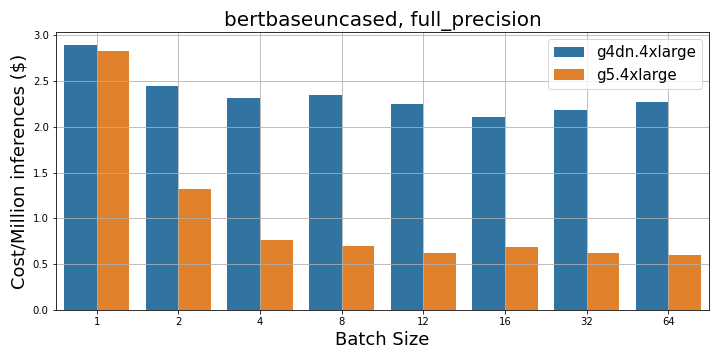

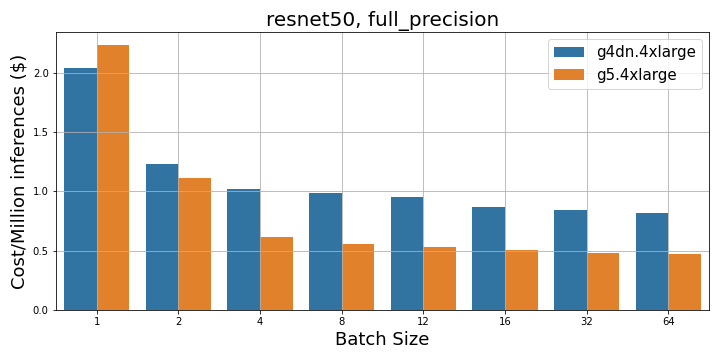

ต้นทุนเทียบกับขนาดแบทช์

ในส่วนนี้ เรานำเสนอผลลัพธ์เปรียบเทียบของต้นทุนการอนุมาน ($ ต่อการอนุมานหนึ่งล้านเหรียญ) กับขนาดแบทช์ จากรูปต่อไปนี้ เราสามารถสังเกตได้อย่างชัดเจนว่าค่าใช้จ่าย (วัดจากการอนุมาน $ ต่อล้าน) นั้นต่ำกว่าอย่างสม่ำเสมอด้วย G5 เทียบกับ G4dn ทั้ง (เต็มและครึ่งความแม่นยำ)

|

|

ตารางต่อไปนี้สรุปการเปรียบเทียบปริมาณงาน เวลาแฝง และราคา ($ ต่อการอนุมานหนึ่งล้านเหรียญ) สำหรับรุ่น BERT และ RESNET50 ในโหมดความแม่นยำทั้งสองสำหรับขนาดแบทช์เฉพาะ แม้จะมีต้นทุนต่ออินสแตนซ์สูงขึ้น G5 ก็ยังมีประสิทธิภาพเหนือกว่า G4dn อย่างสม่ำเสมอในทุกด้านของเวลาแฝงในการอนุมาน ปริมาณงาน และต้นทุน (การอนุมาน $ ต่อการอนุมาน) สำหรับทุกขนาดแบทช์ การรวมตัววัดต่างๆ เข้าด้วยกันเป็นต้นทุน ($ ต่อการอนุมานหนึ่งล้านเหรียญ) โมเดล BERT (ขนาดแบทช์ 32 ความแม่นยำเต็ม) กับ G5 นั้นดีกว่า G3.7dn 4 เท่า และด้วยรุ่น ResNet50 (ขนาดแบทช์ 32 ความแม่นยำเต็ม) เท่ากับ 1.6 ดีกว่า G4dn หลายเท่า

| รุ่น | ขนาดแบทช์ | ความแม่นยำ |

ทางเข้า (ขนาดแบทช์ X คำขอ/วินาที) |

เวลาแฝง (วินาที) |

$/ล้าน การอนุมาน (ตามความต้องการ) |

ผลประโยชน์ด้านต้นทุน (G5 มากกว่า G4dn) |

|||

| . | . | . | G5 | G4dn | G5 | G4dn | G5 | G4dn | |

| Bert-ฐานที่ไม่ได้ใส่ | 32 | เต็ม | 723 | 154 | 44 | 208 | $0.6 | $2.2 | 3.7X |

| ผสม | 870 | 410 | 37 | 79 | $0.5 | $0.8 | 1.6X | ||

| 16 | เต็ม | 651 | 158 | 25 | 102 | $0.7 | $2.1 | 3.0X | |

| ผสม | 762 | 376 | 21 | 43 | $0.6 | $0.9 | 1.5X | ||

| 8 | เต็ม | 642 | 142 | 13 | 57 | $0.7 | $2.3 | 3.3X | |

| ผสม | 681 | 350 | 12 | 23 | $0.7 | $1.0 | 1.4X | ||

| . | 1 | เต็ม | 160 | 116 | 6 | 9 | $2.8 | $2.9 | 1.0X |

| ผสม | 137 | 102 | 7 | 10 | $3.3 | $3.3 | 1.0X | ||

| เรสเน็ต50 | 32 | เต็ม | 941 | 397 | 34 | 82 | $0.5 | $0.8 | 1.6X |

| ผสม | 1533 | 851 | 21 | 38 | $0.3 | $0.4 | 1.3X | ||

| 16 | เต็ม | 888 | 384 | 18 | 42 | $0.5 | $0.9 | 1.8X | |

| ผสม | 1474 | 819 | 11 | 20 | $0.3 | $0.4 | 1.3X | ||

| 8 | เต็ม | 805 | 340 | 10 | 24 | $0.6 | $1.0 | 1.7X | |

| ผสม | 1419 | 772 | 6 | 10 | $0.3 | $0.4 | 1.3X | ||

| . | 1 | เต็ม | 202 | 164 | 5 | 6 | $2.2 | $2 | 0.9X |

| ผสม | 196 | 180 | 5 | 6 | $2.3 | $1.9 | 0.8X | ||

เกณฑ์มาตรฐานการอนุมานเพิ่มเติม

นอกจากผลลัพธ์ของ BERT base และ ResNet50 ในส่วนก่อนหน้าแล้ว เรานำเสนอผลการเปรียบเทียบเพิ่มเติมสำหรับโมเดล NLP และ CV ขนาดใหญ่อื่นๆ ที่ใช้กันทั่วไปใน PyTorch ประโยชน์ด้านประสิทธิภาพของ G5 เหนือ G4dn ได้รับการนำเสนอสำหรับรุ่น BERT Large ที่มีความแม่นยำหลากหลาย และรุ่น Yolo-v5 สำหรับขนาดต่างๆ สำหรับโค้ดสำหรับการจำลองเบนช์มาร์ก โปรดดูที่ ตัวอย่างการเรียนรู้เชิงลึกของ NVIDIA สำหรับ Tensor Cores. ผลลัพธ์เหล่านี้แสดงให้เห็นถึงประโยชน์ของการใช้ G5 บน G4dn สำหรับงานอนุมานที่หลากหลายซึ่งครอบคลุมประเภทโมเดลต่างๆ

| รุ่น | ความแม่นยำ | ขนาดแบทช์ | ลำดับความยาว | ปริมาณงาน (ส่ง/วินาที) | ปริมาณงาน: G4dn | เร่งความเร็วเหนือ G4dn |

| BERT-ขนาดใหญ่ | FP16 | 1 | 128 | 93.5 | 40.31 | 2.3 |

| BERT-ขนาดใหญ่ | FP16 | 4 | 128 | 264.2 | 87.4 | 3.0 |

| BERT-ขนาดใหญ่ | FP16 | 8 | 128 | 392.1 | 107.5 | 3.6 |

| BERT-ขนาดใหญ่ | FP32 | 1 | 128 | 68.4 | 22.67 | 3.0 |

| BERT-ขนาดใหญ่ | 4 | 128 | 118.5 | 32.21 | 3.7 | |

| BERT-ขนาดใหญ่ | 8 | 128 | 132.4 | 34.67 | 3.8 |

| รุ่น | GFLOPS | จำนวนพารามิเตอร์ | การประมวลผลล่วงหน้า (มิลลิวินาที) | การอนุมาน (มิลลิวินาที) | การอนุมาน (การปราบปรามแบบไม่สูงสุด) (NMS/ภาพ) |

| YOLOv5s | 16.5 | 7.2M | 0.2 | 3.6 | 4.5 |

| โยลอฟ5ม | 49.1 | 21M | 0.2 | 6.5 | 4.5 |

| โยลอฟ5ล | 109.3 | 46M | 0.2 | 9.1 | 3.5 |

| YOLOv5x | 205.9 | 86M | 0.2 | 14.4 | 1.3 |

สรุป

ในโพสต์นี้ เราแสดงให้เห็นว่าสำหรับการอนุมานด้วยโมเดล NLP และ CV PyTorch ขนาดใหญ่ อินสแตนซ์ EC2 G5 เป็นตัวเลือกที่ดีกว่าเมื่อเทียบกับอินสแตนซ์ G4dn แม้ว่าค่าใช้จ่ายรายชั่วโมงแบบออนดีมานด์สำหรับอินสแตนซ์ G5 จะสูงกว่าอินสแตนซ์ G4dn แต่ประสิทธิภาพที่สูงขึ้นสามารถบรรลุปริมาณงานได้ 2–5 เท่าในทุกความแม่นยำสำหรับรุ่น NLP และ CV ซึ่งทำให้ต้นทุนต่อล้านการอนุมานดีกว่า 1.5–3.5 เท่า อินสแตนซ์ G4dn แม้แต่สำหรับแอปพลิเคชันที่ผูกกับเวลาแฝง G5 ก็ดีกว่า G2.5dn 5–4 เท่าสำหรับรุ่น NLP และ CV

โดยสรุป อินสแตนซ์ AWS G5 เป็นตัวเลือกที่ยอดเยี่ยมสำหรับความต้องการการอนุมานของคุณ ทั้งจากมุมมองด้านประสิทธิภาพและราคาต่อการอนุมาน ความเป็นสากลของเฟรมเวิร์ก CUDA และขนาดและความลึกของพูลอินสแตนซ์ G5 บน AWS ทำให้คุณมีความสามารถเฉพาะตัวในการอนุมานตามขนาด

เกี่ยวกับผู้แต่ง

อังกูร ศรีสวัสดิ์ เป็น Sr. Solutions Architect ในทีม ML Frameworks เขามุ่งเน้นที่การช่วยเหลือลูกค้าด้วยการฝึกอบรมแบบกระจายที่จัดการด้วยตนเองและการอนุมานบน AWS ประสบการณ์ของเขารวมถึงการบำรุงรักษาเชิงคาดการณ์ทางอุตสาหกรรม ฝาแฝดดิจิทัล การเพิ่มประสิทธิภาพการออกแบบที่น่าจะเป็นไปได้ และสำเร็จการศึกษาระดับปริญญาเอกจากวิศวกรรมเครื่องกลที่มหาวิทยาลัยไรซ์ และการวิจัยระดับหลังปริญญาเอกจากสถาบันเทคโนโลยีแมสซาชูเซตส์

อังกูร ศรีสวัสดิ์ เป็น Sr. Solutions Architect ในทีม ML Frameworks เขามุ่งเน้นที่การช่วยเหลือลูกค้าด้วยการฝึกอบรมแบบกระจายที่จัดการด้วยตนเองและการอนุมานบน AWS ประสบการณ์ของเขารวมถึงการบำรุงรักษาเชิงคาดการณ์ทางอุตสาหกรรม ฝาแฝดดิจิทัล การเพิ่มประสิทธิภาพการออกแบบที่น่าจะเป็นไปได้ และสำเร็จการศึกษาระดับปริญญาเอกจากวิศวกรรมเครื่องกลที่มหาวิทยาลัยไรซ์ และการวิจัยระดับหลังปริญญาเอกจากสถาบันเทคโนโลยีแมสซาชูเซตส์

ซุนดาร์ รังคนาธาน เป็นหัวหน้าฝ่ายพัฒนาธุรกิจ ML Frameworks ในทีม Amazon EC2 เขามุ่งเน้นไปที่ปริมาณงาน ML ขนาดใหญ่ในบริการต่างๆ ของ AWS เช่น Amazon EKS, Amazon ECS, Elastic Fabric Adapter, AWS Batch และ Amazon SageMaker ประสบการณ์ของเขารวมถึงบทบาทความเป็นผู้นำในการจัดการผลิตภัณฑ์และการพัฒนาผลิตภัณฑ์ที่ NetApp, Micron Technology, Qualcomm และ Mentor Graphics

ซุนดาร์ รังคนาธาน เป็นหัวหน้าฝ่ายพัฒนาธุรกิจ ML Frameworks ในทีม Amazon EC2 เขามุ่งเน้นไปที่ปริมาณงาน ML ขนาดใหญ่ในบริการต่างๆ ของ AWS เช่น Amazon EKS, Amazon ECS, Elastic Fabric Adapter, AWS Batch และ Amazon SageMaker ประสบการณ์ของเขารวมถึงบทบาทความเป็นผู้นำในการจัดการผลิตภัณฑ์และการพัฒนาผลิตภัณฑ์ที่ NetApp, Micron Technology, Qualcomm และ Mentor Graphics

มหาเทวัน บาละสุบรามาเนียม เป็น Principal Solutions Architect for Autonomous Computing ด้วยประสบการณ์เกือบ 20 ปีในด้านการเรียนรู้เชิงลึกที่สร้างและปรับใช้ระบบดิจิทัลสำหรับระบบอุตสาหกรรมในขนาดต่างๆ Mahadevan สำเร็จการศึกษาระดับปริญญาเอกสาขาวิศวกรรมเครื่องกลจากสถาบันเทคโนโลยีแมสซาชูเซตส์ และมีสิทธิบัตรและสิ่งพิมพ์มากกว่า 25 รายการให้เครดิตของเขา

มหาเทวัน บาละสุบรามาเนียม เป็น Principal Solutions Architect for Autonomous Computing ด้วยประสบการณ์เกือบ 20 ปีในด้านการเรียนรู้เชิงลึกที่สร้างและปรับใช้ระบบดิจิทัลสำหรับระบบอุตสาหกรรมในขนาดต่างๆ Mahadevan สำเร็จการศึกษาระดับปริญญาเอกสาขาวิศวกรรมเครื่องกลจากสถาบันเทคโนโลยีแมสซาชูเซตส์ และมีสิทธิบัตรและสิ่งพิมพ์มากกว่า 25 รายการให้เครดิตของเขา

อมร รากาบ เป็น Principal Solutions Architect สำหรับ EC2 Accelerated Platforms สำหรับ AWS ที่อุทิศให้กับการช่วยเหลือลูกค้าในการรันเวิร์คโหลดการคำนวณในวงกว้าง ในเวลาว่าง เขาชอบการเดินทางและค้นหาวิธีใหม่ๆ ในการผสมผสานเทคโนโลยีเข้ากับชีวิตประจำวัน

อมร รากาบ เป็น Principal Solutions Architect สำหรับ EC2 Accelerated Platforms สำหรับ AWS ที่อุทิศให้กับการช่วยเหลือลูกค้าในการรันเวิร์คโหลดการคำนวณในวงกว้าง ในเวลาว่าง เขาชอบการเดินทางและค้นหาวิธีใหม่ๆ ในการผสมผสานเทคโนโลยีเข้ากับชีวิตประจำวัน

- ขั้นสูง (300)

- AI

- ไอ อาร์ต

- เครื่องกำเนิดไออาร์ท

- หุ่นยนต์ไอ

- Amazon EC2

- ปัญญาประดิษฐ์

- ใบรับรองปัญญาประดิษฐ์

- ปัญญาประดิษฐ์ในการธนาคาร

- หุ่นยนต์ปัญญาประดิษฐ์

- หุ่นยนต์ปัญญาประดิษฐ์

- ซอฟต์แวร์ปัญญาประดิษฐ์

- AWS Machine Learning AWS

- blockchain

- การประชุม blockchain ai

- เหรียญอัจฉริยะ

- ปัญญาประดิษฐ์สนทนา

- การประชุม crypto ai

- ดัล-อี

- การเรียนรู้ลึก ๆ

- google ai

- เรียนรู้เครื่อง

- เพลโต

- เพลโตไอ

- เพลโตดาต้าอินเทลลิเจนซ์

- เกมเพลโต

- เพลโตดาต้า

- เพลโตเกม

- ขนาดไอ

- วากยสัมพันธ์

- ลมทะเล