วันนี้เราขอประกาศความพร้อมใช้งานของเทคโนโลยีล้ำสมัยของ Amazon สู่สาธารณะ Alexa Teacher Model ที่มีพารามิเตอร์ 20 หมื่นล้านพารามิเตอร์ (AlexaTM 20B) ผ่าน Amazon SageMaker JumpStartฮับแมชชีนเลิร์นนิงของ SageMaker AlexaTM 20B เป็นโมเดลภาษาแบบลำดับต่อลำดับ (seq2seq) ขนาดใหญ่หลายภาษาที่พัฒนาโดย Amazon คุณสามารถใช้ AlexaTM 20B สำหรับกรณีการใช้งานในอุตสาหกรรมที่หลากหลาย ตั้งแต่การสรุปรายงานทางการเงินไปจนถึงการตอบคำถามสำหรับแชทบอทบริการลูกค้า สามารถนำไปใช้ได้แม้มีตัวอย่างการฝึกอบรมเพียงไม่กี่ตัวอย่าง หรือแม้แต่ไม่มีเลย AlexaTM 20B ประสิทธิภาพเหนือกว่า 175 พันล้าน รุ่น GPT-3 ในงานการเรียนรู้แบบ Zero-shot เช่น SuperGLUE และแสดงประสิทธิภาพที่ล้ำสมัยสำหรับงานแบบ Zero-shot หลายภาษา เช่น XNLI

ในโพสต์นี้ เราจะให้ภาพรวมของวิธีการปรับใช้และเรียกใช้การอนุมานด้วยโมเดล AlexaTM 20B โดยทางโปรแกรมผ่าน JumpStart API ซึ่งมีอยู่ใน SageMaker Python SDK. เรายกตัวอย่างวิธีที่คุณสามารถใช้แบบจำลองนี้เพื่อแปลระหว่างหลายภาษา สรุปข้อความรูปแบบยาว ตอบคำถามตามบริบทที่กำหนด และสร้างข้อความที่ดูเหมือนแยกไม่ออกจากข้อความที่เขียนโดยมนุษย์

AlexaTM 20B และการเรียนรู้ในบริบท

โปรแกรม Alexa Teacher Model (AlexaTM) โดย Amazon Alexa AI ได้รับการออกแบบมาเพื่อสร้างโมเดลการเรียนรู้เชิงลึกหลายภาษาขนาดใหญ่ (โดยพื้นฐานแล้วใช้ Transformer) โดยมีเป้าหมายเพื่อปรับปรุงการวางแนวทั่วไปและการจัดการข้อมูลที่ขาดแคลนสำหรับงานดาวน์สตรีม ด้วยการฝึกอบรมล่วงหน้าขนาดใหญ่ แบบจำลองของผู้สอนสามารถสรุปได้ดีเพื่อเรียนรู้งานใหม่จากข้อมูลที่เบาบาง และช่วยนักพัฒนาในการปรับปรุงประสิทธิภาพของงานดาวน์สตรีม แสดง AlexaTM 20B แล้ว ประสิทธิภาพการแข่งขัน เกี่ยวกับเกณฑ์มาตรฐานการประมวลผลภาษาธรรมชาติทั่วไป (NLP) และงานต่างๆ เช่น การแปลด้วยคอมพิวเตอร์ การสร้างข้อมูล และการสรุป

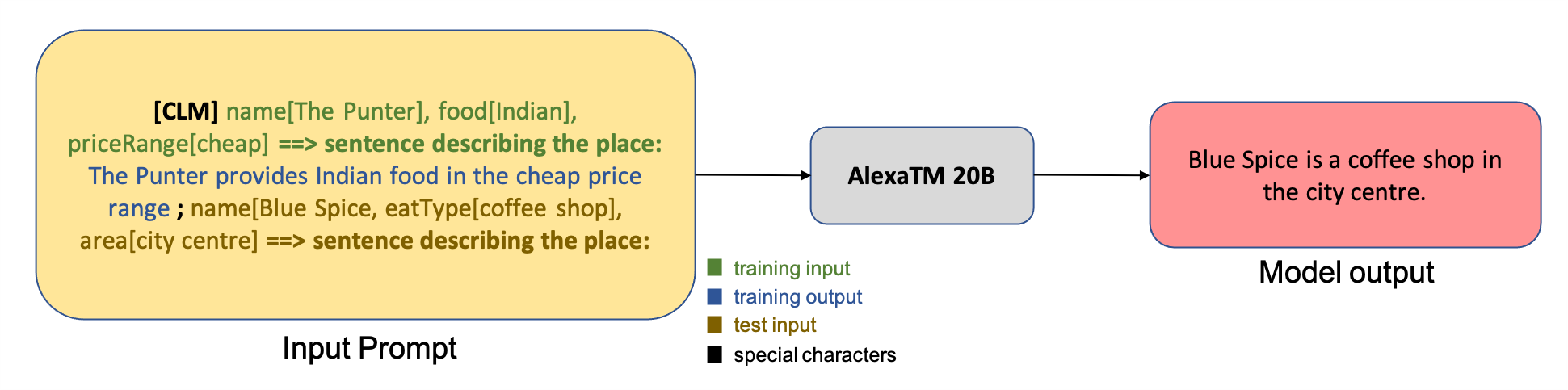

การใช้โมเดลพื้นฐานเช่น AlexaTM 20B ช่วยลดความจำเป็นในการฝึกอบรมโมเดลล่วงหน้าที่มีราคาแพง และให้จุดเริ่มต้นที่ทันสมัยในการพัฒนาโมเดลงานโดยใช้ความพยายามน้อยลงและข้อมูลการฝึกอบรมเฉพาะงานน้อยลง ความสามารถที่สำคัญอย่างหนึ่งของโมเดลพื้นฐานคือเราสามารถสอนโมเดลให้ทำงานใหม่ๆ เช่น คำถามและคำตอบในภาษาต่างๆ ด้วยตัวอย่างอินพุตจำนวนน้อยมากและไม่ต้องปรับละเอียดหรืออัปเดตการไล่ระดับสี สิ่งนี้เรียกว่า การเรียนรู้ในบริบท. ด้วยตัวอย่างเพียงเล็กน้อยของงานใหม่ที่จัดเตรียมไว้เป็นบริบทสำหรับการอนุมาน โมเดล AlexaTM 20B สามารถถ่ายโอนความรู้จากสิ่งที่ได้เรียนรู้ระหว่างการฝึกอบรมล่วงหน้าขนาดใหญ่ แม้กระทั่งข้ามภาษา สิ่งนี้เรียกว่า การเรียนรู้แบบไม่กี่ช็อต. ในบางกรณี แบบจำลองสามารถทำงานได้ดีโดยไม่ต้องใช้ข้อมูลการฝึกอบรมใดๆ เลย โดยมีเพียงคำอธิบายถึงสิ่งที่ควรคาดการณ์เท่านั้น สิ่งนี้เรียกว่า การเรียนรู้แบบไม่มีช็อต. ตัวอย่างเช่น สมมติว่าเราใช้ AlexaTM 20B สำหรับการสร้างภาษาธรรมชาติแบบ one-shot อินพุตที่ส่งผ่านไปยังโมเดลคือตัวอย่างการฝึกอบรมในรูปแบบของคู่ค่าแอตทริบิวต์ พร้อมด้วยคำบรรยายข้อความเอาต์พุตที่สอดคล้องกัน ตัวอย่างการทดสอบจะถูกต่อท้ายเพื่อสร้างพรอมต์อินพุตแบบเต็ม ดังแสดงในรูปต่อไปนี้

หากต้องการเรียนรู้เพิ่มเติมเกี่ยวกับโมเดล โปรดดูที่ รุ่น Alexa พารามิเตอร์ 20B ทำเครื่องหมายใหม่ในการเรียนรู้ไม่กี่ช็อต หรือเดิม กระดาษ.

การใช้งาน AlexaTM 20B มีให้สำหรับการใช้งานที่ไม่ใช่เชิงพาณิชย์และครอบคลุมภายใต้ ข้อตกลงใบอนุญาต Alexa Teacher Model.

ภาพรวมโซลูชัน

ส่วนต่อไปนี้แสดงการสาธิตทีละขั้นตอนเกี่ยวกับวิธีปรับใช้โมเดล เรียกใช้การอนุมาน และทำการเรียนรู้ในบริบทเพื่อแก้ปัญหาการเรียนรู้แบบไม่กี่ช็อต

โปรดทราบว่าส่วนต่อไปนี้มีข้อมูลโค้ด รหัสเต็มพร้อมขั้นตอนทั้งหมดในการสาธิตนี้มีอยู่ในสมุดบันทึกที่ให้มา: การเรียนรู้ในบริบทด้วย AlexaTM 20B ใน SageMaker JumpStart.

ปรับใช้โมเดล

หากต้องการใช้โมเดลภาษาขนาดใหญ่ใน SageMaker คุณต้องมีสคริปต์การอนุมานเฉพาะสำหรับโมเดล ซึ่งรวมถึงขั้นตอนต่างๆ เช่น การโหลดโมเดล การทำให้ขนานกัน และอื่นๆ คุณต้องสร้างการทดสอบแบบ end-to-end สำหรับสคริปต์ โมเดล และประเภทอินสแตนซ์ที่ต้องการเพื่อตรวจสอบว่าทั้งสามสามารถทำงานร่วมกันได้ JumpStart ขจัดความพยายามนี้ด้วยการจัดเตรียมสคริปต์ที่พร้อมใช้งานซึ่งผ่านการทดสอบอย่างเข้มงวดแล้ว

SageMaker ช่วยให้คุณสามารถเรียกใช้คอนเทนเนอร์ Docker ได้อย่างกว้างขวางสำหรับการฝึกอบรมและการอนุมาน JumpStart ใช้เฉพาะเฟรมเวิร์กที่มีอยู่เหล่านี้ คอนเทนเนอร์การเรียนรู้เชิงลึกของ SageMaker (เนื้อหาดาวน์โหลด) เราเริ่มต้นด้วยการดึง DLC ที่ปรับให้เหมาะสม (deploy_image_uri) ใช้ model_id. จากนั้นเราก็ดึง model_uri มีพารามิเตอร์โมเดล พร้อมด้วยสคริปต์การจัดการการอนุมานและการขึ้นต่อกันที่เกี่ยวข้อง ต่อไปเราจะสร้าง ตัวอย่างโมเดล ใน SageMaker และปรับใช้กับตำแหน่งข้อมูลแบบเรียลไทม์ ดูรหัสต่อไปนี้:

การปรับใช้ AlexaTM 20B ต้องใช้อินสแตนซ์ที่สนับสนุน GPU โดยมีหน่วยความจำ CPU อย่างน้อย 50 GB และหน่วยความจำ GPU อย่างน้อย 42 GB SageMaker มีอินสแตนซ์มากมายที่รองรับการอนุมานแบบเรียลไทม์ เราทดสอบโซลูชันนี้ในสามตัวอย่าง: ml.g4dn.12xlarge, ml.p3.8xlarge, ml.p3.16xlarge ดูรหัสต่อไปนี้:

ต่อไป เราปรับใช้โมเดลกับตำแหน่งข้อมูลแบบเรียลไทม์ของ SageMaker:

AlexaTM 20B ต้องการพื้นที่ดิสก์ 40 GB ในคอนเทนเนอร์การอนุมาน อินสแตนซ์ ml.g4dn.12xlarge เป็นไปตามข้อกำหนดนี้ สำหรับอินสแตนซ์ประเภท ml.p3.8xlarge และ ml.p3.16xlarge เราแนบไฟล์ ร้านค้า Amazon Elastic Block ปริมาณ (Amazon EBS) เพื่อจัดการกับโมเดลขนาดใหญ่ ดังนั้นเราจึงตั้งค่า volume_size = None เมื่อใช้งานบน ml.g4dn.12xlarge และ volume_size=256 เมื่อใช้งานบน ml.p3.8xlarge หรือ ml.p3.16xlarge

การทำให้โมเดลใช้งานได้อาจใช้เวลาถึง 10 นาที หลังจากปรับใช้โมเดลแล้ว เราสามารถรับการคาดการณ์จากโมเดลได้แบบเรียลไทม์!

เรียกใช้การอนุมาน

AlexaTM 20B เป็นรูปแบบการสร้างข้อความ ซึ่งกำหนดลำดับบางส่วน (ประโยคหรือข้อความบางส่วน) เพื่อสร้างชุดคำถัดไป ข้อมูลโค้ดต่อไปนี้ช่วยให้คุณเห็นวิธีการสอบถามจุดสิ้นสุดที่เราปรับใช้และแยกวิเคราะห์ผลลัพธ์สำหรับงานเติมข้อความอัตโนมัติ ในการส่งคำขอไปยังโมเดลที่ปรับใช้ เราใช้พจนานุกรม JSON ที่เข้ารหัสในรูปแบบ UTF-8 การตอบสนองปลายทางเป็นวัตถุ JSON ที่มีรายการข้อความที่สร้างขึ้น

ต่อไป เราจะสอบถามจุดสิ้นสุดและแยกวิเคราะห์การตอบสนองของข้อความป้อนตัวอย่าง:

ขณะนี้ AlexaTM 20B รองรับพารามิเตอร์การสร้างข้อความ 10 รายการระหว่างการอนุมาน: max_length, num_return_sequences, num_beams, no_repeat_ngram_size, temperature, early_stopping, do_sample, top_k, top_pและ seed. สำหรับข้อมูลโดยละเอียดเกี่ยวกับค่าที่ถูกต้องสำหรับแต่ละพารามิเตอร์และผลกระทบต่อเอาต์พุต โปรดดูสมุดบันทึกที่ให้มา: การเรียนรู้ในบริบทด้วย AlexaTM 20B ใน SageMaker JumpStart.

การเรียนรู้ในบริบท

การเรียนรู้ในบริบทหมายถึงสิ่งต่อไปนี้: เราจัดเตรียมโมเดลภาษาพร้อมข้อความแจ้ง ซึ่งประกอบด้วยคู่อินพุต-เอาต์พุตการฝึกอบรมที่แสดงให้เห็นงาน เราผนวกอินพุตทดสอบเข้ากับพรอมต์และอนุญาตให้โมเดลภาษาคาดการณ์โดยการปรับเงื่อนไขบนพรอมต์และทำนายโทเค็นหรือคำถัดไป นี่เป็นเทคนิคที่มีประสิทธิภาพสูงในการแก้ปัญหาการเรียนรู้การยิงไม่กี่อย่าง ซึ่งเราเรียนรู้งานจากตัวอย่างการฝึกอบรมสองสามตัวอย่าง

ต่อไป เราจะแสดงวิธีที่คุณสามารถใช้ AlexaTM 20B สำหรับงาน 1-shot และ Zero-shot หลายงานผ่านการเรียนรู้ในบริบท AlexaTM 20B แตกต่างจากโมเดลแบบลำดับต่อลำดับก่อนหน้านี้ ซึ่งได้รับการฝึกอบรมเกี่ยวกับการสร้างแบบจำลองภาษาเชิงสาเหตุนอกเหนือจากการสร้าง denoising ซึ่งทำให้เป็นแบบจำลองที่ดีสำหรับการเรียนรู้ในบริบท

การสรุปข้อความ 1 ช็อต

การสรุปข้อความเป็นงานของการย่อข้อมูลและสร้างการสรุปที่แสดงถึงข้อมูลที่สำคัญที่สุดที่มีอยู่ในข้อความต้นฉบับ การสรุปข้อความแบบ 1-shot หมายถึงการตั้งค่าที่เราเรียนรู้ที่จะสรุปข้อความตามตัวอย่างการฝึกอบรมเดียว รหัสต่อไปนี้เป็นตัวอย่างการสรุปข้อความจาก ชุดข้อมูล XSUM:

เราใช้พรอมต์ต่อไปนี้สำหรับการสรุปเมื่อมีตัวอย่างการฝึกอบรมเพียงชุดเดียว ข้อความที่สร้างขึ้นจากโมเดลจะถูกตีความว่าเป็นบทสรุปที่คาดคะเนของบทความทดสอบ

ผลลัพธ์จะเป็นดังนี้:

การสร้างภาษาธรรมชาติ 1 ช็อต

การสร้างภาษาธรรมชาติเป็นงานของการสร้างคำบรรยายที่เป็นข้อความโดยให้ข้อความที่ป้อนเข้า ตัวอย่างต่อไปนี้แสดงตัวอย่างการฝึกอบรมจาก ชุดข้อมูล E2E:

เราใช้ข้อความแจ้งต่อไปนี้สำหรับการสร้างภาษาธรรมชาติ เมื่อมีตัวอย่างการฝึกอบรมเพียงชุดเดียว (1 ภาพ) ข้อความที่สร้างขึ้นจากโมเดลถูกตีความเป็นข้อความบรรยายที่คาดการณ์ไว้สำหรับอินพุตทดสอบ (test_inp).

ผลลัพธ์จะเป็นดังนี้:

การแปลด้วยเครื่อง 1 ช็อต

การแปลด้วยเครื่องคืองานแปลข้อความจากภาษาหนึ่งเป็นอีกภาษาหนึ่ง ตัวอย่างต่อไปนี้แสดงตัวอย่างการฝึกอบรมจาก ชุดข้อมูล WMT19 ซึ่งเราต้องแปลจากภาษาเยอรมันเป็นภาษาอังกฤษ:

เราใช้ข้อความแจ้งต่อไปนี้สำหรับการแปลด้วยคอมพิวเตอร์ เมื่อมีตัวอย่างการฝึกอบรมเพียงชุดเดียว (1 ภาพ) ข้อความที่สร้างขึ้นจากโมเดลจะถูกตีความว่าเป็นการแปลของอินพุตทดสอบ (test_inp).

ผลลัพธ์จะเป็นดังนี้:

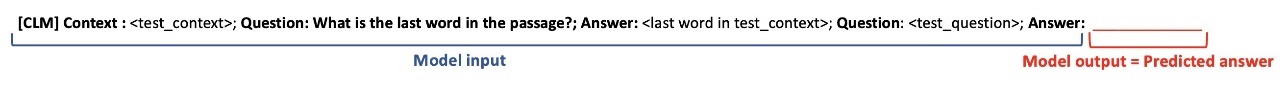

การตอบคำถามสกัดแบบ Zero-shot

การตอบคำถามแบบสกัดเป็นหน้าที่ในการหาคำตอบของคำถามจากย่อหน้าบริบท ต่อไปนี้คือตัวอย่างบริบทและคำถามจาก ชุดข้อมูล SQuAD v2:

โปรดทราบว่าเราไม่มีตัวอย่างการฝึกอบรมสำหรับงานของเรา แต่เราสร้างคำถามจำลองเกี่ยวกับคำสุดท้ายในพรอมต์ โดยอ้างอิงจาก test_context (ดัมมี่ช็อต). ดังนั้นเราจึงทำการตอบคำถามแบบแยกส่วนแบบ Zero-shot

เราใช้ข้อความต่อไปนี้เพื่อตอบคำถามแยกประเด็นเมื่อไม่มีตัวอย่างการฝึกอบรมให้ ข้อความที่สร้างขึ้นจากโมเดลจะถูกตีความว่าเป็นคำตอบสำหรับคำถามทดสอบ

ผลลัพธ์จะเป็นดังนี้:

พร้อมรับงานวิศวกรรม

วิศวกรรมที่รวดเร็วบางครั้งอาจเป็นศิลปะ แม้แต่การเปลี่ยนแปลงเล็กๆ น้อยๆ ในเทมเพลตพรอมต์ก็อาจส่งผลให้เกิดการเปลี่ยนแปลงที่สำคัญต่อประสิทธิภาพของโมเดลในงานเฉพาะได้ ต่อไปนี้เป็นคำแนะนำบางส่วนสำหรับการเขียนเทมเพลตพรอมต์ที่ดี อันดับแรก สิ่งสำคัญคือต้องจำไว้ว่าแบบจำลองนั้นได้รับการฝึกฝนให้เรียนรู้โครงสร้างของประโยคจริง (การสร้างแบบจำลองภาษาเชิงสาเหตุ) ด้วยเหตุนี้ ทางที่ดีควรตรวจสอบให้แน่ใจว่าเทมเพลตพรอมต์ของคุณถูกต้องตามหลักไวยากรณ์และโครงสร้างในภาษาธรรมชาติ ประการที่สอง โมเดลเฉพาะนี้ได้รับประโยชน์จากหุ่นจำลองเพื่อช่วยสอนโครงสร้างที่คาดหวังในคำตอบ ดังที่แสดงไว้ด้านบน ประการที่สาม ขอแนะนำให้ตรวจสอบประสิทธิภาพของงานผ่านเทมเพลตพรอมต์ของผู้สมัครที่หลากหลาย พรอมต์ซอร์ส และ คำแนะนำตามธรรมชาติ เป็นเฟรมเวิร์กโอเพ่นซอร์สสองเฟรมสำหรับเทมเพลตพรอมต์ที่เป็นมาตรฐาน และมีตัวอย่างพรอมต์ที่หลากหลายที่ใช้สำหรับงานสร้างแบบจำลองที่มีอยู่ นอกจากนี้ ภาคผนวก B ของ กระดาษ AlexaTM 20B จัดเตรียมเทมเพลตพรอมต์ที่ใช้เพื่อสร้างผลลัพธ์ที่นำเสนอในกระดาษ มีฟิลด์ย่อยที่เพิ่มขึ้นโดยเฉพาะสำหรับการสร้างอัตโนมัติและการเรียนรู้ข้อความแจ้งที่ดีที่สุดสำหรับงาน รวมถึงทั้งภาษาธรรมชาติและข้อความแจ้งต่อเนื่อง สิ่งนี้อยู่นอกเหนือขอบเขตของบทช่วยสอนนี้

สรุป

ในโพสต์นี้ เราได้แสดงวิธีปรับใช้โมเดล AlexaTM 20B บนตำแหน่งข้อมูล SageMaker และเรียกใช้การอนุมาน คุณสามารถใช้โมเดล AlexaTM 20B สำหรับการเรียนรู้ในบริบทสำหรับงานการเรียนรู้แบบไม่กี่ช็อตที่หลากหลาย หากต้องการเรียนรู้เพิ่มเติมเกี่ยวกับ AlexaTM 20B โปรดดูที่ รุ่น Alexa พารามิเตอร์ 20B ทำเครื่องหมายใหม่ในการเรียนรู้ไม่กี่ช็อต หรือเดิม กระดาษ.

ผู้เขียนต้องการรับทราบการสนับสนุนทางเทคนิคของ Maciej Rudnicki, Jakub Debski, Ashish Khetan, Anastasiia Dubinina, Vitaliy Korolev, Karl Albertsen, Saleh Soltan และ Mariusz Momotko ที่ทำให้การเปิดตัวครั้งนี้เป็นไปได้

เกี่ยวกับจัมพ์สตาร์ท

JumpStart เป็นฮับแมชชีนเลิร์นนิง (ML) ของ Amazon SageMaker ที่มีโมเดลที่ผ่านการฝึกอบรมล่วงหน้ากว่า 350 แบบ อัลกอริทึมในตัว และเทมเพลตโซลูชันที่สร้างไว้ล่วงหน้าเพื่อช่วยให้คุณเริ่มต้นใช้งาน ML ได้อย่างรวดเร็ว JumpStart โฮสต์โมเดลล้ำสมัยจากฮับโมเดลยอดนิยม เช่น TensorFlow, PyTorch, Hugging Face และ MXNet ซึ่งรองรับงาน ML ยอดนิยม เช่น การตรวจจับวัตถุ การจัดประเภทข้อความ และการสร้างข้อความ ชุมชนการวิจัย ML ได้ใช้ความพยายามอย่างมากในการทำให้โมเดลส่วนใหญ่ที่พัฒนาขึ้นเมื่อเร็วๆ นี้พร้อมใช้งานแบบสาธารณะ JumpStart มีจุดมุ่งหมายเพื่อช่วยให้คุณค้นหาโมเดลและอัลกอริทึม ML ที่ถูกต้อง และเริ่มสร้างโมเดลได้ทันที โดยเฉพาะอย่างยิ่ง JumpStart ให้ประโยชน์ดังต่อไปนี้:

- เข้าถึงได้ง่ายด้วย UI และ SDK – คุณสามารถเข้าถึงโมเดลและอัลกอริทึมใน JumpStart แบบเป็นโปรแกรมโดยใช้ SageMaker Python SDK หรือผ่าน JumpStart UI ใน Amazon SageMaker Studio ปัจจุบัน AlexaTM 20B สามารถเข้าถึงได้ผ่าน SageMaker Python SDK เท่านั้น

- อัลกอริทึมในตัวของ SageMaker – JumpStart มีอัลกอริทึมในตัวมากกว่า 350 รายการและโมเดลที่ได้รับการฝึกอบรมล่วงหน้า พร้อมด้วยสคริปต์การฝึกอบรมที่สอดคล้องกัน (หากรองรับ) สคริปต์การอนุมาน และสมุดบันทึกตัวอย่าง สคริปต์ได้รับการปรับให้เหมาะสมสำหรับแต่ละเฟรมเวิร์กและงาน และมีคุณสมบัติต่างๆ เช่น การรองรับ GPU การปรับแต่งโมเดลอัตโนมัติ และการฝึกอบรมเพิ่มเติม สคริปต์ยังได้รับการทดสอบกับอินสแตนซ์และฟีเจอร์ของ SageMaker อีกด้วย เพื่อไม่ให้คุณประสบปัญหาความเข้ากันได้

- โซลูชันที่สร้างไว้ล่วงหน้า – JumpStart นำเสนอชุดโซลูชัน 23 รายการสำหรับกรณีการใช้งาน ML ทั่วไป เช่น การพยากรณ์ความต้องการและแอปพลิเคชันทางอุตสาหกรรมและการเงิน ซึ่งคุณสามารถปรับใช้ได้ด้วยการคลิกเพียงไม่กี่ครั้ง โซลูชันคือแอปพลิเคชัน ML แบบ end-to-end ที่รวมบริการต่างๆ ของ AWS เข้าด้วยกันเพื่อแก้ปัญหากรณีการใช้งานทางธุรกิจโดยเฉพาะ พวกเขาใช้เทมเพลต AWS CloudFormation และสถาปัตยกรรมอ้างอิงสำหรับการปรับใช้อย่างรวดเร็ว ซึ่งหมายความว่าสามารถปรับแต่งได้อย่างเต็มที่

- การสนับสนุน – SageMaker ให้การสนับสนุนที่หลากหลาย เช่น การรักษาเวอร์ชันล่าสุดเมื่อมีการเปิดตัวฟีเจอร์ SageMaker ใหม่หรือเวอร์ชัน Deep Learning Container และการสร้างเอกสารประกอบเกี่ยวกับวิธีใช้เนื้อหา JumpStart ในสภาพแวดล้อม SageMaker

หากต้องการเรียนรู้เพิ่มเติมเกี่ยวกับ JumpStart และวิธีที่คุณสามารถใช้โมเดลโอเพนซอร์สที่ได้รับการฝึกฝนล่วงหน้าสำหรับงาน ML อื่นๆ ที่หลากหลาย โปรดดูสิ่งต่อไปนี้ วิดีโอ AWS re:Invent 2020.

เกี่ยวกับผู้เขียน

ดร.วิเวก มะดัน เป็นนักวิทยาศาสตร์ประยุกต์กับทีม Amazon SageMaker JumpStart เขาสำเร็จการศึกษาระดับปริญญาเอกจากมหาวิทยาลัยอิลลินอยส์ Urbana-Champaign และเป็นนักวิจัยหลังปริญญาเอกที่ Georgia Tech เขาเป็นนักวิจัยเชิงรุกด้านการเรียนรู้ของเครื่องและการออกแบบอัลกอริธึม และได้ตีพิมพ์เอกสารในการประชุม EMNLP, ICLR, COLT, FOCS และ SODA

ดร.วิเวก มะดัน เป็นนักวิทยาศาสตร์ประยุกต์กับทีม Amazon SageMaker JumpStart เขาสำเร็จการศึกษาระดับปริญญาเอกจากมหาวิทยาลัยอิลลินอยส์ Urbana-Champaign และเป็นนักวิจัยหลังปริญญาเอกที่ Georgia Tech เขาเป็นนักวิจัยเชิงรุกด้านการเรียนรู้ของเครื่องและการออกแบบอัลกอริธึม และได้ตีพิมพ์เอกสารในการประชุม EMNLP, ICLR, COLT, FOCS และ SODA

แจ็ค ฟิตซ์เจอรัลด์ เป็นนักวิทยาศาสตร์ประยุกต์อาวุโสที่ Alexa AI ซึ่งปัจจุบันเขามุ่งเน้นไปที่การสร้างแบบจำลองภาษาขนาดใหญ่ การสร้างแบบจำลองข้อความหลายภาษา และการดำเนินการเรียนรู้ของเครื่อง

แจ็ค ฟิตซ์เจอรัลด์ เป็นนักวิทยาศาสตร์ประยุกต์อาวุโสที่ Alexa AI ซึ่งปัจจุบันเขามุ่งเน้นไปที่การสร้างแบบจำลองภาษาขนาดใหญ่ การสร้างแบบจำลองข้อความหลายภาษา และการดำเนินการเรียนรู้ของเครื่อง

ชูเอา มูร่า เป็นสถาปนิกโซลูชันผู้เชี่ยวชาญ AI/ML ที่ Amazon Web Services เขามุ่งเน้นไปที่กรณีการใช้งาน NLP เป็นส่วนใหญ่ และช่วยให้ลูกค้าปรับการฝึกอบรมและปรับใช้โมเดลการเรียนรู้เชิงลึกให้เหมาะสมที่สุด เขายังเป็นผู้สนับสนุนโซลูชัน ML แบบ low-code และฮาร์ดแวร์เฉพาะสำหรับ ML

ชูเอา มูร่า เป็นสถาปนิกโซลูชันผู้เชี่ยวชาญ AI/ML ที่ Amazon Web Services เขามุ่งเน้นไปที่กรณีการใช้งาน NLP เป็นส่วนใหญ่ และช่วยให้ลูกค้าปรับการฝึกอบรมและปรับใช้โมเดลการเรียนรู้เชิงลึกให้เหมาะสมที่สุด เขายังเป็นผู้สนับสนุนโซลูชัน ML แบบ low-code และฮาร์ดแวร์เฉพาะสำหรับ ML

จูน วอน เป็นผู้จัดการผลิตภัณฑ์ที่มี SageMaker JumpStart และอัลกอริทึมในตัว เขามุ่งเน้นที่การทำให้เนื้อหา ML ค้นพบได้ง่ายและใช้งานได้สำหรับลูกค้า SageMaker

จูน วอน เป็นผู้จัดการผลิตภัณฑ์ที่มี SageMaker JumpStart และอัลกอริทึมในตัว เขามุ่งเน้นที่การทำให้เนื้อหา ML ค้นพบได้ง่ายและใช้งานได้สำหรับลูกค้า SageMaker

ปุลกิต คาปูร์ เป็นผู้นำด้านผลิตภัณฑ์สำหรับโปรแกรม Alexa Teacher Model ที่มี Alexa AI โดยเน้นที่ความชาญฉลาดทั่วไปและการประยุกต์ใช้โมเดลพื้นฐานแบบมัลติทาสก์ต่อเนื่องหลายรูปแบบของ Alexa

ปุลกิต คาปูร์ เป็นผู้นำด้านผลิตภัณฑ์สำหรับโปรแกรม Alexa Teacher Model ที่มี Alexa AI โดยเน้นที่ความชาญฉลาดทั่วไปและการประยุกต์ใช้โมเดลพื้นฐานแบบมัลติทาสก์ต่อเนื่องหลายรูปแบบของ Alexa

- AI

- ไอ อาร์ต

- เครื่องกำเนิดไออาร์ท

- หุ่นยนต์ไอ

- อเมซอน SageMaker

- Amazon SageMaker JumpStart

- ปัญญาประดิษฐ์

- ใบรับรองปัญญาประดิษฐ์

- ปัญญาประดิษฐ์ในการธนาคาร

- หุ่นยนต์ปัญญาประดิษฐ์

- หุ่นยนต์ปัญญาประดิษฐ์

- ซอฟต์แวร์ปัญญาประดิษฐ์

- AWS Machine Learning AWS

- blockchain

- การประชุม blockchain ai

- เหรียญอัจฉริยะ

- ปัญญาประดิษฐ์สนทนา

- การประชุม crypto ai

- ดัล-อี

- การเรียนรู้ลึก ๆ

- รองพื้น (100)

- google ai

- เรียนรู้เครื่อง

- เพลโต

- เพลโตไอ

- เพลโตดาต้าอินเทลลิเจนซ์

- เกมเพลโต

- เพลโตดาต้า

- เพลโตเกม

- ขนาดไอ

- วากยสัมพันธ์

- ลมทะเล