ในวันนี้ อเมซอน SageMaker ประกาศสนับสนุนการค้นหากริดสำหรับ การปรับรุ่นอัตโนมัติให้ผู้ใช้มีกลยุทธ์เพิ่มเติมเพื่อค้นหาการกำหนดค่าไฮเปอร์พารามิเตอร์ที่ดีที่สุดสำหรับโมเดลของคุณ

การปรับโมเดลอัตโนมัติของ Amazon SageMaker จะค้นหาเวอร์ชันที่ดีที่สุดของโมเดลโดยเรียกใช้งานการฝึกอบรมจำนวนมากบนชุดข้อมูลของคุณโดยใช้ พิสัย ของไฮเปอร์พารามิเตอร์ที่คุณระบุ จากนั้นจะเลือกค่าไฮเปอร์พารามิเตอร์ที่ส่งผลให้โมเดลทำงานได้ดีที่สุดตามที่วัดโดยa เมตริก ที่คุณเลือก

ในการค้นหาค่าไฮเปอร์พารามิเตอร์ที่ดีที่สุดสำหรับโมเดลของคุณ การปรับแต่งโมเดลอัตโนมัติของ Amazon SageMaker รองรับกลยุทธ์ที่หลากหลาย รวมถึง เบย์เซียน (Default) สุ่ม ค้นหาและ ไฮเปอร์แบนด์.

ค้นหากริด

การค้นหาแบบกริดจะสำรวจการกำหนดค่าในกริดของไฮเปอร์พารามิเตอร์ที่คุณกำหนดอย่างละเอียดถี่ถ้วน ซึ่งช่วยให้คุณได้รับข้อมูลเชิงลึกเกี่ยวกับการกำหนดค่าไฮเปอร์พารามิเตอร์ที่มีแนวโน้มดีที่สุดในกริดของคุณ และสร้างผลลัพธ์ของคุณซ้ำในการปรับแต่งต่างๆ การค้นหากริดช่วยให้คุณมั่นใจมากขึ้นว่ามีการสำรวจพื้นที่การค้นหาพารามิเตอร์ไฮเปอร์ทั้งหมด ประโยชน์นี้มาพร้อมกับการประนีประนอมเนื่องจากการคำนวณมีราคาแพงกว่าการค้นหาแบบเบย์เซียนและการค้นหาแบบสุ่มหากเป้าหมายหลักของคุณคือการค้นหาการกำหนดค่าไฮเปอร์พารามิเตอร์ที่ดีที่สุด

ค้นหาตารางด้วย Amazon SageMaker

ใน Amazon SageMaker คุณใช้การค้นหาแบบกริดเมื่อปัญหาของคุณต้องการให้คุณมีชุดค่าผสมไฮเปอร์พารามิเตอร์ที่เหมาะสมที่สุดที่เพิ่มหรือย่อเมตริกวัตถุประสงค์ให้เหลือน้อยที่สุด กรณีใช้งานทั่วไปที่ลูกค้าใช้ Grid Search คือเมื่อความถูกต้องของแบบจำลองและความสามารถในการทำซ้ำมีความสำคัญต่อธุรกิจของคุณมากกว่าค่าใช้จ่ายในการฝึกอบรมที่จำเป็นเพื่อให้ได้มา

ในการเปิดใช้งาน Grid Search ใน Amazon SageMaker ให้ตั้งค่า Strategy ฟิลด์ไปที่ Grid เมื่อคุณสร้างงานปรับแต่งดังนี้:

นอกจากนี้ การค้นหาแบบกริดต้องการให้คุณกำหนดพื้นที่การค้นหาของคุณ (คาร์ทีเซียนกริด) เป็นช่วงของค่าที่ไม่ต่อเนื่องในการกำหนดงานของคุณโดยใช้ CategoricalParameterRanges ที่สำคัญภายใต้ ParameterRanges พารามิเตอร์ดังต่อไปนี้:

โปรดทราบว่าเราไม่ได้ระบุ MaxNumberOfTrainingJobs สำหรับการค้นหาแบบกริดในข้อกำหนดของงาน เนื่องจากจะกำหนดให้คุณจากจำนวนของชุดค่าผสมประเภท เมื่อใช้การค้นหาแบบสุ่มและแบบเบย์ คุณต้องระบุ MaxNumberOfTrainingJobs พารามิเตอร์เป็นวิธีควบคุมต้นทุนงานปรับแต่งโดยกำหนดขอบเขตบนสำหรับการคำนวณ ด้วยการค้นหา Grid ค่าของ MaxNumberOfTrainingJobs (ตัวเลือกตอนนี้) ถูกตั้งค่าโดยอัตโนมัติเป็นจำนวนผู้สมัครสำหรับการค้นหากริดใน อธิบายHyperParameterTuningJob รูปร่าง. สิ่งนี้ช่วยให้คุณสำรวจตารางไฮเปอร์พารามิเตอร์ที่คุณต้องการอย่างละเอียดถี่ถ้วน นอกจากนี้ คำนิยามงานในการค้นหาแบบกริดจะยอมรับเฉพาะช่วงการจัดหมวดหมู่ที่ไม่ต่อเนื่อง และไม่ต้องการคำจำกัดความช่วงต่อเนื่องหรือจำนวนเต็มเนื่องจากแต่ละค่าในกริดถือเป็นแบบไม่ต่อเนื่อง

การทดสอบการค้นหากริด

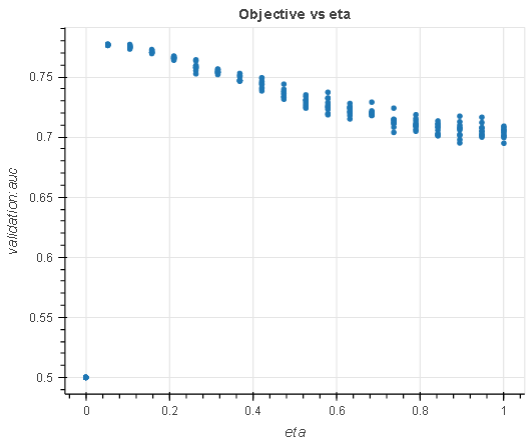

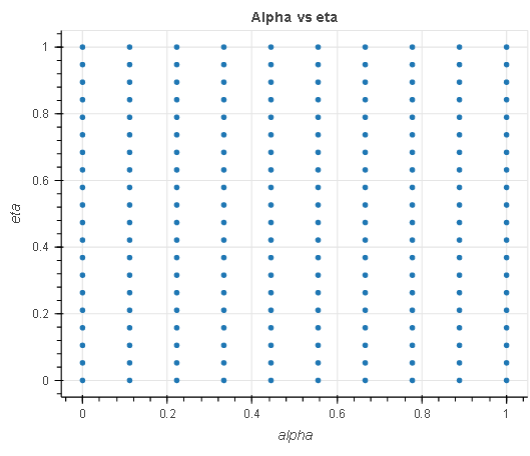

ในการทดลองนี้ โดยให้งานการถดถอย เราค้นหาไฮเปอร์พารามิเตอร์ที่เหมาะสมที่สุดภายในพื้นที่การค้นหาที่มีไฮเปอร์พารามิเตอร์ 200 รายการ 20 eta และ 10 alpha ตั้งแต่ 0.1 ถึง 1 เราใช้ ชุดข้อมูลการตลาดทางตรง เพื่อปรับโมเดลการถดถอย

- การทางพิเศษแห่งประเทศไทย: การย่อขนาดขั้นใช้ในการอัพเดทเพื่อป้องกันการใส่มากเกินไป หลังจากแต่ละขั้นตอนการส่งเสริม คุณจะได้รับน้ำหนักของคุณสมบัติใหม่โดยตรง ดิ

etaพารามิเตอร์จะลดน้ำหนักของฟีเจอร์ลงจริง ๆ เพื่อให้กระบวนการส่งเสริมอนุรักษ์นิยมมากขึ้น - แอลฟา: L1 เงื่อนไขการทำให้เป็นมาตรฐานสำหรับตุ้มน้ำหนัก การเพิ่มมูลค่านี้ทำให้โมเดลมีความอนุรักษ์นิยมมากขึ้น

|

|

แผนภูมิทางด้านซ้ายแสดงการวิเคราะห์ของ eta ไฮเปอร์พารามิเตอร์ที่สัมพันธ์กับตัวชี้วัดวัตถุประสงค์และแสดงให้เห็นว่าการค้นหากริดทำให้พื้นที่การค้นหาทั้งหมด (กริด) ในแกน X หมดลงได้อย่างไรก่อนที่จะส่งคืนโมเดลที่ดีที่สุด แผนภูมิทางด้านขวาจะวิเคราะห์ไฮเปอร์พารามิเตอร์ทั้งสองอย่างเท่าเทียมกันในช่องว่างคาร์ทีเซียนเดียวเพื่อแสดงให้เห็นว่าทุกจุดในกริดถูกเลือกระหว่างการจูน

การทดสอบข้างต้นแสดงให้เห็นว่าลักษณะที่ละเอียดถี่ถ้วนของการค้นหาแบบกริดรับประกันการเลือกไฮเปอร์พารามิเตอร์ที่เหมาะสมที่สุดตามพื้นที่การค้นหาที่กำหนดไว้ นอกจากนี้ยังแสดงให้เห็นว่าคุณสามารถทำซ้ำผลการค้นหาของคุณผ่านการปรับแต่งซ้ำ สิ่งอื่น ๆ ทั้งหมดเท่าเทียมกัน

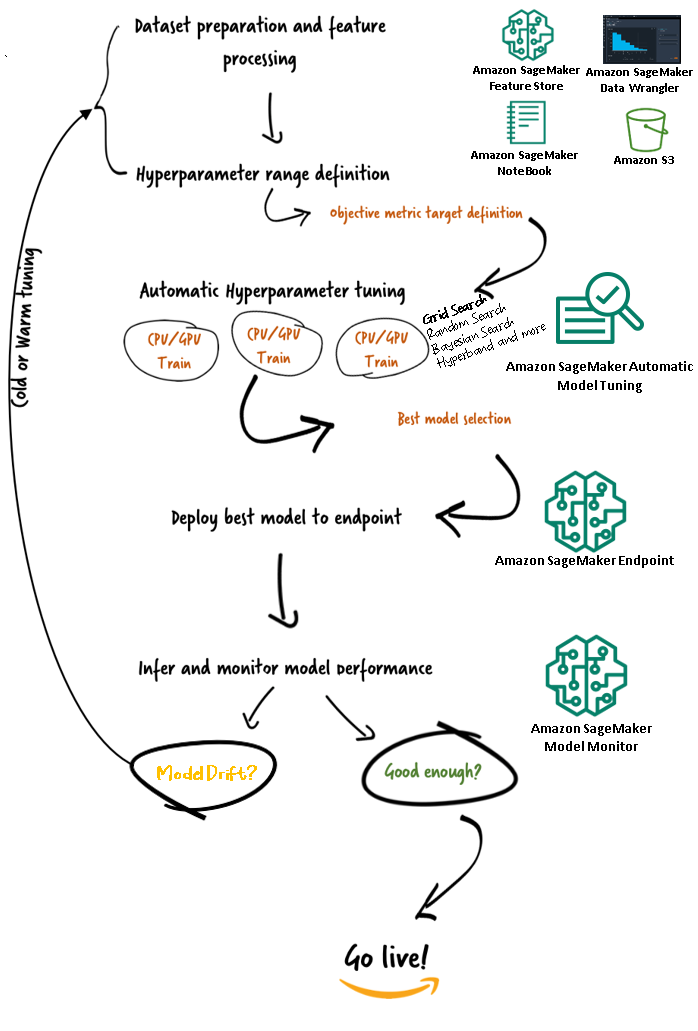

เวิร์กโฟลว์การปรับแต่งโมเดลอัตโนมัติของ Amazon SageMaker (AMT)

ด้วยการปรับแต่งโมเดลอัตโนมัติของ Amazon SageMaker คุณสามารถค้นหาเวอร์ชันที่ดีที่สุดของโมเดลของคุณโดยเรียกใช้งานการฝึกบนชุดข้อมูลของคุณด้วยกลยุทธ์การค้นหาที่หลากหลาย เช่น Bayesian, Random search, Grid search และ Hyperband การปรับโมเดลอัตโนมัติช่วยให้คุณลดเวลาในการปรับแต่งโมเดลโดยการค้นหาการกำหนดค่าไฮเปอร์พารามิเตอร์ที่ดีที่สุดโดยอัตโนมัติภายในช่วงไฮเปอร์พารามิเตอร์ที่คุณระบุ

ตอนนี้เราได้ตรวจสอบข้อดีของการใช้การค้นหาแบบกริดใน Amazon SageMaker AMT แล้ว มาดูขั้นตอนการทำงานของ AMT และทำความเข้าใจว่าทั้งหมดนี้เข้ากันได้อย่างไรใน SageMaker

สรุป

ในโพสต์นี้ เราได้พูดถึงวิธีที่คุณสามารถใช้กลยุทธ์การค้นหาแบบกริดเพื่อค้นหาโมเดลที่ดีที่สุดและความสามารถในการสร้างผลลัพธ์ตามที่กำหนดในงานปรับแต่งต่างๆ เราได้พูดคุยถึงการประนีประนอมเมื่อใช้การค้นหาแบบกริดเทียบกับกลยุทธ์อื่นๆ และวิธีที่จะช่วยให้คุณสำรวจว่าพื้นที่ของไฮเปอร์พารามิเตอร์ใดมีแนวโน้มมากที่สุดและสร้างผลลัพธ์ของคุณอย่างกำหนดได้

หากต้องการเรียนรู้เพิ่มเติมเกี่ยวกับการปรับแต่งโมเดลอัตโนมัติ โปรดไปที่ หน้าสินค้า และ เอกสารทางเทคนิค.

เกี่ยวกับผู้เขียน

ดั๊ก เอ็มบาย่า เป็นสถาปนิกโซลูชันคู่ค้าอาวุโสที่เน้นข้อมูลและการวิเคราะห์ Doug ทำงานอย่างใกล้ชิดกับคู่ค้าของ AWS ช่วยผสานรวมข้อมูลและโซลูชันการวิเคราะห์ในระบบคลาวด์

ดั๊ก เอ็มบาย่า เป็นสถาปนิกโซลูชันคู่ค้าอาวุโสที่เน้นข้อมูลและการวิเคราะห์ Doug ทำงานอย่างใกล้ชิดกับคู่ค้าของ AWS ช่วยผสานรวมข้อมูลและโซลูชันการวิเคราะห์ในระบบคลาวด์

- ขั้นสูง (300)

- AI

- ไอ อาร์ต

- เครื่องกำเนิดไออาร์ท

- หุ่นยนต์ไอ

- อเมซอน SageMaker

- ปัญญาประดิษฐ์

- ใบรับรองปัญญาประดิษฐ์

- ปัญญาประดิษฐ์ในการธนาคาร

- หุ่นยนต์ปัญญาประดิษฐ์

- หุ่นยนต์ปัญญาประดิษฐ์

- ซอฟต์แวร์ปัญญาประดิษฐ์

- AWS Machine Learning AWS

- blockchain

- การประชุม blockchain ai

- เหรียญอัจฉริยะ

- ปัญญาประดิษฐ์สนทนา

- การประชุม crypto ai

- ดัล-อี

- การเรียนรู้ลึก ๆ

- google ai

- เรียนรู้เครื่อง

- เพลโต

- เพลโตไอ

- เพลโตดาต้าอินเทลลิเจนซ์

- เกมเพลโต

- เพลโตดาต้า

- เพลโตเกม

- ขนาดไอ

- วากยสัมพันธ์

- ลมทะเล