โพสต์ในบล็อกนี้เขียนร่วมกับ Tuana Celik จาก deepset

การค้นหาระดับองค์กรเป็นองค์ประกอบสำคัญของประสิทธิภาพองค์กรผ่านการแปลงเอกสารเป็นดิจิทัลและการจัดการความรู้ การค้นหาระดับองค์กรครอบคลุมการจัดเก็บเอกสาร เช่น ไฟล์ดิจิทัล การทำดัชนีเอกสารสำหรับการค้นหา และการให้ผลลัพธ์ที่เกี่ยวข้องตามคำค้นหาของผู้ใช้ ด้วยการถือกำเนิดของโมเดลภาษาขนาดใหญ่ (LLM) เราสามารถนำประสบการณ์การสนทนาไปใช้ในการให้ผลลัพธ์แก่ผู้ใช้ อย่างไรก็ตาม เราจำเป็นต้องตรวจสอบให้แน่ใจว่า LLM จำกัดการตอบสนองต่อข้อมูลของบริษัท ซึ่งจะช่วยบรรเทาภาพหลอนของโมเดลได้

ในโพสต์นี้ เราจะแสดงวิธีสร้างแอปพลิเคชัน AI แบบครบวงจรสำหรับการค้นหาระดับองค์กรด้วย Retreatal Augmented Generation (RAG) โดยใช้ไปป์ไลน์ Haystack และโมเดลคำสั่ง Falcon-40b จาก Amazon SageMaker JumpStart และ บริการ Amazon OpenSearch. ซอร์สโค้ดสำหรับตัวอย่างที่แสดงในโพสต์นี้มีอยู่ใน พื้นที่เก็บข้อมูล GitHub

ภาพรวมโซลูชัน

หากต้องการจำกัดการตอบสนองของแอปพลิเคชัน generative AI ต่อข้อมูลของบริษัทเท่านั้น เราจำเป็นต้องใช้เทคนิคที่เรียกว่า Retrieval Augmented Generation (RAG) แอปพลิเคชันที่ใช้วิธีการ RAG จะดึงข้อมูลที่เกี่ยวข้องกับคำขอของผู้ใช้มากที่สุดจากฐานความรู้หรือเนื้อหาขององค์กร รวมกลุ่มเป็นบริบทพร้อมกับคำขอของผู้ใช้เป็นพรอมต์ จากนั้นจึงส่งไปยัง LLM เพื่อรับการตอบกลับ LLM มีข้อจำกัดเกี่ยวกับจำนวนคำสูงสุดสำหรับข้อความแจ้งการป้อนข้อมูล ดังนั้นการเลือกข้อความที่ถูกต้องจากเอกสารหลายพันหรือล้านรายการในองค์กรจึงส่งผลโดยตรงต่อความแม่นยำของ LLM

เทคนิค RAG มีความสำคัญมากขึ้นในการค้นหาระดับองค์กร ในโพสต์นี้ เราจะแสดงเวิร์กโฟลว์ที่ใช้ประโยชน์จาก SageMaker JumpStart เพื่อปรับใช้โมเดลคำสั่ง Falcon-40b และใช้ Haystack เพื่อออกแบบและเรียกใช้ไปป์ไลน์การตอบคำถามเสริมแบบดึงข้อมูล เวิร์กโฟลว์การเสริมการดึงข้อมูลขั้นสุดท้ายครอบคลุมขั้นตอนระดับสูงต่อไปนี้:

- ข้อความค้นหาของผู้ใช้ใช้สำหรับส่วนประกอบตัวดึงข้อมูล ซึ่งทำการค้นหาเวกเตอร์ เพื่อดึงบริบทที่เกี่ยวข้องมากที่สุดจากฐานข้อมูลของเรา

- บริบทนี้ถูกฝังอยู่ในพรอมต์ที่ออกแบบมาเพื่อสั่งให้ LLM สร้างคำตอบจากบริบทที่ให้ไว้เท่านั้น

- LLM สร้างการตอบสนองต่อคำถามต้นฉบับโดยพิจารณาเฉพาะบริบทที่ฝังอยู่ในพร้อมท์ที่ได้รับเท่านั้น

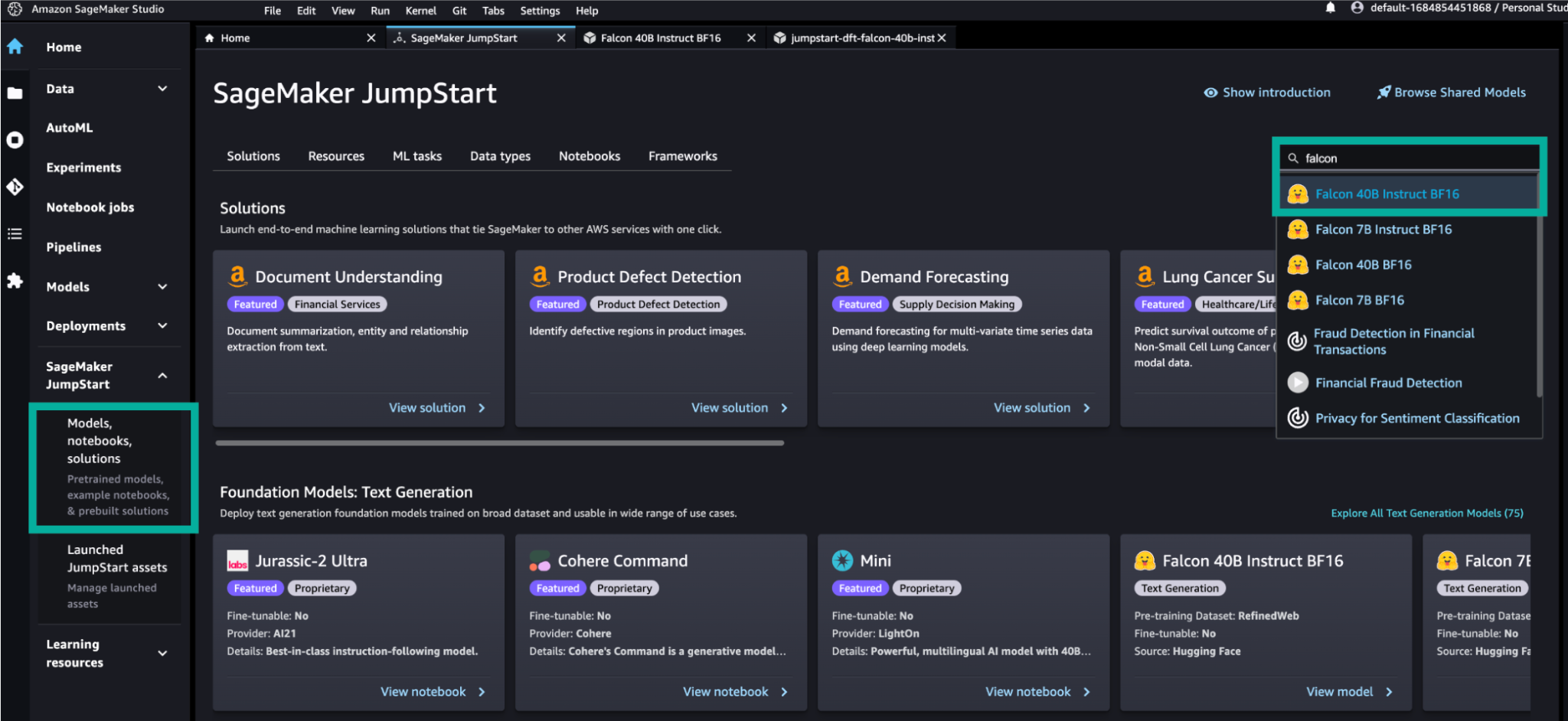

SageMaker JumpStart

SageMaker JumpStart ทำหน้าที่เป็นศูนย์กลางโมเดลที่รวบรวมโมเดลการเรียนรู้เชิงลึกที่หลากหลายสำหรับข้อความ การมองเห็น เสียง และการฝังกรณีการใช้งาน ด้วยโมเดลมากกว่า 500 โมเดล ฮับโมเดลประกอบด้วยทั้งโมเดลสาธารณะและโมเดลที่เป็นกรรมสิทธิ์จากคู่ค้าของ AWS เช่น AI21, Stability AI, Cohere และ LightOn นอกจากนี้ยังโฮสต์โมเดลพื้นฐานที่พัฒนาโดย Amazon แต่เพียงผู้เดียว เช่น AlexaTM โมเดลบางรุ่นมีความสามารถให้คุณปรับแต่งด้วยข้อมูลของคุณเอง SageMaker JumpStart ยังมีเทมเพลตโซลูชันที่ตั้งค่าโครงสร้างพื้นฐานสำหรับกรณีการใช้งานทั่วไป และสมุดบันทึกตัวอย่างที่ปฏิบัติการได้สำหรับการเรียนรู้ของเครื่อง (ML) ด้วย SageMaker

กองหญ้า

กองหญ้า เป็นเฟรมเวิร์กโอเพ่นซอร์สโดย Deepset ที่ช่วยให้นักพัฒนาสามารถประสานแอปพลิเคชัน LLM ซึ่งประกอบด้วยส่วนประกอบต่างๆ เช่น โมเดล ฐานข้อมูลเวกเตอร์ ตัวแปลงไฟล์ และโมดูลอื่นๆ อีกนับไม่ถ้วน กองหญ้าจัดให้ ท่อ และ ตัวแทนสองโครงสร้างอันทรงพลังสำหรับการออกแบบแอปพลิเคชัน LLM สำหรับกรณีการใช้งานที่หลากหลาย รวมถึงการค้นหา การตอบคำถาม และ AI การสนทนา ด้วยการมุ่งเน้นที่วิธีการดึงข้อมูลที่ล้ำสมัยและตัวชี้วัดการประเมินที่มั่นคง จะช่วยให้คุณมีทุกสิ่งที่คุณต้องการในการจัดส่งแอปพลิเคชันที่เชื่อถือได้และเชื่อถือได้ คุณสามารถซีเรียลไลซ์ไปป์ไลน์ไปที่ ไฟล์ YAMLเปิดเผยพวกเขาผ่านก REST APIและปรับขนาดได้อย่างยืดหยุ่นตามปริมาณงานของคุณ ทำให้ง่ายต่อการย้ายแอปพลิเคชันของคุณจากขั้นตอนต้นแบบไปสู่การใช้งานจริง

อเมซอน โอเพนเสิร์ช

OpenSearch Service เป็นบริการที่มีการจัดการเต็มรูปแบบซึ่งทำให้ง่ายต่อการปรับใช้ ปรับขนาด และดำเนินการ OpenSearch ใน AWS Cloud OpenSearch คือชุดซอฟต์แวร์โอเพ่นซอร์สที่ปรับขนาดได้ ยืดหยุ่น และขยายได้สำหรับแอปพลิเคชันการค้นหา การวิเคราะห์ การตรวจสอบความปลอดภัย และความสามารถในการสังเกต โดยได้รับใบอนุญาตภายใต้ลิขสิทธิ์ Apache 2.0

ในช่วงไม่กี่ปีที่ผ่านมา เทคนิค ML ได้รับความนิยมมากขึ้นในการปรับปรุงการค้นหา ในหมู่พวกเขามีการใช้ การฝังโมเดลซึ่งเป็นแบบจำลองประเภทหนึ่งที่สามารถเข้ารหัสเนื้อหาขนาดใหญ่ลงในพื้นที่ n มิติโดยที่แต่ละเอนทิตีถูกเข้ารหัสลงใน เวกเตอร์จุดข้อมูลในพื้นที่นั้น และจัดระเบียบเพื่อให้เอนทิตีที่คล้ายกันอยู่ใกล้กันมากขึ้น ฐานข้อมูลเวกเตอร์ให้การค้นหาความคล้ายคลึงกันของเวกเตอร์ที่มีประสิทธิภาพโดยจัดทำดัชนีเฉพาะเช่นดัชนี k-NN

ด้วยความสามารถของฐานข้อมูลเวกเตอร์ของ OpenSearch Service คุณสามารถปรับใช้การค้นหาเชิงความหมาย, RAG พร้อม LLM, กลไกการแนะนำ และการค้นหาสื่อสมบูรณ์ได้ ในโพสต์นี้ เราใช้ RAG เพื่อช่วยให้เราสามารถเสริม LLM ทั่วไปด้วยฐานความรู้ภายนอกที่โดยทั่วไปแล้วสร้างขึ้นโดยใช้ฐานข้อมูลเวกเตอร์ที่มีบทความความรู้ที่เข้ารหัสเวกเตอร์

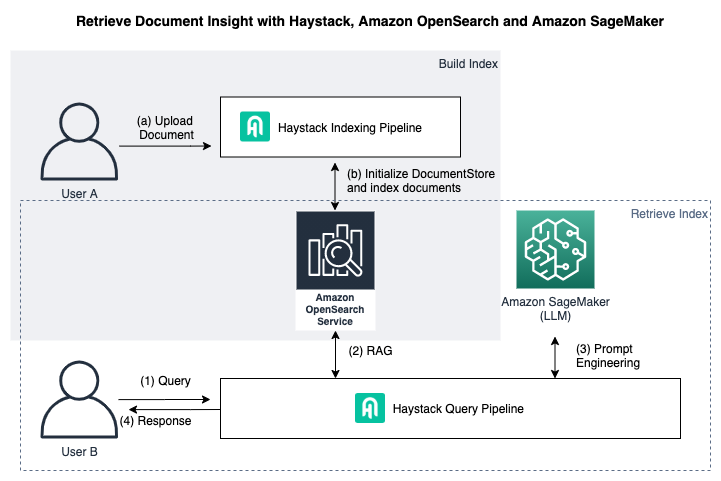

ภาพรวมของแอปพลิเคชัน

แผนภาพต่อไปนี้แสดงโครงสร้างของการใช้งานขั้นสุดท้าย

ในแอปพลิเคชันนี้ เราใช้ไปป์ไลน์การจัดทำดัชนี Haystack เพื่อจัดการเอกสารที่อัพโหลดและเอกสารดัชนี และใช้ไปป์ไลน์การสืบค้น Haystack เพื่อดำเนินการดึงความรู้จากเอกสารที่จัดทำดัชนี

ไปป์ไลน์การจัดทำดัชนี Haystack ประกอบด้วยขั้นตอนระดับสูงต่อไปนี้:

- อัปโหลดเอกสาร

- เริ่มต้น

DocumentStoreและเอกสารดัชนี

เราใช้ OpenSearch เป็นของเรา ร้านเอกสาร และกองหญ้า ไปป์ไลน์การจัดทำดัชนี เพื่อประมวลผลล่วงหน้าและจัดทำดัชนีไฟล์ของเราเป็น OpenSearch กองหญ้า ไฟล์คอนเวอร์เตอร์ และ พรีโปรเซสเซอร์ ช่วยให้คุณสามารถทำความสะอาดและเตรียมไฟล์ Raw ของคุณให้อยู่ในรูปทรงและรูปแบบที่ไปป์ไลน์การประมวลผลภาษาธรรมชาติ (NLP) และโมเดลภาษาที่คุณเลือกสามารถจัดการได้ ไปป์ไลน์การจัดทำดัชนีที่เราใช้ที่นี่ก็ใช้เช่นกัน sentence-transformers/all-MiniLM-L12-v2 เพื่อสร้างการฝังสำหรับแต่ละเอกสาร ซึ่งเราใช้เพื่อการดึงข้อมูลอย่างมีประสิทธิภาพ

ไปป์ไลน์การสืบค้น Haystack มีขั้นตอนระดับสูงดังต่อไปนี้:

- เราส่งข้อความค้นหาไปยังไปป์ไลน์ RAG

- An การฝังRetriever ส่วนประกอบทำหน้าที่เป็นตัวกรองที่ดึงข้อมูลที่เกี่ยวข้องมากที่สุด

top_kเอกสารจากเอกสารที่จัดทำดัชนีของเราใน OpenSearch เราใช้ตัวเลือกรูปแบบการฝังของเราเพื่อฝังทั้งข้อความค้นหาและเอกสาร (ขณะจัดทำดัชนี) เพื่อให้บรรลุเป้าหมายนี้ - เอกสารที่ดึงมาจะถูกฝังอยู่ในข้อความแจ้งของเราไปยังโมเดลคำสั่ง Falcon-40b

- LLM ส่งคืนพร้อมกับการตอบกลับที่อิงตามเอกสารที่ดึงข้อมูล

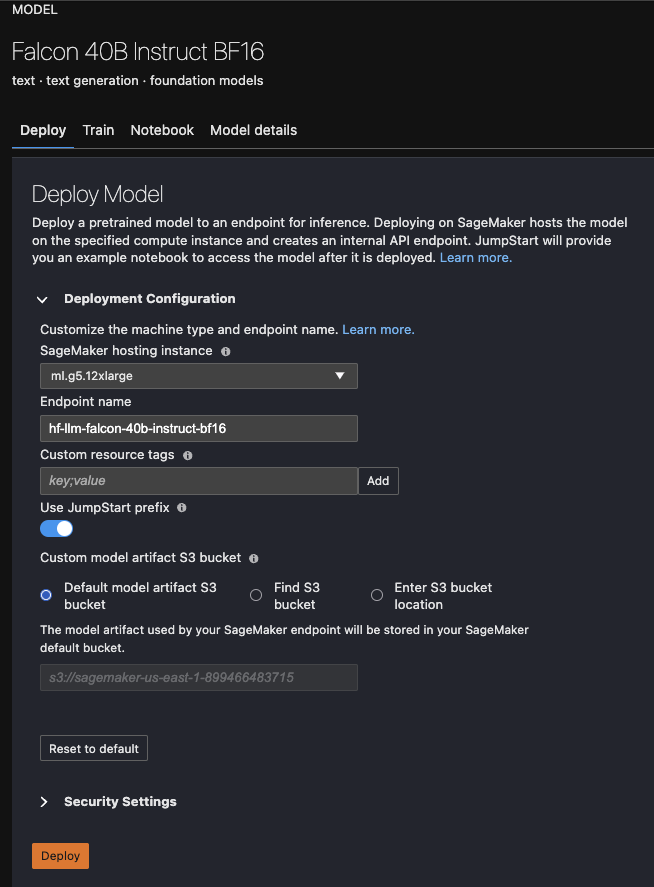

สำหรับการปรับใช้โมเดล เราใช้ SageMaker JumpStart ซึ่งช่วยให้การปรับใช้โมเดลง่ายขึ้นด้วยการกดปุ่มเพียงปุ่มเดียว แม้ว่าเราจะใช้และทดสอบคำสั่ง Falcon-40b สำหรับตัวอย่างนี้แล้ว แต่คุณสามารถใช้โมเดล Hugging Face ใดก็ได้ที่มีอยู่ใน SageMaker

วิธีแก้ปัญหาขั้นสุดท้ายมีอยู่ใน กองหญ้า-นักปราชญ์ พื้นที่เก็บข้อมูลและใช้เว็บไซต์และเอกสารประกอบของ OpenSearch (สำหรับ OpenSearch 2.7) เป็นข้อมูลตัวอย่างของเราเพื่อดำเนินการดึงข้อมูลการตอบคำถามเสริม

เบื้องต้น

สิ่งแรกที่ต้องทำก่อนที่เราจะใช้บริการของ AWS ได้คือต้องแน่ใจว่าเราได้สมัครและสร้างบัญชี AWS แล้ว จากนั้นคุณควรสร้างผู้ใช้และกลุ่มผู้ดูแลระบบ สำหรับคำแนะนำในทั้งสองขั้นตอน โปรดดูที่ ตั้งค่าข้อกำหนดเบื้องต้นของ Amazon SageMaker.

เพื่อให้สามารถใช้ Haystack ได้ คุณจะต้องติดตั้ง farm-haystack แพ็คเกจที่มีการขึ้นต่อกันที่จำเป็น เพื่อให้บรรลุผลนี้ ให้ใช้ requirements.txt แฟ้มใน พื้นที่เก็บข้อมูล GitHub โดยการวิ่ง pip install requirements.txt.

จัดทำดัชนีเอกสารเป็น OpenSearch

Haystack มีตัวเชื่อมต่อจำนวนหนึ่งไปยังฐานข้อมูลซึ่งเรียกว่า DocumentStores. สำหรับเวิร์กโฟลว์ RAG นี้ เราใช้ OpenSearchDocumentStore. ตัวอย่าง กรุ รวมถึงไปป์ไลน์การจัดทำดัชนีและ การก่อตัวของ AWS Cloud เทมเพลต เพื่อตั้งค่า an OpenSearchDocumentStore พร้อมเอกสารที่รวบรวมข้อมูลจากเว็บไซต์ OpenSearch และหน้าเอกสารประกอบ

บ่อยครั้ง เพื่อให้แอปพลิเคชัน NLP ทำงานสำหรับกรณีใช้งานจริง เราต้องคิดถึงการเตรียมและล้างข้อมูล เรื่องนี้ครอบคลุมไปด้วย ไปป์ไลน์การจัดทำดัชนีกองหญ้าแห้งซึ่งช่วยให้คุณออกแบบขั้นตอนการเตรียมข้อมูลของคุณเอง ซึ่งจะเขียนเอกสารของคุณลงในฐานข้อมูลที่คุณเลือกในท้ายที่สุด

ไปป์ไลน์การจัดทำดัชนีอาจมีขั้นตอนในการสร้างการฝังสำหรับเอกสารของคุณ นี่เป็นสิ่งสำคัญอย่างยิ่งสำหรับขั้นตอนการดึงข้อมูล ในตัวอย่างของเรา เราใช้ ประโยค-หม้อแปลง/all-MiniLM-L12-v2 เป็นโมเดลการฝังของเรา โมเดลนี้ใช้เพื่อสร้างการฝังสำหรับเอกสารที่จัดทำดัชนีทั้งหมดของเรา แต่ยังรวมถึงข้อความค้นหาของผู้ใช้ ณ เวลาที่ค้นหาด้วย

เพื่อจัดทำดัชนีเอกสารลงใน OpenSearchDocumentStoreเรามีสองตัวเลือกพร้อมคำแนะนำโดยละเอียดใน README ของที่เก็บตัวอย่าง ที่นี่ เราจะอธิบายขั้นตอนต่างๆ สำหรับการจัดทำดัชนีบริการ OpenSearch ที่ใช้งานบน AWS

เริ่มบริการ OpenSearch

ใช้ เทมเพลต CloudFormation เพื่อตั้งค่าบริการ OpenSearch บน AWS ด้วยการรันคำสั่งต่อไปนี้ คุณจะมีบริการ OpenSearch ที่ว่างเปล่า จากนั้นคุณสามารถเลือกที่จะทำดัชนีข้อมูลตัวอย่างที่เราให้ไว้ หรือใช้ข้อมูลของคุณเอง ซึ่งคุณสามารถล้างข้อมูลและประมวลผลล่วงหน้าได้โดยใช้ ท่อจัดทำดัชนีกองหญ้าแห้ง. โปรดทราบว่าการดำเนินการนี้จะสร้างอินสแตนซ์ที่เปิดอยู่บนอินเทอร์เน็ต ซึ่งไม่แนะนำให้ใช้ในการใช้งานจริง

ให้เวลาประมาณ 30 นาทีเพื่อให้การเปิดตัวสแต็กเสร็จสมบูรณ์ คุณสามารถตรวจสอบความคืบหน้าได้บนคอนโซล AWS CloudFormation โดยไปที่ สแต็ค หน้าและค้นหาสแต็กที่ชื่อ HaystackOpensearch.

จัดทำดัชนีเอกสารลงใน OpenSearch

ขณะนี้เรามีบริการ OpenSearch ที่ทำงานอยู่ เราสามารถใช้คลาส OpenSearchDocumentStore เพื่อเชื่อมต่อและเขียนเอกสารของเราลงไปได้

หากต้องการรับชื่อโฮสต์สำหรับ OpenSearch ให้รันคำสั่งต่อไปนี้:

ขั้นแรก ให้ส่งออกสิ่งต่อไปนี้:

จากนั้น คุณสามารถใช้ opensearch_indexing_pipeline.py สคริปต์เพื่อประมวลผลล่วงหน้าและจัดทำดัชนีข้อมูลสาธิตที่ให้มา

หากคุณต้องการใช้ข้อมูลของคุณเอง ให้แก้ไขไปป์ไลน์การจัดทำดัชนี opensearch_indexing_pipeline.py เพื่อรวมไฟล์ ตัวแปลงไฟล์ และ พรีโปรเซสเซอร์ ขั้นตอนการตั้งค่าที่คุณต้องการ

ใช้ไปป์ไลน์การตอบคำถามแบบเสริมการดึงข้อมูล

ตอนนี้เราได้จัดทำดัชนีข้อมูลใน OpenSearch แล้ว เราก็สามารถตอบคำถามในเอกสารเหล่านี้ได้ สำหรับไปป์ไลน์ RAG นี้ เราใช้โมเดลคำสั่ง Falcon-40b ที่เราปรับใช้บน SageMaker JumpStart

คุณยังมีตัวเลือกในการปรับใช้โมเดลโดยทางโปรแกรมจากสมุดบันทึก Jupyter สำหรับคำแนะนำ โปรดดูที่ repo GitHub.

- ค้นหาโมเดลคำสั่ง Falcon-40b บน SageMaker JumpStart

- ปรับใช้โมเดลของคุณบน SageMaker JumpStart และจดชื่อตำแหน่งข้อมูล

- ส่งออกค่าต่อไปนี้:

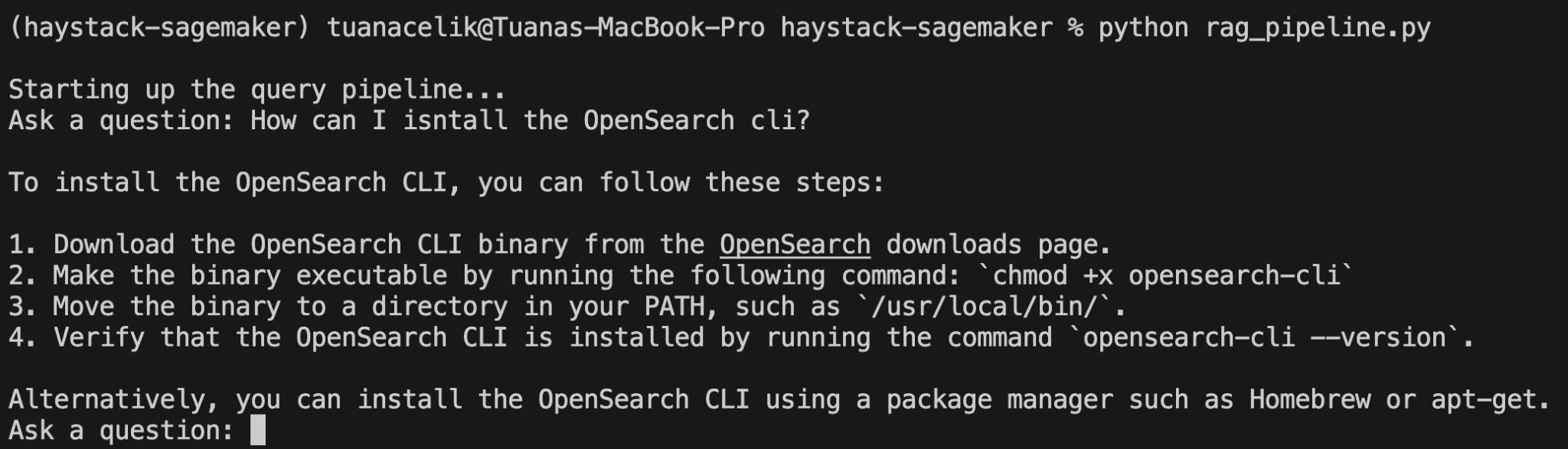

- วิ่ง

python rag_pipeline.py.

นี่จะเป็นการเริ่มยูทิลิตี้บรรทัดคำสั่งที่รอคำถามของผู้ใช้ ตัวอย่างเช่น ถามว่า "ฉันจะติดตั้ง OpenSearch cli ได้อย่างไร"

ผลลัพธ์นี้เกิดขึ้นได้เนื่องจากเราได้กำหนดพร้อมท์ของเราไว้ใน เทมเพลตพรอมต์กองหญ้าแห้ง ให้เป็นดังต่อไปนี้:

การปรับแต่งเพิ่มเติม

คุณสามารถปรับแต่งเพิ่มเติมให้กับองค์ประกอบต่างๆ ในโซลูชันได้ เช่น:

- ข้อมูล – เราได้จัดเตรียม OpenSearch เอกสาร และ เว็บไซต์ ข้อมูลเป็นข้อมูลตัวอย่าง อย่าลืมแก้ไข.

opensearch_indexing_pipeline.pyสคริปต์เพื่อให้เหมาะกับความต้องการของคุณหากคุณเลือกที่จะใช้ข้อมูลของคุณเอง - นางแบบ – ในตัวอย่างนี้ เราใช้โมเดลคำสั่ง Falcon-40b คุณมีอิสระในการปรับใช้และใช้โมเดล Hugging Face อื่นๆ บน SageMaker โปรดทราบว่าการเปลี่ยนโมเดลอาจหมายความว่าคุณควรปรับข้อความแจ้งของคุณให้เข้ากับสิ่งที่ออกแบบมาเพื่อรับมือ

- พรอมต์ – สำหรับโพสต์นี้เราสร้างของเราเอง

PromptTemplateที่สั่งให้โมเดลตอบคำถามตามบริบทที่ให้ไว้ และตอบว่า "ฉันไม่รู้" หากบริบทไม่มีข้อมูลที่เกี่ยวข้อง คุณสามารถเปลี่ยนพรอมต์นี้เพื่อทดลองกับพรอมต์อื่นกับ Falcon-40b-instruct คุณยังสามารถดึงคำแนะนำบางส่วนของเราจาก พร้อมท์ฮับ. - รูปแบบการฝัง – สำหรับขั้นตอนการดึงข้อมูล เราใช้โมเดลการฝังแบบน้ำหนักเบา: ประโยค-หม้อแปลง/all-MiniLM-L12-v2. อย่างไรก็ตาม คุณสามารถเปลี่ยนแปลงสิ่งนี้ได้ตามความต้องการของคุณ อย่าลืมแก้ไขมิติข้อมูลการฝังที่คาดหวังในตัวคุณ

DocumentStoreตาม - จำนวนเอกสารที่ได้รับ – คุณอาจเลือกที่จะเล่นกับจำนวนเอกสารที่คุณถาม

EmbeddingRetrieverเพื่อดึงข้อมูลสำหรับแต่ละแบบสอบถาม ในการตั้งค่าของเรา ตั้งค่านี้เป็น ท็อป_เค=5. คุณอาจทดลองเปลี่ยนตัวเลขนี้เพื่อดูว่าการให้บริบทเพิ่มเติมช่วยปรับปรุงความแม่นยำของผลลัพธ์ของคุณหรือไม่

ความพร้อมในการผลิต

โซลูชันที่นำเสนอในโพสต์นี้สามารถเร่งเวลาให้เกิดคุณค่าของกระบวนการพัฒนาโครงการได้ คุณสามารถสร้างโปรเจ็กต์ที่ปรับขนาดได้ง่ายด้วยสภาพแวดล้อมความปลอดภัยและความเป็นส่วนตัวบน AWS Cloud

เพื่อความปลอดภัยและความเป็นส่วนตัว OpenSearch Service ให้การปกป้องข้อมูลด้วย การระบุตัวตนและการจัดการการเข้าถึง และ การป้องกันพร็อกซีที่สับสนระหว่างบริการ. คุณสามารถใช้การควบคุมการเข้าถึงของผู้ใช้อย่างละเอียดเพื่อให้ผู้ใช้สามารถเข้าถึงเฉพาะข้อมูลที่พวกเขาได้รับอนุญาตให้เข้าถึงเท่านั้น นอกจากนี้ SageMaker ยังมีการตั้งค่าความปลอดภัยที่กำหนดค่าได้สำหรับ ควบคุมการเข้าถึง, การป้องกันข้อมูลและ การบันทึกและการตรวจสอบ. คุณสามารถปกป้องข้อมูลของคุณทั้งที่อยู่นิ่งและอยู่ระหว่างการส่งผ่านได้ บริการจัดการคีย์ AWS คีย์ (AWS KMS) คุณยังสามารถติดตามบันทึกของการปรับใช้โมเดล SageMaker หรือการเข้าถึงจุดสิ้นสุดได้โดยใช้ อเมซอน คลาวด์วอตช์. สำหรับข้อมูลเพิ่มเติม โปรดดูที่ ตรวจสอบ Amazon SageMaker ด้วย Amazon CloudWatch.

เพื่อความสามารถในการปรับขนาดที่สูงของ OpenSearch Service คุณสามารถปรับเปลี่ยนได้โดย ปรับขนาดโดเมน OpenSearch Service ของคุณ และการจ้างงาน แนวทางปฏิบัติที่ดีที่สุดในการปฏิบัติงาน. คุณยังสามารถใช้ประโยชน์จากการปรับขนาดตำแหน่งข้อมูล SageMaker ของคุณโดยอัตโนมัติได้อีกด้วย ปรับขนาดโมเดล SageMaker โดยอัตโนมัติ เพื่อปรับปลายทางทั้งเมื่อมีการเพิ่มการรับส่งข้อมูลหรือไม่ได้ใช้ทรัพยากร

ทำความสะอาด

เพื่อประหยัดค่าใช้จ่าย ให้ลบทรัพยากรทั้งหมดที่คุณปรับใช้เป็นส่วนหนึ่งของโพสต์นี้ หากคุณเปิดใช้สแต็ก CloudFormation คุณสามารถลบได้ผ่านคอนโซล AWS CloudFormation ในทำนองเดียวกัน คุณสามารถลบตำแหน่งข้อมูล SageMaker ใดๆ ที่คุณอาจสร้างผ่านคอนโซล SageMaker ได้

สรุป

ในโพสต์นี้ เราได้จัดแสดงวิธีสร้างแอปพลิเคชัน AI ที่สร้างตั้งแต่ต้นทางถึงปลายทางสำหรับการค้นหาระดับองค์กรด้วย RAG โดยใช้ไปป์ไลน์ Haystack และโมเดลคำสั่ง Falcon-40b จาก SageMaker JumpStart และ OpenSearch Service แนวทาง RAG มีความสำคัญอย่างยิ่งในการค้นหาระดับองค์กร เนื่องจากช่วยให้แน่ใจว่าการตอบสนองที่สร้างขึ้นนั้นอยู่ในโดเมน และช่วยบรรเทาอาการประสาทหลอนได้ ด้วยการใช้ไปป์ไลน์ Haystack เราจึงสามารถประสานแอปพลิเคชัน LLM ซึ่งประกอบด้วยส่วนประกอบต่างๆ เช่น โมเดลและฐานข้อมูลเวกเตอร์ SageMaker JumpStart มอบโซลูชันแบบคลิกเดียวสำหรับการปรับใช้ LLM และเราใช้ OpenSearch Service เป็นฐานข้อมูลเวกเตอร์สำหรับข้อมูลที่จัดทำดัชนีของเรา คุณสามารถเริ่มการทดลองและสร้างการพิสูจน์แนวคิด RAG สำหรับแอปพลิเคชัน AI ที่สร้างสำหรับองค์กรของคุณ โดยใช้ขั้นตอนที่อธิบายไว้ในโพสต์นี้และซอร์สโค้ดที่มีอยู่ใน พื้นที่เก็บข้อมูล GitHub.

เกี่ยวกับผู้เขียน

ทัวน่า เซลิค เป็นหัวหน้าผู้สนับสนุนนักพัฒนาที่ deepset ซึ่งเธอมุ่งเน้นไปที่ชุมชนโอเพ่นซอร์สสำหรับ Haystack เธอเป็นผู้นำฝ่ายนักพัฒนาสัมพันธ์และพูดในกิจกรรมเกี่ยวกับ NLP เป็นประจำ และสร้างสื่อการเรียนรู้สำหรับชุมชน

ทัวน่า เซลิค เป็นหัวหน้าผู้สนับสนุนนักพัฒนาที่ deepset ซึ่งเธอมุ่งเน้นไปที่ชุมชนโอเพ่นซอร์สสำหรับ Haystack เธอเป็นผู้นำฝ่ายนักพัฒนาสัมพันธ์และพูดในกิจกรรมเกี่ยวกับ NLP เป็นประจำ และสร้างสื่อการเรียนรู้สำหรับชุมชน

รอย อัลเลล่า เป็นสถาปนิกโซลูชันผู้เชี่ยวชาญด้าน AI/ML อาวุโสที่ AWS ในเมืองมิวนิก ประเทศเยอรมนี Roy ช่วยให้ลูกค้า AWS ตั้งแต่สตาร์ทอัพขนาดเล็กไปจนถึงองค์กรขนาดใหญ่ ฝึกอบรมและปรับใช้โมเดลภาษาขนาดใหญ่บน AWS ได้อย่างมีประสิทธิภาพ Roy มีความหลงใหลเกี่ยวกับปัญหาการเพิ่มประสิทธิภาพการคำนวณและปรับปรุงประสิทธิภาพของปริมาณงาน AI

รอย อัลเลล่า เป็นสถาปนิกโซลูชันผู้เชี่ยวชาญด้าน AI/ML อาวุโสที่ AWS ในเมืองมิวนิก ประเทศเยอรมนี Roy ช่วยให้ลูกค้า AWS ตั้งแต่สตาร์ทอัพขนาดเล็กไปจนถึงองค์กรขนาดใหญ่ ฝึกอบรมและปรับใช้โมเดลภาษาขนาดใหญ่บน AWS ได้อย่างมีประสิทธิภาพ Roy มีความหลงใหลเกี่ยวกับปัญหาการเพิ่มประสิทธิภาพการคำนวณและปรับปรุงประสิทธิภาพของปริมาณงาน AI

มีอาช้าง เป็นสถาปนิกโซลูชันผู้เชี่ยวชาญ ML สำหรับ Amazon Web Services เธอทำงานร่วมกับลูกค้าใน EMEA และแบ่งปันแนวทางปฏิบัติที่ดีที่สุดในการรันปริมาณงาน AI/ML บนคลาวด์พร้อมพื้นฐานด้านคณิตศาสตร์ประยุกต์ วิทยาการคอมพิวเตอร์ และ AI/ML เธอมุ่งเน้นไปที่ปริมาณงานเฉพาะของ NLP และแบ่งปันประสบการณ์ของเธอในฐานะวิทยากรในการประชุมและผู้แต่งหนังสือ ในเวลาว่าง เธอชอบเดินป่า เล่นบอร์ดเกม และชงกาแฟ

มีอาช้าง เป็นสถาปนิกโซลูชันผู้เชี่ยวชาญ ML สำหรับ Amazon Web Services เธอทำงานร่วมกับลูกค้าใน EMEA และแบ่งปันแนวทางปฏิบัติที่ดีที่สุดในการรันปริมาณงาน AI/ML บนคลาวด์พร้อมพื้นฐานด้านคณิตศาสตร์ประยุกต์ วิทยาการคอมพิวเตอร์ และ AI/ML เธอมุ่งเน้นไปที่ปริมาณงานเฉพาะของ NLP และแบ่งปันประสบการณ์ของเธอในฐานะวิทยากรในการประชุมและผู้แต่งหนังสือ ในเวลาว่าง เธอชอบเดินป่า เล่นบอร์ดเกม และชงกาแฟ

อินาอัม ไซด เป็นสถาปนิกโซลูชันสตาร์ทอัพที่ AWS โดยมุ่งเน้นที่การช่วยเหลือสตาร์ทอัพ B2B และ SaaS ในการปรับขนาดและบรรลุการเติบโต เขามีความหลงใหลอย่างลึกซึ้งต่อสถาปัตยกรรมแบบไร้เซิร์ฟเวอร์และ AI/ML ในเวลาว่าง Inaam สนุกกับช่วงเวลาดีๆ กับครอบครัว และหลงใหลในการขี่จักรยานและแบดมินตัน

อินาอัม ไซด เป็นสถาปนิกโซลูชันสตาร์ทอัพที่ AWS โดยมุ่งเน้นที่การช่วยเหลือสตาร์ทอัพ B2B และ SaaS ในการปรับขนาดและบรรลุการเติบโต เขามีความหลงใหลอย่างลึกซึ้งต่อสถาปัตยกรรมแบบไร้เซิร์ฟเวอร์และ AI/ML ในเวลาว่าง Inaam สนุกกับช่วงเวลาดีๆ กับครอบครัว และหลงใหลในการขี่จักรยานและแบดมินตัน

เดวิด ทิปเพตต์ เป็น Senior Developer Advocate ที่ทำงานเกี่ยวกับ OpenSearch แบบโอเพ่นซอร์สที่ AWS งานของเขาเกี่ยวข้องกับทุกด้านของ OpenSearch ตั้งแต่การค้นหาและความเกี่ยวข้องไปจนถึงความสามารถในการสังเกตและการวิเคราะห์ความปลอดภัย

เดวิด ทิปเพตต์ เป็น Senior Developer Advocate ที่ทำงานเกี่ยวกับ OpenSearch แบบโอเพ่นซอร์สที่ AWS งานของเขาเกี่ยวข้องกับทุกด้านของ OpenSearch ตั้งแต่การค้นหาและความเกี่ยวข้องไปจนถึงความสามารถในการสังเกตและการวิเคราะห์ความปลอดภัย

- เนื้อหาที่ขับเคลื่อนด้วย SEO และการเผยแพร่ประชาสัมพันธ์ รับการขยายวันนี้

- PlatoData.Network Vertical Generative Ai เพิ่มพลังให้กับตัวเอง เข้าถึงได้ที่นี่.

- เพลโตไอสตรีม. Web3 อัจฉริยะ ขยายความรู้ เข้าถึงได้ที่นี่.

- เพลโตESG. ยานยนต์ / EVs, คาร์บอน, คลีนเทค, พลังงาน, สิ่งแวดล้อม แสงอาทิตย์, การจัดการของเสีย. เข้าถึงได้ที่นี่.

- เพลโตสุขภาพ เทคโนโลยีชีวภาพและข่าวกรองการทดลองทางคลินิก เข้าถึงได้ที่นี่.

- ChartPrime. ยกระดับเกมการซื้อขายของคุณด้วย ChartPrime เข้าถึงได้ที่นี่.

- BlockOffsets การปรับปรุงการเป็นเจ้าของออฟเซ็ตด้านสิ่งแวดล้อมให้ทันสมัย เข้าถึงได้ที่นี่.

- ที่มา: https://aws.amazon.com/blogs/machine-learning/build-production-ready-generative-ai-applications-for-enterprise-search-using-haystack-pipelines-and-amazon-sagemaker-jumpstart-with-llms/

- :มี

- :เป็น

- :ไม่

- :ที่ไหน

- $ ขึ้น

- 100

- 12

- 13

- 30

- 500

- 7

- 8

- a

- สามารถ

- เกี่ยวกับเรา

- เร่งความเร็ว

- เข้า

- บรรลุผล

- ตาม

- ลงชื่อเข้าใช้

- ความถูกต้อง

- บรรลุ

- ประสบความสำเร็จ

- การบรรลุ

- การกระทำ

- ปรับ

- เพิ่มเติม

- นอกจากนี้

- การบริหาร

- ความได้เปรียบ

- การกำเนิด

- ผู้สนับสนุน

- AI

- AI / ML

- ทั้งหมด

- อนุญาต

- ช่วยให้

- ตาม

- ด้วย

- แม้ว่า

- อเมซอน

- อเมซอน SageMaker

- Amazon SageMaker JumpStart

- Amazon Web Services

- ในหมู่

- an

- การวิเคราะห์

- และ

- คำตอบ

- ใด

- อาปาเช่

- การใช้งาน

- การใช้งาน

- ประยุกต์

- เข้าใกล้

- ประมาณ

- เป็น

- พื้นที่

- รอบ

- แถว

- ศิลปะ

- บทความ

- AS

- การให้ความช่วยเหลือ

- At

- เสียง

- เติม

- ผู้เขียน

- มีอำนาจ

- รถยนต์

- ใช้ได้

- AWS

- การก่อตัวของ AWS Cloud

- B2B

- พื้นหลัง

- ฐาน

- ตาม

- BE

- เพราะ

- กลายเป็น

- ก่อน

- กำลัง

- ด้านล่าง

- ที่ดีที่สุด

- ปฏิบัติที่ดีที่สุด

- ใหญ่

- บล็อก

- คณะกรรมการ

- เกมกระดาน

- ร่างกาย

- หนังสือ

- ทั้งสอง

- กว้าง

- สร้าง

- การก่อสร้าง

- สร้าง

- การรวมกลุ่ม

- แต่

- ปุ่ม

- by

- ที่เรียกว่า

- CAN

- ความสามารถในการ

- กรณี

- เปลี่ยนแปลง

- เปลี่ยนแปลง

- ตรวจสอบ

- ทางเลือก

- Choose

- เลือก

- เลือก

- ชั้น

- การทำความสะอาด

- ใกล้ชิด

- เมฆ

- รหัส

- กาแฟ

- ร่วมกัน

- ชุมชน

- บริษัท

- ส่วนประกอบ

- สมบูรณ์

- ส่วนประกอบ

- ส่วนประกอบ

- ประกอบด้วย

- คอมพิวเตอร์

- วิทยาการคอมพิวเตอร์

- แนวคิด

- การประชุม

- สับสน

- เชื่อมต่อ

- พิจารณา

- ปลอบใจ

- ที่มีอยู่

- เนื้อหา

- สิ่งแวดล้อม

- ควบคุม

- การสนทนา

- AI สนทนา

- ค่าใช้จ่าย

- ปกคลุม

- ครอบคลุม

- สร้าง

- ที่สร้างขึ้น

- สร้าง

- วิกฤติ

- ลูกค้า

- ข้อมูล

- การเตรียมข้อมูล

- การป้องกันข้อมูล

- ฐานข้อมูล

- ฐานข้อมูล

- ดีบีเอส

- จัดการ

- ลึก

- การเรียนรู้ลึก ๆ

- กำหนด

- สาธิต

- การอ้างอิง

- ปรับใช้

- นำไปใช้

- ปรับใช้

- การใช้งาน

- ออกแบบ

- ได้รับการออกแบบ

- การออกแบบ

- รายละเอียด

- พัฒนา

- ผู้พัฒนา

- นักพัฒนา

- พัฒนาการ

- ต่าง

- ดิจิตอล

- แปลง

- มิติ

- โดยตรง

- do

- เอกสาร

- เอกสาร

- เอกสาร

- ทำ

- ไม่

- สวม

- Dont

- แต่ละ

- ง่าย

- อย่างมีประสิทธิภาพ

- ที่มีประสิทธิภาพ

- อย่างมีประสิทธิภาพ

- ทั้ง

- องค์ประกอบ

- ฝัง

- ที่ฝัง

- การฝัง

- EMEA

- ทำให้สามารถ

- ปลาย

- จบสิ้น

- ปลายทาง

- เครื่องยนต์

- เสริม

- ทำให้มั่นใจ

- เพื่อให้แน่ใจ

- Enterprise

- หน่วยงาน

- เอกลักษณ์

- สิ่งแวดล้อม

- การประเมินผล

- เหตุการณ์

- ทุกอย่าง

- ตัวอย่าง

- ที่คาดหวัง

- ประสบการณ์

- ประสบการณ์

- การทดลอง

- ส่งออก

- ภายนอก

- ใบหน้า

- ครอบครัว

- รูป

- เนื้อไม่มีมัน

- ไฟล์

- กรอง

- สุดท้าย

- ชื่อจริง

- พอดี

- มีความยืดหยุ่น

- อย่างยืดหยุ่น

- โฟกัส

- มุ่งเน้นไปที่

- ดังต่อไปนี้

- สำหรับ

- รูป

- รากฐาน

- กรอบ

- ฟรี

- ราคาเริ่มต้นที่

- อย่างเต็มที่

- ฟังก์ชัน

- เกม

- สร้าง

- สร้าง

- สร้าง

- รุ่น

- กำเนิด

- กำเนิด AI

- ประเทศเยอรมัน

- ได้รับ

- กำหนด

- บัญชีกลุ่ม

- การเจริญเติบโต

- จัดการ

- มี

- มี

- he

- จะช่วยให้

- เธอ

- โปรดคลิกที่นี่เพื่ออ่านรายละเอียดเพิ่มเติม

- จุดสูง

- ระดับสูง

- อย่างสูง

- ของเขา

- เจ้าภาพ

- สรุป ความน่าเชื่อถือของ Olymp Trade?

- ทำอย่างไร

- อย่างไรก็ตาม

- HTML

- ที่ http

- HTTPS

- Hub

- i

- เอกลักษณ์

- if

- ส่งผลกระทบ

- การดำเนินการ

- สำคัญ

- การปรับปรุง

- in

- ประกอบด้วย

- รวมถึง

- รวมทั้ง

- เพิ่มขึ้น

- ขึ้น

- ดัชนี

- การจัดทำดัชนี

- ดัชนี

- ข้อมูล

- โครงสร้างพื้นฐาน

- อินพุต

- ติดตั้ง

- ตัวอย่าง

- คำแนะนำการใช้

- อินเทอร์เน็ต

- เข้าไป

- IT

- ITS

- jpg

- คีย์

- กุญแจ

- ทราบ

- ความรู้

- การจัดการความรู้

- ภาษา

- ใหญ่

- เปิดตัว

- เปิดตัว

- นำ

- นำไปสู่

- การเรียนรู้

- License

- ได้รับใบอนุญาต

- มีน้ำหนักเบา

- กดไลก์

- น่าจะ

- LIMIT

- ข้อ จำกัด

- Line

- LLM

- เข้าสู่ระบบ

- การเข้าสู่ระบบ

- ที่ต้องการหา

- ความรัก

- เครื่อง

- เรียนรู้เครื่อง

- ทำ

- ทำ

- ทำให้

- การทำ

- จัดการ

- การจัดการ

- การจัดการ

- วัสดุ

- คณิตศาสตร์

- สูงสุด

- อาจ..

- หมายความ

- ภาพบรรยากาศ

- วิธีการ

- ตัวชี้วัด

- ล้าน

- นาที

- ซึ่งบรรเทา

- ML

- แบบ

- โมเดล

- แก้ไข

- โมดูล

- Moments

- การตรวจสอบ

- ข้อมูลเพิ่มเติม

- มากที่สุด

- ย้าย

- ชื่อ

- ที่มีชื่อ

- โดยธรรมชาติ

- ประมวลผลภาษาธรรมชาติ

- การนำทาง

- จำเป็นต้อง

- ความต้องการ

- NLP

- สมุดบันทึก

- จำนวน

- of

- เสนอ

- เสนอ

- on

- เพียง

- เปิด

- โอเพนซอร์ส

- ซอฟต์แวร์โอเพนซอร์ส

- ทำงาน

- การเพิ่มประสิทธิภาพ

- ตัวเลือกเสริม (Option)

- Options

- or

- องค์กร

- Organized

- เป็นต้นฉบับ

- อื่นๆ

- ของเรา

- ที่ระบุไว้

- เกิน

- ของตนเอง

- แพ็คเกจ

- หน้า

- หน้า

- ส่วนหนึ่ง

- พาร์ทเนอร์

- กิเลส

- หลงใหล

- ดำเนินการ

- การปฏิบัติ

- ท่อ

- เพลโต

- เพลโตดาต้าอินเทลลิเจนซ์

- เพลโตดาต้า

- เล่น

- กรุณา

- จุด

- ยอดนิยม

- โพสต์

- ที่มีประสิทธิภาพ

- การปฏิบัติ

- การจัดเตรียม

- เตรียมการ

- ความเป็นส่วนตัว

- ปัญหาที่เกิดขึ้น

- กระบวนการ

- การประมวลผล

- การผลิต

- ความคืบหน้า

- โครงการ

- พิสูจน์

- เสนอ

- เป็นเจ้าของ

- ป้องกัน

- การป้องกัน

- ต้นแบบ

- ให้

- ให้

- ให้

- การให้

- หนังสือมอบฉันทะ

- สาธารณะ

- ผลัก

- คุณภาพ

- คำสั่ง

- คำถาม

- คำถาม

- ดิบ

- ที่ได้รับ

- เมื่อเร็ว ๆ นี้

- แนะนำ

- แนะนำ

- สม่ำเสมอ

- ความสัมพันธ์

- ความสัมพันธ์กัน

- ตรงประเด็น

- น่าเชื่อถือ

- จำ

- กรุ

- ขอ

- ต้องการ

- จำเป็นต้องใช้

- ความต้องการ

- แหล่งข้อมูล

- คำตอบ

- การตอบสนอง

- REST

- จำกัด

- ผล

- ผลสอบ

- รับคืน

- รวย

- ขวา

- รอย

- วิ่ง

- วิ่ง

- SaaS

- sagemaker

- ลด

- กล่าว

- scalability

- ที่ปรับขนาดได้

- ขนาด

- ปรับ

- วิทยาศาสตร์

- ค้นหา

- ความปลอดภัย

- เห็น

- ส่ง

- ส่ง

- ระดับอาวุโส

- serverless

- ให้บริการอาหาร

- บริการ

- บริการ

- ชุด

- การตั้งค่า

- การติดตั้ง

- รูปร่าง

- หุ้น

- เธอ

- เรือ

- น่า

- โชว์

- แสดง

- จัดแสดง

- ลงนาม

- คล้ายคลึงกัน

- เหมือนกับ

- ง่าย

- ง่ายดาย

- เล็ก

- So

- ซอฟต์แวร์

- เพียงผู้เดียว

- ของแข็ง

- ทางออก

- โซลูชัน

- บาง

- บางสิ่งบางอย่าง

- แหล่ง

- รหัสแหล่งที่มา

- ช่องว่าง

- ลำโพง

- พูด

- ผู้เชี่ยวชาญ

- เฉพาะ

- Stability

- กอง

- ระยะ

- เริ่มต้น

- การเริ่มต้น

- startups

- ขั้นตอน

- ขั้นตอน

- การเก็บรักษา

- แข็งแรง

- โครงสร้าง

- อย่างเช่น

- ชุด

- แน่ใจ

- เอา

- ใช้เวลา

- เทคนิค

- แม่แบบ

- การทดสอบ

- ที่

- พื้นที่

- ที่มา

- พวกเขา

- แล้วก็

- ดังนั้น

- ดังนั้น

- ล้อยางขัดเหล่านี้ติดตั้งบนแกน XNUMX (มม.) ผลิตภัณฑ์นี้ถูกผลิตในหลายรูปทรง และหลากหลายเบอร์ความแน่นหนาของปริมาณอนุภาคขัดของมัน จะทำให้ท่านได้รับประสิทธิภาพสูงในการขัดและการใช้งานที่ยาวนาน

- พวกเขา

- สิ่ง

- คิด

- นี้

- พัน

- ตลอด

- เวลา

- ไปยัง

- ร่วมกัน

- ลู่

- การจราจร

- การขนส่ง

- เชื่อถือได้

- สอง

- ชนิด

- เป็นปกติ

- ในที่สุด

- ภายใต้

- อัปโหลด

- us

- ใช้

- มือสอง

- ผู้ใช้งาน

- ผู้ใช้

- ใช้

- การใช้

- ประโยชน์

- ความคุ้มค่า

- ความคุ้มค่า

- ต่างๆ

- ผ่านทาง

- วิสัยทัศน์

- รอ

- we

- เว็บ

- บริการเว็บ

- Website

- เมื่อ

- ที่

- จะ

- กับ

- ภายใน

- คำ

- งาน

- เวิร์กโฟลว์

- การทำงาน

- โรงงาน

- จะ

- เขียน

- มันแกว

- ปี

- คุณ

- ของคุณ

- ลมทะเล