ลูกค้าด้านการดูแลสุขภาพและวิทยาศาสตร์ชีวภาพ (HCLS) กำลังนำ AI เชิงสร้างสรรค์มาเป็นเครื่องมือในการรับประโยชน์จากข้อมูลของตนมากขึ้น กรณีการใช้งานรวมถึงการสรุปเอกสารเพื่อช่วยให้ผู้อ่านมุ่งเน้นไปที่ประเด็นสำคัญของเอกสารและการแปลงข้อความที่ไม่มีโครงสร้างให้เป็นรูปแบบมาตรฐานเพื่อเน้นคุณลักษณะที่สำคัญ ด้วยรูปแบบข้อมูลที่เป็นเอกลักษณ์และข้อกำหนดด้านกฎระเบียบที่เข้มงวด ลูกค้าจึงมองหาตัวเลือกในการเลือกโมเดลที่มีประสิทธิภาพและคุ้มค่าที่สุด รวมถึงความสามารถในการดำเนินการปรับแต่งที่จำเป็น (การปรับแต่ง) ให้เหมาะสมกับกรณีการใช้งานทางธุรกิจของตน ในโพสต์นี้ เราจะแนะนำคุณตลอดขั้นตอนการปรับใช้ Falcon large language model (LLM) โดยใช้ Amazon SageMaker JumpStart และใช้โมเดลสรุปเอกสารขนาดยาวด้วย LangChain และ Python

ภาพรวมโซลูชัน

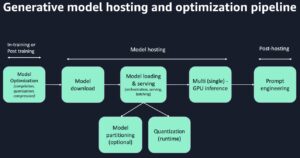

อเมซอน SageMaker สร้างขึ้นจากประสบการณ์สองทศวรรษของ Amazon ในการพัฒนาแอปพลิเคชัน ML ในโลกแห่งความเป็นจริง รวมถึงคำแนะนำผลิตภัณฑ์ การปรับเปลี่ยนในแบบของคุณ การช็อปปิ้งอัจฉริยะ หุ่นยนต์ และอุปกรณ์สั่งงานด้วยเสียง SageMaker เป็นบริการที่ได้รับการจัดการที่เข้าเกณฑ์ HIPAA ซึ่งมอบเครื่องมือที่ช่วยให้นักวิทยาศาสตร์ข้อมูล วิศวกร ML และนักวิเคราะห์ธุรกิจสามารถสร้างสรรค์นวัตกรรมด้วย ML ภายใน SageMaker คือ สตูดิโอ Amazon SageMakerซึ่งเป็นสภาพแวดล้อมการพัฒนาแบบผสานรวม (IDE) ที่สร้างขึ้นโดยมีจุดประสงค์สำหรับเวิร์กโฟลว์ ML ที่ทำงานร่วมกัน ซึ่งในทางกลับกันก็ประกอบด้วยโซลูชันการเริ่มต้นอย่างรวดเร็วที่หลากหลายและโมเดล ML ที่ได้รับการฝึกอบรมล่วงหน้าในฮับแบบรวมที่เรียกว่า SageMaker JumpStart ด้วย SageMaker JumpStart คุณสามารถใช้โมเดลที่ได้รับการฝึกอบรมล่วงหน้า เช่น Falcon LLM พร้อมด้วยสมุดบันทึกตัวอย่างที่สร้างไว้ล่วงหน้าและการสนับสนุน SDK เพื่อทดลองและปรับใช้โมเดลหม้อแปลงอันทรงพลังเหล่านี้ คุณสามารถใช้ SageMaker Studio และ SageMaker JumpStart เพื่อปรับใช้และสืบค้นโมเดลกำเนิดของคุณเองในบัญชี AWS ของคุณ

คุณยังมั่นใจได้ว่าข้อมูลเพย์โหลดการอนุมานจะไม่ออกจาก VPC ของคุณอีกด้วย คุณสามารถจัดเตรียมโมเดลเป็นจุดสิ้นสุดของผู้เช่ารายเดียวและปรับใช้โมเดลเหล่านั้นด้วยการแยกเครือข่าย นอกจากนี้ คุณยังสามารถดูแลและจัดการชุดรูปแบบที่เลือกซึ่งตรงตามข้อกำหนดด้านความปลอดภัยของคุณเองได้โดยใช้ความสามารถของฮับโมเดลส่วนตัวภายใน SageMaker JumpStart และจัดเก็บโมเดลที่ได้รับอนุมัติไว้ในนั้น SageMaker อยู่ในขอบเขตของ ฮิปา บาเอ, สค123และ ฮิตทรัสต์ ซีเอสเอฟ.

พื้นที่ ฟอลคอน แอลแอลเอ็ม เป็นโมเดลภาษาขนาดใหญ่ที่ได้รับการฝึกอบรมโดยนักวิจัยที่ Technology Innovation Institute (TII) บนโทเค็นมากกว่า 1 ล้านล้านโทเค็นโดยใช้ AWS Falcon มีรูปแบบต่างๆ มากมาย โดยมีองค์ประกอบหลักสองประการคือ Falcon 40B และ Falcon 7B ประกอบด้วยพารามิเตอร์ 40 พันล้านและ 7 พันล้านตามลำดับ โดยมีเวอร์ชันที่ได้รับการปรับแต่งอย่างละเอียดซึ่งได้รับการฝึกฝนสำหรับงานเฉพาะ เช่น คำแนะนำต่อไปนี้ Falcon ทำงานได้ดีในงานที่หลากหลาย รวมถึงการสรุปข้อความ การวิเคราะห์ความรู้สึก การตอบคำถาม และการสนทนา โพสต์นี้ให้คำแนะนำที่คุณสามารถปฏิบัติตามเพื่อปรับใช้ Falcon LLM ในบัญชี AWS ของคุณ โดยใช้อินสแตนซ์สมุดบันทึกที่ได้รับการจัดการผ่าน SageMaker JumpStart เพื่อทดลองกับการสรุปข้อความ

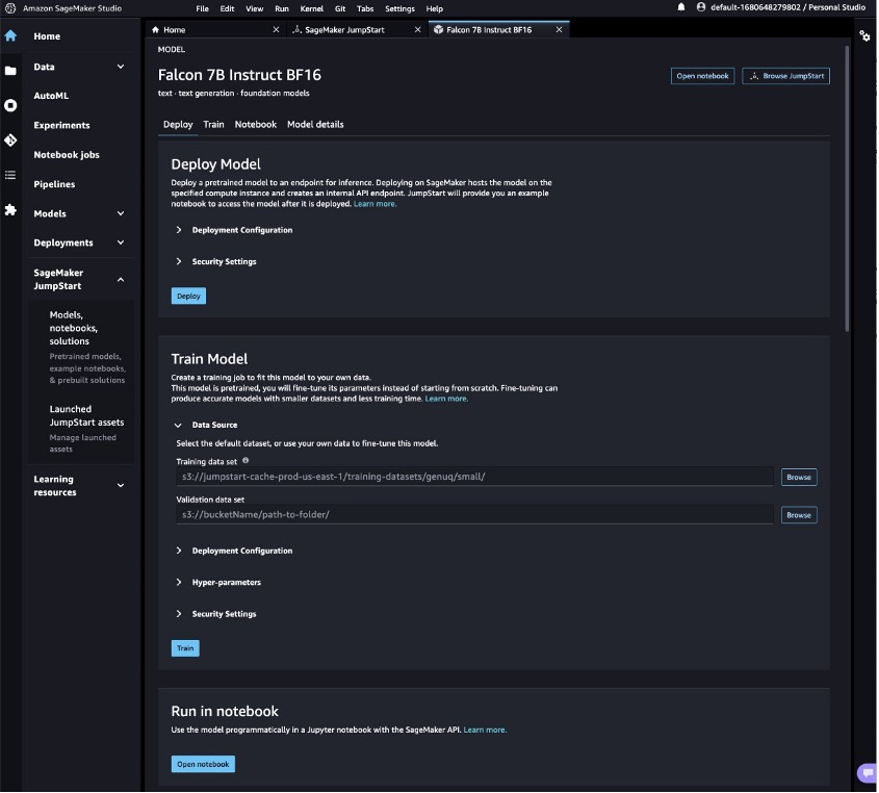

ฮับโมเดล SageMaker JumpStart มีสมุดบันทึกที่สมบูรณ์เพื่อปรับใช้และสืบค้นแต่ละรุ่น ในขณะที่เขียนบทความนี้ มี Falcon ให้เลือกใช้งานหกเวอร์ชันในฮับโมเดล SageMaker JumpStart: Falcon 40B Instruct BF16, Falcon 40B BF16, Falcon 180B BF16, Falcon 180B Chat BF16, Falcon 7B Instruct BF16 และ Falcon 7B BF16 โพสต์นี้ใช้โมเดล Falcon 7B Instruct

ในส่วนต่อไปนี้ เราจะแสดงวิธีเริ่มต้นการสรุปเอกสารโดยการปรับใช้ Falcon 7B บน SageMaker Jumpstart

เบื้องต้น

สำหรับบทช่วยสอนนี้ คุณจะต้องมีบัญชี AWS พร้อมโดเมน SageMaker หากคุณยังไม่มีโดเมน SageMaker โปรดดูที่ ออนบอร์ดไปยังโดเมน Amazon SageMaker เพื่อสร้าง

ปรับใช้ Falcon 7B โดยใช้ SageMaker JumpStart

ในการปรับใช้โมเดลของคุณ ให้ทำตามขั้นตอนต่อไปนี้:

- นำทางไปยังสภาพแวดล้อม SageMaker Studio ของคุณจากคอนโซล SageMaker

- ภายใน IDE ภายใต้ SageMaker JumpStart ในบานหน้าต่างนำทาง ให้เลือก โมเดล โน๊ตบุ๊ค โซลูชั่น.

- ปรับใช้โมเดลคำสั่ง Falcon 7B ไปยังตำแหน่งข้อมูลเพื่อการอนุมาน

ซึ่งจะเป็นการเปิดการ์ดโมเดลสำหรับรุ่น Falcon 7B Instruct BF16 ในหน้านี้คุณจะพบกับ ปรับใช้ or รถไฟ ตัวเลือกรวมถึงลิงก์สำหรับเปิดสมุดบันทึกตัวอย่างใน SageMaker Studio โพสต์นี้จะใช้สมุดบันทึกตัวอย่างจาก SageMaker JumpStart เพื่อปรับใช้โมเดล

- Choose เปิดสมุดบันทึก.

- เรียกใช้สี่เซลล์แรกของโน้ตบุ๊กเพื่อปรับใช้ตำแหน่งข้อมูลคำสั่ง Falcon 7B

คุณสามารถดูโมเดล JumpStart ที่ปรับใช้ของคุณได้ที่ เปิดตัวเนื้อหา JumpStart หน้า.

- ในบานหน้าต่างนำทาง ภายใต้ SageMaker เริ่มต้นอย่างรวดเร็วเลือก เปิดตัวเนื้อหา JumpStart.

- เลือก จุดสิ้นสุดของโมเดล แท็บเพื่อดูสถานะของตำแหน่งข้อมูลของคุณ

เมื่อใช้งานตำแหน่งข้อมูล Falcon LLM คุณก็พร้อมที่จะสืบค้นโมเดลแล้ว

เรียกใช้แบบสอบถามแรกของคุณ

หากต้องการเรียกใช้แบบสอบถาม ให้ทำตามขั้นตอนต่อไปนี้:

- เกี่ยวกับ เนื้อไม่มีมัน เมนูให้เลือก ใหม่ และ สมุดบันทึก เพื่อเปิดสมุดบันทึกใหม่

คุณยังสามารถดาวน์โหลดสมุดบันทึกที่ทำเสร็จแล้วได้ด้วย โปรดคลิกที่นี่เพื่ออ่านรายละเอียดเพิ่มเติม.

- เลือกรูปภาพ เคอร์เนล และประเภทอินสแตนซ์เมื่อได้รับแจ้ง สำหรับโพสต์นี้ เราเลือกอิมเมจ Data Science 3.0, Python 3 kernel และอินสแตนซ์ ml.t3.medium

- นำเข้าโมดูล Boto3 และ JSON โดยป้อนสองบรรทัดต่อไปนี้ลงในเซลล์แรก:

- ข่าวประชา Shift + Enter เพื่อเรียกใช้เซลล์

- ถัดไป คุณสามารถกำหนดฟังก์ชันที่จะเรียกตำแหน่งข้อมูลของคุณได้ ฟังก์ชันนี้รับเพย์โหลดพจนานุกรมและใช้เพื่อเรียกใช้ไคลเอ็นต์รันไทม์ของ SageMaker จากนั้นจะดีซีเรียลไลซ์การตอบสนองและพิมพ์อินพุตและข้อความที่สร้างขึ้น

เพย์โหลดจะรวมพรอมต์เป็นอินพุต พร้อมด้วยพารามิเตอร์อนุมานที่จะถูกส่งไปยังโมเดล

- คุณสามารถใช้พารามิเตอร์เหล่านี้พร้อมกับข้อความแจ้งเพื่อปรับแต่งเอาต์พุตของโมเดลสำหรับกรณีการใช้งานของคุณ:

แบบสอบถามพร้อมข้อความสรุป

โพสต์นี้ใช้ตัวอย่างงานวิจัยเพื่อสาธิตการสรุป ไฟล์ข้อความตัวอย่างเกี่ยวข้องกับการสรุปข้อความอัตโนมัติในวรรณกรรมชีวการแพทย์ ทำตามขั้นตอนต่อไปนี้:

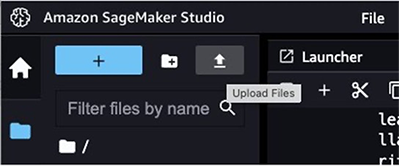

- ดาวน์โหลด PDF และคัดลอกข้อความลงในไฟล์ชื่อ

document.txt. - ใน SageMaker Studio ให้เลือกไอคอนอัปโหลดและอัปโหลดไฟล์ไปยังอินสแตนซ์ SageMaker Studio ของคุณ

เมื่อแกะกล่อง Falcon LLM ให้การสนับสนุนการสรุปข้อความ

- เรามาสร้างฟังก์ชันที่ใช้เทคนิคทางวิศวกรรมที่รวดเร็วในการสรุปกันดีกว่า

document.txt:

คุณจะสังเกตเห็นว่าสำหรับเอกสารที่ยาวกว่านี้ จะมีข้อผิดพลาดปรากฏขึ้น—Falcon ควบคู่ไปกับ LLM อื่นๆ ทั้งหมด มีการจำกัดจำนวนโทเค็นที่ส่งเป็นอินพุต เราสามารถข้ามขีดจำกัดนี้ได้โดยใช้ความสามารถในการสรุปที่ได้รับการปรับปรุงของ LangChain ซึ่งช่วยให้สามารถส่งอินพุตที่ใหญ่กว่ามากไปยัง LLM ได้

นำเข้าและรันห่วงโซ่การสรุป

LangChain เป็นไลบรารีซอฟต์แวร์โอเพ่นซอร์สที่ช่วยให้นักพัฒนาและนักวิทยาศาสตร์ข้อมูลสามารถสร้าง ปรับแต่ง และปรับใช้แอปพลิเคชัน generative ที่กำหนดเองได้อย่างรวดเร็ว โดยไม่ต้องจัดการการโต้ตอบ ML ที่ซับซ้อน ซึ่งมักใช้เพื่อสรุปกรณีการใช้งานทั่วไปจำนวนมากสำหรับโมเดลภาษา generative AI ในเวลาเพียงไม่กี่ บรรทัดของรหัส การสนับสนุนบริการ AWS ของ LangChain รวมถึงการรองรับตำแหน่งข้อมูล SageMaker

LangChain มอบอินเทอร์เฟซที่เข้าถึงได้ให้กับ LLM คุณสมบัติของมันรวมถึงเครื่องมือสำหรับการสร้างเทมเพลตที่รวดเร็วและการผูกมัดที่รวดเร็ว สายโซ่เหล่านี้สามารถใช้เพื่อสรุปเอกสารข้อความที่ยาวเกินกว่าที่โมเดลภาษารองรับในการเรียกครั้งเดียว คุณสามารถใช้กลยุทธ์การลดขนาดแผนที่เพื่อสรุปเอกสารขนาดยาวโดยการแบ่งมันออกเป็นส่วนๆ ที่สามารถจัดการได้ สรุป และรวมเข้าด้วยกัน (และสรุปอีกครั้ง หากจำเป็น)

- มาติดตั้ง LangChain เพื่อเริ่มต้น:

- นำเข้าโมดูลที่เกี่ยวข้องและแบ่งเอกสารขนาดยาวออกเป็นชิ้นๆ:

- เพื่อให้ LangChain ทำงานอย่างมีประสิทธิภาพร่วมกับ Falcon คุณจะต้องกำหนดคลาสตัวจัดการเนื้อหาเริ่มต้นสำหรับอินพุตและเอาต์พุตที่ถูกต้อง:

- คุณสามารถกำหนดพรอมต์แบบกำหนดเองได้เป็น

PromptTemplateobject ซึ่งเป็นเครื่องมือหลักในการแจ้งด้วย LangChain สำหรับวิธีการสรุปการลดแผนที่ นี่เป็นขั้นตอนทางเลือก เนื่องจากการแม็พพร้อมต์และการรวมจะถูกจัดเตรียมไว้ตามค่าเริ่มต้น หากพารามิเตอร์ภายในการเรียกโหลดสายการสรุป (load_summarize_chain) ไม่ได้กำหนดไว้

- LangChain รองรับ LLM ที่โฮสต์บนตำแหน่งข้อมูลการอนุมานของ SageMaker ดังนั้นแทนที่จะใช้ AWS Python SDK คุณสามารถเริ่มต้นการเชื่อมต่อผ่าน LangChain เพื่อการเข้าถึงที่มากขึ้น:

- สุดท้าย คุณสามารถโหลดในห่วงโซ่การสรุปและเรียกใช้การสรุปในเอกสารอินพุตโดยใช้โค้ดต่อไปนี้:

เพราะว่า verbose พารามิเตอร์ถูกตั้งค่าเป็น Trueคุณจะเห็นผลลัพธ์ระดับกลางทั้งหมดของวิธีการลดแผนที่ สิ่งนี้มีประโยชน์ในการติดตามลำดับเหตุการณ์เพื่อให้ได้บทสรุปสุดท้าย ด้วยวิธีการลดแผนที่นี้ คุณสามารถสรุปเอกสารได้อย่างมีประสิทธิภาพนานกว่าปกติตามขีดจำกัดโทเค็นอินพุตสูงสุดของโมเดล

ทำความสะอาด

หลังจากคุณใช้ตำแหน่งข้อมูลการอนุมานเสร็จแล้ว สิ่งสำคัญคือต้องลบออกเพื่อหลีกเลี่ยงค่าใช้จ่ายที่ไม่จำเป็นผ่านบรรทัดโค้ดต่อไปนี้:

การใช้โมเดลพื้นฐานอื่นๆ ใน SageMaker JumpStart

การใช้โมเดลพื้นฐานอื่นๆ ที่มีอยู่ใน SageMaker JumpStart สำหรับการสรุปเอกสารต้องมีค่าใช้จ่ายน้อยที่สุดในการตั้งค่าและปรับใช้ LLM บางครั้งจะแตกต่างกันไปตามโครงสร้างของรูปแบบอินพุตและเอาต์พุต และเมื่อมีการเพิ่มโมเดลใหม่และโซลูชันที่สร้างไว้ล่วงหน้าลงใน SageMaker JumpStart ขึ้นอยู่กับการใช้งาน คุณอาจต้องทำการเปลี่ยนแปลงโค้ดต่อไปนี้:

- หากคุณกำลังดำเนินการสรุปผ่านทาง

summarize()(วิธีที่ไม่ใช้ LangChain) คุณอาจต้องเปลี่ยนโครงสร้าง JSON ของไฟล์payloadตลอดจนการจัดการตัวแปรตอบสนองในquery_endpoint()ฟังก์ชัน - หากคุณกำลังทำการสรุปผ่านทาง LangChain's

load_summarize_chain()วิธีการคุณอาจต้องแก้ไขไฟล์ContentHandlerTextSummarizationชั้นเรียน โดยเฉพาะtransform_input()และtransform_output()เพื่อจัดการเพย์โหลดที่ LLM คาดหวังอย่างถูกต้องและเอาต์พุตที่ LLM ส่งคืน

โมเดลพื้นฐานจะแตกต่างกันไปไม่เพียงแต่ในปัจจัยต่างๆ เช่น ความเร็วและคุณภาพการอนุมาน แต่ยังรวมถึงรูปแบบอินพุตและเอาต์พุตด้วย โปรดดูหน้าข้อมูลที่เกี่ยวข้องของ LLM เกี่ยวกับอินพุตและเอาต์พุตที่คาดหวัง

สรุป

โมเดล Falcon 7B Instruct มีอยู่ในฮับโมเดล SageMaker JumpStart และใช้งานได้กับกรณีการใช้งานหลายกรณี โพสต์นี้สาธิตวิธีที่คุณสามารถปรับใช้ตำแหน่งข้อมูล Falcon LLM ของคุณในสภาพแวดล้อมของคุณโดยใช้ SageMaker JumpStart และทำการทดลองครั้งแรกจาก SageMaker Studio ซึ่งช่วยให้คุณสร้างต้นแบบโมเดลของคุณได้อย่างรวดเร็วและเปลี่ยนไปใช้สภาพแวดล้อมการใช้งานจริงได้อย่างราบรื่น ด้วย Falcon และ LangChain คุณสามารถสรุปเอกสารด้านการดูแลสุขภาพและวิทยาศาสตร์ชีวภาพในรูปแบบยาวได้อย่างมีประสิทธิภาพ

สำหรับข้อมูลเพิ่มเติมเกี่ยวกับการทำงานกับ Generative AI บน AWS โปรดดูที่ ประกาศเครื่องมือใหม่สำหรับการสร้างด้วย Generative AI บน AWS. คุณสามารถเริ่มการทดลองและสร้างเอกสารหลักฐานการสรุปแนวคิดสำหรับแอปพลิเคชัน GenAI ที่เน้นด้านการดูแลสุขภาพและวิทยาศาสตร์ชีวภาพของคุณ โดยใช้วิธีการที่อธิบายไว้ในโพสต์นี้ เมื่อไร อเมซอน เบดร็อค พร้อมใช้งานโดยทั่วไป เราจะเผยแพร่โพสต์ติดตามผลที่แสดงวิธีที่คุณสามารถใช้การสรุปเอกสารโดยใช้ Amazon Bedrock และ LangChain

เกี่ยวกับผู้เขียน

จอห์น คิตะโอกะ เป็นสถาปนิกโซลูชันที่ Amazon Web Services John ช่วยลูกค้าออกแบบและเพิ่มประสิทธิภาพปริมาณงาน AI/ML บน AWS เพื่อช่วยให้พวกเขาบรรลุเป้าหมายทางธุรกิจ

จอห์น คิตะโอกะ เป็นสถาปนิกโซลูชันที่ Amazon Web Services John ช่วยลูกค้าออกแบบและเพิ่มประสิทธิภาพปริมาณงาน AI/ML บน AWS เพื่อช่วยให้พวกเขาบรรลุเป้าหมายทางธุรกิจ

จอช ฟาเมสตัด เป็นสถาปนิกโซลูชันที่ Amazon Web Services Josh ทำงานร่วมกับลูกค้าภาครัฐเพื่อสร้างและดำเนินการแนวทางบนระบบคลาวด์เพื่อส่งมอบลำดับความสำคัญทางธุรกิจ

จอช ฟาเมสตัด เป็นสถาปนิกโซลูชันที่ Amazon Web Services Josh ทำงานร่วมกับลูกค้าภาครัฐเพื่อสร้างและดำเนินการแนวทางบนระบบคลาวด์เพื่อส่งมอบลำดับความสำคัญทางธุรกิจ

- เนื้อหาที่ขับเคลื่อนด้วย SEO และการเผยแพร่ประชาสัมพันธ์ รับการขยายวันนี้

- PlatoData.Network Vertical Generative Ai เพิ่มพลังให้กับตัวเอง เข้าถึงได้ที่นี่.

- เพลโตไอสตรีม. Web3 อัจฉริยะ ขยายความรู้ เข้าถึงได้ที่นี่.

- เพลโตESG. คาร์บอน, คลีนเทค, พลังงาน, สิ่งแวดล้อม แสงอาทิตย์, การจัดการของเสีย. เข้าถึงได้ที่นี่.

- เพลโตสุขภาพ เทคโนโลยีชีวภาพและข่าวกรองการทดลองทางคลินิก เข้าถึงได้ที่นี่.

- ที่มา: https://aws.amazon.com/blogs/machine-learning/create-an-hcls-document-summarization-application-with-falcon-using-amazon-sagemaker-jumpstart/

- :มี

- :เป็น

- :ไม่

- $ ขึ้น

- 1

- 10

- 100

- 11

- 12

- 14

- 150

- 16

- 1M

- 20

- 40

- 400

- 50

- 500

- 7

- a

- ความสามารถ

- บทคัดย่อ

- ยอมรับ

- การเข้าถึง

- สามารถเข้าถึงได้

- ลงชื่อเข้าใช้

- บรรลุ

- ที่เพิ่ม

- การนำ

- อีกครั้ง

- AI

- AI / ML

- ทั้งหมด

- อนุญาตให้

- การอนุญาต

- ช่วยให้

- คู่ขนาน

- แล้ว

- ด้วย

- อเมซอน

- อเมซอน SageMaker

- Amazon SageMaker JumpStart

- Amazon Web Services

- an

- การวิเคราะห์

- นักวิเคราะห์

- และ

- สัตว์

- สัตว์

- การใช้งาน

- การใช้งาน

- เข้าใกล้

- วิธีการ

- ได้รับการอนุมัติ

- เป็น

- รอบ

- AS

- At

- แอตทริบิวต์

- อัตโนมัติ

- ใช้ได้

- หลีกเลี่ยง

- AWS

- ตาม

- BE

- เพราะ

- เริ่ม

- เชื่อ

- พันล้าน

- ชีวการแพทย์

- ร่างกาย

- กล้า

- กล่อง

- ทำลาย

- หมดสภาพ

- สร้าง

- การก่อสร้าง

- สร้าง

- ธุรกิจ

- แต่

- by

- โทรศัพท์

- ที่เรียกว่า

- CAN

- สามารถรับ

- ความสามารถในการ

- ความสามารถ

- บัตร

- กรณี

- กรณี

- เซลล์

- โซ่

- ห่วงโซ่

- เปลี่ยนแปลง

- การเปลี่ยนแปลง

- ทางเลือก

- Choose

- เลือก

- ชั้น

- ชั้นเรียน

- ไคลเอนต์

- เมฆ

- รหัส

- การทำงานร่วมกัน

- รวมกัน

- การรวมกัน

- ร่วมกัน

- อย่างธรรมดา

- เมื่อเทียบกับ

- สมบูรณ์

- เสร็จ

- ซับซ้อน

- ประกอบด้วย

- แนวคิด

- กระชับ

- การเชื่อมต่อ

- ปลอบใจ

- บรรจุ

- เนื้อหา

- ค่าใช้จ่ายที่มีประสิทธิภาพ

- ค่าใช้จ่าย

- สร้าง

- ประเพณี

- ลูกค้า

- การปรับแต่ง

- ข้อมูล

- วิทยาศาสตร์ข้อมูล

- ทศวรรษที่ผ่านมา

- ค่าเริ่มต้น

- กำหนด

- ส่งมอบ

- สาธิต

- แสดงให้เห็นถึง

- ทั้งนี้ขึ้นอยู่กับ

- ปรับใช้

- นำไปใช้

- ปรับใช้

- การใช้งาน

- ออกแบบ

- นักพัฒนา

- ที่กำลังพัฒนา

- พัฒนาการ

- อุปกรณ์

- ต่าง

- do

- เอกสาร

- เอกสาร

- ไม่

- โดเมน

- Dont

- ลง

- ดาวน์โหลด

- แต่ละ

- โลก

- มีประสิทธิภาพ

- ทำให้สามารถ

- ปลายทาง

- ชั้นเยี่ยม

- วิศวกร

- ที่เพิ่มขึ้น

- ทำให้มั่นใจ

- การป้อน

- สิ่งแวดล้อม

- ความผิดพลาด

- เหตุการณ์

- ตัวอย่าง

- ดำเนินการ

- ที่คาดหวัง

- คาดว่า

- ประสบการณ์

- การทดลอง

- การทดลอง

- ใบหน้า

- ปัจจัย

- เท็จ

- คุณสมบัติ

- สองสาม

- เนื้อไม่มีมัน

- สุดท้าย

- หา

- ชื่อจริง

- พอดี

- โฟกัส

- ปฏิบัติตาม

- ดังต่อไปนี้

- สำหรับ

- รากฐาน

- สี่

- ราคาเริ่มต้นที่

- ฟังก์ชัน

- ฟังก์ชั่น

- นอกจากนี้

- โดยทั่วไป

- สร้าง

- สร้าง

- กำเนิด

- กำเนิด AI

- ได้รับ

- เป้าหมาย

- มากขึ้น

- จัดการ

- การจัดการ

- มี

- การดูแลสุขภาพ

- ช่วย

- จะช่วยให้

- เน้น

- เป็นเจ้าภาพ

- สรุป ความน่าเชื่อถือของ Olymp Trade?

- ทำอย่างไร

- HTML

- HTTPS

- Hub

- ICON

- if

- ภาพ

- การดำเนินการ

- การดำเนินงาน

- นำเข้า

- สำคัญ

- in

- ประกอบด้วย

- รวมถึง

- รวมทั้ง

- ข้อมูล

- เราสร้างสรรค์สิ่งใหม่ ๆ

- นักวิเคราะห์ส่วนบุคคลที่หาโอกาสให้เป็นไปได้มากที่สุด

- อินพุต

- ปัจจัยการผลิต

- ติดตั้ง

- ตัวอย่าง

- แทน

- สถาบัน

- คำแนะนำการใช้

- แบบบูรณาการ

- ฉลาด

- ปฏิสัมพันธ์

- อินเตอร์เฟซ

- เข้าไป

- ความเหงา

- IT

- ITS

- จอห์น

- JSON

- เพียงแค่

- คีย์

- ภาษา

- ใหญ่

- ที่มีขนาดใหญ่

- เปิดตัว

- ทิ้ง

- ห้องสมุด

- ชีวิต

- วิทยาศาสตร์สิ่งมีชีวิต

- LIMIT

- เส้น

- การเชื่อมโยง

- วรรณคดี

- LLM

- โหลด

- นาน

- อีกต่อไป

- ที่ต้องการหา

- หลัก

- ทำ

- จัดการ

- จัดการได้

- การจัดการ

- การจัดการ

- หลาย

- การทำแผนที่

- สูงสุด

- อาจ..

- กลาง

- เมนู

- วิธี

- ต่ำสุด

- ML

- แบบ

- โมเดล

- แก้ไข

- โมดูล

- ข้อมูลเพิ่มเติม

- มากที่สุด

- มาก

- การเดินเรือ

- จำเป็น

- จำเป็นต้อง

- จำเป็น

- เครือข่าย

- ใหม่

- NIH

- ปกติ

- สมุดบันทึก

- สังเกต..

- จำนวน

- วัตถุ

- of

- on

- ONE

- เพียง

- เปิด

- โอเพนซอร์ส

- ซอฟต์แวร์โอเพนซอร์ส

- เพิ่มประสิทธิภาพ

- Options

- อื่นๆ

- ที่ระบุไว้

- เอาท์พุต

- เกิน

- ของตนเอง

- หน้า

- บานหน้าต่าง

- กระดาษ

- พารามิเตอร์

- พารามิเตอร์

- ผ่าน

- รูปแบบไฟล์ PDF

- ดำเนินการ

- ที่มีประสิทธิภาพ

- ดำเนินการ

- ส่วนบุคคล

- เพลโต

- เพลโตดาต้าอินเทลลิเจนซ์

- เพลโตดาต้า

- จุด

- โพสต์

- ที่มีประสิทธิภาพ

- พิมพ์

- พิมพ์

- ส่วนตัว

- กระบวนการ

- ผลิตภัณฑ์

- การผลิต

- พิสูจน์

- ต้นแบบ

- ให้

- ให้

- ให้

- บทบัญญัติ

- สาธารณะ

- ประกาศ

- หลาม

- คุณภาพ

- คำถาม

- อย่างรวดเร็ว

- อย่างรวดเร็ว

- ผู้อ่าน

- พร้อม

- โลกแห่งความจริง

- แนะนำ

- อ้างอิง

- หน่วยงานกำกับดูแล

- ตรงประเด็น

- ความต้องการ

- ต้อง

- การวิจัย

- นักวิจัย

- ตามลำดับ

- คำตอบ

- กลับ

- หุ่นยนต์

- วิ่ง

- sagemaker

- การอนุมาน SageMaker

- ขนาด

- วิทยาศาสตร์

- วิทยาศาสตร์

- นักวิทยาศาสตร์

- ขอบเขต

- SDK

- ได้อย่างลงตัว

- ส่วน

- ภาค

- ความปลอดภัย

- เห็น

- เลือก

- ตนเอง

- ความรู้สึก

- ลำดับ

- บริการ

- บริการ

- ชุด

- การตั้งค่า

- ช้อปปิ้ง

- สั้น

- โชว์

- เดียว

- หก

- So

- ซอฟต์แวร์

- โซลูชัน

- โดยเฉพาะ

- เฉพาะ

- ความเร็ว

- เริ่มต้น

- ข้อความที่เริ่ม

- Status

- ขั้นตอน

- ขั้นตอน

- การเก็บรักษา

- กลยุทธ์

- เข้มงวด

- โครงสร้าง

- สตูดิโอ

- อย่างเช่น

- สรุป

- สรุป

- สนับสนุน

- รองรับ

- ใช้เวลา

- งาน

- งาน

- เทคนิค

- เทคโนโลยี

- นวัตกรรมเทคโนโลยี

- ข้อความ

- กว่า

- ที่

- พื้นที่

- ของพวกเขา

- พวกเขา

- แล้วก็

- ที่นั่น

- ล้อยางขัดเหล่านี้ติดตั้งบนแกน XNUMX (มม.) ผลิตภัณฑ์นี้ถูกผลิตในหลายรูปทรง และหลากหลายเบอร์ความแน่นหนาของปริมาณอนุภาคขัดของมัน จะทำให้ท่านได้รับประสิทธิภาพสูงในการขัดและการใช้งานที่ยาวนาน

- นี้

- ตลอด

- ไปยัง

- ร่วมกัน

- โทเค็น

- ราชสกุล

- เครื่องมือ

- เครื่องมือ

- ผ่านการฝึกอบรม

- หม้อแปลงไฟฟ้า

- การเปลี่ยนแปลง

- การเปลี่ยนแปลง

- ล้านล้าน

- จริง

- กลับ

- เกี่ยวกับการสอน

- สอง

- ชนิด

- ไม่ได้กำหนด

- เป็นเอกลักษณ์

- ไม่จำเป็น

- อัปโหลด

- ใช้

- ใช้กรณี

- มือสอง

- ใช้

- การใช้

- ตัวแปร

- ความหลากหลาย

- พาหนะ

- รุ่น

- ผ่านทาง

- รายละเอียด

- เดิน

- คำแนะนำ

- we

- เว็บ

- บริการเว็บ

- ดี

- อะไร

- เมื่อ

- ที่

- กว้าง

- จะ

- กับ

- ภายใน

- ไม่มี

- งาน

- ขั้นตอนการทำงาน

- การทำงาน

- โรงงาน

- เขียน

- การเขียน

- คุณ

- ของคุณ

- ลมทะเล