การประมวลผลเอกสารอัจฉริยะ (IDP) เป็นเทคโนโลยีที่ทำให้การประมวลผลข้อมูลที่ไม่มีโครงสร้างในปริมาณมากโดยอัตโนมัติ รวมถึงข้อความ รูปภาพ และวิดีโอ IDP นำเสนอการปรับปรุงที่สำคัญเหนือวิธีการแบบแมนนวลและระบบการรู้จำอักขระด้วยแสง (OCR) รุ่นเก่า โดยจัดการกับความท้าทายต่างๆ เช่น ต้นทุน ข้อผิดพลาด ความแม่นยำต่ำ และความสามารถในการปรับขนาดที่จำกัด ซึ่งนำไปสู่ผลลัพธ์ที่ดีขึ้นสำหรับองค์กรและผู้มีส่วนได้ส่วนเสีย

การประมวลผลภาษาธรรมชาติ (NLP) เป็นหนึ่งในการพัฒนาล่าสุดใน IDP ที่ปรับปรุงความแม่นยำและประสบการณ์ของผู้ใช้ อย่างไรก็ตาม แม้จะมีความก้าวหน้าเหล่านี้ แต่ก็ยังมีความท้าทายที่ต้องเอาชนะ ตัวอย่างเช่น ระบบ IDP จำนวนมากไม่เป็นมิตรกับผู้ใช้หรือใช้งานง่ายเพียงพอสำหรับผู้ใช้ นอกจากนี้ โซลูชันที่มีอยู่หลายตัวยังขาดความสามารถในการปรับให้เข้ากับการเปลี่ยนแปลงของแหล่งข้อมูล กฎข้อบังคับ และความต้องการของผู้ใช้ผ่านการปรับปรุงและอัปเดตอย่างต่อเนื่อง

การปรับปรุง IDP ผ่านการสนทนาเกี่ยวข้องกับการรวมความสามารถในการสนทนาเข้ากับระบบ IDP ด้วยการทำให้ผู้ใช้สามารถโต้ตอบกับระบบ IDP ด้วยวิธีที่เป็นธรรมชาติและเป็นธรรมชาติมากขึ้น ผ่านการสนทนาหลายรอบโดยการปรับข้อมูลที่ไม่ถูกต้องหรือเพิ่มข้อมูลที่ขาดหายไปซึ่งช่วยด้วยระบบอัตโนมัติของงาน ระบบเหล่านี้จึงมีประสิทธิภาพ แม่นยำ และเป็นมิตรกับผู้ใช้มากขึ้น

ในโพสต์นี้ เราจะสำรวจแนวทางใหม่สำหรับ IDP ที่ใช้โซลูชันการสอบถามแบบโต้ตอบโดยใช้ โมเดลมูลนิธิอเมซอน และ SageMaker JumpStart.

ภาพรวมโซลูชัน

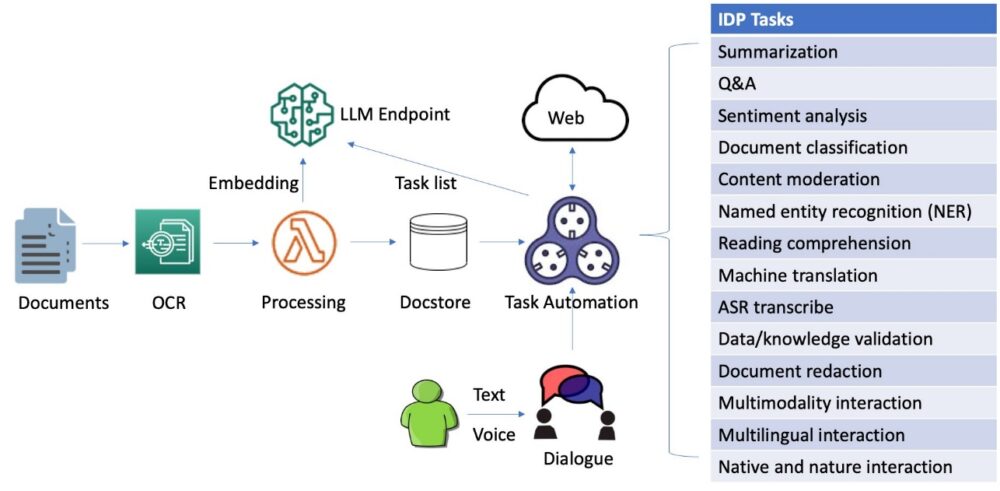

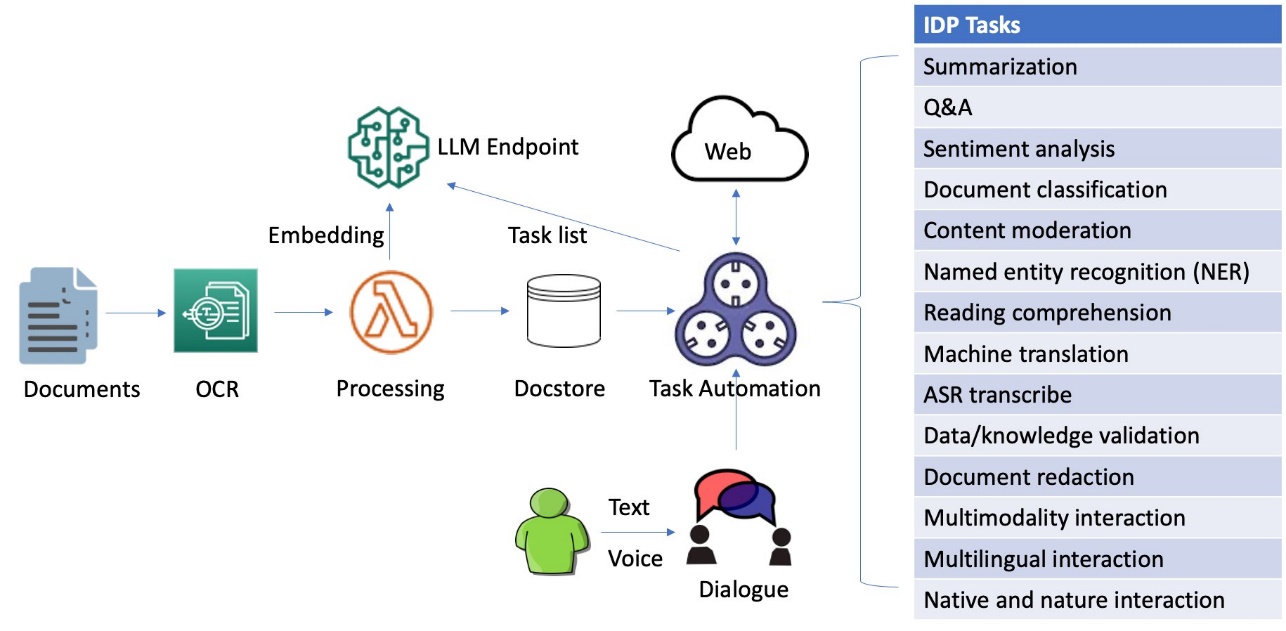

โซลูชันที่เป็นนวัตกรรมใหม่นี้รวมเอา OCR สำหรับการดึงข้อมูล โมเดลภาษาขนาดใหญ่ (LLM) ที่ปรับใช้ในพื้นที่สำหรับการสนทนาและการทำงานอัตโนมัติ VectorDB สำหรับการฝังงานย่อย และระบบงานอัตโนมัติบน LangChain สำหรับการรวมเข้ากับแหล่งข้อมูลภายนอกเพื่อเปลี่ยนวิธีที่ธุรกิจประมวลผลและวิเคราะห์เอกสาร บริบท ด้วยการควบคุมเทคโนโลยี generative AI องค์กรต่างๆ สามารถปรับปรุงเวิร์กโฟลว์ IDP ปรับปรุงประสบการณ์ผู้ใช้ และเพิ่มประสิทธิภาพโดยรวม

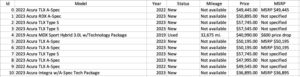

วิดีโอต่อไปนี้เน้นระบบ IDP ที่แนะนำโดยการสนทนาโดยการประมวลผล บทความ ประพันธ์โดย คณะกรรมการธนาคารกลางสหรัฐกล่าวถึงการล่มสลายของ Silicon Valley Bank ในเดือนมีนาคม 2023

ระบบสามารถประมวลผลรูปภาพ ไฟล์ PDF ขนาดใหญ่ และเอกสารในรูปแบบอื่นๆ และตอบคำถามที่ได้รับจากเนื้อหาผ่านข้อความโต้ตอบหรืออินพุตเสียง หากผู้ใช้ต้องการสอบถามนอกเหนือไปจากบริบทของเอกสาร IDP ที่แนะนำการสนทนาสามารถสร้างสายงานจากข้อความแจ้ง จากนั้นจึงอ้างอิงแหล่งข้อมูลภายนอกที่เป็นปัจจุบันเพื่อหาคำตอบที่เกี่ยวข้อง นอกจากนี้ยังรองรับการสนทนาหลายรอบและรองรับการแลกเปลี่ยนหลายภาษา ทั้งหมดนี้จัดการผ่านบทสนทนา

ปรับใช้ LLM ของคุณเองโดยใช้โมเดลรากฐานของ Amazon

หนึ่งในการพัฒนาที่มีแนวโน้มมากที่สุดใน AI เชิงสร้างสรรค์คือการรวม LLM เข้ากับระบบการสนทนา ซึ่งเปิดช่องทางใหม่สำหรับการแลกเปลี่ยนที่เป็นธรรมชาติและมีความหมายมากขึ้น LLM เป็นโมเดล AI ประเภทหนึ่งที่ออกแบบมาเพื่อทำความเข้าใจและสร้างข้อความที่เหมือนมนุษย์ โมเดลเหล่านี้ได้รับการฝึกฝนเกี่ยวกับข้อมูลจำนวนมหาศาลและประกอบด้วยพารามิเตอร์หลายพันล้านตัว ทำให้สามารถทำงานที่เกี่ยวข้องกับภาษาต่างๆ ได้ด้วยความแม่นยำสูง แนวทางการเปลี่ยนแปลงนี้อำนวยความสะดวกในการโต้ตอบที่เป็นธรรมชาติและมีประสิทธิภาพมากขึ้น เชื่อมช่องว่างระหว่างสัญชาตญาณของมนุษย์และความฉลาดของเครื่องจักร ข้อได้เปรียบที่สำคัญของการปรับใช้ LLM ในพื้นที่อยู่ที่ความสามารถในการปรับปรุงความปลอดภัยของข้อมูลโดยไม่ต้องส่งข้อมูลภายนอกไปยัง API ของบุคคลที่สาม ยิ่งไปกว่านั้น คุณสามารถปรับแต่ง LLM ที่คุณเลือกด้วยข้อมูลเฉพาะโดเมน ส่งผลให้ประสบการณ์การเข้าใจภาษาเป็นธรรมชาติและแม่นยำยิ่งขึ้น

ซีรีส์ Jurassic-2 จาก AI21 Labs ซึ่งอ้างอิงตามคำสั่งจูราสสิค-178 LLM ที่ปรับแต่งตามคำแนะนำ 1 พันล้านพารามิเตอร์ เป็นส่วนสำคัญของโมเดลรากฐานของ Amazon ที่มีจำหน่ายผ่าน อเมซอน เบดร็อค. คำสั่ง Jurassic-2 ได้รับการฝึกฝนมาโดยเฉพาะเพื่อจัดการพร้อมต์ที่เป็นคำสั่งเท่านั้น หรือที่เรียกว่า Zero-shotโดยไม่ต้องมีตัวอย่างหรือ ไม่กี่นัด. วิธีนี้ให้การโต้ตอบกับ LLM ที่เป็นธรรมชาติที่สุด และเป็นแนวทางที่ดีที่สุดในการทำความเข้าใจผลลัพธ์ในอุดมคติสำหรับงานของคุณโดยไม่ต้องมีตัวอย่างใดๆ คุณสามารถปรับใช้ J2-jumbo-instruct หรือโมเดล Jurassic-2 อื่นๆ ที่มีอยู่ใน AWS Marketplace ได้อย่างมีประสิทธิภาพ ในระบบคลาวด์ส่วนตัวเสมือน (VPC) ของคุณเองโดยใช้ อเมซอน SageMaker. ดูรหัสต่อไปนี้:

import ai21, sagemaker # Define endpoint name

endpoint_name = "sagemaker-soln-j2-jumbo-instruct"

# Define real-time inference instance type. You can also choose g5.48xlarge or p4de.24xlarge instance types

# Please request P instance quota increase via <a href="https://console.aws.amazon.com/servicequotas/home" target="_blank" rel="noopener">Service Quotas console</a> or your account manager

real_time_inference_instance_type = ("ml.p4d.24xlarge") # Create a Sgaemkaer endpoint then deploy a pre-trained J2-jumbo-instruct-v1 model from AWS Market Place.

model_package_arn = "arn:aws:sagemaker:us-east-1:865070037744:model-package/j2-jumbo-instruct-v1-0-20-8b2be365d1883a15b7d78da7217cdeab"

model = ModelPackage(

role=sagemaker.get_execution_role(),

model_package_arn=model_package_arn,

sagemaker_session=sagemaker.Session()

) # Deploy the model

predictor = model.deploy(1, real_time_inference_instance_type,

endpoint_name=endpoint_name,

model_data_download_timeout=3600,

container_startup_health_check_timeout=600,

)หลังจากปรับใช้ตำแหน่งข้อมูลสำเร็จภายใน VPC ของคุณเองแล้ว คุณสามารถเริ่มงานการอนุมานเพื่อตรวจสอบว่า LLM ที่ปรับใช้นั้นทำงานตามที่คาดการณ์ไว้:

response_jumbo_instruct = ai21.Completion.execute(

sm_endpoint=endpoint_name,

prompt="Explain deep learning algorithms to 8th graders",

numResults=1,

maxTokens=100,

temperature=0.01 #subject to reduce “hallucination” by using common words.

)การประมวลผลเอกสาร การฝัง และการจัดทำดัชนี

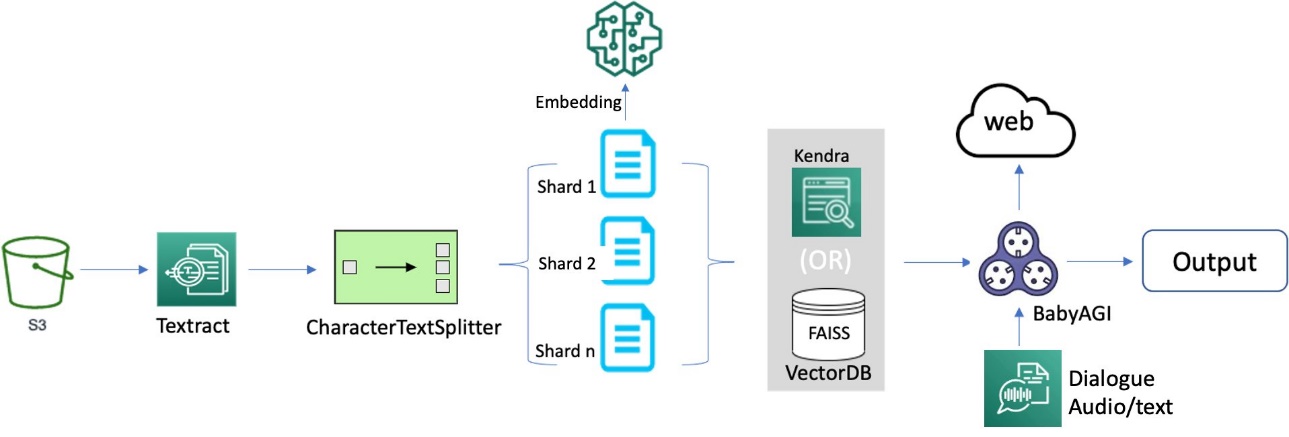

เราเจาะลึกกระบวนการสร้างดัชนีการค้นหาที่มีประสิทธิภาพและประสิทธิผล ซึ่งเป็นรากฐานสำหรับบทสนทนาที่ชาญฉลาดและตอบสนองเพื่อเป็นแนวทางในการประมวลผลเอกสาร ในการเริ่มต้น เราแปลงเอกสารจากรูปแบบต่างๆ เป็นเนื้อหาข้อความโดยใช้ OCR และ Amazon Text. จากนั้นเราจะอ่านเนื้อหานี้และแยกส่วนออกเป็นชิ้นเล็ก ๆ ตามขนาดของประโยคแต่ละประโยค วิธีการแบบละเอียดนี้ช่วยให้ได้ผลการค้นหาที่เกี่ยวข้องและแม่นยำมากขึ้น เนื่องจากช่วยให้จับคู่ข้อความค้นหากับแต่ละส่วนของหน้าได้ดีกว่าทั้งเอกสาร เพื่อปรับปรุงกระบวนการให้ดียิ่งขึ้น เราใช้การฝังเช่น ห้องสมุดแปลงประโยคจาก Hugging Faceซึ่งสร้างการแสดงเวกเตอร์ (การเข้ารหัส) ของแต่ละประโยค เวกเตอร์เหล่านี้ทำหน้าที่แทนข้อความต้นฉบับอย่างกะทัดรัดและมีความหมาย ช่วยให้ฟังก์ชันการจับคู่ความหมายมีประสิทธิภาพและแม่นยำ สุดท้าย เราเก็บเวกเตอร์เหล่านี้ไว้ในฐานข้อมูลเวกเตอร์สำหรับการค้นหาความคล้ายคลึงกัน การผสมผสานของเทคนิคนี้วางรากฐานสำหรับกรอบการประมวลผลเอกสารแบบใหม่ที่ให้ผลลัพธ์ที่ถูกต้องและใช้งานง่ายสำหรับผู้ใช้ ไดอะแกรมต่อไปนี้แสดงเวิร์กโฟลว์นี้

OCR ทำหน้าที่เป็นองค์ประกอบสำคัญในโซลูชัน ทำให้สามารถดึงข้อความจากเอกสารหรือรูปภาพที่สแกนได้ เราสามารถใช้ Amazon Textract เพื่อแยกข้อความจากไฟล์ PDF หรือไฟล์รูปภาพ บริการ OCR ที่มีการจัดการนี้สามารถระบุและตรวจสอบข้อความในเอกสารหลายหน้า รวมถึงข้อความในรูปแบบ PDF, JPEG หรือ TIFF เช่น ใบแจ้งหนี้และใบเสร็จรับเงิน การประมวลผลเอกสารหลายหน้าเกิดขึ้นแบบอะซิงโครนัส ทำให้มีประโยชน์ในการจัดการเอกสารหลายหน้าจำนวนมาก ดูรหัสต่อไปนี้:

def pdf_2_text(input_pdf_file, history):

history = history or []

key = 'input-pdf-files/{}'.format(os.path.basename(input_pdf_file.name))

try:

response = s3_client.upload_file(input_pdf_file.name, default_bucket_name, key)

except ClientError as e:

print("Error uploading file to S3:", e)

s3_object = {'Bucket': default_bucket_name, 'Name': key}

response = textract_client.start_document_analysis(

DocumentLocation={'S3Object': s3_object},

FeatureTypes=['TABLES', 'FORMS']

)

job_id = response['JobId']

while True:

response = textract_client.get_document_analysis(JobId=job_id)

status = response['JobStatus']

if status in ['SUCCEEDED', 'FAILED']:

break

time.sleep(5) if status == 'SUCCEEDED':

with open(output_file, 'w') as output_file_io:

for block in response['Blocks']:

if block['BlockType'] in ['LINE', 'WORD']:

output_file_io.write(block['Text'] + 'n')

with open(output_file, "r") as file:

first_512_chars = file.read(512).replace("n", "").replace("r", "").replace("[", "").replace("]", "") + " [...]"

history.append(("Document conversion", first_512_chars))

return history, historyเมื่อต้องจัดการกับเอกสารขนาดใหญ่ สิ่งสำคัญคือต้องแบ่งเอกสารออกเป็นส่วนๆ ที่จัดการได้ง่ายขึ้นเพื่อการประมวลผลที่ง่ายขึ้น ในกรณีของ LangChain นี่หมายถึงการแบ่งเอกสารแต่ละรายการออกเป็นส่วนย่อยๆ เช่น 1,000 โทเค็นต่อ chunk โดยมี 100 โทเค็นซ้อนทับกัน เพื่อให้บรรลุสิ่งนี้อย่างราบรื่น LangChain ใช้ตัวแยกพิเศษที่ออกแบบมาเพื่อจุดประสงค์นี้โดยเฉพาะ:

from langchain.text_splitter import CharacterTextSplitter

from langchain.document_loaders import TextLoader

separator = 'n'

overlap_count = 100. # overlap count between the splits

chunk_size = 1000 # Use a fixed split unit size

loader = TextLoader(output_file)

documents = loader.load()

text_splitter = CharacterTextSplitter(separator=separator, chunk_overlap=overlap_count, chunk_size=chunk_size, length_function=len)

texts = text_splitter.split_documents(documents)ระยะเวลาที่จำเป็นสำหรับการฝังอาจเปลี่ยนแปลงได้ตามขนาดของเอกสาร ตัวอย่างเช่น อาจใช้เวลาประมาณ 10 นาทีจึงจะเสร็จ แม้ว่ากรอบเวลานี้อาจไม่สำคัญนักเมื่อต้องจัดการกับเอกสารเพียงชุดเดียว แต่การแบ่งสาขาจะยิ่งโดดเด่นมากขึ้นเมื่อจัดทำดัชนีหลายร้อยกิกะไบต์ แทนที่จะเป็นหลายร้อยเมกะไบต์ เพื่อเร่งกระบวนการฝัง คุณสามารถใช้ชาร์ดดิ้งซึ่งเปิดใช้งานการขนานและเพิ่มประสิทธิภาพ:

from langchain.document_loaders import ReadTheDocsLoader

from langchain.text_splitter import RecursiveCharacterTextSplitter

from sentence_transformers import SentenceTransformer

import numpy as np

import ray

from embeddings import LocalHuggingFaceEmbeddings # Define number of splits

db_shards = 10 loader = TextLoader(output_file)

text_splitter = RecursiveCharacterTextSplitter(

chunk_size = 1000,

chunk_overlap = 100,

length_function = len,

) @ray.remote()

def process_shard(shard):

embeddings = LocalHuggingFaceEmbeddings('multi-qa-mpnet-base-dot-v1')

result = Chroma.from_documents(shard, embeddings)

return result # Read the doc content and split them into chunks.

chunks = text_splitter.create_documents([doc.page_content for doc in documents], metadatas=[doc.metadata for doc in documents])

# Embed the doc chunks into vectors.

shards = np.array_split(chunks, db_shards)

futures = [process_shard.remote(shards[i]) for i in range(db_shards)]

texts = ray.get(futures)ตอนนี้เราได้รับส่วนที่เล็กลงแล้ว เราสามารถแสดงเป็นเวกเตอร์ต่อไปได้ผ่านการฝัง Embeddings ซึ่งเป็นเทคนิคหนึ่งใน NLP สร้างการแสดงเวกเตอร์ของข้อความแจ้ง คลาสการฝังทำหน้าที่เป็นอินเทอร์เฟซแบบรวมสำหรับการโต้ตอบกับผู้ให้บริการการฝังต่างๆ เช่น SageMaker, รวมกัน, กอดหน้าและ OpenAIซึ่งปรับปรุงกระบวนการในแพลตฟอร์มต่างๆ การฝังเหล่านี้เป็นการพรรณนาความคิดที่เป็นตัวเลขซึ่งแปลงเป็นลำดับตัวเลข ทำให้คอมพิวเตอร์สามารถเข้าใจความเชื่อมโยงระหว่างแนวคิดเหล่านี้ได้อย่างง่ายดาย ดูรหัสต่อไปนี้:

# Choose a SageMaker deployed local LLM endpoint for embedding

llm_embeddings = SagemakerEndpointEmbeddings(

endpoint_name=<endpoint_name>,

region_name=<region>,

content_handler=content_handler

)หลังจากสร้างการฝัง เราจำเป็นต้องใช้ vectorstore เพื่อจัดเก็บเวกเตอร์ ร้านเวกเตอร์เช่น ความเข้มของสี ได้รับการออกแบบมาเป็นพิเศษเพื่อสร้างดัชนีสำหรับการค้นหาอย่างรวดเร็วในพื้นที่ที่มีมิติสูงในภายหลัง ทำให้เหมาะสมอย่างยิ่งสำหรับวัตถุประสงค์ของเรา เป็นอีกทางเลือกหนึ่งคุณสามารถใช้ ไฟสซึ่งเป็นโซลูชันการจัดกลุ่มเวกเตอร์แบบโอเพ่นซอร์สสำหรับการจัดเก็บเวกเตอร์ ดูรหัสต่อไปนี้:

from langchain.vectorstores import Chroma

# Store vectors in Chroma vectorDB

docsearch_chroma = Chroma.from_documents(texts, llm_embeddings)

# Alternatively you can choose FAISS vectorstore

from langchain.vectorstores import FAISS

docsearch_faiss = FAISS.from_documents(texts, llm_embeddings)คุณยังสามารถใช้ อเมซอน เคนดรา เพื่อจัดทำดัชนีเนื้อหาขององค์กรและสร้างคำตอบที่แม่นยำ ในฐานะบริการที่มีการจัดการเต็มรูปแบบ Amazon Kendra นำเสนอคุณสมบัติการค้นหาความหมายที่พร้อมใช้งานสำหรับเอกสารขั้นสูงและการจัดอันดับข้อความ ด้วยการค้นหาที่มีความแม่นยำสูงใน Amazon Kendra คุณจะได้รับเนื้อหาและเอกสารที่เกี่ยวข้องมากที่สุดเพื่อปรับคุณภาพของเพย์โหลดของคุณให้เหมาะสมที่สุด ซึ่งส่งผลให้เกิดการตอบสนอง LLM ที่เหนือกว่าเมื่อเทียบกับวิธีการค้นหาแบบดั้งเดิมหรือที่เน้นคำหลัก สำหรับข้อมูลเพิ่มเติม โปรดดูที่ สร้างแอปพลิเคชัน Generative AI ที่มีความแม่นยำสูงอย่างรวดเร็วบนข้อมูลองค์กรโดยใช้ Amazon Kendra, LangChain และโมเดลภาษาขนาดใหญ่.

การป้อนข้อมูลด้วยเสียงหลายภาษาแบบโต้ตอบ

การรวมการป้อนข้อมูลด้วยเสียงแบบโต้ตอบเข้ากับการค้นหาเอกสารมีข้อดีมากมายที่ปรับปรุงประสบการณ์ผู้ใช้ การค้นหาเอกสารจึงเป็นธรรมชาติและเป็นธรรมชาติมากขึ้น ทำให้ผู้ใช้สามารถค้นหาข้อมูลที่ต้องการได้ง่ายและรวดเร็วขึ้น การป้อนข้อมูลด้วยเสียงสามารถเพิ่มความแม่นยำของผลการค้นหาได้ เนื่องจากข้อความค้นหาที่พูดจะไวต่อการสะกดหรือข้อผิดพลาดทางไวยากรณ์น้อยกว่า การป้อนข้อมูลด้วยเสียงแบบอินเตอร์แอคทีฟทำให้การค้นหาเอกสารมีความครอบคลุมมากขึ้น รองรับผู้ใช้ในวงกว้างที่มีผู้พูดภาษาและภูมิหลังทางวัฒนธรรมที่แตกต่างกัน

พื้นที่ Amazon Transcribe สตรีมมิ่ง SDK ช่วยให้คุณสามารถทำการรู้จำเสียงเป็นคำพูดได้โดยการผสานรวมโดยตรงกับ Amazon Transcribe ด้วยสตรีมของไบต์เสียงและตัวจัดการพื้นฐาน อีกทางเลือกหนึ่ง คุณสามารถปรับใช้ กระซิบขนาดใหญ่ จำลองเฉพาะที่จาก Hugging Face โดยใช้ SageMakerซึ่งมีการปรับปรุงความปลอดภัยของข้อมูลและประสิทธิภาพที่ดีขึ้น สำหรับรายละเอียด โปรดดูที่ โน๊ตบุ๊คตัวอย่าง เผยแพร่บน repo GitHub

# Choose ASR using a locally deployed Whisper-large model from Hugging Face

image = sagemaker.image_uris.retrieve(

framework='pytorch',

region=region,

image_scope='inference',

version='1.12',

instance_type='ml.g4dn.xlarge',

) model_name = f'sagemaker-soln-whisper-model-{int(time.time())}'

whisper_model_sm = sagemaker.model.Model(

model_data=model_uri,

image_uri=image,

role=sagemaker.get_execution_role(),

entry_point="inference.py",

source_dir='src',

name=model_name,

) # Audio transcribe

transcribe = whisper_endpoint.predict(audio.numpy())วิดีโอสาธิตข้างต้นแสดงให้เห็นว่าคำสั่งเสียงร่วมกับการป้อนข้อความสามารถอำนวยความสะดวกในการสรุปเอกสารผ่านการสนทนาแบบโต้ตอบได้อย่างไร

แนะนำงาน NLP ผ่านการสนทนาหลายรอบ

หน่วยความจำในโมเดลภาษาจะรักษาแนวคิดเกี่ยวกับสถานะตลอดการโต้ตอบของผู้ใช้ สิ่งนี้เกี่ยวข้องกับการประมวลผลลำดับข้อความแชทเพื่อแยกและแปลงความรู้ ประเภทหน่วยความจำแตกต่างกันไป แต่แต่ละประเภทสามารถเข้าใจได้โดยใช้ฟังก์ชันแบบสแตนด์อโลนและภายในห่วงโซ่ หน่วยความจำสามารถส่งคืนจุดข้อมูลหลายจุด เช่น ข้อความล่าสุดหรือการสรุปข้อความ ในรูปแบบของสตริงหรือรายการ โพสต์นี้มุ่งเน้นไปที่รูปแบบหน่วยความจำที่ง่ายที่สุด หน่วยความจำบัฟเฟอร์ ซึ่งจัดเก็บข้อความก่อนหน้าทั้งหมด และสาธิตการใช้งานด้วยฟังก์ชันและสายโซ่ของยูทิลิตี้แบบโมดูลาร์

ของ LangChain ประวัติข้อความแชท คลาสเป็นโปรแกรมอรรถประโยชน์ที่สำคัญสำหรับโมดูลหน่วยความจำ ให้วิธีการที่สะดวกในการบันทึกและดึงข้อความของมนุษย์และ AI โดยจดจำการโต้ตอบการสนทนาก่อนหน้านี้ทั้งหมด เหมาะอย่างยิ่งสำหรับการจัดการหน่วยความจำภายนอกจากเชน โค้ดต่อไปนี้เป็นตัวอย่างของการนำแนวคิดง่ายๆ มาใช้ในห่วงโซ่โดยการแนะนำ หน่วยความจำบัฟเฟอร์การสนทนา, กระดาษห่อสำหรับ ChatMessageHistory. Wrapper นี้จะแยกข้อความออกเป็นตัวแปร ทำให้สามารถแสดงเป็นสตริงได้:

from langchain.memory import ConversationBufferMemory

memory = ConversationBufferMemory(return_messages=True)LangChain ทำงานร่วมกับผู้ให้บริการ LLM ยอดนิยมมากมาย เช่น AI21 Labs, OpenAI, Cohere, Hugging Face และอื่นๆ สำหรับตัวอย่างนี้ เราใช้ wrapper Jurassic-21 LLM ของ AI2 Labs ที่ปรับใช้ในเครื่องโดยใช้ SageMaker AI21 Studio ยังให้การเข้าถึง API สำหรับ Jurassic-2 LLM

from langchain import PromptTemplate, SagemakerEndpoint

from langchain.llms.sagemaker_endpoint import ContentHandlerBase

from langchain.chains.question_answering import load_qa_chain prompt= PromptTemplate(

template=prompt_template, input_variables=["context", "question"]

) class ContentHandler(ContentHandlerBase):

content_type = "application/json"

accepts = "application/json"

def transform_input(self, prompt: str, model_kwargs: Dict) -- bytes:

input_str = json.dumps({prompt: prompt, **model_kwargs})

return input_str.encode('utf-8') def transform_output(self, output: bytes) -- str:

response_json = json.loads(output.read().decode("utf-8"))

return response_json[0]["generated_text"]

content_handler = ContentHandler()

llm_ai21=SagemakerEndpoint(

endpoint_name=endpoint_name,

credentials_profile_name=f'aws-credentials-profile-name',

region_name="us-east-1",

model_kwargs={"temperature":0},

content_handler=content_handler) qa_chain = VectorDBQA.from_chain_type(

llm=llm_ai21,

chain_type='stuff',

vectorstore=docsearch,

verbose=True,

memory=ConversationBufferMemory(return_messages=True)

) response = qa_chain(

{'query': query_input},

return_only_outputs=True

)ในกรณีที่กระบวนการไม่สามารถค้นหาการตอบสนองที่เหมาะสมจากเอกสารต้นฉบับในการตอบคำถามของผู้ใช้ การรวม URL ของบุคคลที่สามหรือตัวแทนอิสระที่ขับเคลื่อนด้วยงานเข้ากับแหล่งข้อมูลภายนอกจะช่วยเพิ่มความสามารถของระบบอย่างมากในการ เข้าถึงข้อมูลที่หลากหลาย ปรับปรุงบริบทและให้ผลลัพธ์ที่แม่นยำและเป็นปัจจุบันมากขึ้นในท้ายที่สุด

ด้วยวิธีการเรียกใช้ Summarize ที่กำหนดค่าไว้ล่วงหน้าของ AI21 แบบสอบถามสามารถเข้าถึง URL ที่กำหนดไว้ล่วงหน้า ย่อเนื้อหา จากนั้นดำเนินงานคำถามและคำตอบตามข้อมูลสรุป:

# Call AI21 API to query the context of a specific URL for Q&A

ai21.api_key = "<YOUR_API_KEY>"

url_external_source = "<your_source_url>"

response_url = ai21.Summarize.execute(

source=url_external_source,

sourceType="URL" )

context = "<concate_document_and_response_url>"

question = "<query>"

response = ai21.Answer.execute(

context=context,

question=question,

sm_endpoint=endpoint_name,

maxTokens=100,

)สำหรับรายละเอียดเพิ่มเติมและตัวอย่างโค้ด โปรดดูที่ เอกสารการรวม LangChain LLM เช่นเดียวกับ เอกสาร API เฉพาะงาน ให้บริการโดย AI21

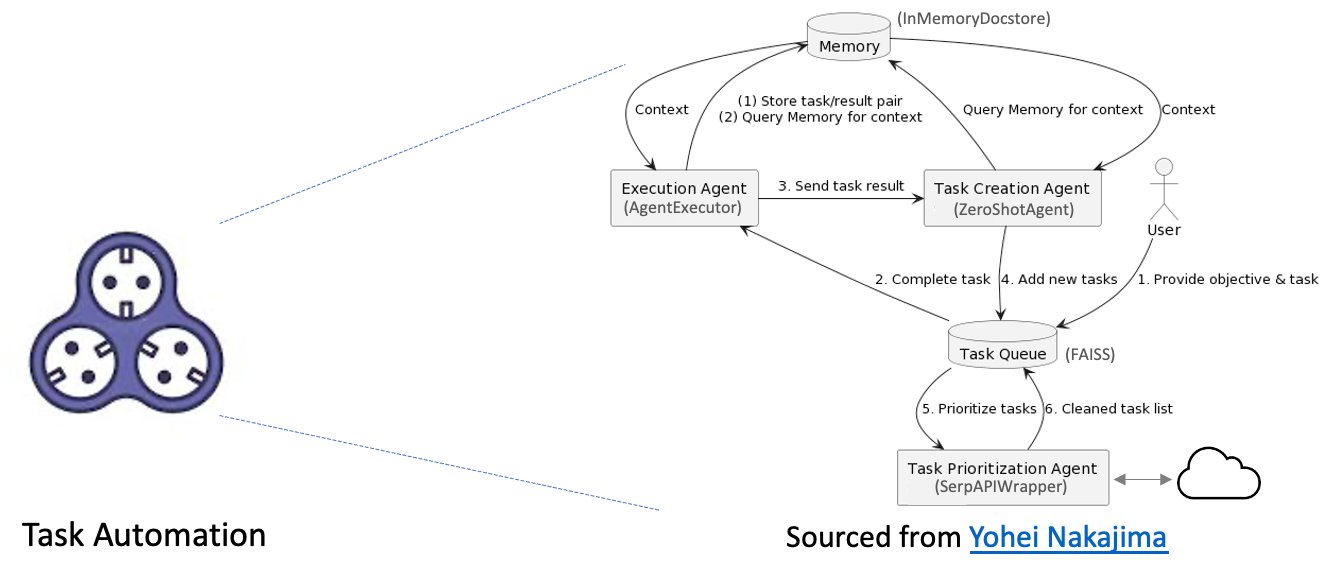

การทำงานอัตโนมัติโดยใช้ BabyAGI

กลไกการทำงานอัตโนมัติช่วยให้ระบบประมวลผลการสืบค้นที่ซับซ้อนและสร้างการตอบกลับที่เกี่ยวข้อง ซึ่งช่วยปรับปรุงความถูกต้องและความถูกต้องของการประมวลผลเอกสารอย่างมาก BabyAGI ของ LangCain เป็นระบบการจัดการงานที่ขับเคลื่อนด้วย AI อันทรงพลัง ซึ่งสามารถสร้าง จัดลำดับความสำคัญ และรันงานได้โดยอัตโนมัติ คุณสมบัติหลักประการหนึ่งคือความสามารถในการเชื่อมต่อกับแหล่งข้อมูลภายนอก เช่น เว็บ ฐานข้อมูล และ API วิธีหนึ่งในการใช้คุณสมบัตินี้คือการรวม BabyAGI เข้ากับ เซอร์ปาปีซึ่งเป็น API ของเครื่องมือค้นหาที่ให้การเข้าถึงเครื่องมือค้นหา การผสานรวมนี้ทำให้ BabyAGI สามารถค้นหาเว็บสำหรับข้อมูลที่เกี่ยวข้องกับงาน ทำให้ BabyAGI สามารถเข้าถึงข้อมูลมากมายนอกเหนือจากเอกสารอินพุต

ความสามารถในการมอบหมายงานอัตโนมัติของ BabyAGI ขับเคลื่อนโดย LLM, ฐานข้อมูลการค้นหาเวกเตอร์, API wrapper ไปยังลิงก์ภายนอก และกรอบงาน LangChain ทำให้สามารถเรียกใช้งานที่หลากหลายในโดเมนต่างๆ สิ่งนี้ทำให้ระบบสามารถดำเนินงานเชิงรุกตามการโต้ตอบของผู้ใช้ เพิ่มประสิทธิภาพขั้นตอนการประมวลผลเอกสารที่รวมแหล่งข้อมูลภายนอก และสร้างประสบการณ์ที่มีประสิทธิภาพและราบรื่นยิ่งขึ้น ไดอะแกรมต่อไปนี้แสดงกระบวนการทำงานอัตโนมัติ

กระบวนการนี้ประกอบด้วยส่วนประกอบต่อไปนี้:

- หน่วยความจำ – หน่วยความจำเก็บข้อมูลทั้งหมดที่ BabyAGI ต้องการเพื่อทำงานให้เสร็จ ซึ่งรวมถึงตัวงานเอง ตลอดจนผลลัพธ์หรือข้อมูลที่อยู่ระหว่างกลางที่ BabyAGI สร้างขึ้น

- ตัวแทนการดำเนินการ – ตัวแทนดำเนินการมีหน้าที่รับผิดชอบในการดำเนินงานที่เก็บไว้ในหน่วยความจำ ทำสิ่งนี้โดยการเข้าถึงหน่วยความจำ ดึงข้อมูลที่เกี่ยวข้อง จากนั้นทำตามขั้นตอนที่จำเป็นเพื่อทำงานให้เสร็จ

- ตัวแทนสร้างงาน – ตัวแทนสร้างงานมีหน้าที่รับผิดชอบในการสร้างงานใหม่สำหรับ BabyAGI เพื่อให้เสร็จสมบูรณ์ ทำสิ่งนี้โดยการวิเคราะห์สถานะปัจจุบันของหน่วยความจำและระบุช่องว่างในความรู้หรือความเข้าใจ เมื่อมีการระบุช่องว่าง ตัวแทนการสร้างงานจะสร้างงานใหม่ที่จะช่วย BabyAGI เติมเต็มช่องว่างนั้น

- คิวงาน – คิวงานคือรายการงานทั้งหมดที่ BabyAGI ได้รับมอบหมาย งานจะถูกเพิ่มลงในคิวตามลำดับที่ได้รับ

- ตัวแทนการจัดลำดับความสำคัญของงาน – ตัวแทนจัดลำดับความสำคัญของงานมีหน้าที่รับผิดชอบในการกำหนดลำดับที่ BabyAGI ควรทำงานให้เสร็จ ทำได้โดยการวิเคราะห์งานในคิวและระบุงานที่สำคัญหรือเร่งด่วนที่สุด งานที่สำคัญที่สุดจะถูกวางไว้ที่ด้านหน้าของคิว และงานที่มีความสำคัญน้อยที่สุดจะถูกวางไว้ที่ด้านหลังคิว

ดูรหัสต่อไปนี้:

from babyagi import BabyAGI

from langchain.docstore import InMemoryDocstore

import faiss

# Set temperatur=0 to generate the most frequent words, instead of more “poetically free” behavior.

new_query = """

What happened to the First Republic Bank? Will the FED take the same action as it did on SVB's failure? """

# Enable verbose logging and use a fixed embedding size.

verbose = True

embedding_size = 1536 # Using FAISS vector cluster for vectore store

index = faiss.IndexFlatL2(embedding_size)

vectorstore = FAISS(llm_embeddings.embed_query, index, InMemoryDocstore({}), {}) # Choose 1 iteration for demo and 1>N>10 for real. If None, it will loop indefinitely

max_iterations: Optional[int] = 2 # Call bayagi class for task automation

baby_agi = BabyAGI.from_llm(

llm=llm_embedding, vectorstore=vectorstore, verbose=verbose, max_iterations=max_iterations<br />) response = baby_agi({"objective": new_query})เรามาตรวจสอบงานที่รวบรวมและผลลัพธ์จากการวนซ้ำเพียงครั้งเดียว ซึ่งใช้เพื่อการสาธิต เพื่อให้บรรลุวัตถุประสงค์ในการตอบคำถามของผู้ใช้ BabyAGI ทำงานเป็นวงจรต่อเนื่องตามขั้นตอนต่อไปนี้:

- ตัวแทนการสร้างงานกำหนดงานใหม่

- งานใหม่รวมอยู่ในคิวงาน

- ตัวแทนจัดลำดับความสำคัญของงานสร้างลำดับงานที่ควรจัดการ

- ตัวแทนดำเนินการทำงานให้สำเร็จ

- ผลลัพธ์ของงานจะถูกบันทึกไว้ในหน่วยความจำ

- วงจรซ้ำ

กระบวนการทำซ้ำๆ นี้ทำให้ BabyAGI สามารถเรียนรู้และพัฒนาเมื่อเวลาผ่านไป เมื่อทำงานจำนวนมากขึ้นได้สำเร็จ ความรู้ของ BabyAGI และความเข้าใจในโลกก็ขยายกว้างขึ้น ด้วยเหตุนี้จึงสามารถสร้างและเรียกใช้งานที่ซับซ้อนและขั้นสูงได้อย่างมีประสิทธิภาพ ด้วยการเพิ่มจำนวนการวนซ้ำ คุณสามารถปรับปรุงผลลัพธ์ผ่านการจัดโครงสร้างรายการงานใหม่ ซึ่งมุ่งเน้นไปที่เป้าหมายและผลลัพธ์ของงานก่อนหน้า ซึ่งท้ายที่สุดจะให้การตอบสนองที่เกี่ยวข้องและแม่นยำยิ่งขึ้น

ดูผลลัพธ์ตัวอย่างต่อไปนี้:

*****TASK LIST*****

1: Make a todo list

*****NEXT TASK*****

1: Make a todo list

> Entering new AgentExecutor chain...

Thought: I need to research the First Republic Bank and the FED's action

Action: Search

Action Input: What happened to the First Republic Bank? Will the FED take the same action as it did on SVB's failure?

Observation: First Republic's failure was due to a run on deposits following the collapse of Silicon Valley Bank and Signature Bank. JPMorgan Chase acquired

First Republic Bank on May 1, 2023. If you had insured or uninsured money in First Republic accounts, your funds are safe and now managed by JPMorgan Chase.

Thought: I need to research the FED's action on SVB's failure

Action: Search

Action Input: What action did the FED take on SVB's failure?

Observation: The Hutchins Center explains how the Federal Reserve has responded to the March 2023 failures of Silicon Valley Bank and Signature Bank.

Thought: I now know the final answer

Final Answer: The FED responded to the March 2023 failures of Silicon Valley Bank and <br />Signature Bank by providing liquidity to the banking system. JPMorgan Chase acquired First Republic Bank on May 1, 2023, and if you had insured or uninsured money in First Republic accounts, your funds are safe and now managed by JPMorgan Chase.

> Finished chain.

*****TASK RESULT*****

The Federal Reserve responded to the March 2023 failures of Silicon Valley Bank and Signature Bank by providing liquidity to the banking system. It is unclear what action the FED will take in response to the failure of First Republic Bank. ***TASK LIST*** 2: Research the timeline of First Republic Bank's failure.

3: Analyze the Federal Reserve's response to the failure of Silicon Valley Bank and Signature Bank.

4: Compare the Federal Reserve's response to the failure of Silicon Valley Bank and Signature Bank to the Federal Reserve's response to the failure of First Republic Bank.

5: Investigate the potential implications of the Federal Reserve's response to the failure of First Republic Bank.

6: Identify any potential risks associated with the Federal Reserve's response to the failure of First Republic Bank.<br />*****NEXT TASK***** 2: Research the timeline of First Republic Bank's failure. > Entering new AgentExecutor chain...

Will the FED take the same action as it did on SVB's failure?

Thought: I should search for information about the timeline of First Republic Bank's failure and the FED's action on SVB's failure.

Action: Search

Action Input: Timeline of First Republic Bank's failure and FED's action on SVB's failure

Observation: March 20: The FDIC decides to break up SVB and hold two separate auctions for its traditional deposits unit and its private bank after failing ...

Thought: I should look for more information about the FED's action on SVB's failure.

Action: Search

Action Input: FED's action on SVB's failure

Observation: The Fed blamed failures on mismanagement and supervisory missteps, compounded by a dose of social media frenzy.

Thought: I now know the final answer.

Final Answer: The FED is likely to take similar action on First Republic Bank's failure as it did on SVB's failure, which was to break up the bank and hold two separate auctions for its traditional deposits unit and its private bank.</p><p>> Finished chain. *****TASK RESULT*****

The FED responded to the March 2023 failures of ilicon Valley Bank and Signature Bank by providing liquidity to the banking system. JPMorgan Chase acquired First Republic Bank on May 1, 2023, and if you had insured or uninsured money in First Republic accounts, your funds are safe and now managed by JPMorgan Chase.*****TASK ENDING*****ด้วย BabyAGI สำหรับการทำงานอัตโนมัติ ระบบ IDP ที่มีการโต้ตอบด้วยบทสนทนาแสดงประสิทธิภาพโดยก้าวข้ามบริบทของเอกสารต้นฉบับเพื่อจัดการกับข้อสงสัยของผู้ใช้เกี่ยวกับการดำเนินการที่อาจเกิดขึ้นของธนาคารกลางสหรัฐเกี่ยวกับความล้มเหลวของธนาคาร First Republic ซึ่งเกิดขึ้นในช่วงปลายเดือนเมษายน 2023 1 เดือนหลังจากนั้น สิ่งพิมพ์ตัวอย่างเมื่อเทียบกับความล้มเหลวของ SVB เพื่อให้บรรลุเป้าหมายนี้ ระบบได้สร้างรายการสิ่งที่ต้องทำและทำงานให้เสร็จตามลำดับ ตรวจสอบสถานการณ์โดยรอบความล้มเหลวของธนาคาร First Republic Bank ระบุความเสี่ยงที่อาจเกิดขึ้นซึ่งเชื่อมโยงกับการตอบสนองของธนาคารกลางสหรัฐ และเปรียบเทียบกับการตอบสนองต่อความล้มเหลวของ SVB

แม้ว่า BabyAGI จะยังคงอยู่ในระหว่างดำเนินการ แต่ก็มีคำมั่นสัญญาว่าจะปฏิวัติการโต้ตอบของเครื่องจักร การคิดเชิงสร้างสรรค์ และการแก้ปัญหา เนื่องจากการเรียนรู้และการเพิ่มประสิทธิภาพของ BabyAGI ยังคงมีอยู่ ก็จะสามารถสร้างการตอบสนองที่แม่นยำ ลึกซึ้ง และสร้างสรรค์มากขึ้น ด้วยการเสริมพลังให้กับเครื่องจักรเพื่อเรียนรู้และพัฒนาอย่างอิสระ BabyAGI สามารถอำนวยความสะดวกในการช่วยเหลือของพวกเขาในงานที่หลากหลาย ตั้งแต่งานบ้านทั่วไปไปจนถึงการแก้ปัญหาที่ซับซ้อน

ข้อ จำกัด และข้อ จำกัด

IDP ที่ได้รับคำแนะนำจากการสนทนานำเสนอแนวทางที่มีแนวโน้มในการเพิ่มประสิทธิภาพและประสิทธิผลของการวิเคราะห์และการแยกเอกสาร อย่างไรก็ตาม เราต้องยอมรับข้อจำกัดและข้อจำกัดในปัจจุบัน เช่น ความจำเป็นในการหลีกเลี่ยงอคติของข้อมูล การบรรเทาภาพหลอน ความท้าทายในการจัดการกับภาษาที่ซับซ้อนและกำกวม และความยากลำบากในการทำความเข้าใจบริบทหรือการรักษาความสอดคล้องกันในการสนทนาที่ยาวขึ้น

นอกจากนี้ สิ่งสำคัญคือต้องพิจารณาความสับสนและภาพหลอนในการตอบสนองที่สร้างโดย AI ซึ่งอาจนำไปสู่การสร้างข้อมูลที่ไม่ถูกต้องหรือปลอมแปลง เพื่อจัดการกับความท้าทายเหล่านี้ การพัฒนาอย่างต่อเนื่องกำลังมุ่งเน้นไปที่การปรับแต่ง LLM ด้วยความสามารถในการเข้าใจภาษาธรรมชาติที่ดีขึ้น การผสมผสานความรู้เฉพาะโดเมน และพัฒนาโมเดลที่คำนึงถึงบริบทที่มีประสิทธิภาพมากขึ้น การสร้าง LLM ตั้งแต่เริ่มต้นอาจมีค่าใช้จ่ายสูงและใช้เวลานาน อย่างไรก็ตาม คุณสามารถใช้หลายกลยุทธ์เพื่อปรับปรุงโมเดลที่มีอยู่:

- ปรับแต่ง LLM ที่ได้รับการฝึกอบรมล่วงหน้าอย่างละเอียดในโดเมนเฉพาะเพื่อให้ได้ผลลัพธ์ที่แม่นยำและเกี่ยวข้องมากขึ้น

- การรวมแหล่งข้อมูลภายนอกที่ทราบกันดีว่าปลอดภัยในระหว่างการอนุมานเพื่อเพิ่มความเข้าใจตามบริบท

- การออกแบบพรอมต์ที่ดีขึ้นเพื่อกระตุ้นการตอบสนองจากโมเดลที่แม่นยำยิ่งขึ้น

- การใช้แบบจำลองทั้งมวลเพื่อรวมเอาต์พุตจาก LLM หลายๆ ตัว การหาค่าเฉลี่ยของข้อผิดพลาด และลดโอกาสการเกิดภาพหลอนให้เหลือน้อยที่สุด

- สร้างราวกั้นเพื่อป้องกันไม่ให้โมเดลเบี่ยงออกไปยังพื้นที่ที่ไม่ต้องการ ขณะเดียวกันก็มั่นใจว่าแอปจะตอบสนองด้วยข้อมูลที่ถูกต้องและเหมาะสม

- ดำเนินการปรับแต่งอย่างละเอียดภายใต้การดูแลด้วยคำติชมของมนุษย์ ปรับแต่งโมเดลซ้ำๆ เพื่อเพิ่มความแม่นยำและลดอาการประสาทหลอน

การนำวิธีการเหล่านี้ไปใช้ คำตอบที่สร้างโดย AI สามารถสร้างความน่าเชื่อถือและมีค่ามากขึ้นได้

ตัวแทนอัตโนมัติที่ขับเคลื่อนด้วยงานมีศักยภาพที่สำคัญในแอพพลิเคชั่นต่างๆ แต่จำเป็นอย่างยิ่งที่จะต้องพิจารณาความเสี่ยงที่สำคัญก่อนที่จะนำเทคโนโลยีมาใช้ ความเสี่ยงเหล่านี้รวมถึง:

- การละเมิดความเป็นส่วนตัวและความปลอดภัยของข้อมูลเนื่องจากการพึ่งพาผู้ให้บริการ LLM และ vectorDB ที่เลือก

- ข้อกังวลด้านจริยธรรมที่เกิดจากการสร้างเนื้อหาที่มีอคติหรือเป็นอันตราย

- การพึ่งพาความถูกต้องของแบบจำลอง ซึ่งอาจนำไปสู่การทำงานที่ไม่มีประสิทธิภาพหรือผลลัพธ์ที่ไม่พึงประสงค์

- ปัญหาการโอเวอร์โหลดของระบบและความสามารถในการขยายขนาดหากการสร้างงานมีมากกว่าการทำให้เสร็จสมบูรณ์ ซึ่งต้องการการจัดลำดับงานที่เหมาะสมและการจัดการแบบขนาน

- การตีความลำดับความสำคัญของงานอย่างผิดๆ ตามความเข้าใจของ LLM เกี่ยวกับความสำคัญของงาน

- ความถูกต้องของข้อมูลที่ได้รับจากเว็บ

การจัดการกับความเสี่ยงเหล่านี้เป็นสิ่งสำคัญสำหรับแอปพลิเคชันที่มีความรับผิดชอบและประสบความสำเร็จ ช่วยให้เราได้รับประโยชน์สูงสุดจากโมเดลภาษาที่ขับเคลื่อนด้วย AI ในขณะที่ลดความเสี่ยงที่อาจเกิดขึ้น

สรุป

โซลูชันการสนทนาแนะนำสำหรับ IDP นำเสนอวิธีการที่ก้าวล้ำในการประมวลผลเอกสารโดยการรวม OCR, การรู้จำเสียงอัตโนมัติ, LLM, การทำงานอัตโนมัติ และแหล่งข้อมูลภายนอก โซลูชันที่ครอบคลุมนี้ช่วยให้ธุรกิจปรับปรุงเวิร์กโฟลว์การประมวลผลเอกสาร ทำให้มีประสิทธิภาพและใช้งานง่ายยิ่งขึ้น ด้วยการรวมเอาเทคโนโลยีที่ล้ำสมัยเหล่านี้เข้าด้วยกัน องค์กรต่างๆ ไม่เพียงแต่สามารถปฏิวัติกระบวนการจัดการเอกสารของตนได้เท่านั้น แต่ยังเพิ่มขีดความสามารถในการตัดสินใจและเพิ่มผลผลิตโดยรวมได้อย่างมาก โซลูชันดังกล่าวนำเสนอแนวทางการเปลี่ยนแปลงและเป็นนวัตกรรมใหม่สำหรับธุรกิจในการปลดล็อกศักยภาพของเวิร์กโฟลว์เอกสารของตนอย่างเต็มที่ ซึ่งท้ายที่สุดจะขับเคลื่อนการเติบโตและความสำเร็จในยุคของ AI เชิงกำเนิด อ้างถึง SageMaker เริ่มต้นอย่างรวดเร็ว สำหรับโซลูชั่นอื่นๆ และ อเมซอน เบดร็อค สำหรับโมเดล AI กำเนิดเพิ่มเติม

ผู้เขียนขอแสดงความขอบคุณอย่างจริงใจต่อ Ryan Kilpatrick, Ashish Lal และ Kristine Pearce สำหรับข้อมูลอันมีค่าและการมีส่วนร่วมในงานนี้ พวกเขายังยอมรับ Clay Elmore สำหรับตัวอย่างโค้ดที่มีให้ใน Github

เกี่ยวกับผู้แต่ง

อัลเฟรด เชน เป็นผู้เชี่ยวชาญด้าน AI/ML อาวุโสที่ AWS เขาทำงานในซิลิคอน แวลลีย์ โดยดำรงตำแหน่งด้านเทคนิคและการจัดการในภาคส่วนต่าง ๆ รวมถึงการดูแลสุขภาพ การเงิน และเทคโนโลยีขั้นสูง เขาเป็นนักวิจัยประยุกต์ AI/ML โดยเฉพาะ โดยมุ่งเน้นที่ CV, NLP และการทำงานหลายรูปแบบ ผลงานของเขาได้รับการจัดแสดงในสื่อสิ่งพิมพ์ เช่น EMNLP, ICLR และ Public Health

อัลเฟรด เชน เป็นผู้เชี่ยวชาญด้าน AI/ML อาวุโสที่ AWS เขาทำงานในซิลิคอน แวลลีย์ โดยดำรงตำแหน่งด้านเทคนิคและการจัดการในภาคส่วนต่าง ๆ รวมถึงการดูแลสุขภาพ การเงิน และเทคโนโลยีขั้นสูง เขาเป็นนักวิจัยประยุกต์ AI/ML โดยเฉพาะ โดยมุ่งเน้นที่ CV, NLP และการทำงานหลายรูปแบบ ผลงานของเขาได้รับการจัดแสดงในสื่อสิ่งพิมพ์ เช่น EMNLP, ICLR และ Public Health

ดร.วิเวก มะดัน เป็นนักวิทยาศาสตร์ประยุกต์กับทีม Amazon SageMaker JumpStart เขาสำเร็จการศึกษาระดับปริญญาเอกจากมหาวิทยาลัยอิลลินอยส์ Urbana-Champaign และเป็นนักวิจัยหลังปริญญาเอกที่ Georgia Tech เขาเป็นนักวิจัยเชิงรุกด้านการเรียนรู้ของเครื่องและการออกแบบอัลกอริธึม และได้ตีพิมพ์เอกสารในการประชุม EMNLP, ICLR, COLT, FOCS และ SODA

ดร.วิเวก มะดัน เป็นนักวิทยาศาสตร์ประยุกต์กับทีม Amazon SageMaker JumpStart เขาสำเร็จการศึกษาระดับปริญญาเอกจากมหาวิทยาลัยอิลลินอยส์ Urbana-Champaign และเป็นนักวิจัยหลังปริญญาเอกที่ Georgia Tech เขาเป็นนักวิจัยเชิงรุกด้านการเรียนรู้ของเครื่องและการออกแบบอัลกอริธึม และได้ตีพิมพ์เอกสารในการประชุม EMNLP, ICLR, COLT, FOCS และ SODA

ดร.หลี่ จาง เป็นผู้จัดการผลิตภัณฑ์หลักด้านเทคนิคสำหรับ Amazon SageMaker JumpStart และ อัลกอริทึมในตัวของ Amazon SageMakerซึ่งเป็นบริการที่ช่วยให้นักวิทยาศาสตร์ข้อมูลและผู้ปฏิบัติงานด้านแมชชีนเลิร์นนิงเริ่มต้นการฝึกอบรมและปรับใช้โมเดลและการใช้งานของตน การเรียนรู้การเสริมแรง ด้วย Amazon SageMaker ผลงานที่ผ่านมาของเขาในฐานะเจ้าหน้าที่วิจัยหลักและนักประดิษฐ์ระดับปรมาจารย์ที่ IBM Research ได้รับรางวัล รางวัลการทดสอบกระดาษเวลา ที่ IEEE INFOCOM

ดร.หลี่ จาง เป็นผู้จัดการผลิตภัณฑ์หลักด้านเทคนิคสำหรับ Amazon SageMaker JumpStart และ อัลกอริทึมในตัวของ Amazon SageMakerซึ่งเป็นบริการที่ช่วยให้นักวิทยาศาสตร์ข้อมูลและผู้ปฏิบัติงานด้านแมชชีนเลิร์นนิงเริ่มต้นการฝึกอบรมและปรับใช้โมเดลและการใช้งานของตน การเรียนรู้การเสริมแรง ด้วย Amazon SageMaker ผลงานที่ผ่านมาของเขาในฐานะเจ้าหน้าที่วิจัยหลักและนักประดิษฐ์ระดับปรมาจารย์ที่ IBM Research ได้รับรางวัล รางวัลการทดสอบกระดาษเวลา ที่ IEEE INFOCOM

ดร.ฉางซา หม่า เป็นผู้เชี่ยวชาญด้าน AI/ML ที่ AWS เธอเป็นนักเทคโนโลยีที่มีปริญญาเอกด้านวิทยาการคอมพิวเตอร์ ปริญญาโทด้านจิตวิทยาการศึกษา และมีประสบการณ์หลายปีในด้านวิทยาศาสตร์ข้อมูลและการให้คำปรึกษาอิสระด้าน AI/ML เธอมีความกระตือรือร้นในการค้นคว้าแนวทางระเบียบวิธีสำหรับเครื่องจักรและความฉลาดของมนุษย์ นอกเวลาทำงาน เธอชอบเดินป่า ทำอาหาร ล่าสัตว์ ให้คำปรึกษาแก่นักศึกษาเกี่ยวกับการเป็นผู้ประกอบการ และใช้เวลากับเพื่อนและครอบครัว

ดร.ฉางซา หม่า เป็นผู้เชี่ยวชาญด้าน AI/ML ที่ AWS เธอเป็นนักเทคโนโลยีที่มีปริญญาเอกด้านวิทยาการคอมพิวเตอร์ ปริญญาโทด้านจิตวิทยาการศึกษา และมีประสบการณ์หลายปีในด้านวิทยาศาสตร์ข้อมูลและการให้คำปรึกษาอิสระด้าน AI/ML เธอมีความกระตือรือร้นในการค้นคว้าแนวทางระเบียบวิธีสำหรับเครื่องจักรและความฉลาดของมนุษย์ นอกเวลาทำงาน เธอชอบเดินป่า ทำอาหาร ล่าสัตว์ ให้คำปรึกษาแก่นักศึกษาเกี่ยวกับการเป็นผู้ประกอบการ และใช้เวลากับเพื่อนและครอบครัว

- เนื้อหาที่ขับเคลื่อนด้วย SEO และการเผยแพร่ประชาสัมพันธ์ รับการขยายวันนี้

- เพลโตไอสตรีม. ข้อมูลอัจฉริยะ Web3 ขยายความรู้ เข้าถึงได้ที่นี่.

- การสร้างอนาคตโดย Adryenn Ashley เข้าถึงได้ที่นี่.

- ซื้อและขายหุ้นในบริษัท PRE-IPO ด้วย PREIPO® เข้าถึงได้ที่นี่.

- ที่มา: https://aws.amazon.com/blogs/machine-learning/dialogue-guided-intelligent-document-processing-with-foundation-models-on-amazon-sagemaker-jumpstart/

- :มี

- :เป็น

- :ไม่

- ][หน้า

- $ ขึ้น

- 000

- 1

- 10

- 100

- 12

- 20

- 2023

- 7

- 8th

- a

- ความสามารถ

- เกี่ยวกับเรา

- ข้างบน

- ยอมรับ

- เข้า

- การเข้าถึง

- บรรลุผล

- ลงชื่อเข้าใช้

- บัญชี

- ความถูกต้อง

- ถูกต้อง

- บรรลุ

- รับทราบ

- ที่ได้มา

- ข้าม

- การกระทำ

- การปฏิบัติ

- คล่องแคล่ว

- ปรับ

- ที่เพิ่ม

- เพิ่ม

- เพิ่มเติม

- นอกจากนี้

- ที่อยู่

- ที่อยู่

- การนำ

- การนำมาใช้

- สูง

- ความก้าวหน้า

- ความได้เปรียบ

- ได้เปรียบ

- ข้อได้เปรียบ

- หลังจาก

- กับ

- ตัวแทน

- AI

- ขับเคลื่อนด้วย AI

- AI / ML

- ขั้นตอนวิธี

- อัลกอริทึม

- ทั้งหมด

- การอนุญาต

- ช่วยให้

- ด้วย

- ทางเลือก

- แม้ว่า

- อเมซอน

- อเมซอน เคนดรา

- อเมซอน SageMaker

- Amazon SageMaker JumpStart

- Amazon Text

- ถอดความจากอเมซอน

- Amazon Web Services

- จำนวน

- an

- การวิเคราะห์

- วิเคราะห์

- วิเคราะห์

- และ

- คำตอบ

- คำตอบ

- ที่คาดว่าจะ

- ใด

- API

- การเข้าถึง API

- APIs

- การใช้งาน

- การใช้งาน

- ประยุกต์

- การประยุกต์ใช้

- ความชื่นชม

- เข้าใกล้

- วิธีการ

- เหมาะสม

- ปพลิเคชัน

- เมษายน

- เป็น

- พื้นที่

- รอบ

- แถว

- AS

- ที่ได้รับมอบหมาย

- ความช่วยเหลือ

- ที่เกี่ยวข้อง

- At

- การประมูล

- เสียง

- ความจริง

- ผู้เขียน

- โดยอัตโนมัติ

- อัตโนมัติ

- อัตโนมัติ

- อิสระ

- ตนเอง

- ใช้ได้

- ค่าเฉลี่ย

- AWS

- AWS Marketplace

- กลับ

- พื้นหลัง

- ธนาคาร

- การธนาคาร

- ระบบธนาคาร

- ตาม

- ขั้นพื้นฐาน

- BE

- เพราะ

- กลายเป็น

- จะกลายเป็น

- รับ

- ก่อน

- เริ่ม

- ประโยชน์ที่ได้รับ

- ที่ดีที่สุด

- ดีกว่า

- ระหว่าง

- เกิน

- อคติ

- ลำเอียง

- พันล้าน

- ปิดกั้น

- Blocks

- คณะกรรมการ

- หนุน

- เพิ่ม

- การละเมิด

- ทำลาย

- การแก้

- กว้าง

- ที่กว้างขึ้น

- กันชน

- สร้าง

- การก่อสร้าง

- built-in

- ธุรกิจ

- แต่

- by

- โทรศัพท์

- CAN

- ความสามารถในการ

- สามารถ

- ความจุ

- พกพา

- การปฏิบัติ

- กรณี

- ศูนย์

- โซ่

- ห่วงโซ่

- ท้าทาย

- ความท้าทาย

- การเปลี่ยนแปลง

- ตัวอักษร

- การรู้จำอักขระ

- การไล่ล่า

- Choose

- เลือก

- สถานการณ์

- ชั้น

- เมฆ

- Cluster

- การจัดกลุ่ม

- รหัส

- ล่มสลาย

- วิทยาลัย

- การผสมผสาน

- รวมกัน

- รวม

- ร่วมกัน

- เปรียบเทียบ

- เมื่อเทียบกับ

- การเปรียบเทียบ

- สมบูรณ์

- เสร็จ

- เสร็จสิ้น

- เสร็จสิ้น

- ซับซ้อน

- ส่วนประกอบ

- เข้าใจ

- ครอบคลุม

- คอมพิวเตอร์

- วิทยาการคอมพิวเตอร์

- คอมพิวเตอร์

- แนวคิด

- ความกังวลเกี่ยวกับ

- การประชุม

- การเชื่อมต่อ

- ดังนั้น

- พิจารณา

- ข้อ จำกัด

- สร้าง

- การให้คำปรึกษา

- เนื้อหา

- สิ่งแวดล้อม

- บริบท

- ตามบริบท

- ต่อ

- ต่อเนื่องกัน

- ผลงาน

- สะดวกสบาย

- การสนทนา

- การสนทนา

- การแปลง

- แปลง

- ราคา

- แพง

- ได้

- สร้าง

- การสร้าง

- การสร้าง

- สำคัญมาก

- วัฒนธรรม

- ปัจจุบัน

- สถานะปัจจุบัน

- ตัดขอบ

- วงจร

- ข้อมูล

- ความลำเอียงของข้อมูล

- จุดข้อมูล

- วิทยาศาสตร์ข้อมูล

- ความปลอดภัยของข้อมูล

- ฐานข้อมูล

- ฐานข้อมูล

- การซื้อขาย

- การตัดสินใจ

- ทุ่มเท

- ลึก

- การเรียนรู้ลึก ๆ

- องศา

- มอบ

- คุ้ย

- แสดงให้เห็นถึง

- ปรับใช้

- นำไปใช้

- ปรับใช้

- การใช้งาน

- เงินฝาก

- ที่ได้มา

- ออกแบบ

- ได้รับการออกแบบ

- แม้จะมี

- รายละเอียด

- การกำหนด

- พัฒนา

- ที่กำลังพัฒนา

- การพัฒนา

- บทสนทนา

- Dict

- DID

- ต่าง

- ความยากลำบาก

- โดยตรง

- พูดคุย

- หลาย

- เอกสาร

- การจัดการเอกสาร

- เอกสาร

- ทำ

- โดเมน

- ลง

- การขับขี่

- สอง

- ระยะเวลา

- ในระหว่าง

- e

- แต่ละ

- ง่ายดาย

- ง่าย

- การศึกษา

- มีประสิทธิภาพ

- ประสิทธิผล

- อย่างมีประสิทธิภาพ

- ที่มีประสิทธิภาพ

- อย่างมีประสิทธิภาพ

- ธาตุ

- ฝัง

- การฝัง

- เพิ่มขีดความสามารถ

- ทำให้สามารถ

- ช่วยให้

- การเปิดใช้งาน

- ปลายทาง

- เครื่องยนต์

- เครื่องยนต์

- เสริม

- ที่เพิ่มขึ้น

- ช่วย

- การเสริมสร้าง

- พอ

- การสร้างความมั่นใจ

- การป้อน

- Enterprise

- ทั้งหมด

- ผู้ประกอบการ

- ยุค

- ความผิดพลาด

- ข้อผิดพลาด

- ก่อตั้ง

- เหตุการณ์

- คาย

- ตรวจสอบ

- การตรวจสอบ

- ตัวอย่าง

- ตัวอย่าง

- ยกเว้น

- แลกเปลี่ยน

- การปฏิบัติ

- ที่มีอยู่

- แสดง

- ประสบการณ์

- อธิบาย

- อธิบาย

- สำรวจ

- ด่วน

- กว้างขวาง

- ภายนอก

- อย่างผิวเผิน

- สารสกัด

- สารสกัดจาก

- ใบหน้า

- อำนวยความสะดวก

- อำนวยความสะดวก

- ล้มเหลว

- ความล้มเหลว

- ความล้มเหลว

- ครอบครัว

- เชื่อมั่น

- ลักษณะ

- คุณสมบัติ

- เฟด

- รัฐบาลกลาง

- ธนาคารกลางสหรัฐฯ

- เฟดเดอรัล

- ข้อเสนอแนะ

- เนื้อไม่มีมัน

- ไฟล์

- ใส่

- สุดท้าย

- ในที่สุด

- เงินทุน

- หา

- เสร็จสิ้น

- ชื่อจริง

- การแก้ไข

- ขึ้น ๆ ลง ๆ

- มุ่งเน้นไปที่

- โดยมุ่งเน้น

- ดังต่อไปนี้

- อาหาร

- สำหรับ

- ฟอร์ม

- รูป

- รูปแบบ

- รากฐาน

- FRAME

- กรอบ

- ความบ้า

- บ่อย

- เพื่อน

- ราคาเริ่มต้นที่

- ด้านหน้า

- เชื้อเพลิง

- เต็ม

- อย่างเต็มที่

- ฟังก์ชั่น

- การทำงาน

- ฟังก์ชั่น

- เงิน

- ต่อไป

- ฟิวเจอร์ส

- ช่องว่าง

- ช่องว่าง

- รวมตัวกัน

- สร้าง

- สร้าง

- สร้าง

- การสร้าง

- รุ่น

- กำเนิด

- กำเนิด AI

- จอร์เจีย

- ได้รับ

- GitHub

- เป้าหมาย

- ไป

- อย่างมาก

- แหวกแนว

- รากฐาน

- การเจริญเติบโต

- ให้คำแนะนำ

- มี

- การจัดการ

- ที่เกิดขึ้น

- เป็นอันตราย

- การควบคุม

- มี

- he

- สุขภาพ

- การดูแลสุขภาพ

- ช่วย

- จะช่วยให้

- จุดสูง

- ไฮไลท์

- ของเขา

- ประวัติ

- ถือ

- โฮลดิ้ง

- สรุป ความน่าเชื่อถือของ Olymp Trade?

- อย่างไรก็ตาม

- HTML

- HTTPS

- เป็นมนุษย์

- สติปัญญาของมนุษย์

- ร้อย

- การล่าสัตว์

- i

- ไอบีเอ็ม

- ในอุดมคติ

- ความคิด

- ระบุ

- แยกแยะ

- ระบุ

- อีอีอี

- if

- อิลลินอยส์

- แสดงให้เห็นถึง

- ภาพ

- ภาพ

- การดำเนินการ

- ผลกระทบ

- นำเข้า

- สำคัญ

- ปรับปรุง

- การปรับปรุง

- การปรับปรุง

- การปรับปรุง

- in

- ในอื่น ๆ

- ไม่เที่ยง

- ประกอบด้วย

- รวมถึง

- รวมทั้ง

- รวมทั้ง

- Incorporated

- ผสมผสาน

- เพิ่ม

- เพิ่มขึ้น

- ที่เพิ่มขึ้น

- อิสระ

- ดัชนี

- ดัชนี

- เป็นรายบุคคล

- ข้อมูล

- การสกัดข้อมูล

- เริ่มต้น

- นวัตกรรม

- อินพุต

- ปัจจัยการผลิต

- สอบถาม

- การสอบสวน

- ตัวอย่าง

- แทน

- คำแนะนำการใช้

- สำคัญ

- รวบรวม

- การบูรณาการ

- บูรณาการ

- Intelligence

- ฉลาด

- การประมวลผลเอกสารอัจฉริยะ

- โต้ตอบ

- การมีปฏิสัมพันธ์

- ปฏิสัมพันธ์

- ปฏิสัมพันธ์

- การโต้ตอบ

- อินเตอร์เฟซ

- เข้าไป

- แนะนำ

- ใช้งานง่าย

- สอบสวน

- ปัญหา

- IT

- การย้ำ

- ITS

- ตัวเอง

- jpg

- JPMorgan

- jpmorgan ไล่ล่า

- JSON

- เพียงแค่

- คีย์

- ทราบ

- ความรู้

- ที่รู้จักกัน

- ห้องปฏิบัติการ

- ไม่มี

- ภาษา

- ใหญ่

- ปลาย

- ต่อมา

- วาง

- นำ

- ชั้นนำ

- เรียนรู้

- การเรียนรู้

- น้อยที่สุด

- มรดก

- น้อยลง

- Li

- ห้องสมุด

- ตั้งอยู่

- กดไลก์

- น่าจะ

- ข้อ จำกัด

- ถูก จำกัด

- Line

- การเชื่อมโยง

- สภาพคล่อง

- รายการ

- รายการ

- LLM

- loader

- ในประเทศ

- ในท้องถิ่น

- การเข้าสู่ระบบ

- อีกต่อไป

- ดู

- รัก

- ต่ำ

- เครื่อง

- เรียนรู้เครื่อง

- เครื่อง

- ทำ

- การบำรุงรักษา

- รักษา

- ทำ

- การทำ

- จัดการ

- การจัดการ

- การจัดการ

- ผู้จัดการ

- การบริหารจัดการ

- การจัดการ

- คู่มือ

- หลาย

- มีนาคม

- ตลาด

- ตลาด

- มาก

- เจ้านาย

- ปริญญาโท

- การจับคู่

- เพิ่ม

- อาจ..

- มีความหมาย

- วิธี

- กลไก

- ภาพบรรยากาศ

- สมาชิก

- หน่วยความจำ

- การให้คำปรึกษา

- ข่าวสาร

- ข้อความ

- เมตาดาต้า

- วิธี

- วิธีการ

- การลด

- นาที

- หายไป

- การบรรเทา

- ML

- แบบ

- โมเดล

- โมดูลาร์

- โมดูล

- เงิน

- เดือน

- ข้อมูลเพิ่มเติม

- มีประสิทธิภาพมากขึ้น

- ยิ่งไปกว่านั้น

- มากที่สุด

- หลาย

- ต้อง

- ชื่อ

- โดยธรรมชาติ

- จำเป็น

- จำเป็นต้อง

- จำเป็น

- ความต้องการ

- ใหม่

- NLP

- โดดเด่น

- นวนิยาย

- ตอนนี้

- จำนวน

- มึน

- วัตถุประสงค์

- วัตถุประสงค์

- ได้รับ

- ที่ได้รับ

- ที่เกิดขึ้น

- OCR

- of

- ปิด

- เสนอ

- on

- ONE

- คน

- ต่อเนื่อง

- เพียง

- โอเพนซอร์ส

- OpenAI

- การเปิด

- ดำเนินการ

- ตรงข้าม

- การรู้จำอักขระด้วยแสง

- เพิ่มประสิทธิภาพ

- or

- ใบสั่ง

- องค์กร

- เป็นต้นฉบับ

- OS

- อื่นๆ

- ของเรา

- ออก

- ผล

- ผลลัพธ์

- เอาท์พุต

- ด้านนอก

- เกิน

- ทั้งหมด

- เอาชนะ

- ของตนเอง

- หน้า

- กระดาษ

- เอกสาร

- Parallel

- พารามิเตอร์

- ส่วน

- หลงใหล

- อดีต

- เส้นทาง

- รูปแบบไฟล์ PDF

- ดำเนินการ

- การปฏิบัติ

- ภาพ

- ชิ้น

- ท่อ

- สถานที่

- แพลตฟอร์ม

- เพลโต

- เพลโตดาต้าอินเทลลิเจนซ์

- เพลโตดาต้า

- กรุณา

- จุด

- ยอดนิยม

- ตำแหน่ง

- โพสต์

- ที่มีศักยภาพ

- ที่มีประสิทธิภาพ

- จำเป็นต้อง

- ความแม่นยำ

- Predictor

- นำเสนอ

- ป้องกัน

- ก่อน

- หลัก

- ก่อน

- จัดลำดับความสำคัญ

- จัดลำดับความสำคัญ

- ความเป็นส่วนตัว

- ความเป็นส่วนตัวและความปลอดภัย

- ส่วนตัว

- ปัญหา

- การแก้ปัญหา

- กระบวนการ

- กระบวนการ

- การประมวลผล

- ก่อ

- ผลิตภัณฑ์

- ประสิทธิผล

- ผลผลิต

- ความคืบหน้า

- คำมั่นสัญญา

- แวว

- เหมาะสม

- ให้

- ผู้จัดหา

- ผู้ให้บริการ

- ให้

- การให้

- จิตวิทยา

- สาธารณะ

- สาธารณสุข

- สิ่งพิมพ์

- การตีพิมพ์

- วัตถุประสงค์

- วัตถุประสงค์

- ไฟฉาย

- Q & A

- คุณภาพ

- คำสั่ง

- คำถาม

- คำถาม

- รวดเร็ว

- ได้เร็วขึ้น

- ตั้งแต่

- อันดับ

- ค่อนข้าง

- RAY

- อ่าน

- จริง

- เรียลไทม์

- รายรับ

- ที่ได้รับ

- เมื่อเร็ว ๆ นี้

- การรับรู้

- ลด

- ลดลง

- การฟอก

- กฎระเบียบ

- ที่เกี่ยวข้อง

- ตรงประเด็น

- น่าเชื่อถือ

- ความเชื่อมั่น

- ซากศพ

- ความทรงจำ

- วาทกรรม

- การปฏิรูป

- แสดง

- การแสดง

- เป็นตัวแทนของ

- สาธารณรัฐ

- ขอ

- ความต้องการ

- การวิจัย

- นักวิจัย

- สำรอง

- ความละเอียด

- ตอบสนอง

- คำตอบ

- การตอบสนอง

- รับผิดชอบ

- การตอบสนอง

- ผล

- ส่งผลให้

- ผลสอบ

- กลับ

- ปฏิวัติ

- ปฏิวัติ

- ความเสี่ยง

- แข็งแรง

- ลวก

- วิ่ง

- ไรอัน

- s

- ปลอดภัย

- sagemaker

- เดียวกัน

- ลด

- scalability

- วิทยาศาสตร์

- นักวิทยาศาสตร์

- นักวิทยาศาสตร์

- รอยขีดข่วน

- ค้นหา

- เครื่องมือค้นหา

- เครื่องมือค้นหา

- ภาค

- ความปลอดภัย

- ช่องโหว่ด้านความปลอดภัย

- เห็น

- กลุ่ม

- เลือก

- ตนเอง

- ระดับอาวุโส

- ประโยค

- แยก

- ลำดับ

- ลำดับ

- ชุด

- ให้บริการ

- ให้บริการอาหาร

- บริการ

- บริการ

- ชุด

- หลาย

- ชาร์ดดิ้ง

- เธอ

- น่า

- จัดแสดง

- แสดงให้เห็นว่า

- สำคัญ

- อย่างมีความหมาย

- ซิลิคอน

- หุบเขาซิลิคอน

- ธนาคาร Silicon Valley

- คล้ายคลึงกัน

- ง่าย

- ง่ายดาย

- เดียว

- ขนาด

- มีขนาดเล็กกว่า

- อย่างราบรื่น

- สังคม

- โซเชียลมีเดีย

- ทางออก

- โซลูชัน

- แหล่งที่มา

- ช่องว่าง

- ลำโพง

- ผู้เชี่ยวชาญ

- เฉพาะ

- พิเศษ

- โดยเฉพาะ

- เฉพาะ

- สเปกตรัม

- การพูด

- การรู้จำเสียง

- การใช้จ่าย

- แยก

- แยก

- ทักษะ

- ผู้มีส่วนได้เสีย

- สแตนด์อโลน

- ข้อความที่เริ่ม

- สถานะ

- Status

- ขั้นตอน

- ยังคง

- จัดเก็บ

- เก็บไว้

- ร้านค้า

- การเก็บรักษา

- กลยุทธ์

- กระแส

- ที่พริ้ว

- เพรียวลม

- การทำให้เพรียวลม

- เชือก

- นักเรียน

- สตูดิโอ

- เป็นกอบเป็นกำ

- ความสำเร็จ

- ที่ประสบความสำเร็จ

- ประสบความสำเร็จ

- อย่างเช่น

- สรุป

- เหนือกว่า

- รองรับ

- ที่ล้อมรอบ

- ฉลาด

- ส.ว

- ระบบ

- ระบบ

- เอา

- การ

- งาน

- งาน

- ทีม

- เทคโนโลยี

- วิชาการ

- เทคนิค

- เทคโนโลยี

- นักเทคโนโลยี

- เทคโนโลยี

- เงื่อนไขการใช้บริการ

- กว่า

- ที่

- พื้นที่

- เฟด

- ข้อมูล

- โลก

- ของพวกเขา

- พวกเขา

- แล้วก็

- ที่นั่น

- ล้อยางขัดเหล่านี้ติดตั้งบนแกน XNUMX (มม.) ผลิตภัณฑ์นี้ถูกผลิตในหลายรูปทรง และหลากหลายเบอร์ความแน่นหนาของปริมาณอนุภาคขัดของมัน จะทำให้ท่านได้รับประสิทธิภาพสูงในการขัดและการใช้งานที่ยาวนาน

- พวกเขา

- คิด

- ของบุคคลที่สาม

- นี้

- เหล่านั้น

- คิดว่า

- ตลอด

- ตลอด

- ผูก

- เวลา

- ต้องใช้เวลามาก

- ไทม์ไลน์

- ไปยัง

- ราชสกุล

- แบบดั้งเดิม

- ผ่านการฝึกอบรม

- การฝึกอบรม

- แปลง

- กระแส

- เปลี่ยน

- หม้อแปลง

- จริง

- ลอง

- สอง

- ชนิด

- ชนิด

- ในที่สุด

- ไม่สามารถ

- เข้าใจ

- ความเข้าใจ

- เข้าใจ

- ปึกแผ่น

- หน่วย

- มหาวิทยาลัย

- ปลดล็อก

- ทันเหตุการณ์

- การปรับปรุง

- อัปโหลด

- ด่วน

- URL

- us

- การใช้

- ใช้

- มือสอง

- ผู้ใช้งาน

- ประสบการณ์ของผู้ใช้

- ที่ใช้งานง่าย

- ผู้ใช้

- การใช้

- ประโยชน์

- นำไปใช้

- ใช้ประโยชน์

- หุบเขา

- มีคุณค่า

- ต่างๆ

- กว้างใหญ่

- ตรวจสอบ

- ผ่านทาง

- วีดีโอ

- วิดีโอ

- เสมือน

- จำเป็น

- เสียงพูด

- ไดรฟ์

- W

- คือ

- ทาง..

- we

- ความมั่งคั่ง

- เว็บ

- บริการเว็บ

- ดี

- คือ

- อะไร

- เมื่อ

- ที่

- ในขณะที่

- จะ

- กับ

- ภายใน

- ไม่มี

- วอน

- คำ

- คำ

- งาน

- ขั้นตอนการทำงาน

- การทำงาน

- โรงงาน

- โลก

- จะ

- ปี

- ยอมให้

- คุณ

- ของคุณ

- ลมทะเล