บล็อกโพสต์นี้เขียนร่วมโดย Guillermo Ribeiro Sr. Data Scientist ที่ Cepsa

แมชชีนเลิร์นนิง (ML) ได้พัฒนาอย่างรวดเร็วจากการเป็นเทรนด์แฟชั่นที่เกิดขึ้นจากสภาพแวดล้อมทางวิชาการและแผนกนวัตกรรม กลายเป็นวิธีการสำคัญในการมอบคุณค่าให้กับธุรกิจในทุกอุตสาหกรรม การเปลี่ยนจากการทดลองในห้องปฏิบัติการไปสู่การแก้ปัญหาจริงในสภาพแวดล้อมการผลิตนั้นต้องไปด้วยกัน ม.ป.ปหรือการปรับ DevOps ให้เข้ากับโลก ML

MLOps ช่วยเพิ่มความคล่องตัวและทำให้วงจรชีวิตเต็มรูปแบบของโมเดล ML เป็นอัตโนมัติ โดยให้ความสำคัญกับชุดข้อมูลต้นทาง ความสามารถในการทำซ้ำของการทดสอบ โค้ดอัลกอริธึม ML และคุณภาพของโมเดล

At Cepsaซึ่งเป็นบริษัทด้านพลังงานระดับโลก เราใช้ ML เพื่อจัดการกับปัญหาที่ซับซ้อนในสายธุรกิจของเรา ตั้งแต่การบำรุงรักษาเชิงคาดการณ์สำหรับอุปกรณ์อุตสาหกรรม ไปจนถึงการตรวจสอบและปรับปรุงกระบวนการปิโตรเคมีที่โรงกลั่นของเรา

ในโพสต์นี้ เราพูดถึงวิธีที่เราสร้างสถาปัตยกรรมอ้างอิงสำหรับ MLO โดยใช้บริการหลักของ AWS ดังต่อไปนี้:

- อเมซอน SageMaker, บริการเพื่อสร้าง ฝึกฝน และปรับใช้โมเดล ML

- ฟังก์ชันขั้นตอนของ AWS, บริการเวิร์กโฟลว์วิชวลเวิร์กโฟลว์โค้ดต่ำแบบไร้เซิร์ฟเวอร์ที่ใช้ในการประสานและทำให้กระบวนการเป็นไปโดยอัตโนมัติ

- อเมซอน EventBridge, บัสเหตุการณ์แบบไร้เซิร์ฟเวอร์

- AWS แลมบ์ดา, บริการประมวลผลแบบไร้เซิร์ฟเวอร์ที่ให้คุณเรียกใช้โค้ดโดยไม่ต้องจัดเตรียมหรือจัดการเซิร์ฟเวอร์

เรายังอธิบายวิธีที่เราใช้สถาปัตยกรรมอ้างอิงนี้ในการบูตสแตรปโปรเจ็กต์ ML ใหม่ในบริษัทของเรา

ความท้าทาย

ในช่วง 4 ปีที่ผ่านมา ธุรกิจหลายสายใน Cepsa ได้เริ่มต้นโครงการ ML แต่ในไม่ช้า ปัญหาและข้อจำกัดบางอย่างก็เริ่มเกิดขึ้น

เราไม่มีสถาปัตยกรรมอ้างอิงสำหรับ ML ดังนั้นแต่ละโปรเจ็กต์จึงใช้เส้นทางการนำไปใช้ที่แตกต่างกัน ดำเนินการฝึกอบรมโมเดลเฉพาะกิจและการปรับใช้ หากไม่มีวิธีการทั่วไปในการจัดการโค้ดและพารามิเตอร์ของโปรเจ็กต์ และไม่มีรีจีสทรีโมเดล ML หรือระบบการกำหนดเวอร์ชัน เราสูญเสียความสามารถในการตรวจสอบย้อนกลับระหว่างชุดข้อมูล โค้ด และโมเดล

นอกจากนี้เรายังตรวจพบพื้นที่สำหรับการปรับปรุงในวิธีที่เราดำเนินการแบบจำลองในการผลิต เนื่องจากเราไม่ได้ตรวจสอบแบบจำลองที่ปรับใช้ ดังนั้นจึงไม่มีวิธีการติดตามประสิทธิภาพของแบบจำลอง ด้วยเหตุนี้ เราจึงมักจะฝึกอบรมแบบจำลองใหม่ตามตารางเวลา เนื่องจากเราขาดตัวชี้วัดที่เหมาะสมในการตัดสินใจฝึกอบรมซ้ำอย่างมีข้อมูล

การแก้ไขปัญหา

เริ่มต้นจากความท้าทายที่เราต้องเอาชนะ เราออกแบบโซลูชันทั่วไปที่มุ่งแยกการเตรียมข้อมูล การฝึกแบบจำลอง การอนุมาน และการตรวจสอบแบบจำลอง และนำเสนอการลงทะเบียนแบบจำลองแบบรวมศูนย์ ด้วยวิธีนี้ เราทำให้การจัดการสภาพแวดล้อมในบัญชี AWS หลายบัญชีง่ายขึ้น ในขณะที่แนะนำการตรวจสอบย้อนกลับของแบบจำลองจากส่วนกลาง

นักวิทยาศาสตร์และนักพัฒนาข้อมูลของเราใช้ AWS Cloud9 (Cloud IDE สำหรับการเขียน การรัน และการดีบักโค้ด) สำหรับการโต้แย้งข้อมูลและการทดลอง ML และ GitHub เป็นที่เก็บโค้ด Git

เวิร์กโฟลว์การฝึกอบรมอัตโนมัติใช้รหัสที่สร้างโดยทีมวิทยาศาสตร์ข้อมูลเพื่อ โมเดลรถไฟบน SageMaker และลงทะเบียนโมเดลเอาต์พุตในรีจีสทรีโมเดล

เวิร์กโฟลว์อื่นจัดการการปรับใช้โมเดล: รับการอ้างอิงจากรีจีสทรีโมเดลและสร้างจุดสิ้นสุดการอนุมานโดยใช้ คุณสมบัติโฮสต์โมเดล SageMaker.

เราใช้ทั้งการฝึกอบรมแบบจำลองและเวิร์กโฟลว์การปรับใช้โดยใช้ Step Functions เนื่องจากได้จัดเตรียมเฟรมเวิร์กที่ยืดหยุ่นซึ่งช่วยให้สามารถสร้างเวิร์กโฟลว์เฉพาะสำหรับแต่ละโปรเจ็กต์และประสานบริการและส่วนประกอบต่างๆ ของ AWS ด้วยวิธีที่ตรงไปตรงมา

รูปแบบการใช้ข้อมูล

ใน Cepsa เราใช้ Data Lake ชุดหนึ่งเพื่อครอบคลุมความต้องการทางธุรกิจที่หลากหลาย และ Data Lake ทั้งหมดเหล่านี้ใช้รูปแบบการใช้ข้อมูลร่วมกัน ซึ่งช่วยให้วิศวกรข้อมูลและนักวิทยาศาสตร์ข้อมูลสามารถค้นหาและใช้ข้อมูลที่ต้องการได้ง่ายขึ้น

เพื่อให้จัดการต้นทุนและความรับผิดชอบได้อย่างง่ายดาย สภาพแวดล้อม Data Lake จะถูกแยกออกจากแอปพลิเคชันของผู้ผลิตข้อมูลและผู้บริโภคโดยสิ้นเชิง และปรับใช้ในบัญชี AWS ต่างๆ ที่เป็นขององค์กร AWS ทั่วไป

ข้อมูลที่ใช้ในการฝึกโมเดล ML และข้อมูลที่ใช้เป็นอินพุตการอนุมานสำหรับโมเดลที่ผ่านการฝึกอบรมนั้นมาจาก Data Lake ต่างๆ ผ่านชุดของ API ที่กำหนดไว้อย่างดีโดยใช้ Amazon API Gateway Amazonซึ่งเป็นบริการในการสร้าง เผยแพร่ บำรุงรักษา ตรวจสอบ และรักษาความปลอดภัย APIs ตามขนาด แบ็กเอนด์ API ใช้ อเมซอน อาเธน่า (บริการสืบค้นข้อมูลเชิงโต้ตอบเพื่อวิเคราะห์ข้อมูลโดยใช้ SQL มาตรฐาน) เพื่อเข้าถึงข้อมูลที่จัดเก็บไว้ใน บริการจัดเก็บข้อมูลอย่างง่ายของ Amazon (Amazon S3) และจัดหมวดหมู่ไว้ใน AWS กาว แคตตาล็อกข้อมูล

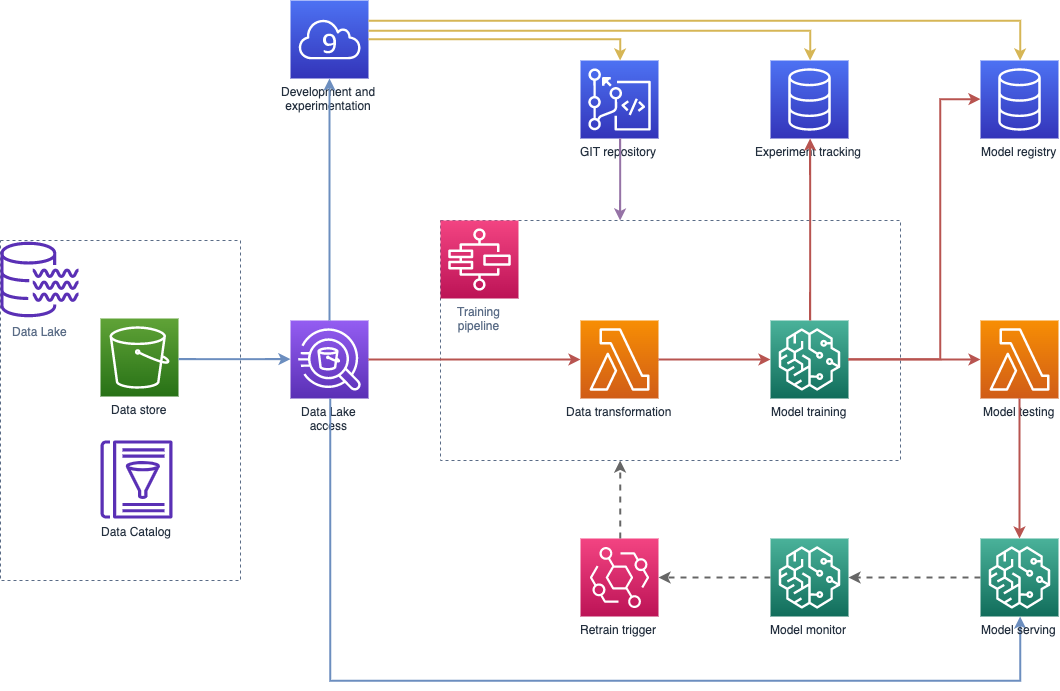

ไดอะแกรมต่อไปนี้แสดงภาพรวมทั่วไปของสถาปัตยกรรม MLOps ของ Cepsa

การฝึกโมเดล

ขั้นตอนการฝึกอบรมไม่ขึ้นกับแต่ละรุ่นและดูแลโดย a ขั้นตอนการทำงานมาตรฐานเวิร์กโฟลว์ซึ่งช่วยให้เรามีความยืดหยุ่นในการสร้างแบบจำลองตามข้อกำหนดของโครงการที่แตกต่างกัน เรามีเทมเพลตพื้นฐานที่กำหนดไว้ซึ่งเราใช้ซ้ำกับโปรเจ็กต์ส่วนใหญ่ โดยจะทำการปรับเปลี่ยนเล็กน้อยเมื่อจำเป็น ตัวอย่างเช่น เจ้าของโปรเจ็กต์บางรายตัดสินใจเพิ่มเกทด้วยตนเองเพื่ออนุมัติการปรับใช้โมเดลการผลิตใหม่ ในขณะที่เจ้าของโปรเจ็กต์รายอื่นๆ ได้ใช้กลไกการตรวจจับข้อผิดพลาดของตนเองและลองใหม่อีกครั้ง

เรายังทำการแปลงชุดข้อมูลอินพุตที่ใช้สำหรับการฝึกโมเดล เพื่อจุดประสงค์นี้ เราใช้ฟังก์ชัน Lambda ที่รวมอยู่ในเวิร์กโฟลว์การฝึกอบรม ในบางสถานการณ์ที่จำเป็นต้องมีการแปลงข้อมูลที่ซับซ้อนมากขึ้น เราเรียกใช้โค้ดของเราใน บริการ Amazon Elastic Container (Amazon ECS) บน AWS ฟาร์เกตซึ่งเป็นเอ็นจิ้นประมวลผลแบบไร้เซิร์ฟเวอร์เพื่อรันคอนเทนเนอร์

ทีมวิทยาศาสตร์ข้อมูลของเราใช้อัลกอริธึมแบบกำหนดเองบ่อยครั้ง ดังนั้นเราจึงใช้ประโยชน์จากความสามารถในการ ใช้คอนเทนเนอร์ที่กำหนดเองในการฝึกโมเดล SageMaker, พึ่งพา การลงทะเบียน Amazon Elastic Container (Amazon ECR) รีจิสตรีคอนเทนเนอร์ที่มีการจัดการเต็มรูปแบบที่ทำให้ง่ายต่อการจัดเก็บ จัดการ แชร์ และปรับใช้อิมเมจคอนเทนเนอร์

โครงการ ML ส่วนใหญ่ของเราใช้ไลบรารี Scikit-learn ดังนั้นเราจึงได้ขยายมาตรฐาน SageMaker Scikit-เรียนรู้คอนเทนเนอร์ เพื่อรวมตัวแปรสภาพแวดล้อมที่จำเป็นสำหรับโครงการ เช่น ข้อมูลที่เก็บ Git และตัวเลือกการปรับใช้

ด้วยวิธีนี้ นักวิทยาศาสตร์ด้านข้อมูลของเราต้องมุ่งเน้นที่การพัฒนาอัลกอริธึมการฝึกอบรมและระบุไลบรารีที่โครงการต้องการ เมื่อพวกเขาผลักดันการเปลี่ยนแปลงโค้ดไปยังที่เก็บ Git ระบบ CI/CD ของเรา (เจนกิ้นส์ โฮสต์บน AWS) สร้างคอนเทนเนอร์ด้วยรหัสการฝึกอบรมและไลบรารี คอนเทนเนอร์นี้ถูกส่งไปยัง Amazon ECR และในที่สุดก็ส่งผ่านเป็นพารามิเตอร์ไปยังการเรียกใช้การฝึกอบรม SageMaker

เมื่อกระบวนการฝึกอบรมเสร็จสิ้น โมเดลผลลัพธ์จะถูกเก็บไว้ใน Amazon S3 ข้อมูลอ้างอิงจะถูกเพิ่มในการลงทะเบียนแบบจำลอง และข้อมูลที่รวบรวมและตัววัดทั้งหมดจะถูกบันทึกไว้ในแค็ตตาล็อกการทดลอง สิ่งนี้ทำให้มั่นใจได้ถึงความสามารถในการทำซ้ำได้อย่างสมบูรณ์เนื่องจากโค้ดอัลกอริธึมและไลบรารีเชื่อมโยงกับโมเดลที่ได้รับการฝึกอบรมพร้อมกับข้อมูลที่เกี่ยวข้องกับการทดสอบ

ไดอะแกรมต่อไปนี้แสดงให้เห็นถึงการฝึกแบบจำลองและกระบวนการฝึกอบรมซ้ำ

การปรับใช้โมเดล

สถาปัตยกรรมมีความยืดหยุ่นและช่วยให้ปรับใช้โมเดลที่ผ่านการฝึกอบรมทั้งแบบอัตโนมัติและด้วยตนเอง เวิร์กโฟลว์ตัวปรับใช้โมเดลถูกเรียกใช้โดยอัตโนมัติโดยใช้เหตุการณ์ที่การฝึก SageMaker เผยแพร่ใน EventBridge หลังจากการฝึกอบรมเสร็จสิ้น แต่สามารถเรียกใช้ด้วยตนเองได้หากจำเป็น โดยส่งเวอร์ชันรุ่นที่ถูกต้องจากการลงทะเบียนรุ่น สำหรับข้อมูลเพิ่มเติมเกี่ยวกับการเรียกอัตโนมัติ โปรดดูที่ ทำให้ Amazon SageMaker ทำงานอัตโนมัติด้วย Amazon EventBridge.

เวิร์กโฟลว์ตัวปรับใช้โมเดลดึงข้อมูลโมเดลจากการลงทะเบียนโมเดลและใช้ การก่อตัวของ AWS Cloudซึ่งเป็นโครงสร้างพื้นฐานที่มีการจัดการเป็นบริการโค้ด เพื่อปรับใช้โมเดลกับจุดสิ้นสุดการอนุมานตามเวลาจริง หรือทำการอนุมานแบบแบตช์ด้วยชุดข้อมูลอินพุตที่จัดเก็บไว้ ขึ้นอยู่กับข้อกำหนดของโปรเจ็กต์

เมื่อใดก็ตามที่ปรับใช้โมเดลได้สำเร็จในสภาพแวดล้อมใดๆ รีจิสทรีของโมเดลจะได้รับการอัปเดตด้วยแท็กใหม่ที่ระบุสภาพแวดล้อมที่โมเดลกำลังทำงานอยู่ ทุกครั้งที่ลบปลายทาง แท็กจะถูกลบออกจากรีจิสทรีของโมเดลด้วย

ไดอะแกรมต่อไปนี้แสดงเวิร์กโฟลว์สำหรับการปรับใช้โมเดลและการอนุมาน

การทดลองและการลงทะเบียนแบบจำลอง

การจัดเก็บทุกเวอร์ชันของการทดสอบและรุ่นในที่เดียวและการมีที่เก็บโค้ดแบบรวมศูนย์ช่วยให้เราสามารถแยกการฝึกอบรมและการปรับใช้โมเดล และใช้บัญชี AWS ที่แตกต่างกันสำหรับทุกโครงการและสภาพแวดล้อม

รายการการทดสอบทั้งหมดจัดเก็บรหัสการคอมมิตของรหัสการฝึกอบรมและการอนุมาน ดังนั้นเราจึงสามารถตรวจสอบย้อนกลับได้อย่างสมบูรณ์ของกระบวนการทดลองทั้งหมด และสามารถเปรียบเทียบการทดสอบต่างๆ ได้อย่างง่ายดาย สิ่งนี้ช่วยป้องกันไม่ให้เราทำงานซ้ำกันในขั้นตอนการสำรวจทางวิทยาศาสตร์สำหรับอัลกอริธึมและโมเดล และทำให้เราสามารถปรับใช้โมเดลของเราได้ทุกที่ โดยไม่ขึ้นกับบัญชีและสภาพแวดล้อมที่โมเดลได้รับการฝึกอบรม สิ่งนี้เป็นจริงสำหรับโมเดลที่ได้รับการฝึกฝนในสภาพแวดล้อมการทดลอง AWS Cloud9 ของเรา

โดยรวมแล้ว เรามีการฝึกโมเดลแบบอัตโนมัติและไปป์ไลน์การปรับใช้ และมีความยืดหยุ่นในการดำเนินการปรับใช้โมเดลด้วยตนเองอย่างรวดเร็วเมื่อบางอย่างทำงานไม่ถูกต้องหรือเมื่อทีมต้องการโมเดลที่ปรับใช้กับสภาพแวดล้อมที่แตกต่างกันเพื่อวัตถุประสงค์ในการทดลอง

กรณีการใช้งานโดยละเอียด: โครงการ YET Dragon

โครงการ YET Dragon มีเป้าหมายเพื่อปรับปรุงประสิทธิภาพการผลิตของโรงงานปิโตรเคมีของ Cepsa ในเซี่ยงไฮ้ เพื่อให้บรรลุเป้าหมายนี้ เราได้ศึกษากระบวนการผลิตอย่างละเอียด โดยมองหาขั้นตอนที่มีประสิทธิภาพน้อยกว่า เป้าหมายของเราคือเพิ่มประสิทธิภาพผลผลิตของกระบวนการโดยรักษาความเข้มข้นของส่วนประกอบให้ต่ำกว่าเกณฑ์พอดี

เพื่อจำลองกระบวนการนี้ เราได้สร้างแบบจำลองสารเติมแต่งทั่วไปหรือ GAM สี่ตัว ซึ่งเป็นแบบจำลองเชิงเส้นตรงที่การตอบสนองขึ้นอยู่กับฟังก์ชันที่ราบรื่นของตัวแปรทำนาย เพื่อทำนายผลลัพธ์ของกระบวนการออกซิเดชันสองกระบวนการ กระบวนการความเข้มข้นหนึ่งกระบวนการ และผลผลิตดังกล่าว เรายังได้สร้างเครื่องมือเพิ่มประสิทธิภาพเพื่อประมวลผลผลลัพธ์ของแบบจำลอง GAM ทั้งสี่แบบ และค้นหาการเพิ่มประสิทธิภาพที่ดีที่สุดที่สามารถนำไปใช้ในโรงงานได้

แม้ว่าแบบจำลองของเราจะได้รับการฝึกอบรมด้วยข้อมูลในอดีต แต่บางครั้งโรงงานก็สามารถทำงานได้ภายใต้สถานการณ์ที่ไม่ได้ลงทะเบียนในชุดข้อมูลการฝึกอบรม เราคาดหวังว่าแบบจำลองการจำลองของเราจะทำงานได้ไม่ดีภายใต้สถานการณ์เหล่านั้น ดังนั้นเราจึงสร้างแบบจำลองการตรวจจับความผิดปกติสองแบบโดยใช้อัลกอริธึม Isolation Forests ซึ่งจะกำหนดว่าจุดข้อมูลไปยังข้อมูลที่เหลือจะตรวจจับความผิดปกติได้ไกลแค่ไหน โมเดลเหล่านี้ช่วยให้เราตรวจพบสถานการณ์ดังกล่าวเพื่อปิดใช้งานกระบวนการปรับให้เหมาะสมอัตโนมัติเมื่อเกิดเหตุการณ์นี้ขึ้น

กระบวนการทางเคมีทางอุตสาหกรรมมีความแปรปรวนสูง และแบบจำลอง ML จำเป็นต้องได้รับการปรับให้สอดคล้องกับการดำเนินงานของโรงงาน ดังนั้นจึงต้องมีการฝึกอบรมซ้ำบ่อยครั้ง รวมทั้งการตรวจสอบย้อนกลับของแบบจำลองที่ปรับใช้ในแต่ละสถานการณ์ YET Dragon เป็นโครงการเพิ่มประสิทธิภาพ ML แรกของเราที่มีการลงทะเบียนแบบจำลอง การทดสอบซ้ำเต็มรูปแบบ และกระบวนการฝึกอบรมอัตโนมัติที่มีการจัดการเต็มรูปแบบ

ในตอนนี้ ไปป์ไลน์ที่สมบูรณ์ซึ่งนำโมเดลไปสู่การผลิต (การแปลงข้อมูล การฝึกโมเดล การติดตามการทดสอบ การลงทะเบียนโมเดล และการปรับใช้โมเดล) นั้นไม่ขึ้นกับแต่ละโมเดล ML ซึ่งช่วยให้เราปรับปรุงโมเดลซ้ำๆ ได้ (เช่น การเพิ่มตัวแปรใหม่หรือการทดสอบอัลกอริธึมใหม่) และเชื่อมต่อขั้นตอนการฝึกอบรมและการใช้งานกับทริกเกอร์ต่างๆ

ผลลัพธ์และการปรับปรุงในอนาคต

ขณะนี้เราสามารถฝึก ปรับใช้ และติดตามโมเดล ML หกแบบที่ใช้ในโปรเจ็กต์ YET Dragon ได้โดยอัตโนมัติ และเราได้ปรับใช้แล้วกว่า 30 เวอร์ชันสำหรับแต่ละโมเดลการผลิต สถาปัตยกรรม MLOps นี้ขยายไปยังโมเดล ML หลายร้อยรายการในโครงการอื่นๆ ทั่วทั้งบริษัท

เราวางแผนที่จะเปิดตัวโปรเจ็กต์ YET ใหม่อย่างต่อเนื่องโดยใช้สถาปัตยกรรมนี้ ซึ่งลดระยะเวลาเฉลี่ยของโปรเจ็กต์ลง 25% อันเนื่องมาจากการลดเวลาการบู๊ตและระบบอัตโนมัติของไปป์ไลน์ ML นอกจากนี้เรายังสามารถประหยัดเงินได้ประมาณ 300,000 ยูโรต่อปี เนื่องจากผลผลิตและความเข้มข้นที่เพิ่มขึ้นซึ่งเป็นผลมาจากโครงการ YET Dragon โดยตรง

วิวัฒนาการระยะสั้นของสถาปัตยกรรม MLOps นี้มุ่งไปที่การตรวจสอบแบบจำลองและการทดสอบอัตโนมัติ เราวางแผนที่จะทดสอบประสิทธิภาพของโมเดลโดยอัตโนมัติกับโมเดลที่ปรับใช้ก่อนหน้านี้ก่อนที่จะปรับใช้โมเดลใหม่ เรากำลังดำเนินการตรวจสอบแบบจำลองและการอนุมานข้อมูลการตรวจสอบการเลื่อนลอยด้วย การตรวจสอบโมเดล Amazon SageMaker, เพื่อให้การฝึกแบบจำลองใหม่เป็นแบบอัตโนมัติ

สรุป

บริษัทต่างๆ กำลังเผชิญกับความท้าทายในการนำโปรเจ็กต์ ML ไปสู่การผลิตในลักษณะอัตโนมัติและมีประสิทธิภาพ การทำให้วงจรชีวิตของโมเดล ML เป็นแบบอัตโนมัติช่วยลดเวลาของโปรเจ็กต์ และทำให้มั่นใจในคุณภาพของโมเดลที่ดีขึ้น และการปรับใช้ในการผลิตที่รวดเร็วและบ่อยขึ้น

ด้วยการพัฒนาสถาปัตยกรรม MLOps ที่ได้มาตรฐานซึ่งได้รับการยอมรับจากธุรกิจต่างๆ ทั่วทั้งบริษัท เราที่ Cepsa จึงสามารถเร่งความเร็วการบูตโปรเจ็กต์ ML และปรับปรุงคุณภาพของโมเดล ML ได้ โดยมอบกรอบการทำงานอัตโนมัติที่เชื่อถือได้ซึ่งทีมวิทยาศาสตร์ข้อมูลของเราสามารถสร้างสรรค์สิ่งใหม่ๆ ได้เร็วยิ่งขึ้น .

สำหรับข้อมูลเพิ่มเติมเกี่ยวกับ MLOps บน SageMaker โปรดไปที่ Amazon SageMaker สำหรับ MLOps และตรวจสอบกรณีการใช้งานอื่นๆ ของลูกค้าใน บล็อก AWS Machine Learning.

เกี่ยวกับผู้แต่ง

กีเยร์โม ริเบโร จิเมเนซ เป็น Sr Data Scientist ที่ Cepsa พร้อมปริญญาเอก ในสาขาฟิสิกส์นิวเคลียร์ เขามีประสบการณ์ 6 ปีในโครงการวิทยาศาสตร์ข้อมูล ส่วนใหญ่อยู่ในอุตสาหกรรมโทรคมนาคมและพลังงาน ปัจจุบันเขาเป็นผู้นำทีมนักวิทยาศาสตร์ข้อมูลในแผนก Digital Transformation ของ Cepsa โดยมุ่งเน้นที่การปรับขนาดและการผลิตโปรเจ็กต์แมชชีนเลิร์นนิง

กีเยร์โม ริเบโร จิเมเนซ เป็น Sr Data Scientist ที่ Cepsa พร้อมปริญญาเอก ในสาขาฟิสิกส์นิวเคลียร์ เขามีประสบการณ์ 6 ปีในโครงการวิทยาศาสตร์ข้อมูล ส่วนใหญ่อยู่ในอุตสาหกรรมโทรคมนาคมและพลังงาน ปัจจุบันเขาเป็นผู้นำทีมนักวิทยาศาสตร์ข้อมูลในแผนก Digital Transformation ของ Cepsa โดยมุ่งเน้นที่การปรับขนาดและการผลิตโปรเจ็กต์แมชชีนเลิร์นนิง

กีเยร์โม เมเนนเดซ คอร์ราล เป็นสถาปนิกโซลูชันที่ AWS Energy and Utilities เขามีประสบการณ์มากกว่า 15 ปีในการออกแบบและสร้างแอปพลิเคชัน SW และปัจจุบันให้คำแนะนำด้านสถาปัตยกรรมแก่ลูกค้า AWS ในอุตสาหกรรมพลังงาน โดยมุ่งเน้นที่การวิเคราะห์และการเรียนรู้ของเครื่อง

กีเยร์โม เมเนนเดซ คอร์ราล เป็นสถาปนิกโซลูชันที่ AWS Energy and Utilities เขามีประสบการณ์มากกว่า 15 ปีในการออกแบบและสร้างแอปพลิเคชัน SW และปัจจุบันให้คำแนะนำด้านสถาปัตยกรรมแก่ลูกค้า AWS ในอุตสาหกรรมพลังงาน โดยมุ่งเน้นที่การวิเคราะห์และการเรียนรู้ของเครื่อง

- คอยน์สมาร์ท การแลกเปลี่ยน Bitcoin และ Crypto ที่ดีที่สุดในยุโรป

- เพลโตบล็อคเชน Web3 Metaverse ข่าวกรอง ขยายความรู้. เข้าฟรี

- คริปโตฮอว์ก เรดาร์ Altcoin ทดลองฟรี.

- ที่มา: https://aws.amazon.com/blogs/machine-learning/how-cepsa-used-amazon-sagemaker-and-aws-step-functions-to-industrialize-their-ml-projects-and-operate- โมเดลของพวกเขาตามขนาด/

- "

- 000

- 100

- a

- ความสามารถ

- เกี่ยวกับเรา

- เข้า

- ลงชื่อเข้าใช้

- บรรลุ

- ข้าม

- Ad

- ที่เพิ่ม

- ความได้เปรียบ

- กับ

- ขั้นตอนวิธี

- อัลกอริทึม

- ทั้งหมด

- ช่วยให้

- แล้ว

- อเมซอน

- ในหมู่

- การวิเคราะห์

- วิเคราะห์

- ทุกแห่ง

- API

- APIs

- การใช้งาน

- ประยุกต์

- เข้าใกล้

- อนุมัติ

- ในเชิงสถาปัตยกรรม

- สถาปัตยกรรม

- รอบ

- ที่เกี่ยวข้อง

- โดยอัตโนมัติ

- อัตโนมัติ

- อัตโนมัติ

- อัตโนมัติ

- โดยอัตโนมัติ

- อัตโนมัติ

- ใช้ได้

- AWS

- เพราะ

- สมควร

- ก่อน

- กำลัง

- ด้านล่าง

- ที่ดีที่สุด

- บล็อก

- สร้าง

- การก่อสร้าง

- สร้าง

- ธุรกิจ

- ธุรกิจ

- กรณี

- กรณี

- ส่วนกลาง

- บาง

- ท้าทาย

- ความท้าทาย

- สารเคมี

- เมฆ

- รหัส

- ผูกมัด

- ร่วมกัน

- บริษัท

- สมบูรณ์

- อย่างสมบูรณ์

- ซับซ้อน

- ส่วนประกอบ

- ส่วนประกอบ

- คำนวณ

- สมาธิ

- เชื่อมต่อ

- บริโภค

- ผู้บริโภค

- การบริโภค

- ภาชนะ

- ภาชนะบรรจุ

- ค่าใช้จ่าย

- ได้

- หน้าปก

- สร้าง

- สร้าง

- การสร้าง

- ขณะนี้

- ประเพณี

- ลูกค้า

- ลูกค้า

- ข้อมูล

- วิทยาศาสตร์ข้อมูล

- นักวิทยาศาสตร์ข้อมูล

- ตัดสินใจ

- การตัดสินใจ

- ทั้งนี้ขึ้นอยู่กับ

- ขึ้นอยู่กับ

- ปรับใช้

- นำไปใช้

- การใช้งาน

- การใช้งาน

- ได้รับการออกแบบ

- การออกแบบ

- รายละเอียด

- ตรวจพบ

- การตรวจพบ

- กำหนด

- นักพัฒนา

- ที่กำลังพัฒนา

- ต่าง

- ดิจิตอล

- แปลงดิจิตอล

- โดยตรง

- สนทนา

- มังกร

- แต่ละ

- อย่างง่ายดาย

- อย่างมีประสิทธิภาพ

- ที่มีประสิทธิภาพ

- กากกะรุน

- ช่วยให้

- ปลายทาง

- พลังงาน

- เครื่องยนต์

- วิศวกร

- สิ่งแวดล้อม

- อุปกรณ์

- ประมาณ

- เหตุการณ์

- วิวัฒนาการ

- เผง

- ตัวอย่าง

- คาดหวัง

- ประสบการณ์

- การทดลอง

- การสำรวจ

- หันหน้าไปทาง

- FAST

- เร็วขึ้น

- ลักษณะ

- ที่โดดเด่น

- ในที่สุด

- ชื่อจริง

- ความยืดหยุ่น

- มีความยืดหยุ่น

- โฟกัส

- ดังต่อไปนี้

- กรอบ

- ราคาเริ่มต้นที่

- เต็ม

- ฟังก์ชั่น

- อนาคต

- เกตส์

- General

- ไป

- GitHub

- เหตุการณ์ที่

- เป้าหมาย

- จัดการ

- มี

- ช่วย

- จะช่วยให้

- อย่างสูง

- ทางประวัติศาสตร์

- ถือ

- เป็นเจ้าภาพ

- โฮสติ้ง

- สรุป ความน่าเชื่อถือของ Olymp Trade?

- HTTPS

- ร้อย

- ภาพ

- การดำเนินงาน

- การดำเนินการ

- ปรับปรุง

- การปรับปรุง

- การปรับปรุง

- ในอื่น ๆ

- ประกอบด้วย

- เพิ่ม

- อิสระ

- อิสระ

- อุตสาหกรรม

- อุตสาหกรรม

- ข้อมูล

- แจ้ง

- โครงสร้างพื้นฐาน

- นักวิเคราะห์ส่วนบุคคลที่หาโอกาสให้เป็นไปได้มากที่สุด

- อินพุต

- แบบบูรณาการ

- การโต้ตอบ

- แนะนำ

- ความเหงา

- ปัญหา

- IT

- เก็บ

- การเก็บรักษา

- คีย์

- การเปิดตัว

- ชั้นนำ

- การเรียนรู้

- ห้องสมุด

- เส้น

- ที่ตั้ง

- ที่ต้องการหา

- เครื่อง

- เรียนรู้เครื่อง

- ทำ

- เก็บรักษา

- การบำรุงรักษา

- ทำ

- ทำให้

- จัดการ

- การจัดการ

- การจัดการ

- ลักษณะ

- คู่มือ

- ด้วยมือ

- วิธี

- ตัวชี้วัด

- ML

- แบบ

- โมเดล

- การตรวจสอบ

- การตรวจสอบ

- ข้อมูลเพิ่มเติม

- มากที่สุด

- หลาย

- ความต้องการ

- ทำงาน

- การดำเนินการ

- การเพิ่มประสิทธิภาพ

- Options

- ใบสั่ง

- organizacja

- อื่นๆ

- ของตนเอง

- เจ้าของ

- ที่ผ่านไป

- การปฏิบัติ

- ที่มีประสิทธิภาพ

- ระยะ

- ฟิสิกส์

- จุด

- คาดการณ์

- ปัญหาที่เกิดขึ้น

- กระบวนการ

- กระบวนการ

- ผู้ผลิต

- การผลิต

- โครงการ

- โครงการ

- ให้

- ให้

- การให้

- ประกาศ

- วัตถุประสงค์

- วัตถุประสงค์

- ผลักดัน

- คุณภาพ

- เรียลไทม์

- ลด

- ทะเบียน

- ลงทะเบียน

- น่าเชื่อถือ

- กรุ

- จำเป็นต้องใช้

- ความต้องการ

- คำตอบ

- ความรับผิดชอบ

- REST

- ส่งผลให้

- ผลสอบ

- วิ่ง

- วิ่ง

- ขนาด

- ปรับ

- วิทยาศาสตร์

- นักวิทยาศาสตร์

- นักวิทยาศาสตร์

- ปลอดภัย

- ชุด

- serverless

- บริการ

- บริการ

- ชุด

- เซี่ยงไฮ้

- Share

- ระยะสั้น

- ง่าย

- จำลอง

- เดียว

- สถานการณ์

- หก

- So

- ทางออก

- โซลูชัน

- บาง

- บางสิ่งบางอย่าง

- โดยเฉพาะ

- ความเร็ว

- ขั้นตอน

- มาตรฐาน

- ข้อความที่เริ่ม

- การเก็บรักษา

- จัดเก็บ

- เพรียวลม

- ประสบความสำเร็จ

- ระบบ

- เป้า

- ทีม

- ทีม

- Telco

- ทดสอบ

- การทดสอบ

- พื้นที่

- ที่มา

- ดังนั้น

- อย่างถี่ถ้วน

- ธรณีประตู

- ตลอด

- เวลา

- ครั้ง

- ไปทาง

- ตรวจสอบย้อนกลับ

- ลู่

- การติดตาม

- การฝึกอบรม

- การแปลง

- การแปลง

- การเปลี่ยนแปลง

- ภายใต้

- us

- ใช้

- มักจะ

- ยูทิลิตี้

- ความคุ้มค่า

- รุ่น

- กำหนดไว้อย่างดี

- ในขณะที่

- ไม่มี

- งาน

- ขั้นตอนการทำงาน

- การทำงาน

- โลก

- การเขียน

- ปี

- ปี

- ผล