โพสต์นี้เขียนร่วมกับ Sowmya Manusani, Sr. Staff Machine Learning Engineer ที่ Zendesk

Zendesk เป็นบริษัท SaaS ที่สร้างซอฟต์แวร์การสนับสนุน การขาย และการมีส่วนร่วมกับลูกค้าสำหรับทุกคน โดยมีความเรียบง่ายเป็นรากฐาน ประสบความสำเร็จจากการทำให้บริษัทกว่า 170,000 แห่งทั่วโลกให้บริการลูกค้าหลายร้อยล้านรายได้อย่างมีประสิทธิภาพ ทีมแมชชีนเลิร์นนิงที่ Zendcaesk มีหน้าที่รับผิดชอบในการปรับปรุงทีมประสบการณ์ลูกค้าเพื่อให้บรรลุผลที่ดีที่สุด ด้วยการรวมพลังของข้อมูลและผู้คนเข้าด้วยกัน Zendesk นำเสนอผลิตภัณฑ์อัจฉริยะที่ทำให้ลูกค้าของพวกเขามีประสิทธิผลมากขึ้นด้วยการทำงานแบบแมนนวลโดยอัตโนมัติ

Zendesk ได้สร้างผลิตภัณฑ์ ML มาตั้งแต่ปี 2015 รวมถึง ตอบบอท, การทำนายความพึงพอใจ, ตัวชี้นำเนื้อหา, มาโครที่แนะนำ, และอื่น ๆ อีกมากมาย. ในช่วงไม่กี่ปีที่ผ่านมา ด้วยการเติบโตของการเรียนรู้เชิงลึก โดยเฉพาะอย่างยิ่งใน NLP พวกเขามองเห็นโอกาสมากมายในการทำให้เวิร์กโฟลว์เป็นอัตโนมัติและช่วยเหลือตัวแทนในการสนับสนุนลูกค้าด้วยโซลูชัน Zendesk ปัจจุบัน Zendesk ใช้ TensorFlow และ PyTorch เพื่อสร้างโมเดลการเรียนรู้เชิงลึก

ลูกค้าเช่น Zendesk ได้สร้างธุรกิจซอฟต์แวร์ขนาดใหญ่ในฐานะบริการ (SaaS) ที่ประสบความสำเร็จบน Amazon Web Services (AWS) ปัจจัยขับเคลื่อนสำคัญสำหรับโมเดลธุรกิจ SaaS ที่ประสบความสำเร็จคือความสามารถในการใช้การเช่าหลายรายการในแอปพลิเคชันและโครงสร้างพื้นฐาน ซึ่งช่วยให้ประหยัดต้นทุนและประสิทธิภาพการดำเนินงานได้ เนื่องจากต้องสร้างแอปพลิเคชันเพียงครั้งเดียว แต่สามารถใช้งานได้หลายครั้งและสามารถแชร์โครงสร้างพื้นฐานได้ เราเห็นลูกค้าจำนวนมากสร้างระบบที่มีผู้เช่าหลายรายที่ปลอดภัย ประหยัดค่าใช้จ่ายบน AWS ในทุกเลเยอร์ของสแต็ก ตั้งแต่การประมวลผล พื้นที่จัดเก็บ ฐานข้อมูล ไปจนถึงเครือข่าย และตอนนี้ เราเห็นลูกค้าต้องการนำไปใช้กับแมชชีนเลิร์นนิง (ML)

ทำให้เกิดการแลกเปลี่ยนที่ยากลำบากระหว่างการใช้โมเดลซ้ำกับการปรับให้เป็นส่วนตัวมากเกินไป

โดยทั่วไปการเช่าหลายบัญชีสำหรับธุรกิจ SaaS หมายความว่าแอปพลิเคชันเดียวถูกนำมาใช้ซ้ำระหว่างผู้ใช้หลายคน (ลูกค้า SaaS) สิ่งนี้สร้างประสิทธิภาพด้านต้นทุนและลดค่าใช้จ่ายในการดำเนินงาน อย่างไรก็ตาม โมเดลแมชชีนเลิร์นนิงในบางครั้งจำเป็นต้องปรับเปลี่ยนให้มีความเฉพาะเจาะจงสูง (ปรับให้เหมาะกับแต่ละบุคคลมากเกินไป) เพื่อให้สามารถคาดการณ์ได้อย่างแม่นยำ ซึ่งหมายความว่ากระบวนทัศน์ SaaS แบบ “สร้างครั้งเดียว ใช้หลายครั้ง” ไม่สามารถนำไปใช้กับ ML ได้เสมอ หากโมเดลมีความเฉพาะเจาะจง ยกตัวอย่างกรณีการใช้งานแพลตฟอร์มสนับสนุนลูกค้า ภาษาที่ผู้ใช้ระบุในตั๋วสนับสนุนจะแตกต่างกันไปขึ้นอยู่กับว่าเป็นปัญหาเกี่ยวกับบริการร่วมเดินทาง (“การเดินทางใช้เวลานานเกินไป”) หรือปัญหาการซื้อเสื้อผ้า (“การเปลี่ยนสีเมื่อซัก”) ในกรณีการใช้งานนี้ การปรับปรุงความแม่นยำในการทำนายการดำเนินการแก้ไขที่ดีที่สุดอาจต้องมีการฝึกอบรมโมเดลการประมวลผลภาษาธรรมชาติ (NLP) ในชุดข้อมูลเฉพาะสำหรับโดเมนธุรกิจหรือประเภทธุรกิจ Zendesk เผชิญกับความท้าทายนี้อย่างแน่นอนเมื่อพยายามใช้ประโยชน์จาก ML ในโซลูชันของตน พวกเขาจำเป็นต้องสร้างโมเดล ML ที่ปรับแต่งได้สูงนับพันโมเดล โดยแต่ละโมเดลจะปรับให้เหมาะกับลูกค้าเฉพาะราย เพื่อแก้ปัญหาความท้าทายในการปรับใช้โมเดลนับพันอย่างคุ้มค่า Zendesk จึงหันมาใช้ Amazon SageMaker

ในโพสต์นี้ เราจะแสดงวิธีใช้คุณสมบัติใหม่บางอย่างของ อเมซอน SageMakerซึ่งเป็นบริการแมชชีนเลิร์นนิงที่มีการจัดการเต็มรูปแบบ เพื่อสร้างความสามารถในการอนุมาน ML แบบหลายผู้เช่า นอกจากนี้ เรายังแชร์ตัวอย่างในโลกแห่งความเป็นจริงว่า Zendesk ประสบความสำเร็จในผลลัพธ์เดียวกันได้อย่างไร โดยปรับใช้สื่อกลางที่มีความสุขระหว่างความสามารถในการสนับสนุนการปรับให้เป็นส่วนตัวแบบไฮเปอร์ในโมเดล ML และการใช้โครงสร้างพื้นฐานร่วมกันอย่างคุ้มค่าโดยใช้ SageMaker multi-model endpoints (MME)

จุดปลายหลายรุ่นของ SageMaker

จุดสิ้นสุดหลายรุ่นของ SageMaker ช่วยให้คุณสามารถปรับใช้หลายรุ่นหลังจุดสิ้นสุดการอนุมานเดียวซึ่งอาจมีหนึ่งอินสแตนซ์หรือมากกว่า แต่ละอินสแตนซ์ได้รับการออกแบบมาเพื่อโหลดและให้บริการหลายรุ่นจนถึงความจุของหน่วยความจำและ CPU ด้วยสถาปัตยกรรมนี้ ธุรกิจ SaaS สามารถลดค่าใช้จ่ายที่เพิ่มขึ้นเชิงเส้นของการโฮสต์โมเดลหลาย ๆ รุ่น และสามารถนำโครงสร้างพื้นฐานกลับมาใช้ใหม่ได้ ซึ่งสอดคล้องกับโมเดลหลายผู้เช่าที่นำไปใช้ในส่วนอื่น ๆ ของแอพพลิเคชั่นสแตก

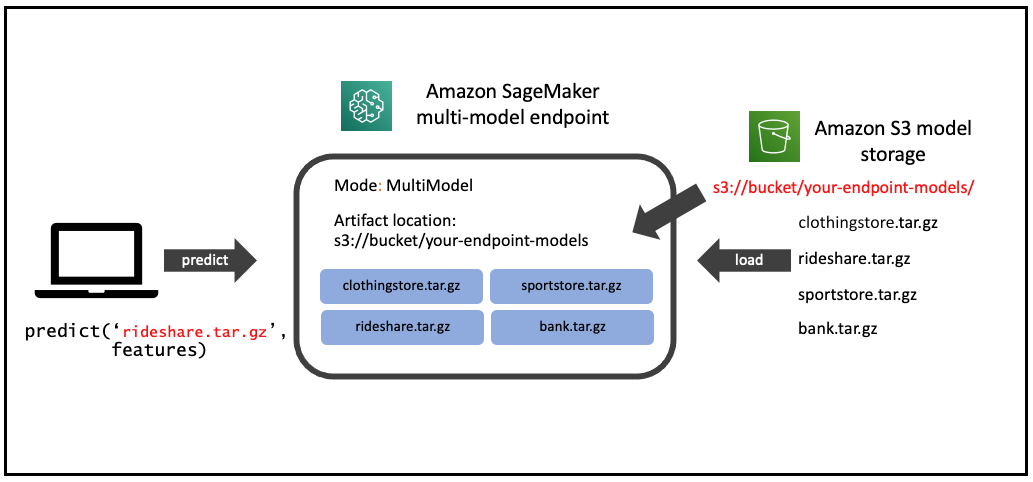

แผนภาพต่อไปนี้แสดงสถาปัตยกรรมของจุดสิ้นสุดแบบหลายโมเดลของ SageMaker

จุดสิ้นสุดหลายโมเดลของ SageMaker โหลดโมเดลแบบไดนามิกจาก บริการจัดเก็บข้อมูลอย่างง่ายของ Amazon (Amazon S3) เมื่อเรียกใช้ แทนที่จะดาวน์โหลดโมเดลทั้งหมดเมื่อสร้างจุดสิ้นสุดเป็นครั้งแรก ผลที่ตามมา การเรียกใช้โมเดลครั้งแรกอาจเห็นเวลาแฝงในการอนุมานสูงกว่าการอนุมานที่ตามมา ซึ่งเสร็จสมบูรณ์โดยมีเวลาแฝงต่ำ หากโมเดลถูกโหลดบนคอนเทนเนอร์แล้วเมื่อเรียกใช้ ขั้นตอนการดาวน์โหลดจะถูกข้ามไป และโมเดลจะส่งคืนการอนุมานที่มีเวลาแฝงต่ำ ตัวอย่างเช่น สมมติว่าคุณมีโมเดลที่ใช้เพียงไม่กี่ครั้งต่อวัน มันถูกโหลดโดยอัตโนมัติตามความต้องการ ในขณะที่โมเดลที่เข้าถึงบ่อยจะถูกเก็บไว้ในหน่วยความจำและเรียกใช้โดยมีเวลาแฝงต่ำอย่างสม่ำเสมอ

มาดูกันดีกว่าว่า Zendesk ใช้ SageMaker MME อย่างไรเพื่อให้ได้การปรับใช้ ML ระดับไฮเปอร์สเกลที่คุ้มค่าคุ้มราคาด้วยฟีเจอร์ ML ที่แนะนำของ Macros

เหตุใด Zendesk จึงสร้างโมเดลที่ปรับให้เหมาะกับแต่ละบุคคล

ลูกค้าของ Zendesk กระจายไปทั่วโลกในแนวดิ่งของอุตสาหกรรมที่แตกต่างกันด้วยความหมายของตั๋วสนับสนุนที่แตกต่างกัน ดังนั้น เพื่อให้บริการลูกค้าได้ดีที่สุด พวกเขามักจะต้องสร้างโมเดลส่วนบุคคลที่ได้รับการฝึกอบรมเกี่ยวกับข้อมูลตั๋วการสนับสนุนเฉพาะลูกค้า เพื่อระบุเจตนา มาโคร และอื่นๆ อย่างถูกต้อง

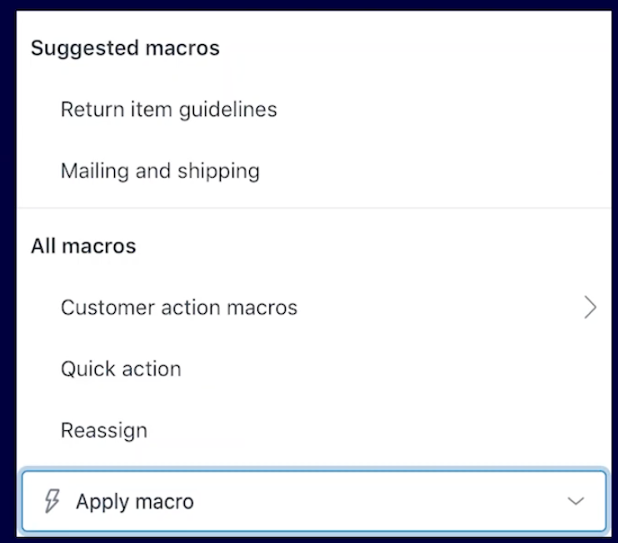

ในเดือนตุลาคม 2021 พวกเขาเปิดตัวฟีเจอร์ใหม่ของ NLP ML นั่นคือมาโครที่แนะนำ ซึ่งแนะนำมาโคร (การดำเนินการที่กำหนดไว้ล่วงหน้า) ตามการคาดการณ์โมเดลเฉพาะของลูกค้านับพันรายการ ทีม ML ของ Zendesk ได้สร้างโมเดลตัวแยกประเภท NLP ที่ใช้ TensorFlow ซึ่งได้รับการฝึกฝนจากประวัติก่อนหน้าของเนื้อหาตั๋วและมาโครต่อลูกค้าหนึ่งราย ด้วยแบบจำลองเหล่านี้ แนะนำให้ใช้การคาดคะเนมาโครเมื่อใดก็ตามที่ตัวแทนดูตั๋ว (ดังที่แสดงในภาพหน้าจอต่อไปนี้) ซึ่งช่วยให้ตัวแทนให้บริการลูกค้าได้อย่างรวดเร็ว เนื่องจากมาโครมีความเฉพาะเจาะจงสำหรับลูกค้า Zendesk จึงต้องการแบบจำลองเฉพาะของลูกค้าเพื่อให้บริการการคาดการณ์ที่แม่นยำ

ภายใต้ประทุนของมาโครที่แนะนำของ Zendesk

โมเดลมาโครที่แนะนำคือ neural nets ที่ใช้ NLP ซึ่งมีขนาดประมาณ 7–15 MB ความท้าทายหลักคือการผลิตโมเดลเหล่านี้หลายพันรุ่นด้วยโซลูชันที่คุ้มค่า เชื่อถือได้ และปรับขนาดได้

แต่ละโมเดลมีรูปแบบการรับส่งข้อมูลที่แตกต่างกัน โดยมีคำขอขั้นต่ำ 100 รายการต่อวินาที และคำขอสูงสุดหลายร้อยรายการต่อวินาที ให้บริการการคาดการณ์หลายล้านรายการต่อวันโดยมีเวลาแฝงของโมเดลประมาณ XNUMX มิลลิวินาทีเมื่อโมเดลพร้อมใช้งานในหน่วยความจำ ตำแหน่งข้อมูล SageMaker ได้รับการปรับใช้ในภูมิภาค AWS หลายแห่ง โดยให้บริการคำขอหลายพันรายการต่อนาทีต่อตำแหน่งข้อมูล

ด้วยความสามารถในการโฮสต์หลายโมเดลบนเอ็นด์พอยต์เดียว SageMaker ช่วยให้ Zendesk ลดค่าใช้จ่ายในการปรับใช้และสร้างโซลูชันที่คุ้มค่าเมื่อเปรียบเทียบกับการปรับใช้เอ็นด์พอยต์โมเดลเดียวต่อลูกค้าหนึ่งราย ข้อเสียที่นี่คือการควบคุมการจัดการต่อโมเดลน้อยลง อย่างไรก็ตาม นี่เป็นพื้นที่ที่ Zendesk ร่วมมือกับ AWS เพื่อปรับปรุงจุดสิ้นสุดแบบหลายรุ่น

หนึ่งในคุณสมบัติแบบหลายรุ่นของ SageMaker คือการโหลดแบบขี้เกียจ กล่าวคือ โมเดลจะถูกโหลดลงในหน่วยความจำเมื่อเรียกใช้เป็นครั้งแรก นี่คือการเพิ่มประสิทธิภาพการใช้หน่วยความจำ อย่างไรก็ตาม มันทำให้เวลาตอบสนองเพิ่มขึ้นอย่างรวดเร็วในการโหลดครั้งแรก ซึ่งอาจถูกมองว่าเป็นปัญหาในการเริ่มเย็น สำหรับมาโครที่แนะนำ นี่เป็นความท้าทาย อย่างไรก็ตาม Zendesk เอาชนะสิ่งนี้ได้ด้วยการใช้ฟังก์ชันการโหลดล่วงหน้าที่ด้านบนของการจัดเตรียมตำแหน่งข้อมูล SageMaker เพื่อโหลดโมเดลลงในหน่วยความจำก่อนให้บริการทราฟฟิกที่ใช้งานจริง ประการที่สอง MME จะยกเลิกการโหลดโมเดลที่ใช้งานไม่บ่อยออกจากหน่วยความจำ ดังนั้นเพื่อให้มีเวลาแฝงต่ำที่สม่ำเสมอในโมเดลทั้งหมด และหลีกเลี่ยง "เพื่อนบ้านที่มีเสียงรบกวน" ซึ่งส่งผลกระทบต่อโมเดลอื่นๆ ที่ใช้งานน้อย Zendesk จึงร่วมมือกับ AWS เพื่อเพิ่มคุณสมบัติใหม่ ซึ่งจะกล่าวถึงในโพสต์ต่อไป เพื่อเปิดใช้งานการจัดการต่อโมเดลที่ชัดเจนยิ่งขึ้น นอกจากนี้ ในฐานะที่เป็นโซลูชันชั่วคราว Zendesk ได้ปรับขนาดฟลีต MME ที่เหมาะสมเพื่อลดการขนถ่ายโมเดลมากเกินไป ด้วยสิ่งนี้ Zendesk สามารถให้บริการการคาดการณ์แก่ลูกค้าทั้งหมดของพวกเขาด้วยเวลาแฝงต่ำ ประมาณ 100 มิลลิวินาที และยังคงประหยัดต้นทุนได้ 90% เมื่อเทียบกับจุดสิ้นสุดเฉพาะ

บน MME ที่มีขนาดเหมาะสม Zendesk สังเกตระหว่างการทดสอบโหลดว่าการมีจำนวนอินสแตนซ์ขนาดเล็กกว่า (อคติในการปรับขนาดแนวนอน) ตามหลัง MME นั้นเป็นทางเลือกที่ดีกว่าการมีอินสแตนซ์หน่วยความจำขนาดใหญ่น้อยกว่า (การปรับขนาดแนวตั้ง) Zendesk สังเกตเห็นว่าถังบรรจุโมเดลจำนวนมากเกินไป (เกิน 500 โมเดล TensorFlow ในกรณีของพวกเขา) ในอินสแตนซ์หน่วยความจำขนาดใหญ่เพียงตัวเดียวทำงานได้ไม่ดี เนื่องจากหน่วยความจำไม่ใช่ทรัพยากรเดียวบนอินสแตนซ์ที่สามารถเป็นคอขวดได้ โดยเฉพาะอย่างยิ่ง พวกเขาสังเกตเห็นว่า TensorFlow สร้างเธรดหลายเธรด (3 x อินสแตนซ์ vCPU ทั้งหมด) ต่อโมเดล ดังนั้นการโหลดโมเดลมากกว่า 500 โมเดลในอินสแตนซ์เดียวทำให้ขีดจำกัดระดับเคอร์เนลถูกละเมิดในจำนวนเธรดสูงสุดที่สามารถสร้างได้ในอินสแตนซ์ ปัญหาอีกประการหนึ่งเกี่ยวกับการใช้อินสแตนซ์ที่น้อยลงแต่มีขนาดใหญ่เกิดขึ้นเมื่อ Zendesk ประสบกับการควบคุมปริมาณ (เป็นกลไกด้านความปลอดภัย) ในบางอินสแตนซ์ที่อยู่เบื้องหลัง MME เนื่องจากการเรียกใช้โมเดลที่ไม่ซ้ำกันต่อวินาทีนั้นเกินกว่าอัตรา เซิร์ฟเวอร์หลายรุ่น (MMS) ในอินสแตนซ์เดียวสามารถจัดการได้อย่างปลอดภัยโดยไม่ทำให้อินสแตนซ์เป็นสีน้ำตาล นี่เป็นอีกปัญหาหนึ่งที่ได้รับการแก้ไขด้วยการใช้อินสแตนซ์จำนวนมากและเล็กลง

จากมุมมองของความสามารถในการสังเกต ซึ่งเป็นส่วนประกอบที่สำคัญของแอปพลิเคชันการผลิตใดๆ อเมซอน คลาวด์วอตช์ เมตริกต่างๆ เช่น การเรียกใช้ CPU การใช้หน่วยความจำ และเมตริกเฉพาะโมเดลหลายรายการ เช่น โมเดลที่โหลดในหน่วยความจำ เวลาในการโหลดโมเดล เวลารอโหลดโมเดล และการเข้าถึงแคชของโมเดลเป็นข้อมูล โดยเฉพาะอย่างยิ่ง การแบ่งเวลาแฝงของโมเดลช่วยให้ Zendesk เข้าใจปัญหาการเริ่มเย็นและผลกระทบของมัน

ภายใต้ประทุนของการปรับขนาดอัตโนมัติ MME

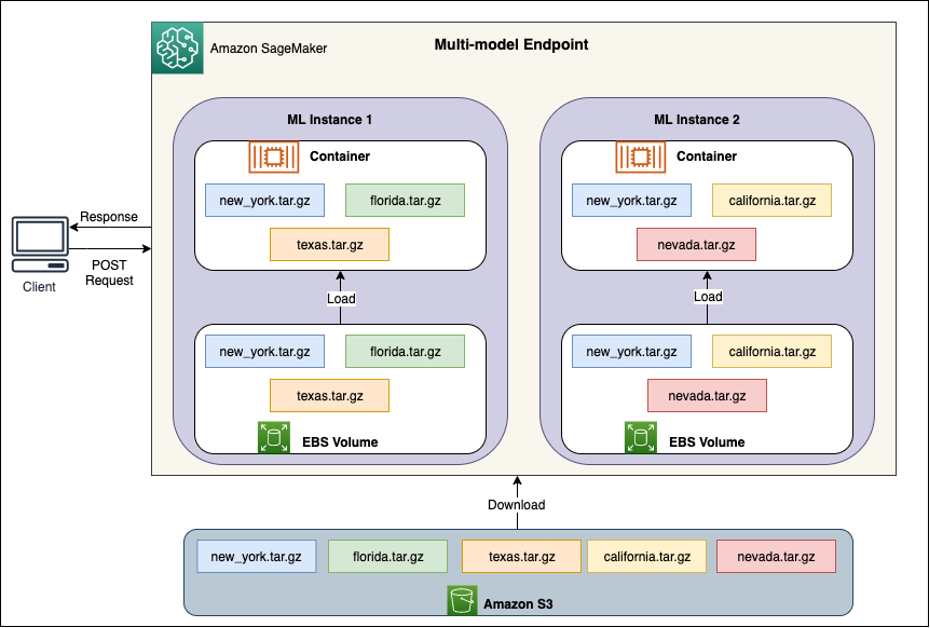

เบื้องหลังจุดสิ้นสุดแบบหลายโมเดลแต่ละรายการ มีโมเดลที่โฮสต์อินสแตนซ์ ดังที่แสดงในแผนภาพต่อไปนี้ อินสแตนซ์เหล่านี้โหลดและนำโมเดลหลายรุ่นเข้าและออกจากหน่วยความจำตามรูปแบบการรับส่งข้อมูลไปยังโมเดล

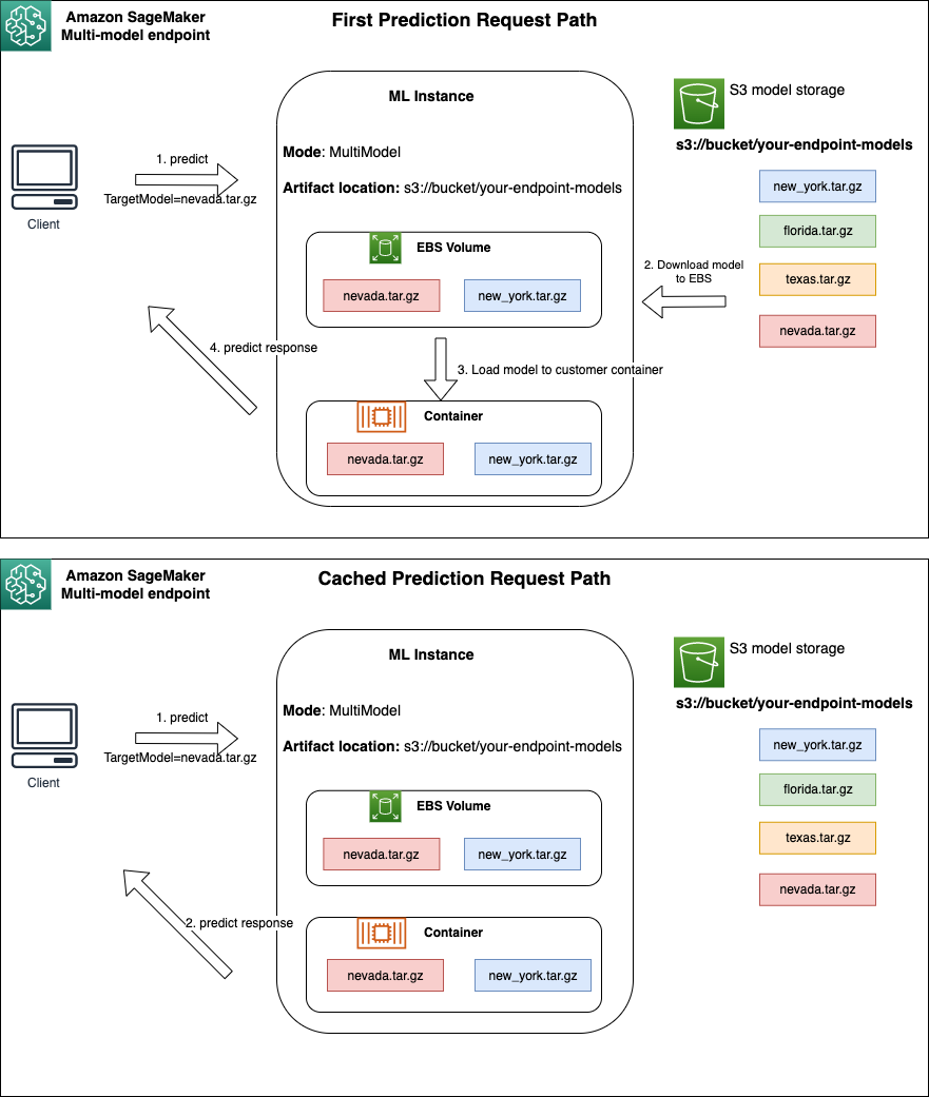

SageMaker ยังคงกำหนดเส้นทางคำขอการอนุมานสำหรับโมเดลไปยังอินสแตนซ์ที่โหลดโมเดลแล้ว เพื่อให้คำขอได้รับจากสำเนาโมเดลที่แคชไว้ (ดูแผนภาพต่อไปนี้ ซึ่งแสดงเส้นทางคำขอสำหรับคำขอการคาดคะเนแรกเทียบกับเส้นทางคำขอการคาดคะเนที่แคชไว้) อย่างไรก็ตาม หากโมเดลได้รับคำขอเรียกจำนวนมาก และมีอินสแตนซ์เพิ่มเติมสำหรับจุดสิ้นสุดหลายโมเดล SageMaker จะกำหนดเส้นทางคำขอบางส่วนไปยังอินสแตนซ์อื่นเพื่อรองรับการเพิ่มขึ้น หากต้องการใช้ประโยชน์จากการปรับขนาดโมเดลอัตโนมัติใน SageMaker ตรวจสอบให้แน่ใจว่าคุณมี ตั้งค่าการปรับขนาดอัตโนมัติของอินสแตนซ์ เพื่อจัดเตรียมความจุอินสแตนซ์เพิ่มเติม ตั้งค่านโยบายการปรับสเกลระดับปลายทางของคุณด้วยพารามิเตอร์ที่กำหนดเองหรือการเรียกใช้ต่อนาที (แนะนำ) เพื่อเพิ่มอินสแตนซ์ให้กับฟลีตปลายทาง

ใช้เคสที่เหมาะที่สุดสำหรับ MME

จุดสิ้นสุดหลายรุ่นของ SageMaker เหมาะอย่างยิ่งสำหรับการโฮสต์โมเดลที่คล้ายกันจำนวนมาก ซึ่งคุณสามารถให้บริการผ่านคอนเทนเนอร์ที่ให้บริการร่วมกัน และไม่จำเป็นต้องเข้าถึงโมเดลทั้งหมดพร้อมกัน MME เหมาะที่สุดสำหรับรุ่นที่มีขนาดและเวลาแฝงในการเรียกใช้ใกล้เคียงกัน การเปลี่ยนแปลงขนาดโมเดลบางอย่างเป็นที่ยอมรับได้ ตัวอย่างเช่น โมเดลของ Zendesk มีขนาดตั้งแต่ 10–50 Mb ซึ่งใช้งานได้ดี แต่การเปลี่ยนแปลงขนาดที่มากกว่า 10, 50 หรือ 100 เท่านั้นไม่เหมาะสม โมเดลที่ใหญ่กว่าอาจทำให้จำนวนการโหลดและยกเลิกการโหลดของโมเดลขนาดเล็กสูงขึ้นเพื่อรองรับพื้นที่หน่วยความจำที่เพียงพอ ซึ่งอาจส่งผลให้มีเวลาแฝงเพิ่มขึ้นบนจุดสิ้นสุด ความแตกต่างของคุณลักษณะด้านประสิทธิภาพของโมเดลขนาดใหญ่อาจใช้ทรัพยากรอย่างเช่น CPU ไม่เท่ากัน ซึ่งอาจส่งผลกระทบต่อโมเดลอื่นๆ บนอินสแตนซ์

นอกจากนี้ MME ยังออกแบบมาสำหรับการโฮสต์ร่วมที่ใช้เฟรมเวิร์ก ML เดียวกัน เนื่องจากใช้คอนเทนเนอร์ที่ใช้ร่วมกันเพื่อโหลดโมเดลหลายรุ่น ดังนั้น หากคุณมีเฟรมเวิร์ก ML ผสมกันในกลุ่มโมเดลของคุณ (เช่น PyTorch และ TensorFlow) อุปกรณ์ปลายทางเฉพาะของ SageMaker หรือการโฮสต์หลายคอนเทนเนอร์คือตัวเลือกที่ดีกว่า ประการสุดท้าย MME เหมาะสำหรับแอปพลิเคชันที่สามารถทนต่อการปรับค่าความหน่วงเวลาการสตาร์ทเย็นเป็นครั้งคราวได้ เนื่องจากโมเดลที่ใช้งานไม่บ่อยสามารถโหลดออกจากโมเดลที่เรียกใช้งานบ่อยแทน หากคุณมีโมเดลที่เข้าถึงไม่บ่อยเป็นหางยาว อุปกรณ์ปลายทางหลายโมเดลสามารถให้บริการทราฟฟิกนี้ได้อย่างมีประสิทธิภาพและช่วยประหยัดค่าใช้จ่ายได้อย่างมาก

สรุป

ในโพสต์นี้ คุณได้เรียนรู้ว่า SaaS และผู้เช่าหลายรายเกี่ยวข้องกับ ML อย่างไร และตำแหน่งข้อมูลหลายรุ่นของ SageMaker เปิดใช้งานการเช่าหลายรายและต้นทุนอย่างมีประสิทธิภาพสำหรับการอนุมาน ML ได้อย่างไร คุณได้เรียนรู้เกี่ยวกับกรณีการใช้งานแบบหลายผู้เช่าของ Zendesk ของโมเดล ML ต่อลูกค้า และวิธีที่พวกเขาโฮสต์โมเดล ML นับพันใน SageMaker MME สำหรับฟีเจอร์มาโครที่แนะนำ และประหยัดต้นทุนในการอนุมานได้ 90% เมื่อเทียบกับจุดสิ้นสุดเฉพาะ กรณีการใช้งานแบบ Hyper-personalization อาจต้องใช้โมเดล ML หลายพันรุ่น และ MME เป็นตัวเลือกที่คุ้มค่าสำหรับกรณีการใช้งานนี้ เราจะทำการปรับปรุงต่อไปใน MME เพื่อให้คุณสามารถโฮสต์โมเดลที่มีเวลาแฝงต่ำและมีการควบคุมที่ละเอียดมากขึ้นสำหรับโมเดลส่วนบุคคลแต่ละแบบ หากต้องการเริ่มต้นใช้งาน MME โปรดดู โฮสต์หลายรุ่นในคอนเทนเนอร์เดียวหลังปลายทางเดียว.

เกี่ยวกับผู้เขียน

ไซด แจฟฟรี เป็น Sr. Solutions Architect กับ AWS เขาทำงานร่วมกับบริษัทต่างๆ ตั้งแต่องค์กรขนาดกลางไปจนถึงองค์กรขนาดใหญ่ บริการทางการเงินไปจนถึง ISV ในการช่วยสร้างและดำเนินการแอปพลิเคชันที่ปลอดภัย ยืดหยุ่น ปรับขยายได้ และประสิทธิภาพสูงในระบบคลาวด์

ไซด แจฟฟรี เป็น Sr. Solutions Architect กับ AWS เขาทำงานร่วมกับบริษัทต่างๆ ตั้งแต่องค์กรขนาดกลางไปจนถึงองค์กรขนาดใหญ่ บริการทางการเงินไปจนถึง ISV ในการช่วยสร้างและดำเนินการแอปพลิเคชันที่ปลอดภัย ยืดหยุ่น ปรับขยายได้ และประสิทธิภาพสูงในระบบคลาวด์

โสมยา มนัสนี เป็นวิศวกรแมชชีนเลิร์นนิงสำหรับพนักงานอาวุโสที่ Zendesk เธอทำงานเกี่ยวกับการผลิตคุณลักษณะ Machine Learning ที่ใช้ NLP ซึ่งมุ่งเน้นไปที่การปรับปรุงประสิทธิภาพการทำงานของ Agent สำหรับลูกค้า Zendesk Enterprise นับพันราย เธอมีประสบการณ์ในการสร้างไปป์ไลน์การฝึกอบรมอัตโนมัติสำหรับโมเดลส่วนตัวหลายพันแบบ และให้บริการโดยใช้แอปพลิเคชันที่ปลอดภัย ยืดหยุ่น ปรับขยายได้ และประสิทธิภาพสูง ในเวลาว่างเธอชอบไขปริศนาและลองวาดภาพ

โสมยา มนัสนี เป็นวิศวกรแมชชีนเลิร์นนิงสำหรับพนักงานอาวุโสที่ Zendesk เธอทำงานเกี่ยวกับการผลิตคุณลักษณะ Machine Learning ที่ใช้ NLP ซึ่งมุ่งเน้นไปที่การปรับปรุงประสิทธิภาพการทำงานของ Agent สำหรับลูกค้า Zendesk Enterprise นับพันราย เธอมีประสบการณ์ในการสร้างไปป์ไลน์การฝึกอบรมอัตโนมัติสำหรับโมเดลส่วนตัวหลายพันแบบ และให้บริการโดยใช้แอปพลิเคชันที่ปลอดภัย ยืดหยุ่น ปรับขยายได้ และประสิทธิภาพสูง ในเวลาว่างเธอชอบไขปริศนาและลองวาดภาพ

ซอราภ ตรีกันเด เป็นผู้จัดการผลิตภัณฑ์อาวุโสสำหรับการอนุมานของ Amazon SageMaker เขาหลงใหลในการทำงานกับลูกค้าและทำให้การเรียนรู้ของเครื่องสามารถเข้าถึงได้มากขึ้น ในเวลาว่าง Saurabh สนุกกับการเดินป่า เรียนรู้เกี่ยวกับเทคโนโลยีที่เป็นนวัตกรรม ติดตาม TechCrunch และใช้เวลากับครอบครัวของเขา

ซอราภ ตรีกันเด เป็นผู้จัดการผลิตภัณฑ์อาวุโสสำหรับการอนุมานของ Amazon SageMaker เขาหลงใหลในการทำงานกับลูกค้าและทำให้การเรียนรู้ของเครื่องสามารถเข้าถึงได้มากขึ้น ในเวลาว่าง Saurabh สนุกกับการเดินป่า เรียนรู้เกี่ยวกับเทคโนโลยีที่เป็นนวัตกรรม ติดตาม TechCrunch และใช้เวลากับครอบครัวของเขา

ทีปติ ราฆะ เป็นวิศวกรพัฒนาซอฟต์แวร์ในทีม Amazon SageMaker งานปัจจุบันของเธอมุ่งเน้นไปที่การสร้างคุณลักษณะเพื่อโฮสต์โมเดลการเรียนรู้ของเครื่องอย่างมีประสิทธิภาพ ในเวลาว่าง เธอชอบการเดินทาง เดินป่า และปลูกพืช

ทีปติ ราฆะ เป็นวิศวกรพัฒนาซอฟต์แวร์ในทีม Amazon SageMaker งานปัจจุบันของเธอมุ่งเน้นไปที่การสร้างคุณลักษณะเพื่อโฮสต์โมเดลการเรียนรู้ของเครื่องอย่างมีประสิทธิภาพ ในเวลาว่าง เธอชอบการเดินทาง เดินป่า และปลูกพืช

- "

- 000

- 10

- 100

- 2021

- a

- ความสามารถ

- เกี่ยวกับเรา

- เข้า

- สามารถเข้าถึงได้

- อำนวยความสะดวก

- ถูกต้อง

- บรรลุ

- ประสบความสำเร็จ

- การกระทำ

- การปฏิบัติ

- คล่องแคล่ว

- ที่เพิ่ม

- เพิ่มเติม

- ความได้เปรียบ

- ตัวแทน

- ทั้งหมด

- แล้ว

- เสมอ

- อเมซอน

- Amazon Web Services

- อื่น

- การใช้งาน

- การใช้งาน

- ประยุกต์

- ใช้

- ประมาณ

- สถาปัตยกรรม

- AREA

- รอบ

- รถยนต์

- โดยอัตโนมัติ

- อัตโนมัติ

- อัตโนมัติ

- โดยอัตโนมัติ

- ใช้ได้

- AWS

- เพราะ

- ก่อน

- กำลัง

- ที่ดีที่สุด

- ระหว่าง

- เกิน

- รายละเอียด

- สร้าง

- การก่อสร้าง

- สร้าง

- ธุรกิจ

- รูปแบบธุรกิจ

- ธุรกิจ

- ความจุ

- กรณี

- กรณี

- ก่อให้เกิด

- ที่เกิดจาก

- สาเหตุที่

- ท้าทาย

- ทางเลือก

- ใกล้ชิด

- เสื้อผ้า

- เมฆ

- การทำงานร่วมกัน

- บริษัท

- บริษัท

- เมื่อเทียบกับ

- ส่วนประกอบ

- คำนวณ

- คงเส้นคงวา

- บริโภค

- ภาชนะ

- เนื้อหา

- ต่อ

- อย่างต่อเนื่อง

- ควบคุม

- การควบคุม

- ค่าใช้จ่ายที่มีประสิทธิภาพ

- ได้

- สร้าง

- ที่สร้างขึ้น

- สร้าง

- สำคัญมาก

- ปัจจุบัน

- ขณะนี้

- ประเพณี

- ลูกค้า

- ประสบการณ์ของลูกค้า

- Customer Support

- ลูกค้า

- ข้อมูล

- ฐานข้อมูล

- วัน

- ทุ่มเท

- ลึก

- มอบ

- ความต้องการ

- ทั้งนี้ขึ้นอยู่กับ

- ปรับใช้

- นำไปใช้

- ปรับใช้

- การใช้งาน

- ได้รับการออกแบบ

- พัฒนาการ

- ต่าง

- ยาก

- โดเมน

- ดาวน์โหลด

- คนขับรถ

- ในระหว่าง

- แต่ละ

- มีประสิทธิภาพ

- อย่างมีประสิทธิภาพ

- ทำให้สามารถ

- ช่วยให้

- ปลายทาง

- มีส่วนร่วม

- วิศวกร

- Enterprise

- ผู้ประกอบการ

- โดยเฉพาะอย่างยิ่ง

- ทุกคน

- เผง

- ตัวอย่าง

- ประสบการณ์

- มีประสบการณ์

- ใบหน้า

- ครอบครัว

- ลักษณะ

- คุณสมบัติ

- ในที่สุด

- ทางการเงิน

- บริการทางการเงิน

- ปลาย

- ชื่อจริง

- ครั้งแรก

- FLEET

- โฟกัส

- มุ่งเน้นไปที่

- ดังต่อไปนี้

- รากฐาน

- กรอบ

- กรอบ

- ฟรี

- ราคาเริ่มต้นที่

- ฟังก์ชั่น

- ทั่วโลก

- มากขึ้น

- การเจริญเติบโต

- การเจริญเติบโต

- จัดการ

- มีความสุข

- มี

- ช่วย

- การช่วยเหลือ

- โปรดคลิกที่นี่เพื่ออ่านรายละเอียดเพิ่มเติม

- จุดสูง

- สูงกว่า

- อย่างสูง

- ประวัติ

- ตามแนวนอน

- เป็นเจ้าภาพ

- โฮสติ้ง

- สรุป ความน่าเชื่อถือของ Olymp Trade?

- ทำอย่างไร

- อย่างไรก็ตาม

- HTTPS

- ร้อย

- แยกแยะ

- ส่งผลกระทบ

- การดำเนินการ

- ปรับปรุง

- การปรับปรุง

- ประกอบด้วย

- รวมทั้ง

- เพิ่ม

- ที่เพิ่มขึ้น

- อุตสาหกรรม

- ให้ข้อมูล

- โครงสร้างพื้นฐาน

- นวัตกรรม

- ตัวอย่าง

- ฉลาด

- ความตั้งใจ

- ปัญหา

- IT

- คีย์

- ภาษา

- ใหญ่

- ที่มีขนาดใหญ่

- ได้เรียนรู้

- การเรียนรู้

- ชั้น

- เลฟเวอเรจ

- ขีด จำกัด

- โหลด

- โหลด

- นาน

- ดู

- เครื่อง

- เรียนรู้เครื่อง

- แมโคร

- ทำ

- การทำ

- การจัดการ

- การจัดการ

- ผู้จัดการ

- คู่มือ

- งานด้วยตนเอง

- วิธี

- กลไก

- กลาง

- หน่วยความจำ

- ตัวชี้วัด

- อาจ

- ล้าน

- ขั้นต่ำ

- ML

- แบบ

- โมเดล

- ข้อมูลเพิ่มเติม

- หลาย

- โดยธรรมชาติ

- ต้อง

- ความต้องการ

- เครือข่าย

- คุณสมบัติใหม่

- จำนวน

- ทำงาน

- โอกาส

- เพิ่มประสิทธิภาพ

- องค์กร

- อื่นๆ

- ตัวอย่าง

- หลงใหล

- คน

- การปฏิบัติ

- ส่วนบุคคล

- มุมมอง

- แพลตฟอร์ม

- นโยบาย

- อำนาจ

- คำทำนาย

- การคาดการณ์

- ก่อน

- ปัญหา

- การประมวลผล

- ผลิตภัณฑ์

- การผลิต

- ผลผลิต

- ผลิตภัณฑ์

- ซื้อ

- อย่างรวดเร็ว

- พิสัย

- แนะนำ

- ลด

- การเผยแพร่

- น่าเชื่อถือ

- ขอ

- การร้องขอ

- ต้องการ

- ยืดหยุ่น

- ทรัพยากร

- แหล่งข้อมูล

- คำตอบ

- รับผิดชอบ

- รับคืน

- เส้นทาง

- อย่างปลอดภัย

- ความปลอดภัย

- ขาย

- เดียวกัน

- ความพอใจ

- ที่ปรับขนาดได้

- ขนาด

- ปรับ

- ปลอดภัย

- อรรถศาสตร์

- บริการ

- บริการ

- การให้บริการ

- ชุด

- Share

- ที่ใช้ร่วมกัน

- แสดง

- สำคัญ

- คล้ายคลึงกัน

- ง่าย

- ตั้งแต่

- เดียว

- ขนาด

- So

- ซอฟต์แวร์

- ซอฟต์แวร์เป็นบริการ

- การพัฒนาซอฟต์แวร์

- ทางออก

- โซลูชัน

- แก้

- บาง

- ช่องว่าง

- โดยเฉพาะ

- เฉพาะ

- การใช้จ่าย

- กระจาย

- กอง

- เริ่มต้น

- ข้อความที่เริ่ม

- ยังคง

- การเก็บรักษา

- ที่ประสบความสำเร็จ

- ประสบความสำเร็จ

- สนับสนุน

- ที่สนับสนุน

- ระบบ

- ทีม

- ทีม

- เทคโนโลยี

- การทดสอบ

- พื้นที่

- ดังนั้น

- พัน

- ตลอด

- ตั๋ว

- เวลา

- ครั้ง

- ด้านบน

- การจราจร

- การฝึกอบรม

- การเดินทาง

- เป็นปกติ

- เข้าใจ

- เป็นเอกลักษณ์

- ใช้

- ผู้ใช้

- แนวดิ่ง

- รอ

- เว็บ

- บริการเว็บ

- อะไร

- ในขณะที่

- ไม่มี

- งาน

- ขั้นตอนการทำงาน

- การทำงาน

- โรงงาน

- ทั่วโลก

- X

- ปี

- ของคุณ

- Zendesk