การปรับใช้ระบบ AI อันทรงพลังช่วยเพิ่มความเข้าใจของเราในเรื่องความปลอดภัยและการใช้ในทางที่ผิด มากกว่าที่จะเป็นไปได้ด้วยการวิจัยเพียงอย่างเดียว สะดุดตา:

- การใช้โมเดลภาษาที่ใช้ API ในทางที่ผิดมักมาในรูปแบบที่แตกต่างจากที่เรากลัวมากที่สุด

- เราได้ระบุข้อจำกัดในการประเมินแบบจำลองภาษาที่มีอยู่ซึ่งเรากำลังแก้ไขด้วยเกณฑ์มาตรฐานและตัวแยกประเภทใหม่

- การวิจัยด้านความปลอดภัยขั้นพื้นฐานมีประโยชน์อย่างมากสำหรับการใช้ประโยชน์เชิงพาณิชย์ของระบบ AI

ในที่นี้ เราอธิบายแนวคิดล่าสุดของเราด้วยความหวังว่าจะช่วยนักพัฒนา AI คนอื่นๆ ในการแก้ไขปัญหาด้านความปลอดภัยและการใช้แบบจำลองที่ปรับใช้ในทางที่ผิด

Oตลอดสองปีที่ผ่านมาเราได้เรียนรู้มากมายเกี่ยวกับวิธีการใช้และใช้แบบจำลองภาษาในทางที่ผิด—ข้อมูลเชิงลึกที่เราไม่สามารถได้รับหากไม่มีประสบการณ์ในการใช้งานจริง ในเดือนมิถุนายน 2020 เราเริ่มให้นักพัฒนาและนักวิจัยเข้าถึง เปิด AI APIซึ่งเป็นอินเทอร์เฟซสำหรับการเข้าถึงและสร้างแอปพลิเคชันบนโมเดล AI ใหม่ที่พัฒนาโดย OpenAI การปรับใช้ GPT-3, Codex และโมเดลอื่นๆ ในลักษณะที่ช่วยลดความเสี่ยงของอันตรายทำให้เกิดความท้าทายด้านเทคนิคและนโยบายหลายประการ

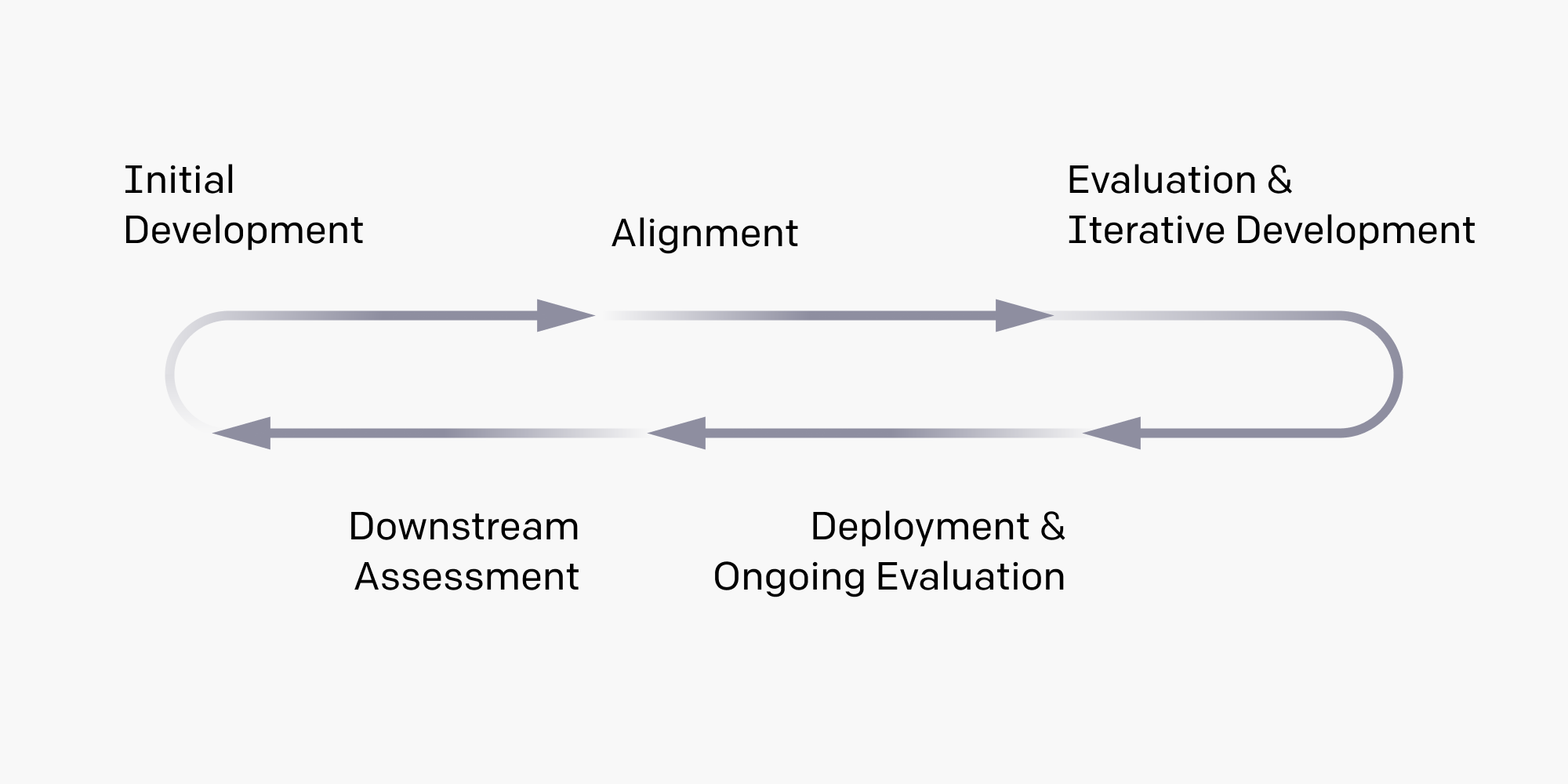

ภาพรวมของวิธีการปรับใช้แบบจำลองของเรา

โมเดลภาษาขนาดใหญ่สามารถแสดง a . ได้แล้ว งานที่หลากหลายมากมักจะออกจากกล่อง โปรไฟล์ความเสี่ยง การใช้งานที่เป็นไปได้ และผลกระทบในวงกว้างต่อสังคม ยังคง ไม่สบาย เข้าใจ. ด้วยเหตุนี้ แนวทางการปรับใช้ของเราจึงเน้นย้ำการทำซ้ำอย่างต่อเนื่อง และใช้กลยุทธ์ต่อไปนี้โดยมุ่งเป้าไปที่การเพิ่มประโยชน์ของการปรับใช้ให้สูงสุดพร้อมทั้งลดความเสี่ยงที่เกี่ยวข้อง:

- การวิเคราะห์ความเสี่ยงก่อนปรับใช้ โดยใช้ประโยชน์จากชุดการประเมินความปลอดภัยที่เพิ่มขึ้นและเครื่องมือทีมสีแดง (เช่น เราตรวจสอบ InstructGPT ของเราสำหรับการลดระดับความปลอดภัยโดยใช้การประเมิน กล่าวถึงด้านล่าง)

- เริ่มต้นด้วยฐานผู้ใช้ขนาดเล็ก (เช่น ทั้ง GPT-3 และ our แนะนำ GPT ซีรีส์เริ่มเป็นเบต้าส่วนตัว)

- ศึกษาผลลัพธ์ของการนำร่องของกรณีการใช้งานแบบใหม่ (เช่น การสำรวจเงื่อนไขที่เราสามารถเปิดใช้งานการสร้างเนื้อหาแบบยาวได้อย่างปลอดภัย ทำงานกับลูกค้าจำนวนน้อย)

- การดำเนินการตามกระบวนการที่ช่วยรักษาจังหวะการใช้งาน (เช่น ทบทวนกรณีการใช้งาน โควต้าโทเค็น และขีดจำกัดอัตรา)

- ดำเนินการทบทวนย้อนหลังโดยละเอียด (เช่น เหตุการณ์ด้านความปลอดภัยและการใช้งานหลัก)

โปรดทราบว่าไดอะแกรมนี้มีจุดมุ่งหมายเพื่อสื่อให้เห็นถึงความจำเป็นของลูปป้อนกลับในกระบวนการต่อเนื่องของการพัฒนาและปรับใช้แบบจำลอง และข้อเท็จจริงที่ว่าความปลอดภัยจะต้องถูกรวมเข้าด้วยกันในแต่ละขั้นตอน ไม่ได้มีจุดมุ่งหมายเพื่อนำเสนอภาพที่สมบูรณ์หรือสมบูรณ์แบบของกระบวนการของเราหรือขององค์กรอื่นใด

ไม่มีสัญลักษณ์แสดงหัวข้อย่อยสีเงินสำหรับการปรับใช้อย่างรับผิดชอบ ดังนั้นเราจึงพยายามเรียนรู้และจัดการกับข้อจำกัดของโมเดลของเรา และช่องทางที่เป็นไปได้สำหรับการใช้ในทางที่ผิด ในทุกขั้นตอนของการพัฒนาและการปรับใช้ แนวทางนี้ช่วยให้เราเรียนรู้ได้มากที่สุดเกี่ยวกับปัญหาด้านความปลอดภัยและนโยบายในขนาดย่อม และรวมเอาข้อมูลเชิงลึกเหล่านั้นก่อนที่จะเปิดตัวการใช้งานในวงกว้าง

แม้จะยังไม่ละเอียดถี่ถ้วน แต่บางพื้นที่ที่เราได้ลงทุนไปแล้วก็มี[1]:

- ก่อนการฝึกอบรม ข้อมูล การดูแลและการกรอง

- ปรับจูน รุ่นที่ดีกว่า ทำตามคำแนะนำ

- การวิเคราะห์ความเสี่ยงของการปรับใช้ที่อาจเกิดขึ้น

- ให้รายละเอียดผู้ใช้ เอกสาร

- การก่อสร้าง เครื่องมือ เพื่อคัดกรองผลลัพธ์ของแบบจำลองที่เป็นอันตราย

- ตรวจสอบกรณีการใช้งานกับของเรา นโยบาย

- การตรวจสอบสัญญาณของ ด่าว่า

- กำลังศึกษา ผลกระทบของแบบจำลองของเรา

เนื่องจากแต่ละขั้นตอนของการแทรกแซงมีข้อจำกัด จึงจำเป็นต้องมีแนวทางแบบองค์รวม

มีหลายพื้นที่ที่เราสามารถทำได้มากกว่านี้และเรายังมีพื้นที่สำหรับการปรับปรุง ตัวอย่างเช่น เมื่อเราทำงานกับ GPT-3 เป็นครั้งแรก เรามองว่ามันเป็นสิ่งประดิษฐ์การวิจัยภายในมากกว่าระบบการผลิต และไม่เข้มงวดในการกรองข้อมูลการฝึกอบรมที่เป็นพิษเท่าที่เราเคยเป็นมา เราได้ลงทุนมากขึ้นในการค้นคว้าและนำเนื้อหาดังกล่าวออกสำหรับรุ่นต่อๆ ไป เราใช้เวลานานขึ้นในการจัดการกับกรณีการใช้งานในทางที่ผิดในกรณีที่เราไม่มีนโยบายที่ชัดเจนในหัวข้อนี้ และได้ปรับปรุงนโยบายเหล่านั้นซ้ำแล้วซ้ำอีก และเรายังคงย้ำถึงข้อกำหนดด้านความปลอดภัยที่มีประสิทธิภาพสูงสุดในการจัดการกับความเสี่ยง ในขณะที่ยังได้รับการสื่อสารอย่างชัดเจนให้นักพัฒนาทราบ และลดแรงเสียดทานที่มากเกินไปให้เหลือน้อยที่สุด

ถึงกระนั้น เราเชื่อว่าแนวทางของเราช่วยให้เราสามารถวัดและลดอันตรายประเภทต่างๆ จากการใช้แบบจำลองทางภาษาได้เมื่อเทียบกับวิธีการแบบลงมือปฏิบัติจริง ในขณะเดียวกันก็ช่วยให้สามารถประยุกต์ใช้ในด้านวิชาการ ศิลปะ และเชิงพาณิชย์ได้อย่างกว้างขวาง โมเดล[2]

การใช้รูปแบบภาษาที่ผิดรูปแบบและหลายขนาด

OpenAI ทำงานอย่างแข็งขันในการวิจัยความเสี่ยงของการใช้ AI ในทางที่ผิดตั้งแต่เราทำงานครั้งแรกใน การใช้ AI . ในทางที่ผิด ใน 2018 และ บน GPT-2 ในปี 2019 และเราได้ให้ความสนใจเป็นพิเศษกับระบบ AI ที่เพิ่มขีดความสามารถในการดำเนินงานที่มีอิทธิพล เรามี ทำงานร่วมกับ ผู้เชี่ยวชาญภายนอกในการพัฒนา หลักฐานของแนวคิด และเลื่อนขั้น ระมัดระวัง การวิเคราะห์ ความเสี่ยงดังกล่าวโดยบุคคลที่สาม เรายังคงมุ่งมั่นที่จะจัดการกับความเสี่ยงที่เกี่ยวข้องกับการดำเนินงานที่มีอิทธิพลต่อแบบจำลองทางภาษา และเมื่อเร็ว ๆ นี้ได้ร่วมจัดการประชุมเชิงปฏิบัติการในหัวข้อนี้[3]

แต่เราได้ตรวจพบและหยุดนักแสดงหลายร้อยคนที่พยายามใช้ GPT-3 ในทางที่ผิดเพื่อวัตถุประสงค์ที่กว้างกว่าการสร้างข้อมูลที่บิดเบือนสำหรับการดำเนินการที่มีอิทธิพล ซึ่งรวมถึงวิธีที่เราไม่ได้คาดหวังหรือที่เราคาดไว้แต่ไม่ได้คาดหวังว่าจะเป็น แพร่หลายมาก[4] Our แนวทางการใช้กรณี, หลักเกณฑ์ด้านเนื้อหาและโครงสร้างพื้นฐานการตรวจจับภายในและการตอบสนองในขั้นต้นมุ่งเน้นไปที่ความเสี่ยงที่เราคาดการณ์ไว้จากการวิจัยภายในและภายนอก เช่น การสร้างเนื้อหาทางการเมืองที่ทำให้เข้าใจผิดด้วย GPT-3 หรือการสร้างมัลแวร์ด้วย Codex ความพยายามในการตรวจจับและตอบสนองของเราได้พัฒนาขึ้นเมื่อเวลาผ่านไปเพื่อตอบสนองต่อกรณีการใช้งานในทางที่ผิดที่เกิดขึ้นจริง "ในธรรมชาติ" ซึ่งไม่ได้มีลักษณะเด่นอย่างเด่นชัดเท่ากับการโน้มน้าวการดำเนินการในการประเมินความเสี่ยงเบื้องต้นของเรา ตัวอย่าง ได้แก่ การโปรโมตสแปมสำหรับผลิตภัณฑ์ทางการแพทย์ที่น่าสงสัยและการแสดงบทบาทสมมุติเกี่ยวกับการแบ่งแยกเชื้อชาติ

เพื่อสนับสนุนการศึกษาการใช้แบบจำลองทางภาษาในทางที่ผิดและการบรรเทาปัญหาดังกล่าว เรากำลังสำรวจโอกาสในการแบ่งปันสถิติเกี่ยวกับเหตุการณ์ด้านความปลอดภัยในปีนี้ เพื่อที่จะสรุปการอภิปรายเกี่ยวกับการใช้แบบจำลองทางภาษาในทางที่ผิด

ความยากในการวัดความเสี่ยงและผลกระทบ

ความเสี่ยงและผลกระทบของแบบจำลองทางภาษาหลายๆ ด้านยังคงวัดได้ยาก ดังนั้นจึงยากที่จะติดตาม ลดขนาด และเปิดเผยในลักษณะที่รับผิดชอบได้ เราใช้เกณฑ์มาตรฐานทางวิชาการที่มีอยู่อย่างแข็งขันในการประเมินแบบจำลองภาษาและกระตือรือร้นที่จะดำเนินการต่อจากภายนอก แต่เราพบว่าชุดข้อมูลเกณฑ์มาตรฐานที่มีอยู่มักจะไม่สะท้อนถึงความปลอดภัยและความเสี่ยงจากการใช้ในทางที่ผิดที่เราเห็นในทางปฏิบัติ[5]

ข้อจำกัดดังกล่าวสะท้อนถึงข้อเท็จจริงที่ว่าชุดข้อมูลทางวิชาการแทบไม่ถูกสร้างขึ้นเพื่อวัตถุประสงค์ที่ชัดเจนในการแจ้งการใช้แบบจำลองภาษาในการผลิต และไม่ได้รับประโยชน์จากประสบการณ์ที่ได้รับจากการปรับใช้แบบจำลองดังกล่าวในวงกว้าง ด้วยเหตุนี้ เราจึงได้พัฒนาชุดข้อมูลและกรอบงานการประเมินใหม่สำหรับการวัดความปลอดภัยของแบบจำลองของเรา ซึ่งเราวางแผนที่จะเผยแพร่ในเร็วๆ นี้ โดยเฉพาะอย่างยิ่ง เราได้พัฒนาตัวชี้วัดการประเมินใหม่สำหรับการวัดความเป็นพิษในผลลัพธ์ของแบบจำลอง และยังได้พัฒนาตัวแยกประเภทภายในสำหรับการตรวจจับเนื้อหาที่ละเมิดของเรา นโยบายเนื้อหาเช่น เนื้อหาเกี่ยวกับกาม วาจาสร้างความเกลียดชัง ความรุนแรง การล่วงละเมิด และการทำร้ายตนเอง ทั้งสองสิ่งนี้ยังถูกนำไปใช้ในการปรับปรุงข้อมูลก่อนการฝึกอบรมของเราอีกด้วย[6]โดยเฉพาะอย่างยิ่ง โดยใช้ตัวแยกประเภทเพื่อกรองเนื้อหาออกและตัววัดการประเมินเพื่อวัดผลกระทบของการแทรกแซงชุดข้อมูล

การแยกประเภทเอาต์พุตของแบบจำลองแต่ละรายการตามมิติต่างๆ อย่างน่าเชื่อถือนั้นเป็นเรื่องยาก และการวัดผลกระทบทางสังคมในระดับ OpenAI API นั้นยากกว่า เราได้ทำการศึกษาภายในหลายครั้งเพื่อสร้างกล้ามเนื้อของสถาบันสำหรับการวัดดังกล่าว แต่สิ่งเหล่านี้มักทำให้เกิดคำถามมากกว่าคำตอบ

เรามีความสนใจเป็นพิเศษในการทำความเข้าใจผลกระทบทางเศรษฐกิจของแบบจำลองของเราและการกระจายของผลกระทบเหล่านั้น เรามีเหตุผลที่ดีที่จะเชื่อว่าผลกระทบของตลาดแรงงานจากการปรับใช้แบบจำลองในปัจจุบันอาจมีนัยสำคัญในแง่ที่สมบูรณ์อยู่แล้ว และจะเติบโตตามความสามารถและการเข้าถึงของแบบจำลองของเรา เราได้เรียนรู้เกี่ยวกับผลกระทบในพื้นที่ต่างๆ จนถึงปัจจุบัน รวมถึงการปรับปรุงประสิทธิภาพการทำงานอย่างมากในงานที่มีอยู่ที่ดำเนินการโดยบุคคล เช่น การเขียนคำโฆษณาและการสรุป (บางครั้งมีส่วนทำให้เกิดการแทนที่งานและการสร้างงาน) ตลอดจนกรณีที่ API ปลดล็อกแอปพลิเคชันใหม่ที่ไม่เคยทำได้มาก่อน , เช่น การสังเคราะห์ผลตอบรับเชิงคุณภาพขนาดใหญ่. แต่เราขาดความเข้าใจที่ดีเกี่ยวกับผลกระทบสุทธิ

เราเชื่อว่าการพัฒนาและปรับใช้เทคโนโลยี AI อันทรงพลังเป็นสิ่งสำคัญสำหรับการพัฒนาและแก้ไขปัญหาทั้งด้านบวกและด้านลบจากการทำงานโดยตรง เราพูดถึงขั้นตอนบางอย่างในทิศทางนั้นในส่วนสรุปของโพสต์นี้

ความสัมพันธ์ระหว่างความปลอดภัยและประโยชน์ของระบบ AI

ในของเรา กฎบัตรซึ่งเผยแพร่ในปี 2018 เรากล่าวว่า "เรากังวลว่าการพัฒนา AGI ระยะสุดท้ายจะกลายเป็นการแข่งขันที่แข่งขันได้โดยไม่มีเวลาสำหรับมาตรการป้องกันความปลอดภัยที่เพียงพอ" เราก็ การตีพิมพ์ การวิเคราะห์โดยละเอียดของการพัฒนา AI ที่สามารถแข่งขันได้ และเราได้ติดตามอย่างใกล้ชิด ภายหลัง การวิจัย. ในขณะเดียวกัน การปรับใช้ระบบ AI ผ่าน OpenAI API ทำให้เราเข้าใจถึงการทำงานร่วมกันระหว่างความปลอดภัยและยูทิลิตี้

ตัวอย่างเช่น นักพัฒนาซอฟต์แวร์ชอบโมเดล InstructGPT ของเราอย่างล้นหลาม—ซึ่งปรับแต่งมาอย่างดีเพื่อให้เป็นไปตามความตั้งใจของผู้ใช้[7]—เหนือรุ่น GPT-3 พื้นฐาน อย่างไรก็ตาม สิ่งที่น่าสังเกตคือ โมเดล InstructGPT เดิมไม่ได้มีแรงจูงใจในการพิจารณาเชิงพาณิชย์ แต่มุ่งเป้าไปที่การสร้างความก้าวหน้าในระยะยาว ปัญหาการจัดตำแหน่ง. ในทางปฏิบัติ นี่หมายความว่าลูกค้า อาจไม่น่าแปลกใจเลยว่าทำไมถึงชอบโมเดลที่คงไว้ซึ่งการทำงานและเข้าใจเจตนาของผู้ใช้ และโมเดลที่มีโอกาสน้อยที่จะให้ผลลัพธ์ที่เป็นอันตรายหรือไม่ถูกต้อง[8] การวิจัยพื้นฐานอื่นๆ เช่น งานของเราเกี่ยวกับ การใช้ประโยชน์จากข้อมูล ดึงมาจากอินเทอร์เน็ตเพื่อตอบคำถามที่เป็นจริงมากขึ้นนอกจากนี้ยังมีศักยภาพในการปรับปรุงยูทิลิตี้เชิงพาณิชย์ของระบบ AI[9]

การทำงานร่วมกันเหล่านี้จะไม่เกิดขึ้นเสมอไป ตัวอย่างเช่น ระบบที่ทรงพลังกว่ามักจะใช้เวลาในการประเมินและดำเนินการอย่างมีประสิทธิภาพมากขึ้น ซึ่งจะทำให้โอกาสในการทำกำไรในทันที และยูทิลิตี้ของผู้ใช้และของสังคมอาจไม่สอดคล้องกันเนื่องจากปัจจัยภายนอกเชิงลบ ให้พิจารณาการเขียนคำโฆษณาแบบอัตโนมัติทั้งหมด ซึ่งอาจเป็นประโยชน์สำหรับผู้สร้างเนื้อหา แต่ไม่ดีต่อระบบนิเวศของข้อมูลโดยรวม

เป็นเรื่องที่น่ายินดีที่ได้เห็นกรณีของการผนึกกำลังที่แข็งแกร่งระหว่างความปลอดภัยและยูทิลิตี้ แต่เรามุ่งมั่นที่จะลงทุนในการวิจัยด้านความปลอดภัยและนโยบายแม้ว่าพวกเขาจะแลกกับยูทิลิตี้เชิงพาณิชย์

วิธีการมีส่วนร่วม

บทเรียนแต่ละบทข้างต้นทำให้เกิดคำถามใหม่ๆ ในตัวมันเอง เหตุการณ์ด้านความปลอดภัยประเภทใดที่เรายังคงไม่สามารถตรวจจับและคาดการณ์ได้ เราจะวัดความเสี่ยงและผลกระทบได้ดีขึ้นได้อย่างไร เราจะปรับปรุงทั้งความปลอดภัยและประโยชน์ของโมเดลของเราต่อไปได้อย่างไร และนำทางให้เกิดการประนีประนอมระหว่างสองสิ่งนี้เมื่อเกิดขึ้นได้อย่างไร

เรากำลังพูดถึงปัญหาเหล่านี้อย่างจริงจังกับบริษัทอื่นๆ ที่ใช้โมเดลภาษา แต่เราทราบด้วยว่าไม่มีองค์กรหรือกลุ่มองค์กรใดที่มีคำตอบทั้งหมด และเราอยากจะเน้นให้เห็นถึงวิธีการต่างๆ ที่ผู้อ่านสามารถมีส่วนร่วมมากขึ้นในการทำความเข้าใจและกำหนดรูปแบบการใช้งานระบบ AI ที่ทันสมัยของเรา

ประการแรก การได้รับประสบการณ์โดยตรงในการโต้ตอบกับระบบ AI ที่ล้ำสมัยนั้นมีค่ามากสำหรับการทำความเข้าใจความสามารถและความหมาย เราเพิ่งยุติรายการรอ API หลังจากสร้างความมั่นใจมากขึ้นในความสามารถของเราในการตรวจจับและตอบสนองต่อการใช้ในทางที่ผิดอย่างมีประสิทธิภาพ บุคคลใน ประเทศและดินแดนที่รองรับ สามารถเข้าถึง OpenAI API ได้อย่างรวดเร็วโดยการลงทะเบียน โปรดคลิกที่นี่เพื่ออ่านรายละเอียดเพิ่มเติม.

ประการที่สอง นักวิจัยที่ทำงานในหัวข้อที่เราสนใจเป็นพิเศษ เช่น ความลำเอียงและการใช้ในทางที่ผิด และผู้ที่จะได้รับประโยชน์จากการสนับสนุนทางการเงิน สามารถสมัครขอเครดิต API ที่อุดหนุนได้โดยใช้ แบบฟอร์มนี้. การวิจัยภายนอกมีความสำคัญต่อการให้ข้อมูลทั้งความเข้าใจของเราเกี่ยวกับระบบที่มีหลายแง่มุมเหล่านี้ ตลอดจนความเข้าใจของสาธารณชนในวงกว้าง

ในที่สุด วันนี้เราจะมาเผยแพร่ วาระการวิจัย สำรวจผลกระทบของตลาดแรงงานที่เกี่ยวข้องกับกลุ่มโมเดล Codex ของเรา และการเรียกร้องให้ผู้ทำงานร่วมกันภายนอกดำเนินการวิจัยนี้ เรารู้สึกตื่นเต้นที่ได้ร่วมงานกับนักวิจัยอิสระเพื่อศึกษาผลกระทบของเทคโนโลยีของเรา เพื่อแจ้งการแทรกแซงนโยบายที่เหมาะสม และเพื่อขยายความคิดของเราในที่สุดจากการสร้างโค้ดไปสู่รูปแบบอื่นๆ

หากคุณสนใจที่จะปรับใช้เทคโนโลยี AI ที่ทันสมัยอย่างมีความรับผิดชอบ ใช้ ไปทำงานที่ OpenAI!

- 2019

- 2020

- 7

- 9

- เกี่ยวกับเรา

- แน่นอน

- เข้า

- คล่องแคล่ว

- ที่อยู่

- ที่อยู่

- ข้อได้เปรียบ

- AI

- ทั้งหมด

- แล้ว

- ขยาย

- การวิเคราะห์

- API

- เหมาะสม

- การใช้งาน

- การใช้งาน

- เข้าใกล้

- ศิลปะ

- อัตโนมัติ

- กำลัง

- มาตรฐาน

- ประโยชน์ที่ได้รับ

- เบิร์กลีย์

- กล่อง

- สร้าง

- การก่อสร้าง

- โทรศัพท์

- เคมบริดจ์

- สามารถรับ

- ความสามารถในการ

- การปฏิบัติ

- กรณี

- ท้าทาย

- ความท้าทาย

- รหัส

- เชิงพาณิชย์

- บริษัท

- เมื่อเทียบกับ

- ส่วนประกอบ

- ความมั่นใจ

- ภาชนะ

- เนื้อหา

- ต่อ

- ควบคุม

- ค่าใช้จ่าย

- ได้

- ประเทศ

- ผู้สร้าง

- เครดิต

- ปัจจุบัน

- ลูกค้า

- ตัดขอบ

- ข้อมูล

- ปรับใช้

- ปรับใช้

- การใช้งาน

- ตรวจพบ

- การตรวจพบ

- พัฒนา

- พัฒนา

- ผู้พัฒนา

- นักพัฒนา

- ที่กำลังพัฒนา

- พัฒนาการ

- DID

- แตกต่าง

- ต่าง

- Dimension

- สนทนา

- การกระจาย

- ก่อน

- ด้านเศรษฐกิจ

- ผลกระทบทางเศรษฐกิจ

- ระบบนิเวศ

- ผล

- มีประสิทธิภาพ

- ผลกระทบ

- เพิ่มขีดความสามารถ

- การเปิดใช้งาน

- ให้กำลังใจ

- มีส่วนร่วม

- อุดม

- ตัวอย่าง

- แสดง

- คาดหวัง

- รายจ่าย

- ประสบการณ์

- ผู้เชี่ยวชาญ

- ความล้มเหลว

- ครอบครัว

- ลักษณะ

- ข้อเสนอแนะ

- ทางการเงิน

- ชื่อจริง

- โฟกัส

- มุ่งเน้น

- ปฏิบัติตาม

- ดังต่อไปนี้

- ฟอร์ม

- รูปแบบ

- พบ

- เต็ม

- เพศ

- ให้

- ดี

- ขึ้น

- การเจริญเติบโต

- สุขภาพ

- ช่วย

- เป็นประโยชน์

- เน้น

- สรุป ความน่าเชื่อถือของ Olymp Trade?

- ทำอย่างไร

- HTTPS

- ร้อย

- ส่งผลกระทบ

- สำคัญ

- ปรับปรุง

- ประกอบด้วย

- รวม

- รวมทั้ง

- เป็นรายบุคคล

- มีอิทธิพล

- ข้อมูล

- โครงสร้างพื้นฐาน

- ข้อมูลเชิงลึก

- สถาบัน

- แบบบูรณาการ

- ความตั้งใจ

- อยากเรียนรู้

- อินเตอร์เฟซ

- อินเทอร์เน็ต

- การลงทุน

- ร่วมมือ

- ปัญหา

- IT

- การสัมภาษณ์

- การติดฉลาก

- แรงงาน

- ภาษา

- ล่าสุด

- การเปิดตัว

- เรียนรู้

- ได้เรียนรู้

- บทเรียนที่ได้รับ

- น้อย

- ในประเทศ

- นาน

- สำคัญ

- การทำ

- มัลแวร์

- ด้วยมือ

- ตลาด

- มาก

- วัด

- ทางการแพทย์

- สุขภาพจิต

- ตัวชี้วัด

- แบบ

- โมเดล

- มากที่สุด

- สุทธิ

- เสนอ

- เปิด

- โอเพนซอร์ส

- การดำเนินการ

- โอกาส

- ใบสั่ง

- organizacja

- องค์กร

- อื่นๆ

- มิฉะนั้น

- ต้องจ่าย

- รูปแบบไฟล์ PDF

- คน

- บางที

- มุมมอง

- ภาพ

- นักบิน

- นโยบาย

- นโยบาย

- ทางการเมือง

- เป็นไปได้

- ที่มีประสิทธิภาพ

- ส่วนตัว

- กระบวนการ

- กระบวนการ

- ก่อ

- การผลิต

- ผลผลิต

- ผลิตภัณฑ์

- ดูรายละเอียด

- กำไร

- สาธารณะ

- การประกาศ

- วัตถุประสงค์

- วัตถุประสงค์

- อย่างรวดเร็ว

- เชื่อชาติ

- ยก

- พิสัย

- RE

- ผู้อ่าน

- ลด

- ลด

- สะท้อน

- ความสัมพันธ์

- ปล่อย

- ความต้องการ

- การวิจัย

- คำตอบ

- รับผิดชอบ

- ข้อ จำกัด

- ผลสอบ

- ทบทวน

- รีวิว

- ความเสี่ยง

- ความเสี่ยง

- ความปลอดภัย

- ประหยัด

- ขนาด

- จอภาพ

- ที่กำลังมองหา

- ชุด

- ชุด

- รูปร่าง

- Share

- สำคัญ

- สัญญาณ

- เงิน

- เล็ก

- So

- สังคม

- สังคม

- ช่องว่าง

- สแปม

- เฉพาะ

- ระยะ

- สถานะ

- สถิติ

- เข้าพัก

- กลยุทธ์

- แข็งแรง

- การศึกษา

- ศึกษา

- สไตล์

- สนับสนุน

- ระบบ

- ระบบ

- งาน

- วิชาการ

- เทคโนโลยี

- คิด

- บุคคลที่สาม

- ตลอด

- เวลา

- ในวันนี้

- โทเค็น

- เครื่องมือ

- ด้านบน

- หัวข้อ

- การค้า

- การฝึกอบรม

- แปลง

- เข้าใจ

- us

- ใช้

- ผู้ใช้

- ประโยชน์

- อะไร

- WHO

- ไม่มี

- งาน

- ทำงาน

- การทำงาน

- การเขียน

- ปี