อเมซอน SageMaker ทำให้ง่ายต่อการปรับใช้โมเดล Machine Learning (ML) สำหรับการอนุมานแบบเรียลไทม์ และเสนออินสแตนซ์ ML ที่หลากหลายซึ่งครอบคลุม CPU และตัวเร่งความเร็ว เช่น การอนุมาน AWS. ในฐานะบริการที่มีการจัดการเต็มรูปแบบ คุณสามารถปรับขนาดการปรับใช้โมเดลของคุณ ลดต้นทุนการอนุมาน และจัดการโมเดลของคุณได้อย่างมีประสิทธิภาพมากขึ้นในการผลิตด้วยภาระในการดำเนินงานที่ลดลง ตำแหน่งข้อมูลการอนุมานแบบเรียลไทม์ของ SageMaker ประกอบด้วยตำแหน่งข้อมูล HTTP และอินสแตนซ์ ML ที่ใช้งานทั่วทั้ง Availability Zone หลายแห่งเพื่อความพร้อมใช้งานสูง SageMaker แอปพลิเคชันปรับขนาดอัตโนมัติ สามารถปรับจำนวนอินสแตนซ์ ML ที่จัดเตรียมไว้สำหรับโมเดลได้แบบไดนามิกเพื่อตอบสนองต่อการเปลี่ยนแปลงปริมาณงาน ตำแหน่งข้อมูลจะกระจายคำขอขาเข้าไปยังอินสแตนซ์ ML อย่างสม่ำเสมอโดยใช้อัลกอริธึมแบบ Round-robin

เมื่อโมเดล ML ที่ใช้งานบนอินสแตนซ์ได้รับการเรียก API จากไคลเอนต์จำนวนมาก การกระจายคำขอแบบสุ่มจะทำงานได้ดีมากเมื่อคำขอและการตอบกลับของคุณไม่มีความแปรปรวนมากนัก แต่ในระบบที่มีปริมาณงาน AI เชิงสร้างสรรค์ คำขอและการตอบสนองอาจมีการเปลี่ยนแปลงอย่างมาก ในกรณีเหล่านี้ มักเป็นที่พึงปรารถนาที่จะปรับสมดุลโหลดโดยคำนึงถึงความจุและการใช้งานของอินสแตนซ์ แทนที่จะพิจารณาการปรับสมดุลโหลดแบบสุ่ม

ในโพสต์นี้ เราจะพูดถึงกลยุทธ์การกำหนดเส้นทางคำขอที่โดดเด่นน้อยที่สุด (LOR) ของ SageMaker และวิธีที่กลยุทธ์สามารถลดเวลาแฝงสำหรับปริมาณงานการอนุมานแบบเรียลไทม์บางประเภทโดยคำนึงถึงความจุและการใช้งานของอินสแตนซ์ ML เราพูดถึงคุณประโยชน์ของกลไกการกำหนดเส้นทางเริ่มต้น และวิธีที่คุณสามารถเปิดใช้งาน LOR สำหรับการปรับใช้โมเดลของคุณ สุดท้ายนี้ เราจะนำเสนอการวิเคราะห์เชิงเปรียบเทียบของการปรับปรุงเวลาแฝงด้วย LOR เหนือกลยุทธ์การกำหนดเส้นทางเริ่มต้นของการกำหนดเส้นทางแบบสุ่ม

กลยุทธ์ SageMaker LOR

ตามค่าเริ่มต้น ตำแหน่งข้อมูล SageMaker จะมีกลยุทธ์การกำหนดเส้นทางแบบสุ่ม ขณะนี้ SageMaker รองรับกลยุทธ์ LOR ซึ่งช่วยให้ SageMaker สามารถกำหนดเส้นทางคำขอไปยังอินสแตนซ์ที่เหมาะสมที่สุดที่จะตอบสนองคำขอนั้นได้อย่างเหมาะสมที่สุด SageMaker ทำให้สิ่งนี้เป็นไปได้โดยการตรวจสอบโหลดของอินสแตนซ์ที่อยู่ด้านหลังตำแหน่งข้อมูลของคุณและโมเดลหรือส่วนประกอบการอนุมานที่ใช้งานในแต่ละอินสแตนซ์

แผนภาพเชิงโต้ตอบต่อไปนี้แสดงนโยบายการกำหนดเส้นทางเริ่มต้นที่คำขอที่มาถึงจุดสิ้นสุดของโมเดลจะถูกส่งต่อในลักษณะสุ่มไปยังอินสแตนซ์ ML

แผนภาพเชิงโต้ตอบต่อไปนี้แสดงกลยุทธ์การกำหนดเส้นทางที่ SageMaker จะกำหนดเส้นทางคำขอไปยังอินสแตนซ์ที่มีจำนวนคำขอที่ค้างอยู่น้อยที่สุด

โดยทั่วไป การกำหนดเส้นทาง LOR จะทำงานได้ดีสำหรับโมเดลพื้นฐานหรือโมเดล AI ทั่วไป เมื่อโมเดลของคุณตอบสนองในหลายร้อยมิลลิวินาทีถึงนาที หากการตอบสนองของโมเดลของคุณมีเวลาแฝงต่ำกว่า (สูงถึงหลายร้อยมิลลิวินาที) คุณอาจได้รับประโยชน์มากขึ้นจากการกำหนดเส้นทางแบบสุ่ม ไม่ว่าอย่างไรก็ตาม เราขอแนะนำให้คุณทดสอบและระบุอัลกอริทึมการกำหนดเส้นทางที่ดีที่สุดสำหรับปริมาณงานของคุณ

วิธีการตั้งค่ากลยุทธ์การกำหนดเส้นทาง SageMaker

SageMaker ให้คุณตั้งค่าไฟล์ RoutingStrategy พารามิเตอร์ในขณะที่สร้าง EndpointConfiguration สำหรับจุดสิ้นสุด ความแตกต่าง RoutingStrategy ค่าที่ SageMaker รองรับคือ:

LEAST_OUTSTANDING_REQUESTSRANDOM

ต่อไปนี้เป็นตัวอย่างการใช้งานโมเดลบนจุดสิ้นสุดการอนุมานที่เปิดใช้งาน LOR:

- สร้างการกำหนดค่าอุปกรณ์ปลายทางโดยการตั้งค่า

RoutingStrategyasLEAST_OUTSTANDING_REQUESTS: - สร้างตำแหน่งข้อมูลโดยใช้การกำหนดค่าตำแหน่งข้อมูล (ไม่มีการเปลี่ยนแปลง):

ผลการดำเนินงาน

เราใช้การวัดประสิทธิภาพเพื่อวัดเวลาแฝงในการอนุมานจากต้นทางถึงปลายทางและปริมาณงานของ โคเดเจน2-7B โมเดลที่โฮสต์บนอินสแตนซ์ ml.g5.24xl พร้อมการกำหนดเส้นทางเริ่มต้นและจุดสิ้นสุดการกำหนดเส้นทางอัจฉริยะ โมเดล CodeGen2 เป็นของตระกูลโมเดลภาษาแบบถอยหลังอัตโนมัติ และสร้างโค้ดที่ปฏิบัติการได้เมื่อได้รับแจ้งเป็นภาษาอังกฤษ

ในการวิเคราะห์ของเรา เราได้เพิ่มจำนวนอินสแตนซ์ ml.g5.24xl ที่อยู่ด้านหลังแต่ละตำแหน่งข้อมูลสำหรับการทดสอบแต่ละครั้ง เนื่องจากจำนวนผู้ใช้พร้อมกันเพิ่มขึ้น ดังที่แสดงในตารางต่อไปนี้

| ทดสอบ | จำนวนผู้ใช้พร้อมกัน | จำนวนอินสแตนซ์ |

| 1 | 4 | 1 |

| 2 | 20 | 5 |

| 3 | 40 | 10 |

| 4 | 60 | 15 |

| 5 | 80 | 20 |

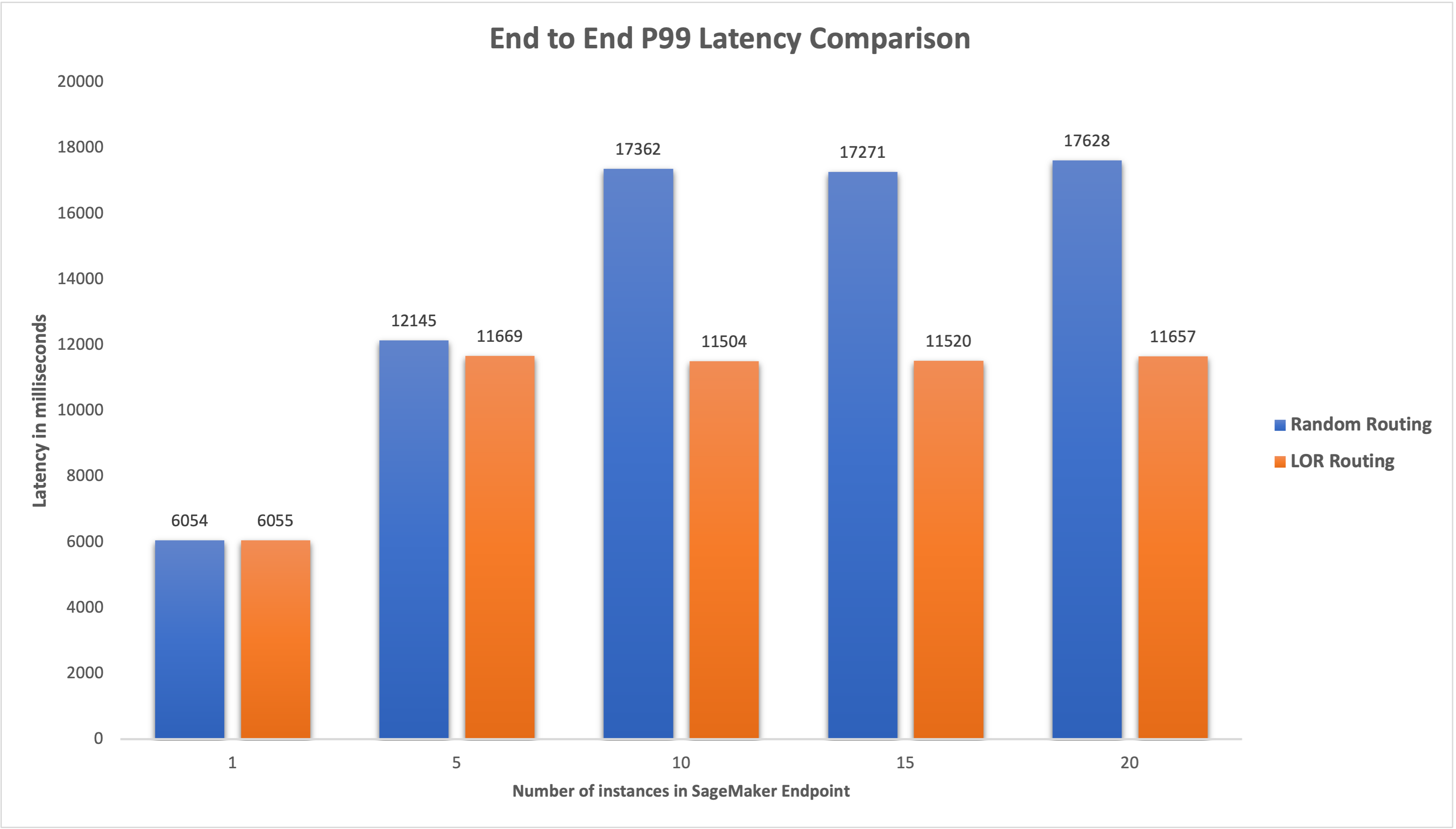

เราวัดเวลาแฝง P99 จากต้นทางถึงปลายทางสำหรับปลายทางทั้งสองแห่ง และสังเกตเห็นการปรับปรุงเวลาแฝง 4–33% เมื่อจำนวนอินสแตนซ์เพิ่มขึ้นจาก 5 เป็น 20 ดังที่แสดงในกราฟต่อไปนี้

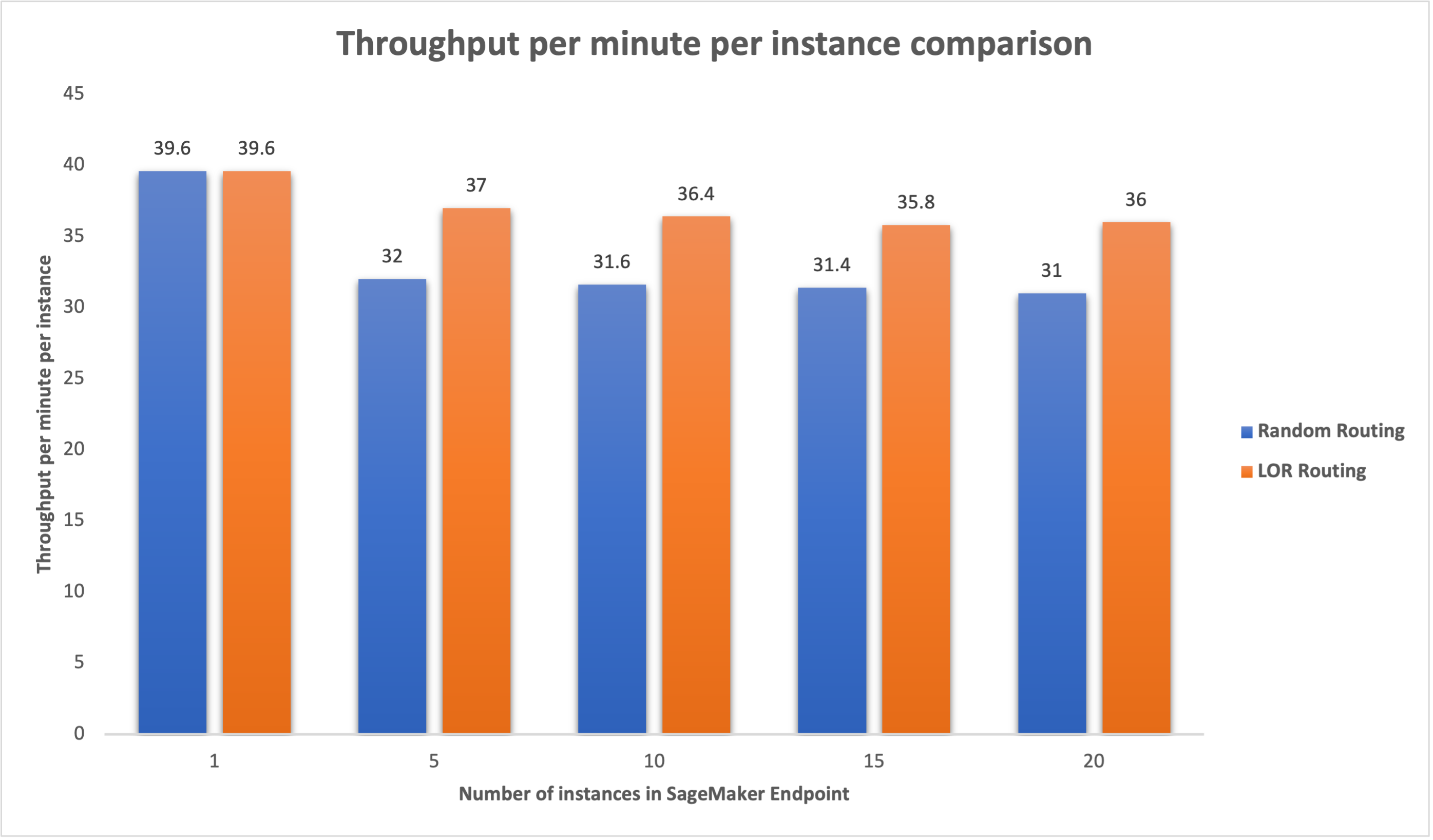

ในทำนองเดียวกัน เราสังเกตเห็นการปรับปรุงปริมาณงานต่อนาทีต่ออินสแตนซ์เพิ่มขึ้น 15–16% เมื่อจำนวนอินสแตนซ์เพิ่มขึ้นจาก 5 เป็น 20

นี่แสดงให้เห็นว่าการกำหนดเส้นทางอัจฉริยะสามารถปรับปรุงการกระจายการรับส่งข้อมูลระหว่างจุดปลายทาง ซึ่งนำไปสู่การปรับปรุงเวลาแฝงจากต้นทางถึงปลายทางและปริมาณงานโดยรวม

สรุป

ในโพสต์นี้ เราได้อธิบายกลยุทธ์การกำหนดเส้นทางของ SageMaker และตัวเลือกใหม่ในการเปิดใช้งานการกำหนดเส้นทาง LOR เราได้อธิบายวิธีเปิดใช้งาน LOR และประโยชน์ที่จะเป็นประโยชน์ต่อการปรับใช้โมเดลของคุณ การทดสอบประสิทธิภาพของเราแสดงให้เห็นถึงการปรับปรุงเวลาแฝงและปริมาณงานในระหว่างการอนุมานแบบเรียลไทม์ หากต้องการเรียนรู้เพิ่มเติมเกี่ยวกับคุณสมบัติการกำหนดเส้นทาง SageMaker โปรดดูที่ เอกสาร. เราขอแนะนำให้คุณประเมินปริมาณงานการอนุมานของคุณ และพิจารณาว่าคุณได้รับการกำหนดค่าอย่างเหมาะสมที่สุดด้วยกลยุทธ์การกำหนดเส้นทางหรือไม่

เกี่ยวกับผู้เขียน

เจมส์พาร์ค เป็นสถาปนิกโซลูชันที่ Amazon Web Services เขาทำงานร่วมกับ Amazon.com เพื่อออกแบบ สร้าง และปรับใช้โซลูชันเทคโนโลยีบน AWS และมีความสนใจเป็นพิเศษในด้าน AI และการเรียนรู้ของเครื่อง ในเวลาว่างเขาสนุกกับการแสวงหาวัฒนธรรมใหม่ ประสบการณ์ใหม่ และติดตามเทรนด์เทคโนโลยีล่าสุด คุณสามารถพบเขาได้ที่ LinkedIn.

เจมส์พาร์ค เป็นสถาปนิกโซลูชันที่ Amazon Web Services เขาทำงานร่วมกับ Amazon.com เพื่อออกแบบ สร้าง และปรับใช้โซลูชันเทคโนโลยีบน AWS และมีความสนใจเป็นพิเศษในด้าน AI และการเรียนรู้ของเครื่อง ในเวลาว่างเขาสนุกกับการแสวงหาวัฒนธรรมใหม่ ประสบการณ์ใหม่ และติดตามเทรนด์เทคโนโลยีล่าสุด คุณสามารถพบเขาได้ที่ LinkedIn.

Venugopal ปาย เป็นสถาปนิกโซลูชันที่ AWS เขาอาศัยอยู่ในเบงกาลูรู ประเทศอินเดีย และช่วยเหลือลูกค้าที่เป็นเจ้าของภาษาดิจิทัลในการปรับขนาดและเพิ่มประสิทธิภาพแอปพลิเคชันของตนบน AWS

Venugopal ปาย เป็นสถาปนิกโซลูชันที่ AWS เขาอาศัยอยู่ในเบงกาลูรู ประเทศอินเดีย และช่วยเหลือลูกค้าที่เป็นเจ้าของภาษาดิจิทัลในการปรับขนาดและเพิ่มประสิทธิภาพแอปพลิเคชันของตนบน AWS

เดวิด นิเจนด้า เป็นวิศวกรอาวุโสด้านการพัฒนาซอฟต์แวร์ในทีม Amazon SageMaker ซึ่งขณะนี้กำลังปรับปรุงเวิร์กโฟลว์การเรียนรู้ของเครื่องที่ใช้งานจริง ตลอดจนเปิดตัวฟีเจอร์การอนุมานใหม่ ในเวลาว่าง เขาพยายามตามให้ทันลูกๆ ของเขา

เดวิด นิเจนด้า เป็นวิศวกรอาวุโสด้านการพัฒนาซอฟต์แวร์ในทีม Amazon SageMaker ซึ่งขณะนี้กำลังปรับปรุงเวิร์กโฟลว์การเรียนรู้ของเครื่องที่ใช้งานจริง ตลอดจนเปิดตัวฟีเจอร์การอนุมานใหม่ ในเวลาว่าง เขาพยายามตามให้ทันลูกๆ ของเขา

ทีปติ ราฆะ เป็นวิศวกรพัฒนาซอฟต์แวร์ในทีม Amazon SageMaker งานปัจจุบันของเธอมุ่งเน้นไปที่การสร้างคุณลักษณะเพื่อโฮสต์โมเดลการเรียนรู้ของเครื่องอย่างมีประสิทธิภาพ ในเวลาว่าง เธอชอบการเดินทาง เดินป่า และปลูกพืช

ทีปติ ราฆะ เป็นวิศวกรพัฒนาซอฟต์แวร์ในทีม Amazon SageMaker งานปัจจุบันของเธอมุ่งเน้นไปที่การสร้างคุณลักษณะเพื่อโฮสต์โมเดลการเรียนรู้ของเครื่องอย่างมีประสิทธิภาพ ในเวลาว่าง เธอชอบการเดินทาง เดินป่า และปลูกพืช

อลัน ตัน เป็นผู้จัดการผลิตภัณฑ์อาวุโสของ SageMaker ซึ่งเป็นผู้นำในการอนุมานแบบจำลองขนาดใหญ่ เขาหลงใหลในการใช้แมชชีนเลิร์นนิงในด้านการวิเคราะห์ นอกเวลางาน เขาสนุกกับกิจกรรมกลางแจ้ง

อลัน ตัน เป็นผู้จัดการผลิตภัณฑ์อาวุโสของ SageMaker ซึ่งเป็นผู้นำในการอนุมานแบบจำลองขนาดใหญ่ เขาหลงใหลในการใช้แมชชีนเลิร์นนิงในด้านการวิเคราะห์ นอกเวลางาน เขาสนุกกับกิจกรรมกลางแจ้ง

ดาวัล พาเทล เป็นหัวหน้าสถาปนิก Machine Learning ที่ AWS เขาได้ทำงานร่วมกับองค์กรต่างๆ ตั้งแต่องค์กรขนาดใหญ่ไปจนถึงสตาร์ทอัพขนาดกลางในปัญหาที่เกี่ยวข้องกับการคำนวณแบบกระจายและปัญญาประดิษฐ์ เขามุ่งเน้นไปที่การเรียนรู้อย่างลึกซึ้งรวมถึงโดเมน NLP และ Computer Vision เขาช่วยให้ลูกค้าบรรลุการอนุมานแบบจำลองประสิทธิภาพสูงบน SageMaker

ดาวัล พาเทล เป็นหัวหน้าสถาปนิก Machine Learning ที่ AWS เขาได้ทำงานร่วมกับองค์กรต่างๆ ตั้งแต่องค์กรขนาดใหญ่ไปจนถึงสตาร์ทอัพขนาดกลางในปัญหาที่เกี่ยวข้องกับการคำนวณแบบกระจายและปัญญาประดิษฐ์ เขามุ่งเน้นไปที่การเรียนรู้อย่างลึกซึ้งรวมถึงโดเมน NLP และ Computer Vision เขาช่วยให้ลูกค้าบรรลุการอนุมานแบบจำลองประสิทธิภาพสูงบน SageMaker

- เนื้อหาที่ขับเคลื่อนด้วย SEO และการเผยแพร่ประชาสัมพันธ์ รับการขยายวันนี้

- PlatoData.Network Vertical Generative Ai เพิ่มพลังให้กับตัวเอง เข้าถึงได้ที่นี่.

- เพลโตไอสตรีม. Web3 อัจฉริยะ ขยายความรู้ เข้าถึงได้ที่นี่.

- เพลโตESG. คาร์บอน, คลีนเทค, พลังงาน, สิ่งแวดล้อม แสงอาทิตย์, การจัดการของเสีย. เข้าถึงได้ที่นี่.

- เพลโตสุขภาพ เทคโนโลยีชีวภาพและข่าวกรองการทดลองทางคลินิก เข้าถึงได้ที่นี่.

- ที่มา: https://aws.amazon.com/blogs/machine-learning/minimize-real-time-inference-latency-by-using-amazon-sagemaker-routing-strategies/

- :มี

- :เป็น

- :ไม่

- :ที่ไหน

- $ ขึ้น

- 1

- 100

- 125

- 150

- 17

- 1870

- 20

- 7

- 9

- a

- สามารถ

- เกี่ยวกับเรา

- เร่ง

- บรรลุ

- ข้าม

- AI

- โมเดล AI

- อลัน

- ขั้นตอนวิธี

- ช่วยให้

- อเมซอน

- อเมซอน SageMaker

- Amazon Web Services

- Amazon.com

- ในหมู่

- an

- การวิเคราะห์

- การวิเคราะห์

- และ

- API

- การใช้งาน

- การประยุกต์ใช้

- เป็น

- AREA

- เทียม

- ปัญญาประดิษฐ์

- AS

- At

- รถยนต์

- ความพร้อมใช้งาน

- AWS

- ยอดคงเหลือ

- สมดุล

- BE

- หลัง

- เป็น

- การเปรียบเทียบ

- ประโยชน์

- ประโยชน์ที่ได้รับ

- ที่ดีที่สุด

- ทั้งสอง

- กว้าง

- สร้าง

- การก่อสร้าง

- ภาระ

- แต่

- by

- โทร

- CAN

- ความจุ

- กรณี

- บาง

- เปลี่ยนแปลง

- การเปลี่ยนแปลง

- ลูกค้า

- รหัส

- COM

- มา

- ส่วนประกอบ

- คอมพิวเตอร์

- วิสัยทัศน์คอมพิวเตอร์

- การคำนวณ

- พร้อมกัน

- องค์ประกอบ

- การกำหนดค่า

- การพิจารณา

- พิจารณา

- ประกอบ

- ค่าใช้จ่าย

- การสร้าง

- ปัจจุบัน

- ขณะนี้

- ลูกค้า

- วันที่

- ลึก

- การเรียนรู้ลึก ๆ

- ค่าเริ่มต้น

- ปรับใช้

- นำไปใช้

- การใช้งาน

- การใช้งาน

- ออกแบบ

- กำหนด

- พัฒนาการ

- ต่าง

- สนทนา

- กระจาย

- คอมพิวเตอร์แบบกระจาย

- การกระจาย

- โดเมน

- ในระหว่าง

- แบบไดนามิก

- แต่ละ

- มีประสิทธิภาพ

- อย่างมีประสิทธิภาพ

- ความพยายาม

- ทำให้สามารถ

- เปิดการใช้งาน

- ส่งเสริม

- จบสิ้น

- ปลายทาง

- วิศวกร

- ภาษาอังกฤษ

- ผู้ประกอบการ

- ประเมินค่า

- ตัวอย่าง

- ประสบการณ์

- อธิบาย

- อย่างยิ่ง

- ครอบครัว

- คุณสมบัติ

- ในที่สุด

- หา

- มุ่งเน้นไปที่

- ดังต่อไปนี้

- สำหรับ

- พื้นฐาน

- ราคาเริ่มต้นที่

- อย่างเต็มที่

- General

- สร้าง

- กำเนิด

- กำเนิด AI

- GIF

- กำหนด

- กราฟ

- การเจริญเติบโต

- มี

- he

- จะช่วยให้

- เธอ

- จุดสูง

- พระองค์

- ของเขา

- เจ้าภาพ

- เป็นเจ้าภาพ

- สรุป ความน่าเชื่อถือของ Olymp Trade?

- ทำอย่างไร

- HTML

- HTTPS

- ร้อย

- แยกแยะ

- if

- แสดงให้เห็นถึง

- ปรับปรุง

- การปรับปรุง

- การปรับปรุง

- การปรับปรุง

- in

- รวมทั้ง

- ขาเข้า

- เพิ่มขึ้น

- อินเดีย

- ตัวอย่าง

- Intelligence

- การโต้ตอบ

- อยากเรียนรู้

- เข้าไป

- IT

- ITS

- jpg

- เก็บ

- เด็ก

- ภาษา

- ใหญ่

- องค์กรขนาดใหญ่

- ความแอบแฝง

- ล่าสุด

- การเปิดตัว

- ชั้นนำ

- เรียนรู้

- การเรียนรู้

- น้อยที่สุด

- ชีวิต

- โหลด

- Lot

- ลด

- เครื่อง

- เรียนรู้เครื่อง

- ทำให้

- จัดการ

- การจัดการ

- ผู้จัดการ

- ลักษณะ

- อาจ..

- วัด

- กลไก

- มิลลิวินาที

- นาที

- นาที

- ML

- แบบ

- โมเดล

- การตรวจสอบ

- ข้อมูลเพิ่มเติม

- หลาย

- ใหม่

- NLP

- ไม่

- ตอนนี้

- จำนวน

- of

- เสนอ

- มักจะ

- on

- การดำเนินงาน

- เพิ่มประสิทธิภาพ

- ตัวเลือกเสริม (Option)

- or

- องค์กร

- ของเรา

- ออก

- กลางแจ้ง

- ด้านนอก

- โดดเด่น

- เกิน

- ทั้งหมด

- พารามิเตอร์

- ในสิ่งที่สนใจ

- หลงใหล

- ต่อ

- การปฏิบัติ

- พืช

- เพลโต

- เพลโตดาต้าอินเทลลิเจนซ์

- เพลโตดาต้า

- นโยบาย

- เป็นไปได้

- โพสต์

- นำเสนอ

- หลัก

- ปัญหาที่เกิดขึ้น

- ผลิตภัณฑ์

- ผู้จัดการผลิตภัณฑ์

- การผลิต

- แจ้ง

- สุ่ม

- ตั้งแต่

- ค่อนข้าง

- เรียลไทม์

- รับ

- แนะนำ

- ลดลง

- อ้างอิง

- ไม่คำนึงถึง

- ที่เกี่ยวข้อง

- ขอ

- การร้องขอ

- คำตอบ

- การตอบสนอง

- เส้นทาง

- การกำหนดเส้นทาง

- วิ่ง

- sagemaker

- ขนาด

- ที่กำลังมองหา

- การเลือก

- ระดับอาวุโส

- ให้บริการ

- บริการ

- บริการ

- ชุด

- การตั้งค่า

- เธอ

- แสดงให้เห็นว่า

- แสดง

- แสดงให้เห็นว่า

- สมาร์ท

- ซอฟต์แวร์

- การพัฒนาซอฟต์แวร์

- โซลูชัน

- ความตึงเครียด

- startups

- การเข้าพัก

- ซื่อตรง

- กลยุทธ์

- กลยุทธ์

- อย่างเช่น

- ที่สนับสนุน

- รองรับ

- ระบบ

- ตาราง

- การ

- คุย

- ทีม

- เทคโนโลยี

- ทดสอบ

- การทดสอบ

- กว่า

- ที่

- พื้นที่

- พื้นที่

- ของพวกเขา

- ที่นั่น

- ล้อยางขัดเหล่านี้ติดตั้งบนแกน XNUMX (มม.) ผลิตภัณฑ์นี้ถูกผลิตในหลายรูปทรง และหลากหลายเบอร์ความแน่นหนาของปริมาณอนุภาคขัดของมัน จะทำให้ท่านได้รับประสิทธิภาพสูงในการขัดและการใช้งานที่ยาวนาน

- นี้

- ปริมาณงาน

- เวลา

- ไปยัง

- การจราจร

- การเดินทาง

- แนวโน้ม

- ชนิด

- ผู้ใช้

- การใช้

- ความคุ้มค่า

- ตัวแปร

- มาก

- วิสัยทัศน์

- we

- เว็บ

- บริการเว็บ

- ดี

- คือ

- เมื่อ

- ที่

- ในขณะที่

- จะ

- กับ

- งาน

- ทำงาน

- ขั้นตอนการทำงาน

- การทำงาน

- โรงงาน

- คุณ

- ของคุณ

- ลมทะเล

- โซน