อเมซอน SageMaker คือบริการที่มีการจัดการเต็มรูปแบบซึ่งช่วยให้นักพัฒนาและนักวิทยาศาสตร์ข้อมูลสามารถสร้าง ฝึกอบรม และปรับใช้โมเดลการเรียนรู้ของเครื่อง (ML) ได้อย่างรวดเร็วและง่ายดายในทุกขนาด SageMaker ช่วยให้ปรับใช้โมเดลในการผลิตโดยตรงผ่านการเรียก API ไปยังบริการได้อย่างง่ายดาย โมเดลต่างๆ ได้รับการบรรจุลงในคอนเทนเนอร์เพื่อการปรับใช้ที่มีประสิทธิภาพและปรับขนาดได้ แม้ว่าจะมีจุดเริ่มต้นที่หลากหลาย เช่น SageMaker Python SDK, AWS SDK, คอนโซล SageMaker และ สตูดิโอ Amazon SageMaker โน้ตบุ๊กเพื่อลดความซับซ้อนของกระบวนการฝึกอบรมและการปรับใช้โมเดล ML ในวงกว้าง ลูกค้ายังคงมองหาวิธีที่ดีกว่าในการปรับใช้โมเดลสำหรับการทดสอบสนามเด็กเล่น และเพื่อเพิ่มประสิทธิภาพการใช้งานจริง

เรากำลังเปิดตัวสองวิธีใหม่เพื่อลดความซับซ้อนของกระบวนการบรรจุและการปรับใช้โมเดลโดยใช้ SageMaker

ในโพสต์นี้ เราขอแนะนำ SageMaker Python SDK ใหม่ ModelBuilder ประสบการณ์ซึ่งมีจุดมุ่งหมายเพื่อลดเส้นโค้งการเรียนรู้สำหรับผู้ใช้ SageMaker ใหม่ เช่น นักวิทยาศาสตร์ข้อมูล ขณะเดียวกันก็ช่วยให้วิศวกร MLOps ที่มีประสบการณ์สามารถใช้ประโยชน์จากบริการโฮสติ้งของ SageMaker ให้เกิดประโยชน์สูงสุด ลดความซับซ้อนของการตั้งค่าเริ่มต้นและการปรับใช้ และโดยการให้คำแนะนำเกี่ยวกับแนวทางปฏิบัติที่ดีที่สุดสำหรับการใช้ประโยชน์จากความสามารถเต็มรูปแบบของ SageMaker เราให้ข้อมูลโดยละเอียดและตัวอย่าง GitHub สำหรับความสามารถ SageMaker ใหม่นี้

การเปิดตัวใหม่อีกอย่างคือการใช้ประสบการณ์การใช้งานแบบโต้ตอบใหม่ใน SageMaker Studio เราจะหารือเรื่องนี้ในส่วนที่ 2

การปรับใช้โมเดลกับตำแหน่งข้อมูล SageMaker มีขั้นตอนต่างๆ มากมายเพื่อเตรียมโมเดลให้พร้อมที่จะโฮสต์บนตำแหน่งข้อมูล SageMaker ซึ่งเกี่ยวข้องกับการรับสิ่งประดิษฐ์ของโมเดลในรูปแบบและโครงสร้างที่ถูกต้อง การสร้างโค้ดอนุมาน และการระบุรายละเอียดที่สำคัญ เช่น URL รูปภาพของโมเดล บริการจัดเก็บข้อมูลอย่างง่ายของ Amazon (Amazon S3) ตำแหน่งของอาร์ติแฟกต์โมเดล ขั้นตอนการทำให้ซีเรียลไลซ์และดีซีเรียลไลซ์ และความจำเป็น AWS Identity และการจัดการการเข้าถึง บทบาท (IAM) เพื่ออำนวยความสะดวกในการอนุญาตการเข้าถึงที่เหมาะสม หลังจากนี้ การกำหนดค่าตำแหน่งข้อมูลจำเป็นต้องกำหนดประเภทการอนุมานและกำหนดค่าพารามิเตอร์ที่เกี่ยวข้อง เช่น ประเภทอินสแตนซ์ จำนวน และการกระจายการรับส่งข้อมูลระหว่างตัวแปรโมเดล

เพื่อช่วยเหลือลูกค้าของเราเพิ่มเติมเมื่อใช้โฮสติ้ง SageMaker เราได้แนะนำรูปแบบใหม่ ModelBuilder คลาสใน SageMaker Python SDK ซึ่งให้ประโยชน์หลักต่อไปนี้เมื่อปรับใช้โมเดลกับตำแหน่งข้อมูล SageMaker:

- รวมประสบการณ์การปรับใช้ข้ามเฟรมเวิร์กเข้าด้วยกัน – ประสบการณ์ใหม่นี้มอบขั้นตอนการทำงานที่สอดคล้องกันสำหรับการปรับใช้โมเดลที่สร้างขึ้นโดยใช้เฟรมเวิร์กที่แตกต่างกัน เช่น PyTorch, TensorFlow และ XGBoost สิ่งนี้ทำให้กระบวนการปรับใช้ง่ายขึ้น

- ปรับใช้โมเดลโดยอัตโนมัติ – งานต่างๆ เช่น การเลือกคอนเทนเนอร์ที่เหมาะสม การจับภาพการขึ้นต่อกัน และการจัดการซีเรียลไลซ์/การดีซีเรียลไลซ์เป็นไปโดยอัตโนมัติ ซึ่งช่วยลดความพยายามด้วยตนเองที่จำเป็นสำหรับการปรับใช้

- ให้การเปลี่ยนแปลงที่ราบรื่นจากจุดสิ้นสุดที่โฮสต์ในเครื่องไปยัง SageMaker – ด้วยการเปลี่ยนแปลงโค้ดเพียงเล็กน้อย โมเดลจึงสามารถเปลี่ยนจากการทดสอบในเครื่องไปเป็นการใช้งานบนตำแหน่งข้อมูล SageMaker ได้อย่างง่ายดาย บันทึกสดทำให้การดีบักราบรื่น

โดยรวมแล้ว SageMaker ModelBuilder ลดความซับซ้อนและปรับปรุงกระบวนการบรรจุแบบจำลองสำหรับการอนุมานของ SageMaker โดยการจัดการรายละเอียดระดับต่ำ และจัดเตรียมเครื่องมือสำหรับการทดสอบ การตรวจสอบ และการปรับจุดสิ้นสุดให้เหมาะสม สิ่งนี้ช่วยปรับปรุงประสิทธิภาพการทำงานของนักพัฒนาและลดข้อผิดพลาด

ในส่วนต่อไปนี้ เราจะเจาะลึกรายละเอียดของฟีเจอร์ใหม่นี้ นอกจากนี้เรายังหารือถึงวิธีการปรับใช้โมเดลกับโฮสติ้ง SageMaker โดยใช้ ModelBuilderซึ่งทำให้กระบวนการง่ายขึ้น จากนั้น เราจะอธิบายตัวอย่างเล็กๆ น้อยๆ สำหรับเฟรมเวิร์กต่างๆ เพื่อปรับใช้ทั้งโมเดล ML แบบดั้งเดิมและโมเดลพื้นฐานที่ขับเคลื่อนกรณีการใช้งาน AI ที่สร้าง

ทำความรู้จักกับ SageMaker ModelBuilder

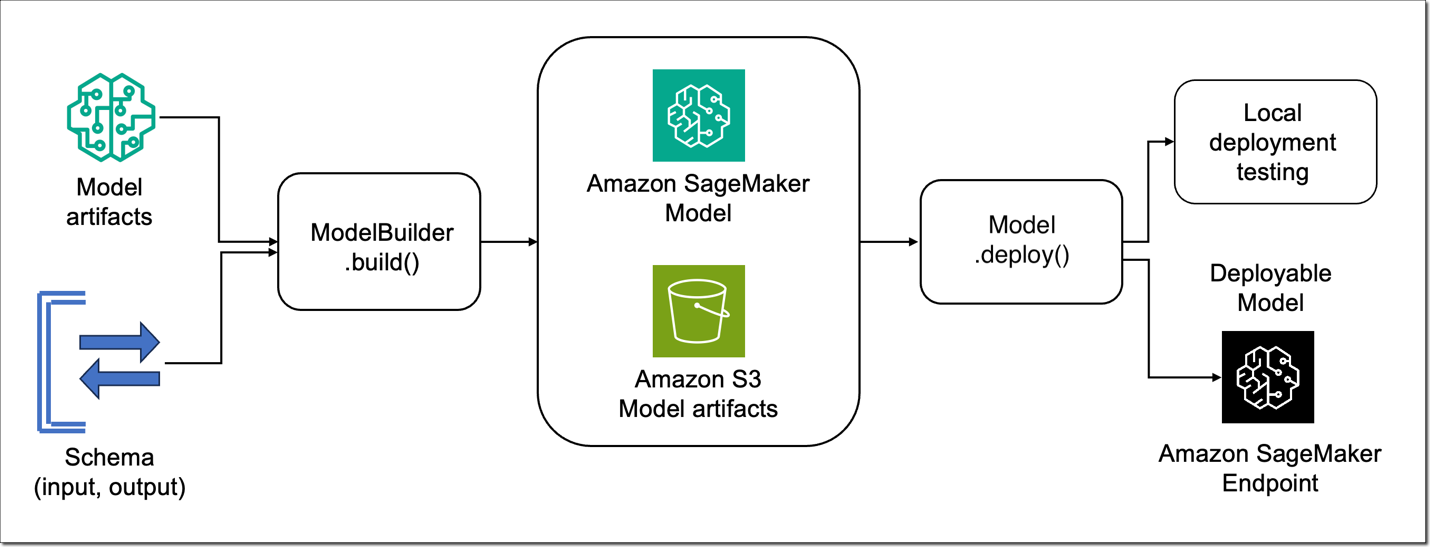

ใหม่ ModelBuilder เป็นคลาส Python ที่เน้นไปที่การนำโมเดล ML ที่สร้างขึ้นโดยใช้เฟรมเวิร์ก เช่น XGBoost หรือ PyTorch มาแปลงเป็นโมเดลที่พร้อมสำหรับการใช้งานบน SageMaker ModelBuilder ให้ build() ฟังก์ชั่นซึ่งสร้างสิ่งประดิษฐ์ตามเซิร์ฟเวอร์รุ่นและ deploy() ฟังก์ชั่นเพื่อปรับใช้ภายในเครื่องหรือไปยังจุดสิ้นสุด SageMaker การเปิดตัวฟีเจอร์นี้ทำให้การรวมโมเดลเข้ากับสภาพแวดล้อม SageMaker ง่ายขึ้น โดยปรับให้เหมาะสมเพื่อประสิทธิภาพและความสามารถในการปรับขนาด แผนภาพต่อไปนี้แสดงวิธีการ ModelBuilder ทำงานในระดับสูง

คลาส ModelBuilder

พื้นที่ ModelBuilder คลาสมีตัวเลือกต่าง ๆ สำหรับการปรับแต่ง อย่างไรก็ตาม ในการปรับใช้โมเดลเฟรมเวิร์ก ตัวสร้างโมเดลเพียงคาดหวังโมเดล อินพุต เอาท์พุต และบทบาท:

SchemaBuilder

พื้นที่ SchemaBuilder class ช่วยให้คุณสามารถกำหนดอินพุตและเอาต์พุตสำหรับปลายทางของคุณได้ ช่วยให้ตัวสร้างสคีมาสร้างฟังก์ชันการจัดลำดับที่สอดคล้องกันสำหรับซีเรียลไลซ์และดีซีเรียลไลซ์อินพุตและเอาต์พุต ไฟล์คลาสต่อไปนี้มีตัวเลือกทั้งหมดสำหรับการปรับแต่ง:

อย่างไรก็ตาม ในกรณีส่วนใหญ่ เพียงแค่อินพุตและเอาต์พุตตัวอย่างก็ใช้งานได้ ตัวอย่างเช่น:

ด้วยการจัดเตรียมอินพุตและเอาต์พุตตัวอย่าง SchemaBuilder สามารถกำหนดการเปลี่ยนแปลงที่จำเป็นได้โดยอัตโนมัติ ทำให้กระบวนการบูรณาการตรงไปตรงมามากขึ้น สำหรับกรณีการใช้งานขั้นสูง มีความยืดหยุ่นในการจัดหาฟังก์ชันการแปลแบบกำหนดเองสำหรับทั้งอินพุตและเอาต์พุต เพื่อให้มั่นใจว่าโครงสร้างข้อมูลที่ซับซ้อนยิ่งขึ้นสามารถจัดการได้อย่างมีประสิทธิภาพ เราสาธิตสิ่งนี้ในส่วนต่อไปนี้โดยการปรับใช้โมเดลที่แตกต่างกันกับเฟรมเวิร์กต่างๆ ที่ใช้ ModelBuilder.

ประสบการณ์โหมดท้องถิ่น

ในตัวอย่างนี้ เราใช้ ModelBuilder เพื่อปรับใช้โมเดล XGBoost ในเครื่อง คุณสามารถใช้โหมดเพื่อสลับระหว่างการทดสอบภายในและการปรับใช้กับตำแหน่งข้อมูล SageMaker ก่อนอื่นเราจะฝึกโมเดล XGBoost (ในเครื่องหรือใน SageMaker) และจัดเก็บสิ่งประดิษฐ์ของโมเดลไว้ในไดเร็กทอรีการทำงาน:

จากนั้นเราสร้างออบเจ็กต์ ModelBuilder โดยส่งผ่านออบเจ็กต์โมเดลจริง SchemaBuilder ที่ใช้ออบเจ็กต์อินพุตและเอาต์พุตทดสอบตัวอย่าง (อินพุตและเอาต์พุตเดียวกับที่เราใช้เมื่อฝึกอบรมและทดสอบโมเดล) เพื่อสรุปซีเรียลไลซ์ที่จำเป็น โปรดทราบว่าเราใช้ Mode.LOCAL_CONTAINER เพื่อระบุการปรับใช้ภายในเครื่อง หลังจากนั้นเราก็เรียก. สร้าง ฟังก์ชั่นเพื่อระบุอิมเมจคอนเทนเนอร์ของเฟรมเวิร์กที่รองรับโดยอัตโนมัติ รวมถึงสแกนหาการขึ้นต่อกัน ดูรหัสต่อไปนี้:

ในที่สุดเราก็สามารถเรียก deploy ในวัตถุโมเดล ซึ่งให้การบันทึกแบบสดเพื่อการดีบักที่ง่ายขึ้น คุณไม่จำเป็นต้องระบุประเภทหรือจำนวนอินสแตนซ์เนื่องจากโมเดลจะถูกปรับใช้ภายในเครื่อง หากคุณระบุพารามิเตอร์เหล่านี้ พารามิเตอร์เหล่านั้นจะถูกละเว้น ฟังก์ชันนี้จะส่งคืนออบเจ็กต์ตัวทำนายที่เราสามารถใช้เพื่อทำนายด้วยข้อมูลทดสอบ:

หรือคุณสามารถควบคุมการโหลดโมเดลและการประมวลผลล่วงหน้าและการประมวลผลภายหลังได้ InferenceSpec. เราจะให้รายละเอียดเพิ่มเติมในภายหลังในโพสต์นี้ โดยใช้ LOCAL_CONTAINER เป็นวิธีที่ยอดเยี่ยมในการทดสอบสคริปต์ของคุณภายในเครื่องก่อนที่จะปรับใช้กับตำแหน่งข้อมูล SageMaker

โปรดดูที่ model-builder-xgboost.ipynb ตัวอย่างเพื่อทดสอบการใช้งานทั้งภายในเครื่องและกับปลายทาง SageMaker โดยใช้ ModelBuilder.

ปรับใช้โมเดลแบบดั้งเดิมกับตำแหน่งข้อมูล SageMaker

ในตัวอย่างต่อไปนี้ เราจะแสดงวิธีการใช้งาน ModelBuilder เพื่อปรับใช้โมเดล ML แบบดั้งเดิม

รุ่น XGBoost

เช่นเดียวกับส่วนก่อนหน้า คุณสามารถปรับใช้โมเดล XGBoost กับตำแหน่งข้อมูล SageMaker ได้โดยการเปลี่ยน mode พารามิเตอร์เมื่อสร้าง ModelBuilder วัตถุ:

โปรดทราบว่าเมื่อปรับใช้กับตำแหน่งข้อมูล SageMaker คุณจะต้องระบุประเภทอินสแตนซ์และจำนวนอินสแตนซ์เมื่อเรียกใช้ deploy ฟังก์ชัน

โปรดดูที่ model-builder-xgboost.ipynb ตัวอย่างในการปรับใช้โมเดล XGBoost

รุ่นไทรทัน

คุณสามารถใช้ได้ ModelBuilder เพื่อให้บริการโมเดล PyTorch เซิร์ฟเวอร์การอนุมานไทรทัน. เพื่อที่คุณจะต้องระบุ model_server พารามิเตอร์เป็น ModelServer.TRITONผ่านแบบจำลองและมี SchemaBuilder วัตถุซึ่งต้องการอินพุตและเอาต์พุตตัวอย่างจากโมเดล ModelBuilder จะจัดการส่วนที่เหลือให้คุณ

เอ่ยถึง model-builder-triton.ipynb เพื่อปรับใช้โมเดลกับ Triton

โมเดลกอดใบหน้า

ในตัวอย่างนี้ เราจะแสดงวิธีปรับใช้โมเดลหม้อแปลงที่ได้รับการฝึกอบรมล่วงหน้าที่ Hugging Face มอบให้กับ SageMaker เราต้องการใช้ใบหน้ากอด pipeline เพื่อโหลดโมเดล ดังนั้นเราจึงสร้างข้อกำหนดการอนุมานแบบกำหนดเองสำหรับ ModelBuilder:

นอกจากนี้เรายังกำหนดอินพุตและเอาต์พุตของปริมาณงานการอนุมานโดยการกำหนด SchemaBuilder วัตถุขึ้นอยู่กับอินพุตและเอาต์พุตของโมเดล:

จากนั้นเราก็สร้าง ModelBuilder วัตถุและปรับใช้โมเดลบนตำแหน่งข้อมูล SageMaker ตามตรรกะเดียวกันกับที่แสดงในตัวอย่างอื่น:

เอ่ยถึง model-builder-huggingface.ipynb เพื่อปรับใช้โมเดลไปป์ไลน์ Hugging Face

ปรับใช้โมเดลพื้นฐานกับตำแหน่งข้อมูล SageMaker

ในตัวอย่างต่อไปนี้ เราจะแสดงวิธีการใช้งาน ModelBuilder เพื่อปรับใช้โมเดลพื้นฐาน เช่นเดียวกับโมเดลที่กล่าวถึงก่อนหน้านี้ สิ่งเดียวที่ต้องมีคือรหัสโมเดล

กอดใบหน้าฮับ

หากคุณต้องการปรับใช้โมเดลพื้นฐานจาก กอดใบหน้าฮับสิ่งที่คุณต้องทำคือส่งรหัสโมเดลที่ได้รับการฝึกล่วงหน้า ตัวอย่างเช่น ข้อมูลโค้ดต่อไปนี้จะปรับใช้ไฟล์ เมตา-ลามะ/ลามะ-2-7b-hf โมเดลในท้องถิ่น คุณสามารถเปลี่ยนโหมดเป็น Mode.SAGEMAKER_ENDPOINT เพื่อปรับใช้กับตำแหน่งข้อมูล SageMaker

สำหรับรุ่นที่มีรั้วรอบขอบชิดบน Hugging Face Hub คุณจะต้องขอการเข้าถึงผ่าน Hugging Face Hub และใช้คีย์ที่เกี่ยวข้องโดยส่งเป็นตัวแปรสภาพแวดล้อม HUGGING_FACE_HUB_TOKEN. Hugging Face บางรุ่นอาจต้องใช้โค้ดระยะไกลที่เชื่อถือได้ สามารถตั้งค่าเป็นตัวแปรสภาพแวดล้อมได้เช่นกัน HF_TRUST_REMOTE_CODE. โดยค่าเริ่มต้น, ModelBuilder จะใช้การอนุมานการสร้างข้อความใบหน้ากอด (TGI) คอนเทนเนอร์เป็นคอนเทนเนอร์ต้นแบบสำหรับโมเดล Hugging Face หากคุณต้องการใช้ AWS Large Model Inference (LMI) คอนเทนเนอร์คุณสามารถตั้งค่า model_server พารามิเตอร์เป็น ModelServer.DJL_SERVING เมื่อคุณกำหนดค่า ModelBuilder วัตถุ.

คุณสมบัติเรียบร้อยของ ModelBuilder คือความสามารถในการเรียกใช้การปรับพารามิเตอร์คอนเทนเนอร์ภายในเครื่องเมื่อคุณใช้งาน LOCAL_CONTAINER โหมด. คุณสมบัตินี้สามารถใช้งานได้เพียงแค่เรียกใช้ tuned_model = model.tune().

เอ่ยถึง การสาธิตโมเดลผู้สร้างกอดใบหน้า llama2.ipynb เพื่อปรับใช้โมเดล Hugging Face Hub

SageMaker JumpStart

Amazon SageMaker JumpStart ยังมีโมเดลพื้นฐานที่ได้รับการฝึกอบรมล่วงหน้าจำนวนหนึ่งอีกด้วย เช่นเดียวกับกระบวนการปรับใช้โมเดลจาก Hugging Face Hub จำเป็นต้องมี ID โมเดล การปรับใช้โมเดล SageMaker JumpStart กับตำแหน่งข้อมูล SageMaker นั้นตรงไปตรงมาเหมือนกับการรันโค้ดต่อไปนี้:

สำหรับรหัสโมเดล SageMaker JumpStart ที่มีอยู่ทั้งหมด โปรดดูที่ อัลกอริธึมในตัวพร้อมตารางโมเดลที่ผ่านการฝึกอบรมมาแล้ว. เอ่ยถึง model-builder-jumpstart-falcon.ipynb เพื่อปรับใช้โมเดล SageMaker JumpStart

องค์ประกอบการอนุมาน

ModelBulder ช่วยให้คุณใช้ความสามารถองค์ประกอบการอนุมานใหม่ใน SageMaker เพื่อปรับใช้โมเดล สำหรับข้อมูลเพิ่มเติมเกี่ยวกับองค์ประกอบการอนุมาน โปรดดู ลดต้นทุนการปรับใช้โมเดลโดยเฉลี่ย 50% โดยใช้คุณสมบัติล่าสุดของ SageMaker. คุณสามารถใช้ส่วนประกอบการอนุมานสำหรับการปรับใช้ด้วย ModelBuilder โดยระบุ endpoint_type=EndpointType.INFERENCE_COMPONENT_BASED ใน deploy() วิธี. คุณยังสามารถใช้ tune() ซึ่งดึงข้อมูลจำนวนตัวเร่งความเร็วที่เหมาะสมที่สุด และแก้ไขหากจำเป็น

เอ่ยถึง model-builder-inference-component.ipynb เพื่อปรับใช้โมเดลเป็นองค์ประกอบการอนุมาน

ปรับแต่งคลาส ModelBuilder

พื้นที่ ModelBuilder คลาสช่วยให้คุณปรับแต่งการโหลดโมเดลโดยใช้ InferenceSpec.

นอกจากนี้ คุณยังสามารถควบคุมเพย์โหลดและการตอบสนองซีเรียลไลเซชันและการดีซีเรียลไลซ์ และปรับแต่งการประมวลผลล่วงหน้าและการประมวลผลภายหลังได้โดยใช้ CustomPayloadTranslator. นอกจากนี้ เมื่อคุณต้องการขยายคอนเทนเนอร์ที่สร้างไว้ล่วงหน้าของเราสำหรับการปรับใช้โมเดลบน SageMaker คุณก็สามารถใช้ได้ ModelBuilder เพื่อจัดการกระบวนการบรรจุภัณฑ์แบบจำลอง ในส่วนต่อไปนี้ เราจะให้รายละเอียดเพิ่มเติมเกี่ยวกับความสามารถเหล่านี้

ข้อมูลจำเพาะการอนุมาน

ข้อมูลจำเพาะการอนุมาน เสนอการปรับแต่งเพิ่มเติมอีกชั้นหนึ่ง ช่วยให้คุณสามารถกำหนดวิธีการโหลดโมเดลและวิธีจัดการกับคำขออนุมานที่เข้ามา ผ่าน InferenceSpecคุณสามารถกำหนดขั้นตอนการโหลดแบบกำหนดเองสำหรับโมเดลของคุณได้ โดยข้ามกลไกการโหลดเริ่มต้น ความยืดหยุ่นนี้มีประโยชน์อย่างยิ่งเมื่อทำงานกับโมเดลที่ไม่ได้มาตรฐานหรือไปป์ไลน์การอนุมานแบบกำหนดเอง วิธีการเรียกใช้สามารถปรับแต่งได้ ทำให้คุณสามารถปรับแต่งวิธีที่โมเดลประมวลผลคำขอที่เข้ามาได้ (การประมวลผลล่วงหน้าและการประมวลผลภายหลัง) การปรับแต่งนี้อาจจำเป็นเพื่อให้แน่ใจว่ากระบวนการอนุมานสอดคล้องกับความต้องการเฉพาะของแบบจำลอง ดูรหัสต่อไปนี้:

รหัสต่อไปนี้แสดงตัวอย่างการใช้คลาสนี้:

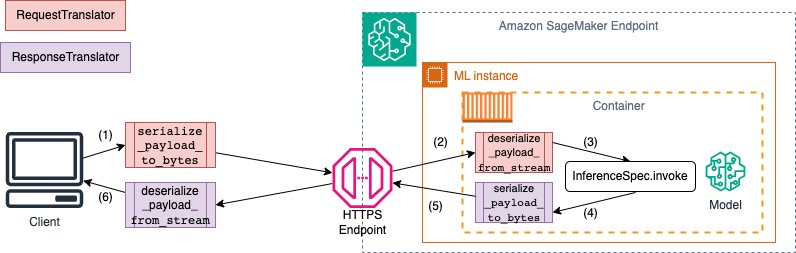

CustomPayloadTranslator

เมื่อเรียกใช้ตำแหน่งข้อมูล SageMaker ข้อมูลจะถูกส่งผ่านเพย์โหลด HTTP ที่มีประเภท MIME ที่แตกต่างกัน ตัวอย่างเช่น รูปภาพที่ส่งไปยังตำแหน่งข้อมูลเพื่อการอนุมานจะต้องแปลงเป็นไบต์ที่ฝั่งไคลเอ็นต์ และส่งผ่านเพย์โหลด HTTP ไปยังตำแหน่งข้อมูล เมื่อจุดสิ้นสุดได้รับเพย์โหลด อุปกรณ์จะต้องดีซีเรียลไลซ์สตริงไบต์กลับไปเป็นประเภทข้อมูลที่โมเดลคาดหวัง (หรือที่เรียกว่า การดีซีเรียลไลซ์ฝั่งเซิร์ฟเวอร์). หลังจากที่แบบจำลองเสร็จสิ้นการคาดการณ์ ผลลัพธ์จะต้องถูกทำให้เป็นอนุกรมเป็นไบต์ที่สามารถส่งกลับผ่านเพย์โหลด HTTP ไปยังผู้ใช้หรือไคลเอนต์ได้ เมื่อไคลเอ็นต์ได้รับข้อมูลไบต์ตอบกลับ จะต้องดำเนินการดีซีเรียลไลซ์ฝั่งไคลเอ็นต์เพื่อแปลงข้อมูลไบต์กลับไปเป็นรูปแบบข้อมูลที่คาดหวัง เช่น JSON อย่างน้อยที่สุด คุณต้องแปลงข้อมูลดังต่อไปนี้ (ตามหมายเลขในแผนภาพต่อไปนี้):

- การซีเรียลไลซ์คำขอการอนุมาน (จัดการโดยไคลเอนต์)

- การดีซีเรียลไลซ์คำขอการอนุมาน (จัดการโดยเซิร์ฟเวอร์หรืออัลกอริทึม)

- การเรียกใช้โมเดลกับเพย์โหลด

- กำลังส่งเพย์โหลดการตอบกลับกลับ

- การทำให้เป็นอนุกรมการตอบสนองการอนุมาน (จัดการโดยเซิร์ฟเวอร์หรืออัลกอริทึม)

- การดีซีเรียลไลซ์การตอบสนองการอนุมาน (จัดการโดยไคลเอนต์)

แผนภาพต่อไปนี้แสดงกระบวนการซีเรียลไลซ์และดีซีเรียลไลซ์ระหว่างกระบวนการเรียกใช้

ในตัวอย่างโค้ดต่อไปนี้ เราจะแสดงตัวอย่าง CustomPayloadTranslator เมื่อจำเป็นต้องมีการปรับแต่งเพิ่มเติมเพื่อจัดการทั้งการทำให้เป็นอนุกรมและการดีซีเรียลไลซ์ในฝั่งไคลเอ็นต์และเซิร์ฟเวอร์ ตามลำดับ:

ตัว Vortex Indicator ได้ถูกนำเสนอลงในนิตยสาร การสาธิตโมเดลผู้สร้าง-pytorch.ipynb ในโน้ตบุ๊ก เราจะสาธิตวิธีการปรับใช้โมเดล PyTorch กับตำแหน่งข้อมูล SageMaker ได้อย่างง่ายดาย ModelBuilder กับ CustomPayloadTranslator และ InferenceSpec ชั้นเรียน

แบบจำลองขั้นสำหรับการปรับใช้

หากคุณต้องการจัดฉากโมเดลสำหรับการอนุมานหรือในการลงทะเบียนโมเดล คุณสามารถใช้ได้ model.create() or model.register(). โมเดลที่เปิดใช้งานจะถูกสร้างขึ้นบนบริการ จากนั้นคุณสามารถปรับใช้ในภายหลังได้ ดูรหัสต่อไปนี้:

ใช้คอนเทนเนอร์แบบกำหนดเอง

SageMaker จัดให้ อิมเมจ Docker ที่สร้างไว้ล่วงหน้า สำหรับอัลกอริธึมในตัวและเฟรมเวิร์กการเรียนรู้เชิงลึกที่รองรับ ซึ่งใช้สำหรับการฝึกอบรมและการอนุมาน หากคอนเทนเนอร์ SageMaker ที่สร้างไว้ล่วงหน้าไม่ตอบสนองความต้องการของคุณทั้งหมด คุณสามารถขยายรูปภาพที่มีอยู่เพื่อรองรับความต้องการของคุณได้ ด้วยการขยายอิมเมจที่สร้างไว้ล่วงหน้า คุณจะสามารถใช้ไลบรารีและการตั้งค่าการเรียนรู้เชิงลึกที่มีมาให้ได้โดยไม่ต้องสร้างอิมเมจตั้งแต่ต้น สำหรับรายละเอียดเพิ่มเติมเกี่ยวกับวิธีการขยายคอนเทนเนอร์ที่สร้างไว้ล่วงหน้า โปรดดูเอกสาร SageMaker ModelBuilder รองรับกรณีการใช้งานเมื่อนำคอนเทนเนอร์ของคุณเองที่ขยายจากคอนเทนเนอร์ Docker ที่สร้างไว้ล่วงหน้าของเรา

หากต้องการใช้อิมเมจคอนเทนเนอร์ของคุณเองในกรณีนี้ คุณต้องตั้งค่าฟิลด์ image_uri และ model_server เมื่อกำหนด ModelBuilder:

ที่นี่ image_uri จะเป็นคอนเทนเนอร์อิมเมจ ARN ที่จัดเก็บไว้ในบัญชีของคุณ การลงทะเบียน Amazon Elastic Container พื้นที่เก็บข้อมูล (Amazon ECR) ตัวอย่างหนึ่งแสดงดังต่อไปนี้:

เมื่อราคาของ image_uri ถูกตั้งค่าไว้ในระหว่าง ModelBuilder กระบวนการสร้าง มันจะข้ามการตรวจจับรูปภาพอัตโนมัติเมื่อมีการระบุ URI ของรูปภาพ ถ้า model_server ไม่ได้ตั้งค่าใน ModelBuilder คุณจะได้รับข้อความแสดงข้อผิดพลาดในการตรวจสอบความถูกต้อง เช่น:

จากการเผยแพร่โพสต์นี้ ModelBuilder รองรับการนำภาชนะของคุณเองที่ขยายมาจากเรา อิมเมจคอนเทนเนอร์ DLC ที่สร้างไว้ล่วงหน้า หรือคอนเทนเนอร์ที่สร้างด้วยโมเดลเซิร์ฟเวอร์เช่น ห้องสมุด Java ลึก (DJL), การอนุมานการสร้างข้อความ (TGI), คบเพลิงให้บริการและ เซิร์ฟเวอร์การอนุมาน Triton.

การพึ่งพาแบบกำหนดเอง

เมื่อวิ่ง ModelBuilder.build()โดยค่าเริ่มต้น มันจะจับสภาพแวดล้อม Python ของคุณโดยอัตโนมัติเป็น requirements.txt ไฟล์และติดตั้งการพึ่งพาเดียวกันในคอนเทนเนอร์ อย่างไรก็ตาม บางครั้งสภาพแวดล้อม Python ในเครื่องของคุณจะขัดแย้งกับสภาพแวดล้อมในคอนเทนเนอร์ ModelBuilder มอบวิธีง่ายๆ สำหรับคุณในการแก้ไขการขึ้นต่อกันที่บันทึกไว้เพื่อแก้ไขข้อขัดแย้งในการขึ้นต่อกันดังกล่าวโดยอนุญาตให้คุณระบุการกำหนดค่าที่กำหนดเองลงใน ModelBuilder. โปรดทราบว่านี่เป็นเพียงสำหรับ TorchServe และ Triton ด้วย InferenceSpec. ตัวอย่างเช่น คุณสามารถระบุการขึ้นต่อกันของพารามิเตอร์อินพุต ซึ่งเป็นพจนานุกรม Python ใน ModelBuilder ได้ดังนี้:

เรากำหนดฟิลด์ต่อไปนี้:

- รถยนต์ – จะพยายามบันทึกการขึ้นต่อกันในสภาพแวดล้อมของคุณหรือไม่

- ความต้องการ – สตริงของเส้นทางของคุณเอง

requirements.txtไฟล์. (นี่เป็นทางเลือก) - ประเพณี – รายการการอ้างอิงแบบกำหนดเองอื่นๆ ที่คุณต้องการเพิ่มหรือแก้ไข (นี่เป็นทางเลือก)

หากมีการระบุโมดูลเดียวกันไว้ในหลายแห่ง custom จะมีลำดับความสำคัญสูงสุดแล้ว requirementsและ auto จะมีลำดับความสำคัญต่ำสุด ตัวอย่างเช่น สมมติว่าระหว่างการตรวจจับอัตโนมัติ ModelBuilder ตรวจพบ numpy==1.25และใน requirements.txt มีไฟล์ที่ระบุ numpy>=1.24,<1.26. นอกจากนี้ยังมีการขึ้นต่อกันแบบกำหนดเอง: custom = ["numpy==1.26.1"]. ในกรณีนี้, numpy==1.26.1 จะถูกเลือกเมื่อเราติดตั้งการขึ้นต่อกันในคอนเทนเนอร์

ทำความสะอาด

เมื่อคุณทดสอบโมเดลเสร็จแล้ว ตามแนวทางปฏิบัติที่ดีที่สุด ให้ลบปลายทางเพื่อประหยัดค่าใช้จ่าย หากไม่จำเป็นต้องใช้ปลายทางอีกต่อไป สามารถติดตามได้ที่ ทำความสะอาด ในแต่ละสมุดบันทึกสาธิต หรือใช้โค้ดต่อไปนี้เพื่อลบโมเดลและจุดสิ้นสุดที่สร้างโดยการสาธิต:

สรุป

ความสามารถของ SageMaker ModelBuilder ใหม่ช่วยลดความยุ่งยากในการปรับใช้โมเดล ML ในการผลิตบน SageMaker ด้วยการจัดการรายละเอียดที่ซับซ้อนมากมายเบื้องหลัง ModelBuilder จึงลดช่วงการเรียนรู้สำหรับผู้ใช้ใหม่ และเพิ่มการใช้งานสูงสุดสำหรับผู้ใช้ที่มีประสบการณ์ ด้วยโค้ดเพียงไม่กี่บรรทัด คุณสามารถปรับใช้โมเดลที่มีเฟรมเวิร์กในตัว เช่น XGBoost, PyTorch, Triton และ Hugging Face รวมถึงโมเดลที่ SageMaker JumpStart มอบให้ในจุดสิ้นสุดที่แข็งแกร่งและปรับขนาดได้บน SageMaker

เราขอแนะนำให้ผู้ใช้ SageMaker ทุกคนทดลองใช้ความสามารถใหม่นี้โดยอ้างอิงถึง ModelBuilder หน้าเอกสาร ModelBuilder พร้อมใช้งานแล้วสำหรับผู้ใช้ SageMaker ทุกคนโดยไม่มีค่าใช้จ่ายเพิ่มเติม ใช้ประโยชน์จากขั้นตอนการทำงานที่เรียบง่ายนี้เพื่อทำให้โมเดลของคุณใช้งานได้เร็วขึ้น เราหวังว่าจะได้ยินวิธีที่ ModelBuilder เร่งวงจรการพัฒนาโมเดลของคุณ!

ขอขอบคุณเป็นพิเศษสำหรับ Sirisha Upadhyayala, Raymond Liu, Gary Wang, Dhawal Patel, Deepak Garg และ Ram Vegiraju

เกี่ยวกับผู้แต่ง

เมลานี ลีปริญญาเอก เป็นผู้เชี่ยวชาญด้าน AI/ML อาวุโส TAM ที่ AWS ในซิดนีย์ ออสเตรเลีย เธอช่วยลูกค้าองค์กรสร้างโซลูชันโดยใช้เครื่องมือ AI/ML ที่ล้ำสมัยบน AWS และให้คำแนะนำเกี่ยวกับการออกแบบสถาปัตยกรรมและการนำโซลูชัน ML ไปใช้งานด้วยแนวทางปฏิบัติที่ดีที่สุด ในเวลาว่างเธอชอบที่จะสำรวจธรรมชาติและใช้เวลากับครอบครัวและเพื่อนฝูง

เมลานี ลีปริญญาเอก เป็นผู้เชี่ยวชาญด้าน AI/ML อาวุโส TAM ที่ AWS ในซิดนีย์ ออสเตรเลีย เธอช่วยลูกค้าองค์กรสร้างโซลูชันโดยใช้เครื่องมือ AI/ML ที่ล้ำสมัยบน AWS และให้คำแนะนำเกี่ยวกับการออกแบบสถาปัตยกรรมและการนำโซลูชัน ML ไปใช้งานด้วยแนวทางปฏิบัติที่ดีที่สุด ในเวลาว่างเธอชอบที่จะสำรวจธรรมชาติและใช้เวลากับครอบครัวและเพื่อนฝูง

มาร์ค คาร์ป เป็น ML Architect กับทีม Amazon SageMaker Service เขามุ่งเน้นไปที่การช่วยลูกค้าออกแบบ ปรับใช้ และจัดการปริมาณงาน ML ตามขนาด ในเวลาว่างเขาชอบท่องเที่ยวและสำรวจสถานที่ใหม่ๆ

มาร์ค คาร์ป เป็น ML Architect กับทีม Amazon SageMaker Service เขามุ่งเน้นไปที่การช่วยลูกค้าออกแบบ ปรับใช้ และจัดการปริมาณงาน ML ตามขนาด ในเวลาว่างเขาชอบท่องเที่ยวและสำรวจสถานที่ใหม่ๆ

แซมเอ็ดเวิร์ดเป็นวิศวกรระบบคลาวด์ (AI/ML) ที่ AWS Sydney ซึ่งเชี่ยวชาญด้าน Machine Learning และ Amazon SageMaker เขามีความกระตือรือร้นในการช่วยลูกค้าแก้ไขปัญหาที่เกี่ยวข้องกับเวิร์กโฟลว์แมชชีนเลิร์นนิงและสร้างสรรค์โซลูชันใหม่ๆ ให้กับลูกค้า นอกเหนือจากการทำงาน เขาชอบเล่นกีฬาแร็กเก็ตและท่องเที่ยว

แซมเอ็ดเวิร์ดเป็นวิศวกรระบบคลาวด์ (AI/ML) ที่ AWS Sydney ซึ่งเชี่ยวชาญด้าน Machine Learning และ Amazon SageMaker เขามีความกระตือรือร้นในการช่วยลูกค้าแก้ไขปัญหาที่เกี่ยวข้องกับเวิร์กโฟลว์แมชชีนเลิร์นนิงและสร้างสรรค์โซลูชันใหม่ๆ ให้กับลูกค้า นอกเหนือจากการทำงาน เขาชอบเล่นกีฬาแร็กเก็ตและท่องเที่ยว

ราหู ราเมชา เป็นสถาปนิกอาวุโสด้านโซลูชัน ML พร้อมทีมบริการ Amazon SageMaker เขามุ่งเน้นที่การช่วยเหลือลูกค้าในการสร้าง ปรับใช้ และโยกย้ายปริมาณงานการผลิต ML ไปยัง SageMaker ในวงกว้าง เขาเชี่ยวชาญด้านการเรียนรู้ของเครื่อง, AI และคอมพิวเตอร์วิทัศน์ และสำเร็จการศึกษาระดับปริญญาโทสาขาวิทยาการคอมพิวเตอร์จาก UT Dallas ในเวลาว่าง เขาชอบท่องเที่ยวและถ่ายรูป

ราหู ราเมชา เป็นสถาปนิกอาวุโสด้านโซลูชัน ML พร้อมทีมบริการ Amazon SageMaker เขามุ่งเน้นที่การช่วยเหลือลูกค้าในการสร้าง ปรับใช้ และโยกย้ายปริมาณงานการผลิต ML ไปยัง SageMaker ในวงกว้าง เขาเชี่ยวชาญด้านการเรียนรู้ของเครื่อง, AI และคอมพิวเตอร์วิทัศน์ และสำเร็จการศึกษาระดับปริญญาโทสาขาวิทยาการคอมพิวเตอร์จาก UT Dallas ในเวลาว่าง เขาชอบท่องเที่ยวและถ่ายรูป

พระศิวะราชาโกฏินี ทำงานเป็นผู้จัดการผลิตภัณฑ์หลักในกลุ่มผลิตภัณฑ์การอนุมานของ Amazon SageMaker เขามุ่งเน้นไปที่การปรับใช้โมเดล การปรับแต่งประสิทธิภาพ และการเพิ่มประสิทธิภาพใน SageMaker เพื่อการอนุมาน

พระศิวะราชาโกฏินี ทำงานเป็นผู้จัดการผลิตภัณฑ์หลักในกลุ่มผลิตภัณฑ์การอนุมานของ Amazon SageMaker เขามุ่งเน้นไปที่การปรับใช้โมเดล การปรับแต่งประสิทธิภาพ และการเพิ่มประสิทธิภาพใน SageMaker เพื่อการอนุมาน

โมฮัน คานธี เป็นวิศวกรซอฟต์แวร์อาวุโสที่ AWS เขาทำงานกับ AWS ในช่วง 10 ปีที่ผ่านมา และเคยทำงานในบริการต่างๆ ของ AWS เช่น EMR, EFA และ RDS ปัจจุบัน เขามุ่งเน้นไปที่การปรับปรุงประสบการณ์การอนุมานของ SageMaker ในเวลาว่าง เขาชอบเดินป่าและวิ่งมาราธอน

โมฮัน คานธี เป็นวิศวกรซอฟต์แวร์อาวุโสที่ AWS เขาทำงานกับ AWS ในช่วง 10 ปีที่ผ่านมา และเคยทำงานในบริการต่างๆ ของ AWS เช่น EMR, EFA และ RDS ปัจจุบัน เขามุ่งเน้นไปที่การปรับปรุงประสบการณ์การอนุมานของ SageMaker ในเวลาว่าง เขาชอบเดินป่าและวิ่งมาราธอน

- เนื้อหาที่ขับเคลื่อนด้วย SEO และการเผยแพร่ประชาสัมพันธ์ รับการขยายวันนี้

- PlatoData.Network Vertical Generative Ai เพิ่มพลังให้กับตัวเอง เข้าถึงได้ที่นี่.

- เพลโตไอสตรีม. Web3 อัจฉริยะ ขยายความรู้ เข้าถึงได้ที่นี่.

- เพลโตESG. คาร์บอน, คลีนเทค, พลังงาน, สิ่งแวดล้อม แสงอาทิตย์, การจัดการของเสีย. เข้าถึงได้ที่นี่.

- เพลโตสุขภาพ เทคโนโลยีชีวภาพและข่าวกรองการทดลองทางคลินิก เข้าถึงได้ที่นี่.

- ที่มา: https://aws.amazon.com/blogs/machine-learning/package-and-deploy-classical-ml-and-llms-easily-with-amazon-sagemaker-part-1-pysdk-improvements/

- :มี

- :เป็น

- :ไม่

- :ที่ไหน

- $ ขึ้น

- 1

- 10

- 100

- 11

- 114

- 12

- 125

- 13

- 14

- 15%

- 16

- 17

- 20

- 24

- 26%

- 7

- 8

- 9

- a

- เอบีซี

- ความสามารถ

- เกี่ยวกับเรา

- เร่ง

- เร่ง

- เข้า

- อำนวยความสะดวก

- ตาม

- ข้าม

- ที่เกิดขึ้นจริง

- เพิ่ม

- นอกจากนี้

- เพิ่มเติม

- นอกจากนี้

- สูง

- ความได้เปรียบ

- หลังจาก

- กับ

- AI

- กรณีการใช้งาน ai

- AI / ML

- จุดมุ่งหมาย

- ขั้นตอนวิธี

- อัลกอริทึม

- จัดแนว

- ทั้งหมด

- การอนุญาต

- ช่วยให้

- ด้วย

- แม้ว่า

- อเมซอน

- อเมซอน SageMaker

- Amazon Web Services

- ในหมู่

- an

- และ

- ใด

- API

- เหมาะสม

- เป็น

- AS

- ที่เกี่ยวข้อง

- At

- ออสเตรเลีย

- รถยนต์

- อัตโนมัติ

- อัตโนมัติ

- ใช้ได้

- เฉลี่ย

- AWS

- กลับ

- ตาม

- BE

- เพราะ

- รับ

- ก่อน

- หลัง

- เบื้องหลัง

- เป็นประโยชน์

- ประโยชน์ที่ได้รับ

- ที่ดีที่สุด

- ปฏิบัติที่ดีที่สุด

- ดีกว่า

- ระหว่าง

- ทั้งสอง

- การนำ

- นำ

- สร้าง

- สร้าง

- สร้าง

- built-in

- by

- โทรศัพท์

- โทร

- โทร

- CAN

- ความสามารถในการ

- ความสามารถ

- จับ

- ถูกจับกุม

- จับ

- จับ

- ซึ่ง

- กรณี

- กรณี

- เปลี่ยนแปลง

- การเปลี่ยนแปลง

- เปลี่ยนแปลง

- รับผิดชอบ

- ทางเลือก

- ชั้น

- ไคลเอนต์

- เมฆ

- รหัส

- ความเห็น

- ซับซ้อน

- ความซับซ้อน

- ส่วนประกอบ

- ส่วนประกอบ

- คอมพิวเตอร์

- วิทยาการคอมพิวเตอร์

- วิสัยทัศน์คอมพิวเตอร์

- องค์ประกอบ

- การกำหนดค่า

- ขัดกัน

- ความขัดแย้ง

- คงเส้นคงวา

- ปลอบใจ

- ภาชนะ

- ภาชนะบรรจุ

- ควบคุม

- แปลง

- แปลง

- การแปลง

- แก้ไข

- ตรงกัน

- ค่าใช้จ่าย

- สร้าง

- ที่สร้างขึ้น

- การสร้าง

- ขณะนี้

- เส้นโค้ง

- ประเพณี

- ลูกค้า

- การปรับแต่ง

- ปรับแต่ง

- การปรับแต่ง

- ดัลลัส

- ข้อมูล

- ลึก

- ดำน้ำลึก

- การเรียนรู้ลึก ๆ

- Deepak

- ค่าเริ่มต้น

- กำหนด

- กำหนด

- การกำหนด

- องศา

- สาธิต

- สาธิต

- การอ้างอิง

- การอยู่ที่

- ปรับใช้

- นำไปใช้

- ปรับใช้

- การใช้งาน

- การใช้งาน

- Deploys

- ออกแบบ

- รายละเอียด

- รายละเอียด

- การตรวจพบ

- กำหนด

- การกำหนด

- ผู้พัฒนา

- นักพัฒนา

- พัฒนาการ

- ต่าง

- โดยตรง

- สนทนา

- การกระจาย

- การดำน้ำ

- do

- นักเทียบท่า

- เอกสาร

- เอกสาร

- ไม่

- โดเมน

- ทำ

- Dont

- ในระหว่าง

- แต่ละ

- ก่อน

- ง่ายดาย

- อย่างง่ายดาย

- อย่างมีประสิทธิภาพ

- ความพยายาม

- ง่าย

- เปิดการใช้งาน

- ช่วยให้

- ส่งเสริม

- ปลายทาง

- วิศวกร

- วิศวกร

- ทำให้มั่นใจ

- การสร้างความมั่นใจ

- Enterprise

- การเข้า

- สิ่งแวดล้อม

- ความผิดพลาด

- ข้อผิดพลาด

- จำเป็น

- ตัวอย่าง

- ตัวอย่าง

- ที่มีอยู่

- ที่คาดหวัง

- คาดว่า

- ประสบการณ์

- มีประสบการณ์

- สำรวจ

- สำรวจ

- ขยายออก

- การขยาย

- ใบหน้า

- อำนวยความสะดวก

- ครอบครัว

- เร็วขึ้น

- ลักษณะ

- สองสาม

- สาขา

- เนื้อไม่มีมัน

- ชื่อจริง

- แก้ไขปัญหา

- ความยืดหยุ่น

- มุ่งเน้น

- มุ่งเน้นไปที่

- ปฏิบัติตาม

- ดังต่อไปนี้

- ดังต่อไปนี้

- สำหรับ

- รูป

- ข้างหน้า

- รากฐาน

- กรอบ

- กรอบ

- ฟรี

- เพื่อน

- ราคาเริ่มต้นที่

- เติมเต็ม

- เต็ม

- อย่างเต็มที่

- ฟังก์ชัน

- ฟังก์ชั่น

- ต่อไป

- การ์ก

- แกรี่

- แกรี่วัง

- รั้วรอบขอบชิด

- สร้าง

- สร้าง

- รุ่น

- กำเนิด

- กำเนิด AI

- ได้รับ

- ได้รับ

- GitHub

- ไป

- ยิ่งใหญ่

- คำแนะนำ

- จัดการ

- การจัดการ

- ที่เกิดขึ้น

- มี

- มี

- he

- การได้ยิน

- ช่วย

- การช่วยเหลือ

- จะช่วยให้

- เธอ

- ระดับสูง

- ที่สูงที่สุด

- ของเขา

- ถือ

- เป็นเจ้าภาพ

- โฮสติ้ง

- บริการโฮสติ้ง

- สรุป ความน่าเชื่อถือของ Olymp Trade?

- ทำอย่างไร

- อย่างไรก็ตาม

- HTML

- ที่ http

- HTTPS

- Hub

- ID

- แยกแยะ

- เอกลักษณ์

- รหัส

- if

- ภาพ

- การดำเนินการ

- นำเข้า

- การปรับปรุง

- ช่วยเพิ่ม

- การปรับปรุง

- in

- รวม

- ขาเข้า

- ข้อมูล

- แรกเริ่ม

- อินพุต

- ปัจจัยการผลิต

- ติดตั้ง

- ตัวอย่าง

- บูรณาการ

- การโต้ตอบ

- เข้าไป

- แนะนำ

- แนะนำ

- บทนำ

- เรียก

- ปัญหา

- IT

- ITS

- ชวา

- jpg

- JSON

- เพียงแค่

- คีย์

- ทราบ

- ที่รู้จักกัน

- ใหญ่

- ชื่อสกุล

- ต่อมา

- ล่าสุด

- เปิดตัว

- การเปิดตัว

- ชั้น

- การเรียนรู้

- ห้องสมุด

- ห้องสมุด

- กดไลก์

- เส้น

- รายการ

- สด

- ดูรายละเอียด

- โหลด

- โหลด

- ในประเทศ

- ในท้องถิ่น

- ที่ตั้ง

- การเข้าสู่ระบบ

- ตรรกะ

- อีกต่อไป

- ดู

- ที่ต้องการหา

- รัก

- ต่ำที่สุด

- เครื่อง

- เรียนรู้เครื่อง

- ทำ

- ทำให้

- การทำ

- จัดการ

- การจัดการ

- ผู้จัดการ

- คู่มือ

- หลาย

- ปริญญาโท

- เพิ่ม

- เพิ่ม

- อาจ..

- กลไก

- หน่วยความจำ

- กล่าวถึง

- ข่าวสาร

- วิธี

- อพยพ

- ต่ำสุด

- ขั้นต่ำ

- ML

- ม.ป.ป

- โหมด

- แบบ

- โมเดล

- แก้ไข

- โมดูล

- ข้อมูลเพิ่มเติม

- มากที่สุด

- หลาย

- ต้อง

- ธรรมชาติ

- จำเป็น

- จำเป็นต้อง

- จำเป็น

- ความต้องการ

- ใหม่

- ผู้ใช้ใหม่

- ไม่

- ไม่มี

- หมายเหตุ

- สมุดบันทึก

- ตอนนี้

- จำนวน

- หมายเลข

- วัตถุ

- วัตถุ

- of

- เสนอ

- on

- ONE

- เพียง

- ไปยัง

- ดีที่สุด

- การเพิ่มประสิทธิภาพ

- เพิ่มประสิทธิภาพ

- การเพิ่มประสิทธิภาพ

- Options

- or

- อื่นๆ

- ของเรา

- ออก

- เอาท์พุต

- เอาท์พุท

- ด้านนอก

- ของตนเอง

- แพ็คเกจ

- แพคเกจ

- บรรจุภัณฑ์

- หน้า

- พารามิเตอร์

- พารามิเตอร์

- ส่วนหนึ่ง

- โดยเฉพาะ

- ส่ง

- ที่ผ่านไป

- หลงใหล

- เส้นทาง

- ดำเนินการ

- การปฏิบัติ

- สิทธิ์

- ส่วนบุคคล

- phd

- การถ่ายภาพ

- เลือก

- ท่อ

- สถานที่

- เพลโต

- เพลโตดาต้าอินเทลลิเจนซ์

- เพลโตดาต้า

- สนามเด็กเล่น

- เล่น

- จุด

- ผลงาน

- โพสต์

- อำนาจ

- การปฏิบัติ

- การปฏิบัติ

- คาดการณ์

- คำทำนาย

- Predictor

- ก่อน

- หลัก

- ลำดับความสำคัญ

- ขั้นตอน

- กระบวนการ

- กระบวนการ

- ผลิตภัณฑ์

- ผู้จัดการผลิตภัณฑ์

- การผลิต

- ผลผลิต

- ให้

- ให้

- ให้

- การให้

- สิ่งพิมพ์

- ผลักดัน

- หลาม

- ไฟฉาย

- อย่างรวดเร็ว

- แรม

- พร้อม

- รับ

- ที่ได้รับ

- ลด

- ลด

- อ้างอิง

- รีจิสทรี

- ที่เกี่ยวข้อง

- รีโมท

- กรุ

- ขอ

- การร้องขอ

- ต้องการ

- จำเป็นต้องใช้

- ความต้องการ

- ต้อง

- ว่า

- ตามลำดับ

- คำตอบ

- REST

- ผลสอบ

- กลับ

- แข็งแรง

- บทบาท

- บทบาท

- วิ่ง

- วิ่ง

- sagemaker

- การอนุมาน SageMaker

- เดียวกัน

- ลด

- ที่บันทึกไว้

- กล่าว

- scalability

- ที่ปรับขนาดได้

- ขนาด

- การสแกน

- ฉาก

- วิทยาศาสตร์

- นักวิทยาศาสตร์

- รอยขีดข่วน

- ต้นฉบับ

- SDK

- sdks

- ไร้รอยต่อ

- Section

- ส่วน

- เห็น

- เลือก

- การเลือก

- ตนเอง

- ระดับอาวุโส

- ส่ง

- ชุด

- ให้บริการ

- เซิร์ฟเวอร์

- เซิร์ฟเวอร์

- บริการ

- บริการ

- ชุด

- การตั้งค่า

- การติดตั้ง

- เธอ

- โชว์

- แสดง

- แสดง

- แสดงให้เห็นว่า

- ด้าน

- ง่าย

- ที่เรียบง่าย

- ช่วยลดความยุ่งยาก

- ลดความซับซ้อน

- ง่ายดาย

- เรียบ

- เศษเล็กเศษน้อย

- So

- ซอฟต์แวร์

- วิศวกรซอฟต์แวร์

- โซลูชัน

- แก้

- บาง

- บางครั้ง

- ผู้เชี่ยวชาญ

- เฉพาะ

- ความเชี่ยวชาญ

- โดยเฉพาะ

- ที่ระบุไว้

- ใช้จ่าย

- กีฬา

- ระยะ

- รัฐของศิลปะ

- ขั้นตอน

- ยังคง

- การเก็บรักษา

- จัดเก็บ

- เก็บไว้

- ซื่อตรง

- กระแส

- ช่วยเพิ่มความคล่องตัว

- เชือก

- โครงสร้าง

- โครงสร้าง

- สตูดิโอ

- อย่างเช่น

- ที่สนับสนุน

- รองรับ

- สวิตซ์

- ซิดนีย์

- ช่างตัดเสื้อ

- เอา

- การ

- งาน

- ทีม

- tensorflow

- ทดสอบ

- การทดสอบ

- ข้อความ

- ขอบคุณ

- ที่

- พื้นที่

- ของพวกเขา

- พวกเขา

- แล้วก็

- ที่นั่น

- ล้อยางขัดเหล่านี้ติดตั้งบนแกน XNUMX (มม.) ผลิตภัณฑ์นี้ถูกผลิตในหลายรูปทรง และหลากหลายเบอร์ความแน่นหนาของปริมาณอนุภาคขัดของมัน จะทำให้ท่านได้รับประสิทธิภาพสูงในการขัดและการใช้งานที่ยาวนาน

- พวกเขา

- นี้

- ตลอด

- เวลา

- ไปยัง

- โทเค็น

- เครื่องมือ

- แบบดั้งเดิม

- การจราจร

- รถไฟ

- การฝึกอบรม

- การแปลง

- หม้อแปลงไฟฟ้า

- การเปลี่ยนแปลง

- เปลี่ยน

- การแปลภาษา

- การเดินทาง

- ไทรทัน

- จริง

- ไว้วางใจ

- ลอง

- จูน

- สอง

- ชนิด

- ชนิด

- พื้นฐาน

- URL

- ใช้

- มือสอง

- ผู้ใช้งาน

- ผู้ใช้

- ใช้

- การใช้

- การตรวจสอบ

- ความคุ้มค่า

- ตัวแปร

- ต่างๆ

- ผ่านทาง

- วิสัยทัศน์

- เดิน

- ต้องการ

- ทาง..

- วิธี

- we

- เว็บ

- บริการเว็บ

- ดี

- เมื่อ

- ว่า

- ที่

- ในขณะที่

- จะ

- กับ

- ไม่มี

- งาน

- ทำงาน

- เวิร์กโฟลว์

- ขั้นตอนการทำงาน

- การทำงาน

- โรงงาน

- จะ

- XGBoost

- ปี

- คุณ

- ของคุณ

- ลมทะเล