ทีมวิทยาศาสตร์ข้อมูลและวิศวกรรมข้อมูลใช้เวลาส่วนใหญ่ของพวกเขาในขั้นตอนการเตรียมข้อมูลของวงจรชีวิตการเรียนรู้ของเครื่อง (ML) ที่ดำเนินการเลือกข้อมูล ทำความสะอาด และขั้นตอนการแปลงข้อมูล เป็นขั้นตอนที่สำคัญและจำเป็นของเวิร์กโฟลว์ ML ใดๆ เพื่อสร้างข้อมูลเชิงลึกและการคาดการณ์ที่มีความหมาย เนื่องจากข้อมูลที่ไม่ดีหรือคุณภาพต่ำจะลดความเกี่ยวข้องของข้อมูลเชิงลึกที่ได้รับอย่างมาก

ตามธรรมเนียมแล้ว ทีมวิศวกรรมข้อมูลมีหน้าที่รับผิดชอบในการนำเข้า การรวมบัญชี และการแปลงข้อมูลดิบสำหรับการบริโภคปลายน้ำ นักวิทยาศาสตร์ข้อมูลมักจะต้องดำเนินการเพิ่มเติมกับข้อมูลสำหรับกรณีการใช้งาน ML เฉพาะโดเมน เช่น ภาษาธรรมชาติและอนุกรมเวลา ตัวอย่างเช่น อัลกอริธึม ML บางอย่างอาจอ่อนไหวต่อค่าที่หายไป คุณลักษณะกระจัดกระจาย หรือค่าผิดปกติ และจำเป็นต้องได้รับการพิจารณาเป็นพิเศษ แม้ในกรณีที่ชุดข้อมูลอยู่ในสภาพดี นักวิทยาศาสตร์ด้านข้อมูลอาจต้องการเปลี่ยนรูปแบบการกระจายคุณลักษณะหรือสร้างคุณลักษณะใหม่เพื่อเพิ่มข้อมูลเชิงลึกที่ได้รับจากแบบจำลองให้มากที่สุด เพื่อให้บรรลุวัตถุประสงค์เหล่านี้ นักวิทยาศาสตร์ข้อมูลต้องพึ่งพาทีมวิศวกรรมข้อมูลเพื่อรองรับการเปลี่ยนแปลงที่ร้องขอ ส่งผลให้เกิดการพึ่งพาและความล่าช้าในกระบวนการพัฒนาแบบจำลอง อีกทางหนึ่ง ทีมวิทยาการข้อมูลอาจเลือกดำเนินการเตรียมข้อมูลและวิศวกรรมคุณลักษณะภายในโดยใช้กระบวนทัศน์การเขียนโปรแกรมต่างๆ อย่างไรก็ตาม มันต้องใช้เวลาและความพยายามอย่างมากในการติดตั้งและกำหนดค่าไลบรารีและเฟรมเวิร์ก ซึ่งไม่เหมาะเพราะเวลานั้นสามารถใช้เวลาปรับปรุงประสิทธิภาพของโมเดลให้เหมาะสมได้ดีขึ้น

Amazon SageMaker ข้อมูล Wrangler ลดความยุ่งยากในการเตรียมข้อมูลและกระบวนการวิศวกรรมคุณลักษณะ โดยลดเวลาที่ใช้ในการรวบรวมและเตรียมข้อมูลสำหรับ ML จากสัปดาห์เหลือเป็นนาที โดยให้อินเทอร์เฟซแบบภาพเดียวสำหรับนักวิทยาศาสตร์ข้อมูลเพื่อเลือก ล้าง และสำรวจชุดข้อมูลของตน Data Wrangler นำเสนอการแปลงข้อมูลในตัวมากกว่า 300 แบบเพื่อช่วยทำให้เป็นมาตรฐาน แปลง และรวมคุณสมบัติต่างๆ โดยไม่ต้องเขียนโค้ดใดๆ คุณสามารถนำเข้าข้อมูลจากแหล่งข้อมูลได้หลายแหล่ง เช่น บริการ Amazon Simple Storage (Amazon S3) อเมซอน อาเธน่า, อเมซอน Redshiftและ เกล็ดหิมะ. คุณยังสามารถใช้ อิฐข้อมูล เป็นแหล่งข้อมูลใน Data Wrangler เพื่อเตรียมข้อมูลสำหรับ ML อย่างง่ายดาย

แพลตฟอร์ม Databricks Lakehouse ผสมผสานองค์ประกอบที่ดีที่สุดของ Data Lake และคลังข้อมูล เพื่อส่งมอบความน่าเชื่อถือ การกำกับดูแลที่เข้มงวด และประสิทธิภาพของคลังข้อมูลด้วยการเปิดกว้าง ความยืดหยุ่น และการสนับสนุนการเรียนรู้ด้วยเครื่องของ Data Lake ด้วย Databricks เป็นแหล่งข้อมูลสำหรับ Data Wrangler คุณสามารถเชื่อมต่อกับ Databricks ได้อย่างรวดเร็วและง่ายดาย สืบค้นข้อมูลแบบโต้ตอบที่จัดเก็บไว้ใน Databricks โดยใช้ SQL และแสดงตัวอย่างข้อมูลก่อนนำเข้า นอกจากนี้ คุณสามารถรวมข้อมูลของคุณใน Databricks ด้วยข้อมูลที่จัดเก็บไว้ใน Amazon S3 และข้อมูลที่สืบค้นผ่าน Amazon Athena, Amazon Redshift และ Snowflake เพื่อสร้างชุดข้อมูลที่เหมาะสมสำหรับกรณีการใช้งาน ML ของคุณ

ในโพสต์นี้ เราแปลงชุดข้อมูล Lending Club Loan โดยใช้ Amazon SageMaker Data Wrangler เพื่อใช้ในการฝึกอบรมโมเดล ML

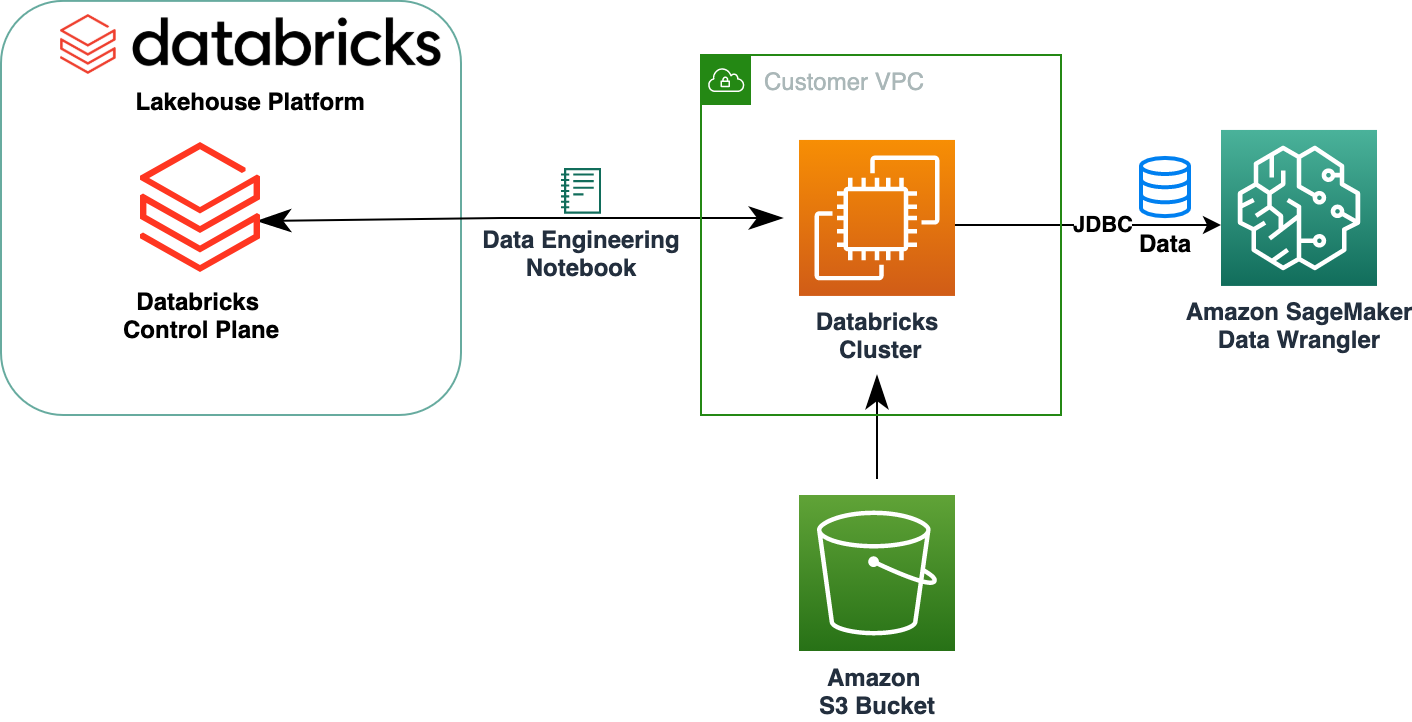

ภาพรวมโซลูชัน

ไดอะแกรมต่อไปนี้แสดงสถาปัตยกรรมโซลูชันของเรา

ชุดข้อมูล Lending Club Loan ประกอบด้วยข้อมูลสินเชื่อที่สมบูรณ์สำหรับสินเชื่อทั้งหมดที่ออกในปี 2007-2011 รวมถึงสถานะเงินกู้ปัจจุบันและข้อมูลการชำระเงินล่าสุด มี 39,717 แถว 22 คอลัมน์คุณลักษณะและ 3 ป้ายชื่อเป้าหมาย

ในการแปลงข้อมูลของเราโดยใช้ Data Wrangler เราทำตามขั้นตอนระดับสูงต่อไปนี้:

- ดาวน์โหลดและแยกชุดข้อมูล

- สร้างโฟลว์ Data Wrangler

- นำเข้าข้อมูลจาก Databricks ไปยัง Data Wrangler

- นำเข้าข้อมูลจาก Amazon S3 ไปยัง Data Wrangler

- เข้าร่วมข้อมูล

- ใช้การแปลง

- ส่งออกชุดข้อมูล

เบื้องต้น

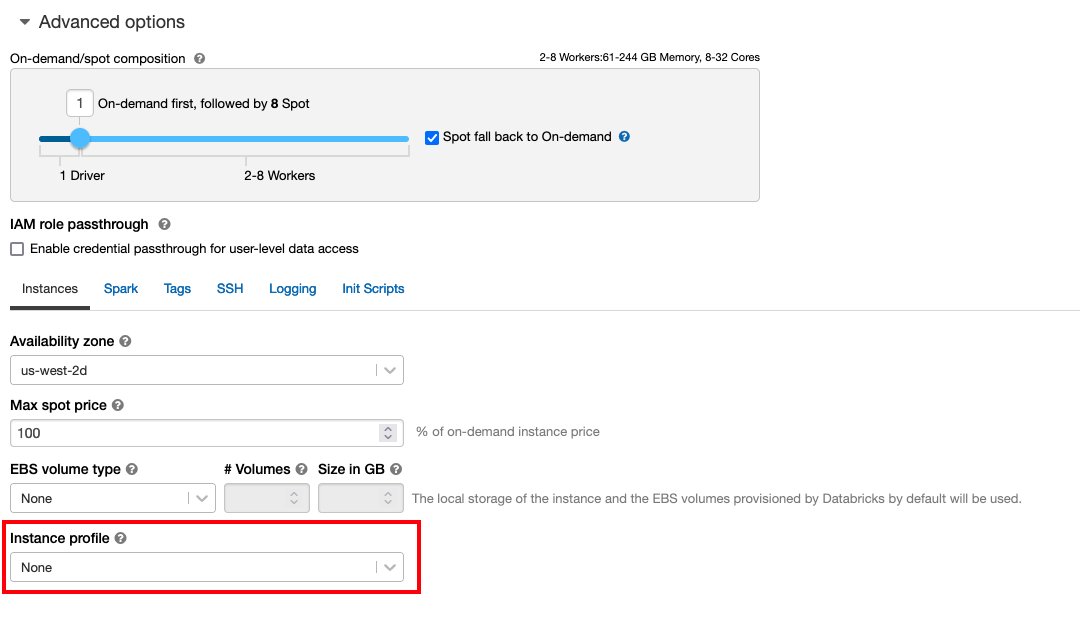

โพสต์ถือว่าคุณมีคลัสเตอร์ Databricks ที่ทำงานอยู่ หากคลัสเตอร์ของคุณทำงานบน AWS ให้ตรวจสอบว่าคุณได้กำหนดค่าต่อไปนี้:

การตั้งค่า Databricks

- An โปรไฟล์อินสแตนซ์ มีสิทธิ์ที่จำเป็นในการเข้าถึงถัง S3

- A นโยบายถัง มีสิทธิ์ที่จำเป็นสำหรับถัง S3 เป้าหมาย

ติดตาม เข้าถึงบัคเก็ต S3 ได้อย่างปลอดภัยโดยใช้โปรไฟล์อินสแตนซ์ ตามความต้องการ AWS Identity และการจัดการการเข้าถึง บทบาท (IAM) นโยบายบัคเก็ต S3 และการกำหนดค่าคลัสเตอร์ Databricks ตรวจสอบให้แน่ใจว่าได้กำหนดค่าคลัสเตอร์ Databricks ด้วยค่าที่เหมาะสม Instance Profileเลือกภายใต้ตัวเลือกขั้นสูง เพื่อเข้าถึงบัคเก็ต S3 ที่ต้องการ

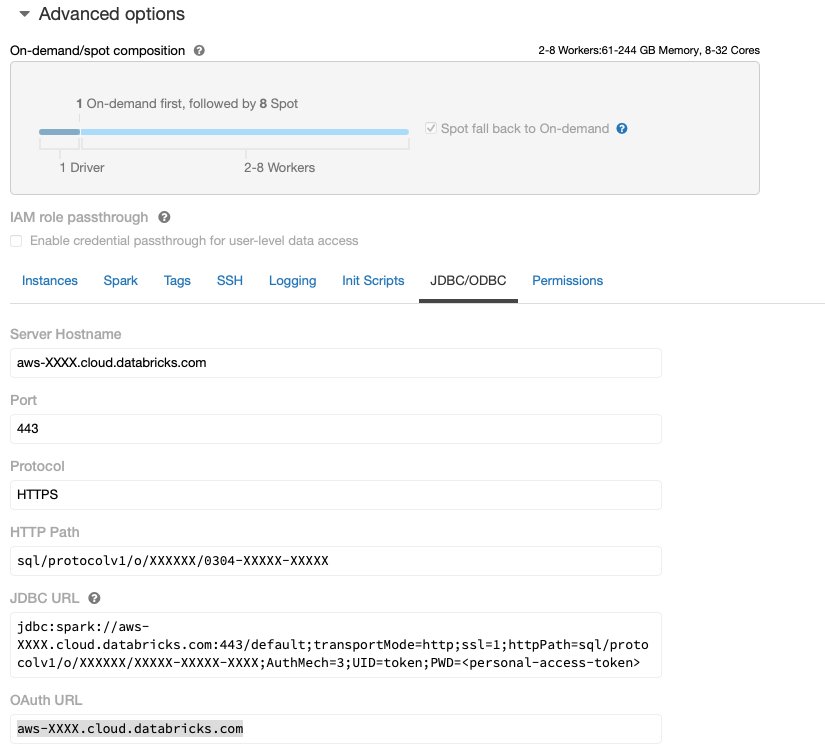

หลังจากที่คลัสเตอร์ Databricks เริ่มทำงานและต้องเข้าถึง Amazon S3 แล้ว คุณสามารถดึงข้อมูล JDBC URL จากคลัสเตอร์ Databricks ของคุณที่จะใช้โดย Data Wrangler เพื่อเชื่อมต่อ

ดึง JDBC URL

ในการดึง JDBC URL ให้ทำตามขั้นตอนต่อไปนี้:

- ใน Databricks ให้ไปที่ UI ของคลัสเตอร์

- เลือกคลัสเตอร์ของคุณ

- เกี่ยวกับ องค์ประกอบ เลือกแท็บ ตัวเลือกขั้นสูง.

- ภายใต้ ตัวเลือกขั้นสูง, เลือก เจดีบีซี/โอดีบีซี แถบ

- คัดลอก JDBC URL

อย่าลืมเปลี่ยนการเข้าถึงส่วนบุคคลของคุณ โทเค็น ใน URL

การตั้งค่า Wrangler ข้อมูล

ขั้นตอนนี้ถือว่าคุณมีสิทธิ์เข้าถึง Amazon SageMaker ซึ่งเป็นอินสแตนซ์ของ สตูดิโอ Amazon SageMakerและผู้ใช้ Studio

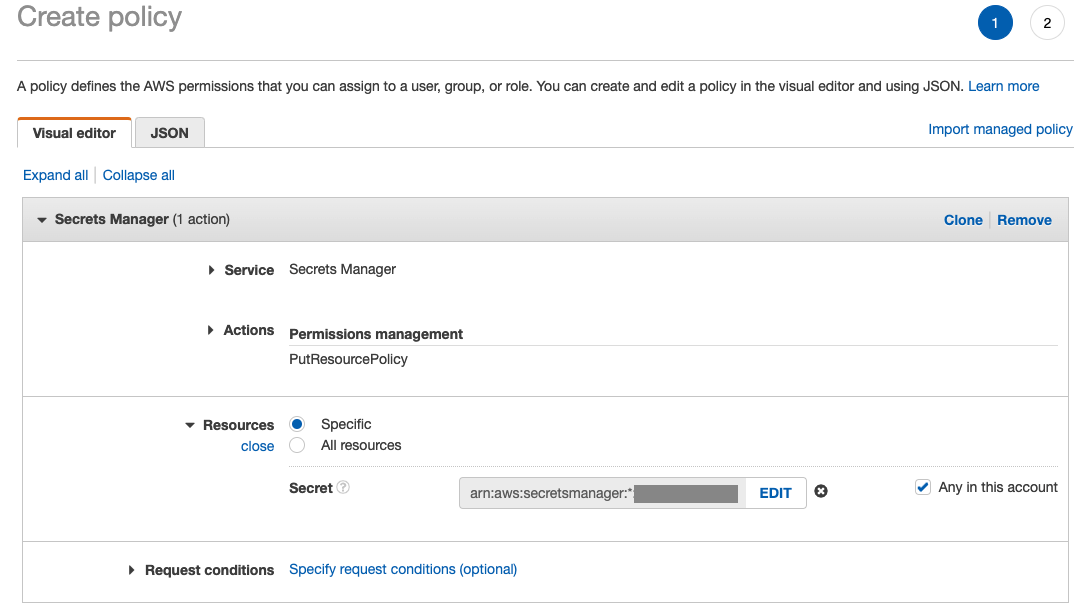

ในการอนุญาตการเข้าถึงการเชื่อมต่อ Databricks JDBC จาก Data Wrangler ผู้ใช้ Studio ต้องได้รับอนุญาตดังต่อไปนี้:

secretsmanager:PutResourcePolicy

ทำตามขั้นตอนด้านล่างเพื่ออัปเดตบทบาทการดำเนินการ IAM ที่กำหนดให้กับผู้ใช้ Studio โดยมีสิทธิ์ด้านบน ในฐานะผู้ใช้ที่เป็นผู้ดูแลระบบ IAM

- บนคอนโซล IAM ให้เลือก บทบาท ในบานหน้าต่างนำทาง

- เลือกบทบาทที่กำหนดให้กับผู้ใช้ Studio ของคุณ

- Choose เพิ่มสิทธิ์.

- Choose สร้างนโยบายอินไลน์.

- สำหรับบริการ เลือก ผู้จัดการความลับ.

- On สถานะเลือก ระดับการเข้าถึง.

- Choose การจัดการสิทธิ์.

- Choose ใส่นโยบายทรัพยากร.

- สำหรับ แหล่งข้อมูลเลือก โดยเฉพาะ และเลือก อะไรก็ได้ในบัญชีนี้.

ดาวน์โหลดและแยกชุดข้อมูล

คุณสามารถเริ่มต้นด้วย กำลังดาวน์โหลดชุดข้อมูล. เพื่อจุดประสงค์ในการสาธิต เราแยกชุดข้อมูลโดยคัดลอกคอลัมน์คุณลักษณะ id, emp_title, emp_length, home_ownerและ annual_inc เพื่อสร้างวินาที เงินกู้_2.csv ไฟล์. เราลบคอลัมน์ดังกล่าวออกจากไฟล์เงินกู้เดิมยกเว้น id คอลัมน์และเปลี่ยนชื่อไฟล์ต้นฉบับเป็น เงินกู้_1.csv. อัปโหลด เงินกู้_1.csv ไฟล์ไปที่ อิฐข้อมูล เพื่อสร้างตาราง loans_1 และ เงินกู้_2.csv ในถัง S3

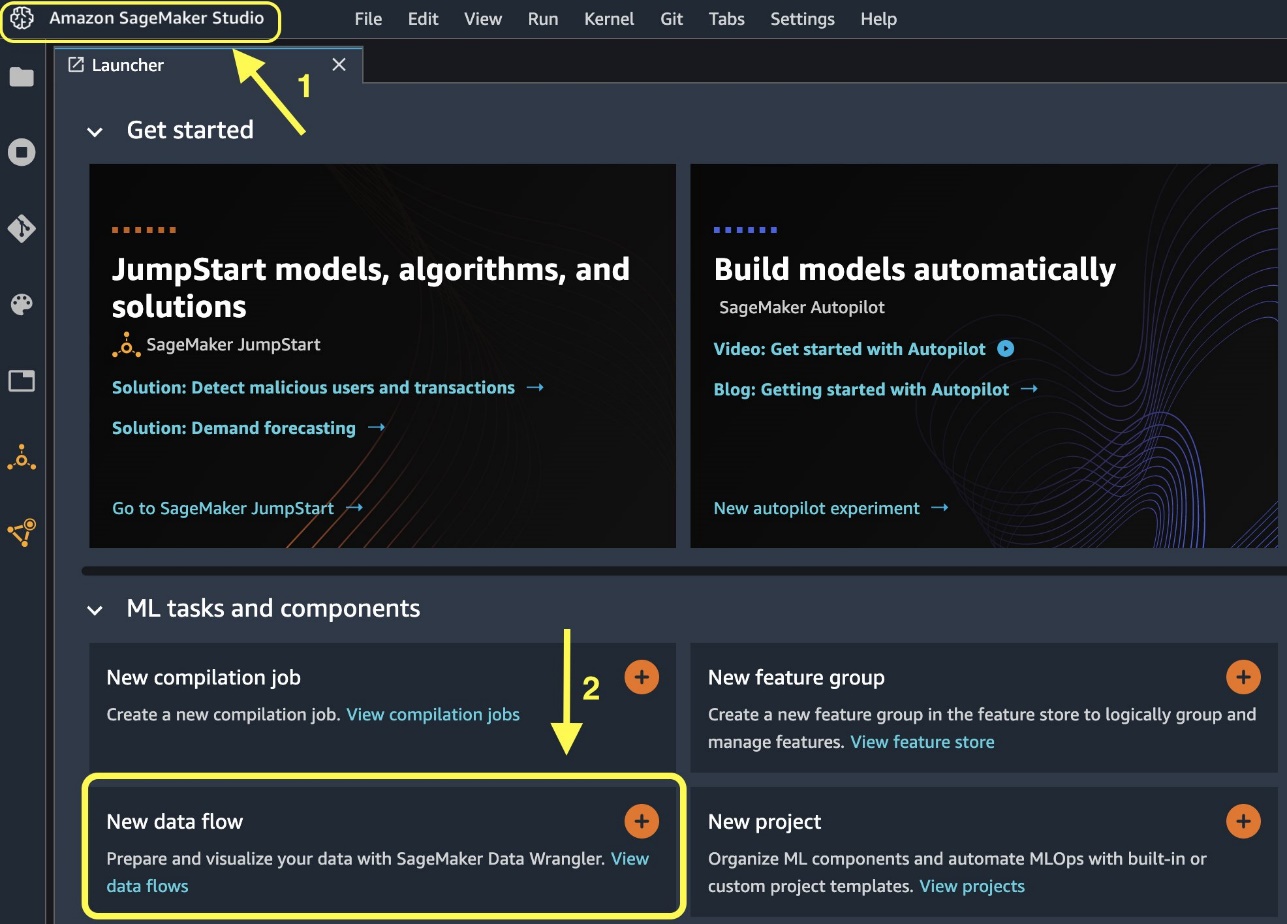

สร้างโฟลว์ Data Wrangler

สำหรับข้อมูลเกี่ยวกับข้อกำหนดเบื้องต้นของ Data Wrangler โปรดดูที่ เริ่มต้นใช้งาน Data Wrangler.

เริ่มต้นด้วยการสร้างโฟลว์ข้อมูลใหม่

- บนคอนโซล Studio บน เนื้อไม่มีมัน เมนูให้เลือก ใหม่.

- Choose การไหลของข้อมูล Wrangler.

- เปลี่ยนชื่อโฟลว์ตามต้องการ

หรือคุณสามารถสร้างโฟลว์ข้อมูลใหม่จาก Launcher ได้

การสร้างโฟลว์ใหม่อาจใช้เวลาสักครู่จึงจะเสร็จสมบูรณ์ หลังจากสร้างโฟลว์แล้ว คุณจะเห็น นำเข้าข้อมูล หน้า.

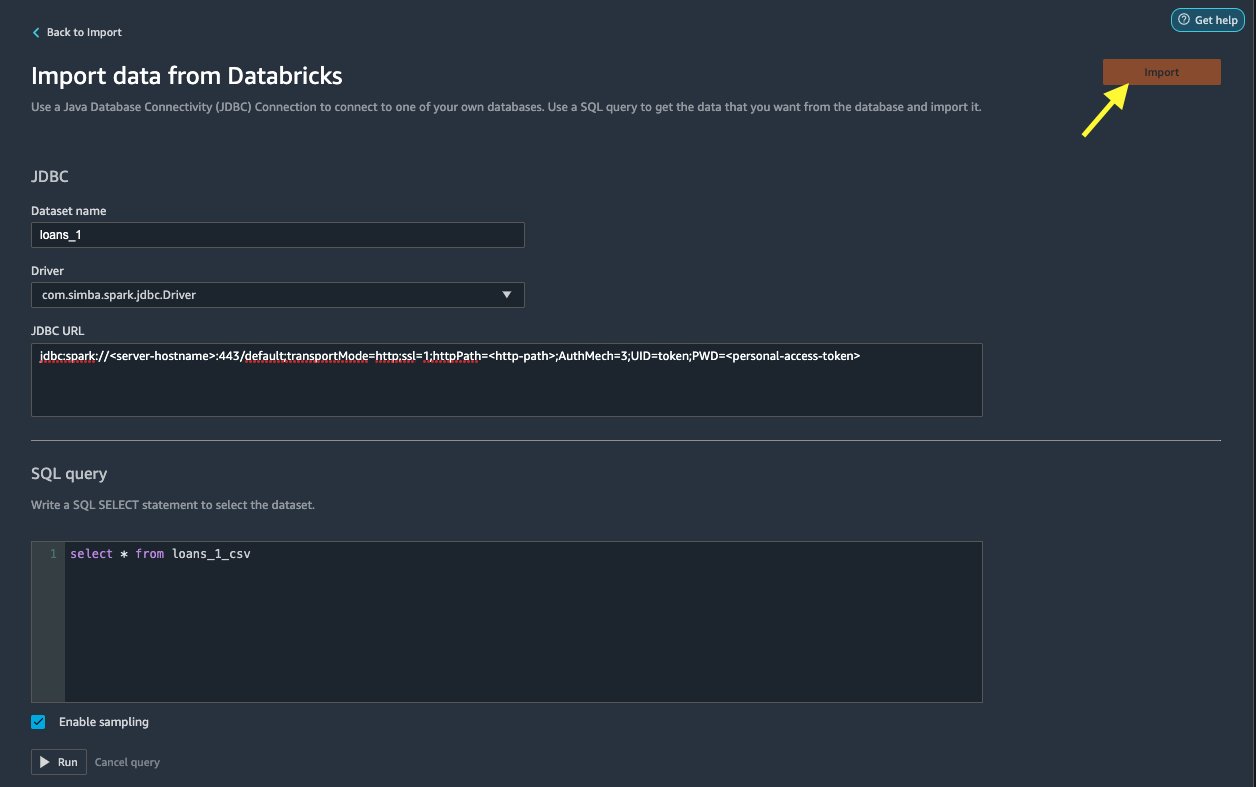

นำเข้าข้อมูลจาก Databricks ไปยัง Data Wrangler

ต่อไป เราตั้งค่า Databricks (JDBC) เป็นแหล่งข้อมูลใน Data Wrangler ในการนำเข้าข้อมูลจาก Databricks ก่อนอื่นเราต้องเพิ่ม Databricks เป็นแหล่งข้อมูล

- เกี่ยวกับ นำเข้าข้อมูล แท็บของโฟลว์ Data Wrangler ของคุณ เลือก เพิ่มแหล่งข้อมูล.

- บนเมนูแบบเลื่อนลง ให้เลือก ดาต้าบริกส์ (JDBC).

เกี่ยวกับ นำเข้าข้อมูลจาก Databricks หน้า คุณป้อนรายละเอียดคลัสเตอร์ของคุณ

- สำหรับ ชื่อชุดข้อมูลป้อนชื่อที่คุณต้องการใช้ในไฟล์โฟลว์

- สำหรับ คนขับรถ, เลือกคนขับ

com.simba.spark.jdbc.Driver. - สำหรับ URL ของ JDBCให้ป้อน URL ของคลัสเตอร์ Databricks ที่ได้รับก่อนหน้านี้

URL ควรมีลักษณะคล้ายกับรูปแบบต่อไปนี้ jdbc:spark://<serve- hostname>:443/default;transportMode=http;ssl=1;httpPath=<http- path>;AuthMech=3;UID=token;PWD=<personal-access-token>.

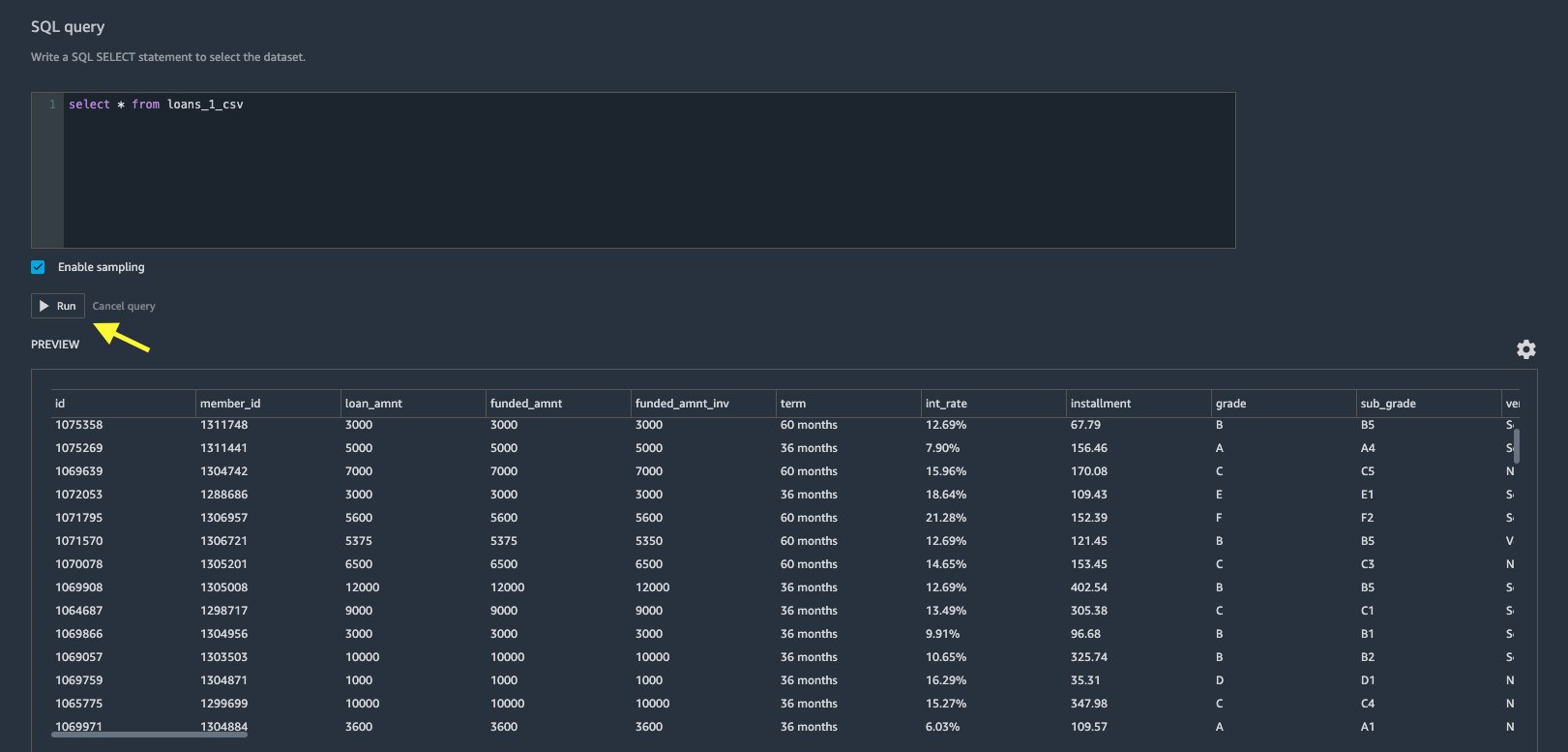

- ในตัวแก้ไขแบบสอบถาม SQL ระบุคำสั่ง SQL SELECT ต่อไปนี้:

หากคุณเลือกชื่อตารางอื่นขณะอัปโหลดข้อมูลไปยัง Databricks ให้แทนที่ Loan_1 ในการสืบค้น SQL ด้านบนตามลำดับ

ตัว Vortex Indicator ได้ถูกนำเสนอลงในนิตยสาร แบบสอบถาม SQL ใน Data Wrangler คุณสามารถสอบถามตารางใดๆ ที่เชื่อมต่อกับฐานข้อมูล JDBC Databricks ที่เลือกไว้ล่วงหน้า เปิดใช้งานการสุ่มตัวอย่าง การตั้งค่าจะดึงข้อมูล 50,000 แถวแรกของชุดข้อมูลของคุณโดยค่าเริ่มต้น ขึ้นอยู่กับขนาดของชุดข้อมูล ยกเลิกการเลือก เปิดใช้งานการสุ่มตัวอย่าง อาจส่งผลให้ใช้เวลาในการนำเข้านานขึ้น

- Choose วิ่ง.

การเรียกใช้คิวรีจะแสดงตัวอย่างชุดข้อมูล Databricks ของคุณโดยตรงใน Data Wrangler

Data Wrangler ให้ความยืดหยุ่นในการตั้งค่าการเชื่อมต่อหลาย ๆ การเชื่อมต่อพร้อมกันกับคลัสเตอร์ Databricks หนึ่งคลัสเตอร์หรือหลายคลัสเตอร์ หากจำเป็น ทำให้สามารถวิเคราะห์และเตรียมชุดข้อมูลที่รวมกันได้

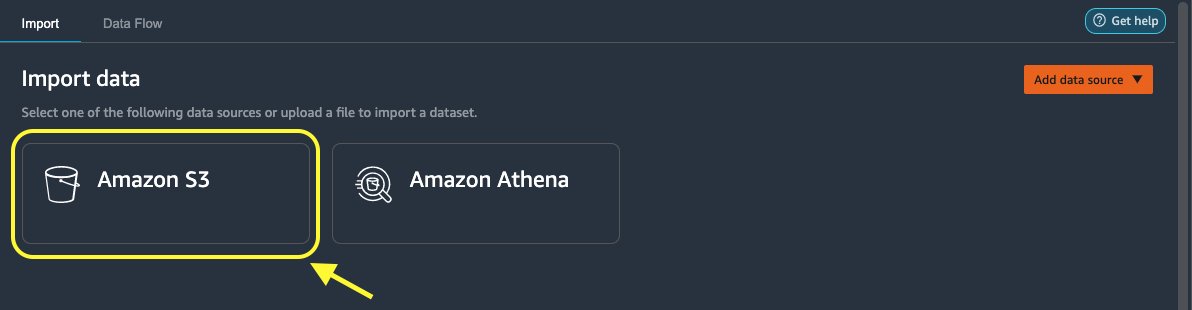

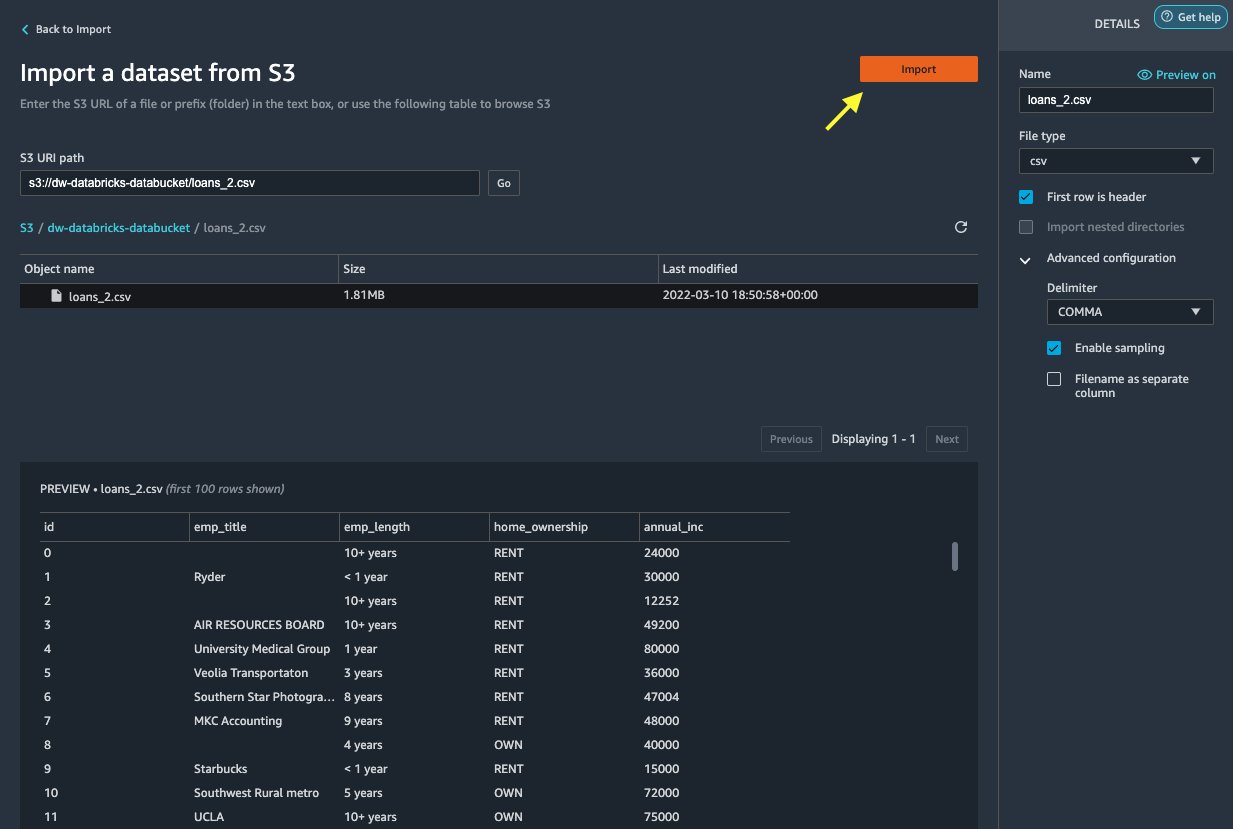

นำเข้าข้อมูลจาก Amazon S3 ไปยัง Data Wrangler

ต่อไปมานำเข้า loan_2.csv ไฟล์จาก Amazon S3

เมื่อคุณเลือกไฟล์ CSV คุณสามารถดูตัวอย่างข้อมูลได้

- ตัว Vortex Indicator ได้ถูกนำเสนอลงในนิตยสาร รายละเอียด บานหน้าต่างเลือก การกำหนดค่าขั้นสูง เพื่อให้แน่ใจว่า เปิดใช้งานการสุ่มตัวอย่าง ถูกเลือกและ จุลภาค ถูกเลือกสำหรับ คั่น.

- Choose นำเข้า.

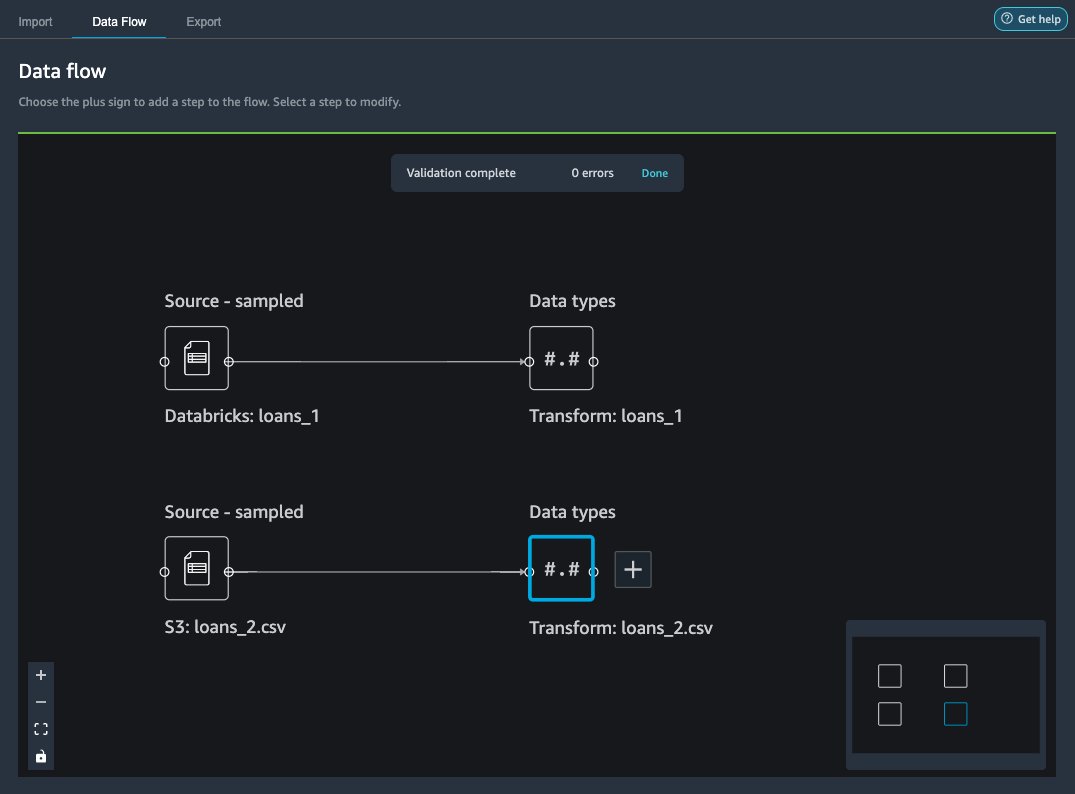

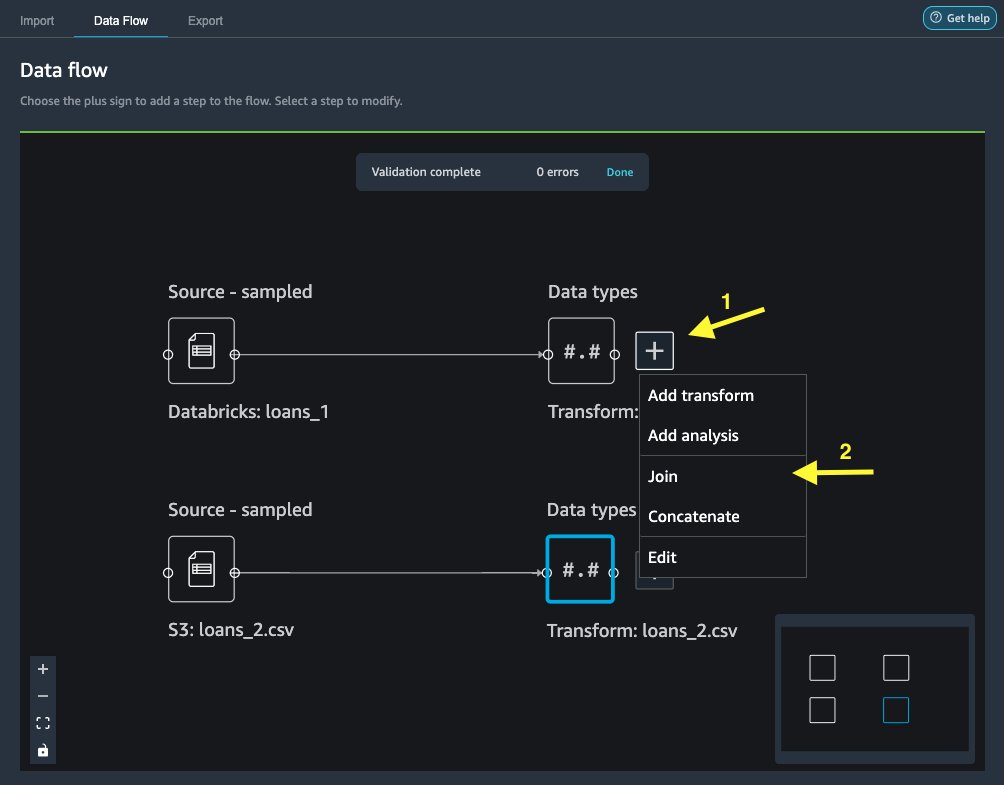

หลังจาก loans_2.csv นำเข้าชุดข้อมูลเรียบร้อยแล้ว อินเทอร์เฟซการไหลของข้อมูลจะแสดงทั้งแหล่งข้อมูล Databricks JDBC และ Amazon S3

เข้าร่วมดาต้า

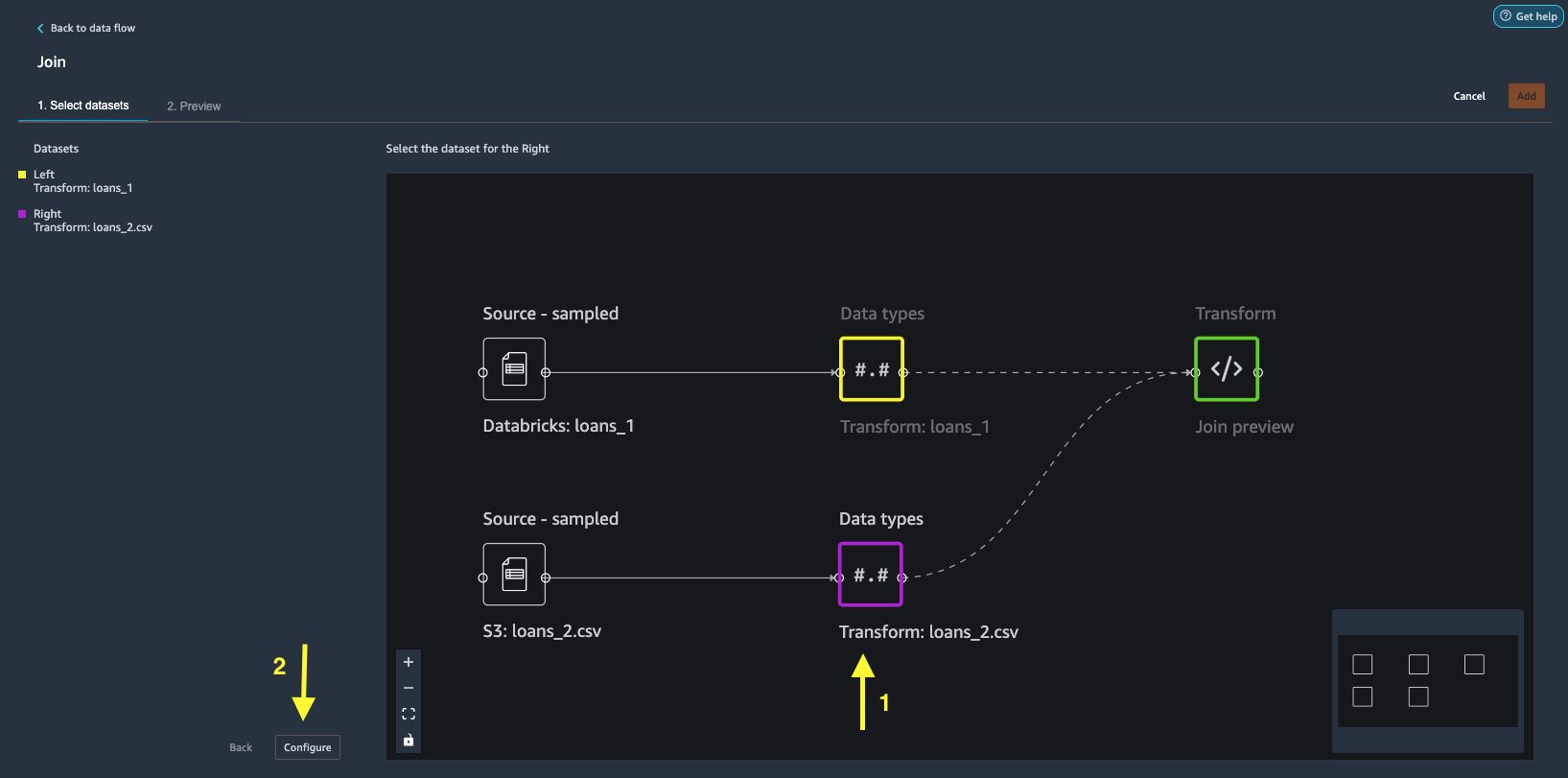

ตอนนี้เราได้นำเข้าข้อมูลจาก Databricks และ Amazon S3 แล้ว มารวมชุดข้อมูลโดยใช้คอลัมน์ตัวระบุที่ไม่ซ้ำทั่วไปกัน

- เกี่ยวกับ การไหลของข้อมูล แท็บสำหรับ ประเภทข้อมูล, เลือกเครื่องหมายบวกสำหรับ

loans_1. - Choose ร่วมเป็นผู้ขายกับเราที่.

- เลือก

loans_2.csvไฟล์เป็น ขวา ชุดข้อมูล - Choose กำหนดค่า เพื่อกำหนดเกณฑ์การเข้าร่วม

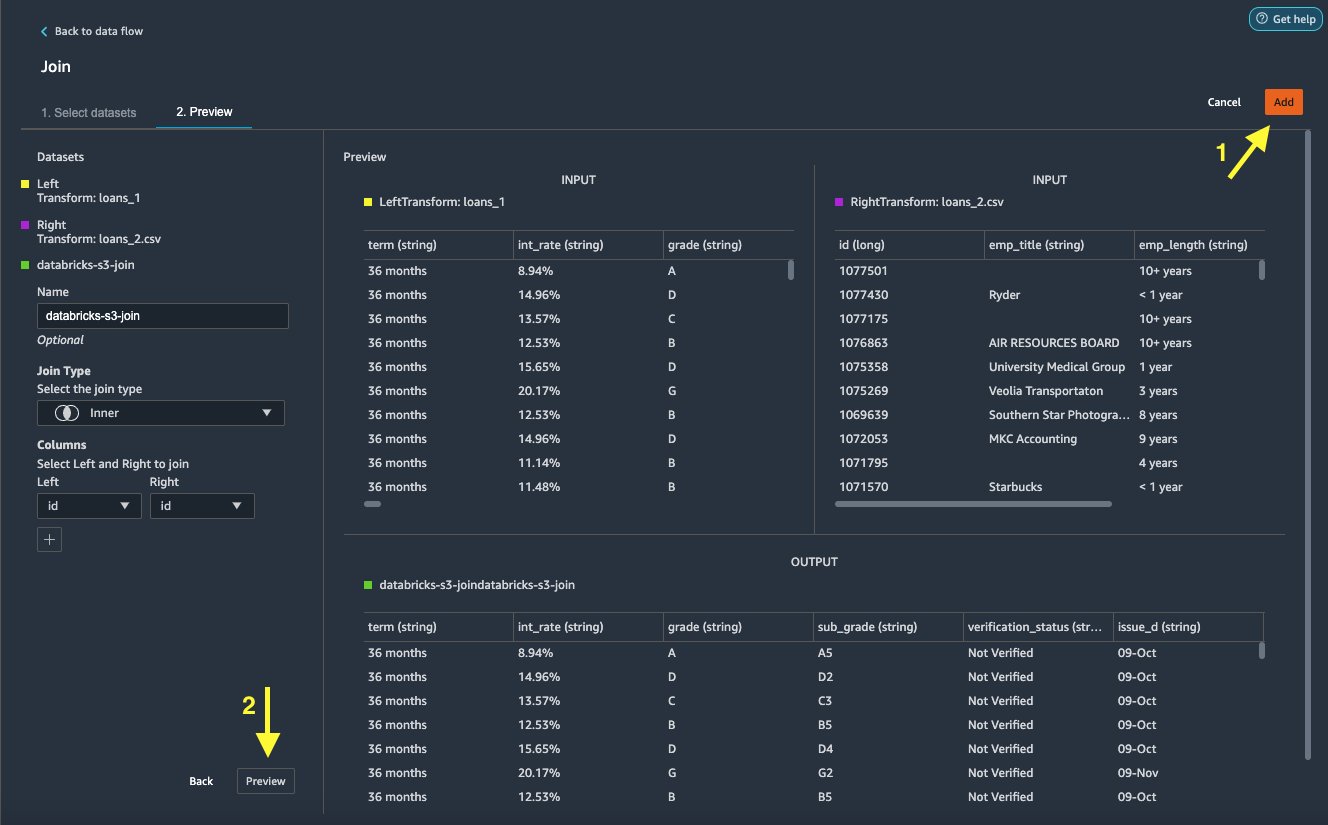

- สำหรับ Nameป้อนชื่อสำหรับการเข้าร่วม

- สำหรับ ประเภทการเข้าร่วมเลือก ภายใน สำหรับโพสต์นี้

- เลือก

idคอลัมน์ที่จะเข้าร่วม - Choose ใช้ เพื่อดูตัวอย่างชุดข้อมูลที่เข้าร่วม

- Choose เพิ่ม เพื่อเพิ่มเข้าไปในกระแสข้อมูล

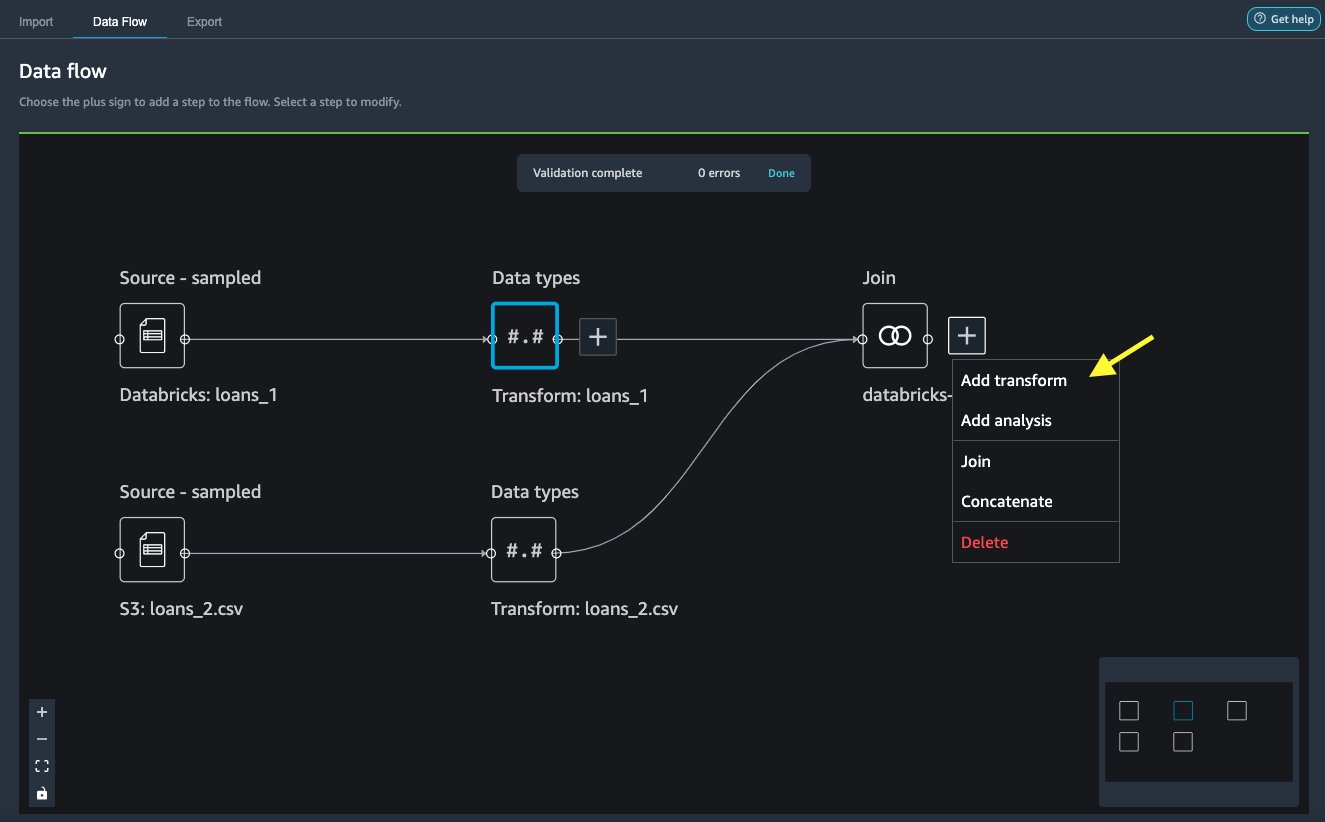

ใช้การแปลงร่าง

Data Wrangler มาพร้อมกับการแปลงในตัวมากกว่า 300 แบบ ซึ่งไม่จำเป็นต้องมีการเข้ารหัส ลองใช้การแปลงในตัวเพื่อเตรียมชุดข้อมูล

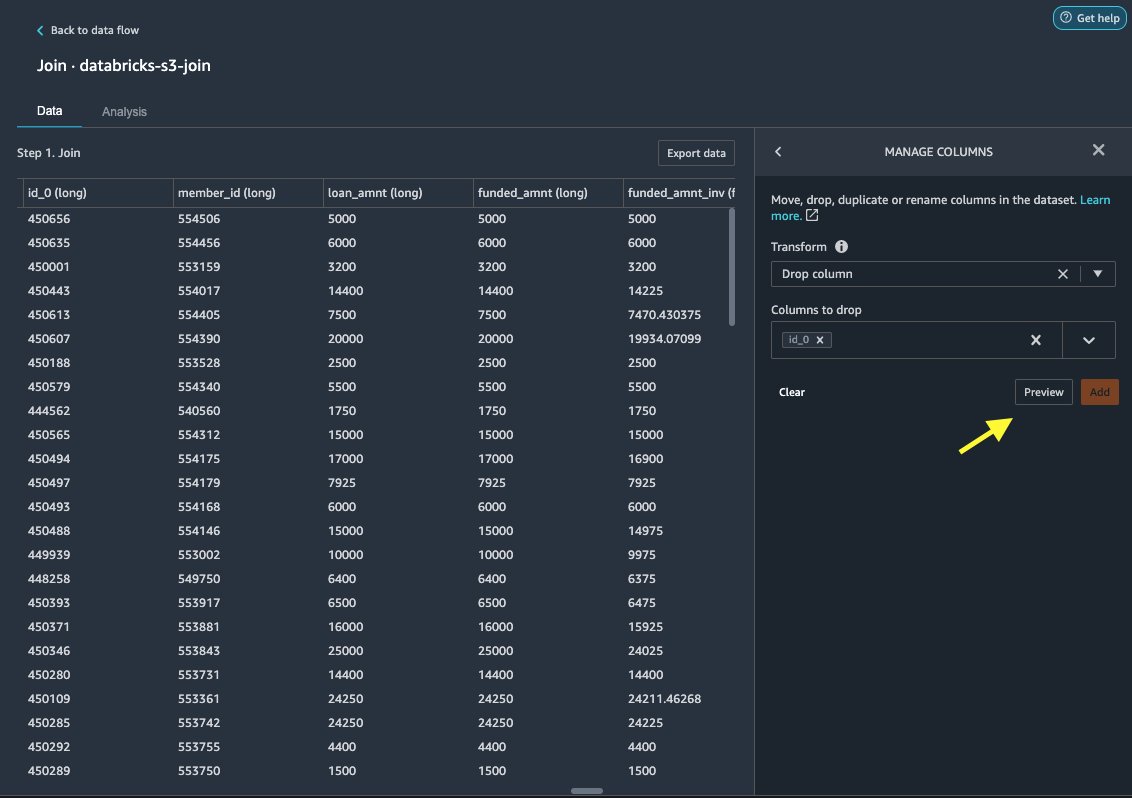

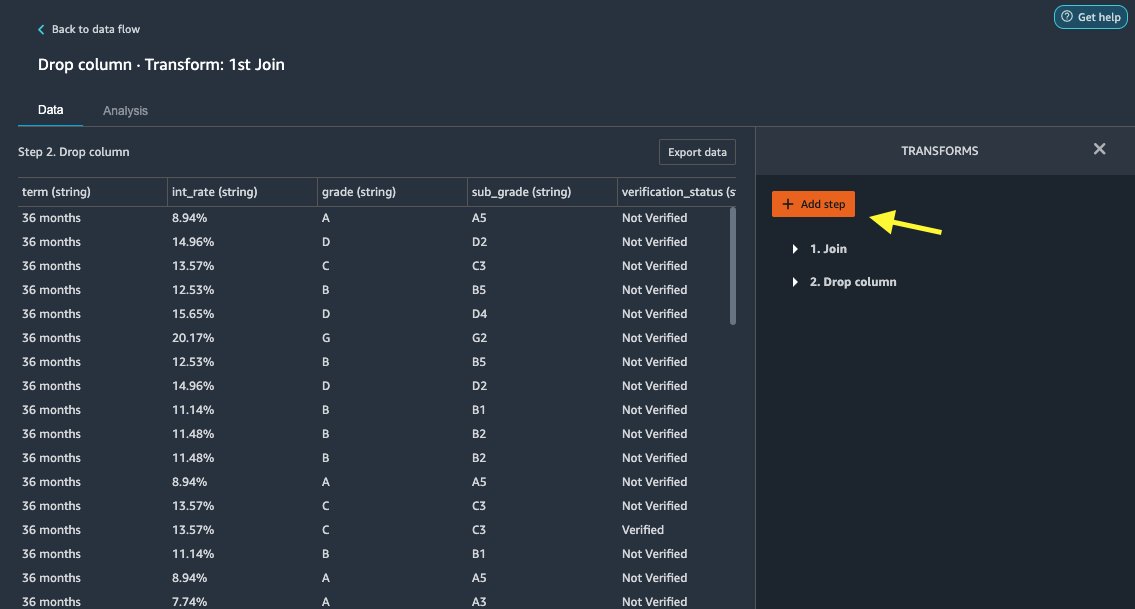

วางคอลัมน์

ก่อนอื่นเราวางคอลัมน์ ID ที่ซ้ำซ้อน

- บนโหนดที่เข้าร่วม ให้เลือกเครื่องหมายบวก

- Choose เพิ่มการแปลง.

- ภายใต้ แปลงร่าง เลือก + เพิ่มขั้นตอน.

- Choose จัดการคอลัมน์.

- สำหรับ แปลงเลือก วางคอลัมน์.

- สำหรับ คอลัมน์ที่จะปล่อย, เลือกคอลัมน์

id_0. - Choose ดูตัวอย่าง.

- Choose เพิ่ม.

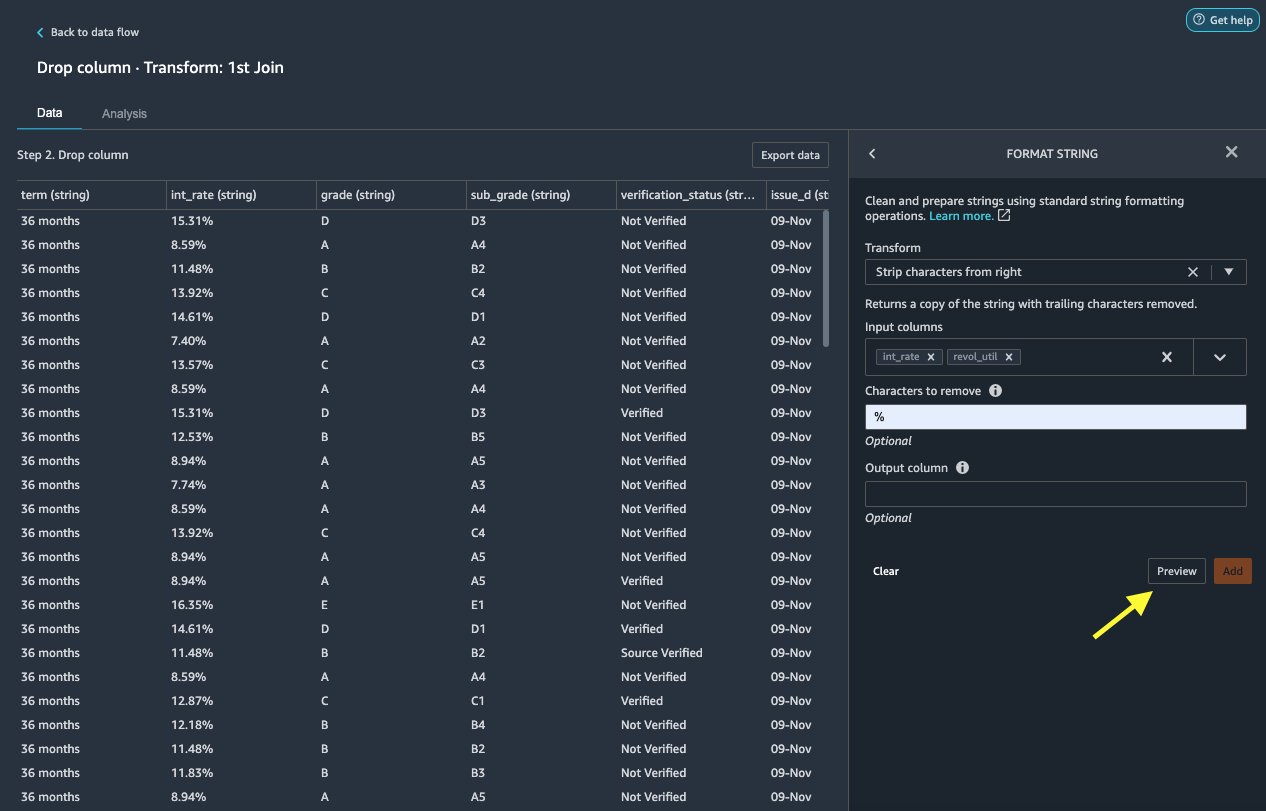

รูปแบบสตริง

ลองใช้การจัดรูปแบบสตริงเพื่อลบสัญลักษณ์เปอร์เซ็นต์จาก int_rate และ revol_util คอลัมน์

- เกี่ยวกับ ข้อมูล แท็บ ภายใต้ แปลงเลือก + เพิ่มขั้นตอน.

- Choose รูปแบบสตริง.

- สำหรับ แปลงเลือก ตัดอักขระจากด้านขวา.

Data Wrangler ช่วยให้คุณสามารถใช้การแปลงที่คุณเลือกกับหลายคอลัมน์พร้อมกันได้

- สำหรับ คอลัมน์อินพุตเลือก

int_rateและrevol_util. - สำหรับ ตัวละครที่จะลบป้อน

%. - Choose ดูตัวอย่าง.

- Choose เพิ่ม.

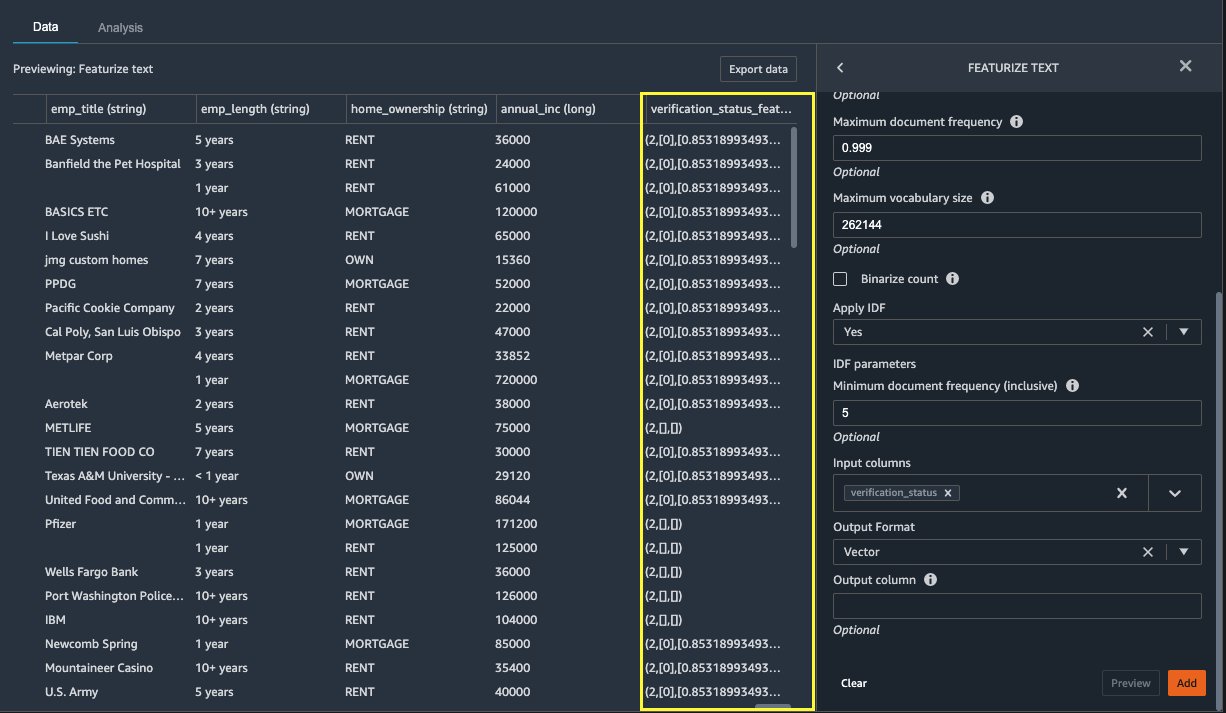

นำเสนอข้อความ

มาสร้างภาพเวกเตอร์กัน verification_statusคอลัมน์คุณลักษณะข้อความ เราแปลงคอลัมน์ข้อความเป็นเวกเตอร์ความถี่ของเทอม – ความถี่เอกสารผกผัน (TF-IDF) โดยใช้ตัวนับเวกเตอร์และตัวสร้างโทเค็นมาตรฐานตามที่อธิบายไว้ด้านล่าง Data Wrangler ยังให้ตัวเลือกในการนำ tokenizer ของคุณเอง ถ้าต้องการ

- ภายใต้ หม้อแปลงเลือก + เพิ่มขั้นตอน.

- Choose นำเสนอข้อความ.

- สำหรับ แปลงเลือก vectorize.

- สำหรับ คอลัมน์อินพุตเลือก

verification_status. - Choose ดูตัวอย่าง.

- Choose เพิ่ม.

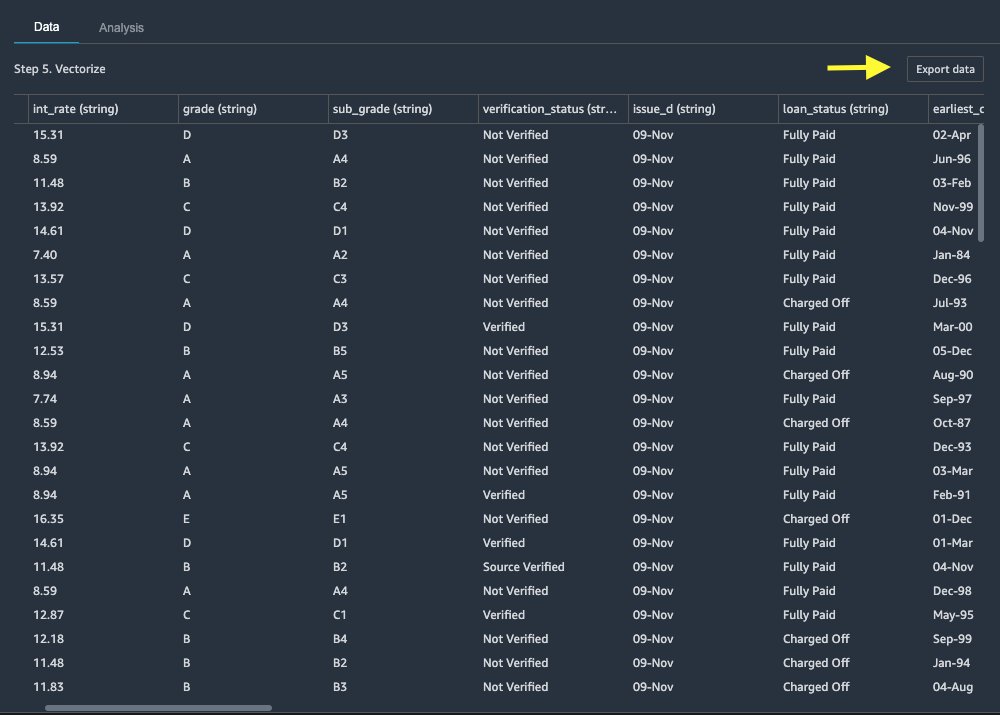

ส่งออกชุดข้อมูล

หลังจากที่เราใช้การแปลงหลายแบบกับคอลัมน์ประเภทต่างๆ รวมทั้งข้อความ การจัดหมวดหมู่ และตัวเลข เราก็พร้อมที่จะใช้ชุดข้อมูลที่แปลงแล้วสำหรับการฝึกโมเดล ML ขั้นตอนสุดท้ายคือการส่งออกชุดข้อมูลที่แปลงแล้วไปยัง Amazon S3 ใน Data Wrangler คุณมีตัวเลือกมากมายสำหรับการใช้การแปลงแบบดาวน์สตรีม:

- Choose ขั้นตอนการส่งออก เพื่อสร้างสมุดบันทึก Jupyter โดยอัตโนมัติด้วยรหัส SageMaker Processing สำหรับการประมวลผลและส่งออกชุดข้อมูลที่แปลงแล้วไปยังบัคเก็ต S3 ดูรายละเอียดเพิ่มเติมได้ที่ เริ่มงานการประมวลผลด้วยการคลิกเพียงไม่กี่ครั้งโดยใช้ Amazon SageMaker Data Wrangler.

- ส่งออกสมุดบันทึก Studio ที่สร้าง a ไปป์ไลน์ SageMaker ด้วยกระแสข้อมูลของคุณ หรือสมุดบันทึกที่สร้าง Amazon SageMaker ฟีเจอร์สโตร์ กลุ่มคุณลักษณะและเพิ่มคุณสมบัติให้กับร้านค้าคุณสมบัติออฟไลน์หรือออนไลน์

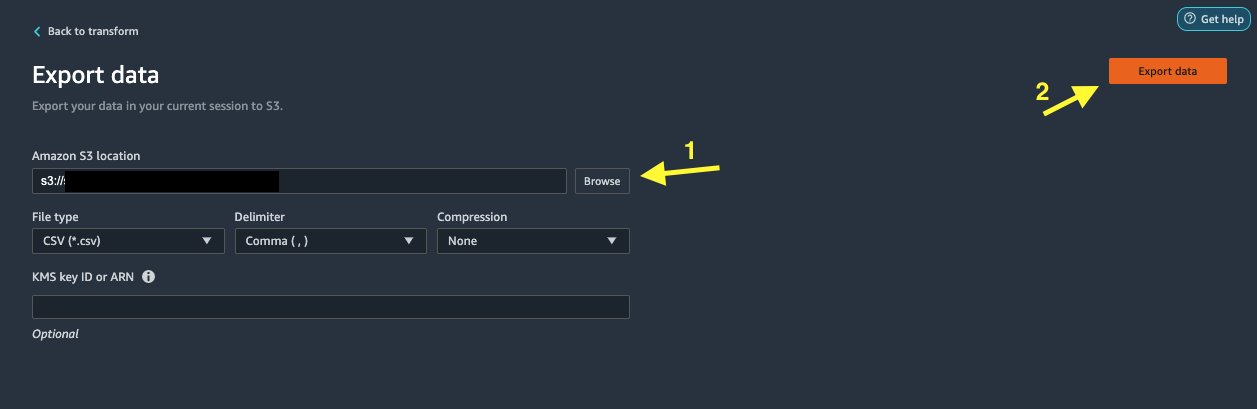

- Choose ส่งออกข้อมูล เพื่อส่งออกโดยตรงไปยัง Amazon S3

ในโพสต์นี้ เราใช้ประโยชน์จาก ส่งออกข้อมูล ตัวเลือกใน แปลง ดูเพื่อส่งออกชุดข้อมูลที่แปลงแล้วไปยัง Amazon S3 โดยตรง

- Choose ส่งออกข้อมูล.

- สำหรับ ที่ตั้ง S3เลือก หมวดหมู่สินค้า แล้วเลือกบัคเก็ต S3 ของคุณ

- Choose ส่งออกข้อมูล.

ทำความสะอาด

หากงานของคุณกับ Data Wrangler เสร็จสมบูรณ์ ปิดอินสแตนซ์ Data Wrangler ของคุณ เพื่อหลีกเลี่ยงค่าธรรมเนียมเพิ่มเติม

สรุป

ในโพสต์นี้ เราได้กล่าวถึงวิธีที่คุณสามารถตั้งค่าและเชื่อมต่อ Databricks เป็นแหล่งข้อมูลใน Data Wrangler ได้อย่างรวดเร็วและง่ายดาย สืบค้นข้อมูลแบบโต้ตอบที่จัดเก็บไว้ใน Databricks โดยใช้ SQL และแสดงตัวอย่างข้อมูลก่อนนำเข้า นอกจากนี้ เราได้ดูวิธีที่คุณสามารถรวมข้อมูลของคุณใน Databricks ด้วยข้อมูลที่จัดเก็บไว้ใน Amazon S3 จากนั้น เราใช้การแปลงข้อมูลกับชุดข้อมูลที่รวมกันเพื่อสร้างไปป์ไลน์การเตรียมข้อมูล หากต้องการสำรวจความสามารถในการวิเคราะห์ของ Data Wrangler เพิ่มเติม รวมถึงเป้าหมายการรั่วไหลและการสร้างรายงานอคติ โปรดดูที่โพสต์บล็อกต่อไปนี้ เร่งการเตรียมข้อมูลโดยใช้ Amazon SageMaker Data Wrangler สำหรับการคาดคะเนการกลับเข้ารับการรักษาของผู้ป่วยเบาหวาน.

ในการเริ่มต้นใช้งาน Data Wrangler โปรดดูที่ เตรียมข้อมูล ML ด้วย Amazon SageMaker Data Wranglerและดูข้อมูลล่าสุดเกี่ยวกับ Data Wrangler หน้าสินค้า.

เกี่ยวกับผู้เขียน

รูป เบนส์ เป็นสถาปนิกโซลูชันที่ AWS โดยมุ่งเน้นที่ AI/ML เขาหลงใหลในการช่วยลูกค้าสร้างสรรค์นวัตกรรมและบรรลุวัตถุประสงค์ทางธุรกิจโดยใช้ปัญญาประดิษฐ์และการเรียนรู้ของเครื่อง ในเวลาว่าง Roop ชอบอ่านหนังสือและเดินป่า

รูป เบนส์ เป็นสถาปนิกโซลูชันที่ AWS โดยมุ่งเน้นที่ AI/ML เขาหลงใหลในการช่วยลูกค้าสร้างสรรค์นวัตกรรมและบรรลุวัตถุประสงค์ทางธุรกิจโดยใช้ปัญญาประดิษฐ์และการเรียนรู้ของเครื่อง ในเวลาว่าง Roop ชอบอ่านหนังสือและเดินป่า

Igor Alekseev เป็น Partner Solution Architect ที่ AWS ในด้านข้อมูลและการวิเคราะห์ Igor ทำงานร่วมกับพันธมิตรเชิงกลยุทธ์เพื่อช่วยสร้างสถาปัตยกรรมที่ซับซ้อนและปรับให้เหมาะสมกับ AWS ก่อนร่วมงานกับ AWS ในฐานะสถาปนิกข้อมูล/โซลูชัน เขาได้ดำเนินการหลายโครงการใน Big Data รวมถึง Data Lake หลายแห่งในระบบนิเวศ Hadoop ในฐานะวิศวกรข้อมูล เขามีส่วนร่วมในการใช้ AI/ML กับการตรวจจับการฉ้อโกงและระบบอัตโนมัติในสำนักงาน โครงการของ Igor อยู่ในหลากหลายอุตสาหกรรม รวมถึงการสื่อสาร การเงิน ความปลอดภัยสาธารณะ การผลิต และการดูแลสุขภาพ ก่อนหน้านี้ Igor ทำงานเป็นวิศวกรเต็มกอง/หัวหน้าฝ่ายเทคโนโลยี

Igor Alekseev เป็น Partner Solution Architect ที่ AWS ในด้านข้อมูลและการวิเคราะห์ Igor ทำงานร่วมกับพันธมิตรเชิงกลยุทธ์เพื่อช่วยสร้างสถาปัตยกรรมที่ซับซ้อนและปรับให้เหมาะสมกับ AWS ก่อนร่วมงานกับ AWS ในฐานะสถาปนิกข้อมูล/โซลูชัน เขาได้ดำเนินการหลายโครงการใน Big Data รวมถึง Data Lake หลายแห่งในระบบนิเวศ Hadoop ในฐานะวิศวกรข้อมูล เขามีส่วนร่วมในการใช้ AI/ML กับการตรวจจับการฉ้อโกงและระบบอัตโนมัติในสำนักงาน โครงการของ Igor อยู่ในหลากหลายอุตสาหกรรม รวมถึงการสื่อสาร การเงิน ความปลอดภัยสาธารณะ การผลิต และการดูแลสุขภาพ ก่อนหน้านี้ Igor ทำงานเป็นวิศวกรเต็มกอง/หัวหน้าฝ่ายเทคโนโลยี

Huong Nguyen เป็น Sr. Product Manager ที่ AWS เธอเป็นผู้นำประสบการณ์ผู้ใช้สำหรับ SageMaker Studio เธอมีประสบการณ์ 13 ปีในการสร้างผลิตภัณฑ์ที่เน้นลูกค้าและขับเคลื่อนด้วยข้อมูลสำหรับทั้งองค์กรและพื้นที่สำหรับผู้บริโภค ในเวลาว่าง เธอชอบอ่านหนังสือ อยู่ในธรรมชาติ และใช้เวลาอยู่กับครอบครัว

Huong Nguyen เป็น Sr. Product Manager ที่ AWS เธอเป็นผู้นำประสบการณ์ผู้ใช้สำหรับ SageMaker Studio เธอมีประสบการณ์ 13 ปีในการสร้างผลิตภัณฑ์ที่เน้นลูกค้าและขับเคลื่อนด้วยข้อมูลสำหรับทั้งองค์กรและพื้นที่สำหรับผู้บริโภค ในเวลาว่าง เธอชอบอ่านหนังสือ อยู่ในธรรมชาติ และใช้เวลาอยู่กับครอบครัว

เฮนรี่วัง เป็นวิศวกรพัฒนาซอฟต์แวร์ที่ AWS เขาเพิ่งเข้าร่วมทีม Data Wrangler หลังจากสำเร็จการศึกษาจาก UC Davis เขามีความสนใจในด้านวิทยาศาสตร์ข้อมูลและการเรียนรู้ของเครื่อง และทำการพิมพ์ 3 มิติเป็นงานอดิเรก

เฮนรี่วัง เป็นวิศวกรพัฒนาซอฟต์แวร์ที่ AWS เขาเพิ่งเข้าร่วมทีม Data Wrangler หลังจากสำเร็จการศึกษาจาก UC Davis เขามีความสนใจในด้านวิทยาศาสตร์ข้อมูลและการเรียนรู้ของเครื่อง และทำการพิมพ์ 3 มิติเป็นงานอดิเรก

- คอยน์สมาร์ท การแลกเปลี่ยน Bitcoin และ Crypto ที่ดีที่สุดในยุโรป

- เพลโตบล็อคเชน Web3 Metaverse ข่าวกรอง ขยายความรู้. เข้าฟรี

- คริปโตฮอว์ก เรดาร์ Altcoin ทดลองฟรี.

- ที่มา: https://aws.amazon.com/blogs/machine-learning/prepare-data-from-databricks-for-machine-learning-using-amazon-sagemaker-data-wrangler/

- "

- 000

- 100

- 39

- 3d

- เกี่ยวกับเรา

- เข้า

- อำนวยความสะดวก

- เพิ่มเติม

- สูง

- ความได้เปรียบ

- อัลกอริทึม

- ทั้งหมด

- อเมซอน

- การวิเคราะห์

- การวิเคราะห์

- การประยุกต์ใช้

- สถาปัตยกรรม

- เทียม

- ปัญญาประดิษฐ์

- ปัญญาประดิษฐ์และการเรียนรู้ด้วยเครื่อง

- ที่ได้รับมอบหมาย

- อัตโนมัติ

- AWS

- กำลัง

- ที่ดีที่สุด

- ข้อมูลขนาดใหญ่

- บล็อก

- ชายแดน

- สร้าง

- built-in

- ธุรกิจ

- ความสามารถในการ

- กรณี

- Choose

- การทำความสะอาด

- สโมสร

- รหัส

- การเข้ารหัส

- คอลัมน์

- รวม

- ร่วมกัน

- คมนาคม

- ซับซ้อน

- องค์ประกอบ

- งานที่เชื่อมต่อ

- การเชื่อมต่อ

- การเชื่อมต่อ

- การพิจารณา

- ปลอบใจ

- การรวบรวม

- ผู้บริโภค

- การบริโภค

- มี

- ที่สร้างขึ้น

- สร้าง

- การสร้าง

- ปัจจุบัน

- ลูกค้า

- ข้อมูล

- วิทยาศาสตร์ข้อมูล

- ฐานข้อมูล

- ความล่าช้า

- ทั้งนี้ขึ้นอยู่กับ

- การตรวจพบ

- พัฒนาการ

- ต่าง

- โดยตรง

- แสดง

- ลง

- คนขับรถ

- หล่น

- อย่างง่ายดาย

- ระบบนิเวศ

- บรรณาธิการ

- ทำให้สามารถ

- การเปิดใช้งาน

- วิศวกร

- ชั้นเยี่ยม

- เข้าสู่

- Enterprise

- ตัวอย่าง

- ยกเว้น

- การปฏิบัติ

- ประสบการณ์

- สำรวจ

- ครอบครัว

- ลักษณะ

- คุณสมบัติ

- ค่าธรรมเนียม

- เงินทุน

- ชื่อจริง

- ความยืดหยุ่น

- ไหล

- ดังต่อไปนี้

- รูป

- การหลอกลวง

- เต็ม

- สร้าง

- รุ่น

- ดี

- การกำกับดูแล

- บัญชีกลุ่ม

- การดูแลสุขภาพ

- ช่วย

- สรุป ความน่าเชื่อถือของ Olymp Trade?

- HTTPS

- เอกลักษณ์

- การดำเนินการ

- สำคัญ

- การนำเข้า

- รวมทั้ง

- อุตสาหกรรม

- ข้อมูล

- ข้อมูลเชิงลึก

- Intelligence

- อยากเรียนรู้

- อินเตอร์เฟซ

- การลงทุน

- ร่วมมือ

- IT

- งาน

- ร่วม

- เข้าร่วม

- ป้ายกำกับ

- ภาษา

- ล่าสุด

- นำ

- ชั้นนำ

- การเรียนรู้

- การให้กู้ยืมเงิน

- เงินให้กู้ยืม

- มอง

- เครื่อง

- เรียนรู้เครื่อง

- ผู้จัดการ

- การผลิต

- ML

- แบบ

- โมเดล

- ข้อมูลเพิ่มเติม

- หลาย

- โดยธรรมชาติ

- ธรรมชาติ

- การเดินเรือ

- คุณสมบัติใหม่

- สมุดบันทึก

- เสนอ

- ออฟไลน์

- ออนไลน์

- ตัวเลือกเสริม (Option)

- Options

- ใบสั่ง

- ของตนเอง

- หุ้นส่วน

- พาร์ทเนอร์

- หลงใหล

- การชำระเงิน

- เปอร์เซ็นต์

- การปฏิบัติ

- ส่วนบุคคล

- ระยะ

- เวที

- นโยบาย

- การคาดการณ์

- ดูตัวอย่าง

- กระบวนการ

- ผลิตภัณฑ์

- ผลิตภัณฑ์

- การเขียนโปรแกรม

- โครงการ

- ให้

- การให้

- สาธารณะ

- วัตถุประสงค์

- อย่างรวดเร็ว

- ดิบ

- การอ่าน

- ลด

- รายงาน

- ต้องการ

- จำเป็นต้องใช้

- รับผิดชอบ

- วิ่ง

- ความปลอดภัย

- วิทยาศาสตร์

- นักวิทยาศาสตร์

- เลือก

- ชุด

- บริการ

- ชุด

- การตั้งค่า

- สำคัญ

- ง่าย

- ขนาด

- ซอฟต์แวร์

- การพัฒนาซอฟต์แวร์

- ทางออก

- โซลูชัน

- ช่องว่าง

- ใช้จ่าย

- การใช้จ่าย

- แยก

- กอง

- มาตรฐาน

- เริ่มต้น

- ข้อความที่เริ่ม

- คำแถลง

- Status

- การเก็บรักษา

- จัดเก็บ

- ยุทธศาสตร์

- แข็งแรง

- สตูดิโอ

- ประสบความสำเร็จ

- สนับสนุน

- เป้า

- ทีม

- ตลอด

- เวลา

- การฝึกอบรม

- แปลง

- การแปลง

- ui

- เป็นเอกลักษณ์

- บันทึก

- ใช้

- ความหลากหลาย

- ต่างๆ

- ในขณะที่

- ไม่มี

- งาน

- ทำงาน

- โรงงาน

- การเขียน