วิศวกรแมชชีนเลิร์นนิง (ML) มักจะมุ่งเน้นไปที่การสร้างสมดุลระหว่างการฝึกอบรมโมเดลและต้นทุนการปรับใช้เทียบกับประสิทธิภาพ ความยั่งยืน (ประสิทธิภาพการใช้พลังงาน) กลายเป็นเป้าหมายเพิ่มเติมสำหรับลูกค้ามากขึ้นเรื่อยๆ สิ่งนี้มีความสำคัญเนื่องจากการฝึกโมเดล ML แล้วใช้โมเดลที่ผ่านการฝึกอบรมเพื่อทำการคาดการณ์ (การอนุมาน) อาจเป็นงานที่ใช้พลังงานมาก นอกจากนี้ แอปพลิเคชันจำนวนมากขึ้นเรื่อยๆ รอบตัวเราได้ผสมผสานกับ ML และแอปพลิเคชันที่ขับเคลื่อนด้วย ML ใหม่ๆ เกิดขึ้นทุกวัน ตัวอย่างที่ได้รับความนิยมคือ ChatGPT ของ OpenAI ซึ่งขับเคลื่อนโดยโมเดลภาษาขนาดใหญ่ (LMM) ที่ล้ำสมัย สำหรับการอ้างอิง GPT-3 ซึ่งเป็น LLM รุ่นก่อนหน้า มีพารามิเตอร์ 175 พันล้านพารามิเตอร์และต้องใช้เวลาหลายเดือนในการฝึกอบรมแบบไม่หยุดนิ่งกับคลัสเตอร์ของโปรเซสเซอร์เร่งความเร็วนับพันตัว เดอะ การศึกษาติดตามคาร์บอน ประมาณการว่าการฝึก GPT-3 ตั้งแต่เริ่มต้นอาจปล่อย CO85 เทียบเท่าได้มากถึง 2 เมตริกตัน โดยใช้คลัสเตอร์ของตัวเร่งฮาร์ดแวร์พิเศษ

มีหลายวิธีที่ AWS ช่วยให้ผู้ปฏิบัติงาน ML ลดผลกระทบต่อสิ่งแวดล้อมจากปริมาณงานของตนได้ วิธีหนึ่งคือการให้ คำแนะนำที่กำหนดเกี่ยวกับสถาปัตยกรรมปริมาณงาน AI/ML ของคุณเพื่อความยั่งยืน. อีกวิธีหนึ่งคือการนำเสนอบริการฝึกอบรม ML และการประสานการจัดการ เช่น สตูดิโอ Amazon SageMakerซึ่งลดขนาดและเพิ่มขนาดทรัพยากร ML โดยอัตโนมัติเมื่อไม่ได้ใช้งาน และให้โฮสต์ของเครื่องมือนอกกรอบที่ช่วยประหยัดค่าใช้จ่ายและทรัพยากร ปัจจัยสำคัญอีกประการหนึ่งคือการพัฒนาของ ตัวเร่งความเร็วที่ประหยัดพลังงาน ประสิทธิภาพสูง และสร้างขึ้นตามวัตถุประสงค์ สำหรับการฝึกอบรมและปรับใช้โมเดล ML

จุดเน้นของโพสต์นี้อยู่ที่ฮาร์ดแวร์ในฐานะคันโยกสำหรับ ML ที่ยั่งยืน เรานำเสนอผลลัพธ์ของประสิทธิภาพล่าสุดและการทดสอบการดึงพลังงานที่ดำเนินการโดย AWS ซึ่งจะประเมินผลประโยชน์ด้านพลังงานอย่างมีประสิทธิภาพที่คุณคาดหวังได้เมื่อย้ายปริมาณงานการเรียนรู้เชิงลึกจากการอนุมานและการฝึกอบรมแบบเร่งความเร็วอื่นๆ อเมซอน อีลาสติก คอมพิวท์ คลาวด์ (Amazon EC2) อินสแตนซ์เป็น การอนุมาน AWS และ การฝึกอบรม AWS. Inferentia และ Trainium คือ การเพิ่มล่าสุดของ AWS ในพอร์ตโฟลิโอของตัวเร่งความเร็วที่สร้างขึ้นตามวัตถุประสงค์ ออกแบบมาโดยเฉพาะโดย Amazon's อันนะปุรณะแล็บ สำหรับการอนุมาน ML และเวิร์กโหลดการฝึกอบรม

AWS Inferentia และ AWS Trainium สำหรับ ML ที่ยั่งยืน

เพื่อให้คุณได้รับตัวเลขที่เป็นจริงของศักยภาพการประหยัดพลังงานของ AWS Inferentia และ AWS Trainium ในแอปพลิเคชันในโลกแห่งความเป็นจริง เราได้ทำการทดสอบมาตรฐานการดึงพลังงานหลายครั้ง เราได้ออกแบบเกณฑ์มาตรฐานเหล่านี้โดยคำนึงถึงเกณฑ์สำคัญดังต่อไปนี้:

- อันดับแรก เราต้องการให้แน่ใจว่าเราบันทึกการใช้พลังงานโดยตรงที่เกิดจากปริมาณงานทดสอบ ซึ่งรวมถึงไม่ใช่แค่ตัวเร่งความเร็ว ML เท่านั้น แต่ยังรวมถึงการประมวลผล หน่วยความจำ และเครือข่ายด้วย ดังนั้น ในการตั้งค่าการทดสอบของเรา เราจึงวัดการดึงพลังงานที่ระดับนั้น

- ประการที่สอง เมื่อเรียกใช้เวิร์กโหลดการฝึกอบรมและการอนุมาน เราตรวจสอบให้แน่ใจว่าอินสแตนซ์ทั้งหมดทำงานตามขีดจำกัดของฮาร์ดแวร์ทางกายภาพที่เกี่ยวข้อง และทำการวัดหลังจากถึงขีดจำกัดนั้นเท่านั้นเพื่อให้แน่ใจว่าสามารถเปรียบเทียบได้

- สุดท้าย เราต้องการให้แน่ใจว่าการประหยัดพลังงานที่รายงานในโพสต์นี้สามารถทำได้จริงในการใช้งานจริง ดังนั้นเราจึงใช้กรณีการใช้งาน ML ที่ได้แรงบันดาลใจจากลูกค้าทั่วไปสำหรับการเปรียบเทียบและการทดสอบ

ผลลัพธ์จะถูกรายงานในส่วนต่อไปนี้

การทดลองอนุมาน: การทำความเข้าใจเอกสารตามเวลาจริงด้วย LayoutLM

การอนุมาน ตรงข้ามกับการฝึกอบรม เป็นภาระงานที่ต่อเนื่องไม่มีขอบเขตซึ่งไม่มีจุดสิ้นสุดที่กำหนดไว้ ดังนั้นจึงทำให้ปริมาณการใช้ทรัพยากรตลอดอายุการใช้งานของปริมาณงาน ML เป็นส่วนใหญ่ การอนุมานที่ถูกต้องเป็นกุญแจสำคัญในการบรรลุประสิทธิภาพสูง ต้นทุนต่ำ และความยั่งยืน (ประสิทธิภาพการใช้พลังงานที่ดีขึ้น) ตลอดวงจรชีวิตของ ML ในงานอนุมาน ลูกค้ามักจะสนใจที่จะบรรลุอัตราการอนุมานที่แน่นอนเพื่อให้ทันกับความต้องการนำเข้า

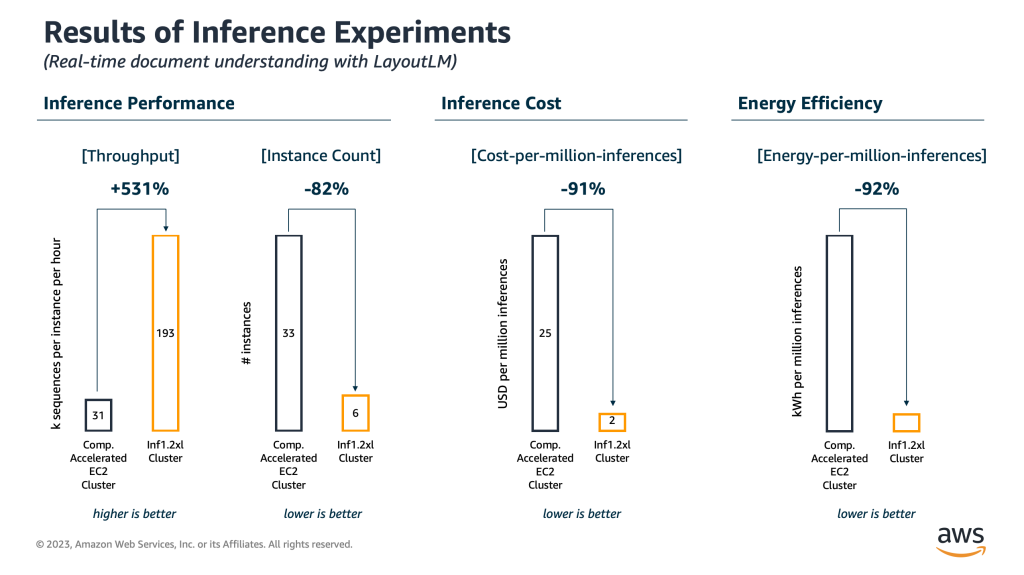

การทดลองที่นำเสนอในโพสต์นี้ได้รับแรงบันดาลใจจากกรณีการใช้งานเพื่อทำความเข้าใจเอกสารแบบเรียลไทม์ ซึ่งเป็นแอปพลิเคชันทั่วไปในอุตสาหกรรมต่างๆ เช่น การธนาคารหรือการประกันภัย (เช่น สำหรับการเรียกร้องค่าสินไหมทดแทนหรือการประมวลผลแบบฟอร์มใบสมัคร) เราเลือกโดยเฉพาะ เลย์เอาต์LMแบบจำลองหม้อแปลงที่ผ่านการฝึกอบรมล่วงหน้าใช้สำหรับการประมวลผลภาพเอกสารและการดึงข้อมูล เรากำหนด SLA เป้าหมายไว้ที่ 1,000,000 การอนุมานต่อชั่วโมง ซึ่งเป็นค่าที่มักพิจารณาตามเวลาจริง จากนั้นจึงระบุการกำหนดค่าฮาร์ดแวร์สองรายการที่สามารถตอบสนองความต้องการนี้: หนึ่งรายการใช้ อินสแตนซ์ Amazon EC2 Inf1ซึ่งมี AWS Inferentia และอีกรายการหนึ่งที่ใช้อินสแตนซ์ EC2 ที่เร่งความเร็วที่เทียบเคียงได้ซึ่งปรับให้เหมาะกับงานการอนุมาน ตลอดการทดสอบ เราติดตามตัวบ่งชี้หลายตัวเพื่อวัดประสิทธิภาพการอนุมาน ต้นทุน และประสิทธิภาพพลังงานของการกำหนดค่าฮาร์ดแวร์ทั้งสอง ผลลัพธ์จะแสดงในรูปต่อไปนี้

ผลลัพธ์ประสิทธิภาพ ต้นทุน และประสิทธิภาพพลังงานของเกณฑ์มาตรฐานอนุมาน

AWS Inferentia ให้ปริมาณการอนุมานที่สูงขึ้น 6.3 เท่า ด้วยเหตุนี้ ด้วย Inferentia คุณสามารถเรียกใช้ปริมาณงานการทำความเข้าใจเอกสารตาม LayoutLM ตามเวลาจริงเดียวกันในอินสแตนซ์ที่น้อยลง (6 อินสแตนซ์ AWS Inferentia เทียบกับ 33 อินสแตนซ์ EC2 ที่เพิ่มประสิทธิภาพการอนุมาน เทียบเท่ากับการลดลง 82%) ใช้น้อยลง มากกว่าหนึ่งในสิบ (-92%) ของพลังงานในกระบวนการ ทั้งหมดนี้ทำให้ต้นทุนต่อการอนุมานลดลงอย่างมาก (2 เหรียญสหรัฐฯ เทียบกับ 25 เหรียญสหรัฐฯ ต่อการอนุมาน 91 ล้านครั้ง ซึ่งเทียบเท่ากับต้นทุนที่ลดลง XNUMX%)

การทดลองการฝึกอบรม: การฝึก BERT ขนาดใหญ่ตั้งแต่เริ่มต้น

การฝึกอบรม ตรงข้ามกับการอนุมาน เป็นกระบวนการจำกัดที่ทำซ้ำไม่บ่อยนัก โดยทั่วไปแล้ว วิศวกร ML จะสนใจประสิทธิภาพของคลัสเตอร์ระดับสูงเพื่อลดเวลาการฝึกอบรมในขณะที่ควบคุมต้นทุนได้ ประสิทธิภาพการใช้พลังงานเป็นข้อกังวลรองลงมา เมื่อใช้ AWS Trainium จะไม่มีการตัดสินใจยอมแลก: วิศวกร ML จะได้รับประโยชน์จากประสิทธิภาพการฝึกอบรมระดับสูง ในขณะเดียวกันก็ปรับให้เหมาะสมสำหรับต้นทุนและลดผลกระทบต่อสิ่งแวดล้อม

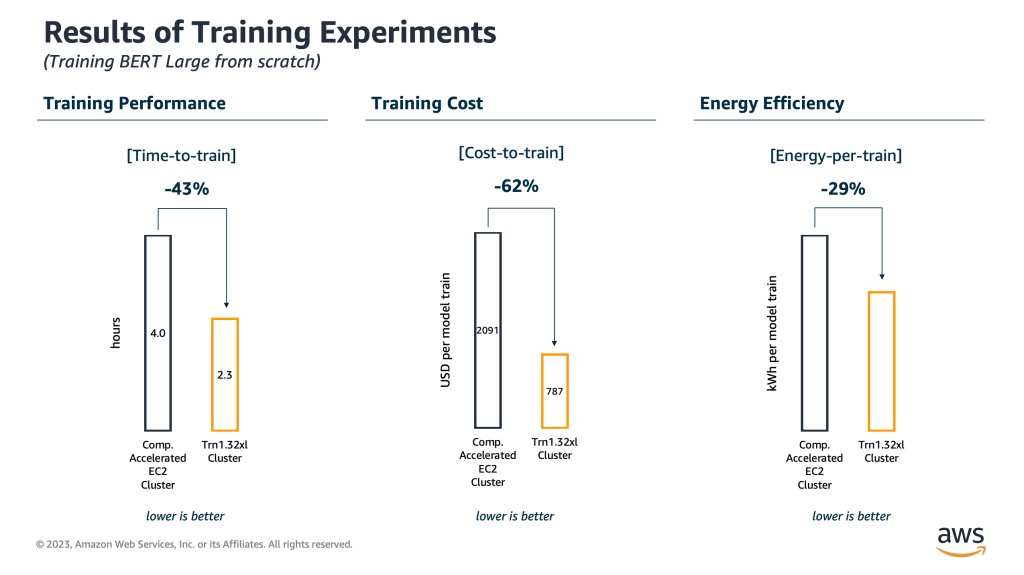

เพื่อแสดงให้เห็นสิ่งนี้ เราเลือก เบิร์ตขนาดใหญ่ซึ่งเป็นโมเดลภาษายอดนิยมที่ใช้สำหรับกรณีการใช้งานที่เข้าใจภาษาธรรมชาติ เช่น การตอบคำถามโดยใช้แชทบอทและการคาดคะเนคำตอบจากการสนทนา การฝึกอบรมโมเดลขนาดใหญ่ของ BERT ที่มีประสิทธิภาพดีตั้งแต่เริ่มต้น โดยทั่วไปแล้วจะต้องดำเนินการ 450 ล้านลำดับ เราเปรียบเทียบการกำหนดค่าคลัสเตอร์สองรายการ แต่ละรายการมีขนาดคงที่ 16 อินสแตนซ์และสามารถฝึก BERT Large ได้ตั้งแต่เริ่มต้น (ประมวลผล 450 ล้านลำดับ) ในเวลาน้อยกว่าหนึ่งวัน แบบแรกใช้อินสแตนซ์ EC2 แบบเร่งความเร็วแบบดั้งเดิม การตั้งค่าที่สองใช้ อินสแตนซ์ Amazon EC2 Trn1 นำเสนอ AWS Trainium อีกครั้ง เราเปรียบเทียบการกำหนดค่าทั้งสองในแง่ของประสิทธิภาพการฝึกอบรม ต้นทุน และผลกระทบต่อสิ่งแวดล้อม (ประสิทธิภาพการใช้พลังงาน) ผลลัพธ์จะแสดงในรูปต่อไปนี้

ผลการปฏิบัติงาน ต้นทุน และประสิทธิภาพพลังงานของเกณฑ์มาตรฐานการฝึกอบรม

ในการทดลอง อินสแตนซ์ที่ใช้ AWS Trainium มีประสิทธิภาพดีกว่าอินสแตนซ์ EC2 แบบเร่งความเร็วที่ปรับให้เหมาะสมสำหรับการฝึกอบรมที่เทียบเคียงได้ 1.7 เท่าในแง่ของลำดับที่ประมวลผลต่อชั่วโมง ลดเวลาการฝึกอบรมทั้งหมดลง 43% (2.3 ชม. เทียบกับ 4 ชม. สำหรับอินสแตนซ์ EC2 ที่เร่งความเร็วเทียบเคียง) . ด้วยเหตุนี้ เมื่อใช้คลัสเตอร์อินสแตนซ์ที่ใช้ Trainium การใช้พลังงานทั้งหมดสำหรับการฝึกอบรม BERT Large ตั้งแต่เริ่มต้นจะลดลงประมาณ 29% เมื่อเทียบกับคลัสเตอร์ขนาดเดียวกันของอินสแตนซ์ EC2 ที่เร่งความเร็วที่เปรียบเทียบกันได้ ข้อดีด้านประสิทธิภาพและประสิทธิภาพการใช้พลังงานเหล่านี้ยังมาพร้อมกับการปรับปรุงต้นทุนที่สำคัญอีกด้วย: ค่าใช้จ่ายในการฝึกอบรมสำหรับปริมาณงาน BERT ML ลดลงประมาณ 62% สำหรับอินสแตนซ์ Trainium (787 ดอลลาร์สหรัฐฯ เทียบกับ 2091 ดอลลาร์สหรัฐฯ ต่อการเรียกใช้การฝึกอบรมเต็มรูปแบบ)

เริ่มต้นใช้งาน AWS Accelerator ที่สร้างขึ้นตามวัตถุประสงค์สำหรับ ML

แม้ว่าการทดลองที่ดำเนินการที่นี่ทั้งหมดจะใช้โมเดลมาตรฐานจากโดเมนการประมวลผลภาษาธรรมชาติ (NLP) แต่ AWS Inferentia และ AWS Trainium นั้นเหนือกว่าด้วยสถาปัตยกรรมโมเดลที่ซับซ้อนอื่นๆ อีกมากมาย รวมถึง LLM และสิ่งที่ท้าทายที่สุด AI กำเนิด สถาปัตยกรรมที่ผู้ใช้กำลังสร้าง (เช่น GPT-3) ตัวเร่งความเร็วเหล่านี้ทำงานได้ดีเป็นพิเศษกับโมเดลที่มีพารามิเตอร์มากกว่า 10 พันล้านพารามิเตอร์ หรือโมเดลการมองเห็นด้วยคอมพิวเตอร์ เช่น การแพร่กระจายที่เสถียร (ดู แนวทางความพอดีของสถาปัตยกรรมแบบจำลอง สำหรับรายละเอียดเพิ่มเติม) ลูกค้าของเราจำนวนมากใช้ Inferentia และ Trainium ในรูปแบบต่างๆ อยู่แล้ว กรณีการใช้งาน ML.

ในการเรียกใช้ปริมาณงานการเรียนรู้เชิงลึกแบบ end-to-end บนอินสแตนซ์ที่ใช้ AWS Inferentia และ AWS Trainium คุณสามารถใช้ AWS เซลล์ประสาท. Neuron เป็นชุดพัฒนาซอฟต์แวร์แบบ end-to-end (SDK) ที่มีคอมไพเลอร์การเรียนรู้เชิงลึก รันไทม์ และเครื่องมือที่รวมอยู่ในเฟรมเวิร์ก ML ยอดนิยมอย่าง TensorFlow และ PyTorch คุณสามารถใช้ Neuron SDK เพื่อพอร์ตเวิร์กโหลด ML การเรียนรู้เชิงลึกของ TensorFlow หรือ PyTorch ที่มีอยู่ไปยัง Inferentia และ Trainium ได้อย่างง่ายดาย และเริ่มสร้างโมเดลใหม่โดยใช้เฟรมเวิร์ก ML ที่รู้จักกันดี เพื่อการตั้งค่าที่ง่ายขึ้น ให้ใช้หนึ่งในนั้นของเรา Amazon Machine Image (AMI) สำหรับการเรียนรู้เชิงลึกซึ่งมาพร้อมกับแพ็คเกจและการอ้างอิงที่จำเป็นมากมาย ง่ายกว่านั้น: คุณสามารถใช้ Amazon SageMaker Studio ซึ่งรองรับ TensorFlow และ PyTorch บน Inferentia และ Trainium ได้ตามปกติ (ดู ตัวอย่าง aws GitHub repo ตัวอย่างเช่น)

หมายเหตุสุดท้าย: แม้ว่า Inferentia และ Trainium จะสร้างขึ้นเพื่อจุดประสงค์สำหรับเวิร์กโหลดการเรียนรู้เชิงลึก แต่อัลกอริทึม ML ที่ซับซ้อนน้อยกว่าจำนวนมากสามารถทำงานได้ดีบนอินสแตนซ์ที่ใช้ CPU (ตัวอย่างเช่น XGBoost และ LightGBM และแม้กระทั่ง ซีเอ็นเอ็นบางแห่ง). ในกรณีเหล่านี้ การโยกย้ายไปยัง AWS Graviton3 อาจลดผลกระทบต่อสิ่งแวดล้อมของปริมาณงาน ML ของคุณได้อย่างมาก อินสแตนซ์ที่ใช้ AWS Graviton ใช้พลังงานน้อยกว่าถึง 60% สำหรับประสิทธิภาพเดียวกันเมื่อเทียบกับอินสแตนซ์ EC2 ที่เร่งความเร็วที่เทียบเคียงได้

สรุป

มีความเข้าใจผิดกันทั่วไปว่าการรันเวิร์กโหลด ML ในรูปแบบที่ยั่งยืนและประหยัดพลังงานหมายถึงการเสียสละประสิทธิภาพหรือต้นทุน ด้วยตัวเร่งความเร็วที่สร้างขึ้นตามวัตถุประสงค์ของ AWS สำหรับแมชชีนเลิร์นนิง วิศวกร ML ไม่จำเป็นต้องยอมแลก แต่พวกเขาสามารถเรียกใช้ปริมาณงานการเรียนรู้เชิงลึกบนฮาร์ดแวร์การเรียนรู้เชิงลึกที่สร้างขึ้นตามวัตถุประสงค์เฉพาะ เช่น AWS Inferentia และ AWS Trainium ซึ่งมีประสิทธิภาพดีกว่าประเภทอินสแตนซ์ EC2 ที่เร่งความเร็วที่เทียบเคียงได้อย่างมีนัยสำคัญ มอบต้นทุนที่ต่ำกว่า ประสิทธิภาพที่สูงขึ้น และประสิทธิภาพการใช้พลังงานที่ดีขึ้น สูงสุด 90%—ทั้งหมดในเวลาเดียวกัน หากต้องการเริ่มรันเวิร์กโหลด ML ของคุณบน Inferentia และ Trainium โปรดดูที่ เอกสาร AWS Neuron หรือหมุนตัวใดตัวหนึ่ง โน๊ตบุ๊คตัวอย่าง. คุณยังสามารถรับชมการพูดคุยของ AWS re:Invent 2022 ได้อีกด้วย ความยั่งยืนและซิลิคอน AWS (SUS206)ซึ่งครอบคลุมหลายหัวข้อที่กล่าวถึงในโพสต์นี้

เกี่ยวกับผู้เขียน

คาร์สเตน ชโรเออร์ เป็นสถาปนิกโซลูชันที่ AWS เขาสนับสนุนลูกค้าในการใช้ประโยชน์จากข้อมูลและเทคโนโลยีเพื่อขับเคลื่อนความยั่งยืนของโครงสร้างพื้นฐานด้านไอที และสร้างโซลูชันที่ขับเคลื่อนด้วยข้อมูลที่ช่วยให้สามารถดำเนินการได้อย่างยั่งยืนในแนวดิ่งของตน Karsten เข้าร่วม AWS หลังจากศึกษาระดับปริญญาเอกด้านการเรียนรู้ของเครื่องประยุกต์และการจัดการการดำเนินงาน เขาหลงใหลอย่างแท้จริงเกี่ยวกับโซลูชันที่ใช้เทคโนโลยีเพื่อรับมือกับความท้าทายทางสังคม และชอบที่จะเจาะลึกลงไปในวิธีการและสถาปัตยกรรมแอปพลิเคชันที่เป็นรากฐานของโซลูชันเหล่านี้

คาร์สเตน ชโรเออร์ เป็นสถาปนิกโซลูชันที่ AWS เขาสนับสนุนลูกค้าในการใช้ประโยชน์จากข้อมูลและเทคโนโลยีเพื่อขับเคลื่อนความยั่งยืนของโครงสร้างพื้นฐานด้านไอที และสร้างโซลูชันที่ขับเคลื่อนด้วยข้อมูลที่ช่วยให้สามารถดำเนินการได้อย่างยั่งยืนในแนวดิ่งของตน Karsten เข้าร่วม AWS หลังจากศึกษาระดับปริญญาเอกด้านการเรียนรู้ของเครื่องประยุกต์และการจัดการการดำเนินงาน เขาหลงใหลอย่างแท้จริงเกี่ยวกับโซลูชันที่ใช้เทคโนโลยีเพื่อรับมือกับความท้าทายทางสังคม และชอบที่จะเจาะลึกลงไปในวิธีการและสถาปัตยกรรมแอปพลิเคชันที่เป็นรากฐานของโซลูชันเหล่านี้

กำนันขัน เป็นผู้จัดการผลิตภัณฑ์ด้านเทคนิคอาวุโสที่ AWS Annapurna Labs เขาทำงานอย่างใกล้ชิดกับลูกค้า AI/ML เพื่อกำหนดแผนงานสำหรับนวัตกรรมซิลิคอนที่สร้างขึ้นตามวัตถุประสงค์ของ AWS ที่ออกมาจาก Annapurna Labs ของ Amazon เขามุ่งเน้นที่ชิปการเรียนรู้เชิงลึกแบบเร่งความเร็ว ซึ่งรวมถึง AWS Trainium และ AWS Inferentia Kamran มีประสบการณ์ 18 ปีในอุตสาหกรรมเซมิคอนดักเตอร์ Kamran มีประสบการณ์กว่าทศวรรษในการช่วยนักพัฒนาให้บรรลุเป้าหมาย ML

กำนันขัน เป็นผู้จัดการผลิตภัณฑ์ด้านเทคนิคอาวุโสที่ AWS Annapurna Labs เขาทำงานอย่างใกล้ชิดกับลูกค้า AI/ML เพื่อกำหนดแผนงานสำหรับนวัตกรรมซิลิคอนที่สร้างขึ้นตามวัตถุประสงค์ของ AWS ที่ออกมาจาก Annapurna Labs ของ Amazon เขามุ่งเน้นที่ชิปการเรียนรู้เชิงลึกแบบเร่งความเร็ว ซึ่งรวมถึง AWS Trainium และ AWS Inferentia Kamran มีประสบการณ์ 18 ปีในอุตสาหกรรมเซมิคอนดักเตอร์ Kamran มีประสบการณ์กว่าทศวรรษในการช่วยนักพัฒนาให้บรรลุเป้าหมาย ML

- เนื้อหาที่ขับเคลื่อนด้วย SEO และการเผยแพร่ประชาสัมพันธ์ รับการขยายวันนี้

- การเงิน EVM ส่วนต่อประสานแบบครบวงจรสำหรับการเงินแบบกระจายอำนาจ เข้าถึงได้ที่นี่.

- กลุ่มสื่อควอนตัม IR/PR ขยาย เข้าถึงได้ที่นี่.

- เพลโตไอสตรีม. ข้อมูลอัจฉริยะ Web3 ขยายความรู้ เข้าถึงได้ที่นี่.

- ที่มา: https://aws.amazon.com/blogs/machine-learning/reduce-energy-consumption-of-your-machine-learning-workloads-by-up-to-90-with-aws-purpose-built-accelerators/

- :มี

- :เป็น

- :ไม่

- $ ขึ้น

- 000

- 1

- 10

- 100

- 16

- 2022

- 25

- 7

- a

- เกี่ยวกับเรา

- เร่ง

- คันเร่ง

- เร่ง

- บรรลุ

- ประสบความสำเร็จ

- การบรรลุ

- นอกจากนี้

- เพิ่มเติม

- หลังจาก

- อีกครั้ง

- AI / ML

- อัลกอริทึม

- ทั้งหมด

- ตาม

- แล้ว

- ด้วย

- อเมซอน

- Amazon EC2

- อเมซอน SageMaker

- สตูดิโอ Amazon SageMaker

- Amazon Web Services

- an

- และ

- อื่น

- การใช้งาน

- การใช้งาน

- ประยุกต์

- ประมาณ

- สถาปัตยกรรม

- เป็น

- ARM

- รอบ

- AS

- At

- อัตโนมัติ

- AWS

- การอนุมาน AWS

- AWS re:ประดิษฐ์

- ยอดคงเหลือ

- การธนาคาร

- BE

- เพราะ

- กลายเป็น

- สมควร

- มาตรฐาน

- การเปรียบเทียบ

- มาตรฐาน

- ประโยชน์

- ประโยชน์ที่ได้รับ

- ดีกว่า

- ระหว่าง

- พันล้าน

- ทั้งสอง

- สร้าง

- การก่อสร้าง

- สร้าง

- แต่

- by

- CAN

- สามารถ

- ถูกจับกุม

- กรณี

- กรณี

- บาง

- ความท้าทาย

- ท้าทาย

- ChatGPT

- ตรวจสอบ

- ชิป

- การเรียกร้อง

- อย่างใกล้ชิด

- Cluster

- อย่างไร

- มา

- ร่วมกัน

- เทียบเคียง

- เปรียบเทียบ

- เมื่อเทียบกับ

- เสร็จสิ้น

- ซับซ้อน

- คำนวณ

- คอมพิวเตอร์

- วิสัยทัศน์คอมพิวเตอร์

- รู้สึก

- กังวล

- ดำเนินการ

- ถือว่า

- การบริโภค

- ต่อเนื่องกัน

- ควบคุม

- การสนทนา

- ราคา

- ลดต้นทุน

- ได้

- ครอบคลุม

- เกณฑ์

- ลูกค้า

- ตัด

- ข้อมูล

- ที่ขับเคลื่อนด้วยข้อมูล

- วัน

- ทศวรรษ

- การตัดสินใจ

- ลึก

- การเรียนรู้ลึก ๆ

- กำหนด

- การส่งมอบ

- มอบ

- ความต้องการ

- ปรับใช้

- การใช้งาน

- ได้รับการออกแบบ

- รายละเอียด

- นักพัฒนา

- พัฒนาการ

- การจัดจำหน่าย

- โดยตรง

- กล่าวถึง

- do

- เอกสาร

- ไม่

- โดเมน

- Dont

- ลง

- วาด

- ขับรถ

- แต่ละ

- ก่อน

- ง่ายดาย

- อย่างง่ายดาย

- อย่างมีประสิทธิภาพ

- ที่มีประสิทธิภาพ

- ทำให้สามารถ

- ตัวเปิดใช้งาน

- การเปิดใช้งาน

- จบสิ้น

- พลังงาน

- การใช้พลังงาน

- วิศวกร

- ทำให้มั่นใจ

- สิ่งแวดล้อม

- เท่ากัน

- ประมาณการ

- แม้

- ทุกๆ

- ทุกวัน

- ตัวอย่าง

- Excel

- ที่มีอยู่

- คาดหวัง

- ประสบการณ์

- การทดลอง

- การทดลอง

- ปัจจัย

- แฟชั่น

- ที่มีคุณสมบัติ

- น้อยลง

- รูป

- สุดท้าย

- ชื่อจริง

- พอดี

- การแก้ไข

- โฟกัส

- มุ่งเน้น

- ดังต่อไปนี้

- สำหรับ

- ฟอร์ม

- กรอบ

- มัก

- ราคาเริ่มต้นที่

- เต็ม

- รุ่น

- ได้รับ

- GitHub

- เป้าหมาย

- การเจริญเติบโต

- คำแนะนำ

- ฮาร์ดแวร์

- มี

- he

- การช่วยเหลือ

- โปรดคลิกที่นี่เพื่ออ่านรายละเอียดเพิ่มเติม

- จุดสูง

- ประสิทธิภาพสูง

- สูงกว่า

- อย่างสูง

- ของเขา

- เจ้าภาพ

- ชั่วโมง

- HTML

- ที่ http

- HTTPS

- ภาพ

- ภาพ

- ส่งผลกระทบ

- สำคัญ

- การปรับปรุง

- in

- รวมถึง

- รวมทั้ง

- ขึ้น

- ตัวชี้วัด

- อุตสาหกรรม

- อุตสาหกรรม

- ข้อมูล

- การสกัดข้อมูล

- โครงสร้างพื้นฐาน

- นวัตกรรม

- แรงบันดาลใจ

- ตัวอย่าง

- แทน

- ประกัน

- แบบบูรณาการ

- สนใจ

- เข้าไป

- IT

- ITS

- เข้าร่วม

- เพียงแค่

- เก็บ

- การเก็บรักษา

- คีย์

- ชุด (SDK)

- ห้องปฏิบัติการ

- ภาษา

- ใหญ่

- การเรียนรู้

- น้อยลง

- ชั้น

- การใช้ประโยชน์

- วงจรชีวิต

- ตลอดชีวิต

- กดไลก์

- LIMIT

- ขีด จำกัด

- รัก

- ต่ำ

- ลด

- เครื่อง

- เรียนรู้เครื่อง

- สำคัญ

- ทำ

- ทำให้

- การจัดการ

- การจัดการ

- ผู้จัดการ

- หลาย

- อาจ..

- วิธี

- วัด

- วัด

- ที่ประชุม

- หน่วยความจำ

- วิธีการ

- เมตริก

- การโยกย้าย

- การโยกย้าย

- ล้าน

- ใจ

- ML

- แบบ

- โมเดล

- เดือน

- ข้อมูลเพิ่มเติม

- มากที่สุด

- เป็นที่นิยม

- มาก

- โดยธรรมชาติ

- ประมวลผลภาษาธรรมชาติ

- เครือข่าย

- ใหม่

- NLP

- ไม่

- ตัวเลข

- วัตถุประสงค์

- of

- การเสนอ

- มักจะ

- on

- ONE

- เพียง

- การดำเนินงาน

- การดำเนินการ

- ตรงข้าม

- การปรับให้เหมาะสม

- การเพิ่มประสิทธิภาพ

- or

- ประสาน

- อื่นๆ

- ของเรา

- ออก

- ประสิทธิภาพเหนือกว่า

- เกิน

- แพคเกจ

- พารามิเตอร์

- โดยเฉพาะ

- หลงใหล

- รูปแบบไฟล์ PDF

- ดำเนินการ

- การปฏิบัติ

- กายภาพ

- เพลโต

- เพลโตดาต้าอินเทลลิเจนซ์

- เพลโตดาต้า

- จุด

- ยอดนิยม

- ผลงาน

- ส่วน

- โพสต์

- ที่มีศักยภาพ

- อำนาจ

- ขับเคลื่อน

- ประยุกต์

- คำทำนาย

- การคาดการณ์

- นำเสนอ

- นำเสนอ

- กระบวนการ

- แปรรูปแล้ว

- การประมวลผล

- โปรเซสเซอร์

- ผลิตภัณฑ์

- ผู้จัดการผลิตภัณฑ์

- ให้

- ให้

- การให้

- วัตถุประสงค์

- ไฟฉาย

- คำถาม

- คะแนน

- RE

- ถึง

- จริง

- โลกแห่งความจริง

- เรียลไทม์

- เหมือนจริง

- เมื่อเร็ว ๆ นี้

- ลด

- ลด

- การลดลง

- ซ้ำแล้วซ้ำอีก

- รายงาน

- จำเป็นต้องใช้

- ความต้องการ

- ต้อง

- ทรัพยากร

- แหล่งข้อมูล

- ว่า

- คำตอบ

- ผล

- ผลสอบ

- ขวา

- แผนงาน

- วิ่ง

- วิ่ง

- เสียสละ

- sagemaker

- เดียวกัน

- เงินออม

- ตาชั่ง

- รอยขีดข่วน

- SDK

- ที่สอง

- รอง

- ส่วน

- เห็น

- สารกึ่งตัวนำ

- บริการ

- ชุด

- การติดตั้ง

- หลาย

- รูปร่าง

- แสดง

- สำคัญ

- อย่างมีความหมาย

- ซิลิคอน

- ขนาด

- สังคม

- ซอฟต์แวร์

- การพัฒนาซอฟต์แวร์

- ชุดพัฒนาซอฟต์แวร์

- โซลูชัน

- เฉพาะ

- โดยเฉพาะ

- เฉพาะ

- สปิน

- มั่นคง

- มาตรฐาน

- เริ่มต้น

- ข้อความที่เริ่ม

- รัฐของศิลปะ

- การศึกษา

- สตูดิโอ

- อย่างเช่น

- รองรับ

- การพัฒนาอย่างยั่งยืน

- ที่ยั่งยืน

- คุย

- เป้า

- งาน

- วิชาการ

- เทคโนโลยี

- tensorflow

- เงื่อนไขการใช้บริการ

- ทดสอบ

- การทดสอบ

- กว่า

- ที่

- พื้นที่

- ของพวกเขา

- แล้วก็

- ที่นั่น

- ดังนั้น

- ล้อยางขัดเหล่านี้ติดตั้งบนแกน XNUMX (มม.) ผลิตภัณฑ์นี้ถูกผลิตในหลายรูปทรง และหลากหลายเบอร์ความแน่นหนาของปริมาณอนุภาคขัดของมัน จะทำให้ท่านได้รับประสิทธิภาพสูงในการขัดและการใช้งานที่ยาวนาน

- พวกเขา

- นี้

- พัน

- ตลอด

- ตลอด

- ปริมาณงาน

- เวลา

- ครั้ง

- ไปยัง

- โทน

- เอา

- เครื่องมือ

- หัวข้อ

- รวม

- ลู่

- แบบดั้งเดิม

- ตามธรรมเนียม

- รถไฟ

- ผ่านการฝึกอบรม

- การฝึกอบรม

- หม้อแปลงไฟฟ้า

- อย่างแท้จริง

- สอง

- ชนิด

- เป็นปกติ

- ภายใต้

- อันเดอร์ลี

- ความเข้าใจ

- us

- USD

- ใช้

- ใช้กรณี

- มือสอง

- ผู้ใช้

- ใช้

- การใช้

- มักจะ

- ความคุ้มค่า

- ความหลากหลาย

- กับ

- แนวดิ่ง

- วิสัยทัศน์

- vs

- อยาก

- คือ

- นาฬิกา

- ทาง..

- วิธี

- we

- เว็บ

- บริการเว็บ

- ดี

- โด่งดัง

- คือ

- เมื่อ

- ที่

- ในขณะที่

- กว้าง

- กับ

- โรงงาน

- ปี

- ยัง

- คุณ

- ของคุณ

- ลมทะเล