ในภารกิจของเราในการจำกัดศักยภาพในการทำลายล้างของปัญญาประดิษฐ์ บทความใหม่ของมหาวิทยาลัยเคมบริดจ์ได้แนะนำให้อบสวิตช์ฆ่าและการล็อกระยะไกล เช่นเดียวกับที่พัฒนาขึ้นเพื่อหยุดการยิงอาวุธนิวเคลียร์โดยไม่ได้รับอนุญาต เข้าไปในฮาร์ดแวร์ที่ขับเคลื่อนมัน

กระดาษ [รูปแบบไฟล์ PDF] ซึ่งรวมถึงเสียงจากสถาบันการศึกษาหลายแห่งและอีกหลายแห่งจาก OpenAI ทำให้กรณีที่การควบคุมฮาร์ดแวร์ที่โมเดลเหล่านี้ใช้อาจเป็นวิธีที่ดีที่สุดในการป้องกันการใช้งานในทางที่ผิด

“การประมวลผลที่เกี่ยวข้องกับ AI เป็นจุดแทรกแซงที่มีประสิทธิภาพเป็นพิเศษ โดยสามารถตรวจจับได้ แยกส่วนได้ และวัดปริมาณได้ และผลิตผ่านห่วงโซ่อุปทานที่มีความเข้มข้นสูง” นักวิจัยโต้แย้ง

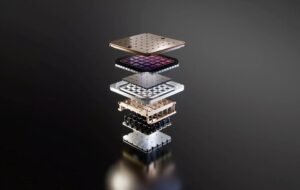

การฝึกอบรมโมเดลที่มีประสิทธิผลมากที่สุด ซึ่งเชื่อว่ามีเกินพารามิเตอร์ล้านล้านนั้น ต้องใช้โครงสร้างพื้นฐานทางกายภาพจำนวนมหาศาล เช่น GPU หรือตัวเร่งความเร็วนับหมื่นตัว และใช้เวลาในการประมวลผลนานหลายสัปดาห์หรือหลายเดือน นักวิจัยกล่าวว่าสิ่งนี้ทำให้การดำรงอยู่และประสิทธิภาพสัมพัทธ์ของทรัพยากรเหล่านี้ยากที่จะซ่อน

ยิ่งไปกว่านั้น ชิปที่ทันสมัยที่สุดที่ใช้ในการฝึกโมเดลเหล่านี้ผลิตโดยบริษัทจำนวนไม่มาก เช่น Nvidia, AMD และ Intel ซึ่งช่วยให้ผู้กำหนดนโยบายจำกัดการขายสินค้าเหล่านี้ให้กับบุคคลหรือประเทศที่น่ากังวลได้

ปัจจัยเหล่านี้ พร้อมด้วยข้อจำกัดอื่นๆ เช่น ข้อจำกัดของห่วงโซ่อุปทานในการผลิตเซมิคอนดักเตอร์ ทำให้ผู้กำหนดนโยบายมีวิธีทำความเข้าใจได้ดีขึ้นว่าโครงสร้างพื้นฐาน AI ถูกนำไปใช้อย่างไรและที่ไหน ใครบ้างที่ไม่ได้รับอนุญาตและไม่ได้รับอนุญาตให้เข้าถึงโครงสร้างพื้นฐาน และบังคับใช้บทลงโทษสำหรับการใช้งานในทางที่ผิด .

การควบคุมโครงสร้างพื้นฐาน

บทความนี้เน้นย้ำถึงวิธีการต่างๆ มากมายที่ผู้กำหนดนโยบายอาจใช้การควบคุมฮาร์ดแวร์ AI คำแนะนำมากมาย รวมถึงข้อเสนอแนะที่ออกแบบมาเพื่อปรับปรุงการมองเห็นและจำกัดการขายเครื่องเร่งความเร็ว AI กำลังแสดงออกมาในระดับชาติแล้ว

ปีที่แล้ว โจ ไบเดน ประธานาธิบดีสหรัฐฯ เสนอข้อเรียกร้อง คำสั่งของผู้บริหาร มุ่งเป้าไปที่การระบุบริษัทที่กำลังพัฒนาโมเดล AI แบบใช้คู่ขนาดใหญ่ รวมถึงผู้จำหน่ายโครงสร้างพื้นฐานที่มีความสามารถ ฝึกอบรมพวกเขา. หากคุณไม่คุ้นเคย “การใช้สองทาง” หมายถึงเทคโนโลยีที่สามารถรองรับหน้าที่สองเท่าในการใช้งานทั้งทางพลเรือนและการทหาร

ล่าสุดกระทรวงพาณิชย์สหรัฐฯ เสนอ กฎระเบียบที่จะกำหนดให้ผู้ให้บริการคลาวด์ในอเมริกาใช้นโยบาย "การรู้จักลูกค้าของคุณ" ที่เข้มงวดยิ่งขึ้น เพื่อป้องกันไม่ให้บุคคลหรือประเทศที่เป็นกังวลหลีกเลี่ยงข้อจำกัดในการส่งออก

นักวิจัยตั้งข้อสังเกตว่าทัศนวิสัยประเภทนี้มีค่า เนื่องจากสามารถช่วยหลีกเลี่ยงการแข่งขันทางอาวุธครั้งใหม่ได้ เช่นเดียวกับที่เกิดจากการโต้เถียงเรื่องช่องว่างขีปนาวุธ ซึ่งรายงานที่ผิดพลาดนำไปสู่การสร้างขีปนาวุธจำนวนมหาศาล แม้ว่าจะมีคุณค่า แต่พวกเขาเตือนว่าการดำเนินการตามข้อกำหนดการรายงานเหล่านี้มีความเสี่ยงที่จะบุกรุกความเป็นส่วนตัวของลูกค้าและอาจนำไปสู่ข้อมูลที่ละเอียดอ่อนรั่วไหลได้

ขณะเดียวกันในด้านการค้า กระทรวงพาณิชย์ยังคงดำเนินการต่อไป ก้าวขึ้น ข้อจำกัด การจำกัดประสิทธิภาพของตัวเร่งความเร็วที่ขายให้กับจีน แต่ดังที่เราได้รายงานไปก่อนหน้านี้ แม้ว่าความพยายามเหล่านี้จะทำให้ประเทศต่างๆ เช่น จีน เข้าถึงชิปของอเมริกาได้ยากขึ้น แต่พวกเขาก็ยังห่างไกลจากความสมบูรณ์แบบ

เพื่อแก้ไขข้อจำกัดเหล่านี้ นักวิจัยได้เสนอให้ดำเนินการลงทะเบียนทั่วโลกสำหรับการขายชิป AI ซึ่งจะติดตามพวกเขาตลอดวงจรชีวิต แม้ว่าพวกเขาจะออกจากประเทศต้นทางแล้วก็ตาม พวกเขาแนะนำว่าการลงทะเบียนดังกล่าวสามารถรวมตัวระบุที่ไม่ซ้ำกันลงในแต่ละชิป ซึ่งสามารถช่วยในการต่อสู้ได้ ลักลอบขน ของส่วนประกอบ

ในตอนท้ายของสเปกตรัม นักวิจัยได้แนะนำว่า Kill Switch สามารถฝังลงในซิลิคอนได้ เพื่อป้องกันการใช้งานในแอปพลิเคชันที่เป็นอันตราย

ตามทฤษฎีแล้ว สิ่งนี้อาจช่วยให้หน่วยงานกำกับดูแลสามารถตอบสนองได้เร็วขึ้นต่อการใช้เทคโนโลยีที่มีความละเอียดอ่อนโดยการตัดการเข้าถึงชิปจากระยะไกล แต่ผู้เขียนเตือนว่าการทำเช่นนี้ไม่ได้ปราศจากความเสี่ยง ความหมายคือหากใช้งานไม่ถูกต้อง Kill Switch ดังกล่าวอาจกลายเป็นเป้าหมายของอาชญากรไซเบอร์ได้

ข้อเสนออีกข้อหนึ่งกำหนดให้หลายฝ่ายลงนามในภารกิจการฝึกอบรม AI ที่อาจมีความเสี่ยงก่อนจึงจะสามารถนำไปใช้งานในวงกว้างได้ “อาวุธนิวเคลียร์ใช้กลไกที่คล้ายกันที่เรียกว่าการเชื่อมโยงการกระทำที่อนุญาต” พวกเขาเขียน

สำหรับอาวุธนิวเคลียร์ ล็อคเพื่อความปลอดภัยเหล่านี้ได้รับการออกแบบมาเพื่อป้องกันไม่ให้บุคคลหนึ่งคนโกงและโจมตีครั้งแรก อย่างไรก็ตาม สำหรับ AI แนวคิดก็คือ หากบุคคลหรือบริษัทต้องการฝึกอบรมโมเดลที่เกินเกณฑ์ที่กำหนดในระบบคลาวด์ พวกเขาจะต้องได้รับอนุญาตก่อนจึงจะทำเช่นนั้นได้

แม้ว่าจะเป็นเครื่องมือที่มีศักยภาพ แต่นักวิจัยตั้งข้อสังเกตว่าสิ่งนี้อาจส่งผลย้อนกลับโดยป้องกันการพัฒนา AI ที่พึงประสงค์ ข้อโต้แย้งดูเหมือนจะเป็นว่าแม้ว่าการใช้อาวุธนิวเคลียร์จะให้ผลลัพธ์ที่ค่อนข้างชัดเจน แต่ AI ก็ไม่ได้ขาวหรือดำเสมอไป

แต่หากสิ่งนี้ให้ความรู้สึกที่ผิดเพี้ยนไปสำหรับรสนิยมของคุณ บทความนี้จะอุทิศทั้งส่วนในการจัดสรรทรัพยากร AI เพื่อทำให้สังคมโดยรวมดีขึ้น แนวคิดที่ว่าผู้กำหนดนโยบายสามารถรวมตัวกันเพื่อทำให้การประมวลผล AI เข้าถึงได้มากขึ้นสำหรับกลุ่มที่ไม่น่าจะนำไปใช้เพื่อความชั่วร้าย แนวคิดที่อธิบายว่าเป็น "การจัดสรร"

เกิดอะไรขึ้นกับการควบคุมการพัฒนา AI?

ทำไมต้องไปเจอปัญหาทั้งหมดนี้? ผู้เขียนรายงานระบุว่าฮาร์ดแวร์ทางกายภาพนั้นควบคุมได้ง่ายกว่าโดยธรรมชาติ

เมื่อเปรียบเทียบกับฮาร์ดแวร์ “อินพุตและเอาท์พุตอื่นๆ ของการพัฒนา AI – ข้อมูล อัลกอริธึม และโมเดลที่ได้รับการฝึกอบรม – สามารถแชร์ได้อย่างง่ายดาย สินค้าที่จับต้องไม่ได้ที่ไม่มีคู่แข่ง ทำให้ยากต่อการควบคุมโดยธรรมชาติ” รายงานระบุ

ข้อโต้แย้งก็คือว่าเมื่อมีการเผยแพร่แบบจำลอง ไม่ว่าจะในที่เปิดเผยหรือรั่วไหล จะไม่มีการนำจินนี่กลับเข้าไปในขวดและหยุดการแพร่กระจายของมันไปทั่วอินเทอร์เน็ต

นักวิจัยยังเน้นย้ำว่าความพยายามในการป้องกันการใช้แบบจำลองในทางที่ผิดได้รับการพิสูจน์แล้วว่าไม่น่าเชื่อถือ ในตัวอย่างหนึ่ง ผู้เขียนได้เน้นย้ำถึงความสะดวกที่นักวิจัยสามารถรื้อระบบป้องกันใน Meta's Llama 2 ได้ ซึ่งมีจุดประสงค์เพื่อป้องกันไม่ให้แบบจำลองสร้างภาษาที่ไม่เหมาะสม

เมื่อพิจารณาถึงขีดสุดแล้ว เป็นที่เกรงกันว่าอาจใช้แบบจำลองการใช้งานสองทางขั้นสูงที่เพียงพอเพื่อเร่งความเร็วได้ พัฒนาการ ของอาวุธเคมีหรือชีวภาพ

เอกสารฉบับนี้ยอมรับว่าการควบคุมฮาร์ดแวร์ AI ไม่ใช่ประเด็นสำคัญ และไม่ได้ขจัดความจำเป็นในการควบคุมในด้านอื่นๆ ของอุตสาหกรรม

อย่างไรก็ตาม การมีส่วนร่วมของนักวิจัย OpenAI หลายคนนั้นยากที่จะเพิกเฉยเมื่อพิจารณาจาก CEO Sam Altman ความพยายามในการ เพื่อควบคุมการเล่าเรื่องเกี่ยวกับกฎระเบียบของ AI ®

- เนื้อหาที่ขับเคลื่อนด้วย SEO และการเผยแพร่ประชาสัมพันธ์ รับการขยายวันนี้

- PlatoData.Network Vertical Generative Ai เพิ่มพลังให้กับตัวเอง เข้าถึงได้ที่นี่.

- เพลโตไอสตรีม. Web3 อัจฉริยะ ขยายความรู้ เข้าถึงได้ที่นี่.

- เพลโตESG. คาร์บอน, คลีนเทค, พลังงาน, สิ่งแวดล้อม แสงอาทิตย์, การจัดการของเสีย. เข้าถึงได้ที่นี่.

- เพลโตสุขภาพ เทคโนโลยีชีวภาพและข่าวกรองการทดลองทางคลินิก เข้าถึงได้ที่นี่.

- ที่มา: https://go.theregister.com/feed/www.theregister.com/2024/02/16/boffins_propose_regulating_ai_hardware/

- :มี

- :เป็น

- :ไม่

- :ที่ไหน

- $ ขึ้น

- 7

- a

- สามารถ

- ละเมิด

- AC

- นักวิชาการ

- เร่งความเร็ว

- เร่ง

- เข้า

- สามารถเข้าถึงได้

- ข้าม

- การกระทำ

- ที่อยู่

- สูง

- หลังจาก

- AI

- โมเดล AI

- การฝึกอบรม AI

- มีวัตถุประสงค์เพื่อ

- อัลกอริทึม

- ทั้งหมด

- การจัดสรร

- อนุญาต

- อนุญาตให้

- การอนุญาต

- ตาม

- แล้ว

- ด้วย

- เสมอ

- เอเอ็มดี

- อเมริกัน

- an

- และ

- อื่น

- การใช้งาน

- เข้าใกล้

- เป็น

- เถียง

- อาร์กิวเมนต์

- อาวุธ

- รอบ

- เทียม

- ปัญญาประดิษฐ์

- AS

- ด้าน

- At

- การอนุญาต

- ผู้เขียน

- หลีกเลี่ยง

- กลับ

- BE

- กลายเป็น

- ก่อน

- กำลัง

- เชื่อว่า

- ที่ดีที่สุด

- ดีกว่า

- การดีขึ้น

- ไบเดน

- Black

- สร้าง

- แต่

- by

- ที่เรียกว่า

- เคมบริดจ์

- CAN

- สามารถ

- กรณี

- ผู้บริหารสูงสุด

- บาง

- โซ่

- สารเคมี

- สาธารณรัฐประชาชนจีน

- ชิป

- ชิป

- พลเรือน

- เมฆ

- CO

- การต่อสู้

- อย่างไร

- พาณิชย์

- บริษัท

- บริษัท

- ส่วนประกอบ

- คำนวณ

- จดจ่อ

- แนวคิด

- กังวล

- พิจารณา

- ข้อ จำกัด

- อย่างต่อเนื่อง

- ควบคุม

- การทะเลาะวิวาท

- ได้

- ประเทศ

- ประเทศ

- คอร์ส

- ลูกค้า

- ตัด

- อาชญากรไซเบอร์

- ข้อมูล

- แผนก

- นำไปใช้

- อธิบาย

- ได้รับการออกแบบ

- พัฒนา

- ที่กำลังพัฒนา

- พัฒนาการ

- ยาก

- do

- doesn

- การทำ

- สอง

- dystopian

- แต่ละ

- ความสะดวก

- ง่ายดาย

- อย่างง่ายดาย

- มีประสิทธิภาพ

- ความพยายาม

- ทั้ง

- กำจัด

- การจ้างงาน

- ปลาย

- บังคับใช้

- ทั้งหมด

- แม้

- ตัวอย่าง

- เกินกว่า

- การดำเนินงาน

- การดำรงอยู่

- ส่งออก

- สุดโต่ง

- อย่างยิ่ง

- ปัจจัย

- คุ้นเคย

- ไกล

- เร็วขึ้น

- กลัว

- รู้สึก

- ชื่อจริง

- สำหรับ

- ข้างหน้า

- ราคาเริ่มต้นที่

- ด้านหน้า

- ช่องว่าง

- การสร้าง

- มาร

- ได้รับ

- ได้รับ

- เหตุการณ์ที่

- Go

- ไป

- สินค้า

- GPUs

- กลุ่ม

- มือ

- ยาก

- ยาก

- ฮาร์ดแวร์

- มี

- ช่วย

- ซ่อน

- ไฮไลต์

- ไฮไลท์

- สรุป ความน่าเชื่อถือของ Olymp Trade?

- อย่างไรก็ตาม

- HTTPS

- ความคิด

- ระบุ

- ระบุ

- if

- ไม่สนใจ

- เวิ้งว้าง

- การดำเนินการ

- การดำเนินการ

- การดำเนินการ

- ปรับปรุง

- in

- ในอื่น ๆ

- รวมถึง

- รวมทั้ง

- รวมเข้าด้วยกัน

- อย่างไม่ถูกต้อง

- เป็นรายบุคคล

- อุตสาหกรรม

- โครงสร้างพื้นฐาน

- อย่างโดยเนื้อแท้

- ปัจจัยการผลิต

- สถาบัน

- ไม่มีตัวตน

- อินเทล

- Intelligence

- การแทรกแซง

- เข้าไป

- ISN

- IT

- ITS

- JOE

- Biden โจ

- jpg

- ฆ่า

- ชนิด

- ภาษา

- ใหญ่

- เปิดตัว

- การเปิดตัว

- นำ

- นำ

- ซ้าย

- ชั้น

- วงจรชีวิต

- กดไลก์

- LIMIT

- ข้อ จำกัด

- การ จำกัด

- การเชื่อมโยง

- น้อย

- ดูรายละเอียด

- ล็อค

- ทำ

- ทำ

- ทำให้

- การทำ

- ที่เป็นอันตราย

- การผลิต

- หลาย

- มาก

- อาจ..

- วิธี

- หมายความว่า

- กลไก

- Meta

- อาจ

- ทหาร

- การใช้งานทางทหาร

- ขีปนาวุธ

- ด่าว่า

- แบบ

- โมเดล

- เดือน

- ข้อมูลเพิ่มเติม

- มากที่สุด

- หลาย

- เล่าเรื่อง

- แห่งชาติ

- จำเป็นต้อง

- สุทธิ

- ใหม่

- ไม่

- หมายเหตุ

- นิวเคลียร์

- จำนวน

- มากมาย

- Nvidia

- สังเกต

- of

- ปิด

- น่ารังเกียจ

- เสนอ

- on

- ครั้งเดียว

- ONE

- เปิด

- OpenAI

- or

- ที่มา

- อื่นๆ

- ผลิตภัณฑ์อื่นๆ

- ของเรา

- ออก

- ผล

- เอาท์พุท

- เกิน

- กระดาษ

- พารามิเตอร์

- การมีส่วนร่วม

- โดยเฉพาะ

- คู่กรณี

- รูปแบบไฟล์ PDF

- บทลงโทษ

- สมบูรณ์

- การปฏิบัติ

- คน

- บุคคล

- กายภาพ

- เพลโต

- เพลโตดาต้าอินเทลลิเจนซ์

- เพลโตดาต้า

- เล่น

- จุด

- นโยบาย

- ผู้กำหนดนโยบาย

- มีพลัง

- ที่มีศักยภาพ

- ที่อาจเกิดขึ้น

- อำนาจ

- ประธาน

- ประธานาธิบดีโจไบเดน

- สวย

- ป้องกัน

- การป้องกัน

- ก่อนหน้านี้

- ความเป็นส่วนตัว

- การประมวลผล

- ผลิต

- อุดมสมบูรณ์

- ข้อเสนอ

- เสนอ

- ที่พิสูจน์แล้ว

- ผู้ให้บริการ

- การตีพิมพ์

- ใส่

- วาง

- เชิงปริมาณ

- การแสวงหา

- เชื่อชาติ

- RE

- เมื่อเร็ว ๆ นี้

- หมายถึง

- รีจิสทรี

- ควบคุม

- ควบคุม

- การควบคุม

- หน่วยงานกำกับดูแล

- ญาติ

- สัมพัทธ์

- วางใจ

- รีโมท

- จากระยะไกล

- รายงาน

- การรายงาน

- รายงาน

- ต้องการ

- ความต้องการ

- ต้อง

- นักวิจัย

- แหล่งข้อมูล

- ตอบสนอง

- จำกัด

- ข้อ จำกัด

- ความเสี่ยง

- ความเสี่ยง

- เสี่ยง

- s

- การป้องกัน

- การขาย

- ขาย

- แซม

- แซมอัลท์แมน

- กล่าว

- ขนาด

- Section

- ความปลอดภัย

- ดูเหมือนว่า

- สารกึ่งตัวนำ

- มีความละเอียดอ่อน

- ให้บริการ

- หลาย

- ลงชื่อ

- ซิลิคอน

- เงิน

- คล้ายคลึงกัน

- เล็ก

- So

- สังคม

- ขาย

- สเปกตรัม

- กระจาย

- เริ่มต้น

- หยุด

- การหยุด

- โขก

- เข้มงวด

- อย่างเช่น

- แนะนำ

- จัดหาอุปกรณ์

- ห่วงโซ่อุปทาน

- สวิตซ์

- เป้า

- งาน

- รสนิยม

- เทคโนโลยี

- เมตริกซ์

- ที่

- พื้นที่

- ของพวกเขา

- พวกเขา

- ทฤษฎี

- ที่นั่น

- ล้อยางขัดเหล่านี้ติดตั้งบนแกน XNUMX (มม.) ผลิตภัณฑ์นี้ถูกผลิตในหลายรูปทรง และหลากหลายเบอร์ความแน่นหนาของปริมาณอนุภาคขัดของมัน จะทำให้ท่านได้รับประสิทธิภาพสูงในการขัดและการใช้งานที่ยาวนาน

- พวกเขา

- นี้

- เหล่านั้น

- พัน

- ธรณีประตู

- เวลา

- ไปยัง

- ร่วมกัน

- เกินไป

- เครื่องมือ

- ลู่

- การค้า

- รถไฟ

- ผ่านการฝึกอบรม

- การฝึกอบรม

- ทริกเกอร์

- ล้านล้าน

- ปัญหา

- ไม่มีสิทธิ

- เข้าใจ

- เป็นเอกลักษณ์

- มหาวิทยาลัย

- มหาวิทยาลัยเคมบริดจ์

- ไม่แน่

- us

- ประธานาธิบดีสหรัฐฯ

- ใช้

- มือสอง

- มีคุณค่า

- Ve

- ผู้ขาย

- ผ่านทาง

- ความชัดเจน

- เสียงVO

- อยาก

- ทาง..

- วิธี

- we

- อาวุธ

- สัปดาห์ที่ผ่านมา

- ดี

- คือ

- ที่

- ในขณะที่

- ขาว

- WHO

- ทั้งหมด

- กับ

- ไม่มี

- จะ

- ผิด

- เขียน

- ปี

- คุณ

- ของคุณ

- ลมทะเล