Amazon Kavramak belgelerden varlıkları, anahtar sözcükleri, dili, duyguları ve diğer öngörüleri otomatik olarak çıkarmak için kullanabileceğiniz bir doğal dil işleme (NLP) hizmetidir. Örneğin, kişiler, yerler, ticari öğeler, tarihler ve miktarlar gibi varlıkları, Amazon Comprehend konsolu, AWS Komut Satırı Arayüzüya da Amazon Anlamak API'leri. Ayrıca, bir parçası olmayan varlıkları çıkarmanız gerekirse Amazon Comprehend yerleşik varlık türleri, özel bir varlık tanıma modeli oluşturabilirsiniz (olarak da bilinir) özel varlık tanıyıcı) bir ürün kataloğundaki öğelerin adları, etki alanına özgü tanımlayıcılar vb. gibi özel kullanım durumunuzla daha alakalı terimleri çıkarmak için. Makine öğrenimi kitaplıkları ve çerçevelerini kullanarak kendi başınıza doğru bir varlık tanıyıcı oluşturmak karmaşık ve zaman alıcı bir süreç olabilir. Amazon Comprehend, model eğitim çalışmanızı önemli ölçüde basitleştirir. Tek yapmanız gereken belge ve ek açıklamalardan oluşan veri kümenizi yüklemek ve modeli oluşturmak için Amazon Comprehend konsolunu, AWS CLI'yi veya API'leri kullanmaktır.

Özel bir varlık tanıyıcıyı eğitmek için Amazon Comprehend'e eğitim verilerini şu şekilde sağlayabilirsiniz: ek açıklamalar veya varlık listeleri. İlk durumda, bir belge koleksiyonu ve belgelerin kümesi içinde varlıkların oluştuğu yeri belirten açıklamaları içeren bir dosya sağlarsınız. Alternatif olarak, varlık listeleriyle, ilgili varlık türü etiketiyle birlikte varlıkların bir listesini ve varlıklarınızın bulunmasını beklediğiniz bir dizi açıklamasız belge sağlarsınız. Her iki yaklaşım da başarılı bir özel varlık tanıma modelini eğitmek için kullanılabilir; ancak, bir yöntemin daha iyi bir seçim olabileceği durumlar vardır. Örneğin, belirli varlıkların anlamı belirsiz ve bağlama bağlı olduğunda, ek açıklamaların sağlanması önerilir çünkü bu, varlıkları ayıklarken bağlamı daha iyi kullanabilen bir Amazon Anlama modeli oluşturmanıza yardımcı olabilir.

Belgelere açıklama eklemek oldukça fazla çaba ve zaman gerektirebilir, özellikle de açıklamaların hem kalitesinin hem de miktarının sonuçta ortaya çıkan varlık tanıma modeli üzerinde bir etkisi olduğunu düşünüyorsanız. Kesin olmayan veya çok az açıklama, kötü sonuçlara yol açabilir. Ek açıklamalar almak için bir süreç oluşturmanıza yardımcı olmak için aşağıdaki gibi araçlar sunuyoruz: Amazon SageMaker Yer GerçeğiBelgelerinize daha hızlı açıklama eklemek ve bir artırılmış bildirim ek açıklamaları dosyası. Ancak, Temel Gerçeği kullansanız bile, varlık tanıyıcınızı başarılı bir şekilde oluşturmak için eğitim veri kümenizin yeterince büyük olduğundan emin olmanız gerekir.

Bugüne kadar bir Amazon Comprehend özel varlık tanıyıcıyı eğitmeye başlamak için varlık türü başına en az 250 belge ve en az 100 ek açıklama sağlamanız gerekiyordu. Bugün, Amazon Comprehend'in temelindeki modellerde yapılan son iyileştirmeler sayesinde, bir tanıyıcıyı düz metin CSV ek açıklama dosyalarıyla eğitmek için minimum gereksinimleri azalttığımızı duyuruyoruz. Artık varlık türü başına en az üç belge ve 25 ek açıklama ile özel bir varlık tanıma modeli oluşturabilirsiniz. Yeni hizmet limitleri hakkında daha fazla bilgiyi şurada bulabilirsiniz: Yönergeler ve kotalar.

Bu azaltmanın özel bir varlık tanıyıcı oluşturmaya başlamanıza nasıl yardımcı olabileceğini göstermek için birkaç açık kaynaklı veri kümesi üzerinde bazı testler yaptık ve performans ölçümlerini topladık. Bu gönderide, karşılaştırmalı değerlendirme süreci ve alt örneklenmiş veri kümeleri üzerinde çalışırken elde ettiğimiz sonuçlar konusunda size yol gösteriyoruz.

Veri seti hazırlığı

Bu gönderide, açıklamalı belgeler kullanarak bir Amazon Comprehend özel varlık tanıyıcısını nasıl eğittiğimizi açıklıyoruz. Genel olarak, ek açıklamalar bir CSV dosyası, Bir Ground Truth tarafından oluşturulan artırılmış manifest dosyası, Ya da bir PDF dosyası. Yeni minimum gereksinimlerden etkilenen ek açıklama türü bu olduğundan, odak noktamız CSV düz metin ek açıklamalarıdır. CSV dosyaları aşağıdaki yapıya sahip olmalıdır:

İlgili alanlar aşağıdaki gibidir:

- fileto – Belgeleri içeren dosyanın adı

- çizgi – 0 satırından başlayarak varlığı içeren satırın numarası

- Başlamak Dengelemek – Giriş metnindeki (satırın başına göre) ilk karakterin 0 konumunda olduğu dikkate alınarak varlığın nerede başladığını gösteren karakter ofseti

- Ofseti Sonlandır – Varlığın nerede bittiğini gösteren giriş metnindeki karakter ofseti

- Tip – Tanımlamak istediğiniz varlık tipinin adı

Ek olarak, bu yaklaşımı kullanırken, her satırda bir belge veya dosya başına bir belge içeren .txt dosyaları olarak bir eğitim belgeleri koleksiyonu sağlamanız gerekir.

Testlerimiz için kullandık SNIPS Doğal Dil Anlama karşılaştırmasıyedi kullanıcı amacı (AddToPlaylist, BookRestaurant, GetWeather, PlayMusic, RateBook, SearchCreativeWork, SearchScreeningEvent). Veri seti, makale bağlamında 2018'de yayınlandı. Snips Voice Platform: özel tasarım ses arabirimleri için yerleşik bir Sözlü Dil Anlama sistemi Coucke, et al.

SNIPS veri kümesi, hem açıklamaları hem de ham metin dosyalarını yoğunlaştıran bir JSON dosyaları koleksiyonundan oluşur. Aşağıdaki, veri kümesinden bir pasajdır:

Varlık tanıyıcımızı oluşturmadan önce, SNIPS ek açıklamalarını ve ham metin dosyalarını bir CSV açıklama dosyasına ve bir .txt belge dosyasına dönüştürdük.

Aşağıdaki bizim bir alıntıdır annotations.csv Dosya:

Aşağıdaki bizim bir alıntıdır documents.txt Dosya:

Örnekleme yapılandırması ve kıyaslama süreci

Deneylerimiz için, SNIPS veri kümesinden varlık türlerinin bir alt kümesine odaklandık:

- KitapRestoran – Varlık türleri:

spatial_relation,poi,party_size_number,restaurant_name,city,timeRange,restaurant_type,served_dish,party_size_description,country,facility,state,sort,cuisine - Hava Durumu Al – Varlık türleri:

condition_temperature,current_location,geographic_poi,timeRange,state,spatial_relation,condition_description,city,country - Müzik çal – Varlık türleri:

track,artist,music_item,service,genre,sort,playlist,album,year

Ayrıca, eğitim için örneklenen belge sayısı ve varlık başına ek açıklama sayısı açısından farklı konfigürasyonlar elde etmek için her bir veri kümesini alt örnekledik (aynı zamanda çekim). Bu, her varlık türünün en az göründüğü alt örneklenmiş veri kümeleri oluşturmak için tasarlanmış özel bir komut dosyası kullanılarak yapıldı. k kez, minimum süre içinde n belgeler.

Her model, eğitim veri kümelerinin belirli bir alt örneği kullanılarak eğitildi; dokuz model konfigürasyonu aşağıdaki tabloda gösterilmektedir.

| Alt örneklenmiş veri kümesi adı | Eğitim için örneklenen belge sayısı | Test için örneklenen belge sayısı | Varlık türü (çekimler) başına ortalama açıklama sayısı |

snips-BookRestaurant-subsample-A |

132 | 17 | 33 |

snips-BookRestaurant-subsample-B |

257 | 33 | 64 |

snips-BookRestaurant-subsample-C |

508 | 64 | 128 |

snips-GetWeather-subsample-A |

91 | 12 | 25 |

snips-GetWeather-subsample-B |

185 | 24 | 49 |

snips-GetWeather-subsample-C |

361 | 46 | 95 |

snips-PlayMusic-subsample-A |

130 | 17 | 30 |

snips-PlayMusic-subsample-B |

254 | 32 | 60 |

snips-PlayMusic-subsample-C |

505 | 64 | 119 |

Modellerimizin doğruluğunu ölçmek için Amazon Comprehend'in bir varlık tanıyıcıyı eğitirken otomatik olarak hesapladığı değerlendirme ölçümlerini topladık:

- Hassas – Bu, tanıyıcı tarafından tespit edilen ve doğru şekilde tanımlanmış ve etiketlenmiş varlıkların oranını gösterir. Farklı bir bakış açısıyla, kesinlik şu şekilde tanımlanabilir: tp / (tp + fps), Burada tp gerçek pozitiflerin sayısıdır (doğru tanımlamalar) ve fp yanlış pozitiflerin sayısıdır (yanlış tanımlamalar).

- Geri çağırmak – Bu, belgelerde bulunan ve doğru şekilde tanımlanmış ve etiketlenmiş varlıkların oranını gösterir. şu şekilde hesaplanır tp / (tp + fn), Burada tp gerçek pozitiflerin sayısıdır ve fn yanlış negatiflerin sayısıdır (kaçırılan tanımlamalar).

- F1 skoru – Bu, modelin genel doğruluğunu ölçen kesinlik ve geri çağırma metriklerinin bir birleşimidir. F1 puanı, kesinlik ve geri çağırma metriklerinin harmonik ortalamasıdır ve şu şekilde hesaplanır: 2 * Hassas * Geri Çağırma / (Hassas + Geri Çağırma).

Varlık tanıyıcılarımızın performansını karşılaştırmak için F1 puanlarına odaklanıyoruz.

Bir veri seti ve bir alt örnek boyutu (belge ve çekim sayısı açısından) verildiğinde, farklı alt örnekler oluşturabileceğinizi göz önünde bulundurarak, dokuz konfigürasyonun her biri için 10 alt örnek oluşturduk, varlık tanıma modellerini eğittik, performans metriklerini topladık ve mikro ortalamayı kullanarak ortalamalarını aldı. Bu, özellikle az sayıdaki alt örnekler için daha kararlı sonuçlar elde etmemizi sağladı.

Sonuçlar

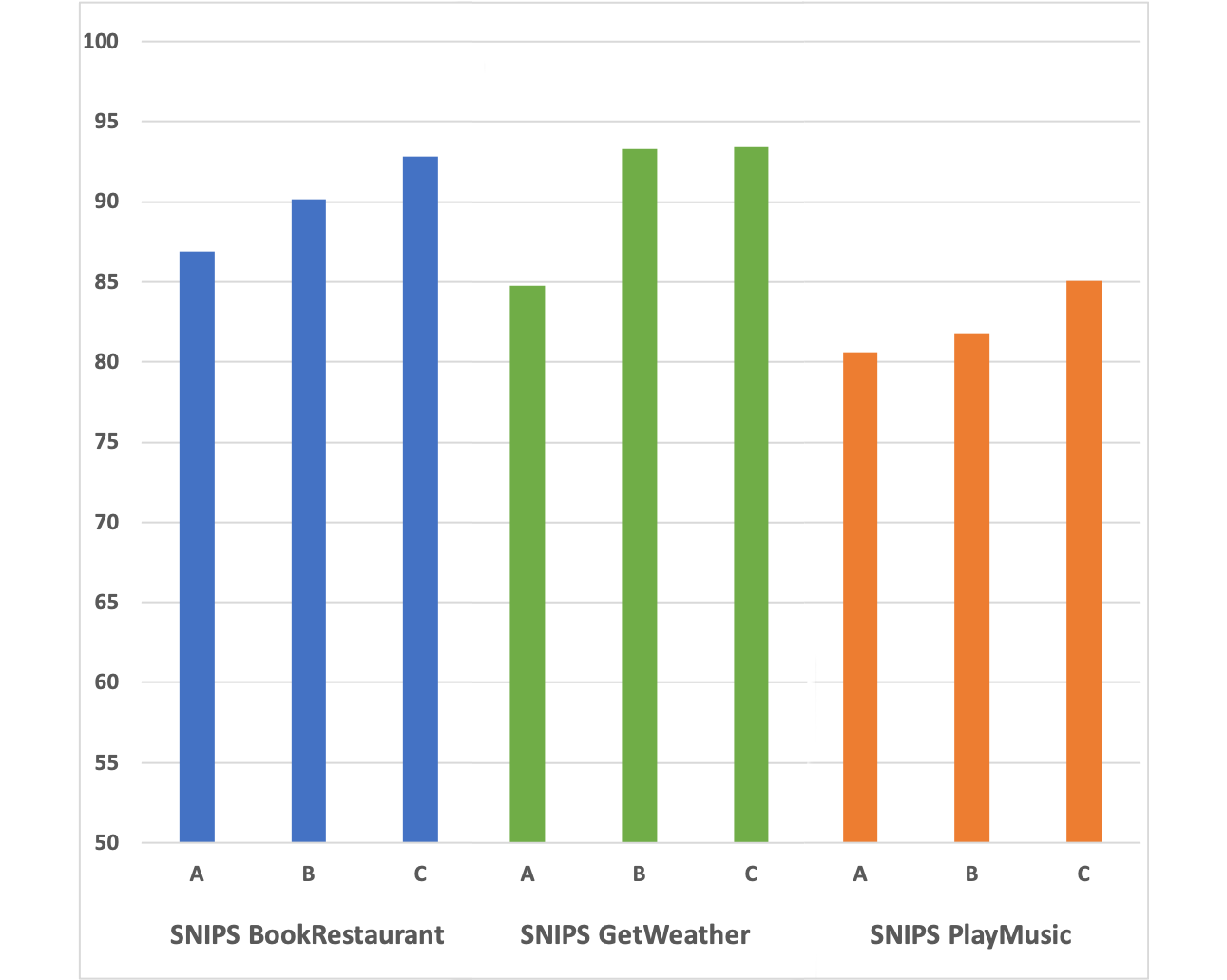

Aşağıdaki tablo, her varlık tanıyıcıyı eğittikten sonra Amazon Comprehend tarafından döndürülen performans ölçümlerinde hesaplanan mikro ortalamalı F1 puanlarını gösterir.

| Alt örneklenmiş veri kümesi adı | Varlık tanıyıcı mikro ortalamalı F1 puanı (%) |

snips-BookRestaurant-subsample-A |

86.89 |

snips-BookRestaurant-subsample-B |

90.18 |

snips-BookRestaurant-subsample-C |

92.84 |

snips-GetWeather-subsample-A |

84.73 |

snips-GetWeather-subsample-B |

93.27 |

snips-GetWeather-subsample-C |

93.43 |

snips-PlayMusic-subsample-A |

80.61 |

snips-PlayMusic-subsample-B |

81.80 |

snips-PlayMusic-subsample-C |

85.04 |

Aşağıdaki sütun grafiği, önceki bölümde açıklandığı gibi eğittiğimiz dokuz konfigürasyon için F1 puanlarının dağılımını göstermektedir.

Varlık türü başına en az 25 ek açıklama ile bile özel varlık tanıma modellerini başarıyla eğitebildiğimizi gözlemleyebiliriz. En küçük üç alt örneklenmiş veri kümesine odaklanırsak (snips-BookRestaurant-subsample-A, snips-GetWeather-subsample-A, ve snips-PlayMusic-subsample-A), kullandığımız sınırlı sayıda belge ve açıklama dikkate alındığında oldukça iyi bir sonuç olan ortalama olarak %1'lük bir F84 puanı elde edebildiğimizi görüyoruz. Modelimizin performansını iyileştirmek istiyorsak, ek belgeler ve açıklamalar toplayabilir ve daha fazla veri ile yeni bir model eğitebiliriz. Örneğin, orta büyüklükteki alt örneklerle (snips-BookRestaurant-subsample-B, snips-GetWeather-subsample-B, ve snips-PlayMusic-subsample-B), iki kat daha fazla belge ve ek açıklama içeren, ortalama olarak %1'lik bir F88 puanı elde ettik ( subsample-A veri kümeleri). Son olarak, daha büyük alt örneklenmiş veri kümeleri (snips-BookRestaurant-subsample-C, snips-GetWeather-subsample-C, ve snips-PlayMusic-subsample-C), daha da fazla açıklamalı veri içerir (bunun için kullanılan belge ve açıklama sayısının yaklaşık dört katı subsample-A veri kümeleri), ortalama F2 puanını %1'a yükselterek %90'lik bir iyileştirme daha sağladı.

Sonuç

Bu gönderide, Amazon Comprehend ile özel varlık tanıyıcı eğitimi için minimum gereksinimlerin azaltıldığını duyurduk ve bu azaltmanın başlamanıza nasıl yardımcı olabileceğini göstermek için açık kaynaklı veri kümelerinde bazı karşılaştırmalar yaptık. Bugünden itibaren, varlık türü başına (25 yerine) en az 100 ek açıklama ve en az üç belge (250 yerine) içeren bir varlık tanıma modeli oluşturabilirsiniz. Bu duyuruyla, Amazon Comprehend özel varlık tanıma teknolojisini kullanmakla ilgilenen kullanıcılar için giriş engelini azaltıyoruz. Kullanım durumunuz için daha doğru bir varlık tanıma modeline ihtiyacınız varsa, artık denemelerinizi çok küçük bir açıklamalı belge koleksiyonuyla çalıştırmaya başlayabilir, ön sonuçları analiz edebilir ve ek açıklamalar ve belgeler ekleyerek yineleyebilirsiniz.

Daha fazla bilgi edinmek ve özel varlık tanıyıcıyı kullanmaya başlamak için bkz. Özel varlık tanıma.

Veri hazırlama ve kıyaslama konusundaki değerli yardımları için meslektaşlarım Jyoti Bansal ve Jie Ma'ya özel teşekkürler.

Yazar hakkında

Luca Guida AWS'de Çözüm Mimarı; Milano merkezlidir ve İtalyan ISV'leri bulut yolculuklarında destekler. Bilgisayar bilimi ve mühendisliğinde akademik bir geçmişe sahip olarak, AI/ML tutkusunu üniversitede geliştirmeye başladı. AWS içindeki doğal dil işleme (NLP) topluluğunun bir üyesi olarak Luca, müşterilerin AI/ML hizmetlerini benimserken başarılı olmalarına yardımcı olur.

Luca Guida AWS'de Çözüm Mimarı; Milano merkezlidir ve İtalyan ISV'leri bulut yolculuklarında destekler. Bilgisayar bilimi ve mühendisliğinde akademik bir geçmişe sahip olarak, AI/ML tutkusunu üniversitede geliştirmeye başladı. AWS içindeki doğal dil işleme (NLP) topluluğunun bir üyesi olarak Luca, müşterilerin AI/ML hizmetlerini benimserken başarılı olmalarına yardımcı olur.

- AI

- yapay zeka

- AI sanat üreteci

- yapay zeka robotu

- Amazon Kavramak

- yapay zeka

- yapay zeka sertifikası

- bankacılıkta yapay zeka

- yapay zeka robotu

- yapay zeka robotları

- yapay zeka yazılımı

- AWS Makine Öğrenimi

- blockchain

- blockchain konferans ai

- zeka

- konuşma yapay zekası

- kripto konferans ai

- dal-e

- derin öğrenme

- google ai

- Orta (200)

- makine öğrenme

- Platon

- plato yapay zekası

- Plato Veri Zekası

- Plato Oyunu

- PlatoVeri

- plato oyunu

- ölçek ai

- sözdizimi

- zefirnet