büyüsünü paylaşmak için DALL E 2 geniş bir kitleyle, güçlü görüntü oluşturma modelleriyle ilişkili riskleri azaltmamız gerekiyordu. Bu amaçla çeşitli korkuluklar oluşturulan görüntülerin kurallarımızı ihlal etmesini önlemek için içerik politikası. Bu yazı odaklanıyor eğitim öncesi hafifletmeler, DALL·E 2'nin öğrendiği verileri doğrudan değiştiren bu korkulukların bir alt kümesi. DALL·E 2 özellikle internetten yüz milyonlarca altyazılı görüntü üzerinde eğitilmiştir ve modelin öğrendiklerini değiştirmek için bu görüntülerin bazılarını kaldırıp yeniden ağırlıklandırıyoruz.

Bu gönderi, her biri farklı bir eğitim öncesi azaltmayı açıklayan üç bölümde düzenlenmiştir:

- İlk bölümde, DALL·E 2'nin eğitim veri setinden şiddet içeren ve cinsel içerikli görüntüleri nasıl filtrelediğimizi açıklıyoruz. Bu azaltma olmadan, model, istendiğinde grafik veya müstehcen görüntüler üretmeyi öğrenecek ve hatta görünüşte zararsız istemlere yanıt olarak bu tür görüntüleri istemeden döndürebilir.

- İkinci bölümde, filtreleme eğitim verilerinin önyargıları güçlendirebileceğini ve bu etkiyi azaltmak için tekniğimizi tanımladık. Örneğin, bu azaltma olmadan, filtrelenmiş veriler üzerinde eğitilen modellerin, orijinal veri kümesinde eğitilen modellere kıyasla bazen erkekleri tasvir eden daha fazla resim ve kadınları tasvir eden daha az resim oluşturduğunu fark ettik.

- Son bölümde, DALL·E 2 gibi modellerin bazen yeni görüntüler oluşturmak yerine üzerinde eğitildikleri görüntüleri yeniden üretebildiğini bularak ezberleme konusuna dönüyoruz. Pratikte gördük ki bu görüntü yetersizliği veri kümesinde birçok kez çoğaltılan görüntülerden kaynaklanır ve veri kümesindeki diğer görüntülere görsel olarak benzeyen görüntüleri kaldırarak sorunu azaltır.

Grafik ve Açık Eğitim Verilerini Azaltma

Eğitim verileri, öğrenilen herhangi bir modelin yeteneklerini şekillendirdiğinden, veri filtreleme, istenmeyen model yeteneklerini sınırlamak için güçlü bir araçtır. DALL·E 2 eğitiminden önce bu kategorilerdeki görüntüleri veri kümesinden filtrelemek için sınıflandırıcılar kullanarak bu yaklaşımı iki kategoriye (grafik şiddet ve cinsel içeriği tasvir eden resimler) uyguladık. Bu görüntü sınıflandırıcıları şirket içinde eğittik ve veri kümesi filtrelemenin eğitimli modelimiz üzerindeki etkileri.

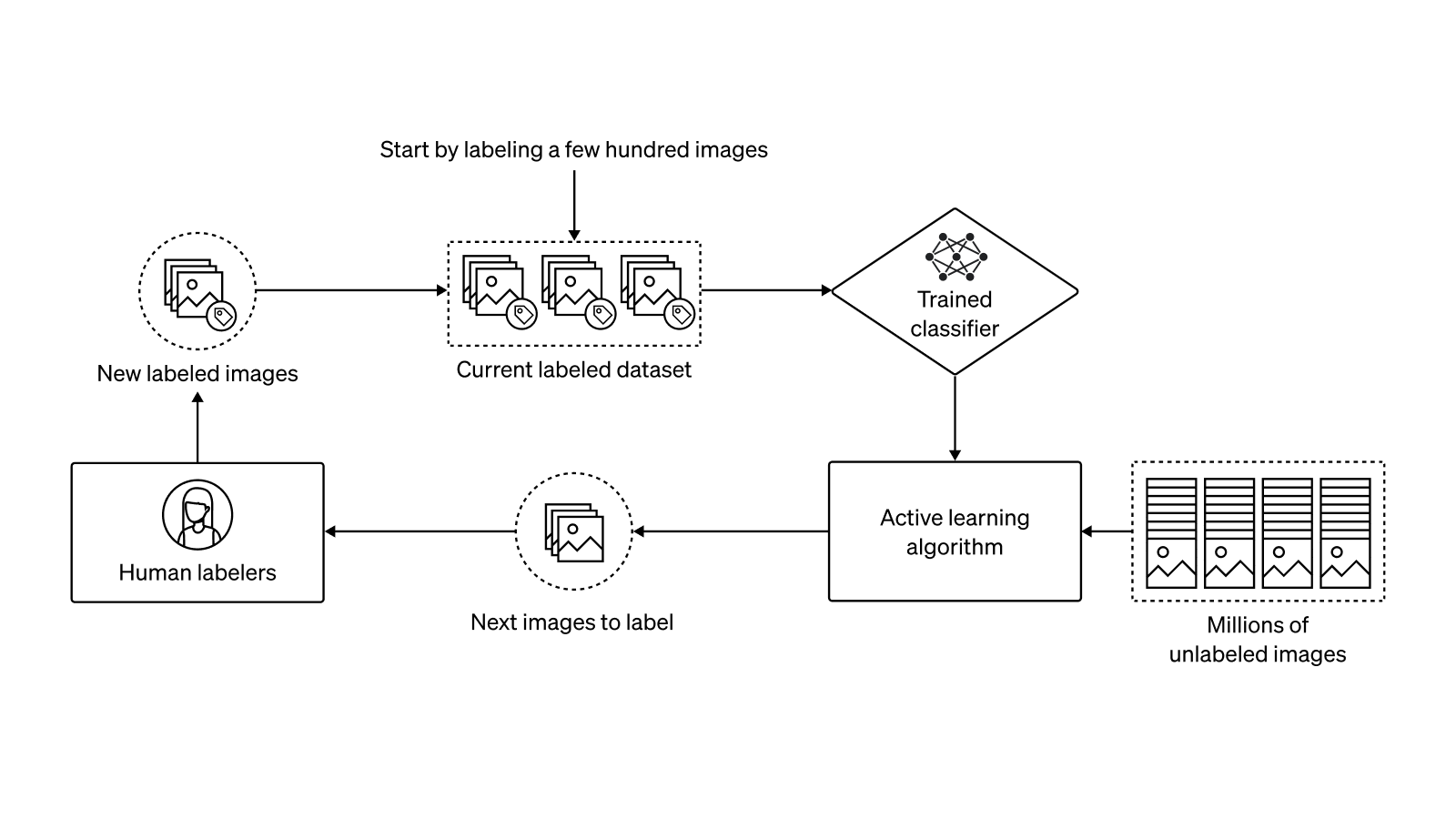

Görüntü sınıflandırıcılarımızı eğitmek için, daha önce eğitim verilerini filtrelemek için kullandığımız bir yaklaşımı yeniden kullandık. SÜRÜŞ. Bu yaklaşımın temel adımları şu şekildedir: ilk olarak, etiketlemek istediğimiz görüntü kategorileri için bir belirtim oluşturuyoruz; ikinci olarak, her kategori için birkaç yüz olumlu ve olumsuz örnek topluyoruz; üçüncü olarak, daha fazla veri toplamak ve kesinlik/hatırlama değiş tokuşunu iyileştirmek için aktif bir öğrenme prosedürü kullanıyoruz; ve son olarak, kesinliğe göre hatırlamayı tercih etmek için elde edilen sınıflandırıcıyı tüm veri kümesinde muhafazakar bir sınıflandırma eşiğiyle çalıştırırız. Bu eşikleri belirlemek için tüm öğeleri filtrelemeye öncelik verdik. kötü tümünde ayrılmaya ilişkin veriler Tercih Etmenizin veri. Bunun nedeni, modelimize daha sonra yeni şeyler öğretmek için daha fazla veri ile her zaman ince ayar yapabilmemizdir, ancak modelin zaten öğrendiği bir şeyi unutmasını sağlamak çok daha zordur.

Aktif öğrenme aşamasında, potansiyel olarak zor veya yanlış sınıflandırılmış görüntüler için insan etiketleri toplayarak sınıflandırıcılarımızı yinelemeli olarak geliştirdik. Özellikle, etiketleme için insanlara sunmak üzere veri kümemizden (yüz milyonlarca etiketlenmemiş görüntü içeren) görüntüleri seçmek için iki aktif öğrenme tekniği kullandık. İlk olarak, sınıflandırıcımızın yanlış pozitif oranını (yani, iyi huylu bir görüntüyü şiddet içeren veya cinsel olarak yanlış sınıflandırma sıklığı) azaltmak için, mevcut modelin pozitif olarak sınıflandırdığı görüntülere insan etiketleri atadık. Bu adımın iyi çalışması için, sınıflandırma eşiğimizi neredeyse %100 hatırlamaya ancak yüksek bir yanlış pozitif oranına ayarladık; bu şekilde, etiketleyicilerimiz çoğunlukla gerçekten olumsuz vakaları etiketliyordu. Bu teknik, yanlış pozitifleri azaltmaya yardımcı olurken ve etiketleyicilerin potansiyel olarak zararlı görüntülere bakma ihtiyacını azaltırken, modelin şu anda eksik olduğu daha fazla pozitif vakayı bulmaya yardımcı olmuyor.

Sınıflandırıcımızın yanlış negatif oranını azaltmak için ikinci bir aktif öğrenme tekniği kullandık: en yakın komşu araması. Özellikle, modelin negatif olarak yanlış sınıflandırmaya meyilli olduğu mevcut etiketli veri kümemizde pozitif örnekler bulmak için çok katlı çapraz doğrulama çalıştırdık (bunu yapmak için, sınıflandırıcının farklı tren doğrulama bölmeleriyle yüzlerce sürümünü tam anlamıyla eğittik). Daha sonra, bu örneklerin en yakın komşuları için geniş etiketlenmemiş görüntü koleksiyonumuzu algısal bir özellik alanında taradık ve keşfedilen görüntülere insan etiketleri atadık. Bilgi işlem altyapımız sayesinde, hem sınıflandırıcı eğitimini hem de en yakın komşu aramasını birçok GPU'ya ölçeklendirmek önemsizdi ve aktif öğrenme adımının saatler veya günler yerine birkaç dakika içinde gerçekleşmesine izin verdi.

Veri filtrelerimizin etkinliğini doğrulamak için, aynı hiperparametrelere sahip iki GLIDE modelini eğittik: biri filtrelenmemiş veriler üzerinde ve diğeri filtrelemeden sonra veri kümesi üzerinde. Eski modele şu şekilde atıfta bulunuyoruz: filtrelenmemiş model, ve ikincisi olarak filtrelenmiş model. Beklendiği gibi, filtrelenmemiş modelin bu tür içerik taleplerine yanıt olarak genellikle daha az açık veya grafik içerik ürettiğini gördük. Bununla birlikte, veri filtrelemenin beklenmedik bir yan etkisi de bulduk: bu, modelin belirli demografilere yönelik önyargılarını yarattı veya güçlendirdi.

Veri Filtrelerinin Getirdiği Önyargıları Düzeltme

Üretken modeller, oradaki herhangi bir önyargı da dahil olmak üzere eğitim verilerinin dağılımını eşleştirmeye çalışır. Sonuç olarak, eğitim verilerinin filtrelenmesi, aşağı akış modellerinde önyargı oluşturma veya artırma potansiyeline sahiptir. Genel olarak, orijinal veri kümesindeki önyargıları düzeltmek, üzerinde çalışmaya devam ettiğimiz zor bir sosyoteknik görevdir ve bu yazının kapsamı dışındadır. Burada ele aldığımız sorun, özellikle veri filtrelemenin kendisinin neden olduğu önyargıların büyütülmesidir. Yaklaşımımızla filtrelenmiş modelin ortadan kaldırılmasını amaçlıyoruz. Daha filtrelenmemiş modelden daha önyargılıdır, esasen veri filtrelemenin neden olduğu dağıtım kaymasını azaltır.

Filtreleme nedeniyle önyargı büyütmenin somut bir örneği olarak, istemi "bir CEO" olarak düşünün. Filtrelenmemiş modelimiz bu istem için görüntüler oluşturduğunda, kadınlardan daha fazla erkek görüntüsü üretme eğilimindeydi ve bu yanlılığın çoğunun mevcut eğitim verilerimizin bir yansıması olmasını bekliyoruz. Ancak, aynı istemi filtrelenmiş modelimizde çalıştırdığımızda, önyargının arttığı görüldü; nesiller neredeyse yalnızca erkeklerin görüntüleriydi.

Bu özel önyargı büyütme vakasının iki yerden geldiğini varsayıyoruz: birincisi, kadınlar ve erkekler orijinal veri setinde kabaca eşit temsile sahip olsalar bile, veri seti kadınları daha cinselleştirilmiş bağlamlarda sunmaya yönelik önyargılı olabilir; ve ikincisi, veri toplama ve doğrulama aşamalarında durumun böyle olmamasını sağlama çabalarımıza rağmen, sınıflandırıcılarımızın kendileri, uygulama veya sınıf tanımı nedeniyle önyargılı olabilir. Bu etkilerin her ikisi nedeniyle, filtremiz, modelin eğitimde gözlemlediği cinsiyet oranını değiştiren, erkeklerden daha fazla kadın görüntüsünü kaldırabilir.

Filtre kaynaklı önyargıyı daha kapsamlı bir şekilde araştırmak için, veri filtrelerimizin çeşitli kavramlara yönelik önyargıyı ne kadar etkilediğini ölçmenin bir yolunu istedik. Özellikle şiddet ve cinsel içerik filtrelerimiz tamamen görüntü tabanlıdır, ancak veri kümemizin çok modlu yapısı, bu filtrelerin metin üzerindeki etkilerini doğrudan ölçmemize olanak tanır. Her görsele bir metin başlığı eşlik ettiğinden, filtrelerin herhangi bir kavramı ne kadar etkilediğini tahmin etmek için filtrelenmiş ve filtrelenmemiş veri kümesinde elle seçilen anahtar kelimelerin göreli sıklığına bakabildik.

Bunu uygulamaya koymak için, hem filtrelenmiş hem de filtrelenmemiş veri kümelerimizdeki tüm altyazılar üzerinde bir avuç anahtar kelimenin (örneğin, "ebeveyn", "kadın", "çocuk") sıklığını hesaplamak için Apache Spark'ı kullandık. Veri kümemiz yüz milyonlarca metin-görüntü çifti içerse de, bu anahtar kelime sıklıklarını hesaplamak, bilgi işlem kümemizi kullanarak yalnızca birkaç dakika sürdü.

Anahtar kelime frekanslarını hesapladıktan sonra, veri seti filtrelerimizin gerçekten de belirli anahtar kelimelerin frekanslarını diğerlerinden daha fazla çarpıttığını doğrulayabildik. Örneğin, filtreler “kadın” kelimesinin sıklığını %14, “erkek” kelimesinin sıklığını ise sadece %6 azaltmıştır. Bu, her iki veri setinde eğitilmiş GLIDE modellerinden örnekleme yoluyla anekdot olarak gözlemlediğimiz şeyi büyük ölçekte doğruladı.

Artık filtre kaynaklı yanlılığı ölçmek için bir vekilimiz olduğuna göre, onu azaltmanın bir yoluna ihtiyacımız vardı. Bu sorunu çözmek için, filtrelenmiş veri kümesinin dağılımının filtrelenmemiş görüntülerin dağılımıyla daha iyi eşleşmesi için yeniden ağırlıklandırmayı amaçladık. Bu fikri örneklendirmek için bir oyuncak örneği olarak, veri setimizin %50 kedi fotoğrafı ve %50 köpek fotoğrafından oluştuğunu, ancak veri filtrelerimizin köpeklerin %75'ini, ancak kedilerin yalnızca %50'sini kaldırdığını varsayalım. Nihai veri seti ⅔ kediler ve ⅓ köpekler olacaktır ve bu veri seti üzerinde eğitilmiş olabilirliğe dayalı bir üretici model, muhtemelen köpeklerden daha fazla kedi görüntüsü oluşturacaktır. Bir köpeğin her görüntüsünün eğitim kaybını 2 ile çarparak, her köpek görüntüsünü iki kez tekrarlamanın etkisini taklit ederek bu dengesizliği düzeltebiliriz. Bu yaklaşımı büyük ölçüde otomatik bir şekilde gerçek veri kümelerimize ve modellerimize ölçekleyebileceğimiz ortaya çıktı - yani, yeniden ağırlık vermek istediğimiz özellikleri elle seçmemize gerek yok.

Tarafından kullanılan yaklaşıma benzer şekilde, özel bir sınıflandırıcıdan gelen olasılıkları kullanarak filtrelenmiş veri kümesindeki görüntülerin ağırlıklarını hesaplıyoruz. Choi ve diğ. (2019). Bu sınıflandırıcıyı eğitmek için, her iki veri kümesinden de görüntüleri eşit olarak örnekler ve görüntünün hangi veri kümesinden geldiğini tahmin ederiz. Özellikle, bu model tahmin P(filtrelenmemiş|resim), önceden verilmiş P(filtrelenmemiş) = 0.5. Pratikte, bu modelin çok güçlü olmasını istemiyoruz, aksi takdirde ilk etapta filtrelerimiz tarafından uygulanan işlevi tam olarak öğrenebilir. Bunun yerine, belirli bir görüntünün filtrelenip filtrelenmeyeceğinden emin olmadan, filtrelerden etkilenen geniş kategorileri yakalayarak modelin orijinal veri filtrelerimizden daha pürüzsüz olmasını istiyoruz. Bu amaçla, küçük bir uzay aracının üzerinde doğrusal bir sonda eğittik. CLIP modeli.

Bir görüntünün filtrelenmemiş veri kümesinden olma olasılığını tahmin eden bir sınıflandırıcımız olduğunda, yine de bu tahmini görüntü için bir ağırlığa dönüştürmemiz gerekir. Örneğin, varsayalım ki P(filtrelenmemiş|resim) = 0.8. Bu, örneğin filtrelenmemiş verilerde filtrelenmiş verilere göre 4 kat daha fazla bulunma olasılığı olduğu ve 4'lük bir ağırlığın dengesizliği düzeltmesi gerektiği anlamına gelir. Daha genel olarak, ağırlığı kullanabiliriz P(filtrelenmemiş|görüntü)/P(filtrelenmiş|görüntü).[1]

Bu yeniden ağırlıklandırma şeması, güçlendirilmiş önyargıyı gerçekte ne kadar iyi azaltıyor? Önceki filtrelenmiş modelimize yeni ağırlıklandırma şemasıyla ince ayar yaptığımızda, ince ayarlanmış modelin davranışı, daha önce bulduğumuz önyargılı örneklerdeki filtrelenmemiş modelle çok daha yakından eşleşiyordu. Bu cesaret verici olsa da, anahtar kelimeye dayalı önyargı buluşsal yöntemimizi kullanarak bu azaltmayı daha kapsamlı bir şekilde değerlendirmek istedik. Yeni ağırlıklandırma düzenimizi hesaba katarken anahtar kelime sıklıklarını ölçmek için, filtrelenmiş veri kümesindeki bir anahtar kelimenin her örneğini, onu içeren örneğin ağırlığına göre ağırlıklandırabiliriz. Bunu yaparak, filtrelenmiş veri kümesindeki örnek ağırlıkları yansıtan yeni bir anahtar sözcük sıklığı kümesi elde ederiz.

Kontrol ettiğimiz anahtar kelimelerin çoğunda, yeniden ağırlıklandırma şeması, filtrelemenin neden olduğu sıklık değişimini azalttı. Önceki “erkek” ve “kadın” örneklerimiz için, göreceli frekans azalmaları %1 ve –%1, önceki değerleri sırasıyla %14 ve %6 idi. Bu metrik, gerçek filtreleme yanlılığı için yalnızca bir vekil olsa da, görüntü tabanlı yeniden ağırlıklandırma şemamızın metin tabanlı bir metriği gerçekten önemli ölçüde iyileştirdiği konusunda güven vericidir.

Kısmen modelin davranışına ilişkin daha geniş değerlendirmeler ve filtrelemenin sapma ve yetenek gelişimini nasıl etkilediğine ilişkin araştırmalar yoluyla DALL·E 2'de kalan önyargıları araştırmaya devam ediyoruz.

Görüntü Yetersizliğinin Önlenmesi

DALL·E 2'nin dahili öncüllerinin bazen eğitim görüntülerini kelimesi kelimesine çoğalttığını gözlemledik. DALL·E 2'nin varsayılan olarak orijinal, benzersiz görüntüler oluşturmasını ve yalnızca mevcut görüntülerin parçalarını "birleştirmesini" istemediğimizden bu davranış istenmeyen bir durumdu. Ek olarak, eğitim görüntülerini kelimesi kelimesine çoğaltmak, telif hakkı ihlali, mülkiyet ve gizlilik (eğitim verilerinde insanların fotoğrafları mevcutsa) hakkında yasal soruları gündeme getirebilir.

Görüntü yetersizliği sorununu daha iyi anlamak için, sıklıkla yinelenen görüntülerle sonuçlanan bir bilgi istemi veri kümesi topladık. Bunu yapmak için, eğitim veri kümemizden 50,000 istem için görüntüleri örneklemek için eğitilmiş bir model kullandık ve örnekleri ilgili eğitim görüntüsüne algısal benzerliğe göre sıraladık. Son olarak, en iyi eşleşmeleri elle inceledik ve toplam 50 bin bilgi isteminden yalnızca birkaç yüz gerçek kopya çifti bulduk. Regürjitasyon oranı %1'in altında görünse de yukarıda belirtilen nedenlerle oranı 0'a indirmenin gerekli olduğunu düşündük.

Kusurlu görüntülerden oluşan veri setimizi incelediğimizde iki model fark ettik. İlk olarak, görüntülerin neredeyse tamamı basit vektör grafikleriydi ve düşük bilgi içeriği nedeniyle muhtemelen ezberlenmesi kolaydı. İkincisi ve daha da önemlisi, görüntülerin hepsinin eğitim veri setinde neredeyse kopyaları vardı. Örneğin, saat 1 yönündeki zamanı gösteren bir saate benzeyen bir vektör grafiği olabilir; ancak o zaman aynı saati saat 2'yi ve ardından saat 3'ü vb. gösteren bir eğitim örneğini keşfederiz. Bunu fark ettik, gerçekten de, tüm yetersiz görüntülerin veri kümesinde algısal olarak benzer kopyalara sahip olduğunu doğrulamak için dağıtılmış bir en yakın komşu araması kullandık. Diğer çalışır benzer bir fenomeni büyük dil modellerinde gözlemlediler ve veri çoğaltmanın ezberlemeyle güçlü bir şekilde bağlantılı olduğunu buldular.

Yukarıdaki bulgu, veri kümemizi tekilleştirirsek yetersizlik sorununu çözebileceğimizi gösterdi. Bunu başarmak için, benzer görünen görüntü gruplarını belirlemek için bir sinir ağı kullanmayı ve ardından her gruptan biri hariç tüm görüntüleri kaldırmayı planladık.[2] Ancak bu, her görüntünün veri kümesindeki diğer tüm görüntülerin kopyası olup olmadığının kontrol edilmesini gerektirir. Veri setimizin tamamı yüz milyonlarca görüntü içerdiğinden, tüm kopyaları bulmak için safça yüzlerce katrilyonlarca görüntü çiftini kontrol etmemiz gerekir. Bu, özellikle büyük bir bilgi işlem kümesinde teknik olarak ulaşılabilir olsa da, maliyetin küçük bir kısmıyla neredeyse aynı derecede işe yarayan, çok daha verimli bir alternatif bulduk.

Veri tekilleştirmeyi gerçekleştirmeden önce veri kümemizi kümelersek ne olacağını düşünün. Yakındaki örnekler sıklıkla aynı kümeye düştüğünden, kopya çiftlerin çoğu küme karar sınırlarını geçmeyecektir. Daha sonra, tüm yinelenen çiftlerin yalnızca küçük bir kısmını kaçırırken, küme dışındaki kopyaları kontrol etmeden her küme içindeki örnekleri tekilleştirebildik. Bu, saf yaklaşımdan çok daha hızlıdır çünkü artık her bir görüntü çiftini kontrol etmemize gerek yoktur.[3] Bu yaklaşımı verilerimizin küçük bir alt kümesi üzerinde ampirik olarak test ettiğimizde, tüm yinelenen çiftlerin %85'ini buldu. K = 1024 kümeler.

Yukarıdaki algoritmanın başarı oranını artırmak için bir anahtar gözlemden yararlandık: bir veri kümesinin farklı rastgele alt kümelerini kümelediğinizde, sonuçta ortaya çıkan küme karar sınırları genellikle oldukça farklıdır. Bu nedenle, yinelenen bir çift, verilerin bir kümelenmesi için bir küme sınırını geçerse, aynı çift farklı bir kümelemede tek bir kümenin içine düşebilir. Ne kadar çok kümeleme denerseniz, belirli bir yinelenen çifti keşfetme olasılığınız o kadar artar. Pratikte, beş kümeleme kullanmaya karar verdik; bu, beş farklı kümenin birleşiminde her görüntünün kopyalarını aradığımız anlamına gelir. Pratikte bu, verilerimizin bir alt kümesindeki tüm çift çiftlerin %97'sini buldu.

Şaşırtıcı bir şekilde, veri setimizin neredeyse dörtte biri veri tekilleştirme ile kaldırıldı. Bulunan neredeyse yinelenen çiftlere baktığımızda, birçoğu anlamlı değişiklikler içeriyordu. Yukarıdaki saat örneğini hatırlayın: veri seti, aynı saatin günün farklı saatlerinde birçok görüntüsünü içerebilir. Bu görüntülerin modelin bu belirli saatin görünümünü ezberlemesini sağlaması muhtemel olsa da, modelin bir saatte günün saatleri arasında ayrım yapmayı öğrenmesine de yardımcı olabilir. Ne kadar veri kaldırıldığı göz önüne alındığında, bunun gibi görüntülerin kaldırılmasının modelin performansına zarar verebileceğinden endişelendik.

Tekilleştirmenin modellerimiz üzerindeki etkisini test etmek için, aynı hiperparametrelere sahip iki modeli eğittik: biri tam veri kümesinde ve diğeri veri kümesinin tekilleştirilmiş versiyonunda. Modelleri karşılaştırmak için orijinal GLIDE modelimizi değerlendirmek için kullandığımız insan değerlendirmelerinin aynısını kullandık. Şaşırtıcı bir şekilde, insan değerlendiricilerin biraz tercihli model tekilleştirilmiş veriler üzerinde eğitildi, bu da veri kümesindeki büyük miktarda gereksiz görüntünün aslında performansa zarar verdiğini gösteriyor.

Tekilleştirilmiş veriler üzerinde eğitilmiş bir modelimiz olduğunda, daha önce eğitim veri setinden 50 bin'in üzerinde istem yaptığımız yetersizlik aramasını yeniden düzenledik. Eğitim veri kümesinden görüntü için tam istem verildiğinde, yeni modelin hiçbir zaman bir eğitim görüntüsünü yeniden kulanmadığını bulduk. Bu testi bir adım daha ileri götürmek için, oluşturulan 50k görüntünün her biri için tüm eğitim veri kümesi üzerinde en yakın komşu araması gerçekleştirdik. Bu şekilde, verilen bir istemle ilişkili olandan farklı bir görüntü kusan modeli yakalayabileceğimizi düşündük. Bu daha kapsamlı kontrole rağmen, hiçbir zaman bir görüntü yetersizliği vakası bulamadık.

Sonraki Adımlar

Yukarıda tartışılan tüm hafifletmeler, DALL·E 2 ile ilişkili riskleri azaltma hedefimize yönelik önemli ilerlemeyi temsil etse de, her bir hafifletme işleminin hala iyileştirilecek yeri vardır:

- Daha iyi ön eğitim filtreleri, DALL·E 2'yi daha fazla veri üzerinde eğitmemize ve potansiyel olarak modeldeki sapmayı daha da azaltmamıza olanak sağlayabilir. Mevcut filtrelerimiz, birçok yanlış pozitiflik pahasına düşük bir yanlış oran için ayarlanmıştır. Sonuç olarak, filtrelenmiş bu görüntülerin çoğu içerik politikamızı hiç ihlal etmese de, tüm veri setimizin kabaca %5'ini filtreledik. Filtrelerimizi geliştirmek, bu eğitim verilerinin bir kısmını geri almamıza izin verebilir.

- Önyargı, sistem geliştirme ve dağıtımının birçok aşamasında ortaya çıkar ve potansiyel olarak güçlendirilir. DALL·E 2 gibi sistemlerdeki önyargıyı ve bu önyargının yol açtığı zararı değerlendirmek ve azaltmak, daha geniş misyonumuzun bir parçası olarak OpenAI'de çalışmaya devam ettiğimiz önemli bir disiplinler arası sorundur. Bu konudaki çalışmalarımız, sorunu daha iyi anlamak için değerlendirmeler oluşturmayı, yeni veri kümelerini düzenlemeyi ve daha sağlam ve temsili teknolojiler oluşturmak için insan geri bildirimi ve ince ayar gibi teknikleri uygulamayı içerir.

- Derin öğrenme sistemlerinde ezberleme ve genelleme çalışmalarına devam etmemiz de çok önemlidir. Veri tekilleştirme, ezberlemeyi önlemeye yönelik iyi bir ilk adım olsa da, DALL·E 2 gibi modellerin eğitim verilerini neden veya nasıl ezberlediğini öğrenmemiz gereken her şeyi bize söylemez.

- 000

- 2019

- a

- Hakkımızda

- Hesap

- Başarmak

- karşısında

- aktif

- adres

- etkileyen

- algoritma

- Türkiye

- Izin

- veriyor

- zaten

- alternatif

- her zaman

- miktar

- Başka

- çıktı

- uygulamalı

- Uygulanması

- yaklaşım

- etrafında

- atanmış

- ilişkili

- izleyici

- Çünkü

- önce

- olmak

- Daha iyi

- arasında

- Ötesinde

- inşa etmek

- bina

- yetenekleri

- başlıklar

- dava

- durumlarda

- Yakalamak

- Kategoriler

- neden

- belli

- değişiklik

- denetleme

- Klinik

- sınıf

- sınıflandırma

- sınıflandırılmış

- saat

- Toplamak

- karşılaştırıldığında

- hesaplamak

- bilgisayar

- kavram

- Düşünmek

- içeren

- içerik

- bağlamlar

- devam etmek

- telif hakkı

- telif hakkı ihlali

- uyan

- olabilir

- yaratmak

- çevrimiçi kurslar düzenliyorlar.

- Oluşturma

- çok önemli

- akım

- Şu anda

- veri

- gün

- Günler

- karar

- derin

- Demografi

- açılma

- tanımlamak

- Rağmen

- gelişme

- farklı

- zor

- direkt olarak

- keşfetmek

- keşfetti

- mesafe

- dağıtıldı

- dağıtım

- aşağı

- çiftleri

- sırasında

- her

- Efekt

- etkili bir şekilde

- etki

- etkileri

- verimli

- çabaları

- teşvik edici

- özellikle

- esasen

- tahmin

- vb

- değerlendirmek

- her şey

- örnek

- örnekler

- sadece

- mevcut

- beklemek

- beklenen

- Daha hızlı

- Özellikler(Hazırlık aşamasında)

- Özellikler

- geribesleme

- şekil

- süzme

- filtreler

- Nihayet

- bulma

- Ad

- sabit

- odaklanır

- şu

- bulundu

- itibaren

- tam

- işlev

- daha fazla

- toplama

- Cinsiyet

- genel

- genellikle

- oluşturmak

- oluşturulan

- nesil

- nesiller

- üretken

- gol

- Tercih Etmenizin

- GPU'lar

- grafik

- grup

- Grubun

- garanti

- avuç

- yardım et

- yardımcı olur

- okuyun

- Yüksek

- Ne kadar

- Ancak

- HTTPS

- insan

- İnsanlar

- Yüzlerce

- Fikir

- belirlemek

- görüntü

- görüntüleri

- uygulama

- uygulanan

- önemli

- iyileştirmek

- gelişmiş

- geliştirme

- dahil

- dahil

- içerir

- Dahil olmak üzere

- bilgi

- Altyapı

- örnek

- Internet

- araştırmak

- konu

- IT

- kendisi

- anahtar

- etiket

- etiketleme

- Etiketler

- dil

- büyük

- büyük

- ÖĞRENİN

- öğrendim

- öğrenme

- Yasal Şartlar

- Muhtemelen

- Bakın

- baktı

- yapmak

- işaret

- Maç

- anlamlı

- anlamına geliyor

- ölçmek

- ölçme

- Erkek

- olabilir

- Askeri

- milyonlarca

- Misyonumuz

- model

- modelleri

- Daha

- çoğu

- çarpılması

- Tabiat

- gerekli

- negatif

- ağ

- numara

- sipariş

- Düzenlenmiş

- orijinal

- Diğer

- mülkiyet

- Bölüm

- belirli

- performans

- icra

- faz

- parçalar

- planlanmış

- politika

- pozitif

- mümkün

- potansiyel

- güçlü

- uygulama

- tahmin

- tahmin

- mevcut

- önlenmesi

- önceki

- gizlilik

- sonda

- Sorun

- süreç

- üretmek

- Üretilmiş

- protesto

- vekil

- Çeyrek

- yükseltmek

- ulaşmak

- fark

- nedenleri

- azaltmak

- Indirimli

- azaltarak

- yansıtmak

- yansıma

- kalan

- kaldırma

- temsil etmek

- temsil

- temsilci

- isteklerinizi

- gerektirir

- gerektirir

- yanıt

- Ortaya çıkan

- dönüş

- riskler

- koşmak

- aynı

- ölçek

- plan

- Ara

- set

- şekiller

- paylaş

- çalışma

- önemli

- benzer

- Basit

- beri

- tek

- beden

- küçük

- So

- ÇÖZMEK

- biraz

- bir şey

- uzay

- özel

- özellikle

- şartname

- Splits

- aşamaları

- başlama

- belirtilen

- Yine

- Ders çalışma

- başarı

- sistem

- Sistemler

- alma

- teknikleri

- Teknolojileri

- test

- The

- bu nedenle

- işler

- iyice

- üç

- eşik

- İçinden

- zaman

- zamanlar

- araç

- üst

- karşı

- Tren

- Eğitim

- anlamak

- sendikasının

- benzersiz

- us

- kullanım

- onaylama

- çeşitli

- doğrulamak

- versiyon

- aranan

- Ne

- olup olmadığını

- süre

- içinde

- olmadan

- Kadın

- İş

- çalışır

- endişeli

- olur

- X