- Mayıs 12, 2014

- Vasilis Vryniotis

- . 4 Yorumlar

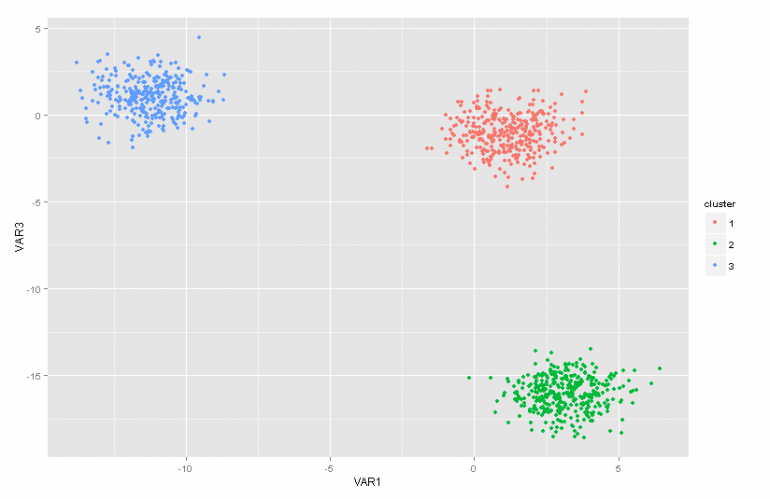

Bu blog gönderisi, Dirichlet Process karışım modelleri hakkındaki makale serisinin ikinci bölümüdür. Önceki yazıda bir çeşitli Küme Analizi tekniklerine genel bakış ve bunları kullanarak ortaya çıkan bazı sorunları / sınırlamaları tartıştık. Ayrıca Dirichlet Process Mixture Modellerini kısaca sunduk, neden faydalı olduklarından bahsettik ve bazı uygulamalarını sunduk.

Güncelleme: Datumbox Machine Learning Framework artık açık kaynak kodlu ve ücretsiz indir. Java'da Dirichlet Proses Karışım Modellerinin uygulanmasını görmek için com.datumbox.framework.machinelearning.clustering paketini inceleyin.

Dirichlet Process Mixture Modellerinin başlangıçta yutulması biraz zor olabilir çünkü bunlar birçok farklı gösterime sahip sonsuz karışım modelleridir. Neyse ki konuya yaklaşmanın iyi bir yolu, Dirichlet Dağılımlı Sonlu Karışım Modellerinden başlayıp sonra sonsuz olanlara geçmektir.

Sonuç olarak bu yazıda ihtiyaç duyacağımız bazı önemli dağılımları kısaca sunacağım, bunları Multinomial Olabilirlik modeli ile Dirichlet Önceliğini oluşturmak için kullanacağız ve ardından Dirichlet Dağılımına dayalı Sonlu Karışım Modeline geçeceğiz.

1. Beta Dağıtımı

The Beta dağıtımı [0,1] aralığında tanımlanan sürekli dağılımlar ailesidir. İki pozitif parametre a ve b ile parametrelendirilir ve formu büyük ölçüde bu iki parametrenin seçimine bağlıdır.

Şekil 1: Farklı a, b parametreleri için Beta Dağılımı

Beta dağılımı, genellikle olasılıklar üzerinden bir dağılımı modellemek için kullanılır ve aşağıdaki olasılık yoğunluğuna sahiptir:

![]()

Denklem 1: Beta PDF

Γ (x) gama fonksiyonudur ve a, b dağılımın parametreleridir. Beta, genellikle olasılık değerlerinin dağılımı olarak kullanılır ve bize modellenen olasılığın belirli bir P = p0 değerine eşit olma olasılığını verir. Beta dağılımı, tanımı gereği doğru veya yanlış değerleri alan ikili sonuçların olasılığını modelleyebilir. A ve b parametreleri, sırasıyla başarı ve başarısızlığın sözde sayıları olarak kabul edilebilir. Böylelikle Beta Dağılımı, a başarılar ve b başarısızlıklar verilen başarı olasılığını modeller.

2. Dirichlet Dağıtımı

The Dirichlet Dağılımı Beta Dağılımının birden fazla sonuç için genelleştirilmesidir (veya başka bir deyişle, birden çok sonucu olan olaylar için kullanılır). K parametresi a ile parametrelendiriliri bu olumlu olmalı. Dirichlet Dağılımı, değişken sayısı k = 2 olduğunda Beta Dağılımına eşittir.

Şekil 2: Çeşitli a için Dirichlet Dağılımıi parametreler

Dirichlet dağılımı genellikle olasılıklar üzerinden bir dağılımı modellemek için kullanılır ve aşağıdaki olasılık yoğunluğuna sahiptir:

![]()

Denklem 2: Dirichlet PDF

Γ (x) gama fonksiyonudur, pi [0,1] ve Σp'deki değerleri alıni= 1. Dirichlet dağılımı, p'nin ortak dağılımını modelleri ve P olasılığını verir1=p1,P2=p2,…., Pk-1=pk-1 P ilek= 1 - ΣPi. Beta'da olduğu gibi, ai parametreler, her bir i olayının ortaya çıkışlarının sahte hesapları olarak düşünülebilir. Dirichlet dağılımı, meydana gelen k rakip olayların olasılığını modellemek için kullanılır ve genellikle Dirichlet (a) olarak gösterilir.

3. Multinomial Olasılıkla Önceden Dirichlet

Daha önce bahsedildiği gibi Dirichlet dağılımı, olasılık dağılımları üzerinden bir dağılım olarak görülebilir. K olayının meydana gelme olasılığını modellemek istediğimiz durumlarda, Bayesci bir yaklaşım kullanmak olacaktır. Çok Terimli Olabilirlik ve Dirichlet Öncülleri .

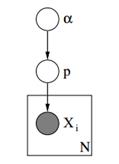

Aşağıda böyle bir modelin grafik modelini görebiliriz.

Şekil 3: Çok Terimli Olasılıklı Dirichlet Öncüllerinin Grafik Modeli

Yukarıdaki grafik modelde α, Dirichlet öncüllerinin hiperparametrelerine sahip bir k boyutlu vektördür, p, olasılık değerleri ve xi 1'den k'ye kadar skaler bir değerdir ve bize hangi olayın meydana geldiğini söyler. Son olarak, P'nin α vektörü ve dolayısıyla P ~ Dirichlet (α) ile parametrelenmiş Dirichlet dağılımını izlediğini ve xi değişkenler, olasılıkların p vektörüyle parametrelendirilmiş Kesikli dağılımı (Çok terimli) izler. Benzer hiyerarşik modeller, farklı konulardaki anahtar kelime frekanslarının dağılımlarını temsil etmek için belge sınıflandırmasında kullanılabilir.

4. Dirichlet Dağılımlı Sonlu Karışım Modeli

Dirichlet Distribution kullanarak bir Sonlu Karışım Modeli kümeleme yapmak için kullanılabilir. Aşağıdaki modele sahip olduğumuzu varsayalım:

![]()

![]()

![]()

![]()

Denklem 3: Dirichlet Dağılımlı Sonlu Karışım Modeli

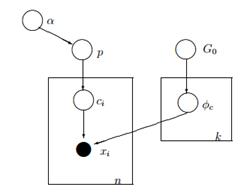

Yukarıdaki model aşağıdakileri varsayar: n gözlemli bir X veri kümesine sahibiz ve üzerinde küme analizi yapmak istiyoruz. K, kullanacağımız küme / bileşen sayısını gösteren sabit bir sonlu sayıdır. Ci değişkenler gözlemin küme atamasını saklar Xi1'den k'ye kadar olan değerleri alırlar ve bileşenlerin karışım olasılıkları olan p parametresi ile Kesikli Dağılımı takip ederler. F, X'imizin üretken dağılımıdır ve bir parametre ile parametrelendirilir. ![]() bu, her bir gözlemin küme atamasına bağlıdır. Toplamda k benzersiz

bu, her bir gözlemin küme atamasına bağlıdır. Toplamda k benzersiz ![]() parametreler kümelerimizin sayısına eşittir.

parametreler kümelerimizin sayısına eşittir. ![]() değişken, üretken F Dağılımını parametrelendiren parametreleri depolar ve bunun temel bir G'yi izlediğini varsayarız.0 dağıtım. P değişkeni, k kümelerinin her biri için karışım yüzdelerini depolar ve Dirichlet'i α / k parametreleriyle takip eder. Son olarak α, Dirichlet dağılımının [2] hiperparametrelerine (pseudocounts) sahip bir k boyutlu vektördür.

değişken, üretken F Dağılımını parametrelendiren parametreleri depolar ve bunun temel bir G'yi izlediğini varsayarız.0 dağıtım. P değişkeni, k kümelerinin her biri için karışım yüzdelerini depolar ve Dirichlet'i α / k parametreleriyle takip eder. Son olarak α, Dirichlet dağılımının [2] hiperparametrelerine (pseudocounts) sahip bir k boyutlu vektördür.

Şekil 4: Dirichlet Dağılımlı Sonlu Karışım Modelinin Grafik Modeli

Modeli açıklamanın daha basit ve daha az matematiksel bir yolu şudur. Verilerimizin k kümeler halinde gruplanabileceğini varsayıyoruz. Her kümenin kendi parametreleri vardır ![]() ve bu parametreler verilerimizi oluşturmak için kullanılır. Parametreler

ve bu parametreler verilerimizi oluşturmak için kullanılır. Parametreler ![]() bazı dağılımları takip ettiği varsayılmaktadır G0. Her gözlem bir x vektörü ile temsil ediliri ve aci ait olduğu kümeyi gösteren değer. Sonuç olarak ci Kesikli Dağılımı, karışım olasılıklarından başka bir şey olmayan bir p parametresiyle, yani her kümenin meydana gelme olasılığıyla izleyen bir değişken olarak görülebilir. Problemimizi Bayesçi bir şekilde ele aldığımıza göre, p parametresini sabit bilinmeyen bir vektör olarak ele almıyoruz. Bunun yerine, P'nin hiperparametreler α / k ile parametreleştirilen Dirichlet'i takip ettiğini varsayıyoruz.

bazı dağılımları takip ettiği varsayılmaktadır G0. Her gözlem bir x vektörü ile temsil ediliri ve aci ait olduğu kümeyi gösteren değer. Sonuç olarak ci Kesikli Dağılımı, karışım olasılıklarından başka bir şey olmayan bir p parametresiyle, yani her kümenin meydana gelme olasılığıyla izleyen bir değişken olarak görülebilir. Problemimizi Bayesçi bir şekilde ele aldığımıza göre, p parametresini sabit bilinmeyen bir vektör olarak ele almıyoruz. Bunun yerine, P'nin hiperparametreler α / k ile parametreleştirilen Dirichlet'i takip ettiğini varsayıyoruz.

5. Sonsuz k kümeleriyle çalışmak

Önceki karışım modeli, denetimsiz öğrenme gerçekleştirmemize izin verir, Bayesci bir yaklaşımı izler ve hiyerarşik bir yapıya sahip olacak şekilde genişletilebilir. Yine de sonlu bir modeldir çünkü sabit bir önceden tanımlanmış k sayıda küme kullanır. Sonuç olarak, Küme Analizi gerçekleştirmeden önce bileşen sayısını tanımlamamızı gerektirir ve çoğu uygulamada daha önce tartıştığımız gibi bu bilinmemektedir ve kolayca tahmin edilemez.

Bunu çözmenin bir yolu, k'nin sonsuzluk eğilimi gösteren çok büyük bir değere sahip olduğunu hayal etmektir. Başka bir deyişle, k sonsuzluk eğilimi gösterdiğinde bu modelin sınırını hayal edebiliriz. Bu durumda, k kümelerinin sayısının sonsuz olmasına rağmen, aktif olan gerçek küme sayısının (en az bir gözlemi olanların) n'den büyük olamayacağını görebiliriz ( veri setimizdeki toplam gözlem sayısı). Aslında daha sonra göreceğimiz gibi, aktif küme sayısı n'den önemli ölçüde daha az olacak ve orantılı olacaktır. ![]() .

.

Elbette k sınırını sonsuza götürmek önemsiz değildir. Böyle bir sınır almanın mümkün olup olmadığı, bu modelin nasıl görüneceği ve nasıl inşa edebiliriz ve böyle bir model kullanın.

Bir sonraki makalede tam olarak şu sorulara odaklanacağız: Dirichlet Sürecini tanımlayacağız, DP'nin çeşitli temsillerini sunacağız ve son olarak bir Dirichlet Süreci oluşturmanın sezgisel ve verimli bir yolu olan Çin Restoran Süreci üzerine odaklanacağız.

Umarım bu yazıyı faydalı bulmuşsunuzdur. Yaptıysanız, lütfen makaleyi Facebook ve Twitter'da paylaşmak için bir dakikanızı ayırın. 🙂

- AI

- yapay zeka

- AI sanat üreteci

- yapay zeka robotu

- yapay zeka

- yapay zeka sertifikası

- yapay zeka robotu

- yapay zeka robotları

- yapay zeka yazılımı

- blockchain

- blockchain konferans ai

- zeka

- konuşma yapay zekası

- kripto konferans ai

- dal-e

- Veri kutusu

- derin öğrenme

- google ai

- makine öğrenme

- Makine Öğrenimi ve İstatistikler

- Platon

- plato yapay zekası

- Plato Veri Zekası

- Plato Oyunu

- PlatoVeri

- plato oyunu

- ölçek ai

- sözdizimi

- zefirnet