Я великий шанувальник подорожей Ентоні Бурдена Частини невідомі. У кожному епізоді шеф-кухар відвідує віддалені села по всьому світу, документуючи життя, їжу та культуру місцевих племен з відкритим серцем і розумом.

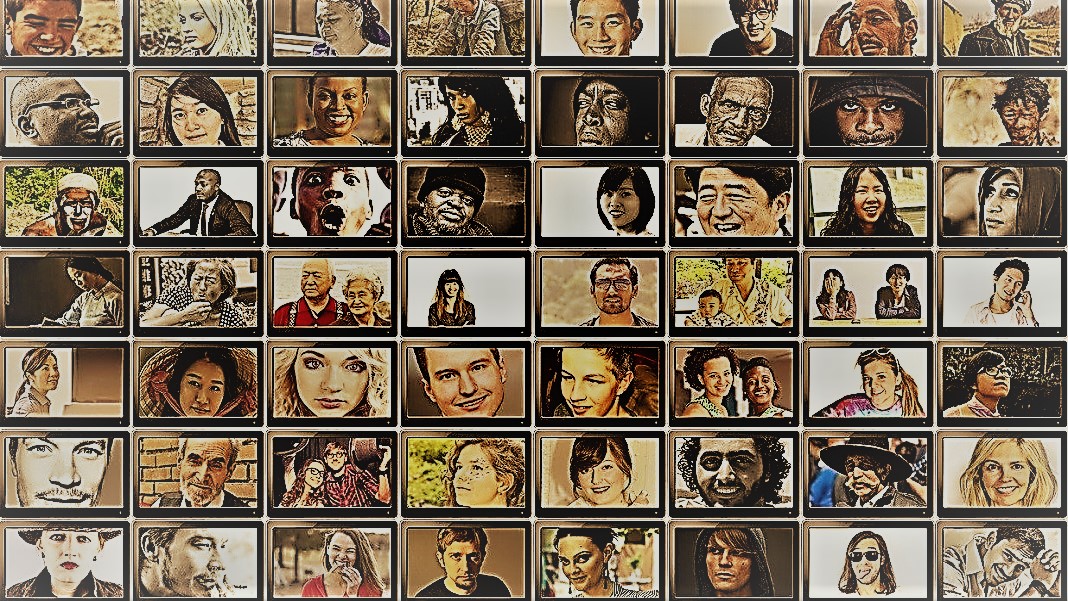

Шоу дозволяє зазирнути в дивовижне розмаїття людства. Соціологи мають схожу мету — зрозуміти поведінку різних людей, груп і культур, — але використовують різноманітні методи в контрольованих ситуаціях. Для обох зірками цих пошуків є суб’єкти: люди.

Але що, якби ви замінили людей чат-ботами зі штучним інтелектом?

Ідея звучить абсурдно. Проте завдяки появі ChatGPT та інших великих мовних моделей (LLM) соціологи заграють з ідеєю використовувати ці інструменти для швидкого створення різноманітних груп «імітованих людей» і проведення експериментів, щоб перевірити їх поведінку та цінності як проксі їхні біологічні аналоги.

Якщо ви уявляєте собі цифровий відтворений людський розум, це не те. Ідея полягає в тому, щоб скористатися досвідом ChatGPT щодо імітації людських реакцій. Оскільки моделі збирають величезну кількість онлайн-даних — блоги, коментарі на Youtube, фанфіки, книги — вони легко вловлюють зв’язки між словами багатьма мовами. Ці складні алгоритми також можуть розшифровувати нюанси мови, такі як іронія, сарказм, метафори та емоційні тони, критичний аспект людського спілкування в кожній культурі. Ці сильні сторони налаштовують LLM на імітацію кількох синтетичних особистостей із широким діапазоном переконань.

Ще один бонус? Порівняно з людьми-учасниками, ChatGPT та інші LLM не втомлюються, дозволяючи вченим збирати дані та перевіряти теорії про людську поведінку з безпрецедентною швидкістю.

Ідея, хоч і суперечлива, але вже має підтримку. Нещодавня стаття Перегляд поля, що зароджується, виявив, що в певних ретельно розроблених сценаріях відповіді ChatGPT корелювали з відповідями приблизно 95 відсотків учасників-людей.

ШІ «може змінити гру для соціальних наукових досліджень», сказав Доктор Ігор Гроссман з Університету Ватерлоо, який разом із колегами нещодавно написав статтю про перспективу в наука. Ключ для використання Homo silicus в дослідженнях? Ретельне управління упередженням і точність даних, сказала команда.

Дослідження людського суспільного розуму

Що таке соціальна наука?

Простіше кажучи, це вивчення того, як люди — як окремі особи чи як група — поводяться за різних обставин, як вони взаємодіють один з одним і розвиваються як культура. Це парасолька академічного пошуку з кількома галузями: економіка, політологія, антропологія та психологія.

Дисципліна розглядає широкий спектр тем, що є значущими в поточному духу часу. Який вплив соціальних мереж на психічне здоров’я? Яке зараз ставлення громадськості до зміни клімату в міру збільшення епізодів суворої погоди? Як різні культури цінують методи спілкування і що викликає непорозуміння?

Соціологічне дослідження починається із запитання та гіпотези. Одне з моїх улюблених: чи культури по-різному сприймають запах тіла? (Без жартів, Тема вивчено зовсім небагато, і так, є різниця!)

Потім вчені використовують різноманітні методи, як-от анкети, поведінкові тести, спостереження та моделювання, щоб перевірити свої ідеї. Опитування є особливо популярним інструментом, тому що питання можуть бути строго розроблені та перевірені та легко охопити широке коло людей, якщо розповсюджувати їх онлайн. Потім вчені аналізують письмові відповіді та дають зрозуміти поведінку людей. Іншими словами, використання мови учасником є критичним для цих досліджень.

Отже, як ChatGPT підходить?

«Homo Silicus»

Для Гроссмана магістерські програми, що стоять за такими чат-ботами, як ChatGPT або Google Bard, представляють безпрецедентну можливість переробити експерименти з соціальних наук.

Оскільки вони навчаються на величезних наборах даних, LLM «можуть представляти широкий спектр людського досвіду та перспектив», — кажуть автори. Оскільки моделі вільно «кочують» без кордонів по Інтернету, як люди, які часто подорожують за кордон, вони можуть приймати та демонструвати ширший діапазон відповідей порівняно з залученими людьми.

ChatGPT також не піддається впливу інших учасників дослідження та не втомлюється, що потенційно дозволяє йому генерувати менш упереджені відповіді. Ці риси можуть бути особливо корисні в «проектах високого ризику» — наприклад, імітація відповідей людей, які живуть у країнах, у яких ведеться війна, або під складними режимами, через дописи в соціальних мережах. У свою чергу, відповіді можуть інформувати про втручання в реальному світі.

Подібним чином магістри права, які пройшли підготовку з культурних гарячих тем, таких як гендерна ідентичність або дезінформація, можуть відтворювати різні теоретичні чи ідеологічні школи думки для формування політики. Замість ретельного опитування сотень тисяч учасників-людей ШІ може швидко генерувати відповіді на основі онлайн-дискурсу.

Окрім можливого використання в реальному житті, LLM також можуть діяти як цифрові суб’єкти, які взаємодіють із людьми, учасниками соціальних наукових експериментів, дещо подібно до неігрових персонажів (NPC) у відеоіграх. Наприклад, магістр права може прийняти різні «особистості» та взаємодіяти з людьми-волонтерами по всьому світу онлайн, використовуючи текст, ставлячи їм те саме запитання. Оскільки алгоритми не сплять, він може працювати 24/7. Отримані дані можуть потім допомогти вченим дослідити, як різні культури оцінюють подібну інформацію та як поширюються думки та дезінформація.

Baby Steps

Ідея використання чат-ботів замість людей у дослідженнях ще не є основною.

Але є перші докази того, що це може спрацювати. А допринтне дослідження опублікований цього місяця від Georgia Tech, Microsoft Research і Olin College, виявив, що LLM відтворює людські реакції в численних класичних психологічних експериментах, у тому числі сумнозвісному Шокові експерименти Мілграма.

Але залишається критичне питання: наскільки добре ці моделі справді можуть відобразити реакцію людини?

Є кілька каменів спотикання.

По-перше, це якість алгоритму та навчальних даних. У більшості онлайн-контенту домінує лише кілька мов. Магістр права, який навчався на цих даних, може легко імітувати настрої, погляди чи навіть моральне судження людей, які використовують ці мови, у свою чергу успадковуючи упередженість від навчальних даних.

«Це упереджене відтворення викликає серйозне занепокоєння, оскільки воно може посилити ті розбіжності, які соціологи прагнуть виявити у своїх дослідженнях», — сказав Гроссман.

Деякі вчені також стурбовані тим, що магістратури є справедливими зригування що їм сказали. Це антипод соціального наукового дослідження, головна мета якого — охопити людство у всій його різноманітній і складній красі. З іншого боку, ChatGPT і подібні моделі, як відомо, "галюцинація”, вигадуючи інформацію, яка звучить правдоподібно, але є неправдивою.

Наразі «великі мовні моделі покладаються на «тіні» людського досвіду», — сказав Гроссман. Оскільки ці системи штучного інтелекту здебільшого є чорними скриньками, важко зрозуміти, як і чому вони генерують певні відповіді — дещо тривожно, якщо використовувати їх як проксі-людей у поведінкових експериментах.

Незважаючи на обмеження, «LLM дозволяють соціологам відійти від традиційних методів дослідження та підійти до своєї роботи інноваційними способами», — кажуть автори. Як перший крок, Homo silicus може допомогти провести мозковий штурм і швидко перевірити гіпотези, а багатообіцяючі з них будуть перевірені на людях.

Але для того, щоб соціальні науки дійсно вітали ШІ, потрібна буде прозорість, справедливість і рівний доступ до цих потужних систем. Навчання LLM складно і дорого, оскільки новітні моделі все частіше закриваються за солідними системами оплати.

«Ми повинні гарантувати, що LLM із соціальних наук, як і всі наукові моделі, мають відкритий вихідний код, тобто їхні алгоритми та, в ідеалі, дані, доступні для всіх для ретельного вивчення, тестування та модифікації», сказав автор дослідження доктор Доун Паркер з Університету Ватерлоо. «Тільки зберігаючи прозорість і здатність відтворюватися, ми можемо гарантувати, що соціальні наукові дослідження за допомогою штучного інтелекту справді сприятимуть нашому розумінню людського досвіду».

Зображення Фото: Герд Альтман / Pixabay

- Розповсюдження контенту та PR на основі SEO. Отримайте посилення сьогодні.

- PlatoData.Network Vertical Generative Ai. Додайте собі сили. Доступ тут.

- PlatoAiStream. Web3 Intelligence. Розширення знань. Доступ тут.

- ПлатонЕСГ. Автомобільні / електромобілі, вуглець, CleanTech, Енергія, Навколишнє середовище, Сонячна, Поводження з відходами. Доступ тут.

- BlockOffsets. Модернізація екологічної компенсаційної власності. Доступ тут.

- джерело: https://singularityhub.com/2023/07/25/chatgpt-is-replacing-humans-in-studies-on-human-behavior-and-its-working-surprisingly-well/

- : має

- :є

- : ні

- $UP

- 23

- a

- МЕНЮ

- академічний

- доступ

- через

- Діяти

- прийняти

- прихід

- AI

- алгоритм

- алгоритми

- ВСІ

- дозволяти

- Дозволити

- вже

- Також

- суми

- an

- аналізувати

- та

- Ентоні

- підхід

- ЕСТЬ

- Арізона

- масив

- стаття

- AS

- зовнішній вигляд

- аспекти

- At

- автор

- authors

- доступний

- заснований

- BE

- Краса

- оскільки

- було

- поведінка

- за

- буття

- переконанням

- між

- зміщення

- упереджений

- Біт

- Black

- блоки

- тіло

- бонус

- кордону

- обидва

- коробки

- мозковий штурм

- гілки

- Перерва

- але

- by

- CAN

- захоплення

- обережний

- певний

- зміна

- символи

- chatbots

- ChatGPT

- обставин

- клімат

- Зміна клімату

- колеги

- збирати

- коледж

- коментарі

- Комунікація

- порівняний

- комплекс

- Занепокоєння

- будувати

- зміст

- сприяє

- контроль

- спірний

- може

- країни

- кредит

- критичний

- критичний аспект

- культурний

- культура

- Поточний

- дані

- набори даних

- призначений

- розвивати

- різний

- важкий

- цифровий

- в цифровому вигляді

- дисплей

- розподілений

- Різне

- різноманітність

- do

- робить

- Ні

- Не знаю

- dr

- малювати

- кожен

- Рано

- легко

- Економіка

- величезний

- забезпечувати

- епізод

- рівним

- особливо

- оцінювати

- Навіть

- Кожен

- точно

- приклад

- дорогий

- досвід

- Досліди

- Експерименти

- експертиза

- дослідити

- справедливість

- false

- вентилятор

- Художня література

- вірність

- поле

- Перший

- відповідати

- продукти

- для

- знайдений

- від

- далі

- гра

- Games

- Стать

- породжувати

- Грузія

- отримати

- Проблиск

- земну кулю

- Google,

- Групи

- рука

- жменя

- Мати

- здоров'я

- Серце

- допомога

- ГАРЯЧА

- Як

- HTML

- HTTP

- HTTPS

- величезний

- людина

- Людський досвід

- Людство

- Людей

- Сотні

- ідея

- в ідеалі

- ідеї

- Особистість

- if

- Impact

- in

- В інших

- У тому числі

- Augmenter

- все більше і більше

- осіб

- ганебний

- під впливом

- повідомити

- інформація

- інноваційний

- розуміння

- взаємодіяти

- в

- іронія

- IT

- ЙОГО

- JPG

- просто

- ключ

- відомий

- мова

- мови

- великий

- в значній мірі

- менше

- як

- недоліки

- Місце проживання

- життя

- LLM

- головний

- Mainstream

- Підтримка

- основний

- Робить

- управління

- масивний

- Може..

- сенс

- Медіа

- члени

- психічний

- Психічне здоров'я

- методика

- Microsoft

- mind

- умів

- Дезінформація

- моделювання

- Моделі

- змінювати

- місяць

- моральний

- найбільш

- множинний

- повинен

- my

- зародження

- Необхідність

- немає

- зараз

- численний

- of

- часто

- on

- ONE

- ті,

- онлайн

- відкрити

- з відкритим вихідним кодом

- Можливість

- or

- Інше

- наші

- Учасники

- Люди

- відсотків

- Особистості

- перспектива

- перспективи

- plato

- Інформація про дані Платона

- PlatoData

- правдоподібний

- точка

- Політика

- політичний

- популярний

- популяції

- Пости

- потенційно

- потужний

- зонд

- видатний

- перспективний

- доказ

- забезпечує

- повноваження

- Психологія

- громадськість

- переслідування

- якість

- питання

- питань

- діапазон

- швидко

- швидше

- досягати

- Реальний світ

- насправді

- останній

- нещодавно

- переконструювати

- режими

- регіональний

- Відносини

- випущений

- покладатися

- залишається

- віддалений

- замінити

- відтворюваність

- тиражувати

- представляти

- відтворення

- дослідження

- відповідь

- відповіді

- в результаті

- грубо

- прогін

- Зазначений

- то ж

- сценарії

- Школи

- наука

- НАУКИ

- науковий

- Вчені

- настрій

- комплект

- кілька

- важкий

- Показувати

- аналогічний

- просто

- ситуацій

- сон

- соціальна

- соціальні медіа

- Повідомлення в соціальних мережах

- суспільний

- кілька

- складний

- швидкість

- Зірки

- починається

- Крок

- сильні сторони

- прагнути

- Дослідження

- Вивчення

- вивчення

- каменем

- такі

- підтримка

- синтетичний

- Systems

- снасті

- Кран

- команда

- технології

- тест

- Тести

- ніж

- Дякую

- Що

- Команда

- їх

- Їх

- потім

- теоретичний

- Там.

- Ці

- вони

- це

- ті

- хоча?

- думка

- тисячі

- через

- втомлений

- до

- інструмент

- інструменти

- теми

- до

- традиційний

- поїзд

- навчений

- Навчання

- прозорість

- подорожувати

- тривожний

- по-справжньому

- ПЕРЕГЛЯД

- парасолька

- розкрити

- при

- розуміти

- розуміння

- університет

- безпрецедентний

- використання

- використовує

- використання

- підтверджено

- значення

- Цінності

- різноманітність

- величезний

- дуже

- перевірено

- Відео

- відеоігри

- Відвідувань

- добровольці

- війна

- способи

- we

- погода

- ласкаво просимо

- ДОБРЕ

- Що

- коли

- який

- ВООЗ

- чому

- широкий

- Широкий діапазон

- ширше

- Вікіпедія

- волі

- з

- без

- слова

- Work

- працює

- турбуватися

- письмовий

- так

- ще

- Ти

- YouTube

- zeitgeist

- зефірнет