Клієнти сфери охорони здоров’я та наук про життя (HCLS) використовують генеративний штучний інтелект як інструмент, щоб отримати більше від своїх даних. Варіанти використання включають резюмування документа, щоб допомогти читачам зосередитися на ключових моментах документа, і перетворення неструктурованого тексту в стандартизовані формати для виділення важливих атрибутів. Завдяки унікальним форматам даних і суворим нормативним вимогам клієнти шукають вибір для вибору найефективнішої та економічно ефективної моделі, а також можливості виконувати необхідні налаштування (точне налаштування) відповідно до свого бізнес-випадку використання. У цій публікації ми ознайомимо вас із розгортанням великої мовної моделі (LLM) Falcon Amazon SageMaker JumpStart і використання моделі для узагальнення довгих документів за допомогою LangChain і Python.

Огляд рішення

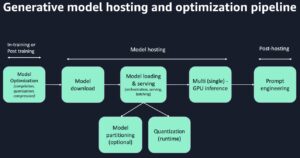

Amazon SageMaker базується на двадцятилітньому досвіді Amazon у розробці реальних додатків ML, включаючи рекомендації продуктів, персоналізацію, інтелектуальні покупки, робототехніку та пристрої з голосовою підтримкою. SageMaker — це керована служба, яка відповідає вимогам HIPAA і надає інструменти, які дають змогу дослідникам обробки даних, інженерам ML і бізнес-аналітикам впроваджувати інновації в ML. У SageMaker є Студія Amazon SageMaker, інтегроване середовище розробки (IDE), спеціально створене для спільних робочих процесів ML, яке, у свою чергу, містить широкий спектр рішень для швидкого запуску та попередньо навчених моделей ML в інтегрованому центрі під назвою SageMaker JumpStart. За допомогою SageMaker JumpStart ви можете використовувати попередньо навчені моделі, такі як Falcon LLM, із попередньо зібраними зразками блокнотів і підтримкою SDK, щоб експериментувати та розгортати ці потужні моделі трансформаторів. Ви можете використовувати SageMaker Studio та SageMaker JumpStart для розгортання та запиту власної генеративної моделі у своєму обліковому записі AWS.

Ви також можете переконатися, що дані корисного навантаження не залишають ваш VPC. Ви можете створити моделі як кінцеві точки з одним клієнтом і розгорнути їх із мережевою ізоляцією. Крім того, ви можете керувати вибраним набором моделей, які відповідають вашим власним вимогам безпеки, використовуючи можливості приватного концентратора моделей у SageMaker JumpStart і зберігаючи там затверджені моделі. SageMaker доступний для HIPAA BAA, SOC123 та HITRUST CSF.

Команда Falcon LLM це велика мовна модель, навчена дослідниками Інституту технологічних інновацій (TII) на понад 1 трильйоні токенів за допомогою AWS. Falcon має багато різних варіацій, з двома основними складовими Falcon 40B і Falcon 7B, які складаються з 40 мільярдів і 7 мільярдів параметрів відповідно, з точно налаштованими версіями, навченими для конкретних завдань, наприклад, виконання інструкцій. Falcon добре виконує різноманітні завдання, зокрема підсумовування тексту, аналіз настроїв, відповіді на запитання та розмову. У цьому дописі наведено покрокове керівництво, за яким ви можете розгорнути Falcon LLM у своєму обліковому записі AWS, використовуючи керований екземпляр блокнота через SageMaker JumpStart для експериментів із узагальненням тексту.

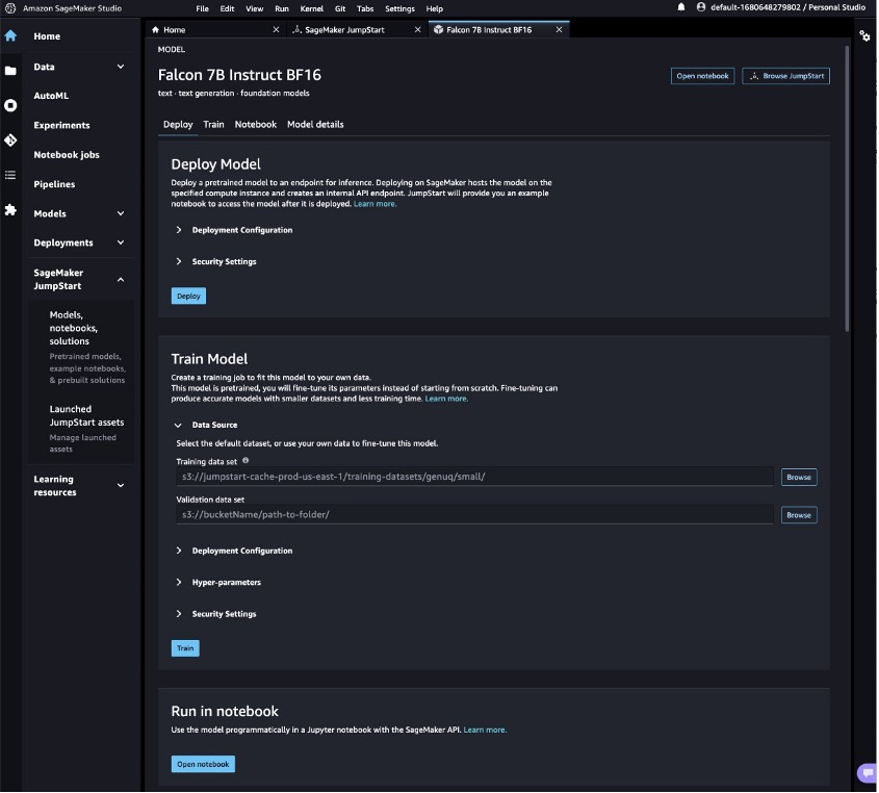

Модельний центр SageMaker JumpStart містить повні блокноти для розгортання та запиту кожної моделі. На момент написання цієї статті в центрі моделей SageMaker JumpStart доступно шість версій Falcon: Falcon 40B Instruct BF16, Falcon 40B BF16, Falcon 180B BF16, Falcon 180B Chat BF16, Falcon 7B Instruct BF16 і Falcon 7B BF16. У цій публікації використовується модель Falcon 7B Instruct.

У наступних розділах ми покажемо, як розпочати підсумовування документів, розгорнувши Falcon 7B на SageMaker Jumpstart.

Передумови

Для цього підручника вам знадобиться обліковий запис AWS із доменом SageMaker. Якщо у вас ще немає домену SageMaker, зверніться до На борту до домену Amazon SageMaker створити його.

Розгорніть Falcon 7B за допомогою SageMaker JumpStart

Щоб розгорнути модель, виконайте такі дії:

- Перейдіть до свого середовища SageMaker Studio з консолі SageMaker.

- У IDE, під SageMaker JumpStart на панелі навігації виберіть Макети, зошити, рішення.

- Розгорніть модель Falcon 7B Instruct на кінцевій точці для висновку.

Це відкриє картку моделі для моделі Falcon 7B Instruct BF16. На цій сторінці ви можете знайти Розгортання or поїзд параметри, а також посилання для відкриття зразків блокнотів у SageMaker Studio. У цьому дописі буде використано зразок блокнота від SageMaker JumpStart для розгортання моделі.

- Вибирати Відкрийте блокнот.

- Запустіть перші чотири клітинки блокнота, щоб розгорнути кінцеву точку Falcon 7B Instruct.

Ви можете побачити свої розгорнуті моделі JumpStart на Запущені ресурси JumpStart стр.

- На панелі навігації під SageMaker Jumpstartвиберіть Запущені ресурси JumpStart.

- Виберіть Кінцеві точки моделі вкладку, щоб переглянути стан кінцевої точки.

Після розгортання кінцевої точки Falcon LLM ви готові запитувати модель.

Виконайте свій перший запит

Щоб запустити запит, виконайте такі кроки:

- на філе меню, виберіть Нові та ноутбук щоб відкрити новий блокнот.

Ви також можете завантажити заповнений зошит тут.

- Виберіть образ, ядро та тип екземпляра, коли буде запропоновано. Для цієї публікації ми вибрали образ Data Science 3.0, ядро Python 3 і екземпляр ml.t3.medium.

- Імпортуйте модулі Boto3 і JSON, ввівши такі два рядки в першу клітинку:

- прес Shift + Enter для запуску клітини.

- Далі ви можете визначити функцію, яка буде викликати вашу кінцеву точку. Ця функція приймає корисне навантаження словника та використовує його для виклику клієнта середовища виконання SageMaker. Потім він десеріалізує відповідь і друкує введений і згенерований текст.

Корисне навантаження включає підказку як вхідні дані разом із параметрами висновку, які будуть передані в модель.

- Ви можете використовувати ці параметри з підказкою, щоб налаштувати вихід моделі для вашого випадку використання:

Запит із підказкою підсумовування

У цьому дописі використовується зразок дослідницької роботи, щоб продемонструвати підведення підсумків. Приклад текстового файлу стосується автоматичного підсумовування тексту в біомедичній літературі. Виконайте наступні дії:

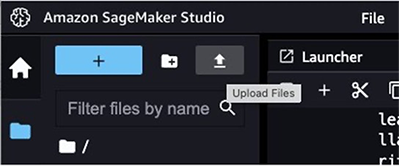

- Завантажити PDF і скопіюйте текст у файл під назвою

document.txt. - У SageMaker Studio виберіть піктограму завантаження та завантажте файл у свій екземпляр SageMaker Studio.

З коробки Falcon LLM підтримує резюмування тексту.

- Давайте створимо функцію, яка використовує швидкі інженерні методи для підсумовування

document.txt:

Ви помітите, що для довших документів з’являється помилка — Falcon, як і всі інші LLM, має обмеження на кількість токенів, що передаються як вхідні дані. Ми можемо обійти це обмеження, використовуючи розширені можливості підсумовування LangChain, які дозволяють передати LLM значно більший обсяг даних.

Імпортуйте та запустіть ланцюжок підсумовування

LangChain — це бібліотека програмного забезпечення з відкритим вихідним кодом, яка дозволяє розробникам і дослідникам обробки даних швидко створювати, налаштовувати та розгортати власні генеративні програми без керування складними взаємодіями машинного навчання, які зазвичай використовуються для абстрагування багатьох звичайних випадків використання генеративних мовних моделей ШІ всього за кілька рядки коду. Підтримка LangChain служб AWS включає підтримку кінцевих точок SageMaker.

LangChain надає доступний інтерфейс для LLM. Його функції включають інструменти для швидкого створення шаблонів і швидкого з’єднання. Ці ланцюжки можна використовувати для підсумовування текстових документів, які довші, ніж підтримує мовна модель, за один виклик. Ви можете використовувати стратегію скорочення карти, щоб узагальнювати довгі документи, розбиваючи їх на керовані фрагменти, підсумовуючи їх і об’єднуючи (і підсумовуючи знову, якщо потрібно).

- Давайте встановимо LangChain для початку:

- Імпортуйте відповідні модулі та розбийте довгий документ на частини:

- Щоб LangChain ефективно працював із Falcon, вам потрібно визначити стандартні класи обробки вмісту для дійсного введення та виведення:

- Ви можете визначити спеціальні підказки як

PromptTemplateоб’єкти, основний засіб для підказок за допомогою LangChain, для підходу до підсумовування за скороченням карти. Це необов’язковий крок, оскільки підказки зіставлення та об’єднання надаються за замовчуванням, якщо параметри виклику для завантаження ланцюжка підсумовування (load_summarize_chain) не визначені.

- LangChain підтримує LLM, розміщені на кінцевих точках висновку SageMaker, тому замість використання AWS Python SDK ви можете ініціалізувати з’єднання через LangChain для більшої доступності:

- Нарешті, ви можете завантажити ланцюжок підсумовування та запустити підсумок на вхідних документах за допомогою такого коду:

Тому що verbose для параметра встановлено значення True, ви побачите всі проміжні результати підходу зменшення карти. Це корисно для того, щоб стежити за послідовністю подій і отримати остаточний підсумок. За допомогою цього підходу до скорочення карти ви можете ефективно підсумовувати документи набагато довше, ніж зазвичай дозволяє максимальний ліміт вхідних маркерів моделі.

Прибирати

Після завершення використання кінцевої точки висновку важливо видалити її, щоб уникнути непотрібних витрат через такі рядки коду:

Використання інших моделей основи в SageMaker JumpStart

Використання інших моделей основи, доступних у SageMaker JumpStart для підсумовування документів, потребує мінімальних витрат на налаштування та розгортання. LLM іноді змінюються залежно від структури вхідних і вихідних форматів, і оскільки нові моделі та готові рішення додаються до SageMaker JumpStart, залежно від виконання завдання, вам, можливо, доведеться внести такі зміни в код:

- Якщо ви виконуєте підсумовування через

summarize()(метод без використання LangChain), вам, можливо, доведеться змінити структуру JSONpayloadпараметр, а також обробка змінної відповіді вquery_endpoint()функція - Якщо ви виконуєте підсумовування через LangChain

load_summarize_chain()вам, можливо, доведеться змінити методContentHandlerTextSummarizationкласу, зокремаtransform_input()таtransform_output()функції, щоб правильно обробляти корисне навантаження, яке очікує LLM, і результат, який LLM повертає

Основні моделі відрізняються не лише такими факторами, як швидкість і якість логічного висновку, але й форматами введення та виведення. Зверніться до відповідної інформаційної сторінки LLM щодо очікуваних вхідних і вихідних даних.

Висновок

Модель Falcon 7B Instruct доступна в центрі моделей SageMaker JumpStart і працює в кількох випадках використання. Ця публікація продемонструвала, як ви можете розгорнути власну кінцеву точку Falcon LLM у своєму середовищі за допомогою SageMaker JumpStart і провести свої перші експерименти в SageMaker Studio, що дозволить вам швидко створювати прототипи своїх моделей і плавно переходити до робочого середовища. За допомогою Falcon і LangChain ви можете ефективно підсумовувати великі документи з охорони здоров’я та наук про життя.

Додаткову інформацію про роботу з генеративним ШІ на AWS див Анонс нових інструментів для створення з Generative AI на AWS. Ви можете почати експериментувати та створювати підсумкові докази концепції документів для ваших додатків GenAI, орієнтованих на охорону здоров’я та життя, за допомогою методу, описаного в цій публікації. Коли Amazon Bedrock є загальнодоступним, ми опублікуємо додаткову публікацію, у якій буде показано, як можна запровадити узагальнення документів за допомогою Amazon Bedrock і LangChain.

Про авторів

Джон Кітаока є архітектором рішень в Amazon Web Services. Джон допомагає клієнтам розробляти й оптимізувати робочі навантаження AI/ML на AWS, щоб допомогти їм досягти своїх бізнес-цілей.

Джон Кітаока є архітектором рішень в Amazon Web Services. Джон допомагає клієнтам розробляти й оптимізувати робочі навантаження AI/ML на AWS, щоб допомогти їм досягти своїх бізнес-цілей.

Джош Фейстад є архітектором рішень в Amazon Web Services. Джош працює з клієнтами державного сектору над розробкою та впровадженням хмарних підходів для виконання бізнес-пріоритетів.

Джош Фейстад є архітектором рішень в Amazon Web Services. Джош працює з клієнтами державного сектору над розробкою та впровадженням хмарних підходів для виконання бізнес-пріоритетів.

- Розповсюдження контенту та PR на основі SEO. Отримайте посилення сьогодні.

- PlatoData.Network Vertical Generative Ai. Додайте собі сили. Доступ тут.

- PlatoAiStream. Web3 Intelligence. Розширення знань. Доступ тут.

- ПлатонЕСГ. вуглець, CleanTech, Енергія, Навколишнє середовище, Сонячна, Поводження з відходами. Доступ тут.

- PlatoHealth. Розвідка про біотехнології та клінічні випробування. Доступ тут.

- джерело: https://aws.amazon.com/blogs/machine-learning/create-an-hcls-document-summarization-application-with-falcon-using-amazon-sagemaker-jumpstart/

- : має

- :є

- : ні

- $UP

- 1

- 10

- 100

- 11

- 12

- 14

- 150

- 16

- 1M

- 20

- 40

- 400

- 50

- 500

- 7

- a

- здатність

- РЕЗЮМЕ

- Приймає

- доступність

- доступною

- рахунки

- Achieve

- доданий

- Прийняття

- знову

- AI

- AI / ML

- ВСІ

- дозволено

- Дозволити

- дозволяє

- пліч-о-пліч

- вже

- Також

- Amazon

- Amazon SageMaker

- Amazon SageMaker JumpStart

- Amazon Web Services

- an

- аналіз

- аналітики

- та

- тварина

- тварини

- додаток

- застосування

- підхід

- підходи

- затверджений

- ЕСТЬ

- навколо

- AS

- At

- Атрибути

- автоматичний

- доступний

- уникнути

- AWS

- заснований

- BE

- оскільки

- починати

- вважає,

- Мільярд

- біомедичні

- тіло

- сміливий

- Box

- Перерва

- Розрив

- будувати

- Створюємо

- побудований

- бізнес

- але

- by

- call

- званий

- CAN

- Може отримати

- можливості

- можливості

- карта

- випадок

- випадків

- Клітини

- ланцюг

- ланцюга

- зміна

- Зміни

- вибір

- Вибирати

- Вибираючи

- клас

- класів

- клієнт

- хмара

- код

- спільний

- об'єднувати

- об'єднання

- загальний

- зазвичай

- порівняний

- повний

- Зроблено

- комплекс

- У складі

- концепція

- лаконічний

- зв'язку

- Консоль

- містити

- зміст

- рентабельним

- витрати

- створювати

- виготовлений на замовлення

- Клієнти

- настройка

- дані

- наука про дані

- десятиліття

- дефолт

- визначати

- доставляти

- демонструвати

- продемонстрований

- Залежно

- розгортання

- розгорнути

- розгортання

- розгортання

- дизайн

- розробників

- розвивається

- розробка

- прилади

- різний

- do

- документ

- документація

- Ні

- домен

- Не знаю

- вниз

- скачати

- кожен

- земля

- фактично

- включіть

- Кінцева точка

- Машинобудування

- Інженери

- підвищена

- забезпечувати

- вхід

- Навколишнє середовище

- помилка

- Події

- приклад

- виконувати

- очікуваний

- чекає

- досвід

- експеримент

- Експерименти

- Face

- фактори

- false

- риси

- кілька

- філе

- остаточний

- знайти

- Перший

- відповідати

- Сфокусувати

- стежити

- після

- для

- фонд

- чотири

- від

- функція

- Функції

- Крім того

- в цілому

- породжувати

- генерується

- генеративний

- Генеративний ШІ

- отримати

- Цілі

- великий

- обробляти

- Обробка

- Мати

- охорона здоров'я

- допомога

- допомагає

- Виділіть

- відбувся

- Як

- How To

- HTML

- HTTPS

- Концентратор

- ICON

- if

- зображення

- здійснювати

- реалізація

- імпорт

- важливо

- in

- включати

- includes

- У тому числі

- інформація

- оновлювати

- інновація

- вхід

- витрати

- встановлювати

- екземпляр

- замість

- Інститут

- інструкції

- інтегрований

- Розумний

- Взаємодії

- інтерфейс

- в

- ізоляція

- IT

- ЙОГО

- Джон

- json

- просто

- ключ

- мова

- великий

- більше

- запущений

- Залишати

- бібліотека

- життя

- Life Sciences

- МЕЖА

- ліній

- зв'язку

- літератури

- LLM

- загрузка

- Довго

- довше

- шукати

- головний

- зробити

- управляти

- керований

- вдалося

- управління

- багато

- відображення

- максимальний

- Може..

- середа

- Меню

- метод

- мінімальний

- ML

- модель

- Моделі

- змінювати

- Модулі

- більше

- найбільш

- багато

- навігація

- необхідно

- Необхідність

- необхідний

- мережу

- Нові

- NIH

- нормально

- ноутбук

- Зверніть увагу..

- номер

- об'єкти

- of

- on

- ONE

- тільки

- відкрити

- з відкритим вихідним кодом

- Програмне забезпечення з відкритим кодом

- Оптимізувати

- Опції

- Інше

- викладені

- вихід

- над

- власний

- сторінка

- pane

- Папір

- параметр

- параметри

- Пройшов

- Виконувати

- виконанні

- виступає

- Втілення

- plato

- Інформація про дані Платона

- PlatoData

- точок

- пошта

- потужний

- друк

- друк

- приватний

- процес

- Product

- Production

- докази

- прототип

- забезпечувати

- за умови

- забезпечує

- забезпечення

- громадськість

- публікувати

- Python

- якість

- питання

- швидко

- швидко

- читачі

- готовий

- Реальний світ

- рекомендації

- послатися

- регуляторні

- доречний

- Вимога

- Вимагається

- дослідження

- Дослідники

- відповідно

- відповідь

- повертати

- робототехніка

- прогін

- мудрець

- Висновок SageMaker

- шкала

- наука

- НАУКИ

- Вчені

- сфера

- Sdk

- плавно

- розділам

- сектор

- безпеку

- побачити

- обраний

- SELF

- настрій

- Послідовність

- обслуговування

- Послуги

- комплект

- установка

- покупка

- Короткий

- Показувати

- один

- SIX

- So

- Софтвер

- Рішення

- конкретний

- конкретно

- швидкість

- старт

- почалася

- Статус

- Крок

- заходи

- зберігання

- Стратегія

- Strict

- структура

- студія

- такі

- підсумовувати

- РЕЗЮМЕ

- підтримка

- Опори

- приймає

- Завдання

- завдання

- методи

- Технологія

- Технологічні інновації

- текст

- ніж

- Що

- Команда

- їх

- Їх

- потім

- Там.

- Ці

- це

- через

- до

- разом

- знак

- Жетони

- інструмент

- інструменти

- навчений

- трансформатор

- перетворення

- перехід

- трильйон

- правда

- ПЕРЕГЛЯД

- підручник

- два

- тип

- невизначених

- створеного

- непотрібний

- Завантаження

- використання

- використання випадку

- використовуваний

- використовує

- використання

- змінна

- різноманітність

- автомобіль

- версії

- через

- вид

- ходити

- покрокове керівництво

- we

- Web

- веб-сервіси

- ДОБРЕ

- Що

- коли

- який

- широкий

- волі

- з

- в

- без

- Work

- Робочі процеси

- робочий

- працює

- запис

- лист

- Ти

- вашу

- зефірнет